Dit bericht is co-auteur met Jan Paul Assendorp, Thomas Lietzow, Christopher Masch, Alexander Meinert, Dr. Lars Palzer, Jan Schillemans van SIGNAL IDUNA.

Bij SIGNAL IDUNA, een grote Duitse verzekeraar, vinden we momenteel onszelf opnieuw uit met ons transformatieprogramma VISION2023 om nog klantgerichter te worden. Twee aspecten staan centraal bij deze transformatie: de reorganisatie van grote delen van het personeelsbestand in cross-functionele en agile teams en het worden van een echt datagedreven bedrijf. Hier is het motto "You build it, you run it" een belangrijke vereiste voor een multifunctioneel team dat een data- of machine learning-product (ML) bouwt. Dit legt strikte beperkingen op aan hoeveel werkteams kunnen uitgeven om een product te produceren en uit te voeren.

Dit bericht laat zien hoe SIGNAL IDUNA deze uitdaging aangaat en gebruik maakt van de AWS Cloud om cross-functionele teams in staat te stellen hun eigen ML-producten te bouwen en te operationaliseren. Daartoe introduceren we eerst de organisatiestructuur van agile teams, die de centrale eisen stelt aan de cloudinfrastructuur die wordt gebruikt om een product te ontwikkelen en te laten draaien. Vervolgens laten we zien hoe drie centrale teams bij SIGNAL IDUNA multifunctionele teams in staat stellen om met minimale hulp dataproducten te bouwen in de AWS Cloud, door een geschikte workflow en infrastructuuroplossingen te bieden die eenvoudig kunnen worden gebruikt en aangepast. Ten slotte herbekijken we onze aanpak en vergelijken deze met een meer klassieke aanpak waar ontwikkeling en exploitatie strikter gescheiden zijn.

Agile@SI – de basis van organisatieverandering

Sinds begin 2021 is SIGNAL IDUNA begonnen met het omzetten van zijn strategie Agile@SI in actie en het opzetten van agile methoden voor het ontwikkelen van klantgerichte oplossingen voor het hele bedrijf [1]. Eerdere taken en doelen worden nu uitgevoerd door multifunctionele teams, genaamd squads. Deze squads maken gebruik van agile methoden (zoals het Scrum-framework), nemen hun eigen beslissingen en bouwen klantgerichte producten. Doorgaans bevinden de squadrons zich in bedrijfsdivisies, zoals marketing, en veel hebben een sterke nadruk op het bouwen van gegevensgestuurde en ML-aangedreven producten. Typische use-cases in verzekeringen zijn bijvoorbeeld het voorspellen van klantverloop en productaanbeveling.

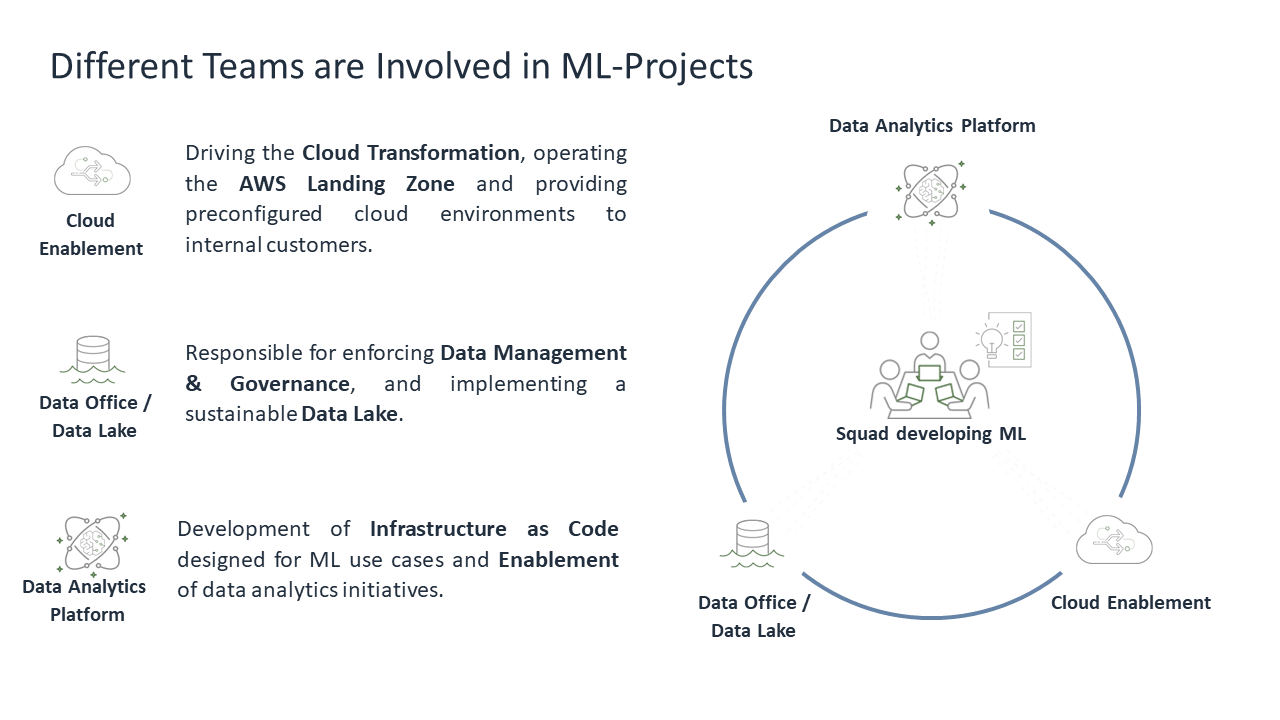

Vanwege de complexiteit van ML is het creëren van een ML-oplossing door één squadron een uitdaging en vereist daarom de samenwerking van verschillende squadrons.

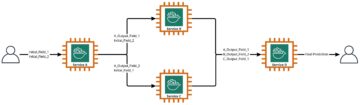

SIGNAL IDUNA heeft drie essentiële teams die het creëren van ML-oplossingen ondersteunen. Omringd door deze drie squads is het team dat verantwoordelijk is voor de ontwikkeling en de lange termijn exploitatie en van de ML-oplossing. Deze aanpak volgt het gedeelde verantwoordelijkheidsmodel van AWS [2].

In de afbeelding hierboven zijn alle squadrons in een overzicht weergegeven.

Cloud inschakelen

De onderliggende cloudinfrastructuur voor de hele organisatie wordt verzorgd door de squad Cloud Enablement. Het is hun taak om de teams in staat te stellen zelf producten te bouwen op cloudtechnologieën. Dit verbetert de time-to-market voor het op de markt brengen van nieuwe producten zoals ML, en het volgt het principe van "You build it, you run it".

Datakantoor/Datameer

Het verplaatsen van gegevens naar de cloud, evenals het vinden van de juiste dataset, wordt ondersteund door het squadron Data Office/Data Lake. Ze zetten een datacatalogus op die kan worden gebruikt om vereiste datasets te zoeken en te selecteren. Hun doel is om gegevenstransparantie en -beheer tot stand te brengen. Daarnaast zijn ze verantwoordelijk voor het opzetten en beheren van een Data Lake dat teams helpt om relevante gegevens te openen en te verwerken.

Platform voor gegevensanalyse

Ons team Data Analytics Platform (DAP) is een cloud- en ML-gericht team bij SIGNAL IDUNA dat bekwaam is in ML-engineering, data-engineering en datawetenschap. We stellen interne teams in staat om public cloud voor ML te gebruiken door infrastructuurcomponenten en kennis te leveren. Onze producten en diensten worden in de volgende sectie in detail gepresenteerd.

Cross-functionele teams inschakelen om ML-oplossingen te bouwen

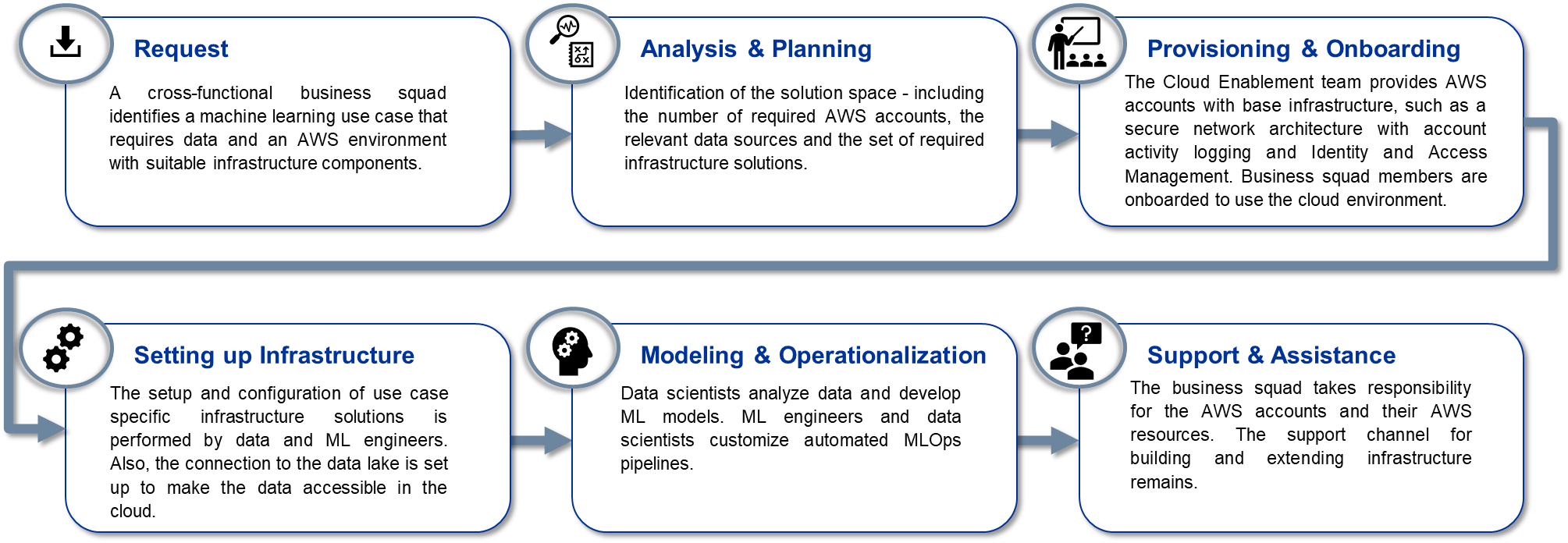

Om cross-functionele teams bij SIGNAL IDUNA in staat te stellen ML-oplossingen te bouwen, hebben we een snelle en veelzijdige manier nodig om herbruikbare cloudinfrastructuur te leveren, evenals een efficiënte workflow voor onboarding-teams om de cloudmogelijkheden te gebruiken.

Hiertoe hebben we een gestandaardiseerd onboarding- en ondersteuningsproces gecreëerd en modulaire infrastructuursjablonen geleverd als Infrastructure as Code (IaC). Deze sjablonen bevatten infrastructuurcomponenten die zijn ontworpen voor veelvoorkomende ML-gebruiksscenario's die eenvoudig kunnen worden aangepast aan de vereisten van een specifieke gebruikssituatie.

De workflow van het bouwen van ML-oplossingen

Er zijn drie belangrijke technische rollen betrokken bij het bouwen en exploiteren van ML-oplossingen: de datawetenschapper, ML-engineer en een data-engineer. Elke rol maakt deel uit van het multifunctionele team en heeft verschillende verantwoordelijkheden. De datawetenschapper beschikt over de vereiste domeinkennis van zowel functionele als technische vereisten van de use case. De ML-engineer is gespecialiseerd in het bouwen van geautomatiseerde ML-oplossingen en modelimplementatie. En de data engineer zorgt ervoor dat de data on-premises en binnen de cloud stroomt.

Het proces van het aanbieden van het platform is als volgt:

De infrastructuur van de specifieke use case wordt gedefinieerd in IaC en geversied in een centrale projectrepository. Dit omvat ook pijplijnen voor modeltraining en -implementatie, evenals andere aan datawetenschap gerelateerde code-artefacten. Datawetenschappers, ML-engineers en data-engineers hebben toegang tot de projectrepository en kunnen alle infrastructuurcode autonoom configureren en bijwerken. Hierdoor kan het team de infrastructuur indien nodig snel aanpassen. De ML-engineer kan echter altijd ondersteunen bij het ontwikkelen en updaten van infrastructuur of ML-modellen.

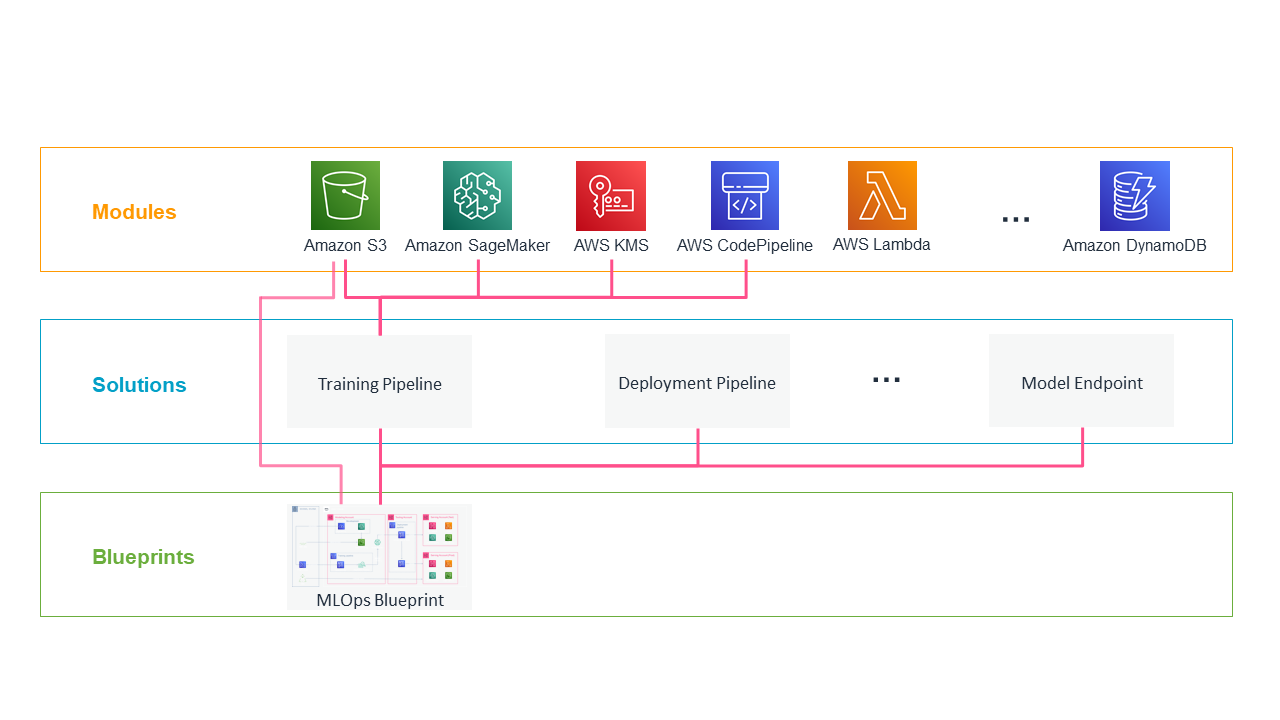

Herbruikbare en modulaire infrastructuurcomponenten

De hiërarchische en modulaire IaC-resources zijn geïmplementeerd in Terraform en omvatten infrastructuur voor algemene datawetenschap en ETL-gebruiksscenario's. Hierdoor kunnen we infrastructuurcode hergebruiken en het vereiste beveiligings- en nalevingsbeleid afdwingen, zoals het gebruik van AWS-sleutelbeheerservice (KMS)) encryptie voor gegevens, evenals het inkapselen van infrastructuur in Amazon virtuele privécloud (VPC) omgevingen zonder directe internettoegang.

De hiërarchische IaC-structuur is als volgt:

- Modules omvatten basis AWS-services met de vereiste configuratie voor beveiliging en toegangsbeheer. Dit omvat best practice-configuraties zoals het voorkomen van openbare toegang tot: Amazon eenvoudige opslagservice (S3) buckets, of het afdwingen van encryptie voor alle opgeslagen bestanden.

- In sommige gevallen hebt u verschillende services nodig om processen te automatiseren, zoals het implementeren van ML-modellen in verschillende fasen. Daarom hebben we gedefinieerd Oplossingen als een bundel van verschillende modules in een gezamenlijke configuratie voor verschillende soorten taken.

- Daarnaast bieden wij complete Blauwdrukken die oplossingen in verschillende omgevingen combineren om aan de vele potentiële behoeften van een project te voldoen. In onze MLOps-blauwdruk definiëren we een inzetbare infrastructuur voor training, levering en monitoring van ML-modellen die zijn geïntegreerd en gedistribueerd in AWS-accounts. We bespreken verdere details in de volgende sectie.

Deze producten worden door het DAP-team geversioneerd in een centrale repository. Hierdoor kunnen we onze IaC continu verbeteren en nieuwe functies van AWS overwegen, zoals: Amazon Sage Maker Modelregister. Elk squadron kan naar deze bronnen verwijzen, ze indien nodig parametriseren en ze uiteindelijk in hun eigen AWS-accounts implementeren.

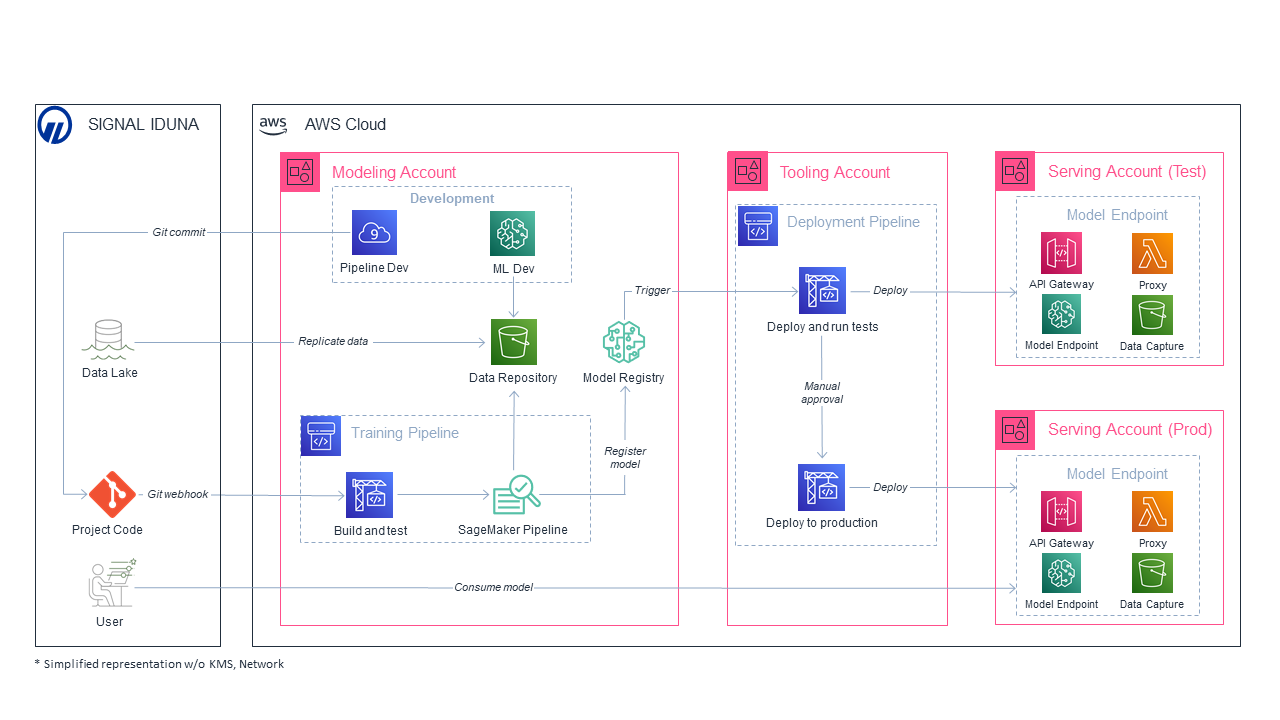

MLops-architectuur

We bieden een kant-en-klare blauwdruk met specifieke oplossingen voor het hele MLOps-proces. De blauwdruk bevat infrastructuur verdeeld over vier AWS-accounts voor het bouwen en implementeren van ML-modellen. Hierdoor kunnen we resources en workflows isoleren voor de verschillende stappen in het MLOps-proces. De volgende afbeelding toont de architectuur met meerdere accounts en we beschrijven hoe de verantwoordelijkheid voor specifieke stappen van het proces is verdeeld over de verschillende technische rollen.

De modellering account omvat diensten voor de ontwikkeling van ML-modellen. Ten eerste gebruikt de data-engineer een ETL-proces om relevante gegevens te leveren uit het SIGNAL IDUNA-datameer, de gecentraliseerde gateway voor gegevensgestuurde workflows in de AWS Cloud. Vervolgens kan de dataset door de datawetenschapper worden gebruikt om modelkandidaten te trainen en te evalueren. Eenmaal klaar voor uitgebreide experimenten, wordt een modelkandidaat door de ML-ingenieur geïntegreerd in een geautomatiseerde trainingspijplijn. We gebruiken Amazon SageMaker Pipelines om training, hyperparameterafstemming en modelevaluatie op schaal te automatiseren. Dit omvat ook modellijn en een gestandaardiseerd goedkeuringsmechanisme voor modellen die moeten worden gefaseerd voor implementatie in productie. Geautomatiseerde unit-tests en code-analyse zorgen voor kwaliteit en betrouwbaarheid van de code voor elke stap van de pijplijn, zoals gegevensvoorverwerking, modeltraining en evaluatie. Zodra een model is geëvalueerd en goedgekeurd, gebruiken we Amazon SageMaker ModelPackages als interface voor het getrainde model en relevante metagegevens.

De tooling account bevat geautomatiseerde CI/CD-pijplijnen met verschillende fasen voor het testen en inzetten van getrainde modellen. In de testfase worden modellen ingezet in de serveren-nonprod rekening. Hoewel de modelkwaliteit wordt geëvalueerd in de trainingspijplijn voordat het model in productie wordt genomen, voeren we hier prestatie- en integratietests uit in een geïsoleerde testomgeving. Na het passeren van de testfase worden modellen ingezet in de serveerstok account worden geïntegreerd in productieworkflows.

Door de fasen van de MLOps-workflow te scheiden in verschillende AWS-accounts, kunnen we ontwikkeling en testen isoleren van productie. Daarom kunnen we een strikt toegangs- en beveiligingsbeleid afdwingen. Bovendien zorgen op maat gemaakte IAM-rollen ervoor dat specifieke services alleen toegang hebben tot gegevens en andere services die nodig zijn voor de reikwijdte ervan, volgens de principe van het minste voorrecht. Services binnen de serveeromgevingen kunnen bovendien toegankelijk worden gemaakt voor externe bedrijfsprocessen. Een bedrijfsproces kan bijvoorbeeld een eindpunt in de serveer-prod-omgeving opvragen voor modelvoorspellingen.

Voordelen van onze aanpak

Dit proces heeft veel voordelen ten opzichte van een strikte scheiding van ontwikkeling en exploitatie voor zowel de ML-modellen als de benodigde infrastructuur:

- Isolatie: Elk team krijgt zijn eigen set AWS-accounts die volledig geïsoleerd zijn van de omgevingen van andere teams. Dit maakt het eenvoudig om toegangsrechten te beheren en de gegevens privé te houden voor degenen die ermee mogen werken.

- Cloud inschakelen: Teamleden met weinig ervaring in cloud DevOps (zoals veel datawetenschappers) kunnen gemakkelijk het hele proces van het ontwerpen en beheren van infrastructuur volgen, aangezien (bijna) niets voor hen verborgen blijft achter een centrale service. Dit zorgt voor een beter begrip van de infrastructuur, wat hen kan helpen om data science-producten efficiënter te maken.

- Product Eigendom: Het gebruik van vooraf geconfigureerde infrastructuuroplossingen en beheerde services houdt de drempel voor het beheren van een ML-product in productie zeer laag. Daarom kan een datawetenschapper gemakkelijk eigenaar worden van een model dat in productie wordt genomen. Dit minimaliseert het bekende risico dat een model na ontwikkeling niet in productie wordt genomen.

- Innovatie: Aangezien ML-ingenieurs al lang voordat een model in productie kan worden genomen, betrokken zijn, kunnen ze infrastructuuroplossingen creëren die geschikt zijn voor nieuwe gebruiksscenario's, terwijl de datawetenschappers een ML-model ontwikkelen.

- Aanpassingsvermogen: Aangezien de door DAP ontwikkelde IaC-oplossing vrij beschikbaar is, kan elk team deze gemakkelijk aanpassen aan een specifieke behoefte voor hun gebruik.

- Open source: Alle nieuwe infrastructuuroplossingen kunnen eenvoudig via de centrale DAP-coderepo beschikbaar worden gesteld voor gebruik door andere teams. In de loop van de tijd zal dit een rijke codebasis creëren met infrastructuurcomponenten die zijn afgestemd op verschillende gebruiksscenario's.

Samengevat

In dit bericht hebben we geïllustreerd hoe cross-functionele teams bij SIGNAL IDUNA in staat worden gesteld om ML-producten op AWS te bouwen en uit te voeren. Centraal in onze aanpak staat het gebruik van een speciale set AWS-accounts voor elk team in combinatie met op maat gemaakte IaC-blauwdrukken en oplossingen. Met deze twee componenten kan een multifunctioneel team een infrastructuur voor productiekwaliteit creëren en beheren. Op hun beurt kunnen ze volledig end-to-end eigenaar worden van hun ML-producten.

Verwijzen naar Amazon SageMaker Modelbouwpijpleidingen - Amazon SageMaker om meer te leren.

Vind meer informatie over ML op AWS op onze officiële pagina.

Referenties

[1] https://www.handelsblatt.com/finanzen/versicherungsbranche-vorbild-spotify-signal-iduna-wird-von-einer-handwerker-versicherung-zum-agilen-konzern/27381902.html

[2] https://blog.crisp.se/wp-content/uploads/2012/11/SpotifyScaling.pdf

[3] https://aws.amazon.com/compliance/shared-responsibility-model/

Over de auteurs

Jan Paul Assendorp is een ML-engineer met een sterke focus op datawetenschap. Hij bouwt ML-modellen en automatiseert modeltraining en de implementatie in productieomgevingen.

Jan Paul Assendorp is een ML-engineer met een sterke focus op datawetenschap. Hij bouwt ML-modellen en automatiseert modeltraining en de implementatie in productieomgevingen.

Thomas Lietzow is de Scrum Master van het team Data Analytics Platform.

Thomas Lietzow is de Scrum Master van het team Data Analytics Platform.

Christopher Mascho is de Product Owner van het team Data Analytics Platform met kennis van data engineering, data science en ML engineering.

Christopher Mascho is de Product Owner van het team Data Analytics Platform met kennis van data engineering, data science en ML engineering.

Alexander Meinert maakt deel uit van het Data Analytics Platform-team en werkt als ML-engineer. Begonnen met statistiek, gegroeid op data science projecten, passie gevonden voor ML methodes en architectuur.

Alexander Meinert maakt deel uit van het Data Analytics Platform-team en werkt als ML-engineer. Begonnen met statistiek, gegroeid op data science projecten, passie gevonden voor ML methodes en architectuur.

Dr Lars Palzer is een datawetenschapper en maakt deel uit van het Data Analytics Platform-team. Nadat hij heeft geholpen bij het bouwen van de MLOps-architectuurcomponenten, gebruikt hij ze nu om ML-producten te bouwen.

Dr Lars Palzer is een datawetenschapper en maakt deel uit van het Data Analytics Platform-team. Nadat hij heeft geholpen bij het bouwen van de MLOps-architectuurcomponenten, gebruikt hij ze nu om ML-producten te bouwen.

Jan Schillemans is een ML engineer met een software engineering achtergrond. Hij richt zich op het toepassen van best practices op het gebied van software engineering op ML-omgevingen (MLOps).

Jan Schillemans is een ML engineer met een software engineering achtergrond. Hij richt zich op het toepassen van best practices op het gebied van software engineering op ML-omgevingen (MLOps).

- Coinsmart. Europa's beste Bitcoin- en crypto-uitwisseling.

- Platoblockchain. Web3 Metaverse Intelligentie. Kennis versterkt. GRATIS TOEGANG.

- CryptoHawk. Altcoin-radar. Gratis proefversie.

- Bron: https://aws.amazon.com/blogs/machine-learning/how-signal-iduna-operationalizes-machine-learning-projects-on-aws/

- "

- 100

- 2021

- toegang

- Account

- over

- Actie

- voordelen

- behendig

- Alles

- Hoewel

- Amazone

- analyse

- analytics

- Het toepassen van

- nadering

- architectuur

- geautomatiseerde

- Beschikbaar

- AWS

- wezen

- BEST

- 'best practices'

- bouw

- Gebouw

- Bundel

- bedrijfsdeskundigen

- mogelijkheden

- gevallen

- uitdagen

- Cloud

- cloud infrastructuur

- code

- samenwerking

- combinatie van

- Gemeen

- afstand

- vergeleken

- nakoming

- Configuratie

- bevat

- Wij creëren

- gegevens

- gegevens Analytics

- data science

- data scientist

- toegewijd aan

- implementeren

- het inzetten

- inzet

- ontwerpen

- detail

- ontwikkelen

- ontwikkelde

- het ontwikkelen van

- Ontwikkeling

- anders

- bespreken

- verdeeld

- domein

- gemakkelijk

- encryptie

- Endpoint

- ingenieur

- Engineering

- Ingenieurs

- Milieu

- essentieel

- oprichten

- voorbeeld

- ervaring

- SNELLE

- Voordelen

- Figuur

- Tot slot

- Voornaam*

- Focus

- gericht

- volgend

- gevonden

- Foundation

- Achtergrond

- vol

- Doelen

- bestuur

- hulp

- helpt

- hier

- Hoe

- HTTPS

- beeld

- geïmplementeerd

- belangrijk

- verbeteren

- omvatten

- informatie

- Infrastructuur

- verzekering

- geïntegreerde

- integratie

- Interface

- Internet

- betrokken zijn

- IT

- sleutel

- kennis

- Groot

- LEARN

- leren

- Elke kleine stap levert grote resultaten op!

- lang

- machine

- machine learning

- management

- beheren

- Markt

- Marketing

- Match

- Leden

- meta

- ML

- model

- modellen

- modulaire

- Grensverkeer

- Nieuwe mogelijkheden

- nieuwe producten

- bieden

- officieel

- Onboarding

- werkzaam

- organisatie

- Overige

- eigenaar

- prestatie

- platform

- beleidsmaatregelen door te lezen.

- beleidsmaatregelen

- voorspelling

- Voorspellingen

- het voorkomen

- privaat

- processen

- Product

- productie

- Producten

- Programma

- project

- projecten

- zorgen voor

- publiek

- public cloud

- kwaliteit

- bewaarplaats

- nodig

- Voorwaarden

- Resources

- verantwoordelijk

- beoordelen

- Risico

- lopen

- Scale

- Wetenschap

- Wetenschapper

- wetenschappers

- Ontdek

- veiligheid

- service

- Diensten

- serveer-

- reeks

- gedeeld

- Eenvoudig

- Software

- software engineering

- Oplossingen

- specialiseert

- besteden

- Stadium

- begin

- gestart

- statistiek

- mediaopslag

- Strategie

- sterke

- Hierop volgend

- ondersteuning

- ondersteunde

- omgeven

- taken

- team

- Technisch

- Technologies

- proef

- Testen

- testen

- niet de tijd of

- Trainingen

- Transformatie

- Transparantie

- bijwerken

- us

- .

- gebruik maken van

- Virtueel

- Bekijk de introductievideo

- WIE

- binnen

- zonder

- Mijn werk

- Workforce

- Bedrijven