We hebben een neuraal netwerk met de naam Whisper getraind en open source gemaakt dat de robuustheid en nauwkeurigheid op menselijk niveau bij Engelse spraakherkenning benadert.

Bekijk code

Bekijk modelkaart

Fluistervoorbeelden:

Whisper is een automatisch spraakherkenningssysteem (ASR) dat is getraind op 680,000 uur aan meertalige en multitask-gesuperviseerde gegevens verzameld van internet. We laten zien dat het gebruik van zo'n grote en diverse dataset leidt tot verbeterde robuustheid voor accenten, achtergrondgeluiden en technische taal. Bovendien maakt het transcriptie in meerdere talen mogelijk, evenals vertaling van die talen naar het Engels. We zijn open-sourcing-modellen en inferentiecode om als basis te dienen voor het bouwen van nuttige toepassingen en voor verder onderzoek naar robuuste spraakverwerking.

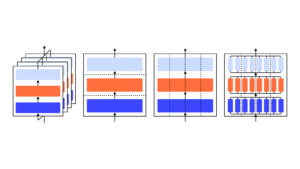

De Whisper-architectuur is een eenvoudige end-to-end-aanpak, geïmplementeerd als een encoder-decoder Transformer. Invoeraudio wordt opgesplitst in brokken van 30 seconden, omgezet in een log-Mel-spectrogram en vervolgens doorgegeven aan een encoder. Een decoder is getraind om het bijbehorende tekstbijschrift te voorspellen, vermengd met speciale tokens die het enkele model aansturen om taken uit te voeren zoals taalidentificatie, tijdstempels op zinsniveau, meertalige spraaktranscriptie en spraakvertaling naar het Engels.

Andere bestaande benaderingen gebruiken vaak kleinere, nauwer gekoppelde audio-tekst trainingsdatasets, of gebruik een brede maar niet-gecontroleerde audiovoortraining. Omdat Whisper is getraind op een grote en diverse dataset en niet is afgestemd op een specifieke dataset, overtreft het geen modellen die gespecialiseerd zijn in LibriSpeech-prestaties, een beroemde competitieve benchmark in spraakherkenning. Wanneer we echter de zero-shot-prestaties van Whisper in veel verschillende datasets meten, ontdekken we dat deze veel robuuster is en 50% minder fouten maakt dan die modellen.

Ongeveer een derde van Whisper's audiodataset is niet-Engels en krijgt afwisselend de taak om te transcriberen in de originele taal of te vertalen naar het Engels. We vinden dat deze aanpak bijzonder effectief is bij het leren van spraak-naar-tekstvertaling en beter presteert dan de begeleide SOTA op CoVoST2 naar Engelse vertaling zero-shot.

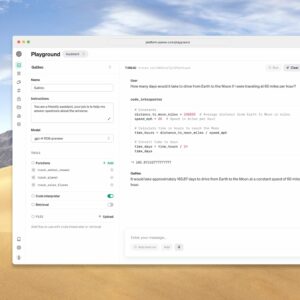

We hopen dat de hoge nauwkeurigheid en het gebruiksgemak van Whisper ontwikkelaars in staat zullen stellen spraakinterfaces toe te voegen aan een veel bredere reeks toepassingen. Bekijk de papier, model kaart en code voor meer details en om Whisper uit te proberen.

- AI

- ai kunst

- ai kunst generator

- je hebt een robot

- kunstmatige intelligentie

- certificering van kunstmatige intelligentie

- kunstmatige intelligentie in het bankwezen

- kunstmatige intelligentie robot

- kunstmatige intelligentie robots

- kunstmatige intelligentiesoftware

- blockchain

- blockchain conferentie ai

- vindingrijk

- conversatie kunstmatige intelligentie

- crypto conferentie ai

- van dall

- diepgaand leren

- google ai

- machine learning

- OpenAI

- Plato

- plato ai

- Plato gegevensintelligentie

- Plato-spel

- PlatoData

- platogamen

- onderzoek

- schaal ai

- syntaxis

- zephyrnet