Large Language Model (LLM)-agents zijn programma's die de mogelijkheden van zelfstandige LLM's uitbreiden met 1) toegang tot externe tools (API's, functies, webhooks, plug-ins, enzovoort), en 2) de mogelijkheid om taken zelf te plannen en uit te voeren -gerichte mode. Vaak moeten LLM's communiceren met andere software, databases of API's om complexe taken uit te voeren. Een administratieve chatbot die vergaderingen plant, heeft bijvoorbeeld toegang nodig tot de agenda's en e-mail van werknemers. Met toegang tot tools kunnen LLM-agenten krachtiger worden, ten koste van extra complexiteit.

In dit bericht introduceren we LLM-agenten en demonstreren we hoe u een LLM-agent voor e-commerce kunt bouwen en implementeren met behulp van Amazon SageMaker JumpStart en AWS Lambda. De agent zal tools gebruiken om nieuwe mogelijkheden te bieden, zoals het beantwoorden van vragen over retouren (“Is mijn retour rtn001 verwerkt?”) en het verstrekken van updates over bestellingen (“Kunt u mij vertellen of de bestelling 123456 is verscheept?"). Deze nieuwe mogelijkheden vereisen dat LLM's gegevens uit meerdere gegevensbronnen ophalen (orders, returns) en voer ophaal-augmented generatie (RAG) uit.

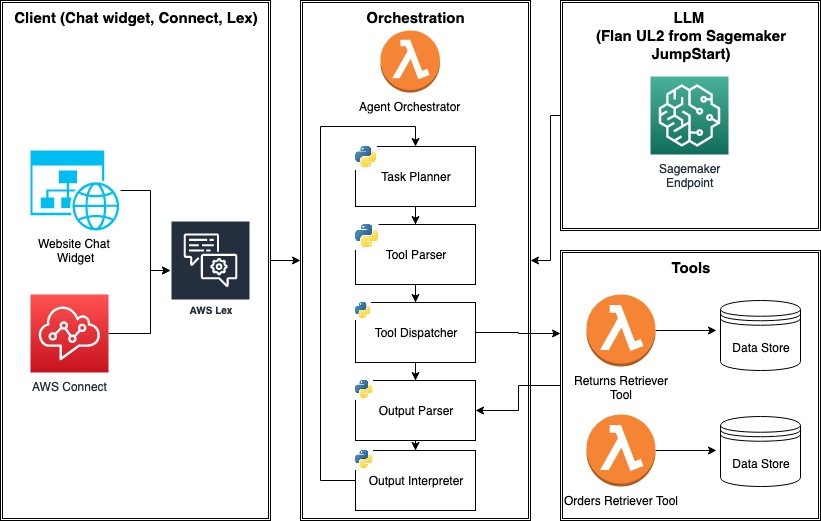

Om de LLM-agent van stroom te voorzien, gebruiken we a Flan-UL2 model ingezet als een SageMaker-eindpunt en gebruik tools voor het ophalen van gegevens die zijn gebouwd met AWS Lambda. De agent kan vervolgens worden geïntegreerd met Amazon-Lex en gebruikt als chatbot binnen websites of AWS-verbinding. We sluiten het bericht af met punten waarmee u rekening moet houden voordat u LLM-agenten in productie zet. Voor een volledig beheerde ervaring voor het bouwen van LLM-agenten biedt AWS ook de agenten voor Amazon Bedrock-functie (in preview).

Een kort overzicht van LLM-agentarchitecturen

LLM-agents zijn programma's die LLM's gebruiken om te beslissen wanneer en hoe ze tools moeten gebruiken als dat nodig is om complexe taken uit te voeren. Met hulpmiddelen en mogelijkheden voor taakplanning kunnen LLM-agenten communiceren met externe systemen en de traditionele beperkingen van LLM's overwinnen, zoals kennisbeperkingen, hallucinaties en onnauwkeurige berekeningen. Tools kunnen verschillende vormen aannemen, zoals API-aanroepen, Python-functies of op webhook gebaseerde plug-ins. Een LLM kan bijvoorbeeld een ‘ophaalplug-in’ gebruiken om relevante context op te halen en RAG uit te voeren.

Dus wat betekent het voor een LLM om tools te kiezen en taken te plannen? Er zijn talloze benaderingen (zoals Reageer, MRKL, Gereedschapsvormer, KnuffelenGPT en Transformator-agents) naar het gebruik van LLM's met tools, en de ontwikkelingen gaan snel. Maar een eenvoudige manier is om een LLM een lijst met tools te vragen en hem te vragen 1) te bepalen of een tool nodig is om aan de vraag van de gebruiker te voldoen, en zo ja, 2) de juiste tool te selecteren. Zo'n prompt ziet er doorgaans uit als in het volgende voorbeeld en kan enkele voorbeelden bevatten om de betrouwbaarheid van de LLM bij het kiezen van het juiste hulpmiddel te verbeteren.

Complexere benaderingen omvatten het gebruik van een gespecialiseerde LLM die direct “API-aanroepen” of “toolgebruik” kan decoderen, zoals GorillaLLM. Dergelijke verfijnde LLM's zijn getraind op datasets met API-specificaties om API-aanroepen te herkennen en te voorspellen op basis van instructies. Vaak hebben deze LLM's bepaalde metagegevens nodig over beschikbare tools (beschrijvingen, yaml of JSON-schema voor hun invoerparameters) om toolaanroepen uit te voeren. Deze aanpak wordt gevolgd door agenten voor Amazon Bedrock en OpenAI-functieaanroepen. Merk op dat LLM's over het algemeen voldoende groot en complex moeten zijn om het vermogen tot gereedschapsselectie aan te tonen.

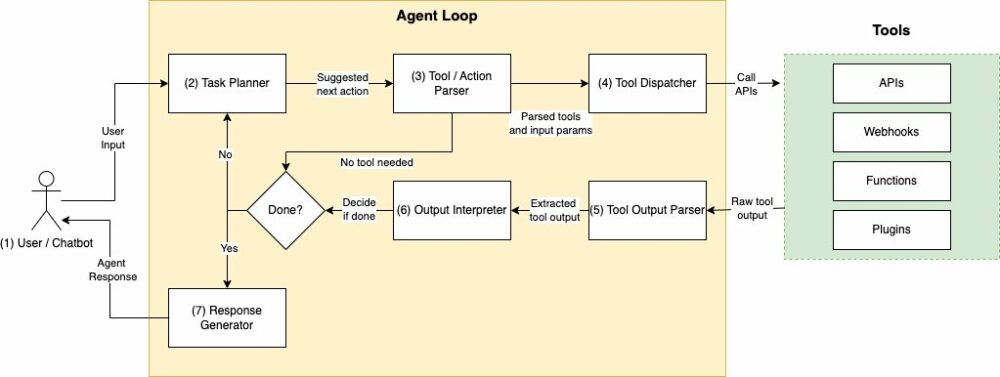

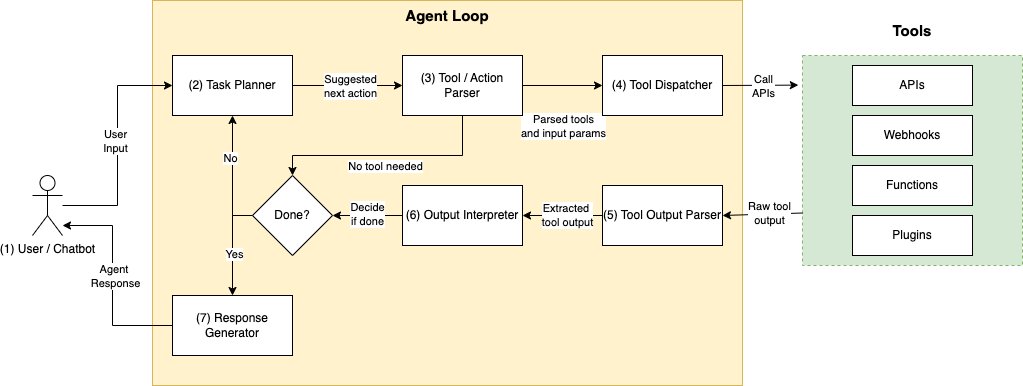

Ervan uitgaande dat mechanismen voor taakplanning en gereedschapsselectie worden gekozen, werkt een typisch LLM-agentprogramma in de volgende volgorde:

- Gebruikersverzoek – Het programma vereist gebruikersinvoer zoals “Waar is mijn bestelling

123456?” vanuit een bepaalde clienttoepassing. - Plan de volgende actie(s) en selecteer de tool(s) die u wilt gebruiken – Vervolgens gebruikt het programma een prompt om de LLM de volgende actie te laten genereren, bijvoorbeeld: “Zoek de ordertabel op met

OrdersAPI.” De LLM wordt gevraagd een toolnaam voor te stellen, zoalsOrdersAPIuit een vooraf gedefinieerde lijst met beschikbare tools en hun beschrijvingen. Als alternatief zou de LLM de opdracht kunnen krijgen om direct een API-oproep te genereren met invoerparameters zoalsOrdersAPI(12345).- Houd er rekening mee dat de volgende actie al dan niet het gebruik van een tool of API kan inhouden. Als dat niet het geval is, zou de LLM reageren op gebruikersinvoer zonder aanvullende context van tools op te nemen of eenvoudigweg een standaardantwoord retourneren, zoals: "Ik kan deze vraag niet beantwoorden."

- Parseertoolverzoek – Vervolgens moeten we de door de LLM voorgestelde tool/actievoorspelling ontleden en valideren. Validatie is nodig om ervoor te zorgen dat toolnamen, API's en aanvraagparameters niet worden gehallucineerd en dat de tools correct worden aangeroepen volgens de specificaties. Voor deze parsering is mogelijk een afzonderlijke LLM-aanroep vereist.

- Gereedschap aanroepen – Zodra geldige toolnaam(en) en parameter(s) zijn gegarandeerd, roepen we de tool aan. Dit kan een HTTP-verzoek, een functieaanroep, enzovoort zijn.

- Uitvoer parseren – Het antwoord van de tool heeft mogelijk aanvullende verwerking nodig. Een API-aanroep kan bijvoorbeeld resulteren in een lang JSON-antwoord, waarbij slechts een subset van velden van belang is voor de LLM. Door informatie in een schoon, gestandaardiseerd formaat te extraheren, kan de LLM het resultaat betrouwbaarder interpreteren.

- Uitvoer interpreteren – Gegeven de output van de tool wordt de LLM opnieuw gevraagd er wijs uit te worden en te beslissen of hij het definitieve antwoord aan de gebruiker kan teruggeven of dat er aanvullende acties nodig zijn.

- Beëindig of ga verder met stap 2 – Retourneer een definitief antwoord of een standaardantwoord in het geval van fouten of time-outs.

Verschillende agentframeworks voeren de vorige programmastroom anders uit. Bijvoorbeeld, Reageer combineert toolselectie en het genereren van definitieve antwoorden in één enkele prompt, in tegenstelling tot het gebruik van afzonderlijke prompts voor toolselectie en het genereren van antwoorden. Deze logica kan ook in één keer worden uitgevoerd of in een while-instructie (de “agentlus”), die eindigt wanneer het definitieve antwoord wordt gegenereerd, er een uitzondering wordt gegenereerd of er een time-out optreedt. Wat constant blijft, is dat agenten de LLM als middelpunt gebruiken om de planning en het aanroepen van tools te orkestreren totdat de taak is beëindigd. Vervolgens laten we zien hoe u een eenvoudige agentlus kunt implementeren met behulp van AWS-services.

Overzicht oplossingen

Voor deze blogpost implementeren we een LLM-agent voor e-commerceondersteuning die twee functionaliteiten biedt, mogelijk gemaakt door tools:

- Hulpprogramma voor het ophalen van de status – Beantwoord vragen over de status van retourzendingen, zoals: “Wat gebeurt er met mijn retourzending

rtn001? " - Hulpprogramma voor het ophalen van de bestelstatus – Volg de status van bestellingen, zoals: “Wat is de status van mijn bestelling

123456? "

De agent gebruikt de LLM effectief als queryrouter. Gegeven een vraag (“Wat is de status van de bestelling 123456?”), selecteert u de juiste ophaaltool om meerdere gegevensbronnen (dat wil zeggen retourzendingen en bestellingen) te doorzoeken. We realiseren queryroutering door de LLM te laten kiezen uit meerdere ophaaltools, die verantwoordelijk zijn voor de interactie met een gegevensbron en het ophalen van context. Dit breidt het eenvoudige RAG-patroon uit, dat uitgaat van één enkele gegevensbron.

Beide ophaaltools zijn Lambda-functies die een id (orderId or returnId) als invoer, haalt een JSON-object op uit de gegevensbron en converteert de JSON naar een mensvriendelijke representatiereeks die geschikt is om door LLM te worden gebruikt. De gegevensbron in een realistisch scenario zou een zeer schaalbare NoSQL-database kunnen zijn, zoals DynamoDB, maar deze oplossing maakt gebruik van eenvoudige Python Dict met voorbeeldgegevens voor demodoeleinden.

Er kunnen extra functionaliteiten aan de agent worden toegevoegd door ophaalhulpmiddelen toe te voegen en de aanwijzingen dienovereenkomstig aan te passen. Deze agent kan worden getest als een zelfstandige service die kan worden geïntegreerd met elke gebruikersinterface via HTTP, wat eenvoudig kan worden gedaan Amazon-Lex.

Hier volgen enkele aanvullende details over de belangrijkste componenten:

- LLM-eindpunt voor gevolgtrekking – De kern van een agentprogramma is een LLM. We zullen de SageMaker JumpStart Foundation-modelhub gebruiken om eenvoudig de

Flan-UL2model. SageMaker JumpStart maakt het eenvoudig om LLM-inferentie-eindpunten te implementeren op specifieke SageMaker instanties. - Agent-orkestrator – Agent Orchestrator orkestreert de interacties tussen de LLM, tools en de client-app. Voor onze oplossing gebruiken we een AWS Lambda-functie om deze stroom aan te sturen en gebruiken we de volgende functies als hulpfuncties.

- Taak(tool)planner – Taakplanner gebruikt de LLM om een van de volgende opties voor te stellen: 1) retouraanvraag, 2) bestelaanvraag, of 3) geen tool. We gebruiken alleen snelle engineering en

Flan-UL2model zoals het is, zonder fijnafstemming. - Gereedschapsparser – Gereedschapsparser zorgt ervoor dat de gereedschapsuggestie van de taakplanner geldig is. Met name zorgen wij ervoor dat een single

orderIdorreturnIdkan worden geparseerd. Anders reageren we met een standaardbericht. - Gereedschapsverzender – De toolverzender roept tools (Lambda-functies) aan met behulp van de geldige parameters.

- Uitvoerparser – Uitvoerparser ruimt relevante items op uit JSON en extraheert deze in een voor mensen leesbare tekenreeks. Deze taak wordt zowel door elk ophaalprogramma als binnen de orkestrator uitgevoerd.

- Uitvoertolk – De verantwoordelijkheid van de uitvoerinterpreter is om 1) de uitvoer van het aanroepen van het hulpprogramma te interpreteren en 2) te bepalen of aan het gebruikersverzoek kan worden voldaan of dat er aanvullende stappen nodig zijn. In het laatste geval wordt afzonderlijk een definitief antwoord gegenereerd en teruggestuurd naar de gebruiker.

- Taak(tool)planner – Taakplanner gebruikt de LLM om een van de volgende opties voor te stellen: 1) retouraanvraag, 2) bestelaanvraag, of 3) geen tool. We gebruiken alleen snelle engineering en

Laten we nu wat dieper ingaan op de belangrijkste componenten: agentorkestrator, taakplanner en tooldispatcher.

Agent-orkestrator

Hieronder ziet u een verkorte versie van de agentlus in de Lambda-functie van de agentorkestrator. De lus maakt gebruik van helperfuncties zoals task_planner or tool_parser, om de taken te modulariseren. De lus hier is ontworpen om maximaal twee keer te draaien om te voorkomen dat de LLM onnodig lang in een lus blijft hangen.

Taakplanner (toolvoorspelling)

De agent-orkestrator gebruikt task planner om een ophaaltool te voorspellen op basis van gebruikersinvoer. Voor onze LLM-agent gebruiken we eenvoudigweg prompt engineering en enkele shot-prompts om de LLM deze taak in context te leren. Meer geavanceerde agenten zouden een verfijnde LLM kunnen gebruiken voor het voorspellen van tools, wat buiten het bestek van dit bericht valt. De prompt is als volgt:

Gereedschapsverzender

Het toolverzendingsmechanisme werkt via if/else logica om geschikte Lambda-functies aan te roepen, afhankelijk van de naam van het gereedschap. Het volgende is tool_dispatch implementatie van de helperfunctie. Het wordt gebruikt binnen de agent loop en retourneert het onbewerkte antwoord van de tool Lambda-functie, die vervolgens wordt opgeschoond door een output_parser functie.

Implementeer de oplossing

Belangrijke voorwaarden – Om aan de slag te gaan met de implementatie, moet u aan de volgende vereisten voldoen:

- Toegang tot de AWS-beheerconsole via een gebruiker die kan starten AWS CloudFormation-stacks

- Bekendheid met het navigeren op de AWS Lambda en Amazon-Lex consoles

Flan-UL2vereist een enkeleml.g5.12xlargevoor inzet, wat het verhogen van de resourcelimieten noodzakelijk kan maken via a support ticket. In ons voorbeeld gebruiken weus-east-1als de regio, dus zorg ervoor dat u het servicequotum (indien nodig) verhoogtus-east-1.

Implementeren met CloudFormation – U kunt de oplossing implementeren op us-east-1 door op onderstaande knop te klikken:![]()

Het implementeren van de oplossing duurt ongeveer 20 minuten en er wordt een LLMAgentStack stapel, die:

- implementeert het SageMaker-eindpunt met behulp van

Flan-UL2model van SageMaker JumpStart; - zet drie Lambda-functies in:

LLMAgentOrchestrator,LLMAgentReturnsTool,LLMAgentOrdersToolund - implementeert een AWS Lex bot die kan worden gebruikt om de agent te testen:

Sagemaker-Jumpstart-Flan-LLM-Agent-Fallback-Bot.

Test de oplossing

De stack zet een Amazon Lex-bot met de naam in Sagemaker-Jumpstart-Flan-LLM-Agent-Fallback-Bot. De bot kan worden gebruikt om de agent end-to-end te testen. Hier is een aanvullende uitgebreide handleiding voor het testen van AWS Amazon Lex-bots met een Lambda-integratie en hoe de integratie op een hoog niveau werkt. Maar kort gezegd is de Amazon Lex-bot een hulpbron die een snelle gebruikersinterface biedt om te chatten met de LLM-agent die draait in een Lambda-functie die we hebben gebouwd (LLMAgentOrchestrator).

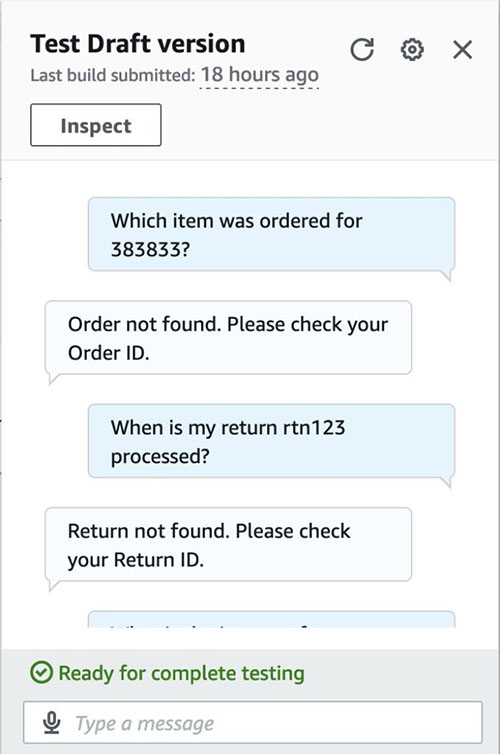

De voorbeeldtestgevallen waarmee u rekening moet houden, zijn als volgt:

- Geldige bestelaanvraag (bijvoorbeeld: 'Voor welk artikel is besteld

123456? ”)- Bestelling “123456” is een geldige bestelling, dus we mogen een redelijk antwoord verwachten (bijv. “Kruidenhandzeep”)

- Geldige retouraanvraag voor een retourzending (bijvoorbeeld: 'Wanneer is mijn retourzending

rtn003verwerkt?”)- We mogen een redelijk antwoord verwachten over de status van de retourzending.

- Niet relevant voor zowel retourzendingen als bestellingen (bijvoorbeeld: "Hoe is het weer in Schotland op dit moment?")

- Een irrelevante vraag voor retourzendingen of bestellingen, dus een standaardantwoord moet worden geretourneerd (“Sorry, ik kan die vraag niet beantwoorden.”)

- Ongeldige bestellingsaanvraag (bijvoorbeeld: 'Voor welk artikel is besteld

383833? ”)- De id 383832 bestaat niet in de gegevensset voor bestellingen en daarom zouden we correct moeten falen (bijvoorbeeld: "Bestelling niet gevonden. Controleer uw bestellings-ID.")

- Ongeldige retouraanvraag (bijvoorbeeld: 'Wanneer ben ik terug

rtn123verwerkt?”)- Zo ook, idd

rtn123bestaat niet in de retourgegevensset en zou daarom correct moeten mislukken.

- Zo ook, idd

- Irrelevant retouronderzoek (bijvoorbeeld: “Wat is de impact van rendement

rtn001over wereldvrede?”)- Deze vraag lijkt weliswaar betrekking te hebben op een geldig bevel, maar is niet relevant. De LLM wordt gebruikt om vragen met irrelevante context te filteren.

Om deze tests zelf uit te voeren, vindt u hier de instructies.

- Op de Amazon Lex-console (AWS-console> Amazon Lex), navigeer naar de bot met de titel

Sagemaker-Jumpstart-Flan-LLM-Agent-Fallback-Bot. Deze bot is al geconfigureerd om deLLMAgentOrchestratorLambda-functie wanneer deFallbackIntentwordt geactiveerd. - Kies in het navigatievenster intents.

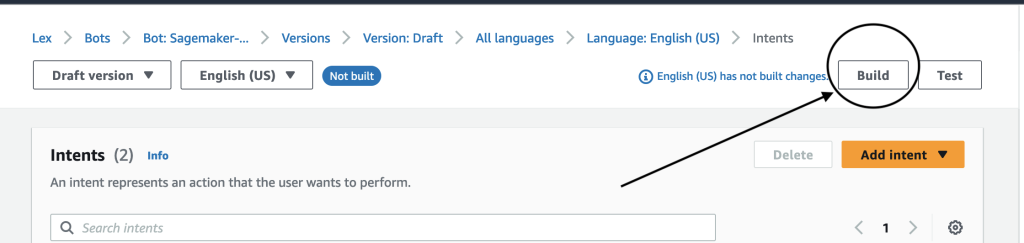

- Kies Bouw in de rechterbovenhoek

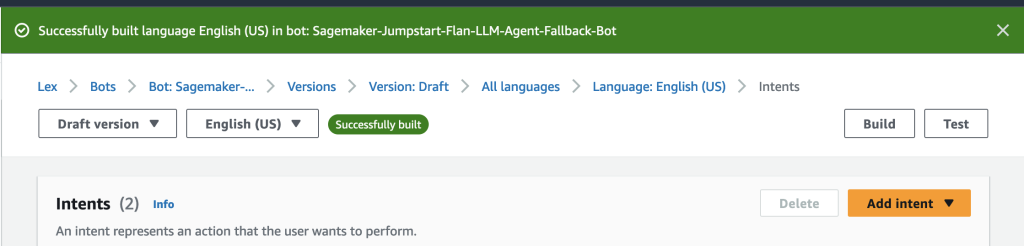

- 4. Wacht tot het bouwproces is voltooid. Als het klaar is, krijg je een succesbericht, zoals weergegeven in de volgende schermafbeelding.

- Test de bot door de testgevallen in te voeren.

Opruimen

Om extra kosten te voorkomen, verwijdert u de bronnen die door onze oplossing zijn gemaakt door deze stappen te volgen:

- Op de AWS CloudFormatie console, selecteer de stapel met de naam

LLMAgentStack(of de aangepaste naam die u heeft gekozen). - Kies Verwijder

- Controleer of de stapel is verwijderd uit de CloudFormation-console.

Belangrijk: Controleer nogmaals of de stapel met succes is verwijderd door ervoor te zorgen dat de Flan-UL2 het inferentie-eindpunt is verwijderd.

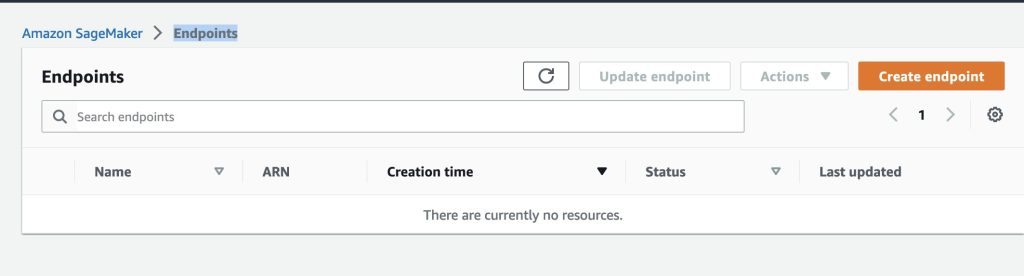

- Ga naar om dit te controleren AWS-console> Sagemaker> Eindpunten> Inferentie pagina.

- De pagina moet alle actieve eindpunten vermelden.

- Zorg ervoor

sm-jumpstart-flan-bot-endpointbestaat niet zoals de onderstaande schermafbeelding.

Overwegingen voor de productie

Voor het implementeren van LLM-agents in productie zijn extra stappen nodig om de betrouwbaarheid, prestaties en onderhoudbaarheid te garanderen. Hier volgen enkele overwegingen voordat u agenten in de productie inzet:

- Het LLM-model selecteren om de agentlus van stroom te voorzien: Voor de oplossing die in dit bericht wordt besproken, hebben we a

Flan-UL2model zonder afstemming om taakplanning of gereedschapsselectie uit te voeren. In de praktijk kan het gebruik van een LLM die is afgestemd op het rechtstreeks uitvoeren van tool- of API-verzoeken de betrouwbaarheid en prestaties verhogen en de ontwikkeling vereenvoudigen. We zouden een LLM kunnen verfijnen op gereedschapsselectietaken of een model kunnen gebruiken dat gereedschapstokens rechtstreeks decodeert, zoals Toolformer.- Het gebruik van verfijnde modellen kan ook het toevoegen, verwijderen en bijwerken van tools die beschikbaar zijn voor een agent vereenvoudigen. Bij benaderingen die alleen op prompts zijn gebaseerd, vereist het updaten van tools dat elke prompt in de agentorchestrator wordt aangepast, zoals die voor taakplanning, het parseren van tools en het verzenden van tools. Dit kan omslachtig zijn en de prestaties kunnen achteruitgaan als er te veel tools worden aangeboden in de context van de LLM.

- Betrouwbaarheid en prestaties: LLM-agents kunnen onbetrouwbaar zijn, vooral voor complexe taken die niet binnen een paar lussen kunnen worden voltooid. Het toevoegen van uitvoervalidaties, nieuwe pogingen, het structureren van uitvoer van LLM's in JSON of yaml en het afdwingen van time-outs om ontsnappingsluiken te bieden voor LLM's die vastzitten in lussen kan de betrouwbaarheid vergroten.

Conclusie

In dit bericht hebben we onderzocht hoe we een LLM-agent kunnen bouwen die vanaf het begin meerdere tools kan gebruiken, met behulp van prompt-engineering op laag niveau, AWS Lambda-functies en SageMaker JumpStart als bouwstenen. We hebben de architectuur van LLM-agents en de agentloop in detail besproken. De concepten en oplossingsarchitectuur die in deze blogpost worden geïntroduceerd, kunnen geschikt zijn voor agenten die een klein aantal van een vooraf gedefinieerde set tools gebruiken. We hebben ook verschillende strategieën besproken voor het gebruik van agenten in de productie. Agents voor Bedrock, dat in preview is, biedt ook een beheerde ervaring voor het bouwen van agenten met native ondersteuning voor het aanroepen van agentische tools.

Over de auteur

John Hwang is een Generative AI Architect bij AWS met speciale focus op Large Language Model (LLM)-applicaties, vectordatabases en generatieve AI-productstrategie. Hij heeft een passie voor het helpen van bedrijven met AI/ML-productontwikkeling en de toekomst van LLM-agenten en co-piloten. Voordat hij bij AWS kwam, was hij productmanager bij Alexa, waar hij hielp conversatie-AI naar mobiele apparaten te brengen, en was hij derivatenhandelaar bij Morgan Stanley. Hij heeft een bachelordiploma in computerwetenschappen behaald aan Stanford University.

John Hwang is een Generative AI Architect bij AWS met speciale focus op Large Language Model (LLM)-applicaties, vectordatabases en generatieve AI-productstrategie. Hij heeft een passie voor het helpen van bedrijven met AI/ML-productontwikkeling en de toekomst van LLM-agenten en co-piloten. Voordat hij bij AWS kwam, was hij productmanager bij Alexa, waar hij hielp conversatie-AI naar mobiele apparaten te brengen, en was hij derivatenhandelaar bij Morgan Stanley. Hij heeft een bachelordiploma in computerwetenschappen behaald aan Stanford University.

- Door SEO aangedreven content en PR-distributie. Word vandaag nog versterkt.

- PlatoData.Network Verticale generatieve AI. Versterk jezelf. Toegang hier.

- PlatoAiStream. Web3-intelligentie. Kennis versterkt. Toegang hier.

- PlatoESG. Automotive / EV's, carbon, CleanTech, Energie, Milieu, Zonne, Afvalbeheer. Toegang hier.

- Plato Gezondheid. Intelligentie op het gebied van biotech en klinische proeven. Toegang hier.

- ChartPrime. Verhoog uw handelsspel met ChartPrime. Toegang hier.

- BlockOffsets. Eigendom voor milieucompensatie moderniseren. Toegang hier.

- Bron: https://aws.amazon.com/blogs/machine-learning/learn-how-to-build-and-deploy-tool-using-llm-agents-using-aws-sagemaker-jumpstart-foundation-models/

- : heeft

- :is

- :niet

- :waar

- $UP

- 1

- 100

- 15%

- 19

- 20

- 200

- 24

- 27

- 500

- 7

- 9

- a

- capaciteiten

- vermogen

- Over

- toegang

- bereiken

- Volgens

- dienovereenkomstig

- over

- Actie

- acties

- actieve

- toegevoegd

- toe te voegen

- Extra

- administratief

- vooruitgang

- Na

- weer

- Agent

- agenten

- AI

- AI / ML

- Alexa

- Alles

- al

- ook

- Amazone

- Amazon-Lex

- Amazon Web Services

- onder

- bedragen

- an

- en

- beantwoorden

- elke

- api

- APIs

- gebruiken

- Aanvraag

- toepassingen

- nadering

- benaderingen

- passend

- architectuur

- ZIJN

- AS

- vragen

- gaat uit van

- At

- aangevuld

- Beschikbaar

- vermijd

- AWS

- AWS Lambda

- terug

- gebaseerde

- BE

- worden

- geweest

- vaardigheden

- wezen

- onder

- Berkeley

- Verder

- Beetje

- Blokken

- Blog

- lichaam

- Bot

- zowel

- bots

- brengen

- bouw

- Gebouw

- bebouwd

- bedrijfsdeskundigen

- maar

- by

- berekeningen

- kalenders

- Bellen

- oproepen

- CAN

- kan niet

- mogelijkheden

- geval

- gevallen

- lasten

- Chatbot

- controle

- Kies

- uitgekozen

- klant

- combines

- Bedrijven

- compleet

- Voltooid

- complex

- ingewikkeldheid

- componenten

- uitgebreid

- computer

- Computer Science

- concepten

- concludeert

- geconfigureerd

- Overwegen

- overwegingen

- troosten

- constante

- verband

- voortzetten

- spraakzaam

- conversatie AI

- Kern

- Kosten

- kon

- en je merk te creëren

- aangemaakt

- hinderlijk

- gewoonte

- gegevens

- Database

- databanken

- datasets

- dagen

- beslissen

- toegewijd aan

- diepere

- Standaard

- definities

- demonstratie

- tonen

- Afhankelijk

- implementeren

- ingezet

- het inzetten

- inzet

- ontplooit

- Derivaten

- ontworpen

- detail

- gegevens

- Bepalen

- Ontwikkeling

- systemen

- direct

- besproken

- duiken

- do

- doet

- gedaan

- rit

- e

- e-commerce

- elk

- gemakkelijk

- En het is heel gemakkelijk

- effectief

- beide

- anders

- telt

- eind tot eind

- Endpoint

- afdwingen

- Engineering

- verhogen

- verzekeren

- verzekerd

- waarborgt

- zorgen

- het invoeren van

- gerechtigd

- fout

- fouten

- ontsnappen

- vooral

- etc

- Event

- Alle

- voorbeeld

- voorbeelden

- Behalve

- uitzondering

- uitvoeren

- bestaan

- verwachten

- ervaring

- Nagegaan

- verlengen

- strekt

- extern

- extra

- extracten

- FAIL

- vals

- Mode

- Kenmerk

- weinig

- Velden

- filter

- finale

- stroom

- Focus

- volgend

- volgt

- Voor

- formaat

- formulieren

- gevonden

- Foundation

- frameworks

- vriendelijk

- oppompen van

- vervullen

- geheel

- functie

- functionaliteiten

- functies

- toekomst

- algemeen

- voortbrengen

- gegenereerde

- generatie

- generatief

- generatieve AI

- krijgen

- gegeven

- Go

- Ground

- gids

- Happening

- luiken

- Hebben

- met

- he

- hulp

- geholpen

- het helpen van

- Vandaar

- hier

- hi

- Hoge

- zeer

- houdt

- HOURS

- Hoe

- How To

- HTML

- http

- HTTPS

- Naaf

- menselijk

- leesbare

- i

- ID

- if

- Impact

- uitvoeren

- uitvoering

- invoer

- verbeteren

- in

- omvatten

- opnemen

- Laat uw omzet

- meer

- informatie

- invoer

- onderzoek

- binnen

- instructies

- geïntegreerde

- integreert

- integratie

- aandachtig

- interactie

- interactie

- interacties

- belang

- in

- voorstellen

- geïntroduceerd

- ingeroepen

- oproept

- betrekken

- IT

- artikelen

- iteraties

- aansluiting

- jpg

- json

- sleutel

- kennis

- taal

- Groot

- lancering

- LEARN

- Niveau

- als

- beperkingen

- grenzen

- Lijst

- LLM

- logica

- lang

- LOOKS

- maken

- MERKEN

- beheerd

- management

- manager

- veel

- Mei..

- me

- gemiddelde

- mechanisme

- mechanismen

- vergaderingen

- Bericht

- Metadata

- minuten

- Mobile

- mobiele toestellen

- model

- modellen

- meer

- Morgan

- Morgan Stanley

- meest

- meervoudig

- my

- naam

- Genoemd

- namen

- inheemse

- OP DEZE WEBSITE VIND JE

- navigeren

- Navigatie

- noodzakelijk

- Noodzaak

- nodig

- New

- volgende

- geen

- Geen

- in het bijzonder

- nu

- aantal

- vele

- object

- of

- vaak

- on

- eens

- EEN

- Slechts

- gekant tegen

- or

- bestellen

- orders

- Overige

- anders-

- onze

- uit

- uitgang

- buiten

- over

- Overwinnen

- overzicht

- pagina

- brood

- parameters

- passeren

- hartstochtelijk

- Patronen

- vrede te brengen.

- in afwachting van

- Uitvoeren

- prestatie

- kiezen

- uitgekozen

- plan

- planning

- Plato

- Plato gegevensintelligentie

- PlatoData

- dan

- plugins

- beleidsmaatregelen

- Post

- energie

- aangedreven

- praktijk

- voorspellen

- voorspelling

- vereisten

- voorkomen

- Voorbeschouwing

- vorig

- Voorafgaand

- Verwerkt

- verwerking

- Product

- productontwikkeling

- product manager

- productie

- Programma

- Programma's

- naar behoren

- zorgen voor

- mits

- biedt

- het verstrekken van

- doeleinden

- Python

- vraag

- Contact

- Quick

- verhogen

- snel

- Rauw

- echte wereld

- redelijk

- herkennen

- terugbetalen

- regio

- relevante

- betrouwbaarheid

- stoffelijk overschot

- verwijderd

- het verwijderen van

- vertegenwoordiging

- te vragen

- verzoeken

- vereisen

- nodig

- vereist

- hulpbron

- Resources

- Reageren

- antwoord

- verantwoordelijkheid

- verantwoordelijk

- resultaat

- terugkeer

- terugkerende

- Retourneren

- rechts

- router

- routing

- lopen

- lopend

- s

- sagemaker

- tevreden

- schaalbare

- scenario

- Wetenschap

- omvang

- Ontdek

- lijkt

- gekozen

- selectie

- zelfgestuurd

- zin

- apart

- Volgorde

- service

- Diensten

- reeks

- verscheidene

- verscheept

- Verzending

- Bermuda's

- schot

- moet

- tonen

- getoond

- Eenvoudig

- vereenvoudigen

- eenvoudigweg

- single

- Klein

- So

- Software

- oplossing

- sommige

- geraffineerd

- bron

- bronnen

- special

- gespecialiseerde

- specifiek

- specificatie

- stack

- standalone

- stanford

- Stanford University

- stanley

- begin

- gestart

- Statement

- Status

- Stap voor

- Stappen

- stop

- shop

- strategieën

- Strategie

- Draad

- structurering

- Hierop volgend

- succes

- Met goed gevolg

- dergelijk

- stel

- geschikt

- ondersteuning

- zeker

- Systems

- tafel

- Nemen

- ingenomen

- neemt

- het nemen

- Taak

- taken

- vertellen

- proef

- getest

- Testen

- testen

- dat

- De

- De toekomst

- hun

- harte

- Er.

- Deze

- dit

- die

- drie

- Dus

- keer

- naar

- tokens

- ook

- tools

- tools

- top

- Totaal

- spoor

- handelaar

- traditioneel

- getraind

- veroorzaakt

- proberen

- twee

- typisch

- typisch

- ui

- universiteit-

- onnodig

- tot

- updates

- bijwerken

- .

- gebruikt

- Gebruiker

- toepassingen

- gebruik

- gebruik maken van

- BEVESTIG

- bevestiging

- variëteit

- versie

- via

- wachten

- was

- Manier..

- we

- Weer

- web

- webservices

- websites

- GOED

- Wat

- Wat is

- wanneer

- telkens als

- of

- welke

- en

- WIE

- wil

- Met

- binnen

- zonder

- Bedrijven

- wereld

- zou

- YAML

- You

- Your

- jezelf

- zephyrnet