Introductie

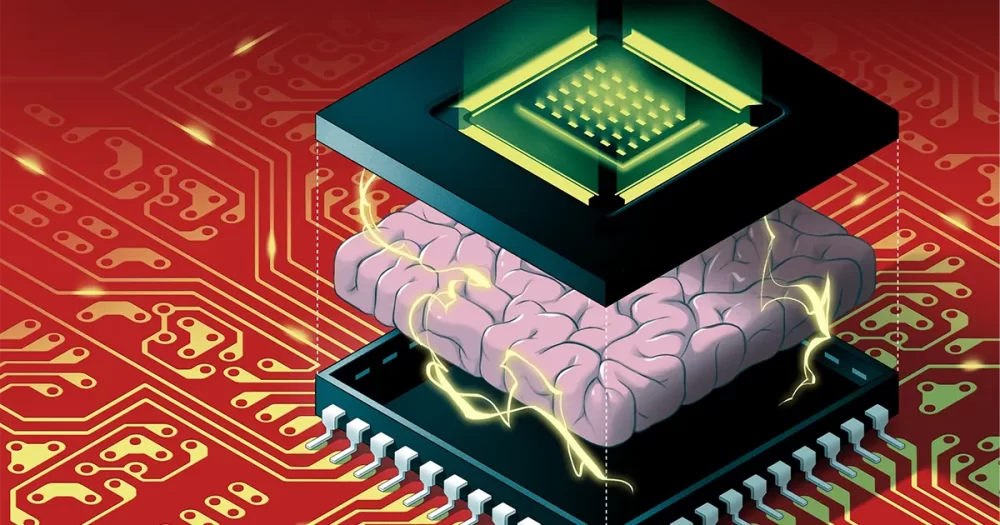

Algoritmen voor kunstmatige intelligentie kunnen in het huidige tempo niet blijven groeien. Algoritmen zoals diepe neurale netwerken - die losjes zijn geïnspireerd door de hersenen, met meerdere lagen kunstmatige neuronen die met elkaar zijn verbonden via numerieke waarden die gewichten worden genoemd - worden elk jaar groter. Maar tegenwoordig houden hardwareverbeteringen geen gelijke tred meer met de enorme hoeveelheid geheugen en verwerkingscapaciteit die nodig is om deze enorme algoritmen uit te voeren. Binnenkort kan de omvang van AI-algoritmen een muur raken.

En zelfs als we hardware zouden kunnen blijven opschalen om aan de eisen van AI te voldoen, is er nog een ander probleem: ze op traditionele computers laten draaien verspilt een enorme hoeveelheid energie. De hoge COXNUMX-uitstoot die wordt gegenereerd door het uitvoeren van grote AI-algoritmen is al schadelijk voor het milieu en zal alleen maar erger worden naarmate de algoritmen steeds groter worden.

Eén oplossing, neuromorphic computing genaamd, haalt inspiratie uit biologische hersenen om energiezuinige ontwerpen te maken. Hoewel deze chips digitale computers kunnen overtreffen in het besparen van energie, missen ze helaas de rekenkracht die nodig is om een omvangrijk diep neuraal netwerk te laten draaien. Daardoor konden AI-onderzoekers ze gemakkelijk over het hoofd zien.

Dat veranderde uiteindelijk in augustus, toen Weier Wan, H.-S. Filip Wong, Gert Cauwenberghs en hun collega's onthulde een nieuwe neuromorfische chip genaamd NeuRRAM met 3 miljoen geheugencellen en duizenden neuronen die in de hardware zijn ingebouwd om algoritmen uit te voeren. Het gebruikt een relatief nieuw type geheugen, resistive RAM of RRAM genaamd. In tegenstelling tot eerdere RRAM-chips, is NeuRRAM geprogrammeerd om analoog te werken om meer energie en ruimte te besparen. Hoewel digitaal geheugen binair is - waarbij een 1 of een 0 wordt opgeslagen - kunnen analoge geheugencellen in de NeuRRAM-chip elk meerdere waarden opslaan langs een volledig continu bereik. Hierdoor kan de chip meer informatie van enorme AI-algoritmen opslaan in dezelfde hoeveelheid chipruimte.

Als gevolg hiervan kan de nieuwe chip net zo goed presteren als digitale computers bij complexe AI-taken zoals beeld- en spraakherkenning, en de auteurs beweren dat hij tot 1,000 keer energiezuiniger is, waardoor kleine chips de mogelijkheid krijgen om steeds ingewikkelder algoritmen uit te voeren. binnen kleine apparaten die voorheen ongeschikt waren voor AI, zoals smartwatches en telefoons.

Onderzoekers die niet bij het werk betrokken waren, waren diep onder de indruk van de resultaten. "Dit papier is vrij uniek," zei Zhongrui Wang, een oude RRAM-onderzoeker aan de Universiteit van Hong Kong. "Het levert bijdragen op verschillende niveaus - op apparaatniveau, op circuitarchitectuurniveau en op algoritmeniveau."

Nieuwe herinneringen creëren

In digitale computers wordt de enorme hoeveelheid energie die wordt verspild terwijl ze AI-algoritmen uitvoeren, veroorzaakt door een eenvoudige en alomtegenwoordige ontwerpfout die elke afzonderlijke berekening inefficiënt maakt. Meestal wordt het geheugen van een computer - dat de gegevens en numerieke waarden bevat die tijdens de berekening worden gekraakt - op het moederbord geplaatst, weg van de processor, waar het computeren plaatsvindt.

Voor de informatie die door de processor stroomt, "is het alsof je acht uur onderweg bent, maar twee uur werkt", zegt Wan, een computerwetenschapper die voorheen aan de Stanford University werkte en onlangs naar de AI-startup Aizip verhuisde.

Introductie

Het lijkt eenvoudig om dit probleem op te lossen met nieuwe alles-in-één-chips die geheugen en rekenkracht op dezelfde plek plaatsen. Het komt ook dichter in de buurt van hoe onze hersenen waarschijnlijk informatie verwerken, aangezien veel neurowetenschappers geloven dat berekening plaatsvindt binnen populaties van neuronen, terwijl herinneringen worden gevormd wanneer de synapsen tussen neuronen hun verbindingen versterken of verzwakken. Maar het maken van dergelijke apparaten is moeilijk gebleken, omdat de huidige vormen van geheugen niet compatibel zijn met de technologie in processors.

Computerwetenschappers ontwikkelden decennia geleden de materialen om nieuwe chips te maken die berekeningen uitvoeren waar geheugen is opgeslagen - een technologie die bekend staat als compute-in-memory. Maar met traditionele digitale computers die zo goed presteren, werden deze ideeën tientallen jaren over het hoofd gezien.

"Dat werk was, net als het meeste wetenschappelijke werk, een beetje vergeten", zegt Wong, een professor aan Stanford.

Inderdaad, de eerste zo'n apparaat dateert van ten minste 1964, toen elektrotechnici van Stanford ontdekten dat ze bepaalde materialen, metaaloxiden genaamd, konden manipuleren om hun vermogen om elektriciteit te geleiden aan en uit te zetten. Dat is belangrijk omdat het vermogen van een materiaal om te schakelen tussen twee toestanden de ruggengraat vormt voor traditionele geheugenopslag. Typisch komt in een digitaal geheugen een toestand van hoge spanning overeen met een 1 en lage spanning met een 0.

Om een RRAM-apparaat van toestand te laten wisselen, past u een spanning toe op metalen elektroden die zijn aangesloten op twee uiteinden van het metaaloxide. Normaal gesproken zijn metaaloxiden isolatoren, wat betekent dat ze geen elektriciteit geleiden. Maar met voldoende spanning bouwt de stroom zich op en duwt uiteindelijk door de zwakke plekken van het materiaal en baant zich een weg naar de elektrode aan de andere kant. Als de stroom eenmaal is doorgebroken, kan deze vrij langs dat pad stromen.

Wong vergelijkt dit proces met bliksem: wanneer er voldoende lading is opgebouwd in een wolk, vindt deze snel een pad met lage weerstand en slaat de bliksem in. Maar in tegenstelling tot bliksem, waarvan het pad verdwijnt, blijft het pad door het metaaloxide bestaan, wat betekent dat het voor onbepaalde tijd geleidend blijft. En het is mogelijk om het geleidende pad te wissen door een ander voltage op het materiaal aan te leggen. Dus onderzoekers kunnen een RRAM schakelen tussen twee toestanden en ze gebruiken om digitaal geheugen op te slaan.

Onderzoekers uit het midden van de vorige eeuw zagen het potentieel van energiezuinig computergebruik niet in en hadden het ook nog niet nodig met de kleinere algoritmen waarmee ze werkten. Het duurde tot het begin van de jaren 2000, met de ontdekking van nieuwe metaaloxiden, voordat onderzoekers de mogelijkheden beseften.

Wong, die op dat moment bij IBM werkte, herinnert zich dat een bekroonde collega die aan RRAM werkte, toegaf dat hij de betrokken fysica niet volledig begreep. "Als hij het niet begrijpt", herinnert Wong zich dat hij dacht, "moet ik het misschien niet proberen te begrijpen."

Maar in 2004 maakten onderzoekers van Samsung Electronics bekend dat ze dat wel hadden gedaan succesvol geïntegreerd RRAM-geheugen gebouwd bovenop een traditionele computerchip, wat suggereert dat een compute-in-memory-chip eindelijk mogelijk zou kunnen zijn. Wong besloot het in ieder geval te proberen.

Compute-in-Memory-chips voor AI

Meer dan een decennium lang werkten onderzoekers zoals Wong aan de opbouw van RRAM-technologie tot het punt waarop het op betrouwbare wijze krachtige computertaken aankon. Rond 2015 begonnen computerwetenschappers het enorme potentieel in te zien van deze energiezuinige apparaten voor grote AI-algoritmen, die een vlucht begonnen te nemen. Dat jaar, wetenschappers aan de Universiteit van Californië, Santa Barbara vertoonde dat RRAM-apparaten meer kunnen dan alleen geheugen op een nieuwe manier opslaan. Ze zouden zelf basiscomputertaken kunnen uitvoeren, waaronder de overgrote meerderheid van de berekeningen die plaatsvinden binnen de kunstmatige neuronen van een neuraal netwerk, wat eenvoudige matrixvermenigvuldigingstaken zijn.

In de NeuRRAM-chip zijn siliciumneuronen ingebouwd in de hardware en de RRAM-geheugencellen slaan de gewichten op - de waarden die de sterkte van de verbindingen tussen neuronen vertegenwoordigen. En omdat de NeuRRAM-geheugencellen analoog zijn, vertegenwoordigen de gewichten die ze opslaan het volledige bereik van weerstandstoestanden die optreden wanneer het apparaat schakelt tussen een toestand met lage weerstand naar een toestand met hoge weerstand. Dit maakt een nog hogere energie-efficiëntie mogelijk dan digitaal RRAM-geheugen kan bereiken, omdat de chip veel matrixberekeningen parallel kan uitvoeren - in plaats van in lockstep na elkaar, zoals in de digitale verwerkingsversies.

Maar aangezien analoge verwerking nog tientallen jaren achterloopt op digitale verwerking, zijn er nog veel problemen die moeten worden opgelost. Een daarvan is dat analoge RRAM-chips ongewoon nauwkeurig moeten zijn, aangezien onvolkomenheden op de fysieke chip variabiliteit en ruis kunnen veroorzaken. (Voor traditionele chips, met slechts twee toestanden, doen deze onvolkomenheden er lang niet zo toe.) Dat maakt het aanzienlijk moeilijker voor analoge RRAM-apparaten om AI-algoritmen uit te voeren, aangezien de nauwkeurigheid van bijvoorbeeld het herkennen van een afbeelding eronder zal lijden als de de geleidende toestand van het RRAM-apparaat is niet elke keer precies hetzelfde.

"Als we naar een verlichtingspad kijken, is het elke keer anders", zegt Wong. "Dus als gevolg daarvan vertoont de RRAM een zekere mate van stochasticiteit - elke keer dat je ze programmeert, is iets anders." Wong en zijn collega's bewezen dat RRAM-apparaten continue AI-gewichten kunnen opslaan en nog steeds even nauwkeurig zijn als digitale computers als de algoritmen worden getraind om te wennen aan de ruis die ze op de chip tegenkomen, een vooruitgang die hen in staat stelde de NeuRRAM-chip te produceren.

Introductie

Een ander belangrijk probleem dat ze moesten oplossen, was de flexibiliteit die nodig was om diverse neurale netwerken te ondersteunen. In het verleden moesten chipontwerpers de minuscule RRAM-apparaten in één ruimte opstellen naast grotere siliciumneuronen. De RRAM-apparaten en de neuronen waren bedraad zonder programmeerbaarheid, dus de berekening kon maar in één richting worden uitgevoerd. Om neurale netwerken met bidirectionele berekeningen te ondersteunen, waren extra draden en circuits nodig, waardoor de energie- en ruimtebehoeften werden opgeblazen.

Dus ontwierp het team van Wong een nieuwe chiparchitectuur waarbij de RRAM-geheugenapparaten en siliciumneuronen met elkaar werden vermengd. Deze kleine wijziging in het ontwerp verkleinde de totale oppervlakte en bespaarde energie.

"Ik dacht dat [het arrangement] echt mooi was", zei Melika Payvand, een neuromorfisch onderzoeker aan het Zwitserse Federale Instituut voor Technologie Zürich. "Ik beschouw het zeker als een baanbrekend werk."

Jarenlang werkte het team van Wong samen met medewerkers om AI-algoritmen op de NeuRRAM-chip te ontwerpen, produceren, testen, kalibreren en uitvoeren. Ze overwogen wel om andere opkomende soorten geheugen te gebruiken die ook kunnen worden gebruikt in een compute-in-memory-chip, maar RRAM had een voorsprong vanwege de voordelen bij analoog programmeren en omdat het relatief eenvoudig te integreren was met traditioneel computermateriaal.

Hun recente resultaten vertegenwoordigen de eerste RRAM-chip die zulke grote en complexe AI-algoritmen kan uitvoeren - een prestatie die voorheen alleen mogelijk was in theoretische simulaties. "Als het om echt silicium gaat, ontbrak die mogelijkheid," zei Anup Das, een computerwetenschapper aan de Drexel University. "Dit werk is de eerste demonstratie."

“Digitale AI-systemen zijn flexibel en nauwkeurig, maar ordes van grootte minder efficiënt”, zegt Cauwenberghs. Nu, zei Cauwenberghs, heeft hun flexibele, nauwkeurige en energie-efficiënte analoge RRAM-chip "voor het eerst de kloof overbrugd".

Opschalen

Het ontwerp van het team houdt de NeuRRAM-chip klein - slechts zo groot als een vingernagel - terwijl er 3 miljoen RRAM-geheugenapparaten samengeperst worden die als analoge processors kunnen dienen. En hoewel hij neurale netwerken minstens even goed kan aansturen als digitale computers, kan de chip ook (en voor het eerst) algoritmen uitvoeren die berekeningen in verschillende richtingen uitvoeren. Hun chip kan een spanning invoeren in de rijen van de RRAM-array en output lezen van de kolommen zoals standaard is voor RRAM-chips, maar het kan het ook achterwaarts doen van de kolommen naar de rijen, zodat het kan worden gebruikt in neurale netwerken die werken met gegevens die in verschillende richtingen stromen.

Net als bij de RRAM-technologie zelf is dit al lang mogelijk, maar niemand dacht eraan. “Waarom hebben we hier niet eerder over nagedacht?” vroeg Payvand. “Achteraf weet ik het niet.”

"Dit opent eigenlijk een heleboel andere kansen", zei Das. Als voorbeelden noemde hij het vermogen van een eenvoudig systeem om de enorme algoritmen uit te voeren die nodig zijn voor multidimensionale natuurkundige simulaties of zelfrijdende auto's.

Toch is de grootte een probleem. De grootste neurale netwerken bevatten nu miljarden gewichten, niet de miljoenen in de nieuwe chips. Wong is van plan om op te schalen door meerdere NeuRRAM-chips op elkaar te stapelen.

Het wordt net zo belangrijk om de energiekosten van toekomstige apparaten laag te houden, of nog verder te schalen. Een manier om er te komen is langs kopiëren van de hersenen nog nauwkeuriger om het communicatiesignaal over te nemen dat wordt gebruikt tussen echte neuronen: de elektrische piek. Het is een signaal dat van het ene neuron naar het andere wordt afgevuurd wanneer het verschil in spanning tussen de binnenkant en de buitenkant van de cel een kritieke drempel bereikt.

"Er zijn grote uitdagingen daar," zei Tony Kenjon, een nanotechnologie-onderzoeker aan University College London. "Maar misschien willen we toch in die richting gaan, want... de kans is groot dat je een grotere energie-efficiëntie zult hebben als je heel weinig spikes gebruikt." Om algoritmen uit te voeren die piekeren op de huidige NeuRRAM-chip zou waarschijnlijk een totaal andere architectuur nodig zijn, merkte Kenyon op.

Voor nu heeft de energie-efficiëntie die het team heeft bereikt tijdens het uitvoeren van grote AI-algoritmen op de NeuRRAM-chip nieuwe hoop gewekt dat geheugentechnologieën de toekomst van computergebruik met AI kunnen vertegenwoordigen. Misschien kunnen we op een dag zelfs de 86 miljard neuronen van het menselijk brein en de biljoenen synapsen die ze met elkaar verbinden matchen zonder zonder stroom te komen te zitten.