1IRIF, CNRS – Université Paris Cité, Frankrijk

2QC Ware, Palo Alto, VS en Parijs, Frankrijk

3School voor Informatica, Universiteit van Edinburgh, Schotland, VK

4F. Hoffmann La Roche AG

Vind je dit artikel interessant of wil je het bespreken? Scite of laat een reactie achter op SciRate.

Abstract

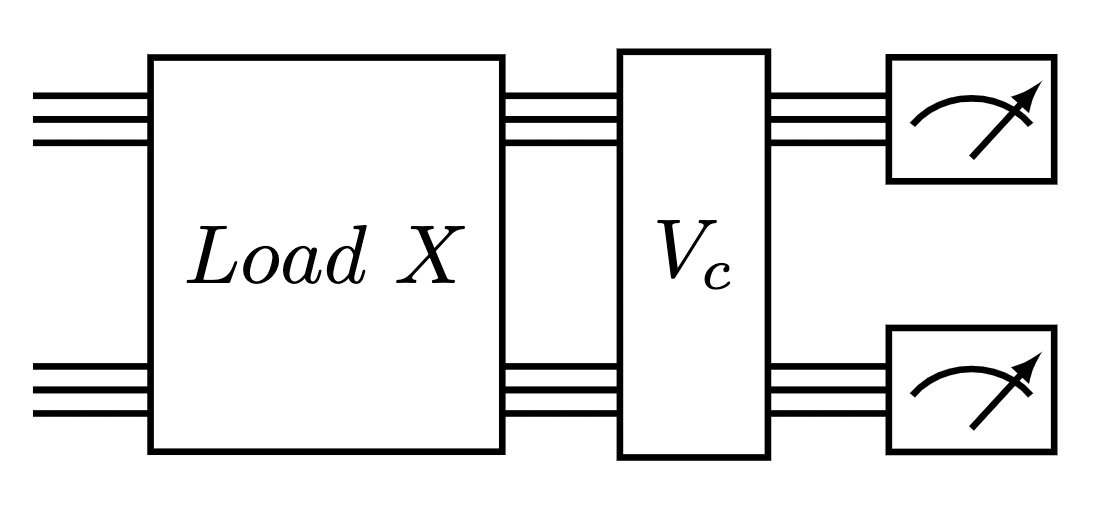

In dit werk worden kwantumtransformatoren in detail ontworpen en geanalyseerd door het uitbreiden van de state-of-the-art klassieke neurale netwerkarchitecturen voor transformatoren waarvan bekend is dat ze zeer performant zijn in natuurlijke taalverwerking en beeldanalyse. Voortbouwend op het eerdere werk, dat gebruik maakt van geparametriseerde kwantumcircuits voor het laden van gegevens en orthogonale neurale lagen, introduceren we drie soorten kwantumtransformatoren voor training en gevolgtrekking, waaronder een kwantumtransformator gebaseerd op samengestelde matrices, die een theoretisch voordeel van het kwantumaandachtsmechanisme garandeert. vergeleken met hun klassieke tegenhanger, zowel wat betreft de asymptotische looptijd als het aantal modelparameters. Deze kwantumarchitecturen kunnen worden gebouwd met behulp van ondiepe kwantumcircuits en kwalitatief verschillende classificatiemodellen produceren. De drie voorgestelde kwantumaandachtslagen variëren in het spectrum tussen het nauw volgen van de klassieke transformatoren en het vertonen van meer kwantumkarakteristieken. Als bouwstenen van de kwantumtransformator stellen we een nieuwe methode voor voor het laden van een matrix als kwantumtoestanden, evenals twee nieuwe trainbare kwantumorthogonale lagen die aanpasbaar zijn aan verschillende niveaus van connectiviteit en kwaliteit van kwantumcomputers. We hebben uitgebreide simulaties van de kwantumtransformatoren uitgevoerd op standaard medische beelddatasets die competitieve en soms betere prestaties lieten zien in vergelijking met de klassieke benchmarks, waaronder de beste klassieke zichttransformatoren in hun klasse. De kwantumtransformatoren die we op deze kleinschalige datasets hebben getraind, vereisen minder parameters vergeleken met standaard klassieke benchmarks. Ten slotte hebben we onze kwantumtransformatoren geïmplementeerd op supergeleidende kwantumcomputers en hebben we bemoedigende resultaten verkregen voor maximaal zes qubit-experimenten.

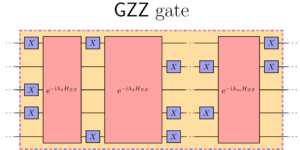

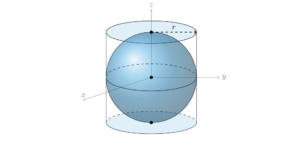

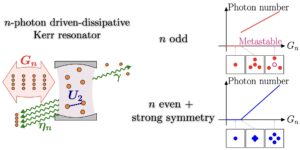

Uitgelichte afbeelding: Quantumcircuit om één aandachtslaag van de Compound Transformer uit te voeren. Een matrixgegevenslader gevolgd door een orthogonale kwantumlaag.

Populaire samenvatting

► BibTeX-gegevens

► Referenties

[1] Jacob Biamonte, Peter Wittek, Nicola Pancotti, Patrick Rebentrost, Nathan Wiebe en Seth Lloyd. "Kwantummachine learning". Natuur 549, 195-202 (2017).

https: / / doi.org/ 10.1038 / nature23474

[2] Iris Cong, Soonwon Choi en Mikhail D Lukin. "Quantum convolutionele neurale netwerken". Natuurfysica 15, 1273-1278 (2019).

https://doi.org/10.1038/s41567-019-0648-8

[3] Kishor Bharti, Alba Cervera-Lierta, Thi Ha Kyaw, Tobias Haug, Sumner Alperin-Lea, Abhinav Anand, Matthias Degroote, Hermanni Heimonen, Jakob S Kottmann, Tim Menke, et al. "Noisy kwantumalgoritmen op middelmatige schaal". Recensies van Moderne Natuurkunde 94, 015004 (2022).

https: / / doi.org/ 10.1103 / RevModPhys.94.015004

[4] Marco Cerezo, Andrew Arrasmith, Ryan Babbush, Simon C Benjamin, Suguru Endo, Keisuke Fujii, Jarrod R McClean, Kosuke Mitarai, Xiao Yuan, Lukasz Cincio, et al. "Variationele kwantumalgoritmen". Natuurrecensies Natuurkunde 3, 625–644 (2021).

https://doi.org/10.1038/s42254-021-00348-9

[5] Jonas Landman, Natansh Mathur, Yun Yvonna Li, Martin Strahm, Skander Kazdaghli, Anupam Prakash en Iordanis Kerenidis. ‘Kwantummethoden voor neurale netwerken en toepassing op classificatie van medische beelden’. Kwantum 6, 881 (2022).

https://doi.org/10.22331/q-2022-12-22-881

[6] Bobak Kiani, Randall Balestriero, Yann LeCun en Seth Lloyd. "projunn: efficiënte methode voor het trainen van diepe netwerken met unitaire matrices". Vooruitgang in neurale informatieverwerkingssystemen 35, 14448–14463 (2022).

[7] Ashish Vaswani, Noam Shazeer, Niki Parmar, Jakob Uszkoreit, Llion Jones, Aidan N Gomez, Łukasz Kaiser en Illia Polosukhin. "Aandacht is alles wat je nodig hebt". Vooruitgang in neurale informatieverwerkingssystemen 30 (2017).

[8] Jacob Devlin, Ming-Wei Chang, Kenton Lee en Kristina Toutanova. “Bert: Voortraining van diepe bidirectionele transformatoren voor taalbegrip” (2018).

[9] Alexey Dosovitskiy, Lucas Beyer, Alexander Kolesnikov, Dirk Weissenborn, Xiaohua Zhai, Thomas Unterthiner, Mostafa Dehghani, Matthias Minderer, Georg Heigold, Sylvain Gelly, Jakob Uszkoreit en Neil Houlsby. “Een afbeelding zegt 16×16 woorden: Transformers voor beeldherkenning op schaal”. Internationale conferentie over leerrepresentaties (2021). url: openreview.net/forum?id=YicbFdNTTy.

https:///openreview.net/forum?id=YicbFdNTTy

[10] Yi Tay, Mostafa Dehghani, Dara Bahri en Donald Metzler. "Efficiënte transformatoren: een onderzoek". ACM Computeronderzoeken (CSUR) (2020).

https: / / doi.org/ 10.1145 / 3530811

[11] Dzmitry Bahdanau, Kyunghyun Cho en Yoshua Bengio. “Neural Machine Translation door gezamenlijk te leren afstemmen en vertalen” (2016). arXiv:1409.0473 [cs, stat].

arXiv: 1409.0473

[12] J. Schmidhuber. "Het verminderen van de verhouding tussen leercomplexiteit en het aantal tijdsvariërende variabelen in volledig terugkerende netten". In Stan Gielen en Bert Kappen, redactie, ICANN '93. Pagina's 460-463. Londen (1993). Springer.

https://doi.org/10.1007/978-1-4471-2063-6_110

[13] Jürgen Schmidhuber. "Leren controle over snelle herinneringen: een alternatief voor dynamische terugkerende netwerken". Neurale berekening 4, 131–139 (1992).

https: / / doi.org/ 10.1162 / neco.1992.4.1.131

[14] Peter Cha, Paul Ginsparg, Felix Wu, Juan Carrasquilla, Peter L McMahon en Eun-Ah Kim. "Op aandacht gebaseerde kwantumtomografie". Machine learning: wetenschap en technologie 3, 01LT01 (2021).

https:///doi.org/10.1088/2632-2153/ac362b

[15] Riccardo Di Sipio, Jia-Hong Huang, Samuel Yen-Chi Chen, Stefano Mangini en Marcel Worring. "Het begin van de kwantumnatuurlijke taalverwerking". In ICASSP 2022-2022 IEEE Internationale conferentie over akoestiek, spraak en signaalverwerking (ICASSP). Pagina's 8612–8616. IEEE (2022).

https:///doi.org/10.1109/ICASSP43922.2022.9747675

[16] Guangxi Li, Xuanqiang Zhao en Xin Wang. “Kwantum-neurale netwerken met zelfaandacht voor tekstclassificatie” (2022).

[17] Fabio Sanches, Sean Weinberg, Takanori Ide en Kazumitsu Kamiya. "Korte kwantumcircuits in het versterken van leerbeleid voor het routeringsprobleem van voertuigen". Fysieke beoordeling A 105, 062403 (2022).

https: / / doi.org/ 10.1103 / PhysRevA.105.062403

[18] YuanFu Yang en Min Sun. “Detectie van halfgeleiderdefecten door hybride klassiek-kwantum deep learning”. CVPR Pagina's 2313–2322 (2022).

https:///doi.org/10.1109/CVPR52688.2022.00236

[19] Maxwell Henderson, Samriddhi Shakya, Shashindra Pradhan en Tristan Cook. "Quanvolutionele neurale netwerken: beeldherkenning mogelijk maken met kwantumcircuits". Kwantummachine-intelligentie 2, 1–9 (2020).

https: / / doi.org/ 10.1007 / s42484-020-00012-y

[20] Edward Farhi en Hartmut Neven. "Classificatie met kwantumneurale netwerken op processors op korte termijn" (2018). url: doi.org/10.48550/arXiv.1802.06002.

https://doi.org/10.48550/arXiv.1802.06002

[21] Kosuke Mitarai, Makoto Negoro, Masahiro Kitagawa en Keisuke Fujii. "Kwantumcircuit leren". Fysieke beoordeling A 98, 032309 (2018).

https: / / doi.org/ 10.1103 / PhysRevA.98.032309

[22] Kui Jia, Shuai Li, Yuxin Wen, Tongliang Liu en Dacheng Tao. "Orthogonale diepe neurale netwerken". IEEE-transacties op patroonanalyse en machine-intelligentie (2019).

https: / / doi.org/ 10.1109 / TPAMI.2019.2948352

[23] Roger A Horn en Charles R Johnson. “Matrixanalyse”. Cambridge University Press. (2012).

https: / / doi.org/ 10.1017 / CBO9780511810817

[24] Iordanis Kerenidis en Anupam Prakash. “Kwantummachine learning met subruimtetoestanden” (2022).

[25] Brooks Foxen, Charles Neill, Andrew Dunsworth, Pedram Roushan, Ben Chiaro, Anthony Megrant, Julian Kelly, Zijun Chen, Kevin Satzinger, Rami Barends, et al. "Demonstratie van een continue set van twee-qubit-poorten voor kwantumalgoritmen op korte termijn". Fysieke beoordelingsbrieven 125, 120504 (2020).

https: / / doi.org/ 10.1103 / PhysRevLett.125.120504

[26] Sonika Johri, Shantanu Debnath, Avinash Mocherla, Alexandros Singk, Anupam Prakash, Jungsang Kim en Iordanis Kerenidis. "Dichtstbijzijnde zwaartepuntclassificatie op een kwantumcomputer met gevangen ionen". npj Quantuminformatie 7, 122 (2021).

https://doi.org/10.1038/s41534-021-00456-5

[27] James W. Cooley en John W. Tukey. “Een algoritme voor de machinale berekening van complexe fourierreeksen”. Wiskunde van berekeningen 19, 297–301 (1965).

https://doi.org/10.1090/S0025-5718-1965-0178586-1

[28] Li Jing, Yichen Shen, Tena Dubcek, John Peurifoy, Scott A. Skirlo, Yann LeCun, Max Tegmark en Marin Soljacic. "Afstembare efficiënte unitaire neurale netwerken (eunn) en hun toepassing op rnns". Tijdens de internationale conferentie over machinaal leren. (2016). url: api.semanticscholar.org/CorpusID:5287947.

https:///api.semanticscholar.org/CorpusID:5287947

[29] Léo Monbroussou, Jonas Landman, Alex B. Grilo, Romain Kukla en Elham Kashefi. "Trainbaarheid en expressiviteit van kwantumcircuits met behoud van gewicht voor machinaal leren" (2023). arXiv:2309.15547.

arXiv: 2309.15547

[30] Enrico Fontana, Dylan Herman, Shouvanik Chakrabarti, Niraj Kumar, Romina Yalovetzky, Jamie Heredge, Shree Hari Sureshbabu en Marco Pistoia. “Het adjoint is alles wat je nodig hebt: het karakteriseren van kale plateaus in quantum ansätze” (2023). arXiv:2309.07902.

arXiv: 2309.07902

[31] Michael Ragone, Bojko N. Bakalov, Frédéric Sauvage, Alexander F. Kemper, Carlos Ortiz Marrero, Martin Larocca en M. Cerezo. “Een uniforme theorie van dorre plateaus voor diep geparametriseerde kwantumcircuits” (2023). arXiv:2309.09342.

arXiv: 2309.09342

[32] Xuchen Jij en Xiaodi Wu. "Exponentieel veel lokale minima in kwantumneurale netwerken". Tijdens de internationale conferentie over machinaal leren. Pagina's 12144–12155. PMLR (2021).

[33] Eric R. Anschuetz en Bobak Toussi Kiani. “Kwantumvariatie-algoritmen worden overspoeld met vallen”. Natuurcommunicatie 13 (2022).

https://doi.org/10.1038/s41467-022-35364-5

[34] Ilya O. Tolstikhin, Neil Houlsby, Alexander Kolesnikov, Lucas Beyer, Xiaohua Zhai, Thomas Unterthiner, Jessica Yung, Daniel Keysers, Jakob Uszkoreit, Mario Lucic en Alexey Dosovitskiy. "MLP-mixer: een volledig mlp-architectuur voor visie". In NeurIPS. (2021).

[35] Jiancheng Yang, Rui Shi en Bingbing Ni. "Medmnist-classificatietienkamp: een lichtgewicht automl-benchmark voor medische beeldanalyse" (2020).

https:///doi.org/10.1109/ISBI48211.2021.9434062

[36] Jiancheng Yang, Rui Shi, Donglai Wei, Zequan Liu, Lin Zhao, Bilian Ke, Hanspeter Pfister en Bingbing Ni. "Medmnist v2-een grootschalige lichtgewicht benchmark voor 2D- en 3D-biomedische beeldclassificatie". Wetenschappelijke gegevens 10, 41 (2023).

https://doi.org/10.1038/s41597-022-01721-8

[37] Angelos Katharopoulos, Apoorv Vyas, Nikolaos Pappas en François Fleuret. “Transformatoren zijn rnns: snelle autoregressieve transformatoren met lineaire aandacht”. Tijdens de internationale conferentie over machinaal leren. Pagina's 5156–5165. PMLR (2020).

[38] James Bradbury, Roy Frostig, Peter Hawkins, Matthew James Johnson, Chris Leary, Dougal Maclaurin, George Necula, Adam Paszke, Jake VanderPlas, Skye Wanderman-Milne en Qiao Zhang. "JAX: samenstelbare transformaties van Python+NumPy-programma's". Github (2018). url: http:///github.com/google/jax.

http: / / github.com/ google / jax

[39] Diederik P. Kingma en Jimmy Ba. “Adam: Een methode voor stochastische optimalisatie”. CoRR abs/1412.6980 (2015).

[40] Hyeonwoo Noh, Tackgeun You, Jonghwan Mun en Bohyung Han. "Het regulariseren van diepe neurale netwerken door ruis: de interpretatie en optimalisatie ervan". NeurIPS (2017).

[41] Xue Ying. “Een overzicht van overfitting en zijn oplossingen”. In Journal of Physics: conferentieserie. Jaargang 1168, pagina 022022. IOP Publishing (2019).

https://doi.org/10.1088/1742-6596/1168/2/022022

Geciteerd door

[1] David Peral García, Juan Cruz-Benito en Francisco José García-Peñalvo, “Systematisch literatuuroverzicht: Quantum Machine Learning en zijn toepassingen”, arXiv: 2201.04093, (2022).

[2] El Amine Cherrat, Snehal Raj, Iordanis Kerenidis, Abhishek Shekhar, Ben Wood, Jon Dee, Shouvanik Chakrabarti, Richard Chen, Dylan Herman, Shaohan Hu, Pierre Minssen, Ruslan Shaydulin, Yue Sun, Romina Yalovetzky en Marco Pistoia, “Kwantumdiepe hedging”, Kwantum 7, 1191 (2023).

[3] Léo Monbroussou, Jonas Landman, Alex B. Grilo, Romain Kukla en Elham Kashefi, "Trainbaarheid en expressiviteit van Hamming-gewicht behoud van kwantumcircuits voor machinaal leren", arXiv: 2309.15547, (2023).

[4] Sohum Thakkar, Skander Kazdaghli, Natansh Mathur, Iordanis Kerenidis, André J. Ferreira-Martins en Samurai Brito, “Verbeterde financiële prognoses via Quantum Machine Learning”, arXiv: 2306.12965, (2023).

[5] Jason Iaconis en Sonika Johri, “Tensor Network Based Efficiënt Quantum Data Loading of Images”, arXiv: 2310.05897, (2023).

[6] Nishant Jain, Jonas Landman, Natansh Mathur en Iordanis Kerenidis, "Quantum Fourier-netwerken voor het oplossen van parametrische PDE's", arXiv: 2306.15415, (2023).

[7] Daniel Mastropietro, Georgios Korpas, Vyacheslav Kungurtsev en Jakub Marecek, "Fleming-Viot helpt variatiekwantumalgoritmen te versnellen in de aanwezigheid van dorre plateaus", arXiv: 2311.18090, (2023).

[8] Aliza U. Siddiqui, Kaitlin Gili en Chris Ballance, "Moderne kwantumhardware benadrukken: prestatie-evaluatie en uitvoeringsinzichten", arXiv: 2401.13793, (2024).

Bovenstaande citaten zijn afkomstig van SAO / NASA ADS (laatst bijgewerkt met succes 2024-02-22 13:37:43). De lijst is mogelijk onvolledig omdat niet alle uitgevers geschikte en volledige citatiegegevens verstrekken.

Kon niet ophalen Door Crossref geciteerde gegevens tijdens laatste poging 2024-02-22 13:37:41: kon niet geciteerde gegevens voor 10.22331 / q-2024-02-22-1265 niet ophalen van Crossref. Dit is normaal als de DOI recent is geregistreerd.

Dit artikel is gepubliceerd in Quantum onder de Creative Commons Naamsvermelding 4.0 Internationaal (CC BY 4.0) licentie. Het auteursrecht blijft berusten bij de oorspronkelijke houders van auteursrechten, zoals de auteurs of hun instellingen.

- Door SEO aangedreven content en PR-distributie. Word vandaag nog versterkt.

- PlatoData.Network Verticale generatieve AI. Versterk jezelf. Toegang hier.

- PlatoAiStream. Web3-intelligentie. Kennis versterkt. Toegang hier.

- PlatoESG. carbon, CleanTech, Energie, Milieu, Zonne, Afvalbeheer. Toegang hier.

- Plato Gezondheid. Intelligentie op het gebied van biotech en klinische proeven. Toegang hier.

- Bron: https://quantum-journal.org/papers/q-2024-02-22-1265/

- :is

- :niet

- ][P

- $UP

- 1

- 10

- 11

- 12

- 125

- 13

- 14

- 15%

- 16

- 17

- 19

- 20

- 2012

- 2015

- 2016

- 2017

- 2018

- 2019

- 2020

- 2021

- 2022

- 2023

- 2024

- 22

- 23

- 24

- 25

- 26%

- 27

- 28

- 29

- 2D

- 30

- 31

- 32

- 33

- 35%

- 36

- 39

- 3d

- 40

- 41

- 43

- 7

- 8

- 9

- 98

- a

- boven

- SAMENVATTING

- toegang

- ACM

- Adam

- Daarnaast

- voorschotten

- Voordeel

- voordelen

- voorkeuren

- AL

- alex

- Alexander

- algoritme

- algoritmen

- richten

- Alles

- alternatief

- an

- analyse

- en

- Andrew

- Anthony

- api

- Aanvraag

- toepassingen

- architectuur

- architecturen

- ZIJN

- AS

- veronderstellingen

- At

- poging

- aandacht

- auteur

- auteurs

- AutoML

- dor

- gebaseerde

- BE

- ben

- criterium

- benchmarks

- Benjamin

- Betere

- tussen

- bidirectionele

- biomedische

- Blokken

- zowel

- Breken

- Gebouw

- bebouwd

- by

- berekening

- Cambridge

- CAN

- mogelijkheden

- carlos

- cha

- chang

- kenmerken

- Charles

- chen

- CHO

- Chris

- classificatie

- van nabij

- commentaar

- Volk

- Communicatie

- vergeleken

- concurrerend

- compleet

- complex

- ingewikkeldheid

- componeerbaar

- Samenstelling

- berekening

- computer

- computers

- computergebruik

- Conferentie

- Connectiviteit

- doorlopend

- onder controle te houden

- auteursrecht

- kon

- Tegenhanger

- tegenhangers

- en je merk te creëren

- Daniel

- gegevens

- datasets

- David

- deep

- diepgaand leren

- tonen

- ontworpen

- detail

- Opsporing

- anders

- bespreken

- donald

- gedurende

- dynamisch

- E & T

- redacteurs

- Edward

- effectiviteit

- doeltreffend

- el

- bemoedigend

- verhogen

- eric

- evaluatie

- Zelfs

- uitvoeren

- uitvoering

- exposeren

- experimenten

- Verken

- verlenging

- uitgebreid

- SNELLE

- Feb

- minder

- Tot slot

- financieel

- gericht

- gevolgd

- volgend

- Voor

- Francisco

- oppompen van

- geheel

- Gates

- George

- GitHub

- Gomez

- garanties

- Hardware

- harvard

- hedging

- hulp

- helpt

- houders

- http

- HTTPS

- Huang

- Hybride

- IEEE

- if

- illia

- beeld

- Afbeeldingsclassificatie

- Beeldherkenning

- afbeeldingen

- geïmplementeerd

- verbeterd

- in

- Inclusief

- informatie

- inzichten

- instellingen

- Intelligentie

- interessant

- Internationale

- interpretatie

- voorstellen

- HAAR

- Jakob

- james

- Jamie

- JavaScript

- Jimmy

- John

- Johnson

- jon

- jones

- tijdschrift

- John

- Kim

- bekend

- kumar

- taal

- grootschalig

- Achternaam*

- lagen

- Legkippen

- leren

- Verlof

- Luwte

- niveaus

- leveraging

- Li

- Vergunning

- lichtgewicht

- als

- lin

- lineair

- Lijst

- literatuur

- lader

- het laden

- lokaal

- London

- machine

- machine learning

- veel

- kader

- mario

- Martin

- wiskunde

- Matrix

- Matthew

- max

- max-width

- Maxwell

- Mei..

- mcschoon

- mechanisme

- medisch

- Memories

- methode

- methoden

- Michael

- mikhail

- Min

- model

- modellen

- Modern

- Maand

- meer

- Naturel

- Natural Language Processing

- NATUUR

- Nabij

- Noodzaak

- Netten

- netwerk

- netwerken

- neurale

- neuraal netwerk

- neurale netwerken

- New

- Geluid

- een

- roman

- aantal

- verkregen

- of

- on

- EEN

- open

- optimalisatie

- or

- origineel

- onze

- uit

- over

- overzicht

- pagina

- paginas

- Palo Alto

- Papier

- parameters

- Parijs

- patrick

- Patronen

- Paul

- prestatie

- uitgevoerd

- Peter

- Fysiek

- Fysica

- Pierre

- Plato

- Plato gegevensintelligentie

- PlatoData

- beleidsmaatregelen door te lezen.

- polosukhin

- potentieel

- Powering

- Prakash

- aanwezigheid

- presenteren

- het behoud van

- pers

- vorig

- probleem

- verwerking

- processors

- produceren

- Programma's

- veelbelovend

- voorstellen

- voorgestelde

- zorgen voor

- gepubliceerde

- uitgever

- uitgevers

- Reclame

- kwaliteit

- Quantum

- kwantumalgoritmen

- Quantumcomputer

- quantum computers

- quantum computing

- kwantuminformatie

- Quantum machine learning

- qubit

- R

- RUMMIE

- verhouding

- onlangs

- erkenning

- terugkerend

- referenties

- geregistreerd

- stoffelijk overschot

- vereisen

- Resultaten

- beoordelen

- Recensies

- Richard

- rots

- romain

- routing

- roy

- lopen

- runtime

- Ryan

- s

- Scale

- Wetenschap

- Wetenschap en Technologie

- wetenschappelijk

- scott

- Sean

- -Series

- reeks

- ondiep

- vertoonde

- Signaal

- Simon

- simulaties

- ZES

- Oplossingen

- Het oplossen van

- sommige

- Spectrum

- toespraak

- snelheid

- standaard

- state-of-the-art

- Staten

- Studie

- Met goed gevolg

- dergelijk

- geschikt

- Zon

- supergeleidend

- Enquête

- Systems

- taken

- Tay

- Technologie

- termijn

- termen

- tekst

- Tekstclassificatie

- dat

- De

- hun

- theoretisch

- theorie

- Deze

- ze

- dit

- thomas

- drie

- Tim

- niet de tijd of

- keer

- Titel

- naar

- getraind

- Trainingen

- Transacties

- transformaties

- transformator

- transformers

- vertalen

- Vertaling

- gevangen

- vallen

- twee

- types

- voor

- begrip

- unified

- unieke

- universiteit-

- bijgewerkt

- op

- URL

- USA

- toepassingen

- gebruik

- variëren

- wisselende

- voertuig

- zeer

- via

- visie

- volume

- W

- wang

- willen

- was

- we

- GOED

- welke

- Met

- hout

- woorden

- Mijn werk

- waard

- wu

- Ciao

- jaar

- Opbrengst

- YING

- You

- Yuan

- zephyrnet

- Zhao