Generatieve kunstmatige intelligentie (generatieve AI)-modellen hebben indrukwekkende mogelijkheden getoond bij het genereren van tekst, afbeeldingen en andere inhoud van hoge kwaliteit. Deze modellen vereisen echter enorme hoeveelheden schone, gestructureerde trainingsgegevens om hun volledige potentieel te bereiken. De meeste gegevens uit de echte wereld bestaan in ongestructureerde formaten zoals PDF's, waarvoor voorbewerking nodig is voordat deze effectief kunnen worden gebruikt.

Think IDCTegenwoordig zijn ongestructureerde data verantwoordelijk voor meer dan 80% van alle bedrijfsgegevens. Dit omvat formaten zoals e-mails, pdf's, gescande documenten, afbeeldingen, audio, video en meer. Hoewel deze gegevens waardevolle inzichten bevatten, maakt de ongestructureerde aard ervan het moeilijk voor AI-algoritmen om deze te interpreteren en ervan te leren. Volgens een Onderzoek 2019 door Deloittegaf slechts 18% van de bedrijven aan voordeel te kunnen halen uit ongestructureerde data.

Naarmate de adoptie van AI blijft versnellen, wordt het ontwikkelen van efficiënte mechanismen voor het verwerken en leren van ongestructureerde gegevens in de toekomst nog belangrijker. Dit kan gepaard gaan met betere voorverwerkingshulpmiddelen, semi-gecontroleerde leertechnieken en vooruitgang in de verwerking van natuurlijke taal. Bedrijven die hun ongestructureerde data het meest effectief gebruiken, zullen aanzienlijke concurrentievoordelen behalen uit AI. Schone gegevens zijn belangrijk voor goede modelprestaties. Geëxtraheerde teksten bevatten nog steeds grote hoeveelheden wartaal en standaardtekst (lees bijvoorbeeld HTML). Geschrapte gegevens van internet bevatten vaak veel doublures. Gegevens van sociale media, recensies of door gebruikers gegenereerde inhoud kunnen ook giftige en bevooroordeelde inhoud bevatten, en het kan zijn dat u deze eruit moet filteren met behulp van enkele voorverwerkingsstappen. Er kan ook veel inhoud van lage kwaliteit of door bots gegenereerde teksten zijn, die kunnen worden uitgefilterd met behulp van de bijbehorende metagegevens (bijvoorbeeld door reacties van de klantenservice eruit te filteren die lage klantbeoordelingen hebben gekregen).

Gegevensvoorbereiding is belangrijk in meerdere fasen van Retrieval Augmented Generation (VOD) modellen. De kennisbrondocumenten moeten worden voorbewerkt, zoals het opschonen van tekst en het genereren van semantische inbedding, zodat ze efficiënt kunnen worden geïndexeerd en opgehaald. De zoekopdracht in natuurlijke taal van de gebruiker vereist ook voorbewerking, zodat deze in een vector kan worden gecodeerd en kan worden vergeleken met documentinsluitingen. Nadat relevante contexten zijn opgehaald, hebben ze mogelijk extra voorbewerking nodig, zoals afkappen, voordat ze worden samengevoegd met de zoekopdracht van de gebruiker om de laatste prompt voor het basismodel te maken. Amazon SageMaker-canvas ondersteunt nu uitgebreide mogelijkheden voor gegevensvoorbereiding, mogelijk gemaakt door Amazon SageMaker-gegevens Wrangler. Met deze integratie biedt SageMaker Canvas klanten een end-to-end werkruimte zonder code om data voor te bereiden, ML en basismodellen te bouwen en te gebruiken om de tijd van data naar zakelijke inzichten te versnellen. U kunt nu eenvoudig gegevens uit meer dan 50 gegevensbronnen ontdekken en samenvoegen, en gegevens verkennen en voorbereiden met behulp van meer dan 300 ingebouwde analyses en transformaties in de visuele interface van SageMaker Canvas.

Overzicht oplossingen

In dit bericht werken we met een PDF-documentatiedataset:Amazonebodem gebruikershandleiding. Verder laten we zien hoe u een dataset voor RAG voorbewerkt. Concreet reinigen we de gegevens en creëren we RAG-artefacten om de vragen over de inhoud van de dataset te beantwoorden. Beschouw het volgende machine learning-probleem (ML): de gebruiker stelt een vraag over een groot taalmodel (LLM): "Hoe modellen filteren en doorzoeken in Amazon Bedrock?". LLM heeft de documentatie niet gezien tijdens de trainings- of verfijningsfase, zou de vraag dus niet kunnen beantwoorden en zal hoogstwaarschijnlijk hallucineren. Ons doel met dit bericht is om een relevant stuk tekst uit de PDF (dat wil zeggen RAG) te vinden en dit aan de prompt toe te voegen, waardoor LLM vragen kan beantwoorden die specifiek zijn voor dit document.

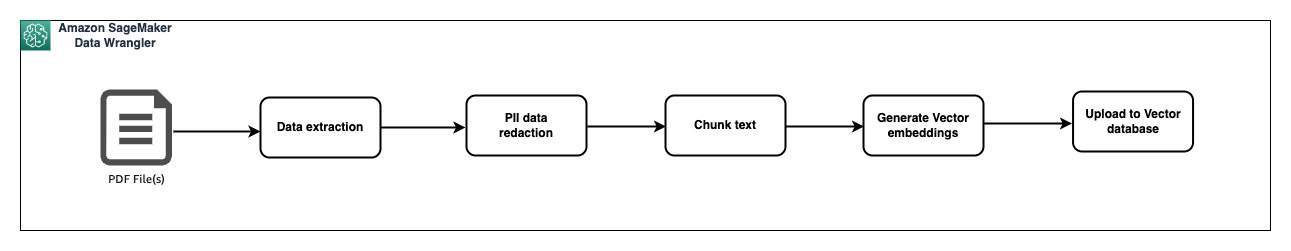

Hieronder laten we zien hoe u al deze belangrijke voorbewerkingsstappen kunt uitvoeren Amazon SageMaker-canvas (aangedreven door Amazon SageMaker-gegevens Wrangler):

- Tekst extraheren uit een PDF-document (mogelijk gemaakt door Textract)

- Gevoelige informatie verwijderen (mogelijk gemaakt door Comprehend)

- Knip tekst in stukjes.

- Maak insluitingen voor elk stuk (mogelijk gemaakt door Bedrock).

- Insluiting uploaden naar een vectordatabase (mogelijk gemaakt door OpenSearch)

Voorwaarden

Voor deze walkthrough moet u het volgende hebben:

Note: Maak OpenSearch Service-domeinen aan volgens de instructies hier. Laten we voor de eenvoud de optie kiezen met een hoofdgebruikersnaam en wachtwoord voor fijnmazige toegangscontrole. Zodra het domein is gemaakt, maakt u een vectorindex met de volgende toewijzingen, en vectordimensie 1536 wordt uitgelijnd met de inbedding van Amazon Titan:

walkthrough

Bouw een gegevensstroom

In dit gedeelte bespreken we hoe we een gegevensstroom kunnen opbouwen om tekst en metagegevens uit PDF's te extraheren, de gegevens op te schonen en te verwerken, insluitingen te genereren met Amazon Bedrock en de gegevens te indexeren in Amazon OpenSearch.

Start SageMaker Canvas

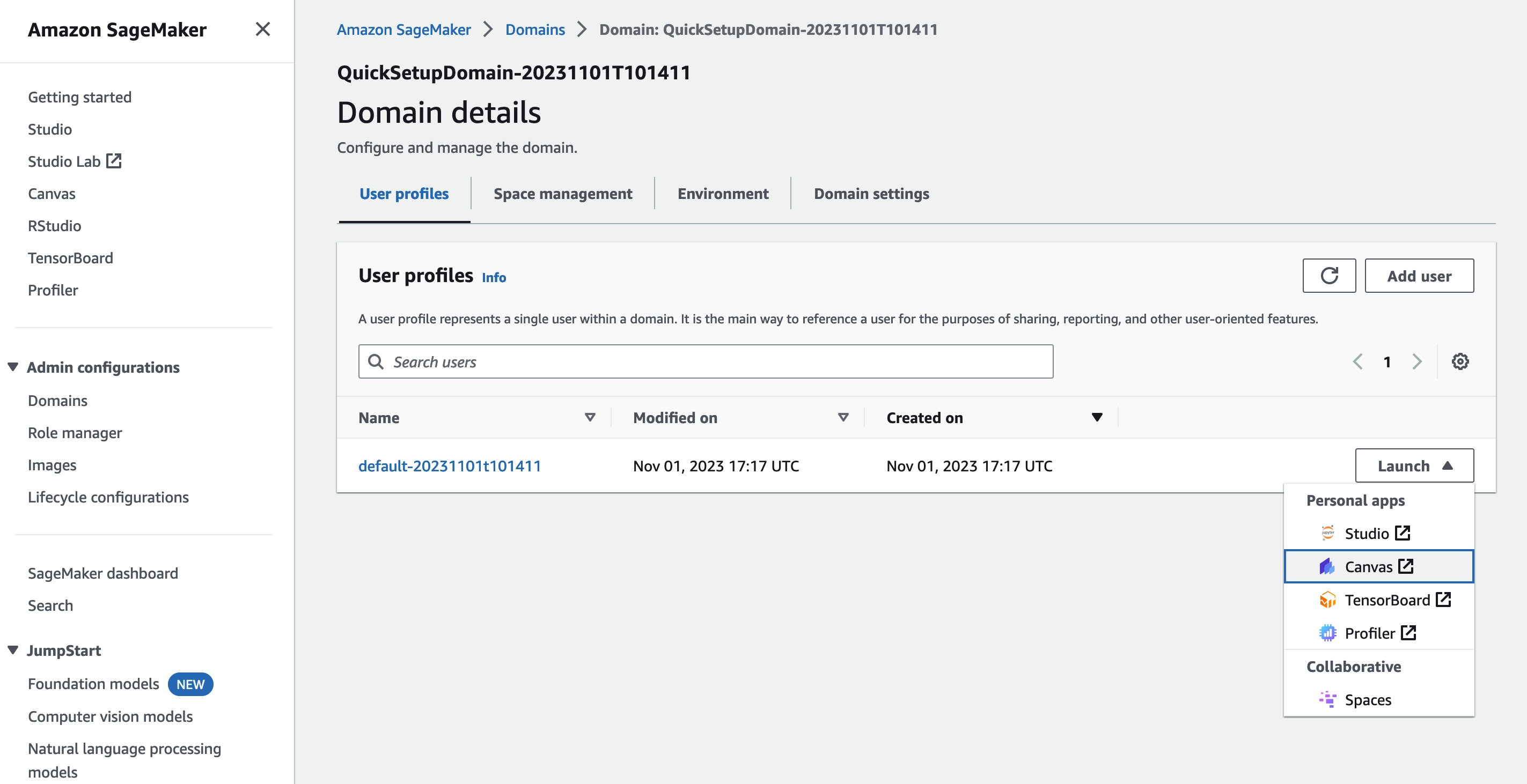

Voer de volgende stappen uit om SageMaker Canvas te starten:

- Op de Amazone SageMaker-console, kiezen domeinen in het navigatievenster.

- Kies uw domein.

- Kies in het startmenu Canvas print.

Maak een gegevensstroom

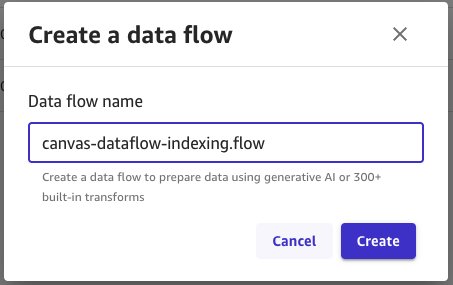

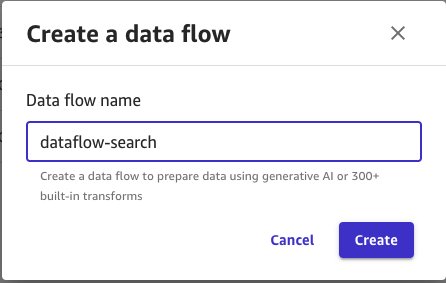

Voer de volgende stappen uit om een gegevensstroom in SageMaker Canvas te maken:

- Kies op de startpagina van SageMaker Canvas Gegevens Wrangler.

- Kies creëren aan de rechterkant van de pagina, geef vervolgens een naam voor de gegevensstroom op en selecteer creëren.

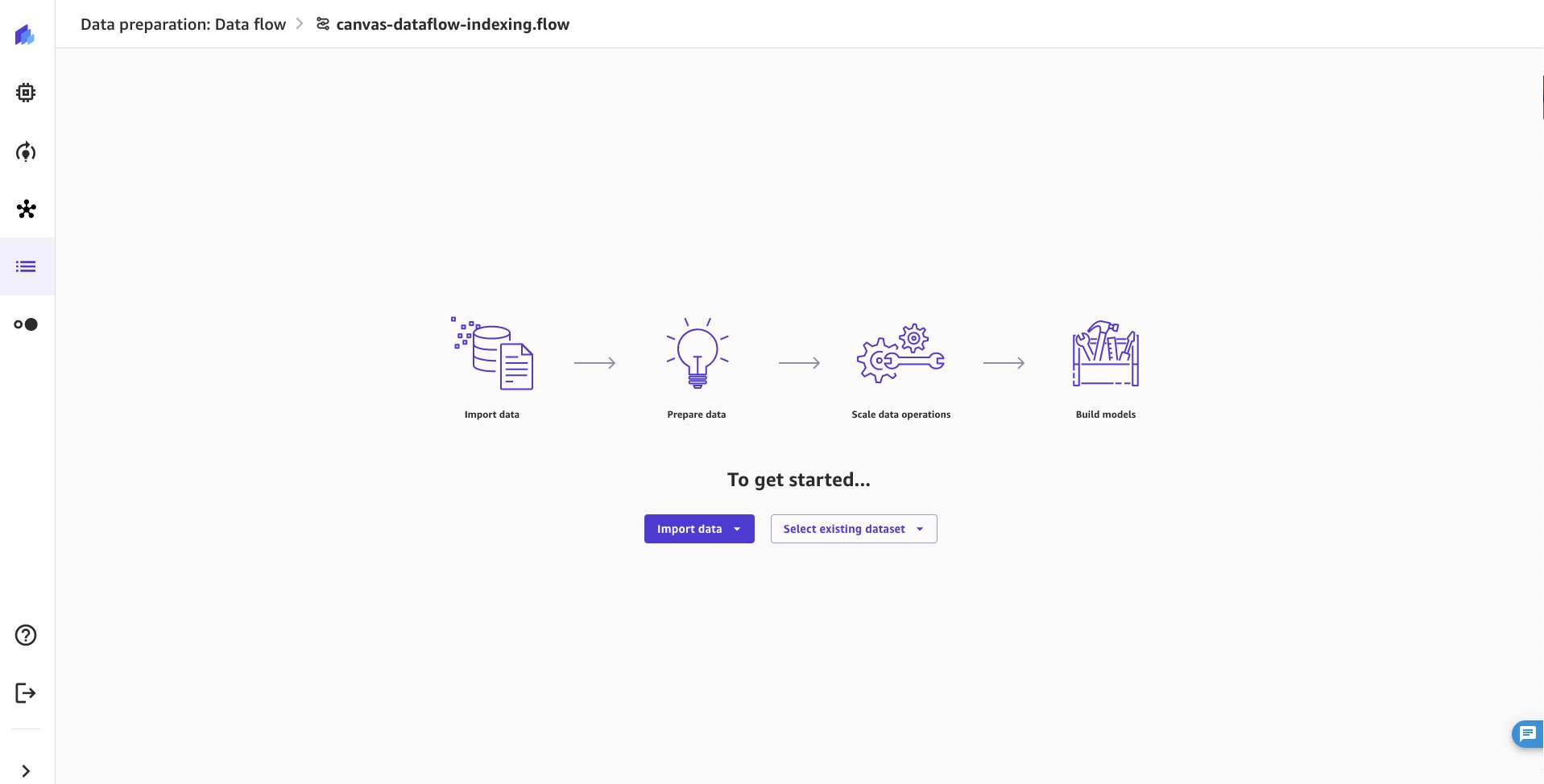

- Dit komt terecht op een gegevensstroompagina.

- Kies Datums importeren, selecteer tabelgegevens.

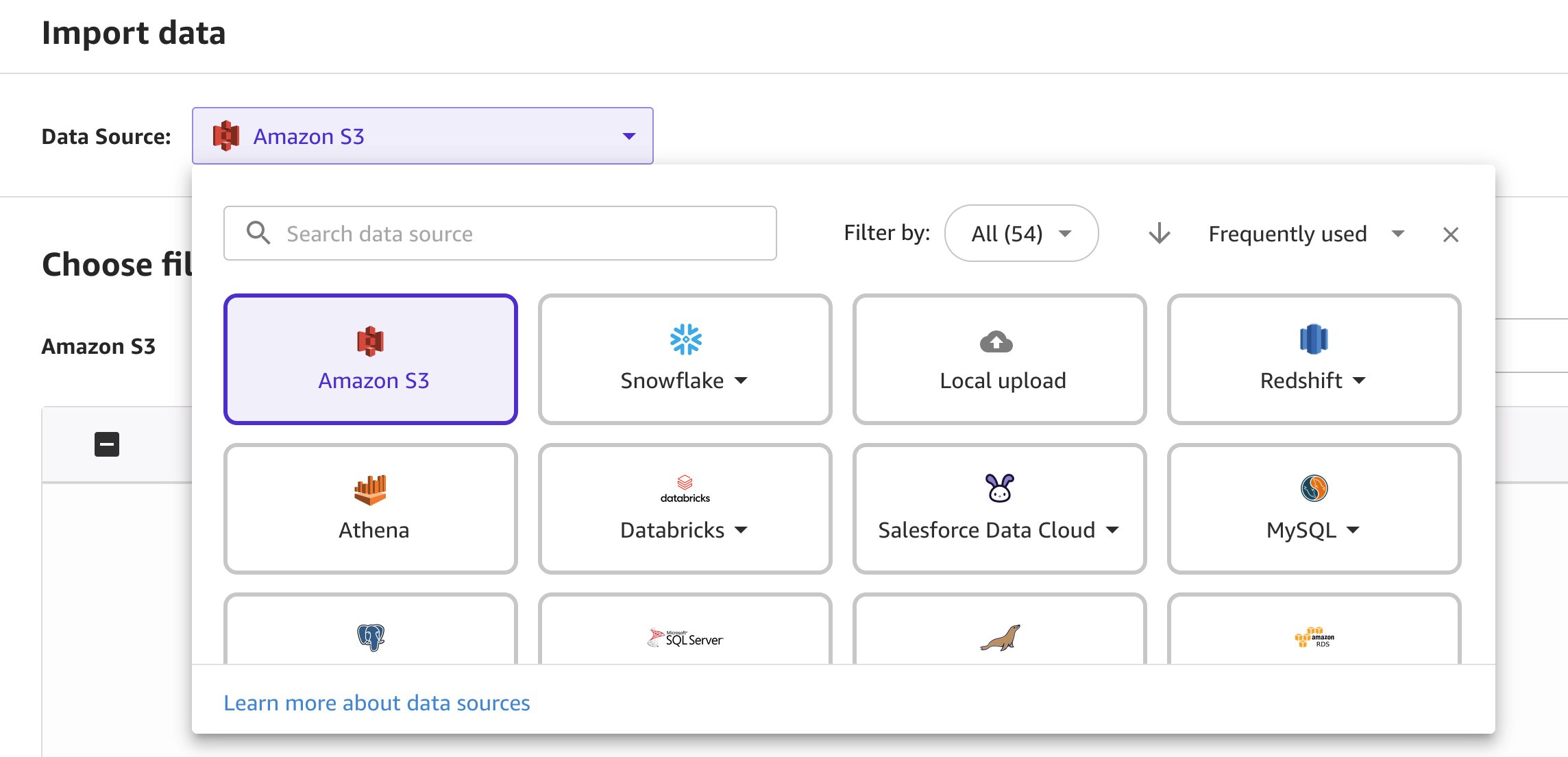

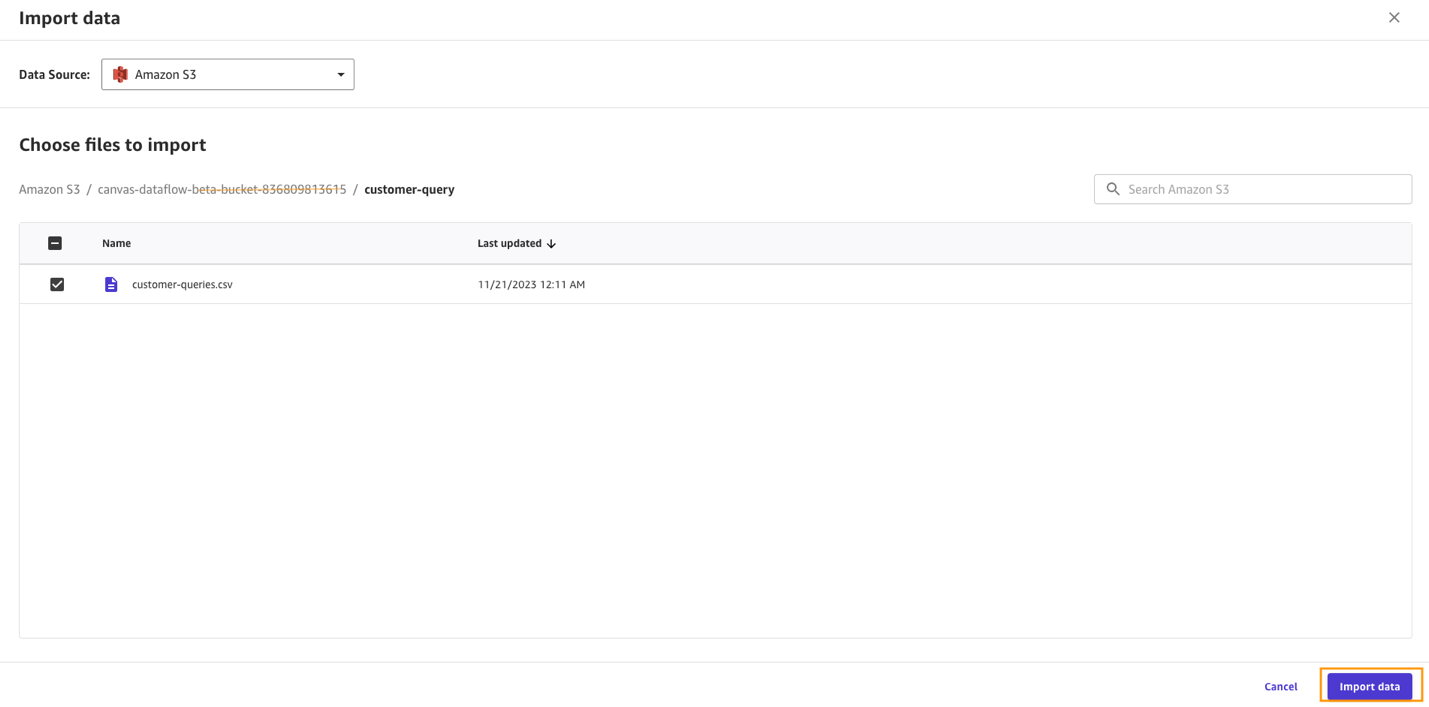

Laten we nu de gegevens uit de Amazon S3-bucket importeren:

- Kies Datums importeren en selecteer tabellarisch uit de vervolgkeuzelijst.

- Databron en selecteer Amazon S3 uit de vervolgkeuzelijst.

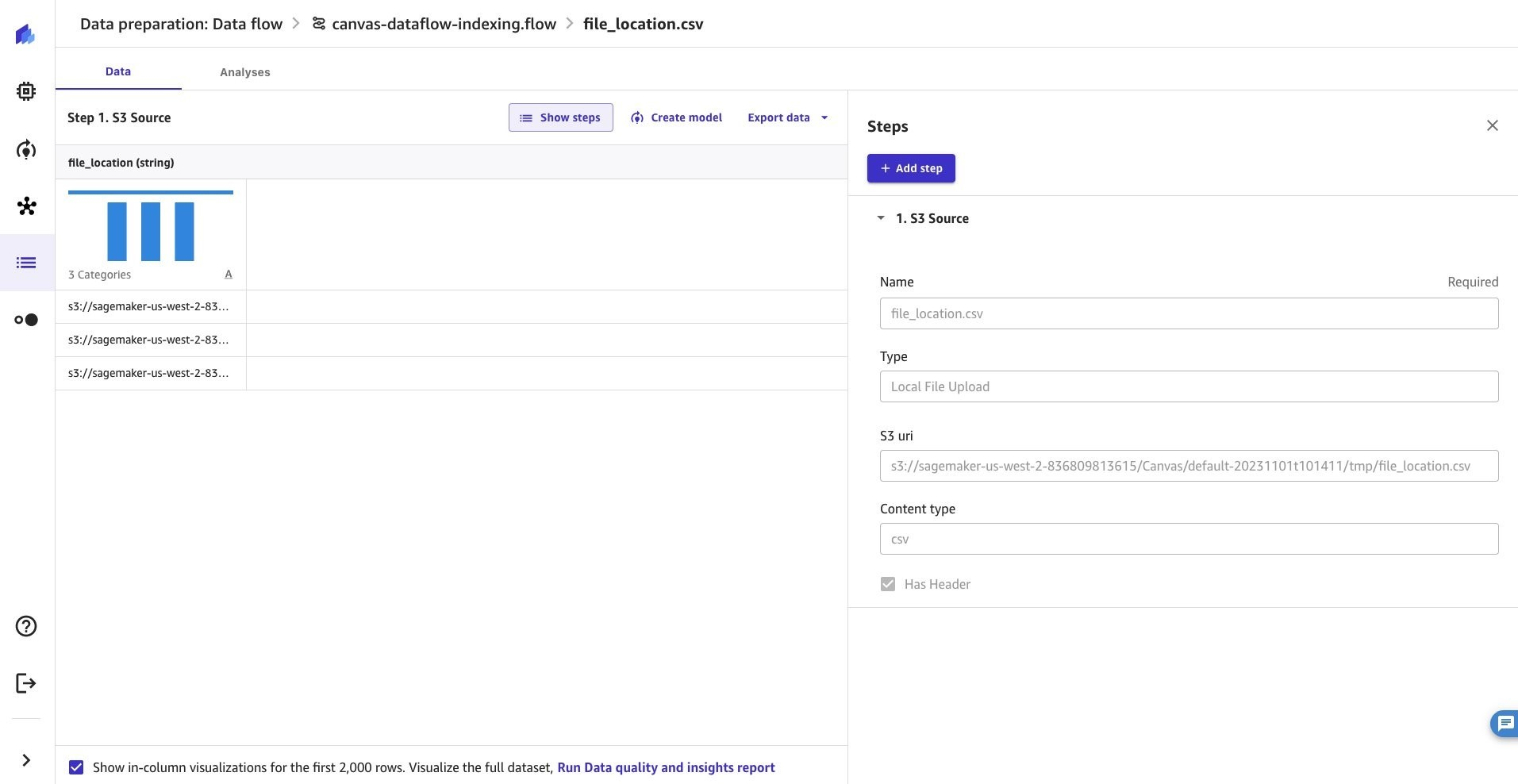

- Navigeer naar het metagegevensbestand met PDF-bestandslocaties en kies het bestand.

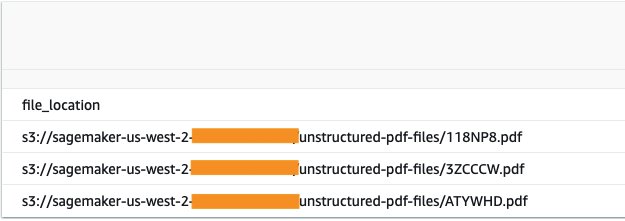

- Nu wordt het metadatabestand in de gegevensstroom voor gegevensvoorbereiding geladen en kunnen we doorgaan met het toevoegen van volgende stappen om de gegevens en index naar Amazon te transformeren OpenSearch. In dit geval heeft het bestand de volgende metagegevens, met de locatie van elk bestand in de Amazon S3-map.

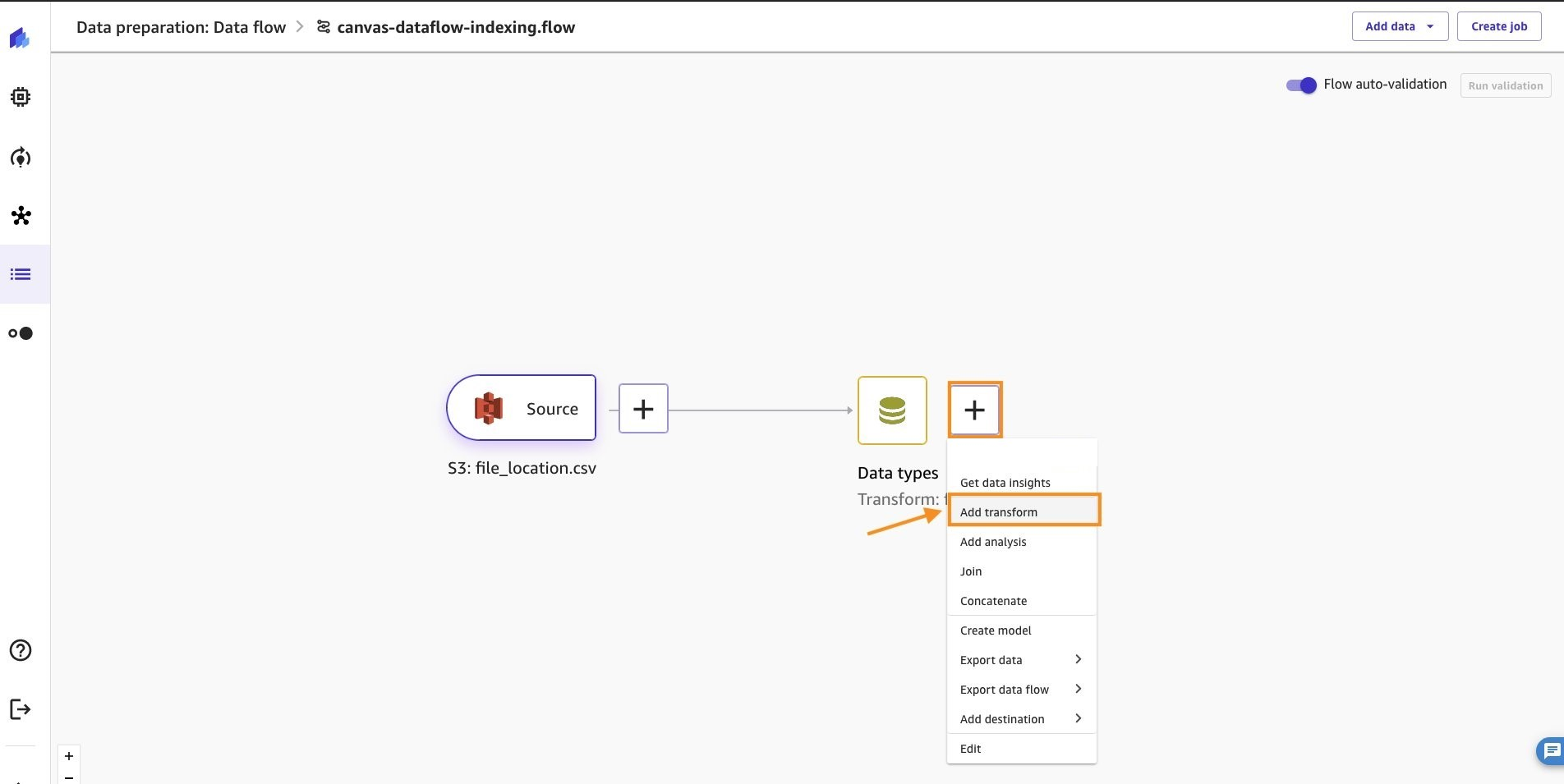

Voer de volgende stappen uit om een nieuwe transformatie toe te voegen:

- Kies het plusteken en kies Voeg Transform toe.

- Kies Stap toevoegen En kies Aangepaste transformatie.

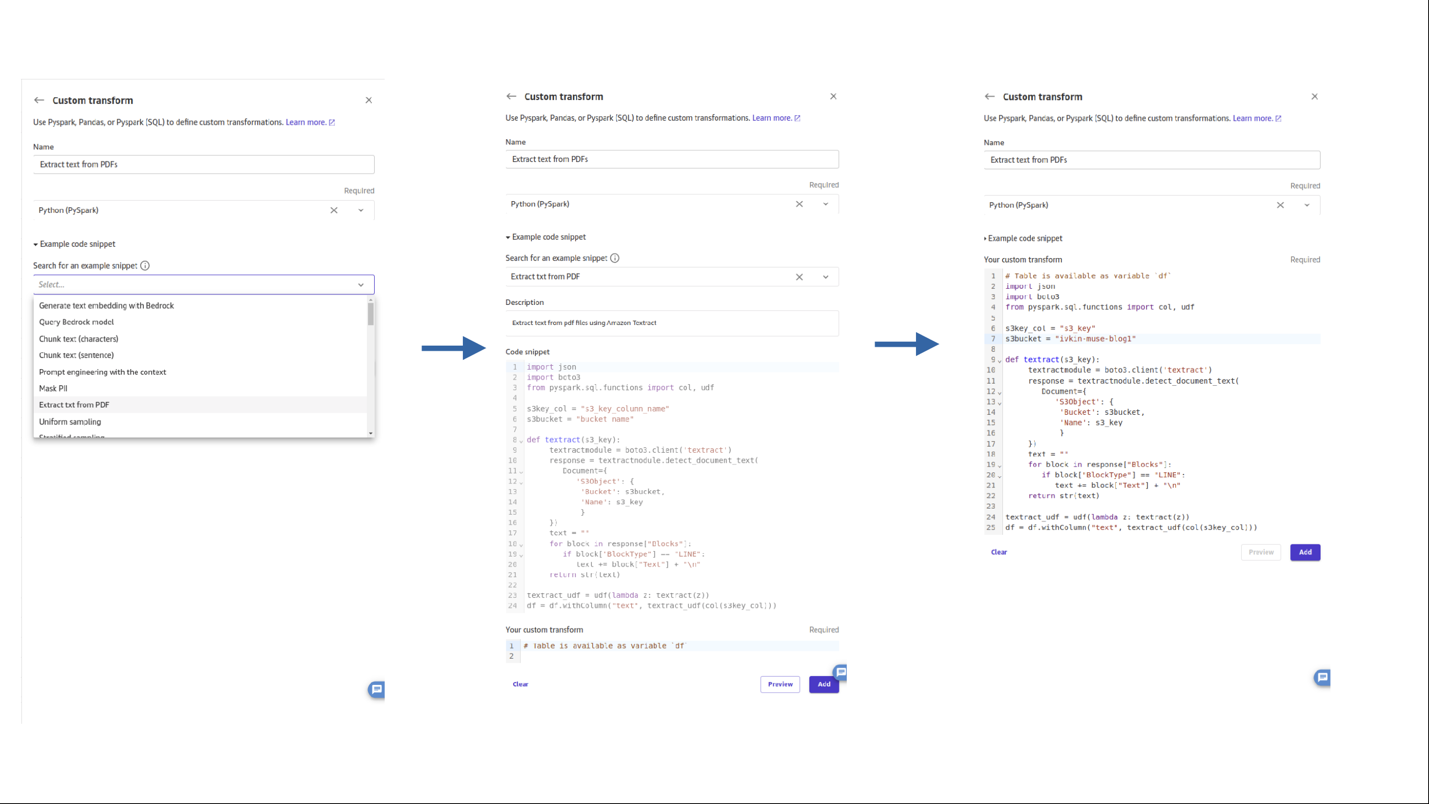

- U kunt een aangepaste transformatie maken met behulp van Pandas, PySpark, door de gebruiker gedefinieerde functies van Python en SQL PySpark. Kiezen Python (PySpark) voor deze gebruikssituatie.

- Voer een naam in voor de stap. Blader en selecteer uit de voorbeeldcodefragmenten tekst uit pdf extraheren. Breng de nodige wijzigingen aan in het codefragment en selecteer Toevoegen.

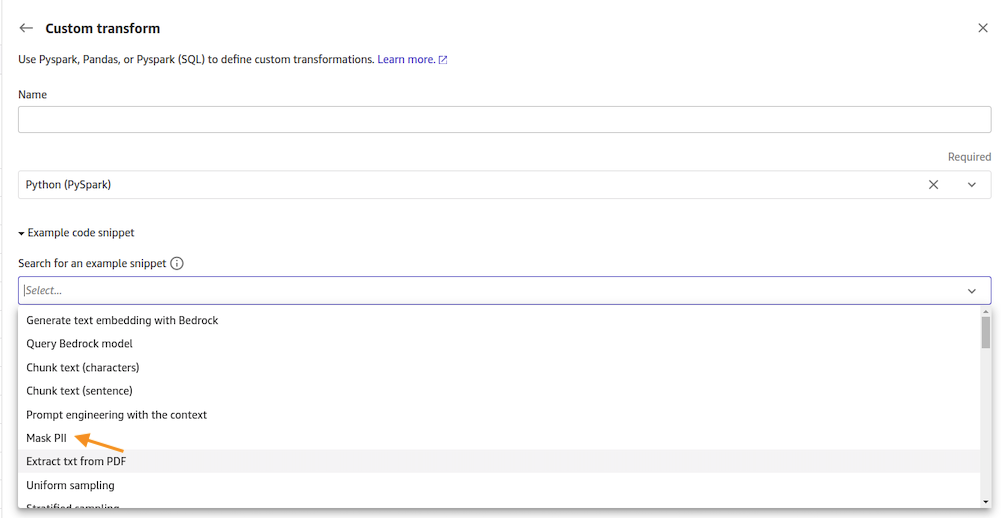

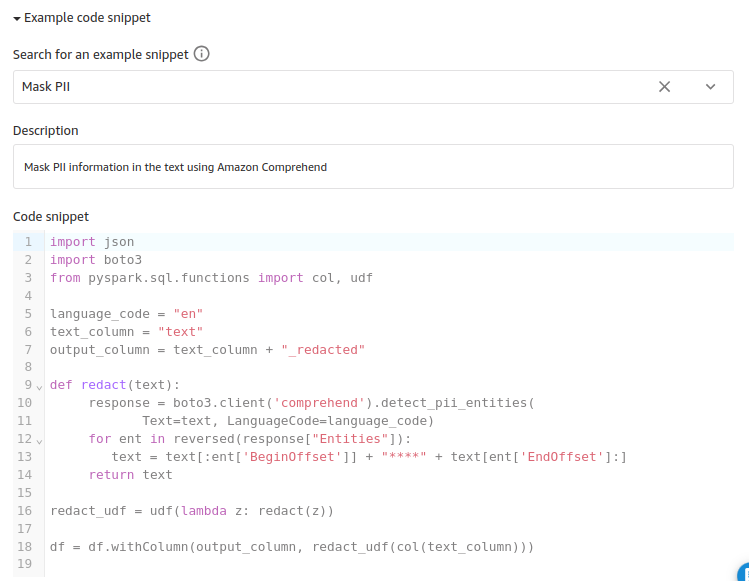

- Laten we een stap toevoegen om gegevens over persoonlijk identificeerbare informatie (PII) uit de geëxtraheerde gegevens te redigeren door gebruik te maken van Amazon begrijpt het. Kiezen Stap toevoegen En kies Aangepaste transformatie. En selecteer Python (PySpark).

Blader en selecteer uit de voorbeeldcodefragmenten masker PII. Breng de nodige wijzigingen aan in het codefragment en selecteer Toe te voegen.

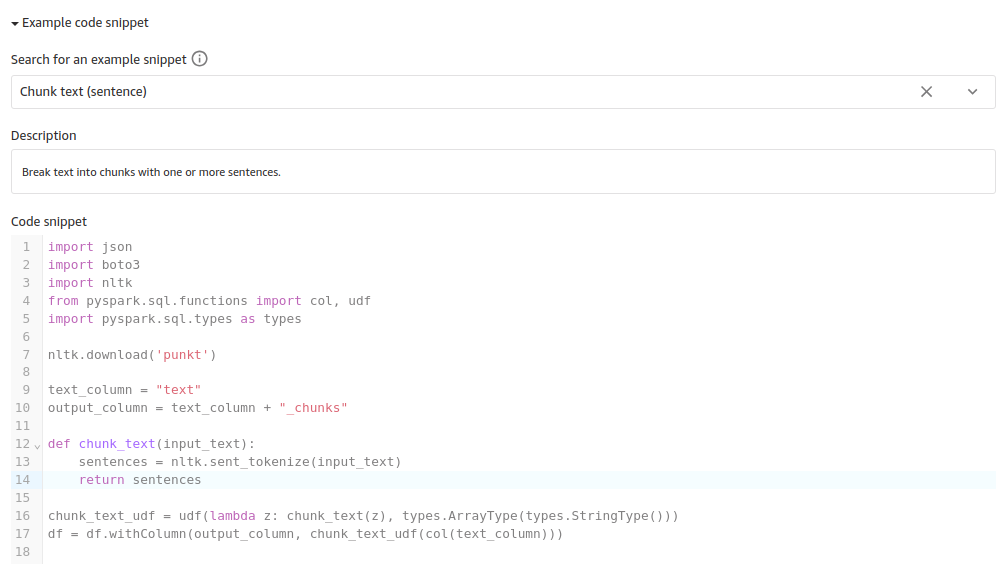

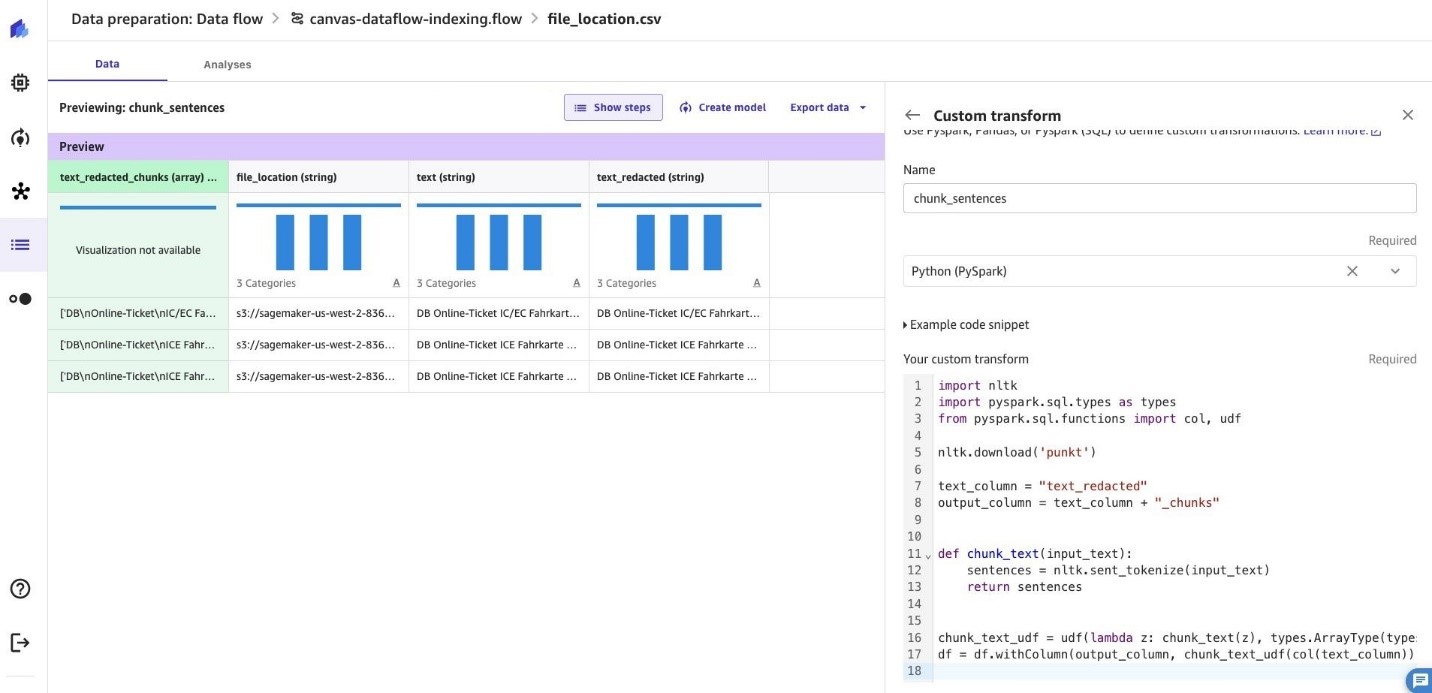

- De volgende stap is het opsplitsen van de tekstinhoud. Kiezen Stap toevoegen En kies Aangepaste transformatie. En selecteer Python (PySpark).

Blader en selecteer uit de voorbeeldcodefragmenten Stukje tekst. Breng de nodige wijzigingen aan in het codefragment en selecteer Toe te voegen.

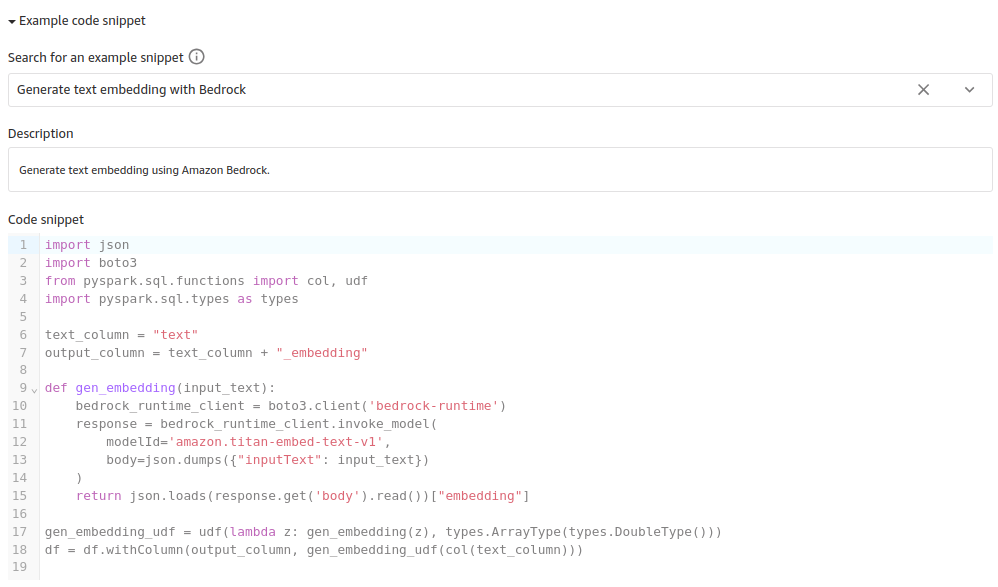

- Laten we de tekstinhoud converteren naar vectorinsluitingen met behulp van de Amazonebodem Titan Embeddings-model. Kiezen Stap toevoegen En kies Aangepaste transformatie. En selecteer Python (PySpark).

Blader en selecteer uit de voorbeeldcodefragmenten Genereer tekstinsluiting met Bedrock. Breng de nodige wijzigingen aan in het codefragment en selecteer Toe te voegen.

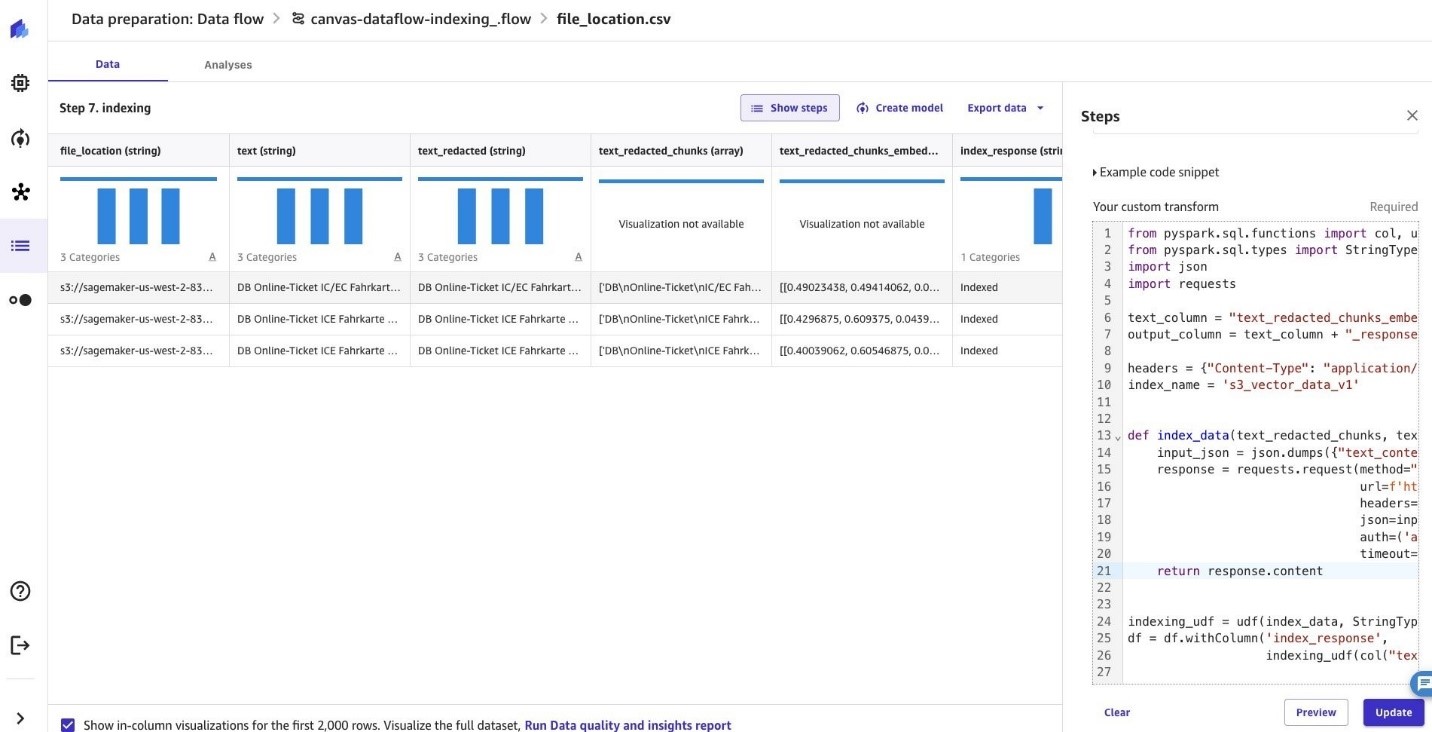

- Nu hebben we vectorinsluitingen beschikbaar voor de inhoud van het PDF-bestand. Laten we doorgaan en de gegevens indexeren in Amazon OpenSearch. Kiezen Stap toevoegen En kies Aangepaste transformatie. En selecteer Python (PySpark). U bent vrij om de volgende code te herschrijven om uw favoriete vectordatabase te gebruiken. Voor de eenvoud gebruiken we de hoofdgebruikersnaam en het wachtwoord om toegang te krijgen tot de OpenSearch API's. Voor productieworkloads selecteert u de optie op basis van uw organisatiebeleid.

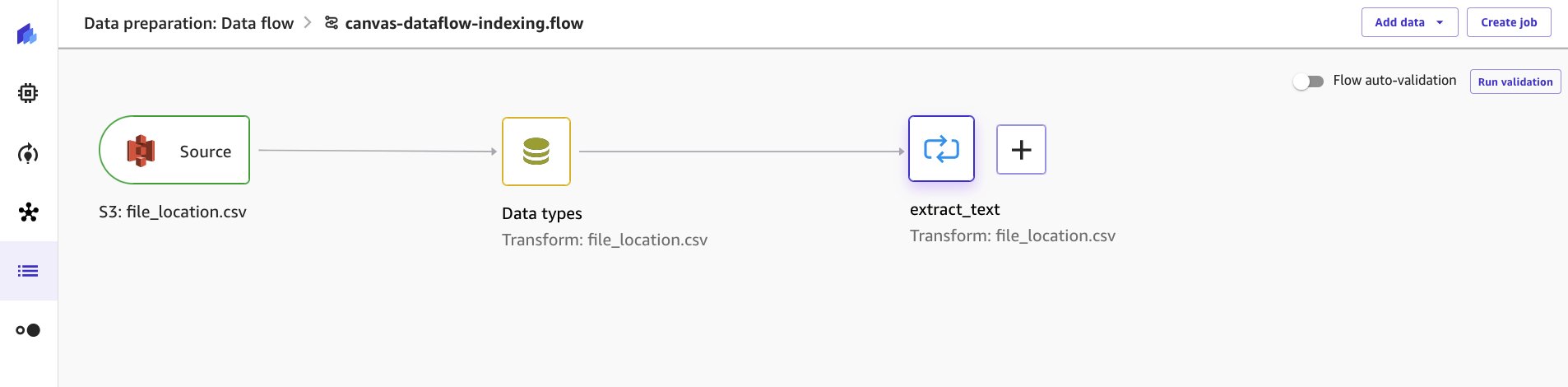

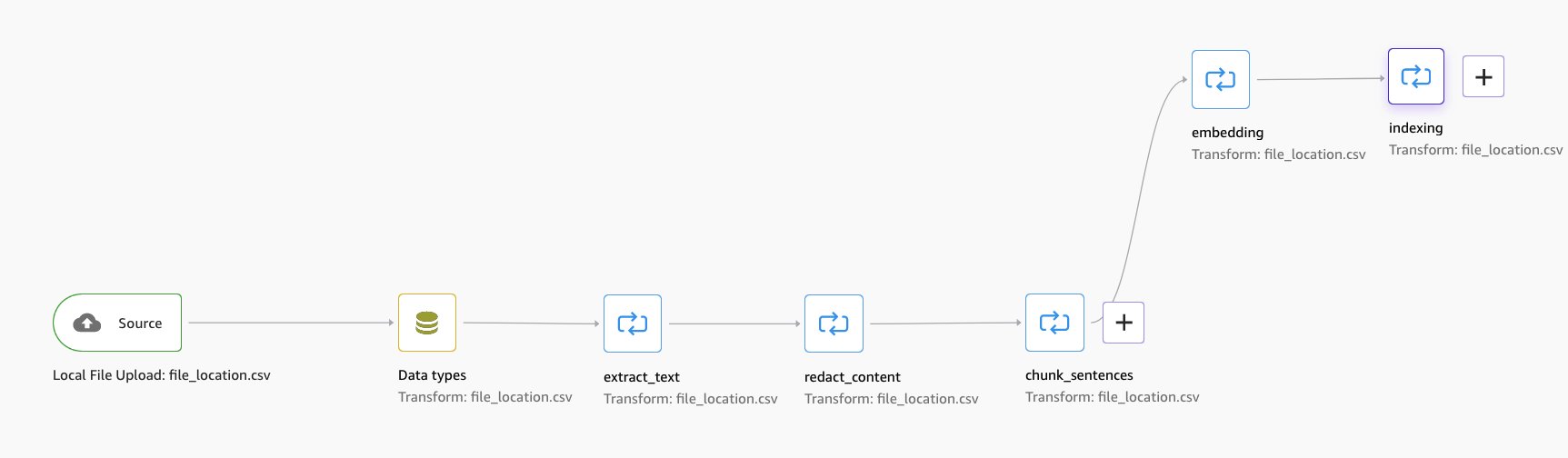

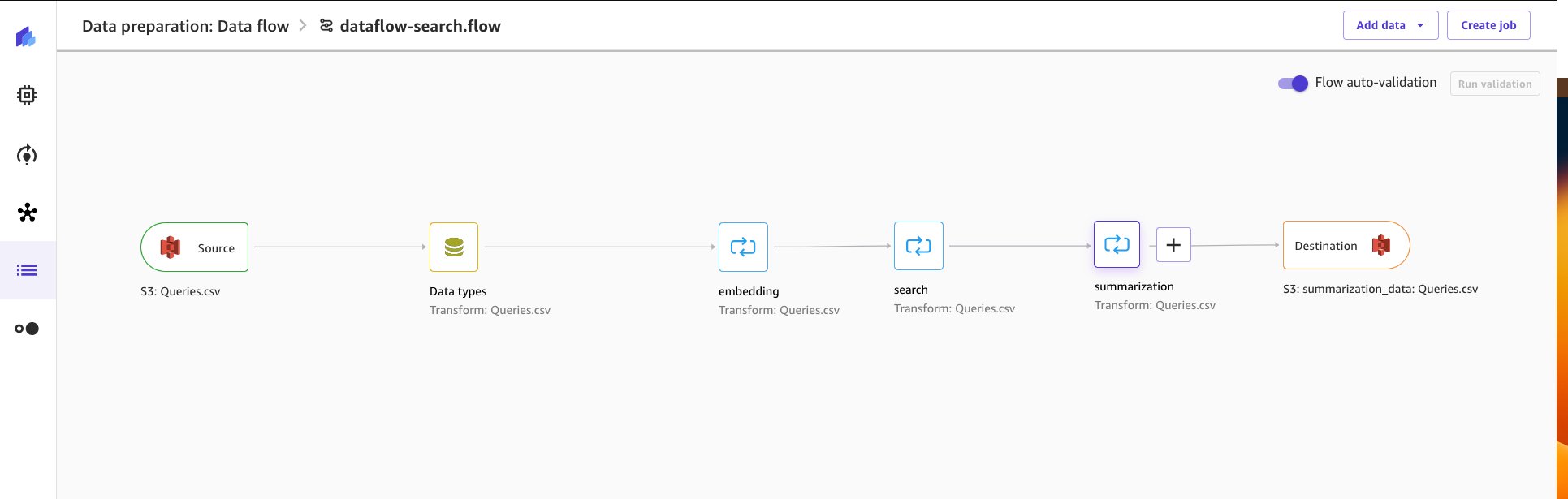

Ten slotte zou de gecreëerde gegevensstroom er als volgt uitzien:

Met deze gegevensstroom zijn de gegevens uit het PDF-bestand gelezen en geïndexeerd met vectorinsluitingen in Amazon OpenSearch. Nu is het tijd voor ons om een bestand met zoekopdrachten te maken om de geïndexeerde gegevens op te vragen en deze op te slaan op de Amazon S3-locatie. We verwijzen onze zoekgegevensstroom naar het bestand en voeren een bestand met bijbehorende resultaten uit in een nieuw bestand op een Amazon S3-locatie.

Een prompt voorbereiden

Nadat we een kennisbank van onze PDF hebben gemaakt, kunnen we deze testen door in de kennisbank naar enkele voorbeeldquery's te zoeken. We verwerken elke vraag als volgt:

- Genereer insluiting voor de zoekopdracht (mogelijk gemaakt door Amazon Bedrock)

- Queryvectordatabase voor de context van de dichtstbijzijnde buur (mogelijk gemaakt door Amazon OpenSearch)

- Combineer de query en de context in de prompt.

- Query LLM met een prompt (mogelijk gemaakt door Amazon Bedrock)

- Kies op de startpagina van SageMaker Canvas Data voorbereiding.

- Kies creëren aan de rechterkant van de pagina, geef vervolgens een naam voor de gegevensstroom op en selecteer creëren.

Laten we nu de gebruikersvragen laden en vervolgens een prompt maken door de vraag en soortgelijke documenten te combineren. Deze prompt wordt aan de LLM verstrekt om een antwoord op de gebruikersvraag te genereren.

- Laten we een csv-bestand met gebruikersvragen laden. Kiezen Data importeren en selecteer tabellarisch uit de vervolgkeuzelijst.

- Databron, en selecteer Amazon S3 uit de vervolgkeuzelijst. Als alternatief kunt u ervoor kiezen om een bestand met gebruikersquery's te uploaden.

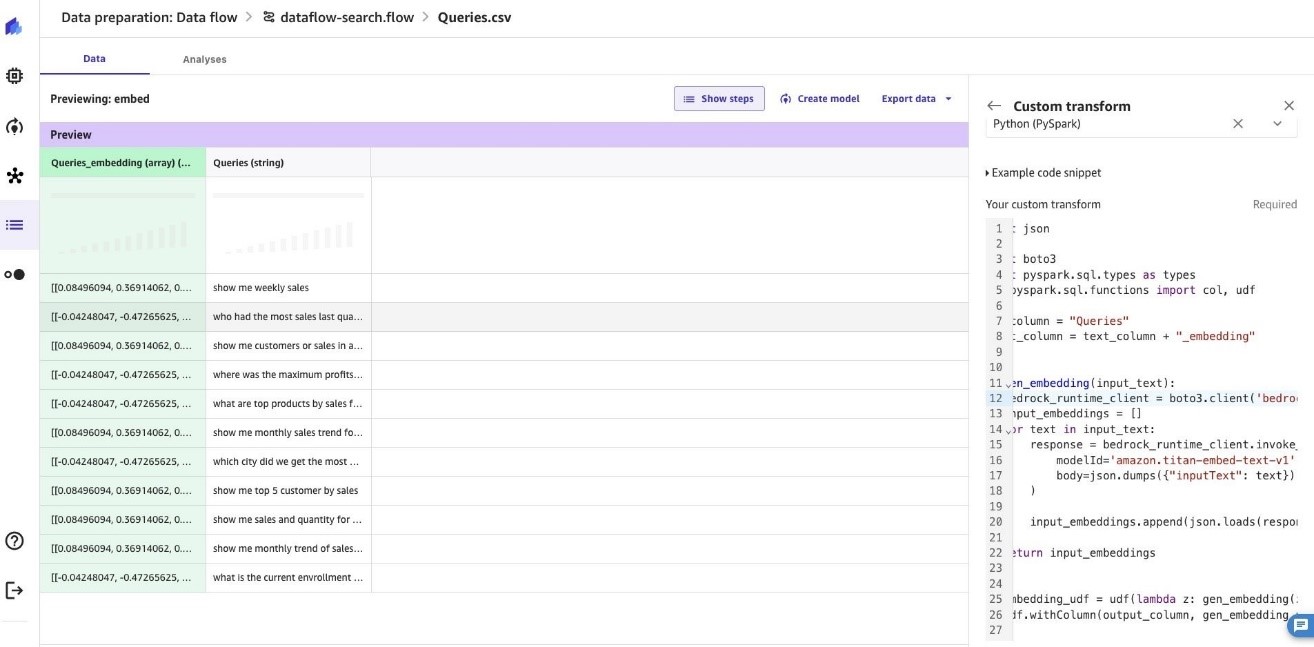

- Laten we een aangepaste transformatie toevoegen om de gegevens om te zetten in vector-insluitingen, gevolgd door het zoeken naar gerelateerde insluitingen van Amazon OpenSearch, voordat we een prompt naar Amazon Bedrock sturen met de zoekopdracht en context uit de kennisbank. Om insluitingen voor de query te genereren, kunt u hetzelfde voorbeeldcodefragment gebruiken Genereer tekstinsluiting met Bedrock vermeld in stap 7 hierboven.

Laten we de Amazon OpenSearch API aanroepen om relevante documenten te doorzoeken op de gegenereerde vectorinsluitingen. Voeg een aangepaste transformatie toe met Python (PySpark).

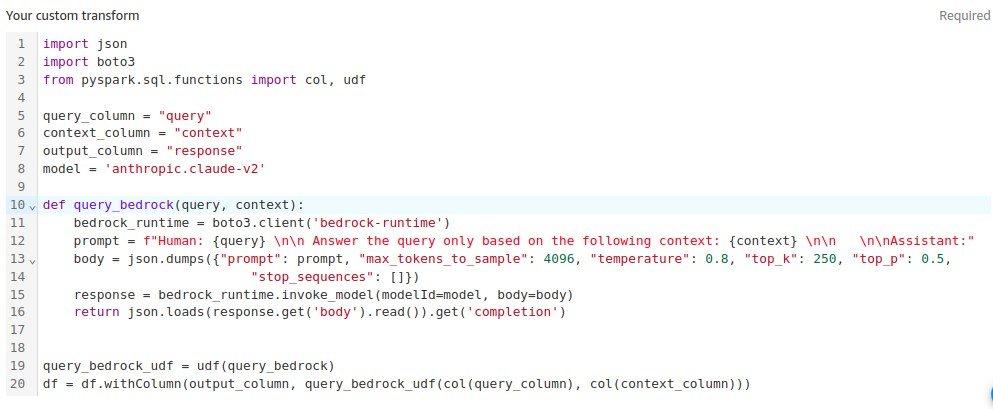

Laten we een aangepaste transformatie toevoegen om de Amazon Bedrock API aan te roepen voor antwoord op vragen, waarbij de documenten uit de Amazon OpenSearch-kennisbank worden doorgegeven. Blader en selecteer uit de voorbeeldcodefragmenten Query Bedrock met context. Breng de nodige wijzigingen aan in het codefragment en selecteer Toe te voegen.

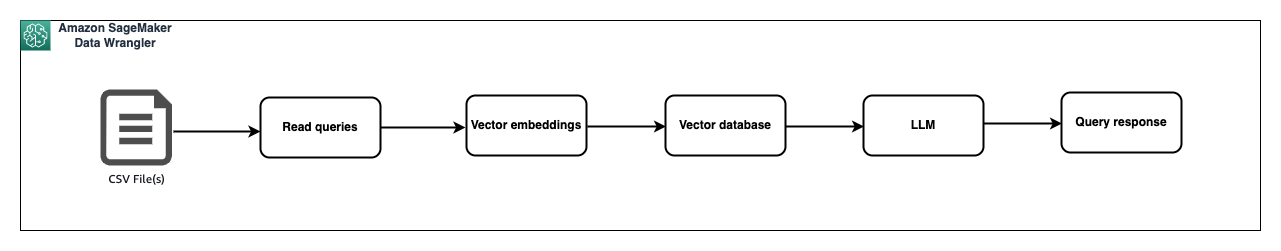

Samenvattend is de op RAG gebaseerde vraag- en antwoordgegevensstroom als volgt:

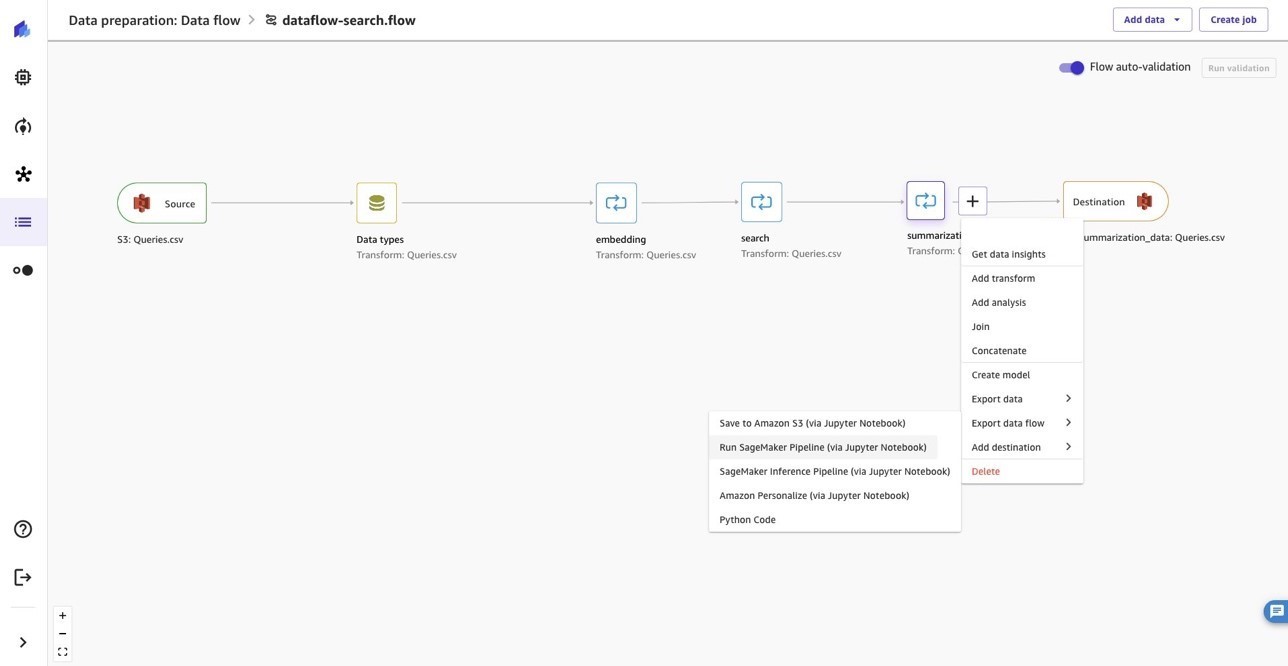

ML-beoefenaars besteden veel tijd aan het maken van feature-engineeringcode, het toepassen ervan op hun initiële datasets, het trainen van modellen op de ontwikkelde datasets en het evalueren van de nauwkeurigheid van het model. Gezien het experimentele karakter van dit werk leidt zelfs het kleinste project tot meerdere iteraties. Dezelfde functie-engineeringcode wordt vaak steeds opnieuw uitgevoerd, waardoor tijd en computerbronnen worden verspild aan het herhalen van dezelfde bewerkingen. In grote organisaties kan dit een nog groter productiviteitsverlies veroorzaken, omdat verschillende teams vaak identieke taken uitvoeren of zelfs dubbele feature-engineeringcode schrijven omdat ze geen kennis hebben van eerder werk. Om te voorkomen dat functies opnieuw worden verwerkt, exporteren we onze gegevensstroom naar een Amazon SageMaker-pijplijn. Laten we het selecteren + knop rechts van de zoekopdracht. Selecteer gegevensstroom exporteren en kies Voer de SageMaker-pijplijn uit (via Jupyter-notebook).

Schoonmaken

Om te voorkomen dat er in de toekomst kosten in rekening worden gebracht, verwijdert of sluit u de bronnen af die u hebt gemaakt tijdens het volgen van dit bericht. Verwijzen naar Afmelden bij Amazon SageMaker Canvas voor meer details.

Conclusie

In dit bericht hebben we je laten zien hoe de end-to-end-mogelijkheden van Amazon SageMaker Canvas worden benut door de rol op zich te nemen van een dataprofessional die gegevens voorbereidt voor een LLM. De interactieve gegevensvoorbereiding maakte het snel opschonen, transformeren en analyseren van de gegevens mogelijk om informatieve functies te ontwikkelen. Door codeercomplexiteit weg te nemen, maakte SageMaker Canvas snelle iteratie mogelijk om een hoogwaardige trainingsdataset te creëren. Deze versnelde workflow leidde rechtstreeks tot het bouwen, trainen en implementeren van een performant machine learning-model voor zakelijke impact. Met zijn uitgebreide datavoorbereiding en uniforme ervaring van data tot inzichten stelt SageMaker Canvas gebruikers in staat hun ML-resultaten te verbeteren.

We moedigen u aan om meer te leren door te verkennen Amazon SageMaker-gegevens Wrangler, Amazon SageMaker-canvas, Amazone Titan modellen Amazonebodemen Amazon OpenSearch-service om een oplossing te bouwen met behulp van de voorbeeldimplementatie in dit bericht en een dataset die relevant is voor uw bedrijf. Als u vragen of suggesties heeft, kunt u een reactie achterlaten.

Over de auteurs

Ajjay Govindaram is Senior Solutions Architect bij AWS. Hij werkt met strategische klanten die AI/ML gebruiken om complexe bedrijfsproblemen op te lossen. Zijn ervaring ligt in het geven van technische leiding en ontwerpondersteuning voor bescheiden tot grootschalige implementaties van AI/ML-applicaties. Zijn kennis reikt van applicatie-architectuur tot big data, analytics en machine learning. Hij luistert graag naar muziek terwijl hij rust, het buitenleven ervaart en tijd doorbrengt met zijn dierbaren.

Ajjay Govindaram is Senior Solutions Architect bij AWS. Hij werkt met strategische klanten die AI/ML gebruiken om complexe bedrijfsproblemen op te lossen. Zijn ervaring ligt in het geven van technische leiding en ontwerpondersteuning voor bescheiden tot grootschalige implementaties van AI/ML-applicaties. Zijn kennis reikt van applicatie-architectuur tot big data, analytics en machine learning. Hij luistert graag naar muziek terwijl hij rust, het buitenleven ervaart en tijd doorbrengt met zijn dierbaren.

Nikita Ivkin is een Senior Applied Scientist bij Amazon SageMaker Data Wrangler met interesse in machine learning en algoritmen voor het opschonen van gegevens.

Nikita Ivkin is een Senior Applied Scientist bij Amazon SageMaker Data Wrangler met interesse in machine learning en algoritmen voor het opschonen van gegevens.

- Door SEO aangedreven content en PR-distributie. Word vandaag nog versterkt.

- PlatoData.Network Verticale generatieve AI. Versterk jezelf. Toegang hier.

- PlatoAiStream. Web3-intelligentie. Kennis versterkt. Toegang hier.

- PlatoESG. carbon, CleanTech, Energie, Milieu, Zonne, Afvalbeheer. Toegang hier.

- Plato Gezondheid. Intelligentie op het gebied van biotech en klinische proeven. Toegang hier.

- Bron: https://aws.amazon.com/blogs/machine-learning/simplify-data-prep-for-gen-ai-with-amazon-sagemaker-data-wrangler/

- : heeft

- :is

- :niet

- 100

- 14

- 20

- 25

- 28

- 50

- 7

- 8

- 804

- a

- in staat

- Over

- boven

- versnellen

- versneld

- toegang

- Volgens

- accounts

- nauwkeurigheid

- toevoegen

- Extra

- Adoptie

- voorschotten

- Voordeel

- voordelen

- Na

- weer

- aggregaat

- vooruit

- AI

- AI / ML

- algoritmen

- Lijnt uit

- Alles

- toegestaan

- ook

- Amazone

- Amazon Sage Maker

- Amazon SageMaker-gegevens Wrangler

- Amazon Web Services

- hoeveelheden

- an

- analyses

- analytics

- het analyseren van

- en

- beantwoorden

- elke

- api

- Aanvraag

- toegepast

- Het toepassen van

- architectuur

- ZIJN

- kunstmatig

- kunstmatige intelligentie

- AS

- Hulp

- At

- hechten

- audio

- aangevuld

- Beschikbaar

- vermijd

- AWS

- baseren

- gebaseerde

- BE

- omdat

- wordt

- geweest

- vaardigheden

- wezen

- Betere

- vooringenomen

- Groot

- Big data

- bouw

- Gebouw

- ingebouwd

- bedrijfsdeskundigen

- ondernemingen

- by

- Bellen

- CAN

- canvas

- mogelijkheden

- geval

- Veroorzaken

- Wijzigingen

- lasten

- Kies

- schoon

- Schoonmaak

- code

- codering

- combineren

- commentaar

- Bedrijven

- vergeleken

- concurrerend

- compleet

- complex

- complexiteit

- begrijpen

- uitgebreid

- Berekenen

- Overwegen

- troosten

- bevatten

- bevat

- content

- inhoud

- verband

- contexten

- blijft

- onder controle te houden

- converteren

- Overeenkomend

- kon

- deksel

- en je merk te creëren

- aangemaakt

- kritisch

- gewoonte

- klant

- Klantenservice

- Klanten

- gegevens

- Data voorbereiding

- Database

- datasets

- deloitte

- gedemonstreerd

- het inzetten

- implementaties

- Design

- gegevens

- het ontwikkelen van

- anders

- moeilijk

- Afmeting

- richting

- direct

- Onthul Nu

- do

- document

- documentatie

- documenten

- domein

- domeinen

- beneden

- gedurende

- e

- elk

- gemakkelijk

- effectief

- doeltreffend

- efficiënt

- e-mails

- inbedding

- machtigt

- ingeschakeld

- waardoor

- aanmoedigen

- eind tot eind

- ingenieur

- ontworpen

- Engineering

- evalueren

- Zelfs

- voorbeeld

- bestaat

- ervaring

- het ervaren van

- experimenteel

- Verken

- Verkennen

- exporteren

- extract

- Kenmerk

- Voordelen

- weinig

- Velden

- Dien in

- filter

- finale

- VIND DE PLEK DIE PERFECT VOOR JOU IS

- stroom

- gevolgd

- volgend

- volgt

- Voor

- Forbes

- Foundation

- Stichtingen

- Gratis

- oppompen van

- vol

- functies

- verder

- toekomst

- Krijgen

- voortbrengen

- gegenereerde

- het genereren van

- generatie

- generatief

- generatieve AI

- krijgen

- Geven

- gegeven

- Globaal

- Go

- doel

- goed

- meer

- Hebben

- he

- headers

- hoogwaardige

- zijn

- houdt

- Home

- Hoe

- How To

- Echter

- HTML

- HTTPS

- i

- identiek

- if

- afbeeldingen

- Impact

- uitvoering

- importeren

- belangrijk

- indrukwekkend

- verbeteren

- in

- omvat

- index

- geïndexeerd

- informatie

- leerzaam

- eerste

- inzichten

- instructies

- integratie

- Intelligentie

- interactieve

- belangen

- Interface

- Internet

- in

- betrekken

- IT

- herhaling

- iteraties

- HAAR

- Vacatures

- jpg

- json

- kennis

- Land

- taal

- Groot

- grootschalig

- lancering

- Leads

- LEARN

- leren

- Verlof

- LED

- leveraging

- ligt

- als

- Lijst

- Het luisteren

- LLM

- laden

- plaats

- locaties

- uit

- lot

- hield

- Laag

- machine

- machine learning

- Hoofd

- maken

- MERKEN

- maskeren

- massief

- meester

- Mei..

- mechanismen

- Media

- Menu

- meta

- Metadata

- ML

- model

- modellen

- bescheiden

- meer

- meest

- meervoudig

- Muziek

- naam

- Naturel

- Natural Language Processing

- NATUUR

- Navigatie

- noodzakelijk

- Noodzaak

- New

- volgende

- geen

- notitieboekje

- nu

- of

- vaak

- on

- eens

- degenen

- Slechts

- Operations

- Keuze

- or

- organisatie

- organisaties

- Overige

- onze

- uit

- resultaten

- buiten

- uitgang

- over

- pagina

- panda's

- brood

- Voorbijgaand

- Wachtwoord

- prestatie

- persoonlijk

- kiezen

- stuk

- stukken

- pijpleiding

- Plato

- Plato gegevensintelligentie

- PlatoData

- dan

- plus

- punt

- beleidsmaatregelen door te lezen.

- Post

- potentieel

- aangedreven

- bij voorkeur

- voorbereiding

- Voorbereiden

- voorbereiding

- Voorafgaand

- waarschijnlijk

- probleem

- problemen

- gaan

- verwerking

- productie

- produktiviteit

- professioneel

- project

- vastgoed

- mits

- biedt

- het verstrekken van

- Python

- queries

- vraag

- Contact

- snel

- ranges

- snel

- waarderingen

- bereiken

- Lees

- echte wereld

- ontvangen

- verwijzen

- verwant

- relevante

- het verwijderen van

- gemeld

- verzoeken

- vereisen

- vereist

- Resources

- antwoord

- reacties

- resting

- Resultaten

- terugkeer

- Recensies

- rechts

- Rol

- lopen

- sagemaker

- dezelfde

- Bespaar

- Wetenschapper

- Ontdek

- zoeken

- sectie

- gezien

- kiezen

- verzending

- senior

- gevoelig

- service

- Diensten

- settings

- moet

- tonen

- vertoonde

- sluiten

- stilgelegd

- kant

- teken

- aanzienlijke

- gelijk

- eenvoud

- vereenvoudigen

- Maat

- snipper

- So

- Social

- social media

- oplossing

- Oplossingen

- OPLOSSEN

- sommige

- bron

- bronnen

- specifiek

- specifiek

- besteden

- Uitgaven

- Stadium

- stadia

- Stap voor

- Stappen

- Still

- strategisch

- gestructureerde

- OVERZICHT

- steunen

- Enquête

- Nemen

- teams

- Technisch

- technieken

- proef

- tekst

- dat

- De

- De toekomst

- hun

- Ze

- harte

- Er.

- Deze

- ze

- dit

- Dus

- niet de tijd of

- Titan

- naar

- vandaag

- tools

- Trainingen

- Transformeren

- Transformatie

- transformaties

- transformeren

- waar

- inkorting

- type dan:

- types

- unified

- us

- .

- gebruikt

- Gebruiker

- gebruikers

- gebruik

- waardevol

- via

- Video

- visuele

- walkthrough

- we

- web

- webservices

- GOED

- welke

- en

- WIE

- wil

- Met

- Mijn werk

- workflow

- Bedrijven

- zou

- schrijven

- You

- Your

- zephyrnet