Ja. Ik heb het over de AI-toepassingen – onze talloze AI-toepassingen en aankomende toepassingen die tegen mensen fluisteren over wat ze moeten doen…. hoe het moet... maar niet over de fluisteraars die communiceren met de AI-chatbots.

Think IDC voorspellingen, zou de wereldwijde AI-markt in 500 meer dan $ 2024 miljard kunnen bereiken - een stijging van meer dan 50% ten opzichte van 2021. Dit geeft aan dat we zijn overgestapt van zakelijke experimenten naar de acceptatie dat het een integraal onderdeel is van de bedrijfsstrategie voor alle soorten en maten. Het is een noodzakelijke tool om gegevens om te zetten in inzichten om actie te stimuleren op basis van betere beslissingen. Niemand discussieert over de voordelen van AI om bedrijfsrisico's te verkleinen en de ROI te vergroten met innovatie. Maar zoals altijd is er een ... MAAR ... de onpartijdige AI is gemakkelijker gezegd dan gedaan.

Deze AI-modellen zijn cruciaal voor het bedrijf en moeten betrouwbaar werken met zichtbaarheid en verantwoording. Anders heeft een mislukking in dit geval ernstige gevolgen die van invloed zijn op de cashflow van elk bedrijf en zelfs kan leiden tot juridische zaken. De enige manier om dit te voorkomen is automatisering en transparantie om één vraag te beantwoorden: "Kunt u bewijzen dat deze AI-toepassing/-workload ethisch is gebouwd." Oftewel... hoe regeer je? En kunt u bewijzen dat het continu wordt bestuurd?

Dit is waar bedrijven van houden IBM hebben geïnvesteerd in AI-governance om het algehele proces van aansturing, beheer en monitoring van de AI-activiteiten van de organisatie te orkestreren. De primaire taak is ervoor te zorgen dat alle bedrijfseenheden proactief blijven en het bestuurskader in de initiatieven te integreren om het vermogen om te voldoen aan ethische principes en voorschriften te versterken. Vooral gereguleerde sectoren zoals het bankwezen en de financiële dienstverlening zijn wettelijk verplicht om het bewijs te leveren om de toezichthouders tevreden te stellen.

De invloed van AI groeit exponentieel in de financiële dienstverlening door de enorme druk van digitale transformatie. Zoals gezegd, het is makkelijker gezegd dan gedaan omdat:

1. De AI-apps met vertrouwen operationaliseren:

In sommige gevallen worden modellen gebouwd zonder duidelijkheid en catalogisering; het behoeft geen betoog dat monitoring te midden van alles wegglipt om de end-to-end levenscyclus te volgen. Terwijl banken worstelen met legacy-applicaties, werd het automatiseren van de processen om transparantie en uitlegbaarheid te creëren moeilijker en op zijn beurt een black box. Niemand weet waarom/hoe beslissingen werden genomen. De nieuwe apps die verward zijn met legacy-apps zien nooit het daglicht, hoewel er een enorme ROI aan verbonden is vanwege de kwaliteit en onopgemerkte risico's.

Dat brengt ons bij ons tweede punt: het beheersen van het reputatierisico

2. Beheer het reputatierisico samen met het algehele risico

ik heb gevraagd #chatGPT en #Bard – wie is Padma Chukka. #ChatGPT weigerde te antwoorden, zelfs als ik de vraag op meerdere manieren veranderde. Toch gaf Bard me een gedetailleerd antwoord, inclusief mijn LinkedIn-profiel... maar de gegevens zijn afkomstig van verschillende sites waar mijn oude profiel nog steeds bestaat als onderdeel van de bios van de spreker. Vanaf dat moment moet ik de bard nog openen. Zo snel werd ik uitgeschakeld, oftewel: reputatierisico. Stel dat ik een eenvoudige chatbot kan uitschakelen als ik me realiseer dat de gegevens mogelijk niet consistent zijn. Hoe kon ik het niet zeker weten voordat ik besloot een AI-geïntegreerde applicatie te kopen om kritieke zaken te doen? Reputatierisico is een essentiële factor die bedrijven soms vergeten. Als je het reputatierisico kwantificeert, zie je de enorme impact op het bedrijf als je niet proactief bent.

Om het nog ingewikkelder te maken, is de derde...

3. Hoe kan een bedrijf inspelen op veranderende AI-regelgeving?

Om reputatierisico's te voorkomen, moet een succesvol en verantwoordelijk AI-team op de hoogte zijn van elke lokale en wereldwijde regelgeving, die als een tikkende video in een oogwenk verschijnt. En niet-naleving kan een organisatie uiteindelijk miljoenen dollars kosten aan boetes rond het werk, zoals de voorgestelde EU AI-wet. Het kan oplopen tot 30 miljoen euro of 6% van de wereldwijde omzet van het bedrijf – OUCH.

Nou, niet alles hoeft vanaf het begin rooskleurig te zijn... zolang we maar weten hoe we een make-over kunnen geven van een enge naar een rooskleurige situatie.

Geen verrassing... het zijn altijd mensen, processen en technologie. Creëer dus eerst een multifunctioneel bestuursorgaan om de initiatieven op basis van de doelstellingen op te leiden, te sturen en te controleren. Benchmark vervolgens de huidige AI-technologie en -processen, begrijp de hiaten en herstel vervolgens naar toekomstbestendig. Val vervolgens terug op een reeks geautomatiseerde governance-workflows in overeenstemming met de nalevingsvereisten. Zet ten slotte een monitoringsysteem op om eigenaren te waarschuwen als de acceptabele drempel dichterbij komt. Vanuit de technologiekant vereist een goed ontworpen, goed uitgevoerde en goed verbonden AI meerdere bouwstenen. En zorg ervoor dat het enkele of alle mogelijkheden heeft:

· Gegevensintegriteit bij diverse implementaties

· Gebruik open, flexibele bestaande tools die voldoen aan AI Governance

· Zorg ervoor dat u zelfbedieningstoegang biedt met privacycontroles - een manier om te volgen

· Ontwerp met het oog op automatisering en AI-governance

· Kan verbinding maken en aanpasbaar zijn voor meerdere belanghebbenden via aanpasbare workflow

Zodra we de app een make-over hebben gegeven van eng naar Rosy...dan is de volgende vraag hoe je bewijst...

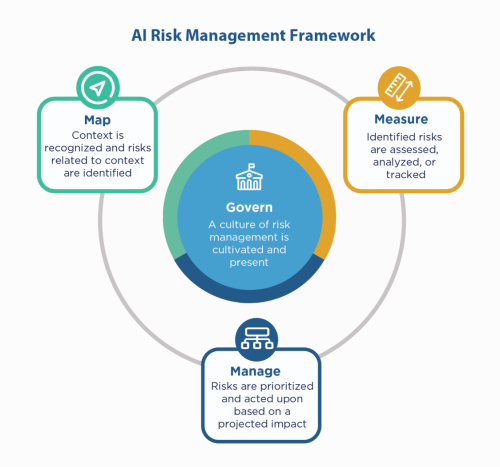

Ten eerste, val terug op de AI-principes van het bedrijf – bouw ermee, en toch moet je “laten zien” dat je compliant bent, vooral in gereguleerde omgevingen zoals Financial Services. Aangezien financiële diensten moeten klagen bij NIST 800-53, zouden ze kunnen kijken naar de NIST AI Risk Management Framework (AI RMF). NIST stelde de besturingselementen voor in vier families: besturen, in kaart brengen, meten en beheren. Gebruik dat als leidende factor en test de applicaties om de hiaten te identificeren die moeten worden verholpen en gecontroleerd.

IBM kan uw modellen valideren voordat u ze in productie neemt en kan worden gecontroleerd op eerlijkheid, kwaliteit en afwijkingen. Het kan ook documentatie verschaffen waarin het gedrag en de voorspellingen van het model worden uitgelegd om te voldoen aan de vereisten van toezichthouders en auditors. Deze uitleg kan zichtbaarheid bieden en de controlepijn verlichten, en de transparantie en het vermogen om mogelijke risico's te bepalen vergroten.

Luister met vertrouwen naar die AI-fluisteringen!

#Financiële diensten #verantwoordelijkai #ethisch #NISTAIRMF

- Door SEO aangedreven content en PR-distributie. Word vandaag nog versterkt.

- Platoblockchain. Web3 Metaverse Intelligentie. Kennis versterkt. Toegang hier.

- De toekomst slaan met Adryenn Ashley. Toegang hier.

- Bron: https://www.finextra.com/blogposting/24053/the-costly-consequences-of-unethical-ai-whisperer?utm_medium=rssfinextra&utm_source=finextrablogs

- :is

- $UP

- 2021

- 2024

- 7

- a

- vermogen

- Over

- aanvaardbaar

- toegang

- verantwoording

- over

- Handelen

- Actie

- activiteiten

- aanhangen

- AI

- AI-wet

- AI-beheer

- aka

- Alarm

- Alles

- altijd

- en

- beantwoorden

- gebruiken

- Aanvraag

- toepassingen

- apps

- ZIJN

- rond

- AS

- geassocieerd

- At

- controleren

- accountants

- geautomatiseerde

- automatiseren

- Automatisering

- terug

- Bankieren

- Banken

- gebaseerde

- BE

- omdat

- vaardigheden

- wezen

- criterium

- betekent

- Betere

- Miljard

- Zwart

- Blokken

- lichaam

- Box camera's

- Brengt

- bouw

- Gebouw

- bebouwd

- bedrijfsdeskundigen

- kopen

- by

- CAN

- mogelijkheden

- geval

- gevallen

- Contant geld

- cash flow

- veranderende

- Chatbot

- chatbots

- helderheid

- sluitend

- Bedrijven

- afstand

- ingewikkeldheid

- nakoming

- compliant

- Gedrag

- vertrouwen

- Verbinden

- Gevolgen

- doorlopend

- controles

- Kosten

- kon

- en je merk te creëren

- kritisch

- Actueel

- aanpasbare

- cyclus

- gegevens

- debatteren

- Beslissen

- beslissingen

- verlagen

- Design

- gedetailleerd

- Bepalen

- digitaal

- Digitale Transformatie

- dire

- directe

- leiding

- diversen

- documentatie

- dollar

- dropping

- gemakkelijker

- opvoeden

- eind tot eind

- verzekeren

- Enterprise

- omgevingen

- vooral

- essentieel

- ethisch

- EU

- Euro

- Zelfs

- Alle

- alles

- bewijzen

- bestaand

- bestaat

- uitleggen

- exponentieel

- Storing

- eerlijkheid

- Vallen

- gezinnen

- Tot slot

- financieel

- financiële diensten

- uiteinden

- Fijnextra

- Voornaam*

- flexibel

- stroom

- Voor

- Achtergrond

- oppompen van

- vanaf 2021

- toekomst

- Geven

- Globaal

- bestuur

- Groeiend

- Hebben

- Hoe

- How To

- HTTPS

- reusachtig

- Mensen

- i

- identificeren

- Impact

- in

- Inclusief

- Laat uw omzet

- geeft aan

- industrieën

- beïnvloeden

- initiatieven

- Innovatie

- inzichten

- integraal

- integriteit

- interactie

- investeerde

- IT

- HAAR

- Jobomschrijving:

- blijven

- Nalatenschap

- Juridisch

- juridische zaken

- Life

- als

- Lijn

- lokaal

- lang

- Kijk

- gemaakt

- maken

- beheer

- management

- beheren

- kaart

- Markt

- Zaken

- Mei..

- maatregel

- Maak kennis met

- macht

- miljoen

- miljoenen

- model

- modellen

- moment

- monitor

- bewaakt

- Grensverkeer

- meer

- meervoudig

- noodzakelijk

- Noodzaak

- Onnodig

- New

- volgende

- NIST

- doelstellingen

- of

- bieden

- Oud

- on

- EEN

- open

- besturen

- organisatie

- anders-

- totaal

- eigenaren

- Pijn

- deel

- Mensen

- Plato

- Plato gegevensintelligentie

- PlatoData

- punt

- mogelijk

- Voorspellingen

- druk

- primair

- principes

- privacy

- Proactieve

- processen

- productie

- Profiel

- bewijs

- voorgestelde

- Bewijzen

- zorgen voor

- zetten

- kwaliteit

- vraag

- snel

- bereiken

- realiseren

- gereguleerd

- gereguleerde industrieën

- Regulatie

- reglement

- Regelgevers

- reputatie

- nodig

- Voorwaarden

- vereist

- Reageren

- verantwoordelijk

- resultaat

- inkomsten

- Risico

- risicobeheer

- risico's

- ROI

- Rooskleurig

- s

- Zei

- Tweede

- sector

- Zelfbediening

- Diensten

- reeks

- moet

- tonen

- kant

- Eenvoudig

- sinds

- Locaties

- situatie

- maten

- So

- sommige

- Vonk

- Spreker

- stakeholders

- blijven

- Still

- Strategie

- Versterken

- spanning

- Worstelen

- geslaagd

- system

- praat

- team

- Technologie

- proef

- dat

- De

- Ze

- Deze

- Derde

- drempel

- Door

- naar

- tools

- tools

- spoor

- Transformatie

- Transparantie

- ontzettend

- BEURT

- Gedraaid

- Tenslotte

- begrijpen

- eenheden

- komende

- us

- .

- BEVESTIG

- divers

- Video

- zichtbaarheid

- Manier..

- manieren

- Wat

- en

- WIE

- Met

- zonder

- Mijn werk

- workflows

- You

- Your

- zephyrnet