Terwijl klanten hun migraties naar de cloud versnellen en hun bedrijf transformeren, komen sommigen in situaties terecht waarin ze IT-activiteiten in een multicloud-omgeving moeten beheren. Het kan bijvoorbeeld zijn dat u een bedrijf heeft overgenomen dat al op een andere cloudprovider draaide, of dat u een werklast heeft die waarde genereert uit de unieke mogelijkheden van AWS. Een ander voorbeeld zijn onafhankelijke softwareleveranciers (ISV's) die hun producten en diensten beschikbaar stellen op verschillende cloudplatforms ten behoeve van hun eindklanten. Het kan ook zijn dat een organisatie actief is in een regio waar geen primaire cloudprovider beschikbaar is, en om te voldoen aan de eisen op het gebied van datasoevereiniteit of datalocatie, kunnen ze een secundaire cloudprovider gebruiken.

In deze scenario's, terwijl u generatieve AI, grote taalmodellen (LLM's) en machine learning (ML)-technologieën als een kernonderdeel van uw bedrijf begint te omarmen, zoekt u mogelijk naar opties om hiervan te profiteren AWS AI en ML mogelijkheden buiten AWS in een multicloud-omgeving. Misschien wilt u er bijvoorbeeld gebruik van maken Amazon Sage Maker om een ML-model te bouwen en te trainen, of te gebruiken Amazon SageMaker-jumpstart om kant-en-klare basismodellen of ML-modellen van derden te implementeren, die u met een paar klikken kunt implementeren. Of misschien wilt u hiervan profiteren Amazonebodem om generatieve AI-applicaties te bouwen en te schalen, of u kunt er gebruik van maken De vooraf getrainde AI-diensten van AWS, waarvoor u geen machine learning-vaardigheden hoeft te leren. AWS biedt ondersteuning voor scenario’s waar organisaties dat willen hun eigen model naar Amazon SageMaker brengen or in Amazon SageMaker Canvas voor voorspellingen.

In dit bericht demonstreren we een van de vele opties die u heeft om te profiteren van de breedste en diepste reeks AI/ML-mogelijkheden van AWS in een multicloud-omgeving. We laten zien hoe u een ML-model in AWS kunt bouwen en trainen en het model op een ander platform kunt implementeren. We trainen het model met Amazon SageMaker en slaan de modelartefacten op Amazon eenvoudige opslagservice (Amazon S3), en implementeer en voer het model uit in Azure. Deze aanpak is nuttig als u AWS-services voor ML gebruikt vanwege de meest uitgebreide reeks functies, maar u uw model in een andere cloudprovider moet draaien in een van de situaties die we hebben besproken.

Sleutelbegrippen

Amazon SageMaker Studio is een webgebaseerde, geïntegreerde ontwikkelomgeving (IDE) voor machine learning. Met SageMaker Studio kunnen datawetenschappers, ML-ingenieurs en data-ingenieurs data voorbereiden, ML-modellen bouwen, trainen en implementeren op één webinterface. Met SageMaker Studio heeft u toegang tot speciaal gebouwde tools voor elke fase van de ML-ontwikkelingslevenscyclus, van datavoorbereiding tot het bouwen, trainen en implementeren van uw ML-modellen, waardoor de productiviteit van het data science-team tot wel tien keer wordt verbeterd. SageMaker Studio-notitieboekjes zijn snelle, collaboratieve notebooks die kunnen worden geïntegreerd met speciaal gebouwde ML-tools in SageMaker en andere AWS-services.

SageMaker is een uitgebreide ML-service waarmee bedrijfsanalisten, datawetenschappers en MLOps-ingenieurs ML-modellen kunnen bouwen, trainen en implementeren voor elk gebruiksscenario, ongeacht de ML-expertise.

AWS biedt: Deep Learning-containers (DLC's) voor populaire ML-frameworks zoals PyTorch, TensorFlow en Apache MXNet, die u met SageMaker kunt gebruiken voor training en gevolgtrekking. DLC's zijn beschikbaar als Docker-images in Amazon Elastic Container-register (Amazone ECR). De Docker-images zijn vooraf geïnstalleerd en getest met de nieuwste versies van populaire deep learning-frameworks en andere afhankelijkheden die nodig zijn voor training en gevolgtrekking. Voor een volledige lijst van de vooraf gebouwde Docker-images beheerd door SageMaker, zie Docker-registerpaden en voorbeeldcode. Amazon ECR ondersteunt beveiligingsscans en is geïntegreerd met Amazon-inspecteur kwetsbaarheidsbeheerservice om te voldoen aan de beveiligingsvereisten voor image-compliance van uw organisatie, en om het scannen van kwetsbaarheidsbeoordelingen te automatiseren. Ook organisaties kunnen gebruik maken van AWS Trainium en AWS Inferentie voor betere prijs-kwaliteitverhouding voor het uitvoeren van ML-trainingstaken of gevolgtrekkingen.

Overzicht oplossingen

In deze sectie beschrijven we hoe u een model bouwt en traint met SageMaker en hoe u het model implementeert in Azure Functions. We gebruiken een SageMaker Studio-notebook om het model te bouwen, trainen en implementeren. We trainen het model in SageMaker met behulp van een vooraf gebouwde Docker-image voor PyTorch. Hoewel we in dit geval het getrainde model in Azure implementeren, kunt u dezelfde aanpak gebruiken om het model op andere platforms te implementeren, zoals op locatie of op andere cloudplatforms.

Wanneer we een trainingstaak maken, start SageMaker de ML-rekeninstanties en gebruikt onze trainingscode en de trainingsgegevensset om het model te trainen. Het slaat de resulterende modelartefacten en andere uitvoer op in een S3-bucket die we specificeren als invoer voor de trainingstaak. Wanneer de modeltraining is voltooid, gebruiken we de Neurale netwerkuitwisseling openen (ONNX) runtime-bibliotheek om het PyTorch-model te exporteren als een ONNX-model.

Ten slotte implementeren we het ONNX-model samen met een aangepaste inferentiecode geschreven in Python naar Azure Functions met behulp van de Azure CLI. ONNX ondersteunt de meeste van de veelgebruikte ML-frameworks en -tools. Eén ding om op te merken is dat het converteren van een ML-model naar ONNX handig is als u een ander doelimplementatieframework wilt gebruiken, zoals PyTorch naar TensorFlow. Als u hetzelfde framework voor zowel de bron als het doel gebruikt, hoeft u het model niet naar de ONNX-indeling te converteren.

Het volgende diagram illustreert de architectuur voor deze aanpak.

We gebruiken een SageMaker Studio-notebook samen met de SageMaker Python-SDK om ons model te bouwen en te trainen. De SageMaker Python SDK is een open-sourcebibliotheek voor het trainen en implementeren van ML-modellen op SageMaker. Voor meer details, zie Maak of open een Amazon SageMaker Studio-notebook.

De codefragmenten in de volgende secties zijn getest in de SageMaker Studio-notebookomgeving met behulp van de Data Science 3.0-image en Python 3.0-kernel.

In deze oplossing demonstreren we de volgende stappen:

- Train een PyTorch-model.

- Exporteer het PyTorch-model als een ONNX-model.

- Verpak het model en de gevolgtrekkingscode.

- Implementeer het model in Azure Functions.

Voorwaarden

U moet de volgende vereisten hebben:

- Een AWS-account.

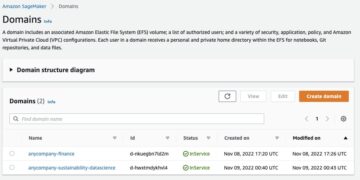

- Een SageMaker-domein en SageMaker Studio-gebruiker. Voor instructies om deze te maken, zie Aan boord van Amazon SageMaker Domain met behulp van Snelle installatie.

- De Azure CLI.

- Toegang tot Azure en referenties voor een service-principal die machtigingen heeft om Azure Functions te maken en te beheren.

Train een model met PyTorch

In deze sectie beschrijven we de stappen voor het trainen van een PyTorch-model.

Afhankelijkheden installeren

Installeer de bibliotheken om de stappen uit te voeren die nodig zijn voor modeltraining en modelimplementatie:

pip install torchvision onnx onnxruntimeVoltooi de initiële installatie

We beginnen met het importeren van de AWS SDK voor Python (Boto3) en SageMaker Python-SDK. Als onderdeel van de installatie definiëren we het volgende:

- Een sessieobject dat gemaksmethoden biedt binnen de context van SageMaker en ons eigen account.

- Een SageMaker-rol die ARN gebruikte om machtigingen te delegeren aan de trainings- en hostingservice. We hebben dit nodig zodat deze services toegang kunnen krijgen tot de S3-buckets waar onze gegevens en ons model zijn opgeslagen. Voor instructies over het creëren van een rol die aan uw zakelijke behoeften voldoet, raadpleegt u SageMaker-rollen. Voor dit bericht gebruiken we dezelfde uitvoeringsrol als onze Studio-notebookinstantie. Deze rol krijgen wij door te bellen

sagemaker.get_execution_role(). - De standaardregio waar onze trainingstaak zal worden uitgevoerd.

- De standaardbucket en het voorvoegsel dat we gebruiken om de modeluitvoer op te slaan.

Zie de volgende code:

import sagemaker

import boto3

import os execution_role = sagemaker.get_execution_role()

region = boto3.Session().region_name

session = sagemaker.Session()

bucket = session.default_bucket()

prefix = "sagemaker/mnist-pytorch"Maak de trainingsgegevensset

We gebruiken de dataset die beschikbaar is in de openbare bucket sagemaker-example-files-prod-{region}. De dataset bevat de volgende bestanden:

- trein-images-idx3-ubyte.gz – Bevat afbeeldingen van trainingssets

- treinlabels-idx1-ubyte.gz – Bevat trainingssetlabels

- t10k-images-idx3-ubyte.gz – Bevat testsetafbeeldingen

- t10k-labels-idx1-ubyte.gz – Bevat testsetlabels

We maken gebruik van detorchvision.datasets module om de gegevens lokaal uit de openbare bucket te downloaden voordat deze naar onze trainingsgegevensbucket worden geüpload. We geven deze bucketlocatie door als input voor de SageMaker-trainingstaak. Ons trainingsscript gebruikt deze locatie om de trainingsgegevens te downloaden en voor te bereiden, en vervolgens het model te trainen. Zie de volgende code:

MNIST.mirrors = [ f"https://sagemaker-example-files-prod-{region}.s3.amazonaws.com/datasets/image/MNIST/"

] MNIST( "data", download=True, transform=transforms.Compose( [transforms.ToTensor(), transforms.Normalize((0.1307,), (0.3081,))] ),

)

Maak het trainingsscript

Met SageMaker kunt u uw eigen model meenemen scriptmodus. Met de scriptmodus kunt u de vooraf gebouwde SageMaker-containers gebruiken en uw eigen trainingsscript leveren, dat de modeldefinitie bevat, samen met eventuele aangepaste bibliotheken en afhankelijkheden. De SageMaker Python-SDK geeft ons script door als een entry_point naar de container, die de treinfunctie laadt en uitvoert vanuit het meegeleverde script om ons model te trainen.

Wanneer de training is voltooid, slaat SageMaker de modeluitvoer op in de S3-bucket die we als parameter voor de trainingstaak hebben opgegeven.

Onze trainingscode is een aangepaste versie van het volgende PyTorch-voorbeeldscript. Het volgende fragment uit de code toont de modeldefinitie en de treinfunctie:

# define network class Net(nn.Module): def __init__(self): super(Net, self).__init__() self.conv1 = nn.Conv2d(1, 32, 3, 1) self.conv2 = nn.Conv2d(32, 64, 3, 1) self.dropout1 = nn.Dropout(0.25) self.dropout2 = nn.Dropout(0.5) self.fc1 = nn.Linear(9216, 128) self.fc2 = nn.Linear(128, 10) def forward(self, x): x = self.conv1(x) x = F.relu(x) x = self.conv2(x) x = F.relu(x) x = F.max_pool2d(x, 2) x = self.dropout1(x) x = torch.flatten(x, 1) x = self.fc1(x) x = F.relu(x) x = self.dropout2(x) x = self.fc2(x) output = F.log_softmax(x, dim=1) return output# train def train(args, model, device, train_loader, optimizer, epoch): model.train() for batch_idx, (data, target) in enumerate(train_loader): data, target = data.to(device), target.to(device) optimizer.zero_grad() output = model(data) loss = F.nll_loss(output, target) loss.backward() optimizer.step() if batch_idx % args.log_interval == 0: print('Train Epoch: {} [{}/{} ({:.0f}%)]tLoss: {:.6f}'.format( epoch, batch_idx * len(data), len(train_loader.dataset), 100. * batch_idx / len(train_loader), loss.item())) if args.dry_run: breakTrain het model

Nu we onze omgeving hebben ingericht en onze invoerdataset en aangepast trainingsscript hebben gemaakt, kunnen we de modeltraining starten met SageMaker. We gebruiken de PyTorch-schatter in de SageMaker Python SDK om een trainingstaak op SageMaker te starten. We geven de vereiste parameters door aan de schatter en roepen de fit-methode aan. Wanneer we fit noemen op de PyTorch-schatter, start SageMaker een trainingstaak met ons script als trainingscode:

from sagemaker.pytorch import PyTorch output_location = f"s3://{bucket}/{prefix}/output"

print(f"training artifacts will be uploaded to: {output_location}") hyperparameters={ "batch-size": 100, "epochs": 1, "lr": 0.1, "gamma": 0.9, "log-interval": 100

} instance_type = "ml.c4.xlarge"

estimator = PyTorch( entry_point="train.py", source_dir="code", # directory of your training script role=execution_role, framework_version="1.13", py_version="py39", instance_type=instance_type, instance_count=1, volume_size=250, output_path=output_location, hyperparameters=hyperparameters

) estimator.fit(inputs = { 'training': f"{inputs}", 'testing': f"{inputs}"

})Exporteer het getrainde model als een ONNX-model

Nadat de training is voltooid en ons model is opgeslagen op de vooraf gedefinieerde locatie in Amazon S3, exporteren we het model naar een ONNX-model met behulp van de ONNX-runtime.

We nemen de code op om ons model naar ONNX te exporteren in ons trainingsscript, zodat deze wordt uitgevoerd nadat de training is voltooid.

PyTorch exporteert het model naar ONNX door het model uit te voeren met behulp van onze invoer en een spoor vast te leggen van de operators die zijn gebruikt om de uitvoer te berekenen. Met de PyTorch gebruiken we een willekeurige invoer van het juiste type torch.onnx.export functie om het model naar ONNX te exporteren. We specificeren de eerste dimensie in onze invoer ook als dynamisch, zodat ons model een variabele accepteert batch_size van invoer tijdens inferentie.

def export_to_onnx(model, model_dir, device): logger.info("Exporting the model to onnx.") dummy_input = torch.randn(1, 1, 28, 28).to(device) input_names = [ "input_0" ] output_names = [ "output_0" ] path = os.path.join(model_dir, 'mnist-pytorch.onnx') torch.onnx.export(model, dummy_input, path, verbose=True, input_names=input_names, output_names=output_names, dynamic_axes={'input_0' : {0 : 'batch_size'}, # variable length axes 'output_0' : {0 : 'batch_size'}})ONNX is een open standaardformaat voor deep learning-modellen die interoperabiliteit tussen deep learning-frameworks zoals PyTorch, Microsoft Cognitive Toolkit (CNTK) en meer mogelijk maakt. Dit betekent dat u elk van deze raamwerken kunt gebruiken om het model te trainen en vervolgens de vooraf getrainde modellen in ONNX-indeling kunt exporteren. Door het model naar ONNX te exporteren, profiteert u van een bredere selectie aan implementatieapparaten en -platforms.

Download en extraheer de modelartefacten

Het ONNX-model dat ons trainingsscript heeft opgeslagen, is door SageMaker gekopieerd naar Amazon S3 op de uitvoerlocatie die we hebben opgegeven toen we met de trainingstaak begonnen. De modelartefacten worden opgeslagen als een gecomprimeerd archiefbestand, genaamd model.tar.gz. We downloaden dit archiefbestand naar een lokale map in onze Studio-notebookinstantie en extraheren de modelartefacten, namelijk het ONNX-model.

import tarfile local_model_file = 'model.tar.gz'

model_bucket,model_key = estimator.model_data.split('/',2)[-1].split('/',1)

s3 = boto3.client("s3")

s3.download_file(model_bucket,model_key,local_model_file) model_tar = tarfile.open(local_model_file)

model_file_name = model_tar.next().name

model_tar.extractall('.')

model_tar.close()Valideer het ONNX-model

Het ONNX-model wordt geëxporteerd naar een bestand met de naam mnist-pytorch.onnx door ons trainingsscript. Nadat we dit bestand hebben gedownload en uitgepakt, kunnen we het ONNX-model optioneel valideren met behulp van de onnx.checker module. De check_model functie in deze module controleert de consistentie van een model. Er wordt een uitzondering gemaakt als de test mislukt.

import onnx onnx_model = onnx.load("mnist-pytorch.onnx")

onnx.checker.check_model(onnx_model)Verpak het model en de gevolgtrekkingscode

Voor dit bericht gebruiken we .zip-implementatie voor Azure Functions. Bij deze methode verpakken we ons model, de bijbehorende code en de Azure Functions-instellingen in een ZIP-bestand en publiceren we dit naar Azure Functions. De volgende code toont de mapstructuur van ons implementatiepakket:

mnist-onnx├── function_app.py├── model│ └── mnist-pytorch.onnx└── requirements.txt

Maak een lijst van afhankelijkheden

We vermelden de afhankelijkheden voor onze inferentiecode in de requirements.txt bestand in de root van ons pakket. Dit bestand wordt gebruikt om de Azure Functions-omgeving te bouwen wanneer we het pakket publiceren.

azure-functionsnumpyonnxruntime

Schrijf inferentiecode

We gebruiken Python om de volgende gevolgtrekkingscode te schrijven, waarbij we de ONNX Runtime-bibliotheek gebruiken om ons model te laden en gevolgtrekking uit te voeren. Hiermee wordt de Azure Functions-app geïnstrueerd om het eindpunt beschikbaar te maken op de /classify relatief pad.

import logging

import azure.functions as func

import numpy as np

import os

import onnxruntime as ort

import json app = func.FunctionApp() def preprocess(input_data_json): # convert the JSON data into the tensor input return np.array(input_data_json['data']).astype('float32') def run_model(model_path, req_body): session = ort.InferenceSession(model_path) input_data = preprocess(req_body) logging.info(f"Input Data shape is {input_data.shape}.") input_name = session.get_inputs()[0].name # get the id of the first input of the model try: result = session.run([], {input_name: input_data}) except (RuntimeError) as e: print("Shape={0} and error={1}".format(input_data.shape, e)) return result[0] def get_model_path(): d=os.path.dirname(os.path.abspath(__file__)) return os.path.join(d , './model/mnist-pytorch.onnx') @app.function_name(name="mnist_classify")

@app.route(route="classify", auth_level=func.AuthLevel.ANONYMOUS)

def main(req: func.HttpRequest) -> func.HttpResponse: logging.info('Python HTTP trigger function processed a request.') # Get the img value from the post. try: req_body = req.get_json() except ValueError: pass if req_body: # run model result = run_model(get_model_path(), req_body) # map output to integer and return result string. digits = np.argmax(result, axis=1) logging.info(type(digits)) return func.HttpResponse(json.dumps({"digits": np.array(digits).tolist()})) else: return func.HttpResponse( "This HTTP triggered function successfully.", status_code=200 )Implementeer het model in Azure Functions

Nu we de code hebben verpakt in de vereiste .zip-indeling, zijn we klaar om deze te publiceren naar Azure Functions. Dat doen we met behulp van de Azure CLI, een opdrachtregelhulpprogramma waarmee we Azure-resources kunnen maken en beheren. Installeer de Azure CLI met de volgende code:

!pip install -q azure-cliVoer daarna de volgende stappen uit:

- Inloggen bij Azure:

!az login - Stel de parameters voor het maken van bronnen in:

import random random_suffix = str(random.randint(10000,99999)) resource_group_name = f"multicloud-{random_suffix}-rg" storage_account_name = f"multicloud{random_suffix}" location = "ukwest" sku_storage = "Standard_LRS" functions_version = "4" python_version = "3.9" function_app = f"multicloud-mnist-{random_suffix}" - Gebruik de volgende opdrachten om de Azure Functions-app samen met de vereiste bronnen te maken:

!az group create --name {resource_group_name} --location {location} !az storage account create --name {storage_account_name} --resource-group {resource_group_name} --location {location} --sku {sku_storage} !az functionapp create --name {function_app} --resource-group {resource_group_name} --storage-account {storage_account_name} --consumption-plan-location "{location}" --os-type Linux --runtime python --runtime-version {python_version} --functions-version {functions_version} - Stel de Azure Functions zo in dat wanneer we het Functions-pakket implementeren, de

requirements.txtbestand wordt gebruikt om onze applicatie-afhankelijkheden op te bouwen:!az functionapp config appsettings set --name {function_app} --resource-group {resource_group_name} --settings @./functionapp/settings.json - Configureer de Functions-app om het Python v2-model uit te voeren en een build uit te voeren op de code die wordt ontvangen na de .zip-implementatie:

{ "AzureWebJobsFeatureFlags": "EnableWorkerIndexing", "SCM_DO_BUILD_DURING_DEPLOYMENT": true } - Nadat we de resourcegroep, opslagcontainer en Functions-app met de juiste configuratie hebben, publiceert u de code naar de Functions-app:

!az functionapp deployment source config-zip -g {resource_group_name} -n {function_app} --src {function_archive} --build-remote true

Test het model

We hebben het ML-model geïmplementeerd in Azure Functions als een HTTP-trigger, wat betekent dat we de Functions-app-URL kunnen gebruiken om een HTTP-aanvraag naar de functie te sturen om de functie aan te roepen en het model uit te voeren.

Om de invoer voor te bereiden, downloadt u de testafbeeldingsbestanden uit de SageMaker-voorbeeldbestandenbucket en bereidt u een reeks voorbeelden voor in het formaat dat vereist is voor het model:

from torch.utils.data import DataLoader

from torchvision import datasets, transforms

import matplotlib.pyplot as plt transform=transforms.Compose( [transforms.ToTensor(), transforms.Normalize((0.1307,), (0.3081,))]

) test_dataset = datasets.MNIST(root='../data', download=True, train=False, transform=transform)

test_loader = DataLoader(test_dataset, batch_size=16, shuffle=True) test_features, test_labels = next(iter(test_loader))Gebruik de aanvragenbibliotheek om een postaanvraag naar het inferentie-eindpunt te verzenden met de voorbeeldinvoer. Het inferentie-eindpunt heeft de indeling zoals weergegeven in de volgende code:

import requests, json def to_numpy(tensor): return tensor.detach().cpu().numpy() if tensor.requires_grad else tensor.cpu().numpy() url = f"https://{function_app}.azurewebsites.net/api/classify"

response = requests.post(url, json.dumps({"data":to_numpy(test_features).tolist()}) )

predictions = json.loads(response.text)['digits']Opruimen

Wanneer u klaar bent met het testen van het model, verwijdert u de resourcegroep samen met de ingesloten resources, inclusief de opslagcontainer en de Functions-app:

!az group delete --name {resource_group_name} --yesBovendien wordt aanbevolen om inactieve bronnen binnen SageMaker Studio af te sluiten om de kosten te verlagen. Voor meer informatie, zie Bespaar kosten door inactieve bronnen binnen Amazon SageMaker Studio automatisch af te sluiten.

Conclusie

In dit bericht hebben we laten zien hoe u een ML-model kunt bouwen en trainen met SageMaker en dit kunt implementeren bij een andere cloudprovider. In de oplossing gebruikten we een SageMaker Studio-notebook, maar voor productieworkloads raden we aan om MLops om herhaalbare trainingsworkflows te creëren om de ontwikkeling en implementatie van modellen te versnellen.

Dit bericht liet niet alle mogelijke manieren zien om een model in een multicloud-omgeving te implementeren en uit te voeren. U kunt uw model bijvoorbeeld ook verpakken in een containerimage, samen met inferentiecode en afhankelijkheidsbibliotheken, om het model als containertoepassing op elk platform uit te voeren. Voor meer informatie over deze aanpak, zie Implementeer containerapplicaties in een multicloud-omgeving met Amazon CodeCatalyst. De bedoeling van het bericht is om te laten zien hoe organisaties AWS AI/ML-mogelijkheden kunnen gebruiken in een multicloud-omgeving.

Over de auteurs

Raja Vaidyanathan is een Solutions Architect bij AWS die wereldwijde klanten in de financiële dienstverlening ondersteunt. Raja werkt samen met klanten om oplossingen te bedenken voor complexe problemen met een positieve impact op de lange termijn op hun bedrijf. Hij is een sterke technische professional, bedreven in IT-strategie, enterprise data management en applicatie-architectuur, met bijzondere interesse in analytics en machine learning.

Raja Vaidyanathan is een Solutions Architect bij AWS die wereldwijde klanten in de financiële dienstverlening ondersteunt. Raja werkt samen met klanten om oplossingen te bedenken voor complexe problemen met een positieve impact op de lange termijn op hun bedrijf. Hij is een sterke technische professional, bedreven in IT-strategie, enterprise data management en applicatie-architectuur, met bijzondere interesse in analytics en machine learning.

Amandeep Bajwa is een Senior Solutions Architect bij AWS die financiële dienstverleners ondersteunt. Hij helpt organisaties hun bedrijfsresultaten te bereiken door de juiste cloudtransformatiestrategie te identificeren op basis van trends in de sector en organisatorische prioriteiten. Enkele van de gebieden waar Amandeep advies over geeft zijn cloudmigratie, cloudstrategie (inclusief hybride en multicloud), digitale transformatie, data en analyse, en technologie in het algemeen.

Amandeep Bajwa is een Senior Solutions Architect bij AWS die financiële dienstverleners ondersteunt. Hij helpt organisaties hun bedrijfsresultaten te bereiken door de juiste cloudtransformatiestrategie te identificeren op basis van trends in de sector en organisatorische prioriteiten. Enkele van de gebieden waar Amandeep advies over geeft zijn cloudmigratie, cloudstrategie (inclusief hybride en multicloud), digitale transformatie, data en analyse, en technologie in het algemeen.

Prema Iyer is Senior Technisch Accountmanager voor AWS Enterprise Support. Ze werkt met externe klanten aan verschillende projecten en helpt hen de waarde van hun oplossingen te verbeteren bij het gebruik van AWS.

Prema Iyer is Senior Technisch Accountmanager voor AWS Enterprise Support. Ze werkt met externe klanten aan verschillende projecten en helpt hen de waarde van hun oplossingen te verbeteren bij het gebruik van AWS.

- Door SEO aangedreven content en PR-distributie. Word vandaag nog versterkt.

- PlatoData.Network Verticale generatieve AI. Versterk jezelf. Toegang hier.

- PlatoAiStream. Web3-intelligentie. Kennis versterkt. Toegang hier.

- PlatoESG. carbon, CleanTech, Energie, Milieu, Zonne, Afvalbeheer. Toegang hier.

- Plato Gezondheid. Intelligentie op het gebied van biotech en klinische proeven. Toegang hier.

- Bron: https://aws.amazon.com/blogs/machine-learning/train-and-deploy-ml-models-in-a-multicloud-environment-using-amazon-sagemaker/

- : heeft

- :is

- :niet

- :waar

- $UP

- 1

- 10

- 100

- 13

- 25

- 28

- 32

- 7

- 9

- a

- Over

- versnellen

- Accepteert

- toegang

- Account

- Bereiken

- verworven

- Voordeel

- Na

- AI

- AI / ML

- Alles

- toestaat

- langs

- al

- ook

- Hoewel

- Amazone

- Amazon Sage Maker

- Amazon SageMaker-canvas

- Amazon SageMaker Studio

- Amazon Web Services

- an

- analisten

- analytics

- en

- Anoniem

- Nog een

- elke

- apache

- gebruiken

- Aanvraag

- toepassingen

- nadering

- passend

- architectuur

- Archief

- ZIJN

- gebieden

- AS

- beoordeling

- At

- automatiseren

- webmaster.

- Beschikbaar

- AWS

- ASSEN

- Azuur

- gebaseerde

- BE

- geweest

- vaardigheden

- beginnen

- heilzaam

- voordeel

- Betere

- tussen

- zowel

- brengen

- bredere

- bouw

- Gebouw

- bedrijfsdeskundigen

- maar

- by

- Bellen

- Dit betekent dat we onszelf en onze geliefden praktisch vergiftigen.

- bellen

- CAN

- canvas

- mogelijkheden

- dragen

- geval

- Controles

- klasse

- classificeren

- Klik

- Cloud

- code

- cognitieve

- samenwerkend

- afstand

- compleet

- complex

- nakoming

- uitgebreid

- Berekenen

- Configuratie

- bevatte

- Containers

- containers

- bevat

- verband

- gemak

- converteren

- het omzetten van

- Kern

- Kosten

- kon

- en je merk te creëren

- aangemaakt

- Wij creëren

- het aanmaken

- Geloofsbrieven

- gewoonte

- Klanten

- gegevens

- gegevensbeheer

- Data voorbereiding

- data science

- datasets

- deep

- diepgaand leren

- diepste

- Standaard

- bepalen

- definitie

- tonen

- afhankelijkheden

- Afhankelijkheid

- implementeren

- ingezet

- het inzetten

- inzet

- beschrijven

- detail

- gegevens

- Ontwikkeling

- apparaat

- systemen

- anders

- digitaal

- Digitale Transformatie

- cijfers

- Afmeting

- besproken

- do

- havenarbeider

- domein

- gedaan

- Dont

- beneden

- Download

- gedurende

- dynamisch

- e

- anders

- omarmen

- maakt

- waardoor

- einde

- Endpoint

- Engineering

- Ingenieurs

- Enterprise

- bedrijven

- Milieu

- tijdperk

- tijdperken

- Alle

- voorbeeld

- Behalve

- uitzondering

- uitvoering

- expertise

- exporteren

- export

- extern

- extract

- mislukt

- Voordelen

- weinig

- Dien in

- Bestanden

- financieel

- financiële diensten

- VIND DE PLEK DIE PERFECT VOOR JOU IS

- Voornaam*

- geschikt

- volgend

- Voor

- formaat

- Foundation

- Achtergrond

- frameworks

- oppompen van

- functie

- functies

- Algemeen

- genereert

- generatief

- generatieve AI

- krijgen

- Globaal

- wereldwijd financieel

- Groep

- Hebben

- he

- het helpen van

- helpt

- Hosting

- Hoe

- How To

- HTML

- http

- HTTPS

- Hybride

- ID

- het identificeren van

- Idle

- if

- illustreert

- beeld

- afbeeldingen

- Impact

- importeren

- importeren

- verbeteren

- het verbeteren van

- in

- omvatten

- Inclusief

- onafhankelijk

- -industrie

- informatie

- eerste

- invoer

- ingangen

- installeren

- instantie

- instructies

- integreren

- geïntegreerde

- aandachtig

- belangen

- Interface

- Interoperabiliteit

- in

- IT

- HAAR

- Jobomschrijving:

- Vacatures

- jpg

- json

- taal

- Groot

- laatste

- lanceert

- LEARN

- leren

- Lengte

- Hefboomwerking

- bibliotheken

- Bibliotheek

- levenscyclus van uw product

- Lijn

- linux

- Lijst

- laden

- ladingen

- lokaal

- plaatselijk

- plaats

- logging

- langdurig

- op zoek

- uit

- machine

- machine learning

- maken

- beheer

- beheerd

- management

- manager

- veel

- kaart

- matplotlib

- Mei..

- middel

- Maak kennis met

- Meets

- methode

- methoden

- Microsoft

- macht

- migratie

- ML

- MLops

- Mode

- model

- modellen

- Module

- meer

- meest

- naam

- Genoemd

- namelijk

- Noodzaak

- nodig

- behoeften

- netto

- netwerk

- neurale

- neuraal netwerk

- notitieboekje

- numpy

- object

- of

- on

- EEN

- open

- open source

- werkzaam

- Operations

- exploitanten

- Opties

- or

- bestellen

- organisatie

- organisatorische

- organisaties

- OS

- Overige

- onze

- uit

- resultaten

- uitgang

- buiten

- het te bezitten.

- pakket

- verpakt

- parameter

- parameters

- deel

- bijzonder

- feest

- passeren

- passes

- pad

- Uitvoeren

- permissies

- platform

- platforms

- Plato

- Plato gegevensintelligentie

- PlatoData

- Populair

- positief

- mogelijk

- Post

- Voorspellingen

- voorbereiding

- Voorbereiden

- vereisten

- primair

- Principal

- problemen

- Verwerkt

- productie

- produktiviteit

- Producten

- professioneel

- projecten

- zorgen voor

- mits

- leverancier

- biedt

- publiek

- publiceren

- Python

- pytorch

- Quick

- opgebracht

- willekeurige

- klaar

- ontvangt

- aanbevolen

- opname

- verminderen

- verwijzen

- achteloos

- regio

- register

- relatief

- herhaalbare

- te vragen

- verzoeken

- vereisen

- nodig

- Voorwaarden

- hulpbron

- Resources

- antwoord

- resultaat

- verkregen

- terugkeer

- rechts

- Rol

- wortel

- lopen

- lopend

- loopt

- sagemaker

- dezelfde

- gered

- Scale

- het scannen

- scenario's

- Wetenschap

- wetenschappers

- script

- sdk

- secundair

- sectie

- secties

- veiligheid

- zien

- selectie

- ZELF

- sturen

- senior

- service

- Diensten

- Sessie

- reeks

- settings

- setup

- Vorm

- ze

- moet

- tonen

- vertoonde

- getoond

- Shows

- stilgelegd

- het afsluiten van

- Eenvoudig

- situaties

- geschoold

- vaardigheden

- So

- Software

- oplossing

- Oplossingen

- sommige

- bron

- soevereiniteit

- gespecificeerd

- Stadium

- standaard

- begin

- gestart

- starts

- Stappen

- mediaopslag

- shop

- opgeslagen

- Strategie

- Draad

- sterke

- structuur

- studio

- Hierop volgend

- Met goed gevolg

- dergelijk

- ondersteuning

- Ondersteuning

- steunen

- Nemen

- neemt

- doelwit

- team

- Technisch

- Technologies

- Technologie

- tien

- tensorflow

- proef

- getest

- Testen

- tekst

- dat

- De

- De Bron

- hun

- Ze

- zich

- harte

- Deze

- ze

- ding

- Derde

- dit

- keer

- naar

- toolkit

- tools

- fakkel

- Fakkelvisie

- Opsporen

- Trainen

- getraind

- Trainingen

- Transformeren

- Transformatie

- Transformatiestrategie

- transformaties

- Trends

- leiden

- veroorzaakt

- waar

- proberen

- type dan:

- unieke

- geüpload

- Uploaden

- URL

- .

- use case

- gebruikt

- Gebruiker

- toepassingen

- gebruik

- utility

- BEVESTIG

- waarde

- variabele

- variëteit

- vendors

- versies

- kwetsbaarheid

- willen

- was

- manieren

- we

- web

- webservices

- Web-based

- GOED

- wanneer

- welke

- wil

- Met

- binnen

- workflows

- Bedrijven

- schrijven

- geschreven

- X

- nog

- You

- Your

- zephyrnet

- Postcode