In deze tweedelige serie laten we zien hoe u modellen labelt en traint voor 3D-objectdetectietaken. In deel 1 bespreken we de dataset die we gebruiken, evenals eventuele voorbewerkingsstappen om gegevens te begrijpen en te labelen. In deel 2 laten we zien hoe u een model op uw dataset kunt trainen en implementeren in productie.

LiDAR (lichtdetectie en bereik) is een methode om afstanden te bepalen door een object of oppervlak met een laser te richten en de tijd te meten die het gereflecteerde licht nodig heeft om terug te keren naar de ontvanger. Autonome voertuigbedrijven gebruiken doorgaans LiDAR-sensoren om een 3D-inzicht te genereren in de omgeving rond hun voertuigen.

Naarmate LiDAR-sensoren toegankelijker en kosteneffectiever worden, gebruiken klanten steeds vaker puntenwolkgegevens in nieuwe ruimtes zoals robotica, signaalmapping en augmented reality. Sommige nieuwe mobiele apparaten bevatten zelfs LiDAR-sensoren. De groeiende beschikbaarheid van LiDAR-sensoren heeft de interesse in puntenwolkgegevens voor machine learning (ML)-taken vergroot, zoals 3D-objectdetectie en -tracking, 3D-segmentatie, 3D-objectsynthese en -reconstructie, en het gebruik van 3D-gegevens om 2D-diepteschatting te valideren.

In deze serie laten we u zien hoe u een objectdetectiemodel traint dat draait op puntenwolkgegevens om de locatie van voertuigen in een 3D-scène te voorspellen. In dit bericht richten we ons specifiek op het labelen van LiDAR-gegevens. Standaard LiDAR-sensoroutput is een reeks 3D-puntenwolkframes, met een typische opnamesnelheid van 10 frames per seconde. Om deze sensoruitvoer te labelen, hebt u een labeltool nodig die 3D-gegevens kan verwerken. Amazon SageMaker Grondwaarheid maakt het gemakkelijk om objecten te labelen in een enkel 3D-frame of in een reeks 3D-puntenwolkframes voor het bouwen van ML-trainingsdatasets. Ground Truth ondersteunt ook sensorfusie van camera- en LiDAR-gegevens met maximaal acht videocamera-ingangen.

Gegevens zijn essentieel voor elk ML-project. Met name 3D-gegevens kunnen moeilijk te vinden, te visualiseren en te labelen zijn. Wij gebruiken de A2D2-gegevensset in dit bericht en begeleid je door de stappen om het te visualiseren en te labelen.

A2D2 bevat 40,000 frames met semantische segmentatie en puntenwolklabels, waaronder 12,499 frames met labels voor 3D-grenzen. Omdat we ons richten op objectdetectie, zijn we geïnteresseerd in de 12,499 frames met 3D-selectiekaderlabels. Deze annotaties omvatten 14 klassen die relevant zijn voor het rijden, zoals auto, voetganger, vrachtwagen, bus, enz.

De volgende tabel toont de volledige klassenlijst:

| Index | Klassenlijst |

| 1 | dier |

| 2 | fiets |

| 3 | bus |

| 4 | auto |

| 5 | caravan vervoerder |

| 6 | fietser |

| 7 | noodvoertuig |

| 8 | motorrijder |

| 9 | motorfiets |

| 10 | voetganger |

| 11 | aanhangwagen |

| 12 | truck |

| 13 | bedrijfsvoertuig |

| 14 | bestelwagen/SUV |

We zullen onze detector trainen om specifiek auto's te detecteren, aangezien dat de meest voorkomende klasse in onze dataset is (32616 van de 42816 totale objecten in de dataset zijn gelabeld als auto's).

Overzicht oplossingen

In deze serie bespreken we hoe u uw gegevens kunt visualiseren en labelen met Amazon SageMaker Ground Truth en laten we zien hoe u deze gegevens kunt gebruiken in een Amazon SageMaker-trainingstaak om een objectdetectiemodel te maken dat wordt geïmplementeerd op een Amazon SageMaker-eindpunt. We zullen met name een Amazon SageMaker-notebook gebruiken om de oplossing te bedienen en eventuele label- of trainingstaken te starten.

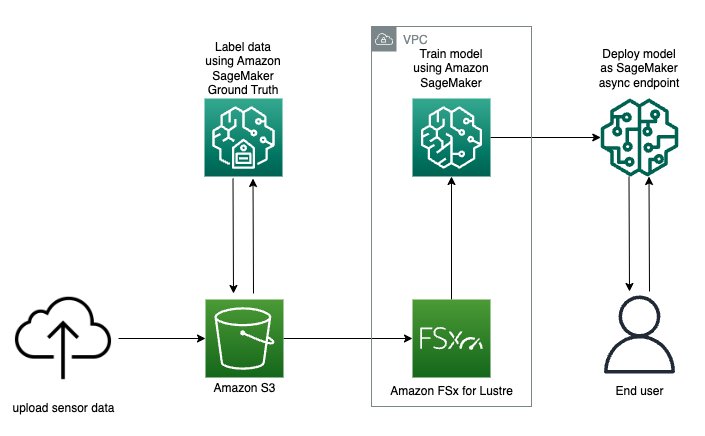

Het volgende diagram geeft de algehele stroom van sensorgegevens weer, van labeling tot training tot implementatie:

Je leert hoe je een real-time 3D-objectdetectiemodel traint en implementeert met Amazon Sage Maker Ground Truth met de volgende stappen:

- Download en visualiseer een dataset van een puntenwolk

- Bereid gegevens voor die moeten worden gelabeld met de Amazon SageMaker Ground Truth-puntenwolktool

- Start een gedistribueerde Amazon SageMaker Ground Truth-trainingstaak met MMDetectie3D

- Evalueer de resultaten van uw trainingstaak en profileer uw gebruik van middelen met Amazon SageMaker-foutopsporing

- Implementeer een asynchroon SageMaker-eindpunt

- Roep het eindpunt op en visualiseer 3D-objectvoorspellingen

AWS-services gebruikt om deze oplossing te implementeren

Voorwaarden

Het volgende diagram laat zien hoe u een eigen personeelsbestand maakt. Voor schriftelijke, stapsgewijze instructies, zie Maak een Amazon Cognito Workforce met behulp van de Labelling Workforces-pagina.

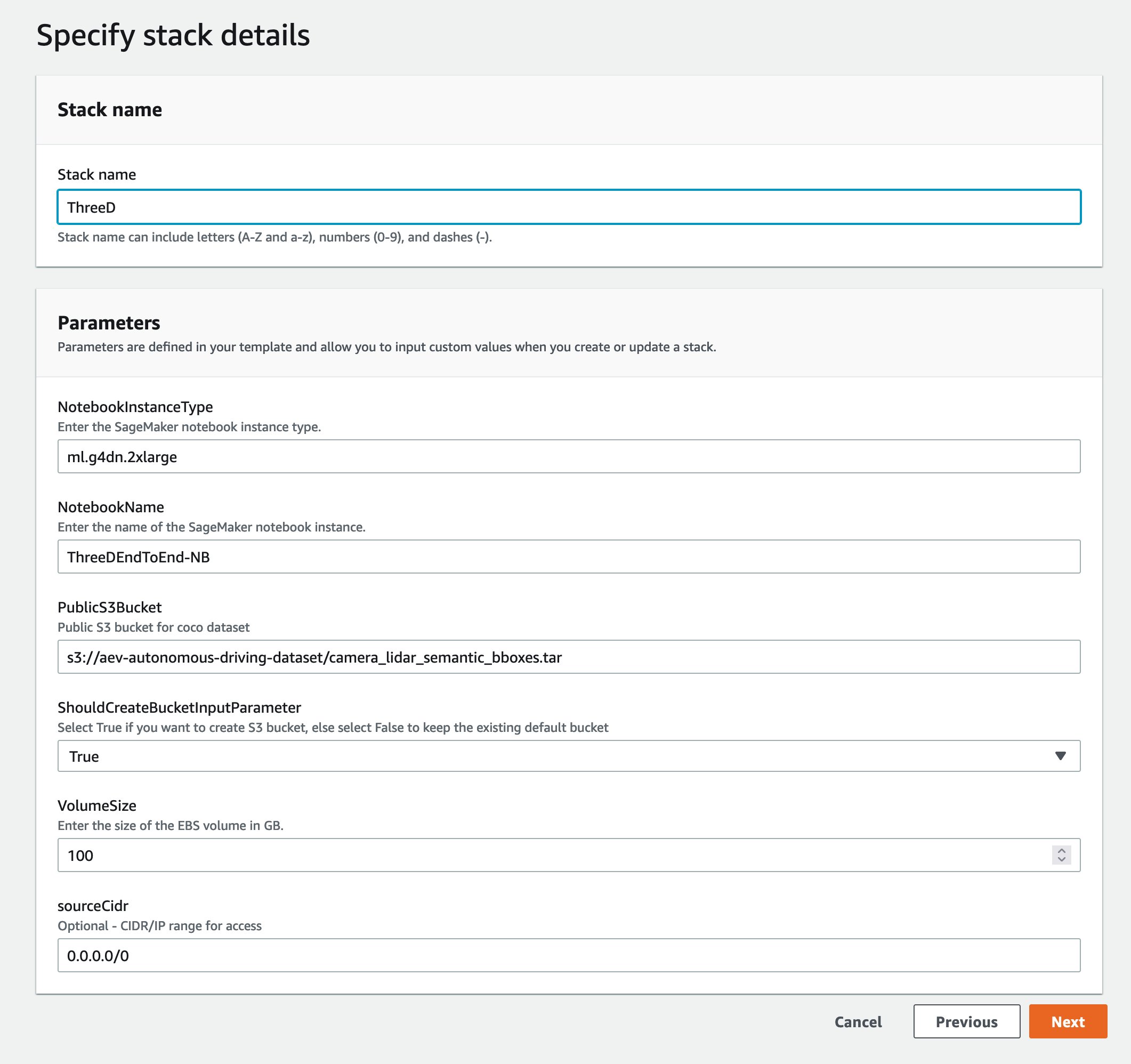

Lancering van de AWS CloudFormation-stack

Nu u de structuur van de oplossing hebt gezien, implementeert u deze in uw account, zodat u een voorbeeldworkflow kunt uitvoeren. Alle implementatiestappen met betrekking tot de labelpijplijn worden beheerd door AWS CloudFormation. Dit betekent dat AWS Cloudformation uw notebook-instantie maakt, evenals alle rollen of Amazon S3-buckets om het uitvoeren van de oplossing te ondersteunen.

U kunt de stapel starten in AWS-regio us-east-1 op de AWS CloudFormation-console met behulp van de Start Stack

knop. Om de stapel in een andere regio te starten, gebruikt u de instructies in de README van de GitHub-repository.

Het duurt ongeveer 20 minuten om alle bronnen te maken. U kunt de voortgang volgen vanuit de AWS CloudFormation-gebruikersinterface (UI).

Zodra uw CloudFormation-sjabloon klaar is, gaat u terug naar de AWS-console.

Het notitieboek openen

Amazon SageMaker Notebook Instances zijn ML-rekeninstanties die worden uitgevoerd op de Jupyter Notebook-app. Amazon SageMaker beheert het maken van instanties en gerelateerde bronnen. Gebruik Jupyter-notebooks in uw notebook-exemplaar om gegevens voor te bereiden en te verwerken, code te schrijven om modellen te trainen, modellen te implementeren op Amazon SageMaker-hosting en uw modellen te testen of te valideren.

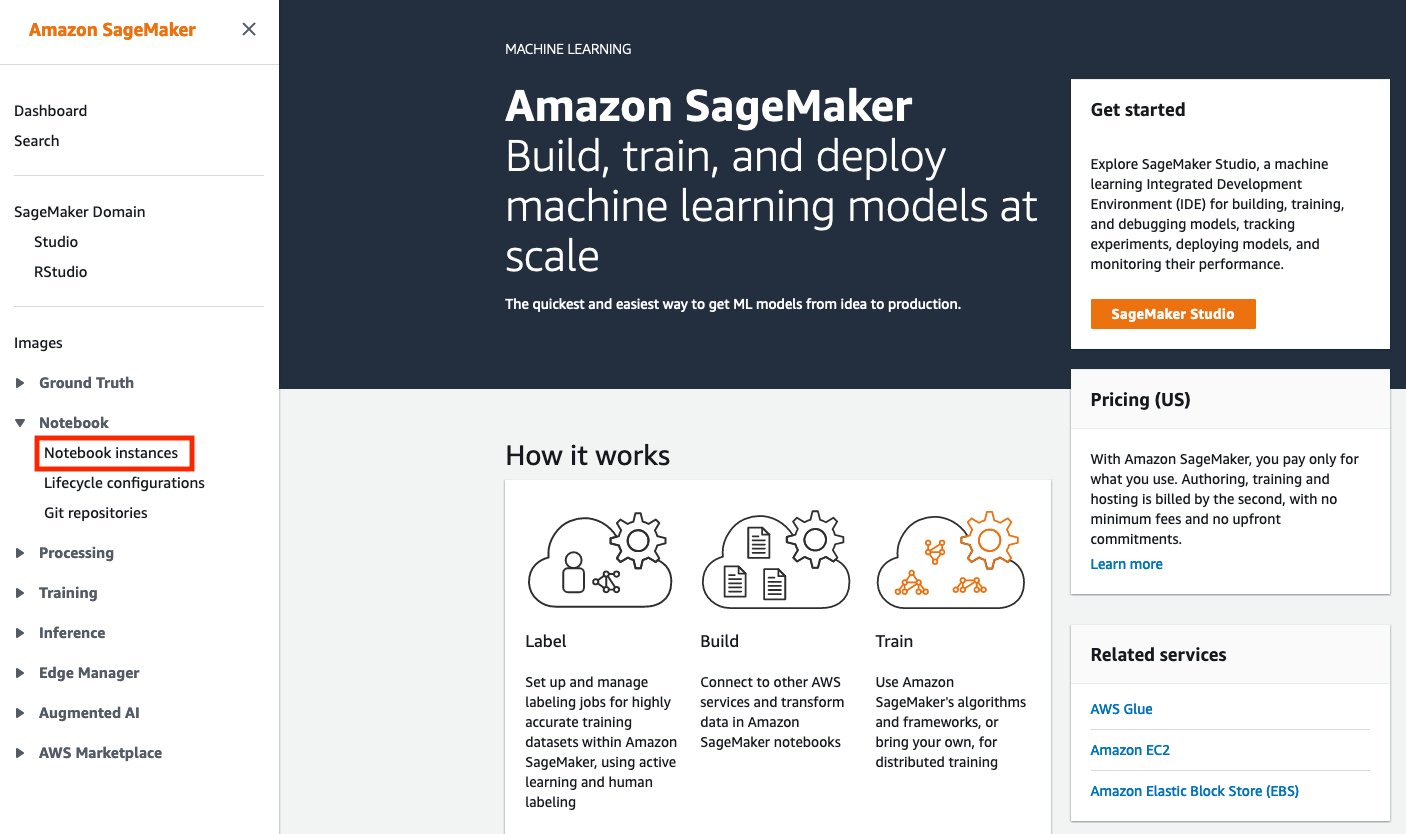

Volg de volgende stappen om toegang te krijgen tot de Amazon SageMaker Notebook-omgeving:

- Zoek onder services naar Amazon Sage Maker.

- Onder Notitieboekselecteer Notebook-exemplaren.

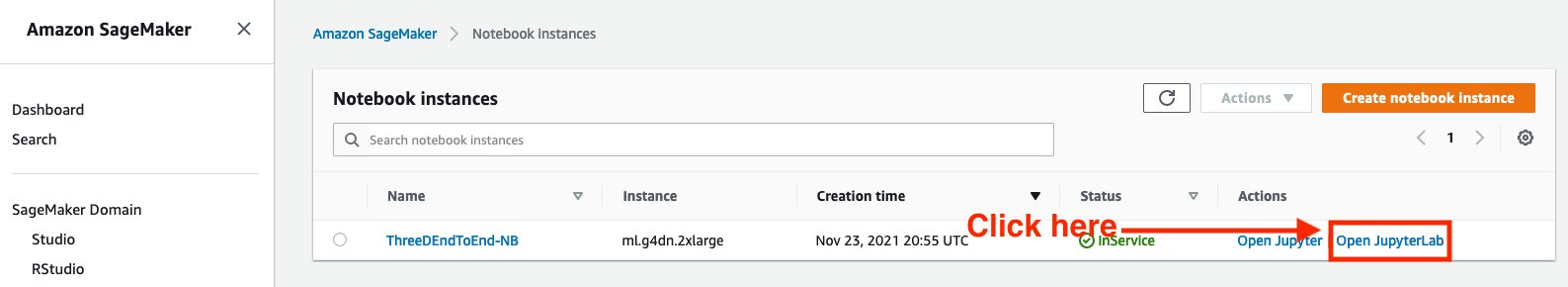

- Er moet een Notebook-exemplaar worden ingericht. Selecteer Openen jupyter lab, die zich aan de rechterkant van de vooraf ingerichte Notebook-instantie onder bevindt Acties.

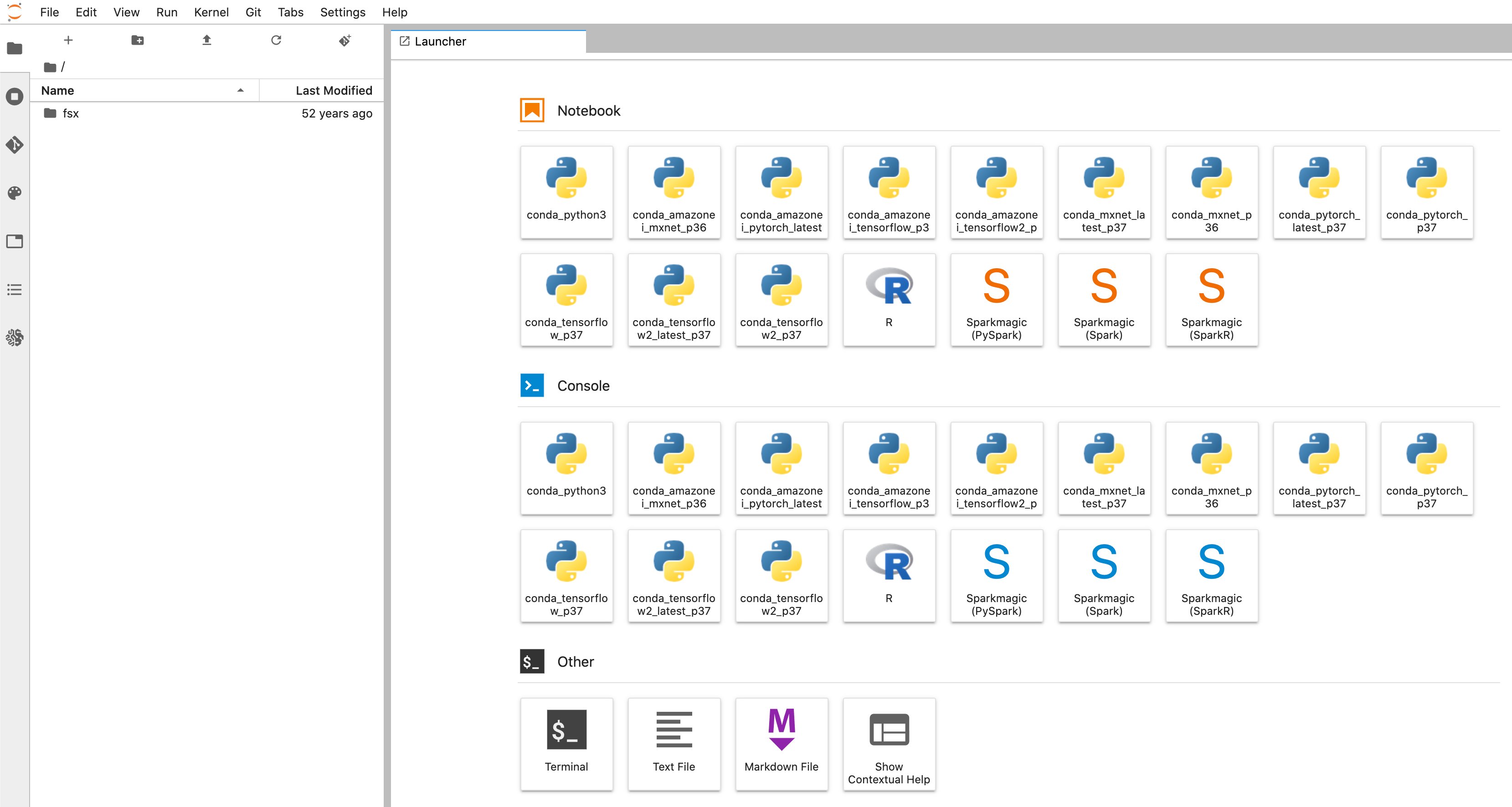

- U ziet een pictogram zoals dit terwijl de pagina wordt geladen:

- U wordt omgeleid naar een nieuw browsertabblad dat eruitziet als in het volgende diagram:

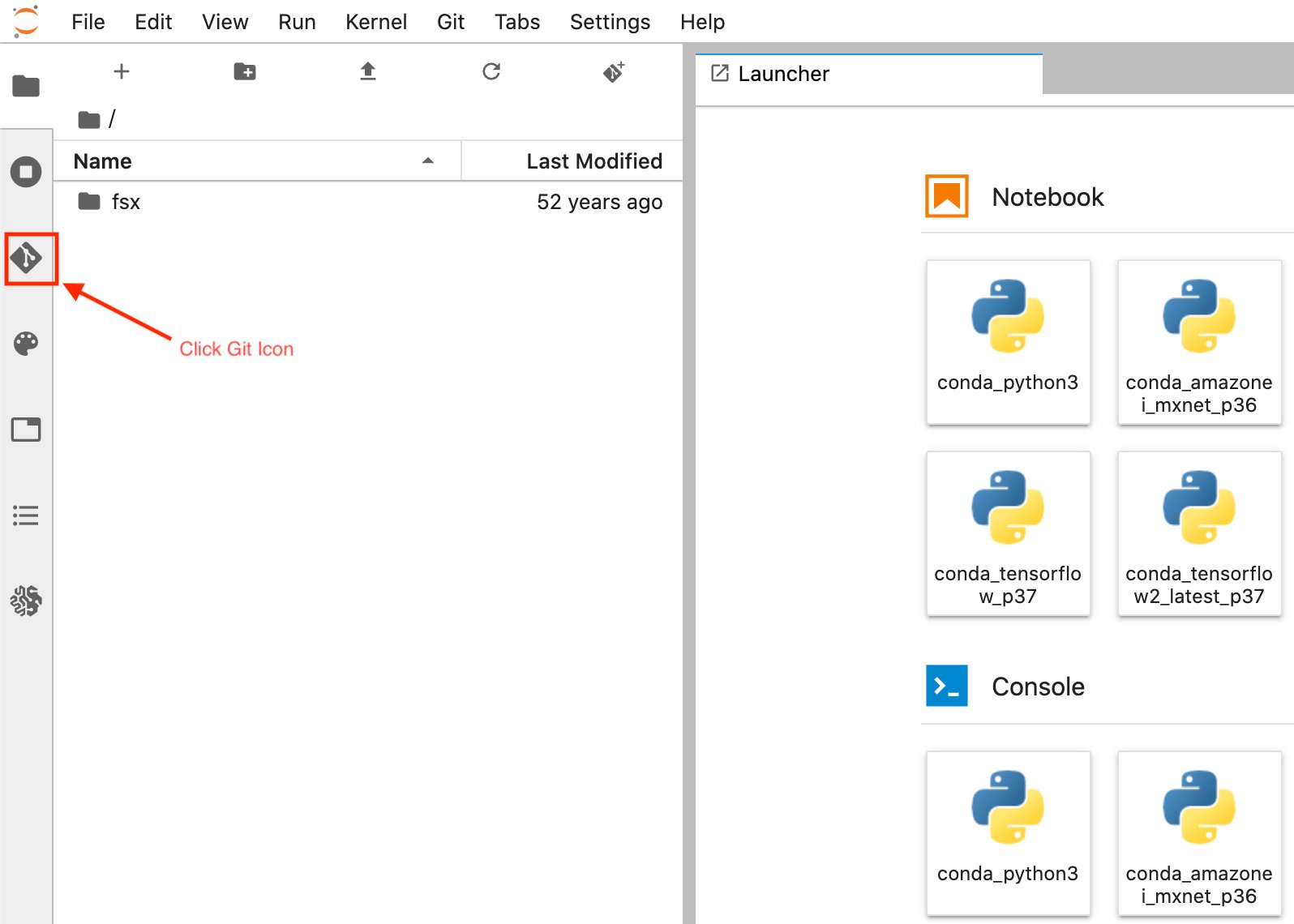

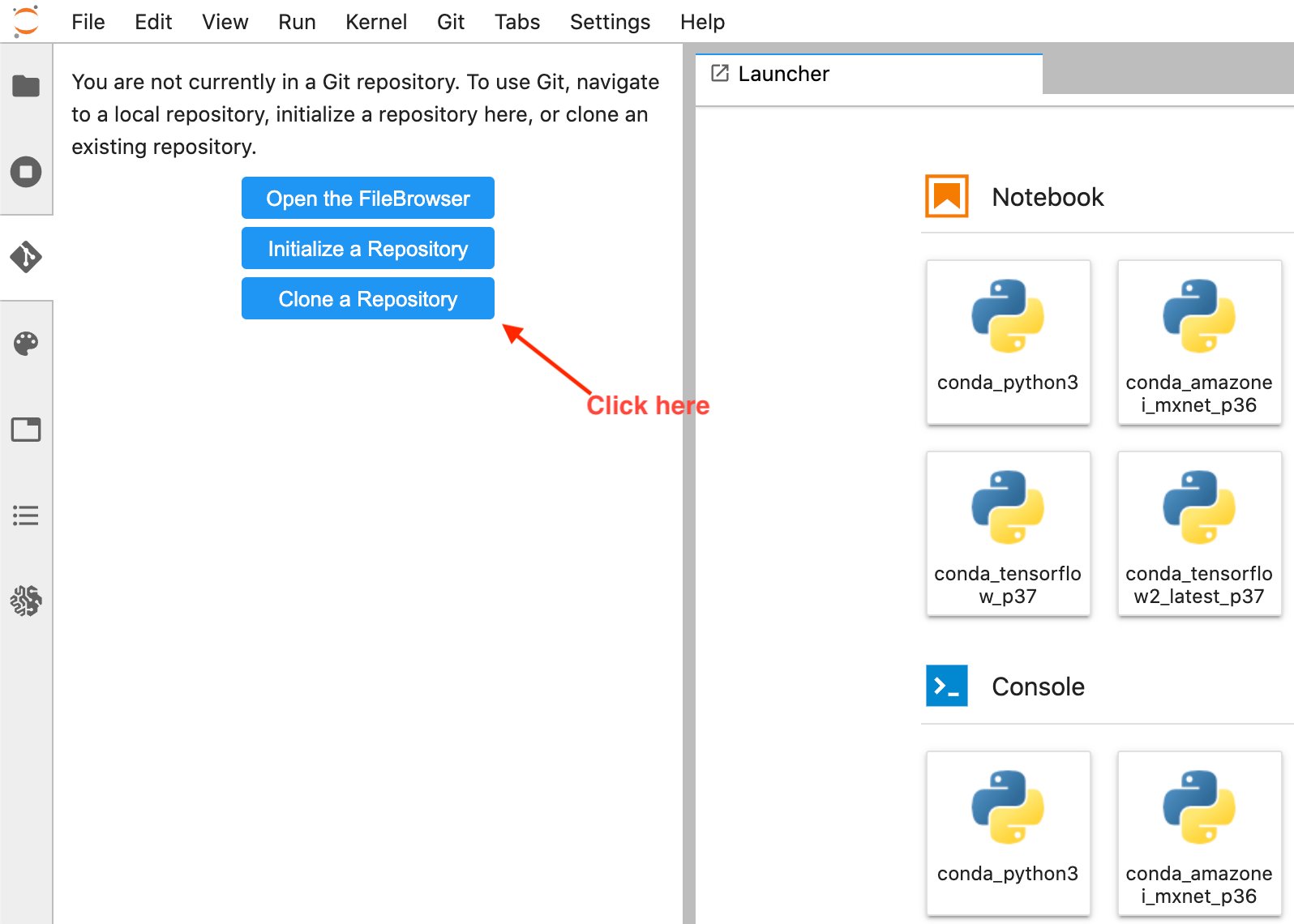

- Zodra u zich in de gebruikersinterface van Amazon SageMaker Notebook Instance Launcher bevindt. Selecteer in de linkerzijbalk de Git pictogram zoals weergegeven in het volgende diagram.

- kies Een opslagplaats klonen optie.

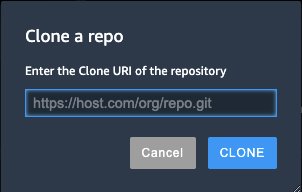

- Voer GitHub-URL in (https://github.com/aws-samples/end-2-end-3d-ml) in het pop-upvenster en kies klonen.

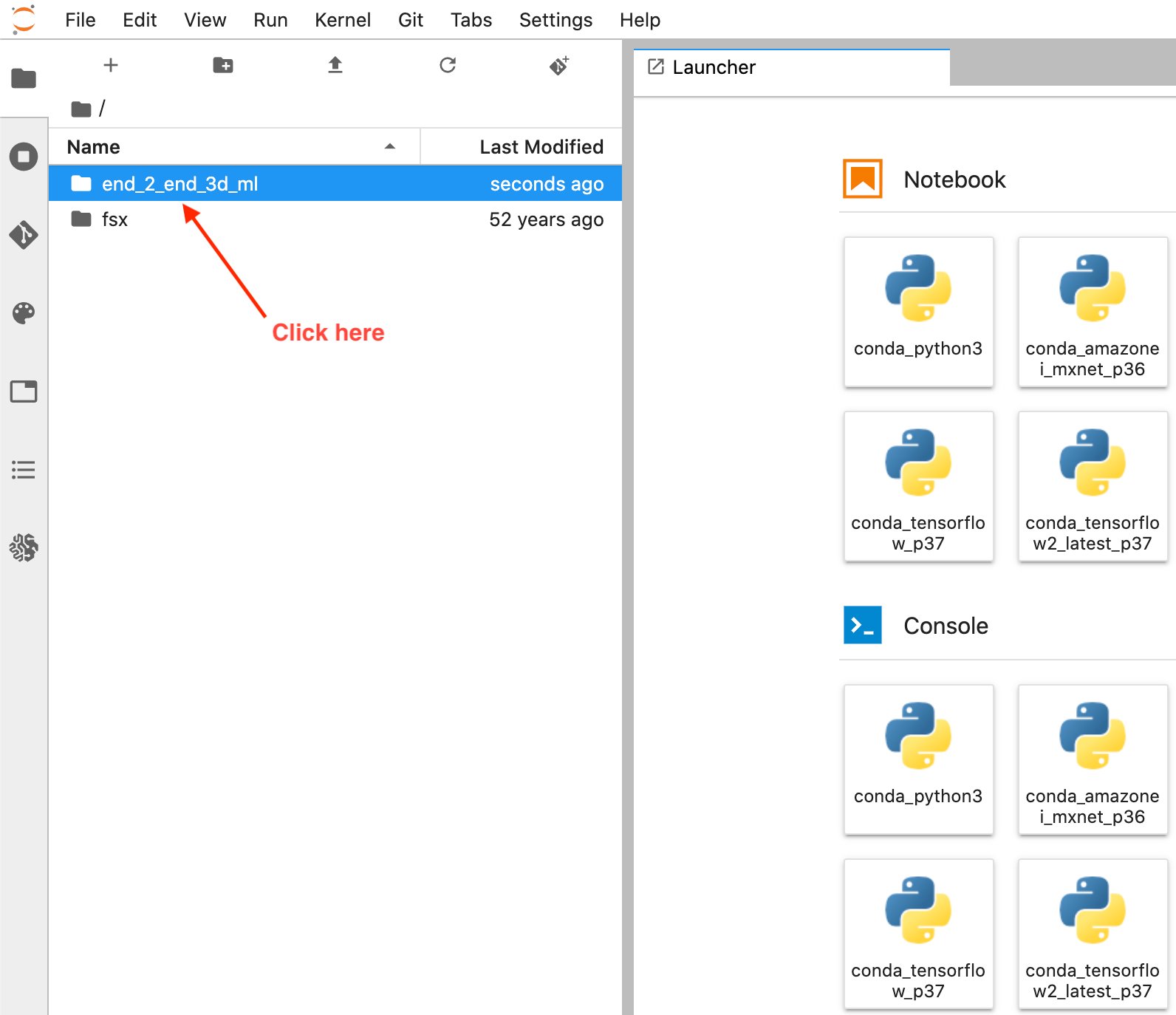

- kies Bestandsbrowser om de GitHub-map te zien.

- Open het notitieboek met de titel

1_visualization.ipynb.

De notebook bedienen

Overzicht

De eerste paar cellen van het notitieblok in de sectie met de titel Gedownloade bestanden laat zien hoe u de dataset kunt downloaden en de bestanden erin kunt inspecteren. Nadat de cellen zijn uitgevoerd, duurt het een paar minuten voordat de gegevens zijn gedownload.

Na het downloaden kunt u de bestandsstructuur van A2D2 bekijken, een lijst met scènes of stations. Een scène is een korte opname van sensorgegevens van ons voertuig. A2D2 biedt 18 van deze scènes waarop we kunnen trainen, die allemaal worden geïdentificeerd door unieke datums. Elke scène bevat 2D-cameragegevens, 2D-labels, 3D-kubusvormige annotaties en 3D-puntenwolken.

U kunt de bestandsstructuur voor de A2D2-dataset bekijken met het volgende:

A2D2-sensoropstelling

In de volgende sectie leest u enkele van deze puntenwolkgegevens om er zeker van te zijn dat we deze correct interpreteren en in het notitieboek kunnen visualiseren voordat we proberen het om te zetten in een formaat dat klaar is voor gegevenslabels.

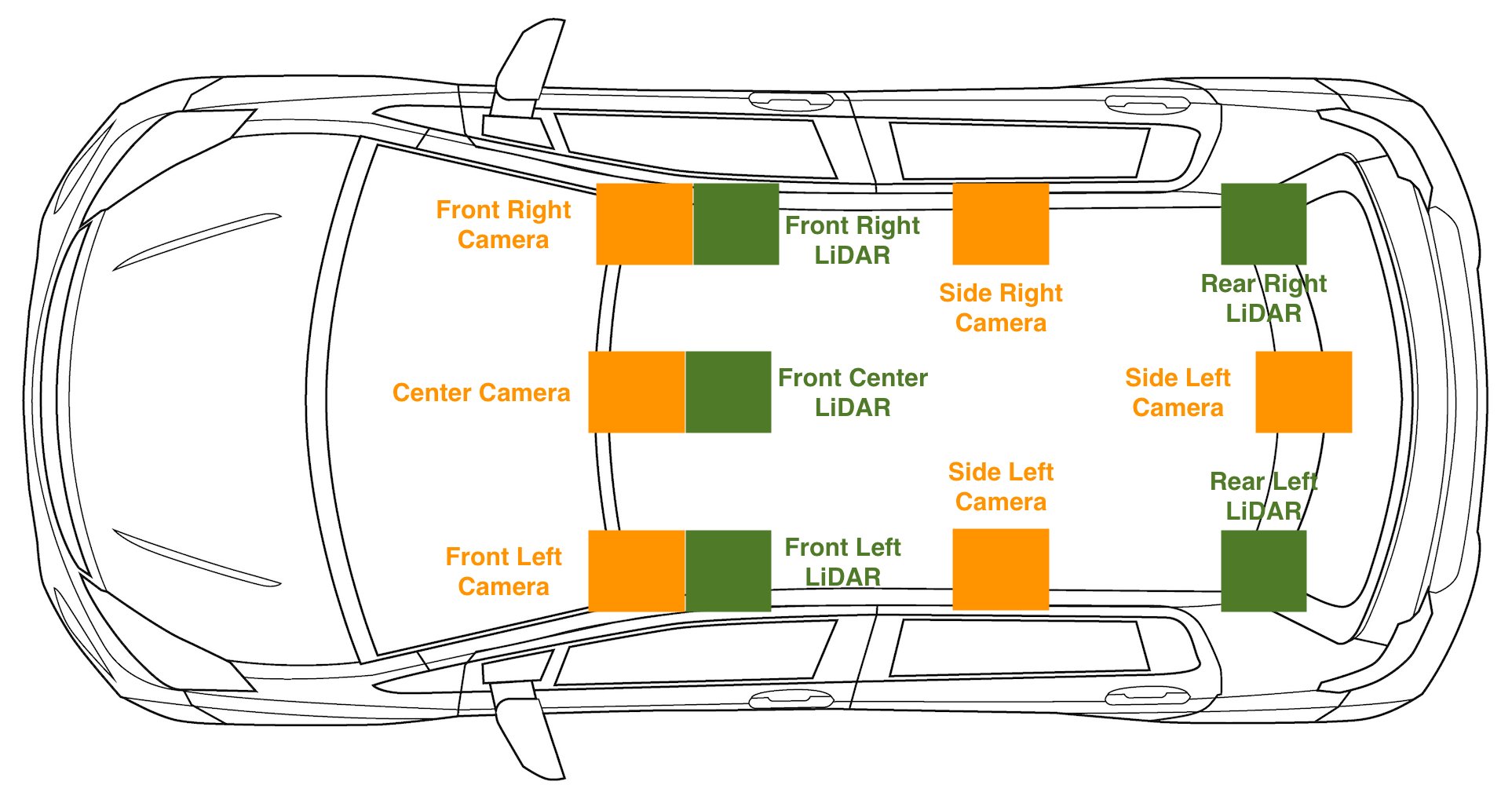

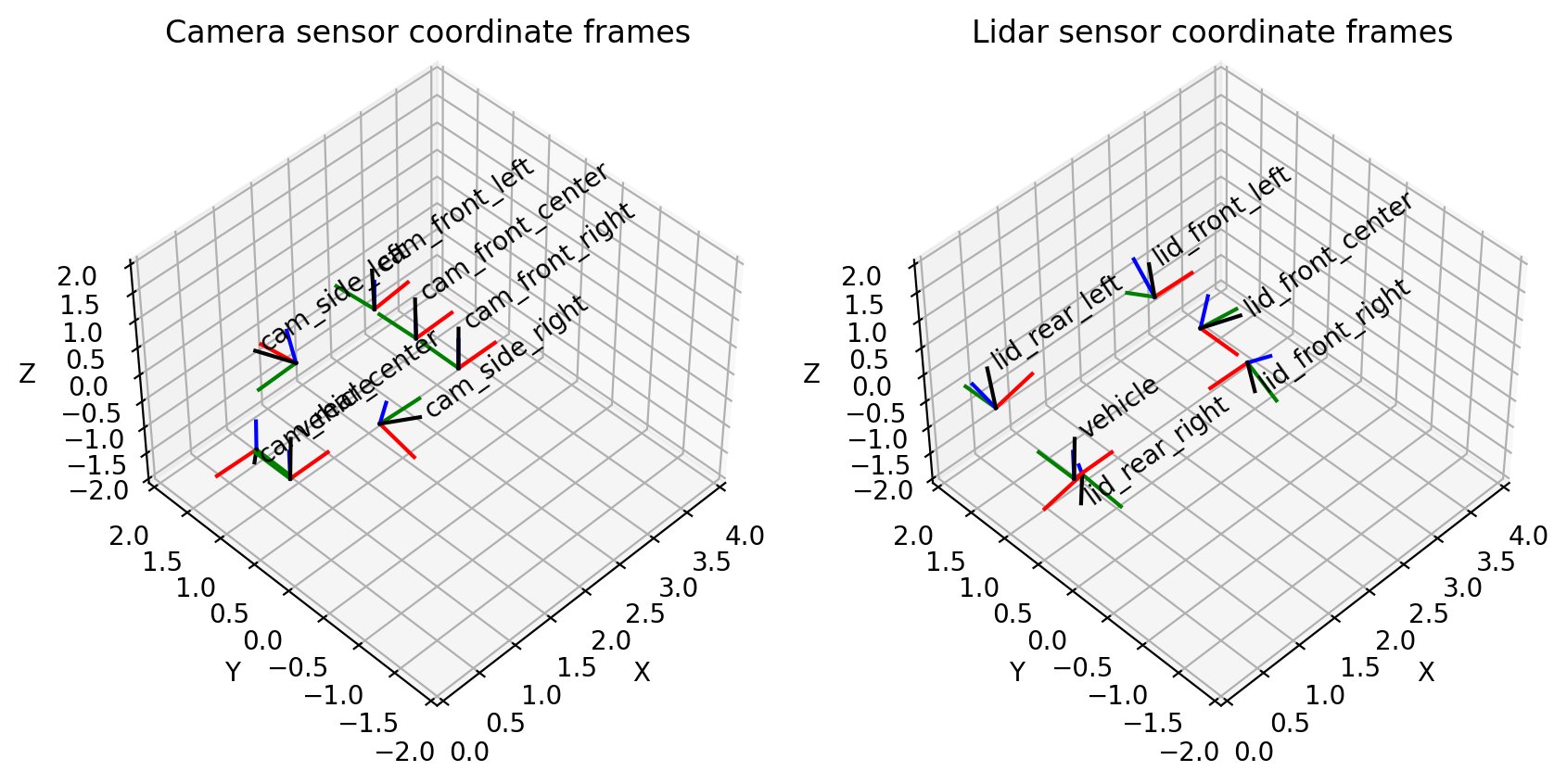

Voor elke vorm van autonoom rijden waarbij we 2D- en 3D-sensorgegevens hebben, is het vastleggen van sensorkalibratiegegevens essentieel. Naast de ruwe data hebben we ook gedownload cams_lidar.json. Dit bestand bevat de vertaling en oriëntatie van elke sensor ten opzichte van het coördinatenframe van het voertuig. Dit kan ook de positie van de sensor of locatie in de ruimte worden genoemd. Dit is belangrijk voor het converteren van punten van het coördinatenframe van een sensor naar het coördinatenframe van het voertuig. Met andere woorden, het is belangrijk voor het visualiseren van de 2D- en 3D-sensoren terwijl het voertuig rijdt. Het coördinatenframe van het voertuig wordt gedefinieerd als een statisch punt in het midden van het voertuig, met de x-as in de richting van de voorwaartse beweging van het voertuig, de y-as geeft links en rechts aan en links is positief, en de z- as die door het dak van het voertuig wijst. Een punt (X,Y,Z) van (5,2,1) betekent dat dit punt 5 meter voor ons voertuig ligt, 2 meter naar links en 1 meter boven ons voertuig. Met deze kalibraties kunnen we ook 3D-punten op ons 2D-beeld projecteren, wat vooral handig is voor het labelen van puntenwolken.

Raadpleeg het volgende diagram om de sensoropstelling op het voertuig te zien.

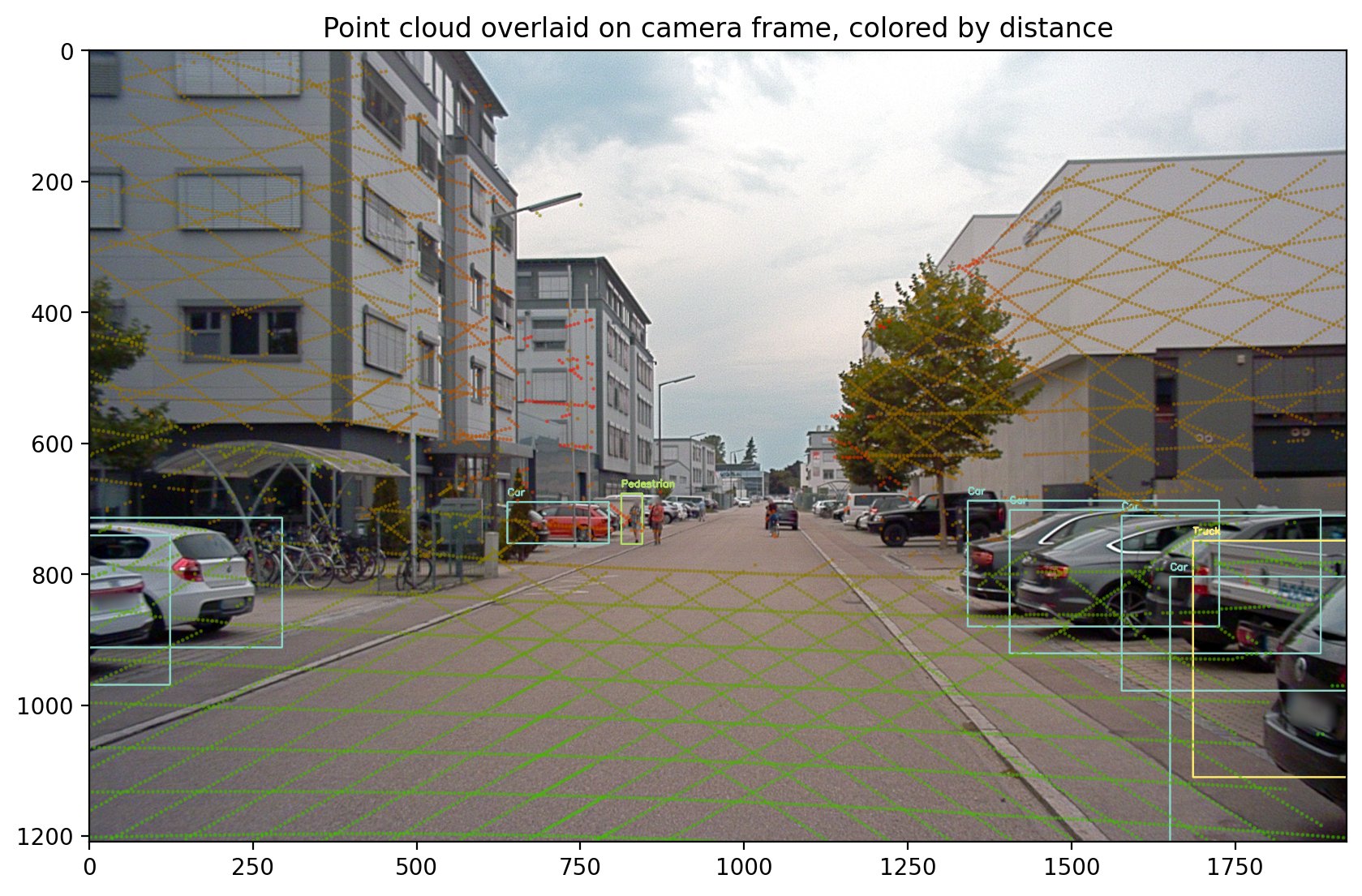

De puntenwolkgegevens waarop we trainen, zijn specifiek afgestemd op de naar voren gerichte camera of cam front-center:

Dit komt overeen met onze visualisatie van camerasensoren in 3D:

In dit gedeelte van de notebook wordt gevalideerd dat de A2D2-dataset overeenkomt met onze verwachtingen over sensorposities en dat we gegevens van de puntenwolksensoren kunnen uitlijnen met het cameraframe. Voel je vrij om alle cellen door de titel te halen Projectie van 3D naar 2D om uw puntenwolkgegevens als overlay te zien op het volgende camerabeeld.

Conversie naar Amazon SageMaker Ground Truth

Nadat we onze gegevens in ons notitieboekje hebben gevisualiseerd, kunnen we onze puntenwolken vol vertrouwen omzetten in Amazon Het 3D-formaat van SageMaker Ground Truth om onze labels te verifiëren en aan te passen. In dit gedeelte wordt uitgelegd hoe u het gegevensformaat van A2D2 converteert naar een Amazon SageMaker Ground Truth-reeksbestand, met het invoerformaat dat wordt gebruikt door de modaliteit voor het volgen van objecten.

Het sequentiebestandsformaat omvat de puntenwolkformaten, de afbeeldingen die bij elke puntenwolk horen, en alle sensorpositie- en oriëntatiegegevens die nodig zijn om afbeeldingen uit te lijnen met puntenwolken. Deze conversies worden gedaan met behulp van de sensorinformatie die uit de vorige sectie is gelezen. Het volgende voorbeeld is een reeksbestandsindeling van Amazon SageMaker Ground Truth, die een reeks met slechts één tijdstap beschrijft.

De puntenwolk voor deze tijdstap bevindt zich op s3://sagemaker-us-east-1-322552456788/a2d2_smgt/20180807_145028_out/20180807145028_lidar_frontcenter_000000091.txt en heeft een formaat van <x coordinate> <y coordinate> <z coordinate>.

Geassocieerd met de puntenwolk, bevindt zich een enkel camerabeeld op s3://sagemaker-us-east-1-322552456788/a2d2_smgt/20180807_145028_out/undistort_20180807145028_camera_frontcenter_000000091.png. Merk op dat we het sequentiebestand nemen dat alle cameraparameters definieert om projectie van de puntenwolk naar de camera en terug mogelijk te maken.

Conversie naar dit invoerformaat vereist dat we een conversie schrijven van het dataformaat van A2D2 naar dataformaten die worden ondersteund door Amazon SageMaker Ground Truth. Dit is hetzelfde proces dat iedereen moet ondergaan wanneer hij zijn eigen gegevens meebrengt voor etikettering. We zullen stap voor stap doornemen hoe deze conversie werkt. Als je meegaat in het notitieboek, kijk dan naar de functie met de naam a2d2_scene_to_smgt_sequence_and_seq_label.

Puntenwolk conversie

De eerste stap is het converteren van de gegevens van een gecomprimeerd bestand in Numpy-indeling (NPZ), dat is gegenereerd met het bestand numpy.weten methode, naar een geaccepteerd ruw 3D-formaat voor Amazon SageMaker Ground Truth. Concreet genereren we een bestand met één rij per punt. Elk 3D-punt wordt gedefinieerd door drie zwevende komma X-, Y- en Z-coördinaten. Wanneer we ons formaat specificeren in het sequentiebestand, gebruiken we de string text/xyz om dit formaat weer te geven. Amazon SageMaker Ground Truth ondersteunt ook het toevoegen van intensiteitswaarden of rood-groen-blauwe (RGB)-punten.

De NPZ-bestanden van A2D2 bevatten meerdere Numpy-arrays, elk met een eigen naam. Om een conversie uit te voeren, laden we het NPZ-bestand met behulp van Numpy's laden methode, toegang tot de array genaamd punten (dwz een Nx3-array, waarbij N het aantal punten in de puntenwolk is), en bewaar als tekst in een nieuw bestand met behulp van Numpy's bewaartxt methode.

Voorbewerking van afbeeldingen

Vervolgens bereiden we onze afbeeldingsbestanden voor. A2D2 biedt PNG-afbeeldingen en Amazon SageMaker Ground Truth ondersteunt PNG-afbeeldingen; deze afbeeldingen zijn echter vervormd. Vervorming treedt vaak op omdat de beeldopnamelens niet evenwijdig aan het beeldvlak is uitgelijnd, waardoor sommige delen van het beeld dichterbij lijken dan verwacht. Deze vervorming beschrijft het verschil tussen een fysieke camera en een geïdealiseerd pinhole cameramodel. Als er geen rekening wordt gehouden met vervorming, kan Amazon SageMaker Ground Truth onze 3D-punten niet bovenop de camerabeelden weergeven, wat het moeilijker maakt om te labelen. Bekijk deze documentatie van voor een zelfstudie over camerakalibratie OpenCV.

Hoewel Amazon SageMaker Ground Truth vervormingscoëfficiënten in het invoerbestand ondersteunt, kunt u ook voorbewerking uitvoeren vóór de labeltaak. Aangezien A2D2 helpercode levert om vervorming ongedaan te maken, passen we deze toe op de afbeelding en laten we de velden die verband houden met vervorming uit ons sequentiebestand. Merk op dat de vervormingsgerelateerde velden omvatten k1, k2, k3, k4, p1, p2 en scheeftrekken.

Camerapositie, oriëntatie en projectieconversie

Naast de onbewerkte gegevensbestanden die nodig zijn voor het labelen, heeft het sequentiebestand ook camerapositie- en oriëntatie-informatie nodig om de projectie van 3D-punten in de 2D-camerabeelden uit te voeren. We moeten weten waar de camera in de 3D-ruimte naar kijkt om erachter te komen hoe 3D-kubusvormige labels en 3D-punten bovenop onze afbeeldingen moeten worden weergegeven.

Omdat we onze sensorposities hebben geladen in een gemeenschappelijke transformatiemanager in het gedeelte A2D2-sensorinstellingen, kunnen we de transformatiemanager gemakkelijk om de gewenste informatie vragen. In ons geval behandelen we de voertuigpositie als (0, 0, 0) in elk frame omdat we geen positie-informatie van de sensor hebben die wordt geleverd door de objectdetectiedataset van A2D2. Dus ten opzichte van ons voertuig wordt de oriëntatie en positie van de camera beschreven door de volgende code:

Nu positie en oriëntatie zijn geconverteerd, moeten we ook waarden opgeven voor fx, fy, cx en cy, alle parameters voor elke camera in het sequentiebestandsformaat.

Deze parameters verwijzen naar waarden in de cameramatrix. Terwijl de positie en oriëntatie beschrijven in welke richting een camera kijkt, beschrijft de cameramatrix het gezichtsveld van de camera en precies hoe een 3D-punt ten opzichte van de camera wordt omgezet in een 2D-pixellocatie in een afbeelding.

A2D2 biedt een cameramatrix. In de volgende code wordt een referentiecameramatrix weergegeven, samen met hoe onze notebook deze matrix indexeert om de juiste velden te krijgen.

Nu alle velden zijn geparseerd vanuit het formaat van A2D2, kunnen we het sequentiebestand opslaan en gebruiken in een Amazon SageMaker Ground Truth invoermanifestbestand om een labeltaak te starten. Met deze labeltaak kunnen we 3D-labels voor begrenzingskaders maken die stroomafwaarts kunnen worden gebruikt voor training van 3D-modellen.

Voer alle cellen uit tot het einde van de notebook en zorg ervoor dat u de workteam ARN met de Amazon SageMaker Ground Truth workteam ARN je hebt een vereiste gemaakt. Na ongeveer 10 minuten tijd voor het maken van een labeltaak, zou u in staat moeten zijn om in te loggen op het werknemersportaal en de gebruikersinterface labelen om uw scène te visualiseren.

Opruimen

Verwijder de AWS CloudFormation-stack die u hebt geïmplementeerd met behulp van de Start Stack knop genoemd ThreeD in de AWS CloudFormation-console om alle bronnen te verwijderen die in dit bericht worden gebruikt, inclusief alle actieve instanties.

Geschatte kosten

De geschatte kosten zijn $ 5 voor 2 uur.

Conclusie

In dit bericht hebben we gedemonstreerd hoe u 3D-gegevens kunt nemen en deze kunt converteren naar een formulier dat klaar is om te worden gelabeld in Amazon SageMaker Ground Truth. Met deze stappen kunt u uw eigen 3D-gegevens labelen voor het trainen van objectdetectiemodellen. In het volgende bericht in deze serie laten we u zien hoe u A2D2 neemt en een objectdetectormodel traint op de labels die al in de dataset staan.

Gelukkig gebouw!

Over de auteurs

Isaak Privitera is Senior Data Scientist bij de Amazon Machine Learning Solutions-lab, waar hij op maat gemaakte machine learning- en deep learning-oplossingen ontwikkelt om zakelijke problemen van klanten aan te pakken. Hij werkt voornamelijk op het gebied van computervisie, waarbij hij zich richt op het mogelijk maken van AWS-klanten met gedistribueerde training en actief leren.

Isaak Privitera is Senior Data Scientist bij de Amazon Machine Learning Solutions-lab, waar hij op maat gemaakte machine learning- en deep learning-oplossingen ontwikkelt om zakelijke problemen van klanten aan te pakken. Hij werkt voornamelijk op het gebied van computervisie, waarbij hij zich richt op het mogelijk maken van AWS-klanten met gedistribueerde training en actief leren.

Vidya Sagar Ravipati is beheerder bij de Amazon Machine Learning Solutions-lab, waar hij gebruikmaakt van zijn uitgebreide ervaring in grootschalige gedistribueerde systemen en zijn passie voor machine learning om AWS-klanten in verschillende branche-branches te helpen hun AI- en cloud-acceptatie te versnellen. Eerder was hij Machine Learning Engineer in Connectivity Services bij Amazon, die hielp bij het bouwen van personalisatie- en voorspellende onderhoudsplatforms.

Vidya Sagar Ravipati is beheerder bij de Amazon Machine Learning Solutions-lab, waar hij gebruikmaakt van zijn uitgebreide ervaring in grootschalige gedistribueerde systemen en zijn passie voor machine learning om AWS-klanten in verschillende branche-branches te helpen hun AI- en cloud-acceptatie te versnellen. Eerder was hij Machine Learning Engineer in Connectivity Services bij Amazon, die hielp bij het bouwen van personalisatie- en voorspellende onderhoudsplatforms.

Jeremy Feltracco is een Software Development Engineer met th Amazon Machine Learning Solutions-lab bij Amazon Web Services. Hij gebruikt zijn achtergrond in computervisie, robotica en machine learning om AWS-klanten te helpen hun AI-adoptie te versnellen.

Jeremy Feltracco is een Software Development Engineer met th Amazon Machine Learning Solutions-lab bij Amazon Web Services. Hij gebruikt zijn achtergrond in computervisie, robotica en machine learning om AWS-klanten te helpen hun AI-adoptie te versnellen.

- Door SEO aangedreven content en PR-distributie. Word vandaag nog versterkt.

- Platoblockchain. Web3 Metaverse Intelligentie. Kennis versterkt. Toegang hier.

- Bron: https://aws.amazon.com/blogs/machine-learning/using-amazon-sagemaker-with-point-clouds-part-1-ground-truth-for-3d-labeling/

- :is

- $UP

- 000

- 1

- 10

- 100

- 1996

- 2D

- 3d

- 7

- 9

- a

- in staat

- Over

- boven

- versnellen

- toegang

- beschikbaar

- Account

- over

- actieve

- toevoeging

- adres

- Adoptie

- Na

- vooruit

- AI

- uitgelijnd

- Alles

- toestaat

- al

- Amazone

- Amazon Cognito

- Amazon Sage Maker

- Amazon SageMaker Grondwaarheid

- Amazon Web Services

- en

- iedereen

- gebruiken

- Solliciteer

- passend

- ongeveer

- architectuur

- ZIJN

- gebieden

- rond

- reeks

- AS

- geassocieerd

- At

- aangevuld

- Augmented Reality

- autonoom

- beschikbaarheid

- AWS

- AWS CloudFormatie

- terug

- achtergrond

- BE

- omdat

- worden

- vaardigheden

- wezen

- onder

- tussen

- Blauw

- Box camera's

- Bringing

- browser

- bouw

- Gebouw

- bus

- bedrijfsdeskundigen

- by

- Dit betekent dat we onszelf en onze geliefden praktisch vergiftigen.

- camera

- CAN

- vangen

- Het vastleggen

- auto

- auto's

- geval

- Cellen

- Centreren

- uitdagend

- controle

- Kies

- klasse

- klassen

- dichterbij

- Cloud

- cloud adoptie

- code

- Gemeen

- Bedrijven

- compleet

- Berekenen

- computer

- Computer visie

- vertrouwen

- Connectiviteit

- troosten

- bevatten

- bevat

- Camper ombouw

- conversies

- converteren

- geconverteerd

- coördineren

- Kosten

- kostenefficient

- deksel

- en je merk te creëren

- aangemaakt

- creëert

- het aanmaken

- Klanten

- CX

- gegevens

- data scientist

- datasets

- Data

- deep

- diepgaand leren

- gedefinieerd

- definieert

- tonen

- gedemonstreerd

- demonstreert

- implementeren

- ingezet

- inzet

- diepte

- beschrijven

- beschreven

- Opsporing

- bepalen

- Ontwikkeling

- ontwikkelt

- systemen

- verschil

- anders

- moeilijk

- richting

- bespreken

- verdeeld

- gedistribueerde systemen

- gedistribueerde training

- documentatie

- Dont

- Download

- aandrijving

- e

- elk

- gemakkelijk

- waardoor

- Endpoint

- ingenieur

- verzekeren

- Milieu

- vooral

- essentieel

- etc

- Zelfs

- precies

- voorbeeld

- verwachtingen

- verwacht

- ervaring

- naar

- weinig

- veld-

- Velden

- Figuur

- Dien in

- Bestanden

- afmaken

- Voornaam*

- drijvend

- stroom

- Focus

- gericht

- volgend

- Voor

- formulier

- formaat

- Naar voren

- gevonden

- FRAME

- Gratis

- oppompen van

- voor

- functie

- fusie

- FX

- voortbrengen

- gegenereerde

- krijgen

- gif

- Git

- GitHub

- Go

- Goes

- Groen

- Ground

- Groeiend

- handvat

- Hebben

- met

- Titel

- hulp

- geholpen

- nuttig

- Hosting

- HOURS

- Hoe

- How To

- Echter

- HTML

- HTTPS

- i

- ICON

- geïdentificeerd

- beeld

- afbeeldingen

- Imaging

- uitvoeren

- belangrijk

- in

- Anders

- omvatten

- omvat

- Inclusief

- meer

- in toenemende mate

- indexen

- -industrie

- informatie

- invoer

- instantie

- instructies

- belang

- geïnteresseerd

- Interface

- IT

- HAAR

- Jobomschrijving:

- Vacatures

- jpg

- json

- Soort

- blijven

- label

- etikettering

- labels

- grootschalig

- laser

- lancering

- LEARN

- leren

- Verlof

- hefbomen

- licht

- als

- Lijst

- laden

- ladingen

- gelegen

- plaats

- Kijk

- op zoek

- LOOKS

- machine

- machine learning

- onderhoud

- maken

- MERKEN

- beheerd

- manager

- beheert

- in kaart brengen

- Matrix

- middel

- het meten van

- methode

- minuten

- ML

- Mobile

- mobiele toestellen

- model

- modellen

- monitor

- meer

- meest

- beweging

- meervoudig

- naam

- Genoemd

- Noodzaak

- New

- volgende

- notitieboekje

- aantal

- numpy

- object

- Objectdetectie

- objecten

- of

- on

- EEN

- open

- OpenCV

- besturen

- Keuze

- Overige

- uitgang

- totaal

- het te bezitten.

- pagina

- Parallel

- parameters

- deel

- bijzonder

- passie

- pad

- Uitvoeren

- Personalisatie

- Fysiek

- pijpleiding

- pixel

- platforms

- Plato

- Plato gegevensintelligentie

- PlatoData

- punt

- punten

- Portaal

- positie

- posities

- positief

- Post

- voorspellen

- Voorbereiden

- vorig

- die eerder

- in de eerste plaats

- privaat

- problemen

- productie

- profilering

- Voortgang

- project

- Projectie

- mits

- biedt

- variërend

- tarief

- Rauw

- Lees

- lezing

- klaar

- real-time

- Realiteit

- opname

- Rood

- verwezen

- weerspiegeld

- regio

- verwant

- relevante

- resterende

- verwijderen

- vervangen

- vertegenwoordigen

- nodig

- vereist

- hulpbron

- Resources

- Resultaten

- terugkeer

- beoordelen

- RGB

- robotica

- rollen

- dak

- RIJ

- lopen

- lopend

- s

- sagemaker

- dezelfde

- Bespaar

- scène

- Scenes

- Wetenschapper

- Ontdek

- Tweede

- sectie

- segmentatie

- senior

- sensor

- Volgorde

- -Series

- Diensten

- setup

- Bermuda's

- moet

- tonen

- getoond

- Shows

- kant

- Signaal

- sinds

- single

- So

- Software

- software development

- oplossing

- Oplossingen

- sommige

- bron

- Tussenruimte

- ruimten

- specifiek

- stack

- standaard

- begin

- Stap voor

- Stappen

- structuur

- leveren

- ondersteuning

- ondersteunde

- steunen

- Oppervlak

- Systems

- tafel

- Nemen

- neemt

- targeting

- taken

- sjabloon

- proef

- dat

- De

- de informatie

- hun

- Deze

- drie

- Door

- niet de tijd of

- getiteld

- naar

- tools

- top

- Totaal

- Tracking

- Trainen

- Trainingen

- Transformeren

- Vertaling

- behandelen

- truck

- zelfstudie

- typisch

- typisch

- ui

- voor

- begrijpen

- begrip

- unieke

- us

- .

- Gebruiker

- User Interface

- BEVESTIG

- Values

- groot

- voertuig

- Voertuigen

- controleren

- verticals

- Video

- Bekijk

- .

- visie

- visualisatie

- Manier..

- web

- webservices

- GOED

- welke

- en

- WIE

- Wikipedia

- wil

- Met

- binnen

- woorden

- werker

- Workforce

- Bedrijven

- schrijven

- code schrijven

- geschreven

- X

- YAML

- You

- Your

- zephyrnet