Toen Stable Diffusion, de AI-toepassing die fotorealistische beelden weergeeft die een paar weken geleden op de voorgrond zijn gezet, een paar weken geleden op de voorgrond trad, kwam er een nieuw modewoord bij; hypernetwerken.

Nu zijn stabiele diffusie en hypernetwerken al zo samengevoegd dat het onmogelijk is om de een zonder de ander in dezelfde paragraaf te noemen.

“Ik heb stabiele diffusie-hypernetwerken getraind op kleine datasets (nee, geen hedendaagse kunstenaars afgezien van ondergetekende) om het obscure 'stijlen' te leren die het niet direct begrijpt. Het werkt precies zoals beschreven, eigenlijk beter dan ik zelf had gedacht”, zegt een gebruiker op twitter.

ik heb stabiele diffusie-hypernetwerken getraind op kleine datasets (nee, geen hedendaagse kunstenaars behalve ondergetekende) om het obscure "stijlen" te leren die het niet echt begrijpt out of the box. het werkt precies zoals hij beschreef, eigenlijk beter dan ik zelf dacht dat het zou doen.

- spijtmaximalisator (@regretmaximizer) 20 december 2022

Dit belichaamt de hypernetwerk-buzz die netizens de laatste tijd aangrijpt.

In de informatica is een hypernetwerk technisch gezien een netwerk dat gewichten genereert voor een hoofdnetwerk. Met andere woorden, er wordt aangenomen dat het gedrag van het hoofdnetwerk hetzelfde is als dat van andere neurale netwerken, omdat het leert om sommige onbewerkte inputs naar hun gewenste doelen te mappen, terwijl het hypernetwerk een set inputs neemt die informatie bevatten over de structuur van de gewichten en genereert het gewicht voor die laag.

Lees ook: AI-technologie die levensvernietigende diepe nepbeelden creëert

Hoe worden hypernetwerken gebruikt?

Laten we, om te begrijpen wat een hypernetwerk is, een beetje teruggaan. Als je afbeeldingen hebt gemaakt op Stable Diffusion - de AI-tool voor het maken van digitale kunst en afbeeldingen - ben je die tegengekomen.

Training verwijst over het algemeen naar een proces waarbij een model goede waarden leert (bepalen) voor alle gewichten en de vertekening van gelabelde voorbeelden

Afbeeldingen maken op Stabiele diffusie is geen automatisch proces, zoals we hebben besproken elders. Om daar te komen, zijn er processen.

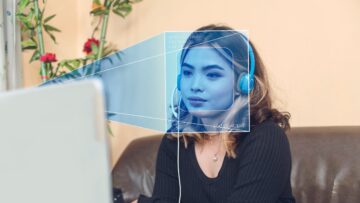

Eerst moet een AI-model leren hoe een afbeelding van iemand via software kan worden weergegeven of gesynthetiseerd tot een foto van een 2D- of 3D-model. Hoewel het Stable Diffusion-model grondig is getest, heeft het enkele trainingsbeperkingen die kunnen worden gecorrigeerd door trainingsmethoden voor inbedding en hypernetwerken.

Om de beste resultaten te krijgen, kunnen eindgebruikers ervoor kiezen om aanvullende training te volgen om de generatie-output af te stemmen op meer specifieke use-cases. Een 'inbedding'-training omvat een verzameling door de gebruiker aangeleverde afbeeldingen en stelt het model in staat om visueel vergelijkbare afbeeldingen te maken wanneer de naam van de inbedding wordt gebruikt binnen een generatieprompt.

Inbeddingen zijn gebaseerd op het concept 'tekstuele inversie', ontwikkeld door onderzoekers van de Universiteit van Tel Aviv, waarbij vectorrepresentaties voor specifieke tokens die door de tekstencoder van het model worden gebruikt, worden gekoppeld aan nieuwe pseudowoorden. Insluiten kan vooroordelen binnen het oorspronkelijke model verminderen of visuele stijlen nabootsen.

Een "hypernetwerk" daarentegen is een vooraf getraind neuraal netwerk dat wordt toegepast op verschillende punten binnen een groter neuraal netwerk, en verwijst naar de techniek die in 2021 is gemaakt door NovelAI-ontwikkelaar Kurumuz, oorspronkelijk bedoeld voor tekstgenererende transformatormodellen .

Traint op specifieke artiesten

Hypernetwerken zijn inbegrepen om de resultaten in een bepaalde richting te sturen, waardoor op Stable Diffusion gebaseerde modellen kunststijlen van specifieke artiesten kunnen repliceren. Het netwerk heeft het voordeel dat het zelfs kan werken als de artiest niet wordt herkend door het originele model en het beeld nog steeds zal verwerken door belangrijke gebieden zoals haar en ogen te vinden en deze gebieden vervolgens in een secundaire latente ruimte te patchen.

“De inbeddingslaag in Stable Diffusion is verantwoordelijk voor het coderen van de invoer (bijvoorbeeld de tekstprompt en klasselabels) in laag-dimensionale vectoren. Deze vectoren helpen het diffusiemodel te leiden om beelden te produceren die overeenkomen met de input van de gebruiker”, legt Benny Cheung uit in zijn blog.

“De Hypernetwork-laag is een manier voor het systeem om te leren en zijn eigen kennis weer te geven. Het stelt Stable Diffusion in staat om beelden te creëren op basis van eerdere ervaringen.”

Terwijl de inbeddingslaag de invoer zoals tekstprompt en klasselabels codeert in laag-dimensionale vectoren om het diffusiemodel te helpen bij het produceren van afbeeldingen die overeenkomen met de invoer van de gebruiker, is de hypernetwerklaag een manier voor het systeem om te leren en zijn eigen laag weer te geven. kennis.

Met andere woorden, het stelt Stable Diffusion in staat om afbeeldingen te creëren op basis van eerdere ervaringen. In stabiele diffusie is een hypernetwerk een extra laag die wordt verwerkt nadat een afbeelding door het model is weergegeven. Het hypernetwerk heeft de neiging om alle resultaten van het model naar uw trainingsgegevens te verschuiven, op een manier die het model in wezen "verandert".

Geheugenbehoud

Dit betekent in wezen dat het hypernetwerk verantwoordelijk is voor het bewaren van afbeeldingen die het systeem eerder heeft gegenereerd. Wanneer een gebruiker een nieuwe invoer geeft, kan het systeem zijn bestaande kennis gebruiken om een nauwkeuriger beeld te creëren. Als zodanig stellen hypernetwerken het systeem daarom in staat om sneller te leren en gaandeweg te verbeteren.

Dit heeft als voordeel dat elke afbeelding die iets bevat dat jouw trainingsgegevens beschrijft, op jouw trainingsgegevens gaat lijken.

“We ontdekten dat trainen met inbedding gemakkelijker is dan trainen met een hypernetwerk voor het genereren van zelfportretten. Onze training heeft goede resultaten opgeleverd waar we tevreden mee zijn”, schreef Cheung.

Welke finetuning techniek gebruik je? Iets als hypernetwerken of tekstuele inversie?

— Mathias Michel (@m91michel) 21 december 2022

Maar het is een technologie waarmee velen nog steeds afdingen. Hypernetwerken en AI-generatoren zijn net begonnen om tegemoet te komen aan de behoeften en wensen van gebruikers. De gebruikersinterfaces en prompttechnieken zullen ongetwijfeld snel vooruitgaan en misschien zelfs aansprekend zijn Kopen Google Reviews overrompeld, zoals MetaNews recent gedekt.

- AI

- ai kunst

- Bitcoin

- blockchain

- blockchain-naleving

- coinbase

- vindingrijk

- Overeenstemming

- cryptoconferentie

- crypto mijnbouw

- cryptogeld

- gedecentraliseerde

- diepe vervalsingen

- Defi

- Digitale activa

- ethereum

- uitgelicht

- hypernetwerken

- machine learning

- MetaNieuws

- niet-vervangbare token

- Plato

- plato ai

- Plato gegevensintelligentie

- PlatoData

- platogamen

- Veelhoek

- Bewijs van het belang

- stabiele diffusie

- Technologie

- W3

- zephyrnet