De siste årene har fremskritt innen datasyn gjort det mulig for forskere, førstehjelpere og myndigheter å takle det utfordrende problemet med å behandle globale satellittbilder for å forstå planeten vår og vår innvirkning på den. AWS nylig utgitt Amazon SageMaker geospatiale muligheter for å gi deg satellittbilder og geospatiale toppmoderne maskinlæringsmodeller (ML), noe som reduserer barrierer for denne typen brukstilfeller. For mer informasjon, se Forhåndsvisning: Bruk Amazon SageMaker til å bygge, trene og distribuere ML-modeller ved å bruke geospatiale data.

Mange byråer, inkludert førstehjelp, bruker disse tilbudene for å få storstilt situasjonsbevissthet og prioritere hjelpearbeid i geografiske områder som har blitt rammet av naturkatastrofer. Disse byråene har ofte å gjøre med katastrofebilder fra lav høyde og satellittkilder, og disse dataene er ofte umerket og vanskelige å bruke. State-of-the-art datasynsmodeller underpresterer ofte når de ser på satellittbilder av en by som en orkan eller skogbrann har truffet. Gitt mangelen på disse datasettene, er til og med state-of-the-art ML-modeller ofte ikke i stand til å levere nøyaktigheten og presisjonen som kreves for å forutsi standard FEMA-katastrofeklassifiseringer.

Geospatiale datasett inneholder nyttige metadata som bredde- og lengdegradskoordinater og tidsstempler, som kan gi kontekst for disse bildene. Dette er spesielt nyttig for å forbedre nøyaktigheten til geospatial ML for katastrofescener, fordi disse bildene i seg selv er rotete og kaotiske. Bygninger er mindre rektangulære, vegetasjon har fått skader, og lineære veier har blitt avbrutt av flom eller gjørmeskred. Fordi merking av disse enorme datasettene er dyrt, manuelt og tidkrevende, er utviklingen av ML-modeller som kan automatisere bildemerking og merknader kritisk.

For å trene denne modellen trenger vi en merket grunnsannhetsundergruppe av LADI-datasett (Low Altitude Disaster Imagery). Dette datasettet består av menneske- og maskinmerkede luftbårne bilder samlet inn av Civil Air Patrol til støtte for ulike katastroferesponser fra 2015-2019. Disse LADI-datasettene fokuserer på de atlantiske orkansesongene og kyststatene langs Atlanterhavet og Mexicogulfen. To viktige forskjeller er lav høyde, skrå perspektiv av bildene og katastroferelaterte funksjoner, som sjelden er omtalt i datasyn-benchmarks og datasett. Lagene brukte eksisterende FEMA-kategorier for skader som flom, rusk, brann og røyk, eller jordskred, som standardiserte etikettkategoriene. Løsningen er da i stand til å gi spådommer på resten av treningsdataene, og rute resultater med lavere konfidens for menneskelig vurdering.

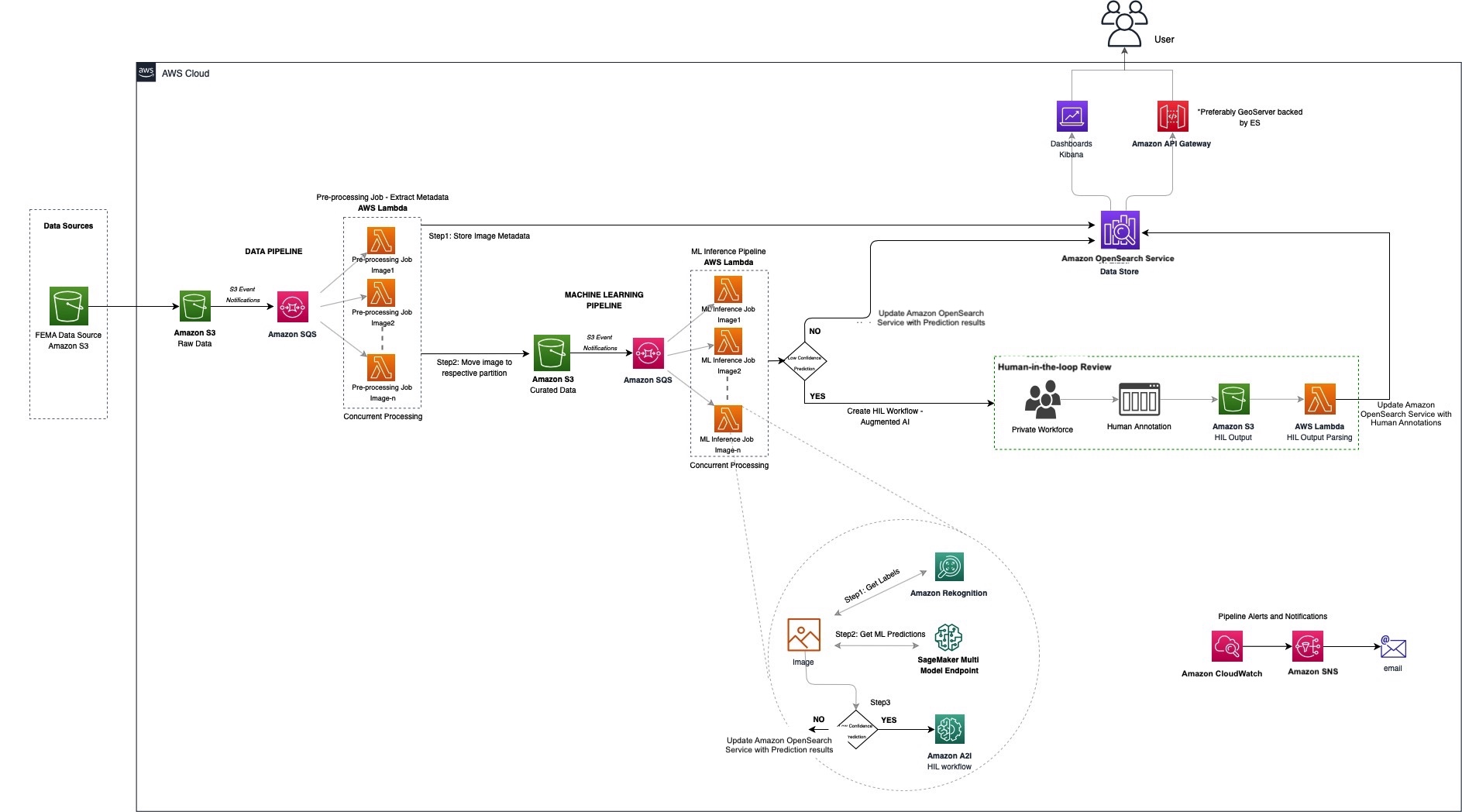

I dette innlegget beskriver vi vår design og implementering av løsningen, beste praksis og nøkkelkomponentene i systemarkitekturen.

Løsningsoversikt

Kort fortalt innebar løsningen å bygge tre rørledninger:

- Datapipeline – Trekker ut metadataene til bildene

- Maskinlæringspipeline – Klassifiserer og merker bilder

- Human-in-the-loop gjennomgangspipeline – Bruker et menneskelig team for å vurdere resultater

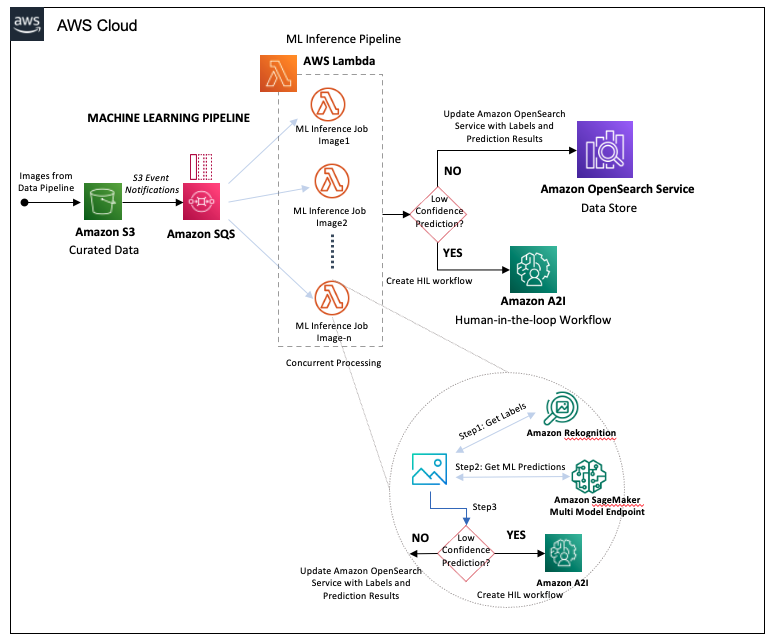

Følgende diagram illustrerer løsningsarkitekturen.

Gitt naturen til et merkesystem som dette, utformet vi en horisontalt skalerbar arkitektur som ville håndtere inntakstopper uten overprovisionering ved å bruke en serverløs arkitektur. Vi bruker et en-til-mange mønster fra Amazon enkel køtjeneste (Amazon SQS) til AWS Lambda på flere steder for å støtte disse inntakstoppene, tilby motstandskraft.

Bruke en SQS-kø for behandling Amazon enkel lagringstjeneste (Amazon S3)-hendelser hjelper oss med å kontrollere samtidigheten av nedstrømsbehandling (Lambda-funksjoner, i dette tilfellet) og håndtere innkommende datatopper. Kø for innkommende meldinger fungerer også som en bufferlagring i tilfelle feil nedstrøms.

Gitt de svært parallelle behovene, valgte vi Lambda for å behandle bildene våre. Lambda er en serverløs databehandlingstjeneste som lar oss kjøre kode uten å klargjøre eller administrere servere, lage arbeidsbelastningsbevisst klyngeskaleringslogikk, vedlikeholde hendelsesintegrasjoner og administrere kjøretider.

Vi bruker Amazon OpenSearch-tjeneste som vårt sentrale datalager for å dra nytte av dets svært skalerbare, raske søk og integrerte visualiseringsverktøy, OpenSearch Dashboards. Det gjør det mulig for oss å iterativt legge til kontekst til bildet, uten å måtte rekompilere eller skalere om, og håndtere skjemaevolusjon.

Amazon-anerkjennelse gjør det enkelt å legge til bilde- og videoanalyse i applikasjonene våre ved å bruke velprøvd, svært skalerbar dyplæringsteknologi. Med Amazon Rekognition får vi en god baseline av oppdagede objekter.

I de følgende avsnittene dykker vi mer detaljert inn i hver rørledning.

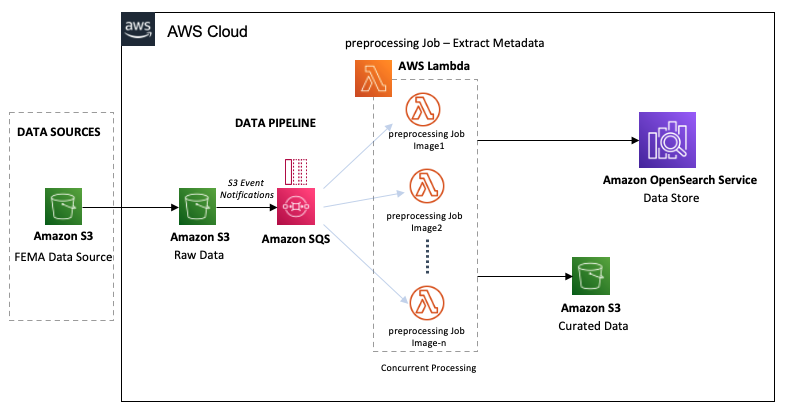

Datapipeline

Følgende diagram viser arbeidsflyten til datarørledningen.

LADI-datapipelinen starter med inntak av rådatabilder fra FEMA Common Alerting Protocol (CAP) i en S3-bøtte. Når vi tar inn bildene i rådatabøtten, behandles de i nesten sanntid i to trinn:

- S3-bøtten utløser hendelsesvarsler for alle objektopprettelser, og lager meldinger i SQS-køen for hvert bilde som tas inn.

- SQS-køen påkaller samtidig forbehandlingslamda-funksjonene på bildet.

Lambda-funksjonene utfører følgende forbehandlingstrinn:

- Beregn UUID for hvert bilde, og oppgi en unik identifikator for hvert bilde. Denne ID-en vil identifisere bildet for hele livssyklusen.

- Trekk ut metadata som GPS-koordinater, bildestørrelse, GIS-informasjon og S3-plassering fra bildet og bevar det i OpenSearch.

- Basert på et oppslag mot FIPS-koder, flytter funksjonen bildet inn i den kurerte data S3-bøtten. Vi deler dataene etter bildets FIPS-State-code/FIPS-County-code/Year/Month.

Maskinlæringspipeline

ML-pipelinen starter fra bildene lander i den kurerte data S3-bøtten i datapipeline-trinnet, som utløser følgende trinn:

- Amazon S3 genererer en melding til en annen SQS-kø for hvert objekt som er opprettet i den kurerte data S3-bøtten.

- SQS-køen utløser samtidig Lambda-funksjoner for å kjøre ML-inferensjobben på bildet.

Lambda-funksjonene utfører følgende handlinger:

- Send hvert bilde til Amazon Rekognition for gjenkjenning av objekter, lagring av returnerte etiketter og respektive konfidenspoeng.

- Komponer Amazon Rekognition-utgangen til inngangsparametere for vår Amazon SageMaker multi-modell endepunkt. Dette endepunktet er vert for vårt ensemble av klassifiserere, som er opplært for spesifikke sett med skadeetiketter.

- Send resultatene av SageMaker-endepunktet til Amazon Augmented AI (Amazon A2I).

Følgende diagram illustrerer rørledningens arbeidsflyt.

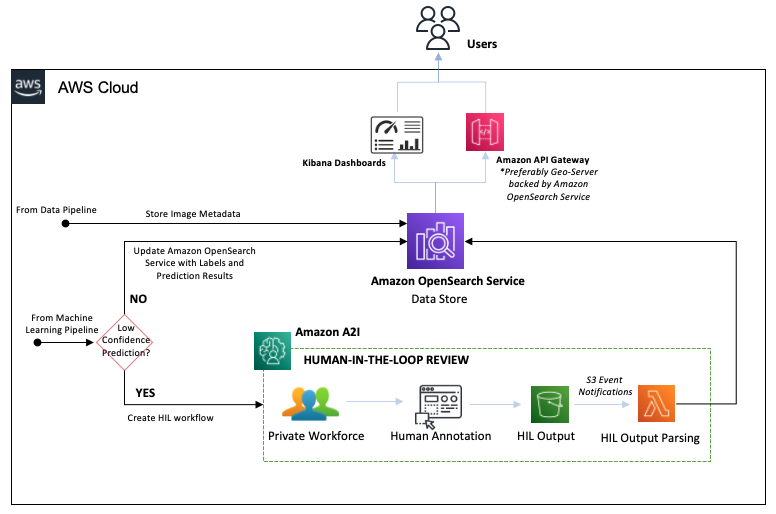

Human-in-the-loop gjennomgangspipeline

Følgende diagram illustrerer rørledningen menneske-i-løkken (HIL).

Med Amazon A2I kan vi konfigurere terskler som vil utløse en menneskelig vurdering av et privat team når en modell gir en lav konfidensprediksjon. Vi kan også bruke Amazon A2I til å gi en løpende revisjon av modellens spådommer. Arbeidsflyttrinnene er som følger:

- Amazon A2I ruter høysikkerhetsspådommer til OpenSearch Service, og oppdaterer bildets etikettdata.

- Amazon A2I sender spådommer med lav konfidens til det private teamet for å kommentere bilder manuelt.

- Den menneskelige anmelderen fullfører merknaden og genererer en utdatafil for menneskelige merknader som er lagret i HIL Output S3-bøtten.

- HIL Output S3-bøtten utløser en Lambda-funksjon som analyserer de menneskelige merknadene og oppdaterer bildets data i OpenSearch Service.

Ved å dirigere de menneskelige annoteringsresultatene tilbake til datalageret, kan vi omskolere ensemblemodellene og iterativt forbedre modellens nøyaktighet.

Med våre resultater av høy kvalitet nå lagret i OpenSearch Service, er vi i stand til å utføre geospatialt og tidsmessig søk via et REST API, ved å bruke Amazon API-gateway og Geoserver. OpenSearch Dashboard gjør det også mulig for brukere å søke og kjøre analyser med dette datasettet.

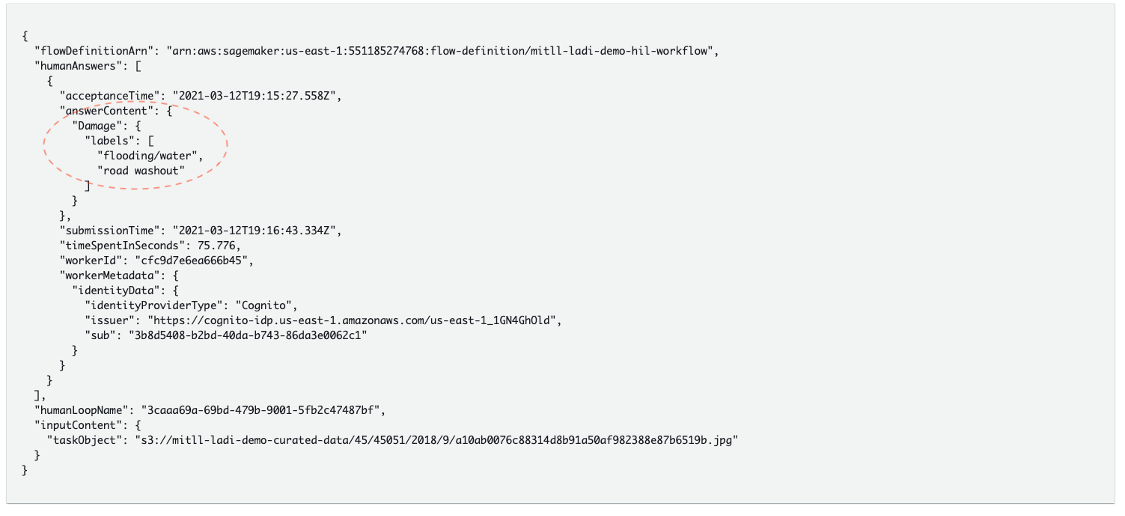

Resultater

Følgende kode viser et eksempel på resultatene våre.

Med denne nye rørledningen skaper vi en menneskelig bakstopper for modeller som ennå ikke har full ytelse. Denne nye ML-rørledningen er satt i produksjon for bruk med en Civil Air Patrol Image Filter microservice som tillater filtrering av Civil Air Patrol-bilder i Puerto Rico. Dette gjør det mulig for førstehjelpere å se skadeomfanget og se bilder knyttet til skaden etter orkaner. AWS Data Lab, AWS Open Data Program, Amazon Disaster Response-team og AWS human-in-the-loop-teamet jobbet med kunder for å utvikle en åpen kildekode-pipeline som kan brukes til å analysere Civil Air Patrol-data lagret i Open Data Programregister på forespørsel etter enhver naturkatastrofe. For mer informasjon om rørledningsarkitekturen og en oversikt over samarbeidet og virkningen, sjekk ut videoen Fokuserer på katastroferespons med Amazon Augmented AI, AWS Open Data Program og AWS Snowball.

konklusjonen

Ettersom klimaendringene fortsetter å øke hyppigheten og intensiteten av stormer og skogbranner, fortsetter vi å se viktigheten av å bruke ML for å forstå virkningen av disse hendelsene på lokalsamfunn. Disse nye verktøyene kan akselerere innsatsen for katastroferespons og tillate oss å bruke dataene fra disse analysene etter hendelse for å forbedre prediksjonsnøyaktigheten til disse modellene med aktiv læring. Disse nye ML-modellene kan automatisere datakommentarer, noe som gjør oss i stand til å utlede omfanget av skade fra hver av disse hendelsene når vi overlegger skadeetiketter med kartdata. Disse kumulative dataene kan også bidra til å forbedre vår evne til å forutsi skader for fremtidige katastrofehendelser, noe som kan gi grunnlag for avbøtende strategier. Dette kan igjen forbedre motstandskraften til lokalsamfunn, økonomier og økosystemer ved å gi beslutningstakere den informasjonen de trenger for å utvikle datadrevet politikk for å håndtere disse nye miljøtruslene.

I dette blogginnlegget diskuterte vi bruk av datasyn på satellittbilder. Denne løsningen er ment å være en referansearkitektur eller en hurtigstartguide som du kan tilpasse for dine egne behov.

Gi det en virvel og la oss få vite hvordan dette løste brukssaken ved å gi tilbakemelding i kommentarfeltet. For mer informasjon, se Amazon SageMaker geospatiale muligheter.

Om forfatterne

Vamshi Krishna Enabothala er en Sr. Applied AI Specialist Architect ved AWS. Han jobber med kunder fra forskjellige sektorer for å akselerere effektive data, analyser og maskinlæringsinitiativer. Han brenner for anbefalingssystemer, NLP og datasyn innen AI og ML. Utenom jobben er Vamshi en RC-entusiast, og bygger RC-utstyr (fly, biler og droner), og liker også hagearbeid.

Vamshi Krishna Enabothala er en Sr. Applied AI Specialist Architect ved AWS. Han jobber med kunder fra forskjellige sektorer for å akselerere effektive data, analyser og maskinlæringsinitiativer. Han brenner for anbefalingssystemer, NLP og datasyn innen AI og ML. Utenom jobben er Vamshi en RC-entusiast, og bygger RC-utstyr (fly, biler og droner), og liker også hagearbeid.

Morgan Dutton er senior teknisk programleder med Amazon Augmented AI og Amazon SageMaker Ground Truth-teamet. Hun jobber med bedriftskunder, akademiske og offentlige kunder for å akselerere bruken av maskinlæring og human-in-the-loop ML-tjenester.

Morgan Dutton er senior teknisk programleder med Amazon Augmented AI og Amazon SageMaker Ground Truth-teamet. Hun jobber med bedriftskunder, akademiske og offentlige kunder for å akselerere bruken av maskinlæring og human-in-the-loop ML-tjenester.

Sandeep Verma er en Sr. Prototyping Architect med AWS. Han liker å dykke dypt inn i kundenes utfordringer og bygge prototyper for kunder for å akselerere innovasjon. Han har bakgrunn fra AI/ML, grunnlegger av New Knowledge, og generelt lidenskapelig opptatt av teknologi. På fritiden elsker han å reise og gå på ski med familien.

Sandeep Verma er en Sr. Prototyping Architect med AWS. Han liker å dykke dypt inn i kundenes utfordringer og bygge prototyper for kunder for å akselerere innovasjon. Han har bakgrunn fra AI/ML, grunnlegger av New Knowledge, og generelt lidenskapelig opptatt av teknologi. På fritiden elsker han å reise og gå på ski med familien.

- SEO-drevet innhold og PR-distribusjon. Bli forsterket i dag.

- Platoblokkkjede. Web3 Metaverse Intelligence. Kunnskap forsterket. Tilgang her.

- kilde: https://aws.amazon.com/blogs/machine-learning/accelerate-disaster-response-with-computer-vision-for-satellite-imagery-using-amazon-sagemaker-and-amazon-augmented-ai/

- 100

- 7

- 98

- a

- evne

- I stand

- Om oss

- akademisk

- akselerere

- nøyaktighet

- handlinger

- aktiv

- handlinger

- adresse

- Adopsjon

- fremskritt

- Fordel

- mot

- byråer

- AI

- AI / ML

- AIR

- Alle

- tillater

- Amazon

- Amazon Augmented AI

- Amazon-anerkjennelse

- Amazon SageMaker

- Amazon SageMaker Ground Truth

- analyser

- analyse

- analytics

- analysere

- og

- En annen

- api

- søknader

- anvendt

- Anvendt AI

- arkitektur

- områder

- assosiert

- revisjon

- augmented

- automatisere

- bevissthet

- AWS

- tilbake

- bakgrunn

- løpssperre

- barrierer

- Baseline

- fordi

- benchmarks

- BEST

- beste praksis

- Blogg

- buffer

- bygge

- Bygning

- lokk

- biler

- saken

- saker

- kategorier

- sentral

- utfordringer

- utfordrende

- endring

- sjekk

- valgte

- City

- Klima

- Klima forandringer

- Cluster

- kode

- samarbeid

- kommentarer

- Felles

- Communities

- Fullfører

- komponenter

- Beregn

- datamaskin

- Datamaskin syn

- selvtillit

- inneholde

- kontekst

- fortsette

- fortsetter

- kontroll

- skape

- opprettet

- Opprette

- kreasjoner

- kritisk

- kuratert

- kunde

- Kunder

- tilpasse

- dashbord

- dato

- data-drevet

- datasett

- håndtering

- beslutningstakere

- dyp

- dyp læring

- leverer

- Etterspørsel

- utplassere

- beskrive

- utforming

- designet

- detalj

- oppdaget

- Gjenkjenning

- utvikle

- Utvikling

- forskjellig

- vanskelig

- katastrofe

- katastrofer

- diskutert

- Droner

- hver enkelt

- økonomier

- økosystemer

- innsats

- Emery

- aktivert

- muliggjør

- Endpoint

- Enterprise

- entusiast

- Hele

- miljømessige

- utstyr

- spesielt

- Selv

- Event

- hendelser

- evolusjon

- eksempel

- eksisterende

- dyrt

- ekstrakter

- familie

- FAST

- kjennetegnet

- Egenskaper

- tilbakemelding

- filet

- filtrere

- filtrering

- Brann

- Først

- Fokus

- etter

- følger

- Grunnleggeren

- Gratis

- Frekvens

- fra

- fullt

- funksjon

- funksjoner

- framtid

- Gevinst

- generelt

- genererer

- genererer

- geografiske

- Geospatial ML

- få

- gitt

- Giving

- Global

- god

- regjeringer

- gps

- Ground

- veilede

- håndtere

- å ha

- hjelpe

- nyttig

- hjelper

- Høy

- høykvalitets

- svært

- hit

- Vertskapet

- Hvordan

- HTML

- HTTPS

- menneskelig

- orkan

- ID

- identifikator

- identifisere

- bilde

- bilder

- Påvirkning

- gjennomføring

- betydning

- forbedre

- bedre

- in

- Inkludert

- Innkommende

- Øke

- informasjon

- initiativer

- Innovasjon

- inngang

- integrert

- integrasjoner

- avbrutt

- påkaller

- involvert

- IT

- Jobb

- nøkkel

- Vet

- kunnskap

- lab

- Etiketten

- merking

- etiketter

- maling

- landing

- storskala

- læring

- forlater

- Lar

- Livssyklus

- lokal

- plassering

- ser

- oppslag

- Lav

- maskin

- maskinlæring

- Vedlike

- gjøre

- GJØR AT

- leder

- administrerende

- håndbok

- manuelt

- kart

- Kart

- massive

- melding

- meldinger

- metadata

- Mexico

- skadebegrensning

- ML

- modell

- modeller

- mer

- trekk

- Multi-Model endepunkt

- flere

- Naturlig

- Natur

- Trenger

- behov

- Ny

- nlp

- varslinger

- objekt

- Objektdeteksjon

- gjenstander

- hav

- tilbud

- pågående

- åpen

- åpne data

- åpen kildekode

- utenfor

- oversikt

- egen

- Parallel

- parametere

- lidenskapelig

- Mønster

- Utfør

- perspektiv

- rørledning

- planet

- plato

- Platon Data Intelligence

- PlatonData

- Post

- praksis

- Precision

- forutsi

- prediksjon

- Spådommer

- Prioriter

- privat

- Problem

- prosess

- Bearbeidet

- prosessering

- Produksjon

- program

- protokollen

- prototyper

- prototyping

- utprøvd

- gi

- gi

- offentlig

- Port

- Puerto Rico

- sette

- Rask

- Raw

- nylig

- nylig

- Anbefaling

- redusere

- registret

- utgitt

- lindring

- påkrevd

- forskere

- resiliens

- de

- svar

- REST

- Resultater

- anmeldelse

- RICO

- Rute

- ruter

- Kjør

- sagemaker

- satellitt

- skalerbar

- skalering

- Scener

- Søk

- årstider

- Seksjon

- seksjoner

- sektor

- sektorer

- senior

- server~~POS=TRUNC

- Servere

- tjeneste

- Tjenester

- sett

- Viser

- Enkelt

- Størrelse

- Røyk

- Snapshot

- løsning

- Kilder

- spesialist

- spesifikk

- pigger

- Standard

- Begynn

- starter

- state-of-the-art

- Stater

- Trinn

- Steps

- lagring

- oppbevare

- lagret

- stormer

- strategier

- slik

- støtte

- system

- Systemer

- Ta

- lag

- lag

- tech

- Teknisk

- Teknologi

- De

- informasjonen

- trusler

- tre

- tid

- tidkrevende

- til

- verktøy

- verktøy

- Tog

- trent

- Kurs

- Traveling

- utløse

- SVING

- typer

- forstå

- unik

- oppdateringer

- oppdatering

- us

- bruke

- bruk sak

- Brukere

- ulike

- av

- video

- Se

- syn

- visualisering

- hvilken

- vil

- uten

- Arbeid

- arbeidet

- virker

- ville

- år

- rentene

- Du

- Din

- youtube

- zephyrnet