Dette er et gjesteblogginnlegg skrevet sammen med Vik Pant og Kyle Bassett fra PwC.

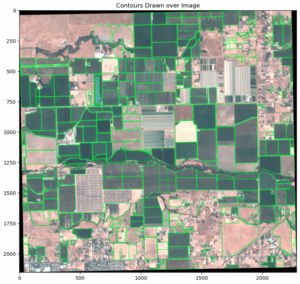

Med organisasjoner som i økende grad investerer i maskinlæring (ML), har ML-adopsjon blitt en integrert del av forretningstransformasjonsstrategier. En fersk PwC-sjef Undersøkelsen avduket at 84% av kanadiske administrerende direktører er enige om at kunstig intelligens (AI) vil endre virksomheten deres betydelig i løpet av de neste 5 årene, noe som gjør denne teknologien mer kritisk enn noen gang. Implementering av ML i produksjon kommer imidlertid med ulike hensyn, spesielt å kunne navigere i verden av AI trygt, strategisk og ansvarlig. Et av de første trinnene, og spesielt en stor utfordring for å bli AI-drevet, er å effektivt utvikle ML-rørledninger som kan skaleres bærekraftig i skyen. Å tenke på ML i form av rørledninger som genererer og vedlikeholder modeller i stedet for modeller alene, bidrar til å bygge allsidige og motstandsdyktige prediksjonssystemer som er bedre i stand til å motstå meningsfulle endringer i relevante data over tid.

Mange organisasjoner starter sin reise inn i ML-verdenen med et modellsentrisk synspunkt. I de tidlige stadiene av å bygge en ML-praksis er fokuset på opplæring av veiledede ML-modeller, som er matematiske representasjoner av sammenhenger mellom input (uavhengige variabler) og utganger (avhengige variabler) som læres fra data (typisk historiske). Modeller er matematiske artefakter som tar inndata, utfører beregninger og beregninger på dem, og genererer spådommer eller slutninger.

Selv om denne tilnærmingen er et rimelig og relativt enkelt utgangspunkt, er den ikke iboende skalerbar eller iboende bærekraftig på grunn av den manuelle og ad hoc-naturen til modelltrening, innstilling, testing og utprøving. Organisasjoner med større modenhet i ML-domenet tar i bruk et ML-operasjonsparadigme (MLOps) som inkluderer kontinuerlig integrasjon, kontinuerlig levering, kontinuerlig distribusjon og kontinuerlig opplæring. Sentralt i dette paradigmet er et pipeline-sentrisk synspunkt for utvikling og drift av industriell styrke ML-systemer.

I dette innlegget starter vi med en oversikt over MLOps og dens fordeler, beskriver en løsning for å forenkle implementeringene, og gir detaljer om arkitekturen. Vi avslutter med en casestudie som fremhever fordelene til en stor AWS- og PwC-kunde som implementerte denne løsningen.

Bakgrunn

En MLOps-pipeline er et sett med sammenhengende sekvenser av trinn som brukes til å bygge, distribuere, drifte og administrere én eller flere ML-modeller i produksjon. En slik pipeline omfatter stadiene som er involvert i bygging, testing, tuning og distribusjon av ML-modeller, inkludert, men ikke begrenset til, dataforberedelse, funksjonsutvikling, modelltrening, evaluering, distribusjon og overvåking. Som sådan er en ML-modell produktet av en MLOps-pipeline, og en pipeline er en arbeidsflyt for å lage en eller flere ML-modeller. Slike rørledninger støtter strukturerte og systematiske prosesser for å bygge, kalibrere, vurdere og implementere ML-modeller, og modellene genererer selv spådommer og slutninger. Ved å automatisere utviklingen og operasjonaliseringen av stadier av rørledninger, kan organisasjoner redusere tiden til levering av modeller, øke stabiliteten til modellene i produksjonen og forbedre samarbeidet mellom team av datavitere, programvareingeniører og IT-administratorer.

Løsningsoversikt

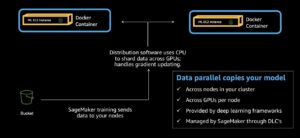

AWS tilbyr en omfattende portefølje av skybaserte tjenester for å utvikle og kjøre MLOps-rørledninger på en skalerbar og bærekraftig måte. Amazon SageMaker omfatter en omfattende portefølje av funksjoner som en fullt administrert MLOps-tjeneste for å gjøre det mulig for utviklere å lage, trene, distribuere, drifte og administrere ML-modeller i skyen. SageMaker dekker hele MLOps-arbeidsflyten, fra innsamling til forberedelse og opplæring av dataene med innebygde høyytelsesalgoritmer og sofistikerte automatiserte ML (AutoML)-eksperimenter slik at bedrifter kan velge spesifikke modeller som passer deres forretningsprioriteringer og preferanser. SageMaker gjør det mulig for organisasjoner å samarbeide om å automatisere mesteparten av MLOps-livssyklusen, slik at de kan fokusere på forretningsresultater uten å risikere prosjektforsinkelser eller eskalerende kostnader. På denne måten lar SageMaker virksomheter fokusere på resultater uten å bekymre seg for infrastruktur, utvikling og vedlikehold knyttet til å drive prediksjonstjenester med industriell styrke.

SageMaker inkluderer Amazon SageMaker JumpStart, som tilbyr ut-av-boksen løsningsmønstre for organisasjoner som ønsker å akselerere sin MLOps-reise. Organisasjoner kan starte med forhåndsopplærte og åpen kildekode-modeller som kan finjusteres for å møte deres spesifikke behov gjennom omskolering og overføringslæring. I tillegg tilbyr JumpStart løsningsmaler designet for å takle vanlige brukstilfeller, samt eksempler på Jupyter-notatbøker med forhåndsskrevet startkode. Disse ressursene kan nås ved ganske enkelt å besøke JumpStart-landingssiden Amazon SageMaker Studio.

PwC har bygget en ferdigpakket MLOps-akselerator som gir ytterligere raskere tid til verdi og øker avkastningen på investeringen for organisasjoner som bruker SageMaker. Denne MLOps-akseleratoren forbedrer de opprinnelige egenskapene til JumpStart ved å integrere komplementære AWS-tjenester. Med en omfattende pakke med tekniske artefakter, inkludert infrastruktur som kode (IaC)-skript, databehandlingsarbeidsflyter, tjenesteintegrasjonskode og pipeline-konfigurasjonsmaler, forenkler PwCs MLOps-akselerator prosessen med å utvikle og drifte prediksjonssystemer i produksjonsklassen.

Arkitekturoversikt

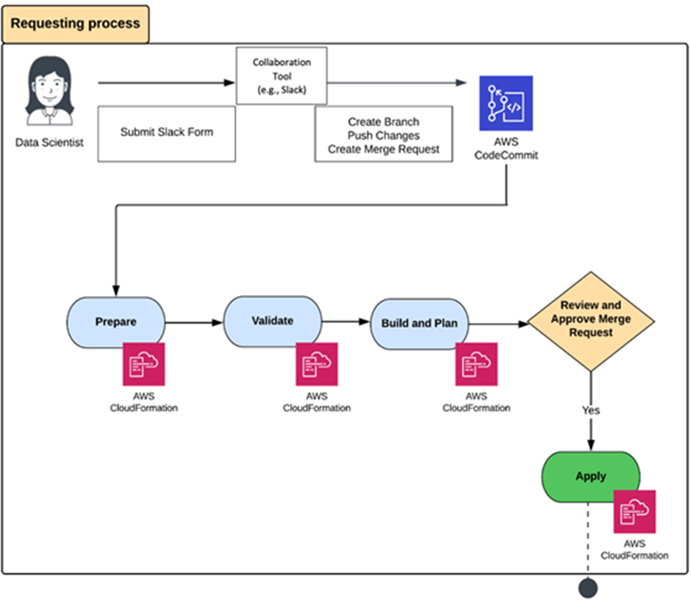

Inkluderingen av skybaserte serverløse tjenester fra AWS er prioritert i arkitekturen til PwC MLOps-akseleratoren. Inngangspunktet til denne akseleratoren er et hvilket som helst samarbeidsverktøy, for eksempel Slack, som en dataforsker eller dataingeniør kan bruke for å be om et AWS-miljø for MLOps. En slik forespørsel analyseres og godkjennes deretter hel- eller halvautomatisk ved bruk av arbeidsflytfunksjoner i det samarbeidsverktøyet. Etter at en forespørsel er godkjent, brukes detaljene for parameterisering av IaC-maler. Kildekoden for disse IaC-malene administreres i AWS CodeCommit. Disse parameteriserte IaC-malene sendes til AWS skyformasjon for modellering, klargjøring og administrasjon av stabler med AWS og tredjepartsressurser.

Følgende diagram illustrerer arbeidsflyten.

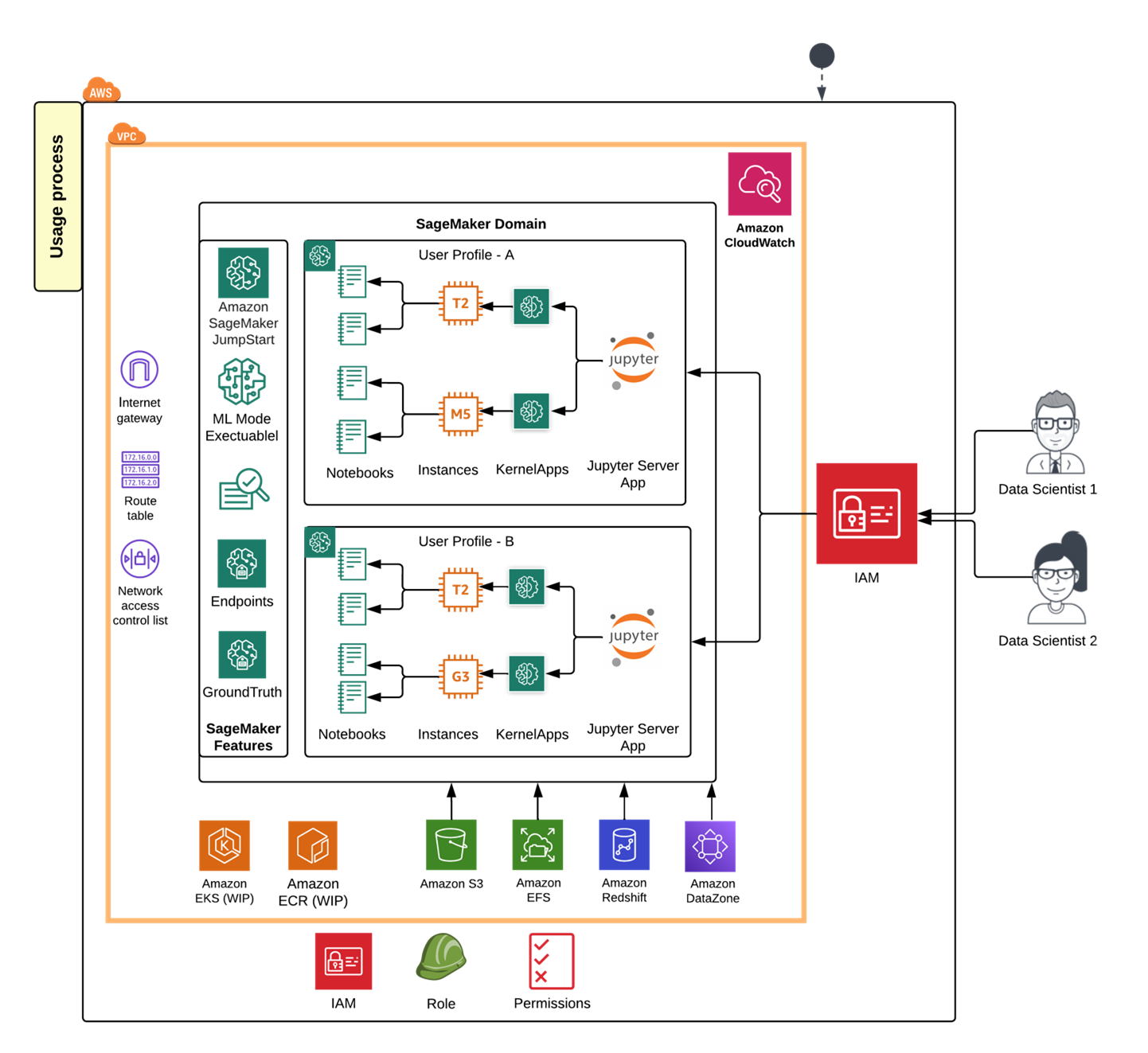

Etter at AWS CloudFormation har levert et miljø for MLOps på AWS, er miljøet klart for bruk av dataforskere, dataingeniører og deres samarbeidspartnere. PWC-akseleratoren inkluderer forhåndsdefinerte roller på AWS identitets- og tilgangsadministrasjon (IAM) som er relatert til MLOps aktiviteter og oppgaver. Disse rollene spesifiserer tjenestene og ressursene i MLOps-miljøet som kan nås av ulike brukere basert på jobbprofilene deres. Etter å ha tilgang til MLOps-miljøet, kan brukere få tilgang til alle modalitetene på SageMaker for å utføre pliktene sine. Disse inkluderer SageMaker notatbokforekomster, Amazon SageMaker Autopilot eksperimenter og Studio. Du kan dra nytte av alle SageMaker-funksjoner, inkludert modellopplæring, innstilling, evaluering, distribusjon og overvåking.

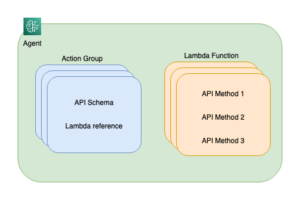

Akseleratoren inkluderer også forbindelser med Amazon DataZone for å dele, søke og oppdage data i stor skala på tvers av organisasjonsgrenser for å generere og berike modeller. Tilsvarende kan data for opplæring, testing, validering og detektering av modelldrift hente en rekke tjenester, inkludert Amazon RedShift, Amazon Relational Database Service (Amazon RDS), Amazon elastisk filsystem (Amazon EFS), og Amazon enkel lagringstjeneste (Amazon S3). Prediksjonssystemer kan distribueres på mange måter, inkludert som SageMaker-endepunkter direkte, SageMaker-endepunkter pakket inn i AWS Lambda funksjoner, og SageMaker-endepunkter som påkalles gjennom tilpasset kode på Amazon Elastic Kubernetes-tjeneste (Amazon EKS) eller Amazon Elastic Compute Cloud (Amazon EC2). Amazon CloudWatch brukes til å overvåke miljøet for MLOps på AWS på en omfattende måte for å observere alarmer, logger og hendelsesdata fra hele stabelen (applikasjoner, infrastruktur, nettverk og tjenester).

Følgende diagram illustrerer denne arkitekturen.

Case study

I denne delen deler vi en illustrerende casestudie fra et stort forsikringsselskap i Canada. Den fokuserer på den transformative effekten av implementeringen av PwC Canadas MLOps-akselerator og JumpStart-maler.

Denne klienten inngikk samarbeid med PwC Canada og AWS for å møte utfordringer med ineffektiv modellutvikling og ineffektive distribusjonsprosesser, mangel på konsistens og samarbeid og vanskeligheter med å skalere ML-modeller. Implementeringen av denne MLOps Accelerator i samråd med JumpStart-maler oppnådde følgende:

- End-to-end automatisering – Automatisering nesten halvert tiden for dataforbehandling, modellopplæring, hyperparameterinnstilling og modelldistribusjon og overvåking

- Samarbeid og standardisering – Standardiserte verktøy og rammeverk for å fremme konsistens på tvers av organisasjonen doblet nesten frekvensen av modellinnovasjon

- Modellstyring og etterlevelse – De implementerte et rammeverk for modellstyring for å sikre at alle ML-modeller oppfylte regulatoriske krav og fulgte selskapets etiske retningslinjer, som reduserte risikostyringskostnadene med 40 %

- Skalerbar skyinfrastruktur – De investerte i skalerbar infrastruktur for å effektivt administrere enorme datavolumer og distribuere flere ML-modeller samtidig, noe som reduserte infrastruktur- og plattformkostnadene med 50 %

- Rask utplassering – Den ferdigpakkede løsningen reduserte tiden til produksjon med 70 %

Ved å levere MLOps beste praksis gjennom raske distribusjonspakker, var kunden vår i stand til å redusere risikoen for MLOps-implementeringen og låse opp det fulle potensialet til ML for en rekke forretningsfunksjoner, som risikoprediksjon og aktivaprising. Samlet sett gjorde synergien mellom PwC MLOps-akseleratoren og JumpStart kunden vår i stand til å strømlinjeforme, skalere, sikre og opprettholde sine datavitenskapelige og datatekniske aktiviteter.

Det skal bemerkes at PwC- og AWS-løsningen ikke er bransjespesifikk og er relevant på tvers av bransjer og sektorer.

konklusjonen

SageMaker og dets akseleratorer lar organisasjoner øke produktiviteten til ML-programmet deres. Det er mange fordeler, inkludert men ikke begrenset til følgende:

- Lag IaC-, MLOps- og AutoML-brukstilfeller i samarbeid for å realisere forretningsfordeler fra standardisering

- Aktiver effektiv eksperimentell prototyping, med og uten kode, for å turbolade AI fra utvikling til distribusjon med IaC, MLOps og AutoML

- Automatiser kjedelige, tidkrevende oppgaver som funksjonsutvikling og hyperparameterinnstilling med AutoML

- Bruk et kontinuerlig modellovervåkingsparadigme for å tilpasse risikoen for bruk av ML-modeller med bedriftens risikoappetitt

Ta kontakt med forfatterne av dette innlegget, AWS Advisory Canadaeller PwC Canada for å lære mer om Jumpstart og PwCs MLOps-akselerator.

Om forfatterne

vik er partner i Cloud & Data-praksisen hos PwC Canada. Han tok en doktorgrad i informasjonsvitenskap fra University of Toronto. Han er overbevist om at det er en telepatisk forbindelse mellom hans biologiske nevrale nettverk og de kunstige nevrale nettverkene som han trener på SageMaker. Ta kontakt med ham videre Linkedin.

vik er partner i Cloud & Data-praksisen hos PwC Canada. Han tok en doktorgrad i informasjonsvitenskap fra University of Toronto. Han er overbevist om at det er en telepatisk forbindelse mellom hans biologiske nevrale nettverk og de kunstige nevrale nettverkene som han trener på SageMaker. Ta kontakt med ham videre Linkedin.

Kyle er partner i Cloud & Data-praksisen hos PwC Canada, sammen med hans crack-team av tekniske alkymister, vever de fortryllende MLOPs-løsninger som trollbinder kunder med akselerert forretningsverdi. Bevæpnet med kraften til kunstig intelligens og et dryss av trolldom, gjør Kyle komplekse utfordringer til digitale eventyr, og gjør det umulige mulig. Ta kontakt med ham videre Linkedin.

Kyle er partner i Cloud & Data-praksisen hos PwC Canada, sammen med hans crack-team av tekniske alkymister, vever de fortryllende MLOPs-løsninger som trollbinder kunder med akselerert forretningsverdi. Bevæpnet med kraften til kunstig intelligens og et dryss av trolldom, gjør Kyle komplekse utfordringer til digitale eventyr, og gjør det umulige mulig. Ta kontakt med ham videre Linkedin.

Francois er en hovedrådgivende konsulent hos AWS Professional Services Canada og den kanadiske praksislederen for Data and Innovation Advisory. Han veileder kunder til å etablere og implementere deres overordnede skyreise og deres dataprogrammer, med fokus på visjon, strategi, forretningsdrivere, styring, måldriftsmodeller og veikart. Ta kontakt med ham videre Linkedin.

Francois er en hovedrådgivende konsulent hos AWS Professional Services Canada og den kanadiske praksislederen for Data and Innovation Advisory. Han veileder kunder til å etablere og implementere deres overordnede skyreise og deres dataprogrammer, med fokus på visjon, strategi, forretningsdrivere, styring, måldriftsmodeller og veikart. Ta kontakt med ham videre Linkedin.

- SEO-drevet innhold og PR-distribusjon. Bli forsterket i dag.

- PlatoAiStream. Web3 Data Intelligence. Kunnskap forsterket. Tilgang her.

- Minting the Future med Adryenn Ashley. Tilgang her.

- Kjøp og selg aksjer i PRE-IPO-selskaper med PREIPO®. Tilgang her.

- kilde: https://aws.amazon.com/blogs/machine-learning/accelerate-machine-learning-time-to-value-with-amazon-sagemaker-jumpstart-and-pwcs-mlops-accelerator/

- : har

- :er

- :ikke

- $OPP

- 100

- 7

- a

- I stand

- Om oss

- akselerere

- akselerert

- akselerator

- akseleratorer

- adgang

- aksesseres

- Tilgang

- oppnådd

- tvers

- Aktiviteter

- Ad

- I tillegg

- adresse

- administratorer

- adoptere

- Adopsjon

- rådgivende

- Etter

- AI

- algoritmer

- justere

- Alle

- tillate

- tillater

- langs

- også

- Amazon

- Amazon EC2

- Amazon RDS

- Amazon SageMaker

- Amazon SageMaker JumpStart

- Amazon Web Services

- beløp

- an

- og

- noen

- søknader

- tilnærming

- godkjent

- arkitektur

- ER

- væpnet

- kunstig

- kunstig intelligens

- Kunstig intelligens (AI)

- AS

- vurdere

- eiendel

- assosiert

- At

- forfattere

- automatisere

- Automatisert

- Automatisere

- Automatisering

- AutoML

- AWS

- AWS skyformasjon

- AWS profesjonelle tjenester

- basert

- BE

- bli

- bli

- være

- nytte

- Fordeler

- BEST

- beste praksis

- Bedre

- mellom

- Blogg

- grenser

- bygge

- Bygning

- bygget

- innebygd

- virksomhet

- forretningsfunksjoner

- Forretningstransformasjon

- bedrifter

- men

- by

- beregninger

- CAN

- Canada

- Canadian

- evner

- saken

- case study

- saker

- sentral

- konsernsjef

- CEOs

- utfordre

- utfordringer

- endring

- Endringer

- Velg

- kunde

- klienter

- Cloud

- sky infrastruktur

- kode

- samarbeid

- Samle

- COM

- kommer

- Felles

- Selskaper

- Selskapet

- Selskapets

- utfyllende

- fullføre

- komplekse

- omfattende

- består

- beregninger

- Beregn

- konsert

- Konfigurasjon

- Koble

- tilkobling

- Tilkoblinger

- betraktninger

- konsulent

- kontakt

- kontinuerlig

- Kostnader

- Dekker

- crack

- skape

- Opprette

- kritisk

- skikk

- kunde

- Kunder

- dato

- Dataklargjøring

- databehandling

- datavitenskap

- dataforsker

- Database

- forsinkelser

- levere

- levering

- avhengig

- utplassere

- utplassert

- utplasserings

- distribusjon

- beskrive

- designet

- detaljer

- utviklere

- utvikle

- Utvikling

- Vanskelighetsgrad

- digitalt

- direkte

- oppdage

- domene

- doblet

- drivere

- to

- Tidlig

- opptjent

- effektivt

- effektiv

- muliggjøre

- aktivert

- muliggjør

- Omfatter

- ingeniør

- Ingeniørarbeid

- Ingeniører

- forbedre

- Forbedrer

- berike

- sikre

- Enterprise

- Hele

- entry

- Miljø

- etablere

- etisk

- evaluering

- hendelser

- NOEN GANG

- eksempel

- eksperimenter

- Trekk

- Egenskaper

- filet

- ferdig

- Først

- første steg

- passer

- Fokus

- fokuserer

- fokusering

- etter

- Til

- Rammeverk

- rammer

- fra

- fullt

- fullt

- funksjoner

- videre

- generere

- styresett

- flott

- større

- Gjest

- retningslinjer

- Guider

- halvert

- he

- hjelper

- høy ytelse

- utheving

- ham

- hans

- historisk

- Men

- HTML

- http

- HTTPS

- Innstilling av hyperparameter

- Identitet

- illustrerer

- Påvirkning

- iverksette

- gjennomføring

- implementert

- implementere

- umulig

- forbedre

- in

- inkludere

- inkluderer

- Inkludert

- inkludering

- Øke

- øker

- stadig

- uavhengig

- bransjer

- industri

- ineffektiv

- info

- informasjon

- Infrastruktur

- Innovasjon

- inngang

- innganger

- forsikring

- integrert

- Integrering

- integrering

- Intelligens

- inn

- egen~~POS=TRUNC

- investert

- investere

- investering

- påkalt

- involvert

- IT

- DET ER

- Jobb

- reise

- jpg

- maling

- landing

- stor

- føre

- LÆRE

- lært

- læring

- Livssyklus

- Begrenset

- maskin

- maskinlæring

- vedlikeholde

- vedlikehold

- Flertall

- Making

- administrer

- fikk til

- ledelse

- administrerende

- måte

- håndbok

- mange

- massive

- matematiske

- modenhet

- meningsfylt

- Møt

- ML

- MLOps

- modell

- modeller

- Overvåke

- overvåking

- mer

- flere

- innfødt

- Natur

- Naviger

- nesten

- behov

- nettverk

- nettverk

- nevrale nettverket

- nevrale nettverk

- neste

- spesielt

- bærbare

- bemerket

- observere

- of

- Tilbud

- on

- ONE

- åpen kildekode

- betjene

- drift

- Drift

- or

- organisasjon

- organisasjons

- organisasjoner

- vår

- enn

- samlet

- oversikt

- pakker

- side

- paradigmet

- del

- partner

- samarbeid

- mønstre

- Utfør

- rørledning

- plattform

- plato

- Platon Data Intelligence

- PlatonData

- Point

- portefølje

- mulig

- Post

- potensiell

- makt

- powered

- Slå

- praksis

- praksis

- prediksjon

- Spådommer

- preferanser

- forbereder

- prising

- Principal

- prioritert

- prosess

- Prosesser

- prosessering

- Produkt

- Produksjon

- produktivitet

- profesjonell

- Profiler

- program

- programmer

- prosjekt

- fremme

- prototyping

- gi

- gir

- PWC

- område

- rask

- Sats

- heller

- klar

- realisere

- rimelig

- nylig

- redusere

- Redusert

- redusere

- regulatorer

- i slekt

- Relasjoner

- relativt

- relevant

- anmode

- Krav

- spenstig

- Ressurser

- Resultater

- retur

- Risiko

- risikostyring

- risikere

- veikart

- roller

- rennende

- trygt

- sagemaker

- skalerbar

- Skala

- skalering

- Vitenskap

- Forsker

- forskere

- skript

- søker

- Seksjon

- sektorer

- sikre

- søker

- server~~POS=TRUNC

- tjeneste

- Tjenester

- sett

- Del

- deling

- bør

- betydelig

- på samme måte

- Enkelt

- forenkle

- ganske enkelt

- samtidig

- slakk

- So

- Software

- løsning

- Solutions

- sofistikert

- kilde

- kildekoden

- spesifikk

- hastigheter

- Stabilitet

- stable

- Stabler

- stadier

- Begynn

- Start

- Steps

- lagring

- strategisk

- strategier

- Strategi

- effektivisere

- strukturert

- studio

- Studer

- innsendt

- slik

- suite

- støtte

- bærekraftig

- synergi

- Systemer

- takle

- Ta

- Target

- oppgaver

- lag

- lag

- tech

- Teknisk

- Teknologi

- maler

- vilkår

- Testing

- enn

- Det

- De

- Kilden

- verden

- deres

- Dem

- seg

- deretter

- Der.

- Disse

- de

- tenker

- tredjeparts

- denne

- Gjennom

- tid

- tidkrevende

- til

- verktøy

- verktøy

- toronto

- Tog

- Kurs

- Togene

- overføre

- Transformation

- transformative

- snur

- typisk

- universitet

- låse opp

- avduket

- bruk

- bruke

- brukt

- Brukere

- ved hjelp av

- verdi

- variasjon

- ulike

- allsidig

- syn

- volumer

- var

- Vei..

- måter

- we

- Weave

- web

- webtjenester

- VI VIL

- hvilken

- HVEM

- vil

- med

- innenfor

- uten

- arbeidsflyt

- verden

- Innpakket

- år

- Du

- zephyrnet