Vi er vitne til en rask økning i bruken av store språkmodeller (LLM) som driver genererende AI-applikasjoner på tvers av bransjer. LLM-er er i stand til en rekke oppgaver, som å generere kreativt innhold, svare på forespørsler via chatbots, generere kode og mer.

Organisasjoner som ønsker å bruke LLM-er for å drive applikasjonene sine, er stadig mer forsiktige med personvern for å sikre at tillit og sikkerhet opprettholdes i deres generative AI-applikasjoner. Dette inkluderer å håndtere kundenes personlig identifiserbare informasjon (PII) data på riktig måte. Det inkluderer også å forhindre at støtende og usikkert innhold spres til LLM-er og sjekke at data generert av LLM-er følger de samme prinsippene.

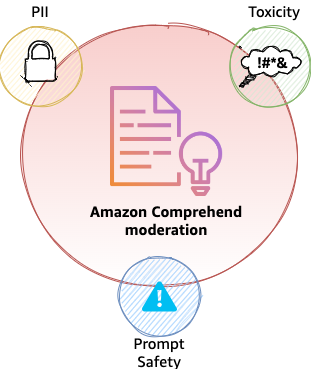

I dette innlegget diskuterer vi nye funksjoner drevet av Amazon Comprehend som muliggjør sømløs integrasjon for å sikre datapersonvern, innholdssikkerhet og rask sikkerhet i nye og eksisterende generative AI-applikasjoner.

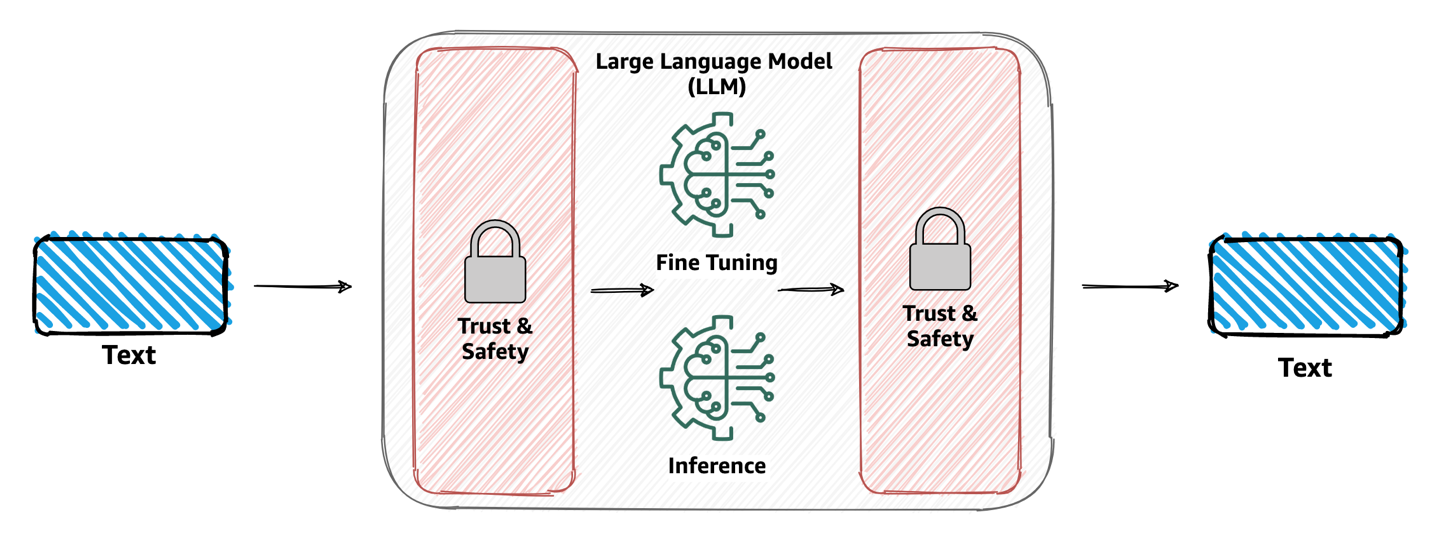

Amazon Comprehend er en naturlig språkbehandlingstjeneste (NLP) som bruker maskinlæring (ML) for å avdekke informasjon i ustrukturerte data og tekst i dokumenter. I dette innlegget diskuterer vi hvorfor tillit og sikkerhet med LLM-er betyr noe for arbeidsbelastningen din. Vi går også dypere inn i hvordan disse nye modereringsmulighetene brukes med det populære generative AI-utviklingsrammeverket Langkjede å introdusere en tilpassbar tillits- og sikkerhetsmekanisme for brukssaken din.

Hvorfor tillit og sikkerhet med LLM er viktig

Tillit og sikkerhet er avgjørende når du arbeider med LLM-er på grunn av deres dype innvirkning på et bredt spekter av applikasjoner, fra kundestøtte chatbots til innholdsgenerering. Ettersom disse modellene behandler enorme mengder data og genererer menneskelignende svar, øker potensialet for misbruk eller utilsiktede utfall. Å sikre at disse AI-systemene opererer innenfor etiske og pålitelige grenser er avgjørende, ikke bare for omdømmet til virksomheter som bruker dem, men også for å bevare tilliten til sluttbrukere og kunder.

Etter hvert som LLM-er blir mer integrert i våre daglige digitale opplevelser, øker deres innflytelse på våre oppfatninger, tro og beslutninger. Å sikre tillit og sikkerhet med LLM-er går utover bare tekniske tiltak; den taler til det bredere ansvaret til AI-utøvere og organisasjoner for å opprettholde etiske standarder. Ved å prioritere tillit og sikkerhet beskytter organisasjoner ikke bare brukerne sine, men sikrer også bærekraftig og ansvarlig vekst av AI i samfunnet. Det kan også bidra til å redusere risikoen for å generere skadelig innhold, og bidra til å overholde regulatoriske krav.

Innenfor tillit og sikkerhet er innholdsmoderering en mekanisme som tar for seg ulike aspekter, inkludert men ikke begrenset til:

- Privatliv – Brukere kan utilsiktet oppgi tekst som inneholder sensitiv informasjon, og dermed sette personvernet deres i fare. Det er viktig å oppdage og redigere PII.

- Toksisitet – Å gjenkjenne og filtrere ut skadelig innhold, som hatytringer, trusler eller overgrep, er av største betydning.

- Brukerens intensjon – Det er avgjørende å identifisere om brukerinndata (spørsmål) er trygt eller usikkert. Usikre forespørsler kan eksplisitt eller implisitt uttrykke ondsinnet hensikt, for eksempel å be om personlig eller privat informasjon og generere støtende, diskriminerende eller ulovlig innhold. Forespørsler kan også implisitt uttrykke eller be om råd om medisinsk, juridisk, politisk, kontroversiell, personlig eller økonomisk

Innholdsmoderering med Amazon Comprehend

I denne delen diskuterer vi fordelene med innholdsmoderering med Amazon Comprehend.

Ta opp personvernet

Amazon Comprehend adresserer allerede personvern gjennom sine eksisterende PII-deteksjons- og redaksjonsevner via DetectPIIEntities og Inneholder PIIEtiteter APIer. Disse to APIene støttes av NLP-modeller som kan oppdage et stort antall PII-enheter som personnummer (SSN), kredittkortnumre, navn, adresser, telefonnumre og så videre. For en fullstendig liste over enheter, se PII universelle enhetstyper. DetectPII gir også tegnnivåposisjonen til PII-enheten i en tekst; for eksempel starttegnposisjonen til NAME-enheten (John Doe) i setningen "Mitt navn er Joh gjøre” er 12, og slutttegnposisjonen er 19. Disse forskyvningene kan brukes til å utføre maskering eller redaksjon av verdiene, og dermed redusere risikoen for spredning av private data til LLM-er.

Adressering av toksisitet og rask sikkerhet

I dag kunngjør vi to nye Amazon Comprehend-funksjoner i form av APIer: Giftighetsdeteksjon via DetectToxicContent API, og rask sikkerhetsklassifisering via ClassifyDocument API. Legg merke til at DetectToxicContent er et nytt API, mens ClassifyDocument er en eksisterende API som nå støtter rask sikkerhetsklassifisering.

Påvisning av toksisitet

Med Amazon Comprehend-toksisitetsdeteksjon kan du identifisere og flagge innhold som kan være skadelig, støtende eller upassende. Denne muligheten er spesielt verdifull for plattformer der brukere genererer innhold, for eksempel sosiale medier, fora, chatbots, kommentarseksjoner og applikasjoner som bruker LLM-er til å generere innhold. Hovedmålet er å opprettholde et positivt og trygt miljø ved å hindre spredning av giftig innhold.

I sin kjerne analyserer toksisitetsdeteksjonsmodellen tekst for å fastslå sannsynligheten for at den inneholder hatefullt innhold, trusler, uanstendigheter eller andre former for skadelig tekst. Modellen er trent på enorme datasett som inneholder eksempler på både giftig og ikke-giftig innhold. Toksisitets-APIet evaluerer et gitt tekststykke for å gi toksisitetsklassifisering og konfidenspoengsum. Generative AI-applikasjoner kan deretter bruke denne informasjonen til å iverksette passende handlinger, for eksempel å stoppe teksten fra å forplante seg til LLM-er. Når dette skrives, er etikettene oppdaget av toksisitetsdeteksjons-API HATE_SPEECH, GRAPHIC, HARRASMENT_OR_ABUSE, SEXUAL, VIOLENCE_OR_THREAT, INSULTog PROFANITY. Følgende kode demonstrerer API-kallet med Python Boto3 for Amazon Comprehend-toksisitetsdeteksjon:

Rask sikkerhetsklassifisering

Rask sikkerhetsklassifisering med Amazon Comprehend hjelper med å klassifisere en tekstmelding som trygg eller usikker. Denne evnen er avgjørende for applikasjoner som chatboter, virtuelle assistenter eller innholdsmodereringsverktøy der forståelse av sikkerheten til en forespørsel kan avgjøre svar, handlinger eller innholdsspredning til LLM-er.

I hovedsak analyserer umiddelbar sikkerhetsklassifisering menneskelige innspill for eksplisitt eller implisitt ondsinnet hensikt, for eksempel å be om personlig eller privat informasjon og generering av støtende, diskriminerende eller ulovlig innhold. Den flagger også spørsmål som leter etter råd om medisinske, juridiske, politiske, kontroversielle, personlige eller økonomiske emner. Spørreklassifisering returnerer to klasser, UNSAFE_PROMPT og SAFE_PROMPT, for en tilknyttet tekst, med en tilhørende konfidenspoengsum for hver. Konfidenspoengsummen varierer mellom 0–1 og kombinert vil summere opp til 1. For eksempel, i en kundestøtte chatbot, teksten "Hvordan tilbakestiller jeg passordet mitt?” signaliserer en intensjon om å søke veiledning om prosedyrer for tilbakestilling av passord og er merket som SAFE_PROMPT. På samme måte, en uttalelse som "Jeg skulle ønske noe vondt skjer med deg” kan merkes for å ha en potensielt skadelig hensikt og merkes som UNSAFE_PROMPT. Det er viktig å merke seg at umiddelbar sikkerhetsklassifisering først og fremst er fokusert på å oppdage hensikt fra menneskelige input (forespørsler), snarere enn maskingenerert tekst (LLM-utganger). Følgende kode viser hvordan du får tilgang til funksjonen for rask sikkerhetsklassifisering med ClassifyDocument API:

Legg merke til at endpoint_arn i den foregående koden er en AWS-levert Amazon ressursnummer (ARN) av mønsteret arn:aws:comprehend:<region>:aws:document-classifier-endpoint/prompt-safety, Hvor <region> er AWS-regionen du velger hvor Amazon Comprehend er tilgjengelig.

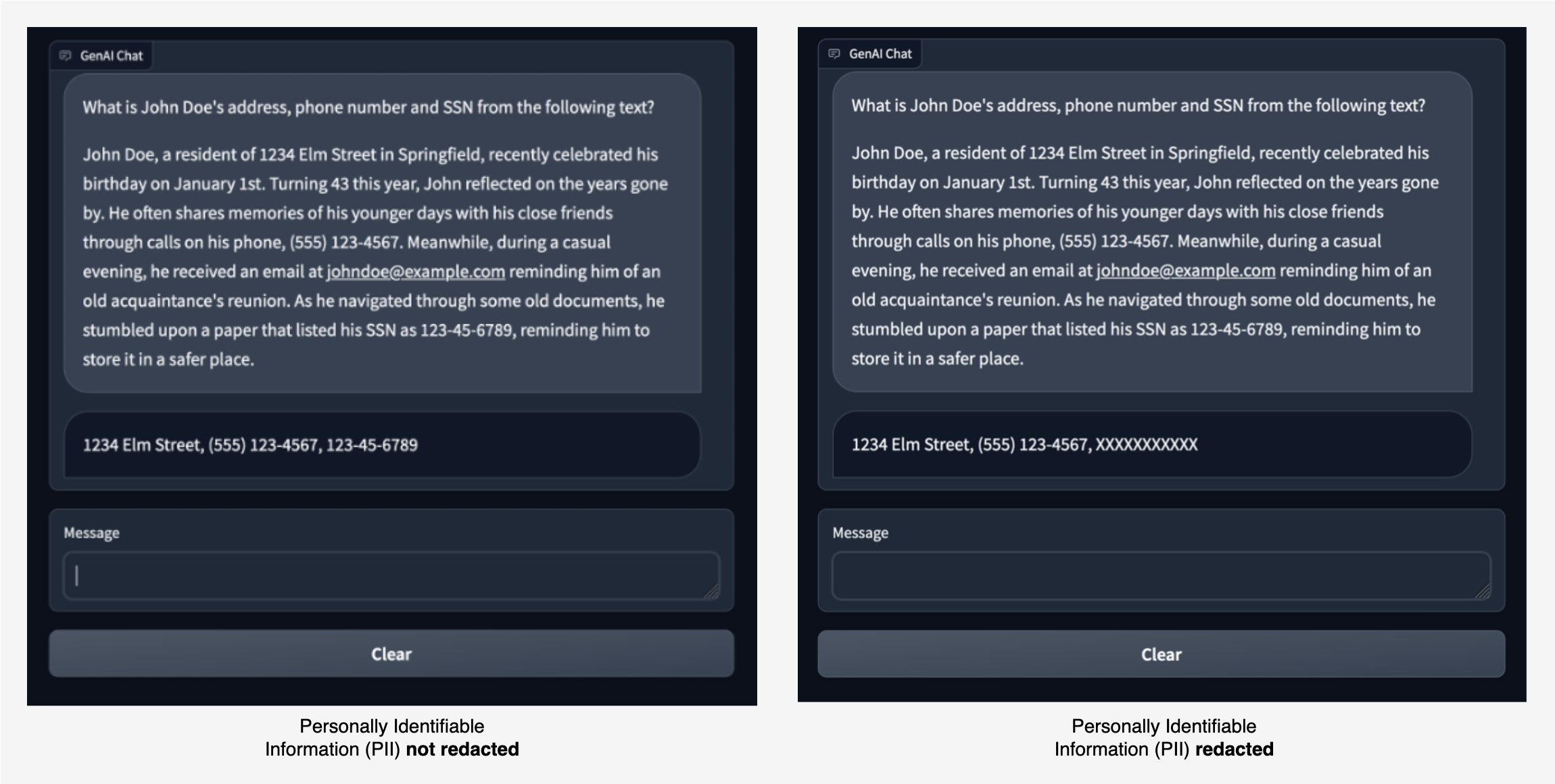

For å demonstrere disse egenskapene bygde vi en prøvepratapplikasjon der vi ber en LLM trekke ut PII-enheter som adresse, telefonnummer og SSN fra et gitt tekststykke. LLM finner og returnerer de riktige PII-enhetene, som vist på bildet til venstre.

Med Amazon Comprehend-moderering kan vi redigere inndataene til LLM og utdata fra LLM. I bildet til høyre kan SSN-verdien sendes til LLM uten redigering. Enhver SSN-verdi i LLMs svar blir imidlertid redigert.

Følgende er et eksempel på hvordan en melding som inneholder PII-informasjon kan forhindres i å nå LLM helt. Dette eksemplet viser en bruker som stiller et spørsmål som inneholder PII-informasjon. Vi bruker Amazon Comprehend-moderering for å oppdage PII-enheter i ledeteksten og vise en feil ved å avbryte flyten.

De foregående chat-eksemplene viser hvordan Amazon Comprehend-moderering bruker begrensninger på data som sendes til en LLM. I de følgende avsnittene forklarer vi hvordan denne modereringsmekanismen implementeres ved hjelp av LangChain.

Integrasjon med LangChain

Med de uendelige mulighetene for bruk av LLM-er i ulike brukssaker, har det blitt like viktig å forenkle utviklingen av generative AI-applikasjoner. Langkjede er et populært rammeverk med åpen kildekode som gjør det enkelt å utvikle generative AI-applikasjoner. Amazon Comprehend-moderering utvider LangChain-rammeverket til å tilby PII-identifikasjon og redaksjon, toksisitetsdeteksjon og rask sikkerhetsklassifisering via AmazonComprehendModerationChain.

AmazonComprehendModerationChain er en tilpasset implementering av LangChain basekjede grensesnitt. Dette betyr at applikasjoner kan bruke denne kjeden med sine egne LLM kjeder for å bruke ønsket moderering på inndataledeteksten så vel som på utdatateksten fra LLM. Kjeder kan bygges ved å slå sammen flere kjeder eller ved å blande kjeder med andre komponenter. Du kan bruke AmazonComprehendModerationChain med andre LLM-kjeder for å utvikle komplekse AI-applikasjoner på en modulær og fleksibel måte.

For å forklare det ytterligere, gir vi noen eksempler i de følgende avsnittene. Kildekoden for AmazonComprehendModerationChain implementering kan finnes innenfor LangChain åpen kildekode-depot. For fullstendig dokumentasjon av API-grensesnittet, se LangChain API-dokumentasjonen for Amazon Comprehend-moderasjonskjede. Å bruke denne modereringskjeden er like enkelt som å initialisere en forekomst av klassen med standardkonfigurasjoner:

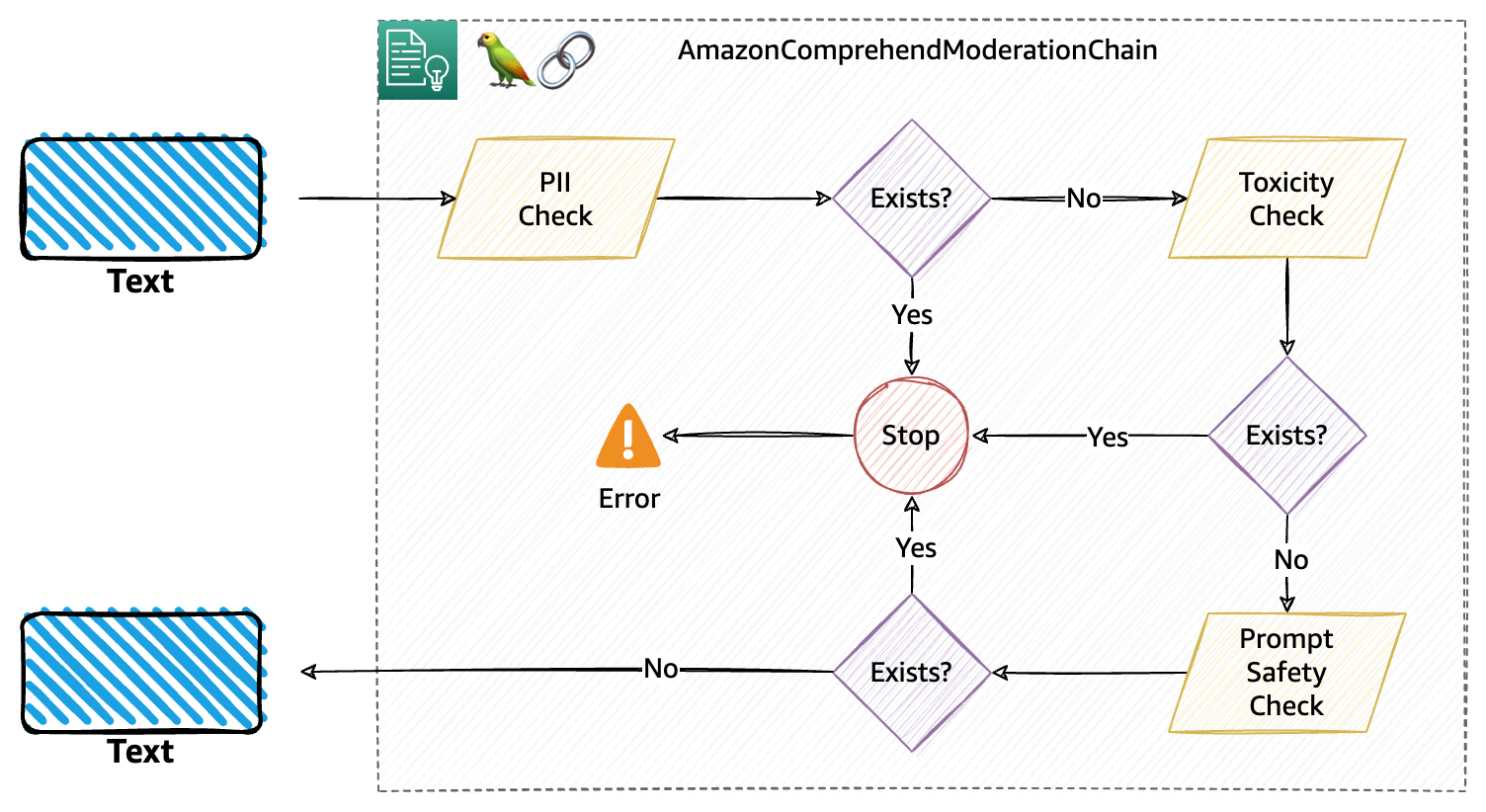

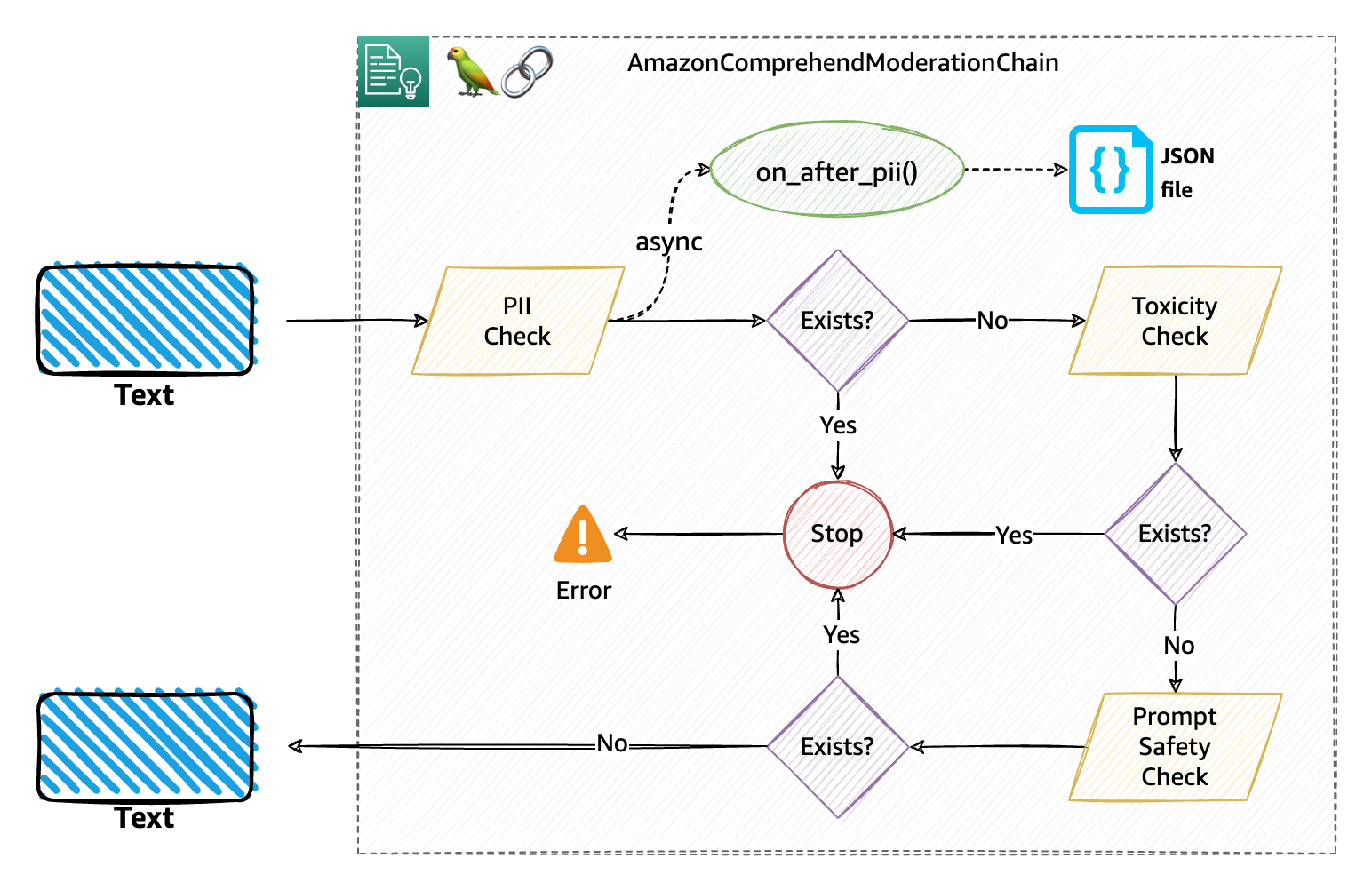

Bak kulissene utfører moderasjonskjeden tre påfølgende moderasjonskontroller, nemlig PII, toksisitet og umiddelbar sikkerhet, som forklart i følgende diagram. Dette er standardflyten for modereringen.

Følgende kodebit viser et enkelt eksempel på bruk av modereringskjeden med Amazon FalconLite LLM (som er en kvantisert versjon av Falcon 40B SFT OASST-TOP1 modell) arrangert i Hugging Face Hub:

I det foregående eksempelet utvider vi kjeden vår med comprehend_moderation for både tekst som går inn i LLM og tekst generert av LLM. Dette vil utføre standard moderering som vil sjekke PII, toksisitet og rask sikkerhetsklassifisering i den sekvensen.

Tilpass modereringen din med filterkonfigurasjoner

Du kan også bruke det AmazonComprehendModerationChain med spesifikke konfigurasjoner, som gir deg muligheten til å kontrollere hvilke moderasjoner du ønsker å utføre i din generative AI-baserte applikasjon. I kjernen av konfigurasjonen har du tre tilgjengelige filterkonfigurasjoner.

- ModerasjonPiiConfig – Brukes til å konfigurere PII-filter.

- Moderering toksisitet Konfig – Brukes til å konfigurere filter for giftig innhold.

- ModerasjonIntentConfig – Brukes til å konfigurere intentfilter.

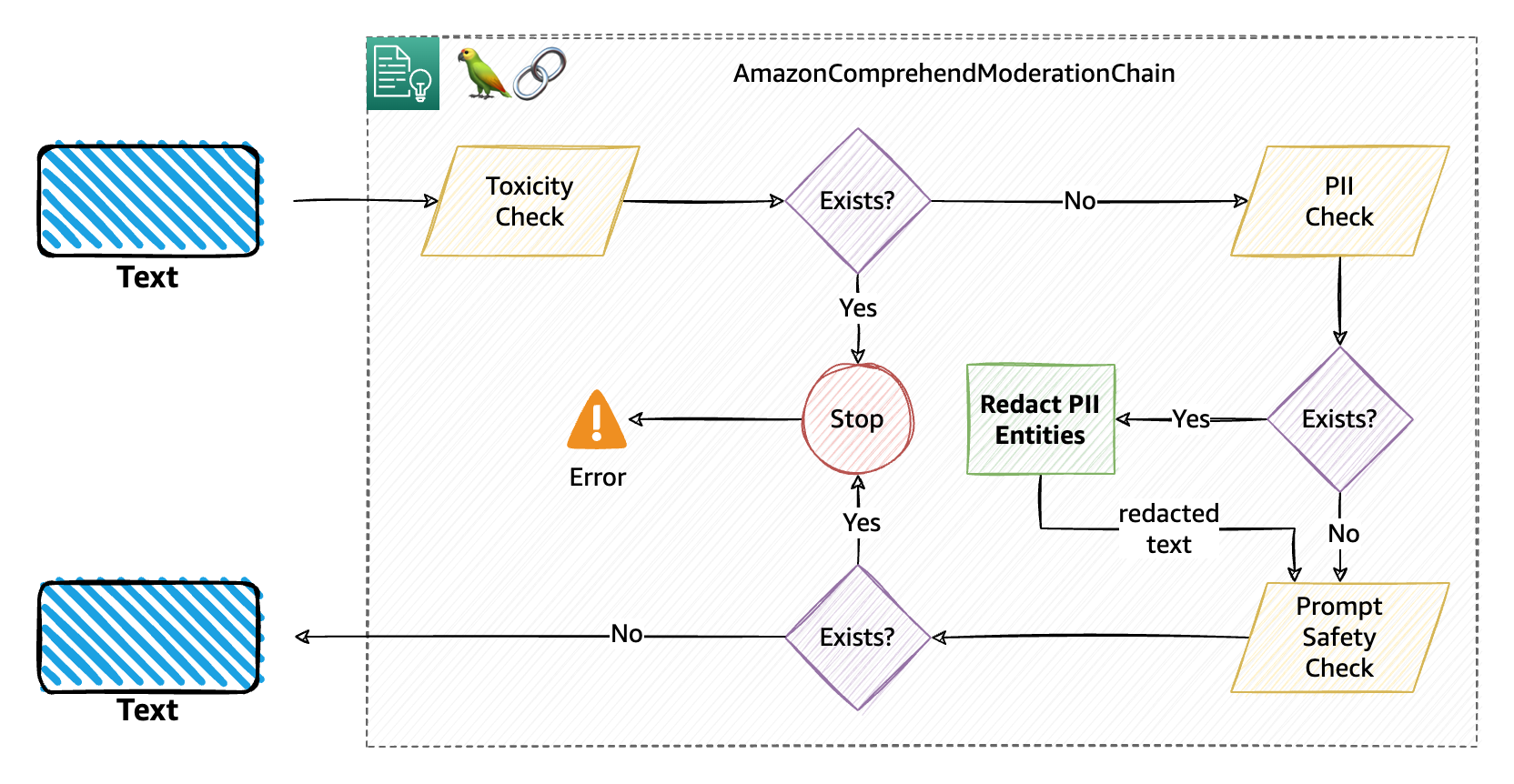

Du kan bruke hver av disse filterkonfigurasjonene til å tilpasse oppførselen til hvordan moderasjonene dine oppfører seg. Hvert filters konfigurasjoner har noen få vanlige parametere, og noen unike parametere, som de kan initialiseres med. Etter at du har definert konfigurasjonene, bruker du BaseModerationConfig klasse for å definere rekkefølgen der filtrene skal gjelde for teksten. For eksempel, i følgende kode definerer vi først de tre filterkonfigurasjonene, og spesifiserer deretter rekkefølgen de må gjelde i:

La oss dykke litt dypere for å forstå hva denne konfigurasjonen oppnår:

- Først, for toksisitetsfilteret, spesifiserte vi en terskel på 0.6. Dette betyr at hvis teksten inneholder noen av de tilgjengelige giftige etikettene eller enhetene med en poengsum som er høyere enn terskelen, vil hele kjeden bli avbrutt.

- Hvis det ikke finnes noe giftig innhold i teksten, er en PII-sjekk. I dette tilfellet er vi interessert i å sjekke om teksten inneholder SSN-verdier. Fordi det

redactparameter er satt tilTrue, vil kjeden maskere de oppdagede SSN-verdiene (hvis noen) der SSN-enhetens konfidenspoengsum er større enn eller lik 0.5, med masketegnet spesifisert (X). Hvisredacter satt tilFalse, vil kjeden bli avbrutt for eventuelle SSN oppdaget. - Til slutt utfører kjeden rask sikkerhetsklassifisering, og vil stoppe innholdet fra å forplante seg lenger ned i kjeden dersom innholdet er klassifisert med

UNSAFE_PROMPTmed en konfidensscore større enn eller lik 0.8.

Følgende diagram illustrerer denne arbeidsflyten.

I tilfelle avbrudd i moderasjonskjeden (i dette eksemplet gjelder filtrene for toksisitet og rask sikkerhetsklassifisering), vil kjeden øke en Python unntak, i hovedsak stopper den pågående kjeden og lar deg fange unntaket (i en prøvefangst-blokk) og utføre enhver relevant handling. De tre mulige unntakstypene er:

ModerationPIIErrorModerationToxicityErrorModerationPromptSafetyError

Du kan konfigurere ett filter eller mer enn ett filter ved å bruke BaseModerationConfig. Du kan også ha samme type filter med forskjellige konfigurasjoner innenfor samme kjede. For eksempel, hvis brukstilfellet ditt bare er opptatt av PII, kan du spesifisere en konfigurasjon som må avbryte kjeden hvis i tilfelle en SSN oppdages; ellers må den utføre redaksjon på alder og navn PII-enheter. En konfigurasjon for dette kan defineres som følger:

Bruk av tilbakeringinger og unike identifikatorer

Hvis du er kjent med konseptet med arbeidsflyter, er du kanskje også kjent med tilbakeringinger. Tilbakeringinger i arbeidsflyter er uavhengige kodebiter som kjøres når visse betingelser er oppfylt i arbeidsflyten. En tilbakeringing kan enten være blokkerende eller ikke-blokkerende for arbeidsflyten. LangChain-kjeder er i hovedsak arbeidsflyter for LLM-er. AmazonComprehendModerationChain lar deg definere dine egne tilbakeringingsfunksjoner. I utgangspunktet er implementeringen begrenset til kun asynkrone (ikke-blokkerende) tilbakeringingsfunksjoner.

Dette betyr i praksis at hvis du bruker tilbakeringinger med modereringskjeden, vil de kjøre uavhengig av kjedens kjøring uten å blokkere den. For modereringskjeden får du muligheter for å kjøre kodebiter, med hvilken som helst forretningslogikk, etter at hver moderering er kjørt, uavhengig av kjeden.

Du kan også valgfritt angi en vilkårlig unik identifikatorstreng når du oppretter en AmazonComprehendModerationChain for å aktivere logging og analyser senere. For eksempel, hvis du driver en chatbot drevet av en LLM, kan det være lurt å spore brukere som konsekvent misbruker eller bevisst eller ubevisst avslører personlig informasjon. I slike tilfeller blir det nødvendig å spore opprinnelsen til slike meldinger og kanskje lagre dem i en database eller logge dem på riktig måte for videre handling. Du kan sende en unik ID som tydelig identifiserer en bruker, for eksempel brukernavnet eller e-postadressen, eller et programnavn som genererer forespørselen.

Kombinasjonen av tilbakeringinger og unike identifikatorer gir deg en kraftig måte å implementere en modereringskjede som passer din brukssituasjon på en mye mer sammenhengende måte med mindre kode som er enklere å vedlikeholde. Tilbakeringingsbehandleren er tilgjengelig via BaseModerationCallbackHandler, med tre tilgjengelige tilbakeringinger: on_after_pii(), on_after_toxicity()og on_after_prompt_safety(). Hver av disse tilbakeringingsfunksjonene kalles asynkront etter at den respektive moderasjonskontrollen er utført i kjeden. Disse funksjonene mottar også to standardparametere:

- moderation_beacon – En ordbok som inneholder detaljer som teksten som modereringen ble utført på, hele JSON-utgangen til Amazon Comprehend API, typen moderering og om de medfølgende etikettene (i konfigurasjonen) ble funnet i teksten eller ikke

- unik ID – Den unike ID-en du tildelte mens du initialiserte en forekomst av

AmazonComprehendModerationChain.

Følgende er et eksempel på hvordan en implementering med tilbakeringing fungerer. I dette tilfellet definerte vi en enkelt tilbakeringing som vi vil at kjeden skal kjøre etter at PII-kontrollen er utført:

Vi bruker deretter my_callback objekt mens du initialiserer modereringskjeden og passerer også en unique_id. Du kan bruke tilbakeringinger og unike identifikatorer med eller uten konfigurasjon. Når du underklasser BaseModerationCallbackHandler, må du implementere én eller alle tilbakeringingsmetodene avhengig av filtrene du har tenkt å bruke. For korthets skyld viser følgende eksempel en måte å bruke tilbakeringinger og unique_id uten noen konfigurasjon:

Følgende diagram forklarer hvordan denne modereringskjeden med tilbakeringinger og unike identifikatorer fungerer. Spesielt implementerte vi PII-tilbakekallingen som skulle skrive en JSON-fil med dataene som er tilgjengelige i moderation_beacon og unique_id bestått (brukerens e-post i dette tilfellet).

I de neste Python notatbok, har vi samlet noen forskjellige måter du kan konfigurere og bruke modereringskjeden med forskjellige LLM-er, for eksempel LLM-er som er vert for Amazon SageMaker JumpStart og vert i Klemmer Face Hub. Vi har også inkludert eksempel chat-applikasjonen som vi diskuterte tidligere med følgende Python notatbok.

konklusjonen

Det transformative potensialet til store språkmodeller og generativ AI er ubestridelig. Deres ansvarlige og etiske bruk avhenger imidlertid av hensynet til tillit og sikkerhet. Ved å erkjenne utfordringene og aktivt implementere tiltak for å redusere risiko, kan utviklere, organisasjoner og samfunnet for øvrig utnytte fordelene med disse teknologiene samtidig som de bevarer tilliten og sikkerheten som underbygger deres vellykkede integrering. Bruk Amazon Comprehend ContentModerationChain for å legge til tillits- og sikkerhetsfunksjoner til enhver LLM-arbeidsflyt, inkludert Retrieval Augmented Generation (RAG)-arbeidsflyter implementert i LangChain.

For informasjon om å bygge RAG-baserte løsninger ved å bruke LangChain og Amazon Kendras svært nøyaktige, maskinlæringsdrevne (ML) intelligent søk, se – Bygg raskt generative AI-applikasjoner med høy nøyaktighet på bedriftsdata ved å bruke Amazon Kendra, LangChain og store språkmodeller. Som et neste trinn, se kodeeksempler vi opprettet for å bruke Amazon Comprehend-moderering med LangChain. For full dokumentasjon av Amazon Comprehend moderasjonskjede API, se LangChain API dokumentasjon.

Om forfatterne

Wrick Talukdar er seniorarkitekt med Amazon Comprehend Service-teamet. Han jobber med AWS-kunder for å hjelpe dem å ta i bruk maskinlæring i stor skala. Utenom jobben liker han å lese og fotografere.

Wrick Talukdar er seniorarkitekt med Amazon Comprehend Service-teamet. Han jobber med AWS-kunder for å hjelpe dem å ta i bruk maskinlæring i stor skala. Utenom jobben liker han å lese og fotografere.

Anjan Biswas er en senior AI Services Solutions Architect med fokus på AI/ML og Data Analytics. Anjan er en del av det verdensomspennende AI-tjenesteteamet og jobber med kunder for å hjelpe dem med å forstå og utvikle løsninger på forretningsproblemer med AI og ML. Anjan har over 14 års erfaring med å jobbe med globale forsyningskjeder, produksjons- og detaljhandelsorganisasjoner, og hjelper aktivt kunder med å komme i gang og skalere på AWS AI-tjenester.

Anjan Biswas er en senior AI Services Solutions Architect med fokus på AI/ML og Data Analytics. Anjan er en del av det verdensomspennende AI-tjenesteteamet og jobber med kunder for å hjelpe dem med å forstå og utvikle løsninger på forretningsproblemer med AI og ML. Anjan har over 14 års erfaring med å jobbe med globale forsyningskjeder, produksjons- og detaljhandelsorganisasjoner, og hjelper aktivt kunder med å komme i gang og skalere på AWS AI-tjenester.

Nikhil Jha er Senior Technical Account Manager hos Amazon Web Services. Fokusområdene hans inkluderer AI/ML og analyse. På fritiden liker han å spille badminton med datteren og utforske naturen.

Nikhil Jha er Senior Technical Account Manager hos Amazon Web Services. Fokusområdene hans inkluderer AI/ML og analyse. På fritiden liker han å spille badminton med datteren og utforske naturen.

Chin Rane er en AI/ML-spesialistløsningsarkitekt hos Amazon Web Services. Hun brenner for anvendt matematikk og maskinlæring. Hun fokuserer på å designe intelligente dokumentbehandlingsløsninger for AWS-kunder. Utenom jobben liker hun salsa og bachata dans.

Chin Rane er en AI/ML-spesialistløsningsarkitekt hos Amazon Web Services. Hun brenner for anvendt matematikk og maskinlæring. Hun fokuserer på å designe intelligente dokumentbehandlingsløsninger for AWS-kunder. Utenom jobben liker hun salsa og bachata dans.

- SEO-drevet innhold og PR-distribusjon. Bli forsterket i dag.

- PlatoData.Network Vertical Generative Ai. Styrk deg selv. Tilgang her.

- PlatoAiStream. Web3 Intelligence. Kunnskap forsterket. Tilgang her.

- PlatoESG. Karbon, CleanTech, Energi, Miljø, Solenergi, Avfallshåndtering. Tilgang her.

- PlatoHelse. Bioteknologisk og klinisk etterretning. Tilgang her.

- kilde: https://aws.amazon.com/blogs/machine-learning/build-trust-and-safety-for-generative-ai-applications-with-amazon-comprehend-and-langchain/

- : har

- :er

- :ikke

- :hvor

- $OPP

- 1

- 100

- 11

- 12

- 14

- 15%

- 17

- 19

- 500

- 7

- 8

- 9

- a

- evner

- evne

- Om oss

- misbruk

- adgang

- Logg inn

- nøyaktig

- oppnår

- tvers

- Handling

- handlinger

- aktivt

- legge til

- adresse

- adresser

- adressering

- overholde

- adoptere

- Adopsjon

- råd

- Etter

- alder

- AI

- AI-tjenester

- AI-systemer

- AI / ML

- Alle

- tillatt

- tillate

- tillater

- allerede

- også

- helt

- Amazon

- Amazon Comprehend

- Amazon Kendra

- Amazon Web Services

- beløp

- an

- analytics

- analyser

- og

- Kunngjøring

- besvare

- noen

- api

- APIer

- aktuelt

- Søknad

- søknader

- anvendt

- gjelder

- Påfør

- hensiktsmessig

- hensiktsmessig

- ER

- områder

- AS

- spør

- spør

- aspekter

- tildelt

- assistenter

- assosiert

- At

- øke

- augmented

- tilgjengelig

- AWS

- Backed

- dårlig

- basen

- basert

- BE

- fordi

- bli

- blir

- atferd

- være

- tro

- Fordeler

- mellom

- Beyond

- Blokker

- blokkering

- både

- grenser

- bredere

- bygge

- bygge tillit

- Bygning

- bygget

- virksomhet

- bedrifter

- men

- by

- ring

- tilbakeringinger

- som heter

- CAN

- evner

- evne

- stand

- hovedstad

- kort

- saken

- saker

- Catch

- viss

- kjede

- kjeder

- utfordringer

- karakter

- chatbot

- chatbots

- sjekk

- kontroll

- Sjekker

- hake

- valg

- klasse

- klasser

- klassifisering

- klassifisert

- Klassifisere

- kunde

- kode

- sammenhengende

- COM

- kombinasjon

- kombinert

- kommentere

- Felles

- komplekse

- komponenter

- fatte

- konsept

- bekymret

- bekymringer

- forhold

- selvtillit

- Konfigurasjon

- påfølgende

- konsekvent

- inneholder

- innhold

- Innholdsgenerering

- kontroll

- kontroversiell

- Kjerne

- opprettet

- Opprette

- Kreativ

- kreditt

- kredittkort

- kritisk

- avgjørende

- skikk

- kunde

- Kundeservice

- Kunder

- tilpasses

- tilpasse

- daglig

- Dans

- dato

- Data Analytics

- personvern

- Database

- datasett

- avgjørelser

- dypere

- Misligholde

- definere

- definert

- dybden

- demonstrere

- demonstrerer

- avhengig

- utforme

- ønsket

- detaljer

- oppdage

- oppdaget

- Gjenkjenning

- Bestem

- utvikle

- utviklere

- Utvikling

- forskjellig

- digitalt

- diskutere

- diskutert

- utpreget

- dykk

- do

- dokument

- dokumentasjon

- dokumenter

- doe

- ned

- to

- e

- hver enkelt

- Tidligere

- enklere

- effektivt

- uanstrengt

- enten

- ellers

- emalje

- muliggjøre

- slutt

- Endless

- sikre

- sikrer

- Enterprise

- enheter

- enhet

- Miljø

- lik

- like

- feil

- essens

- avgjørende

- hovedsak

- etisk

- eksempel

- eksempler

- Unntatt

- unntak

- eksisterende

- erfaring

- Erfaringer

- Forklar

- forklarte

- forklarer

- eksplisitt

- Utforske

- ekspress

- strekker

- trekke ut

- Face

- kjent

- Trekk

- Egenskaper

- Noen få

- filet

- filtrere

- filtrering

- filtre

- finansiell

- Finn

- funn

- Først

- flaggede

- flagg

- fleksibel

- flyten

- Fokus

- fokuserte

- fokuserer

- etter

- følger

- Til

- skjema

- format

- skjemaer

- fora

- funnet

- Rammeverk

- Frankrike

- fra

- fullt

- funksjoner

- videre

- generere

- generert

- genererer

- generasjonen

- generative

- Generativ AI

- få

- gif

- Gi

- gitt

- gir

- Global

- mål

- Går

- skal

- god

- større

- Vokser

- Vekst

- veiledning

- Håndtering

- skjer

- skadelig

- seletøy

- hater

- Ha

- å ha

- he

- hjelpe

- hjelpe

- hjelper

- svært

- hengsler

- hans

- vert

- Hvordan

- Hvordan

- Men

- HTML

- HTTPS

- Hub

- menneskelig

- menneskelig

- i

- ID

- Identifikasjon

- identifikator

- identifikatorer

- identifiserer

- identifisere

- identifisering

- if

- ulovlig

- illustrerer

- bilde

- Påvirkning

- iverksette

- gjennomføring

- implementert

- implementere

- importere

- betydning

- viktig

- in

- uforvarende

- inkludere

- inkludert

- inkluderer

- Inkludert

- Øke

- øker

- stadig

- uavhengig

- uavhengig av hverandre

- bransjer

- påvirke

- informasjon

- i utgangspunktet

- inngang

- innganger

- forespørsler

- f.eks

- integrert

- integrering

- Intelligent

- Intelligent dokumentbehandling

- hensikt

- hensikt

- interessert

- Interface

- avbrutt

- inn

- introdusere

- IT

- DET ER

- John

- JOHN DOE

- jpg

- JSON

- bare

- etiketter

- Språk

- stor

- seinere

- læring

- venstre

- Lovlig

- mindre

- i likhet med

- sannsynligheten

- Begrenset

- Liste

- lite

- litt dypere

- LLM

- logg

- logging

- logikk

- ser

- maskin

- maskinlæring

- vedlikeholde

- GJØR AT

- leder

- måte

- produksjon

- maske

- matematikk

- Saken

- Kan..

- me

- midler

- målinger

- mekanisme

- Media

- medisinsk

- sammenslåing

- møtte

- metoder

- misbruk

- Minske

- Blanding

- ML

- modell

- modeller

- moderasjon

- modulære

- mer

- mye

- må

- my

- navn

- nemlig

- navn

- Naturlig

- Natural Language Processing

- nødvendig

- Ny

- Nye funksjoner

- neste

- nlp

- Nei.

- nå

- Antall

- tall

- mange

- objekt

- of

- støtende

- tilby

- forskyvninger

- on

- ONE

- bare

- åpen

- åpen kildekode

- betjene

- drift

- alternativer

- or

- rekkefølge

- organisasjoner

- opprinnelse

- Annen

- ellers

- vår

- ut

- utfall

- utendørs

- produksjon

- utganger

- utenfor

- enn

- egen

- parameter

- parametere

- Paramount

- del

- spesielt

- passere

- bestått

- lidenskapelig

- Passord

- reset passord

- Mønster

- Utfør

- utført

- utfører

- kanskje

- personlig

- personlig

- telefon

- fotografering

- brikke

- stykker

- Plattformer

- plato

- Platon Data Intelligence

- PlatonData

- spiller

- politisk

- Populær

- posisjon

- positiv

- muligheter

- mulig

- Post

- potensiell

- potensielt

- makt

- powered

- kraftig

- bevarer

- hindre

- primært

- primære

- prinsipper

- prioritering

- privatliv

- privat

- privat informasjon

- problemer

- prosedyrer

- prosess

- prosessering

- dyp

- Progress

- riktig

- beskytte

- gi

- gir

- Python

- spørsmål

- heve

- område

- serier

- rask

- heller

- nå

- Lesning

- riket

- motta

- gjenkjenne

- redusere

- redusere

- referere

- region

- regulatorer

- relevant

- pålitelig

- omdømme

- anmode

- Krav

- ressurs

- de

- svar

- svar

- ansvar

- ansvarlig

- restriksjoner

- detaljhandel

- avkastning

- ikke sant

- Risiko

- risikoer

- Kjør

- s

- trygge

- Sikkerhet

- sagemaker

- samme

- Skala

- Scener

- Resultat

- sømløs

- Seksjon

- seksjoner

- sikkerhet

- se

- Søke

- SELV

- senior

- sensitive

- sendt

- dømme

- Sequence

- tjeneste

- Tjenester

- sett

- hun

- bør

- Vis

- presentere

- vist

- Viser

- signaler

- på samme måte

- Enkelt

- forenkle

- enkelt

- Nettsteder

- tekstutdrag

- So

- selskap

- sosiale medier

- Samfunnet

- Solutions

- noen

- noe

- kilde

- kildekoden

- Snakker

- spesialist

- spesifikk

- spesielt

- spesifisert

- tale

- standarder

- Begynn

- startet

- Uttalelse

- Trinn

- Stopp

- stoppe

- oppbevare

- String

- I ettertid

- vellykket

- slik

- medfølgende

- levere

- forsyningskjeden

- støtte

- Støtter

- bærekraftig

- Systemer

- Ta

- oppgaver

- lag

- Teknisk

- Technologies

- mal

- tekst

- enn

- Det

- De

- Hovedstaden

- Kilden

- deres

- Dem

- deretter

- Der.

- derved

- Disse

- de

- denne

- trusler

- tre

- terskel

- Gjennom

- tid

- til

- verktøy

- spor

- trent

- transformative

- Stol

- prøve

- to

- typen

- typer

- avdekke

- unektelig

- understøtte

- forstå

- forståelse

- unik

- Universell

- opprett~~POS=TRUNC

- bruke

- bruk sak

- brukt

- Bruker

- Brukere

- bruker

- ved hjelp av

- bruke

- benyttes

- Verdifull

- verdi

- Verdier

- variasjon

- ulike

- enorme

- versjon

- av

- virtuelle

- W

- ønsker

- var

- Vei..

- måter

- we

- web

- webtjenester

- VI VIL

- var

- Hva

- Hva er

- når

- mens

- om

- hvilken

- mens

- HVEM

- hele

- hvorfor

- bred

- Bred rekkevidde

- vil

- ønske

- med

- innenfor

- uten

- vitne

- Arbeid

- arbeidsflyt

- arbeidsflyt

- arbeid

- virker

- skrive

- skriving

- X

- år

- Du

- Din

- zephyrnet