Clearview AI-sagaen fortsetter!

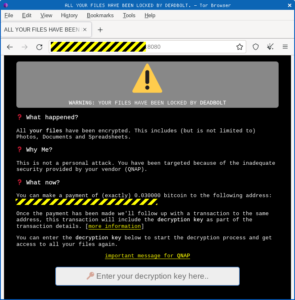

Hvis du ikke har hørt om dette selskapet før, her er en veldig klar og kortfattet oppsummering fra den franske personvernregulatoren, CNIL (Nasjonal kommisjon for databehandling og friheter), som veldig praktisk har publisert sine funn og avgjørelser i denne langvarige historien på både fransk og engelsk:

Clearview AI samler bilder fra mange nettsteder, inkludert sosiale medier. Den samler alle fotografiene som er direkte tilgjengelige på disse nettverkene (dvs. som kan sees uten å logge inn på en konto). Bilder er også hentet fra videoer som er tilgjengelige online på alle plattformer.

Dermed har selskapet samlet over 20 milliarder bilder over hele verden.

Takket være denne samlingen markedsfører selskapet tilgang til bildedatabasen sin i form av en søkemotor der en person kan søkes ved hjelp av et fotografi. Selskapet tilbyr denne tjenesten til rettshåndhevende myndigheter for å identifisere gjerningsmenn eller ofre for kriminalitet.

Ansiktsgjenkjenningsteknologi brukes til å søke i søkemotoren og finne en person basert på fotografiet deres. For å gjøre det bygger selskapet en «biometrisk mal», dvs. en digital representasjon av en persons fysiske egenskaper (ansiktet i dette tilfellet). Disse biometriske dataene er spesielt sensitive, spesielt fordi de er knyttet til vår fysiske identitet (hva vi er) og gjør oss i stand til å identifisere oss på en unik måte.

De aller fleste personer hvis bilder er samlet inn i søkemotoren, er ikke klar over denne funksjonen.

Clearview AI har på ulike måter tiltrukket seg harme fra selskaper, personvernorganisasjoner og regulatorer de siste årene, inkludert å bli rammet av:

- Klager og gruppesøksmål arkivert i Illinois, Vermont, New York og California.

- En juridisk utfordring fra American Civil Liberties Union (ACLU).

- Opphøre-og-avstå ordre fra Facebook, Google og YouTube, som mente at Clearview var skrapeaktiviteter har brutt deres vilkår og betingelser.

- Inngrepsaksjon og bøter in Australia og Storbritannia.

- En kjennelse som finner driften ulovlig i 2021, av ovennevnte franskmenn regulator.

Ingen legitim interesse

I desember 2021 uttalte CNIL, ganske rett ut, at:

[D]et selskapet innhenter ikke samtykke fra de berørte personene til å samle inn og bruke fotografiene deres til å levere programvaren.

Clearview AI har heller ikke en legitim interesse i å samle inn og bruke disse dataene, spesielt gitt prosessens påtrengende og massive natur, som gjør det mulig å hente bildene som finnes på Internett til flere titalls millioner Internett-brukere i Frankrike. Disse menneskene, hvis fotografier eller videoer er tilgjengelige på ulike nettsteder, inkludert sosiale medier, forventer ikke med rimelighet at bildene deres skal behandles av selskapet for å levere et ansiktsgjenkjenningssystem som kan brukes av stater til rettshåndhevelsesformål.

Alvoret i dette bruddet førte til at CNIL-lederen beordret Clearview AI til å slutte, på grunn av mangel på et juridisk grunnlag, innsamlingen og bruken av data fra personer på fransk territorium, i forbindelse med driften av programvaren for ansiktsgjenkjenning den markedsfører.

Videre dannet CNIL den oppfatning at Clearview AI ikke så ut til å bry seg mye om å overholde europeiske regler for innsamling og håndtering av personopplysninger:

Klagene mottatt av CNIL avslørte vanskelighetene klagere møtte ved å utøve rettighetene sine med Clearview AI.

På den ene siden legger selskapet ikke til rette for utøvelse av den registrertes rett til innsyn:

- ved å begrense utøvelsen av denne retten til data samlet inn i løpet av de tolv månedene før forespørselen;

- ved å begrense utøvelsen av denne retten til to ganger i året, uten begrunnelse;

- ved kun å svare på visse forespørsler etter et for stort antall forespørsler fra samme person.

På den annen side svarer ikke selskapet effektivt på forespørsler om tilgang og sletting. Den gir delvise svar eller svarer ikke på forespørsler i det hele tatt.

CNIL publiserte til og med en infografikk som oppsummerer beslutningen og beslutningsprosessen:

De australske og britiske informasjonskommissærene kom til lignende konklusjoner, med lignende resultater for Clearview AI: dataskrapingen din er ulovlig i våre jurisdiksjoner; du må slutte å gjøre det her.

Men som vi sa tilbake i mai 2022, da Storbritannia rapporterte at de ville bøtelegge Clearview AI omtrent £ 7,500,000 (ned fra 17 millioner pund i bot ble først foreslått) og beordrer selskapet til ikke lenger å samle inn data om britiske redidenter, "Hvordan dette vil bli politibetjent, enn si håndhevet, er uklart."

Vi kan være i ferd med å finne ut hvordan selskapet vil bli overvåket i fremtiden, med CNIL mister tålmodigheten med Clearview AI for ikke å etterkomme kjennelsen om å slutte å samle inn biometriske data til franskmenn ...

…og kunngjør en bot på €20,000,000 XNUMX XNUMX:

Etter en formell melding som forble uadressert, ila CNIL en bot på 20 millioner euro og beordret CLEARVIEW AI til å slutte å samle inn og bruke data om enkeltpersoner i Frankrike uten juridisk grunnlag og å slette dataene som allerede er samlet inn.

Hva nå?

Som vi har skrevet før, ser det ut til at Clearview AI ikke bare er glad for å ignorere reguleringsvedtak som er utstedt mot det, men også forvente at folk skal synes synd på det på samme tid, og faktisk være på sin side for å gi det det mener er en viktig tjeneste for samfunnet.

I den britiske kjennelsen, der regulatoren tok en lignende linje som CNIL i Frankrike, ble selskapet fortalt at dets oppførsel var ulovlig, uønsket og må stoppe umiddelbart.

Men rapporter på den tiden antydet at langt fra å vise noen ydmykhet, reagerte administrerende direktør i Clearview Hoan Ton-That med en åpningsstemning som ikke ville være malplassert i en tragisk kjærlighetssang:

Det knuser hjertet mitt at Clearview AI ikke har vært i stand til å hjelpe når de har mottatt presserende forespørsler fra britiske rettshåndhevelsesbyråer som ønsker å bruke denne teknologien til å etterforske tilfeller av alvorlige seksuelle overgrep mot barn i Storbritannia.

Som vi foreslo tilbake i mai 2022, kan selskapet finne sine mange motstandere som svarer med egne sangtekster:

Gråt meg en elv. (Ikke oppfør deg som om du ikke vet det.)

Hva tror du?

Tilbyr Clearview AI virkelig en fordelaktig og sosialt akseptabel tjeneste til rettshåndhevelse?

Eller tråkker det tilfeldig på personvernet vårt og vår uskyldspresumsjon ved å samle inn biometriske data på ulovlig vis, og kommersialisere dem for etterforskningsformål uten samtykke (og tilsynelatende uten grenser)?

Gi oss beskjed i kommentarene nedenfor ... du kan forbli anonym.

- blockchain

- Clearview

- clearview AI

- coingenius

- cryptocurrency lommebøker

- kryptoverveksling

- cybersikkerhet

- nettkriminelle

- Cybersecurity

- datainnsamling

- innenriksdepartementet

- digitale lommebøker

- ansiktsgjenkjenning

- brannmur

- Kaspersky

- Lov og orden

- malware

- Mcafee

- Naken sikkerhet

- NexBLOC

- plato

- plato ai

- Platon Data Intelligence

- Platon spill

- PlatonData

- platogaming

- privatliv

- VPN

- nettside sikkerhet

- zephyrnet

![S3 Ep118: Gjett passordet ditt? Ikke nødvendig hvis den allerede er stjålet! [Lyd + tekst] S3 Ep118: Gjett passordet ditt? Ikke nødvendig hvis den allerede er stjålet! [Lyd + tekst]](https://platoblockchain.com/wp-content/uploads/2023/01/s3-ep118-guess-your-password-no-need-if-its-stolen-already-audio-text-360x188.png)