- Juni 30, 2014

- Vasilis Vryniotis

- . Ingen kommentarer

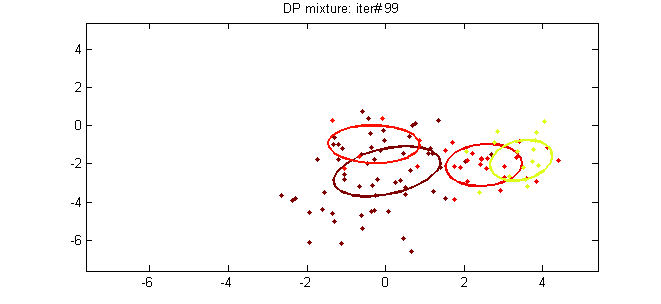

Denne artikkelen er den femte delen av opplæringen om Gruppering med DPMM. I de forrige innleggene dekket vi i detalj den teoretiske bakgrunnen til metoden, og vi beskrev dens matematiske representasjoner og måter å konstruere den på. I dette innlegget vil vi prøve å koble teorien med praksisen ved å introdusere to modeller DPMM: Dirichlet Multivariate Normal Mixture Model som kan brukes til å gruppere Gaussiske data og Dirichlet-Multinomial Mixture Model som brukes til å gruppere dokumenter.

Oppdatering: Datumbox Machine Learning Framework er nå åpen kildekode og gratis å nedlasting. Sjekk ut pakken com.datumbox.framework.machinelearning.clustering for å se implementeringen av Dirichlet Process Mixture Models i Java.

1. Dirichlet multivariat normal blandingsmodell

Den første Dirichlet-prosessblandingsmodellen som vi vil undersøke er Dirichlet Multivariate Normal Mixture Model som kan brukes til å utføre klynging på kontinuerlige datasett. Blandingsmodellen er definert som følger:

![]()

![]()

![]()

Ligning 1: Dirichlet multivariat normal blandingsmodell

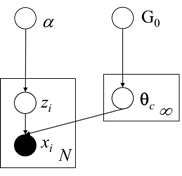

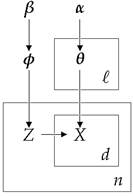

Som vi kan se ovenfor, antar den spesielle modellen at den generative distribusjonen er den multinomiale gaussiske distribusjonen og bruker den kinesiske restaurant-prosessen som tidligere for klyngeoppdragene. Dessuten for basedistribusjonen G0 den bruker Normal-Inverse-Wishart prior som er konjugerer tidligere av Multivariat Normalfordeling med ukjent gjennomsnitt og kovariansmatrise. Nedenfor presenterer vi den grafiske modellen for blandingsmodellen:

Figur 1: Grafisk modell av Dirichlet Multivariate Normal Mixture Model

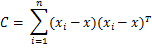

Som vi diskuterte tidligere, for å kunne estimere klyngeoppdragene, vil vi bruke Samlet Gibbs-sampling som krever å velge passende konjugerte priors. I tillegg må vi oppdatere parametrene som er gitt forut og bevis. Nedenfor ser vi MAP estimater av parameterne for en av klyngene:

![]()

![]()

![]()

![]()

![]()

Ligning 2: KART-estimater på klyngeparametere

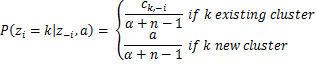

Hvor d er dimensjonaliteten til våre data og ![]() er prøvegjennomsnittet. Dessuten har vi flere hyperparametre for Normal-Inverse-Wishart som μ0 som er startmiddelet, κ0 er gjennomsnittsbrøken som fungerer som en utjevningsparameter, ν0 er frihetsgradene som er satt til antall dimensjoner og Ψ0 er det parvise avviksproduktet som er satt til dxd-identitetsmatrisen multiplisert med en konstant. Fra nå av alle de tidligere hyperparametrene til G0 vil bli betegnet med λ for å forenkle notasjonen. Til slutt ved å ha alt det ovennevnte, kan vi estimere sannsynlighetene som kreves av Collapsed Gibbs Sampler. Sannsynligheten for at observasjon i skal tilhøre klynge k gitt klyngetilordningene, datasettet og alle hyperparametrene α og λ til DP og G0 er gitt nedenfor:

er prøvegjennomsnittet. Dessuten har vi flere hyperparametre for Normal-Inverse-Wishart som μ0 som er startmiddelet, κ0 er gjennomsnittsbrøken som fungerer som en utjevningsparameter, ν0 er frihetsgradene som er satt til antall dimensjoner og Ψ0 er det parvise avviksproduktet som er satt til dxd-identitetsmatrisen multiplisert med en konstant. Fra nå av alle de tidligere hyperparametrene til G0 vil bli betegnet med λ for å forenkle notasjonen. Til slutt ved å ha alt det ovennevnte, kan vi estimere sannsynlighetene som kreves av Collapsed Gibbs Sampler. Sannsynligheten for at observasjon i skal tilhøre klynge k gitt klyngetilordningene, datasettet og alle hyperparametrene α og λ til DP og G0 er gitt nedenfor:

![]()

![]()

Ligning 3: Sannsynligheter brukt av Gibbs Sampler for MNMM

Hvor zi er klyngetilordningen til observasjon xi, x1:n er det komplette datasettet, z-i er settet med klyngetilordninger uten den av ith observasjon, x-i er det komplette datasettet unntatt ith observasjon, ck,-Jeg er det totale antallet observasjoner tilordnet klynge k unntatt ith observasjon mens ![]() og

og ![]() er gjennomsnittet og kovariansmatrisen til klyngen k unntatt ith observasjon.

er gjennomsnittet og kovariansmatrisen til klyngen k unntatt ith observasjon.

2. Dirichlet-multinomial blandingsmodellen

Dirichlet-Multinomial Mixture Model brukes til å utføre klyngeanalyse av dokumenter. Den bestemte modellen har et litt mer komplisert hierarki siden den modellerer dokumentenes emner/kategorier, ordsannsynlighetene innenfor hvert emne, klyngetilordningene og den generative distribusjonen av dokumentene. Målet er å utføre uovervåket læring og gruppere en liste over dokumenter ved å tilordne dem til grupper. Blandingsmodellen er definert som følger:

![]()

![]()

![]()

![]()

Ligning 4: Dirichlet-Multinomial blandingsmodell

Der φ modellerer emnesannsynlighetene, zi er en emnevelger, θk er ordet sannsynligheter i hver klynge og xjeg, j representerer dokumentordene. Vi bør merke oss at denne teknikken bruker bag-of-word rammeverk som representerer dokumentene som en uordnet samling av ord, sett bort fra grammatikk og ordrekkefølge. Denne forenklede representasjonen brukes ofte i naturlig språkbehandling og informasjonsinnhenting. Nedenfor presenterer vi den grafiske modellen for blandingsmodellen:

Figur 2: Grafisk modell av Dirichlet-Multinomial Mixture Model

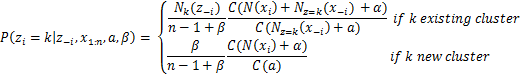

Den spesielle modellen bruker Multinomial Diskret distribusjon for den generative fordeling og Dirichlet-fordelinger for priorene. ℓ er størrelsen på våre aktive klynger, n det totale antallet dokumenter, β kontrollerer det a priori forventede antallet klynger mens α kontrollerer antall ord som er tildelt hver klynge. For å estimere sannsynlighetene som kreves av Samarbeidet Gibbs Sampler vi bruker følgende ligning:

![]()

Ligning 5: Sannsynligheter brukt av Gibbs Sampler for DMMM

Der Γ er gammafunksjonen, zi er klyngetilordningen til dokument xi, x1:n er det komplette datasettet, z-i er settet med klyngetilordninger uten den av ith dokument, x-i er det komplette datasettet unntatt ith dokument, Nk(z-i) er antall observasjoner tilordnet klynge k unntatt ith dokument, Nz=k(x-i) er en vektor med summen av antall for hvert ord for alle dokumentene som er tilordnet klynge k unntatt ith dokument og N(xi) er den sparsomme vektoren med antallet av hvert ord i dokument xi. Til slutt, som vi kan se ovenfor, ved å bruke Collapsed Gibbs Sampler med den kinesiske restaurantprosessen θjk variabel som lagrer sannsynligheten for ord j i emne k kan integreres ut.

- AI

- ai kunst

- ai art generator

- du har en robot

- kunstig intelligens

- sertifisering av kunstig intelligens

- kunstig intelligens robot

- kunstig intelligens roboter

- programvare for kunstig intelligens

- blockchain

- blockchain konferanse ai

- coingenius

- samtale kunstig intelligens

- kryptokonferanse ai

- dall sin

- Datoboks

- dyp læring

- google det

- maskinlæring

- Maskinlæring og statistikk

- plato

- plato ai

- Platon Data Intelligence

- Platon spill

- PlatonData

- platogaming

- skala ai

- syntaks

- zephyrnet