Healthcare and life sciences (HCLS)-kunder tar i bruk generativ AI som et verktøy for å få mer ut av dataene sine. Brukstilfeller inkluderer dokumentoppsummering for å hjelpe lesere med å fokusere på nøkkelpunkter i et dokument og transformere ustrukturert tekst til standardiserte formater for å fremheve viktige egenskaper. Med unike dataformater og strenge regulatoriske krav, leter kunder etter valg for å velge den mest effektive og kostnadseffektive modellen, samt muligheten til å utføre nødvendig tilpasning (finjustering) for å passe deres forretningsbruk. I dette innlegget leder vi deg gjennom distribusjon av en Falcon Large Language Model (LLM) ved hjelp av Amazon SageMaker JumpStart og bruke modellen til å oppsummere lange dokumenter med LangChain og Python.

Løsningsoversikt

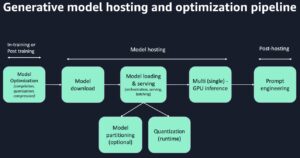

Amazon SageMaker er bygget på Amazons to tiår med erfaring med å utvikle virkelige ML-applikasjoner, inkludert produktanbefalinger, personalisering, intelligent shopping, robotikk og stemmeassisterte enheter. SageMaker er en HIPAA-kvalifisert administrert tjeneste som gir verktøy som gjør det mulig for dataforskere, ML-ingeniører og forretningsanalytikere å innovere med ML. Innen SageMaker er Amazon SageMaker Studio, et integrert utviklingsmiljø (IDE) spesialbygd for samarbeidende ML-arbeidsflyter, som igjen inneholder et bredt utvalg av hurtigstartløsninger og forhåndstrente ML-modeller i en integrert hub kalt SageMaker JumpStart. Med SageMaker JumpStart kan du bruke ferdigtrente modeller, for eksempel Falcon LLM, med forhåndsbygde eksempelnotatbøker og SDK-støtte for å eksperimentere med og distribuere disse kraftige transformatormodellene. Du kan bruke SageMaker Studio og SageMaker JumpStart til å distribuere og spørre etter din egen generative modell i AWS-kontoen din.

Du kan også sikre at slutningsdataene for nyttelast ikke forlater VPC-en din. Du kan klargjøre modeller som endepunkter med én leietaker og distribuere dem med nettverksisolasjon. Videre kan du kurere og administrere det valgte settet med modeller som tilfredsstiller dine egne sikkerhetskrav ved å bruke den private modellhub-funksjonen i SageMaker JumpStart og lagre de godkjente modellene der. SageMaker er i omfang for HIPAA BAA, SOC123og HITRUST CSF.

De Falcon LLM er en stor språkmodell, trent av forskere ved Technology Innovation Institute (TII) på over 1 billion tokens ved hjelp av AWS. Falcon har mange forskjellige variasjoner, med sine to hovedbestanddeler Falcon 40B og Falcon 7B, bestående av henholdsvis 40 milliarder og 7 milliarder parametere, med finjusterte versjoner som er trent for spesifikke oppgaver, for eksempel å følge instruksjoner. Falcon presterer godt på en rekke oppgaver, inkludert tekstoppsummering, sentimentanalyse, svar på spørsmål og samtale. Dette innlegget gir en gjennomgang som du kan følge for å distribuere Falcon LLM til AWS-kontoen din, ved å bruke en administrert notatbokforekomst gjennom SageMaker JumpStart for å eksperimentere med tekstoppsummering.

SageMaker JumpStart-modellhuben inkluderer komplette bærbare datamaskiner for å distribuere og spørre hver modell. Når dette skrives, er det seks versjoner av Falcon tilgjengelig i SageMaker JumpStart-modellhuben: Falcon 40B Instruct BF16, Falcon 40B BF16, Falcon 180B BF16, Falcon 180B Chat BF16, Falcon 7B Instruct BF16 og Falcon 7B B. Dette innlegget bruker Falcon 16B Instruct-modellen.

I de følgende delene viser vi hvordan du kommer i gang med dokumentoppsummering ved å distribuere Falcon 7B på SageMaker Jumpstart.

Forutsetninger

For denne opplæringen trenger du en AWS-konto med et SageMaker-domene. Hvis du ikke allerede har et SageMaker-domene, se Ombord på Amazon SageMaker Domain å lage en.

Distribuer Falcon 7B ved hjelp av SageMaker JumpStart

For å distribuere modellen, fullfør følgende trinn:

- Naviger til SageMaker Studio-miljøet fra SageMaker-konsollen.

- Innenfor IDE, under SageMaker JumpStart Velg navigasjonsruten Modeller, notatbøker, løsninger.

- Distribuer Falcon 7B Instruct-modellen til et endepunkt for slutning.

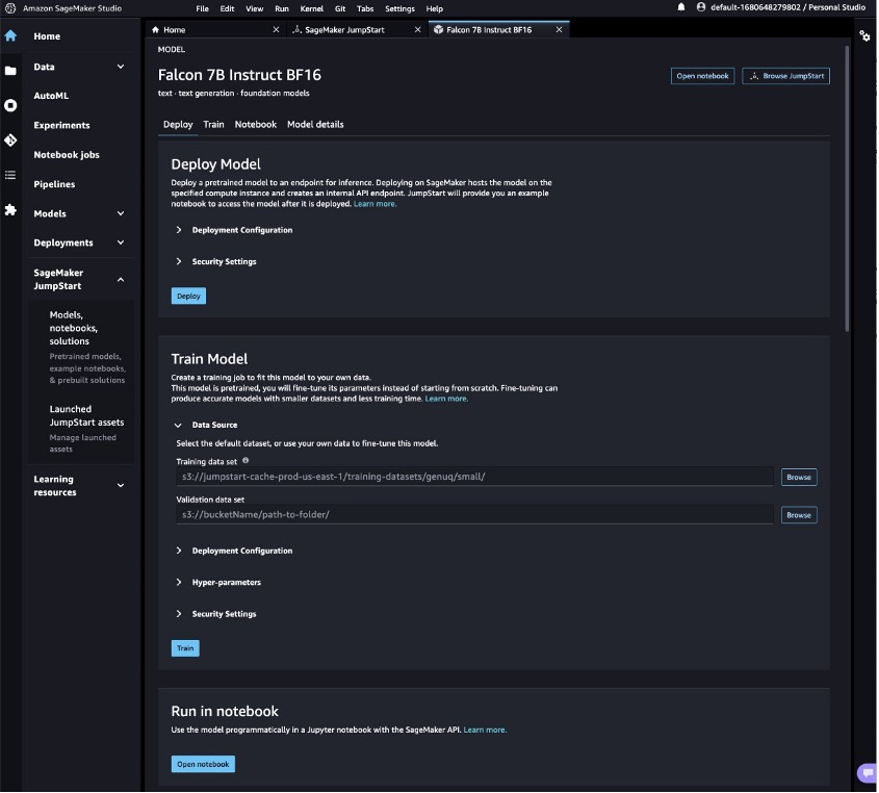

Dette vil åpne modellkortet for Falcon 7B Instruct BF16-modellen. På denne siden finner du Distribuer or Tog alternativer samt lenker for å åpne prøvenotatbøkene i SageMaker Studio. Dette innlegget vil bruke eksempelnotisboken fra SageMaker JumpStart for å distribuere modellen.

- Velg Åpne notatboken.

- Kjør de fire første cellene i den bærbare datamaskinen for å distribuere Falcon 7B Instruct-endepunktet.

Du kan se dine utplasserte JumpStart-modeller på Lanserte JumpStart-ressurser side.

- I navigasjonsruten under SageMaker Jumpstart, velg Lanserte JumpStart-ressurser.

- Velg Modellens endepunkter for å se statusen til endepunktet ditt.

Med Falcon LLM-endepunktet utplassert, er du klar til å spørre etter modellen.

Kjør din første spørring

For å kjøre en spørring, fullfør følgende trinn:

- På filet meny, velg Ny og bærbare for å åpne en ny notisbok.

Du kan også laste ned den ferdige notatboken her..

- Velg bildet, kjernen og forekomsttypen når du blir bedt om det. For dette innlegget velger vi Data Science 3.0-bildet, Python 3-kjernen og ml.t3.medium-forekomsten.

- Importer Boto3- og JSON-modulene ved å skrive inn følgende to linjer i den første cellen:

- Press Skift + Enter å kjøre cellen.

- Deretter kan du definere en funksjon som kaller endepunktet ditt. Denne funksjonen tar en ordboknyttelast og bruker den til å starte SageMaker runtime-klient. Deretter deserialiserer den responsen og skriver ut input og generert tekst.

Nyttelasten inkluderer ledeteksten som innganger, sammen med slutningsparametrene som sendes til modellen.

- Du kan bruke disse parameterne med ledeteksten for å justere utdataene til modellen for ditt bruksområde:

Spørring med en oppsummeringsprompt

Dette innlegget bruker en prøveoppgave for å demonstrere oppsummering. Eksempeltekstfilen handler om automatisk tekstoppsummering i biomedisinsk litteratur. Fullfør følgende trinn:

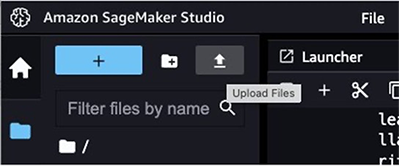

- Last ned PDF-filen og kopier teksten til en fil med navn

document.txt. - I SageMaker Studio velger du opplastingsikonet og laster opp filen til SageMaker Studio-forekomsten.

Ut av esken gir Falcon LLM støtte for tekstoppsummering.

- La oss lage en funksjon som bruker raske ingeniørteknikker for å oppsummere

document.txt:

Du vil legge merke til at for lengre dokumenter vises en feil – Falcon har, sammen med alle andre LLM-er, en grense på antall tokens som sendes som input. Vi kan komme rundt denne grensen ved å bruke LangChains forbedrede oppsummeringsfunksjoner, som gjør at mye større input kan sendes til LLM.

Importer og kjør en oppsummeringskjede

LangChain er et åpen kildekode-programvarebibliotek som lar utviklere og dataforskere raskt bygge, justere og distribuere tilpassede generative applikasjoner uten å administrere komplekse ML-interaksjoner, ofte brukt til å abstrahere mange av de vanlige brukstilfellene for generative AI-språkmodeller på bare noen få linjer med kode. LangChains støtte for AWS-tjenester inkluderer støtte for SageMaker-endepunkter.

LangChain gir et tilgjengelig grensesnitt til LLM-er. Funksjonene inkluderer verktøy for rask maling og rask kjeding. Disse kjedene kan brukes til å oppsummere tekstdokumenter som er lengre enn hva språkmodellen støtter i en enkelt samtale. Du kan bruke en kartreduksjonsstrategi for å oppsummere lange dokumenter ved å dele dem opp i håndterbare biter, oppsummere dem og kombinere dem (og oppsummere igjen, hvis nødvendig).

- La oss installere LangChain for å begynne:

- Importer de relevante modulene og del ned det lange dokumentet i biter:

- For å få LangChain til å fungere effektivt med Falcon, må du definere standard innholdsbehandlerklassene for gyldig input og output:

- Du kan definere egendefinerte ledetekster som

PromptTemplateobjekter, hovedredskapet for spørring med LangChain, for tilnærmingen til kartreduser oppsummering. Dette er et valgfritt trinn fordi kartleggings- og kombineringsforespørsler leveres som standard hvis parametrene i kallet for å laste oppsummeringskjeden (load_summarize_chain) er udefinerte.

- LangChain støtter LLM-er som er vert på SageMaker inferensendepunkter, så i stedet for å bruke AWS Python SDK, kan du initialisere forbindelsen gjennom LangChain for større tilgjengelighet:

- Til slutt kan du laste inn en oppsummeringskjede og kjøre et sammendrag på inndatadokumentene ved å bruke følgende kode:

Fordi verbose parameter er satt til True, vil du se alle de mellomliggende utgangene til kartreduksjonsmetoden. Dette er nyttig for å følge hendelsesforløpet for å komme frem til et endelig sammendrag. Med denne kartreduserende tilnærmingen kan du effektivt oppsummere dokumenter mye lenger enn det som normalt er tillatt av modellens maksimale inndatatokengrense.

Rydd opp

Etter at du er ferdig med å bruke slutningsendepunktet, er det viktig å slette det for å unngå å pådra deg unødvendige kostnader gjennom følgende kodelinjer:

Bruker andre fundamentmodeller i SageMaker JumpStart

Bruk av andre grunnlagsmodeller som er tilgjengelige i SageMaker JumpStart for dokumentoppsummering krever minimale overhead å sette opp og distribuere. LLM-er varierer av og til med strukturen til input- og outputformater, og ettersom nye modeller og ferdiglagde løsninger legges til SageMaker JumpStart, avhengig av oppgaveimplementeringen, må du kanskje gjøre følgende kodeendringer:

- Hvis du utfører oppsummering via

summarize()metoden (metoden uten å bruke LangChain), må du kanskje endre JSON-strukturen tilpayloadparameter, samt håndtering av responsvariabelen iquery_endpoint()funksjon - Hvis du utfører oppsummering via LangChain's

load_summarize_chain()metoden må du kanskje endreContentHandlerTextSummarizationklasse, spesielttransform_input()ogtransform_output()funksjoner, for å håndtere nyttelasten som LLM forventer og utdataene LLM returnerer

Grunnmodeller varierer ikke bare i faktorer som inferenshastighet og kvalitet, men også input- og outputformater. Se LLMs relevante informasjonsside om forventet input og output.

konklusjonen

Falcon 7B Instruct-modellen er tilgjengelig på SageMaker JumpStart-modellhuben og fungerer på en rekke bruksområder. Dette innlegget demonstrerte hvordan du kan distribuere ditt eget Falcon LLM-endepunkt i miljøet ditt ved å bruke SageMaker JumpStart og gjøre dine første eksperimenter fra SageMaker Studio, slik at du raskt kan prototype modellene dine og sømløs gå over til et produksjonsmiljø. Med Falcon og LangChain kan du effektivt oppsummere langformede helse- og biovitenskapsdokumenter i stor skala.

For mer informasjon om arbeid med generativ AI på AWS, se Annonserer nye verktøy for bygging med generativ AI på AWS. Du kan begynne å eksperimentere og bygge dokumentoppsummeringsbevis for konseptet for dine helse- og livsvitenskapsorienterte GenAI-applikasjoner ved å bruke metoden som er skissert i dette innlegget. Når Amazonas grunnfjell er generelt tilgjengelig, vil vi publisere et oppfølgende innlegg som viser hvordan du kan implementere dokumentoppsummering ved hjelp av Amazon Bedrock og LangChain.

Om forfatterne

John Kitaoka er løsningsarkitekt hos Amazon Web Services. John hjelper kunder med å designe og optimalisere AI/ML-arbeidsbelastninger på AWS for å hjelpe dem med å nå forretningsmålene sine.

John Kitaoka er løsningsarkitekt hos Amazon Web Services. John hjelper kunder med å designe og optimalisere AI/ML-arbeidsbelastninger på AWS for å hjelpe dem med å nå forretningsmålene sine.

Josh Famestad er løsningsarkitekt hos Amazon Web Services. Josh jobber med offentlige kunder for å bygge og utføre skybaserte tilnærminger for å levere på forretningsprioriteringer.

Josh Famestad er løsningsarkitekt hos Amazon Web Services. Josh jobber med offentlige kunder for å bygge og utføre skybaserte tilnærminger for å levere på forretningsprioriteringer.

- SEO-drevet innhold og PR-distribusjon. Bli forsterket i dag.

- PlatoData.Network Vertical Generative Ai. Styrk deg selv. Tilgang her.

- PlatoAiStream. Web3 Intelligence. Kunnskap forsterket. Tilgang her.

- PlatoESG. Karbon, CleanTech, Energi, Miljø, Solenergi, Avfallshåndtering. Tilgang her.

- PlatoHelse. Bioteknologisk og klinisk etterretning. Tilgang her.

- kilde: https://aws.amazon.com/blogs/machine-learning/create-an-hcls-document-summarization-application-with-falcon-using-amazon-sagemaker-jumpstart/

- : har

- :er

- :ikke

- $OPP

- 1

- 10

- 100

- 11

- 12

- 14

- 150

- 16

- 1M

- 20

- 40

- 400

- 50

- 500

- 7

- a

- evne

- ABSTRACT

- godtar

- tilgjengelighet

- tilgjengelig

- Logg inn

- Oppnå

- la til

- vedta

- en gang til

- AI

- AI / ML

- Alle

- tillatt

- tillate

- tillater

- sammen

- allerede

- også

- Amazon

- Amazon SageMaker

- Amazon SageMaker JumpStart

- Amazon Web Services

- an

- analyse

- analytikere

- og

- dyr

- dyr

- Søknad

- søknader

- tilnærming

- tilnærminger

- godkjent

- ER

- rundt

- AS

- At

- attributter

- Automatisk

- tilgjengelig

- unngå

- AWS

- basert

- BE

- fordi

- begynne

- mener

- Milliarder

- biomedisinsk

- kroppen

- pin

- Eske

- Break

- Breaking

- bygge

- Bygning

- bygget

- virksomhet

- men

- by

- ring

- som heter

- CAN

- Kan få

- evner

- evne

- kort

- saken

- saker

- Celler

- kjede

- kjeder

- endring

- Endringer

- valg

- Velg

- velge

- klasse

- klasser

- kunde

- Cloud

- kode

- samarbeids

- kombinere

- kombinere

- Felles

- vanligvis

- sammenlignet

- fullføre

- Terminado

- komplekse

- Omfattet

- konsept

- konsis

- tilkobling

- Konsoll

- inneholde

- innhold

- kostnadseffektiv

- Kostnader

- skape

- skikk

- Kunder

- tilpasning

- dato

- datavitenskap

- tiår

- Misligholde

- definere

- leverer

- demonstrere

- demonstrert

- avhengig

- utplassere

- utplassert

- utplasserings

- distribusjon

- utforming

- utviklere

- utvikle

- Utvikling

- Enheter

- forskjellig

- do

- dokument

- dokumenter

- ikke

- domene

- ikke

- ned

- nedlasting

- hver enkelt

- jord

- effektivt

- muliggjøre

- Endpoint

- Ingeniørarbeid

- Ingeniører

- forbedret

- sikre

- går inn

- Miljø

- feil

- hendelser

- eksempel

- henrette

- forventet

- forventer

- erfaring

- eksperiment

- eksperimenter

- Face

- faktorer

- falsk

- Egenskaper

- Noen få

- filet

- slutt~~POS=TRUNC

- Finn

- Først

- passer

- Fokus

- følge

- etter

- Til

- Fundament

- fire

- fra

- funksjon

- funksjoner

- Dess

- generelt

- generere

- generert

- generative

- Generativ AI

- få

- Mål

- større

- håndtere

- Håndtering

- Ha

- helsetjenester

- hjelpe

- hjelper

- Uthev

- vert

- Hvordan

- Hvordan

- HTML

- HTTPS

- Hub

- ICON

- if

- bilde

- iverksette

- gjennomføring

- importere

- viktig

- in

- inkludere

- inkluderer

- Inkludert

- informasjon

- innovere

- Innovasjon

- inngang

- innganger

- installere

- f.eks

- i stedet

- Institute

- instruksjoner

- integrert

- Intelligent

- interaksjoner

- Interface

- inn

- isolasjon

- IT

- DET ER

- John

- JSON

- bare

- nøkkel

- Språk

- stor

- større

- lansert

- Permisjon

- Bibliotek

- Life

- Life Sciences

- BEGRENSE

- linjer

- lenker

- litteratur

- LLM

- laste

- Lang

- lenger

- ser

- Hoved

- gjøre

- administrer

- overkommelig

- fikk til

- administrerende

- mange

- kartlegging

- maksimal

- Kan..

- medium

- Meny

- metode

- minimal

- ML

- modell

- modeller

- modifisere

- Moduler

- mer

- mest

- mye

- Navigasjon

- nødvendig

- Trenger

- nødvendig

- nettverk

- Ny

- NIH

- normalt

- bærbare

- Legge merke til..

- Antall

- gjenstander

- of

- on

- ONE

- bare

- åpen

- åpen kildekode

- Programvare med åpen kildekode

- Optimalisere

- alternativer

- Annen

- skissert

- produksjon

- enn

- egen

- side

- brød

- Papir

- parameter

- parametere

- bestått

- Utfør

- utfører

- utfører

- Tilpassing

- plato

- Platon Data Intelligence

- PlatonData

- poeng

- Post

- kraftig

- Skrive ut

- utskrifter

- privat

- prosess

- Produkt

- Produksjon

- bevis

- prototype

- gi

- forutsatt

- gir

- forsyning

- offentlig

- publisere

- Python

- kvalitet

- spørsmål

- raskt

- raskt

- lesere

- klar

- virkelige verden

- anbefalinger

- referere

- regulatorer

- relevant

- Krav

- Krever

- forskning

- forskere

- henholdsvis

- svar

- retur

- robotikk

- Kjør

- sagemaker

- SageMaker Inference

- Skala

- Vitenskap

- VITENSKAPER

- forskere

- omfang

- SDK

- sømløst

- seksjoner

- sektor

- sikkerhet

- se

- valgt

- SELV

- sentiment

- Sequence

- tjeneste

- Tjenester

- sett

- innstilling

- Shopping

- Kort

- Vis

- enkelt

- SIX

- So

- Software

- Solutions

- spesifikk

- spesielt

- fart

- Begynn

- startet

- status

- Trinn

- Steps

- lagring

- Strategi

- Streng

- struktur

- studio

- slik

- oppsummere

- SAMMENDRAG

- støtte

- Støtter

- tar

- Oppgave

- oppgaver

- teknikker

- Teknologi

- Teknologiinnovasjon

- tekst

- enn

- Det

- De

- deres

- Dem

- deretter

- Der.

- Disse

- denne

- Gjennom

- til

- sammen

- token

- tokens

- verktøy

- verktøy

- trent

- transformator

- transformere

- overgang

- Trillion

- sant

- SVING

- tutorial

- to

- typen

- undefined

- unik

- unødvendig

- Opplasting

- bruke

- bruk sak

- brukt

- bruker

- ved hjelp av

- variabel

- variasjon

- kjøretøy

- versjoner

- av

- Se

- gå

- walkthrough

- we

- web

- webtjenester

- VI VIL

- Hva

- når

- hvilken

- bred

- vil

- med

- innenfor

- uten

- Arbeid

- arbeidsflyt

- arbeid

- virker

- skrive

- skriving

- Du

- Din

- zephyrnet