Frøene til et maskinlæringsparadigmeskifte (ML) har eksistert i flere tiår, men med lett tilgjengelighet av praktisk talt uendelig datakapasitet, en massiv spredning av data og den raske utviklingen av ML-teknologier, tar kunder på tvers av bransjer raskt i bruk og bruker ML teknologier for å transformere sine virksomheter.

Nylig har generative AI-applikasjoner fanget alles oppmerksomhet og fantasi. Vi er virkelig ved et spennende vendepunkt i den utbredte bruken av ML, og vi tror hver kundeopplevelse og applikasjon vil bli gjenoppfunnet med generativ AI.

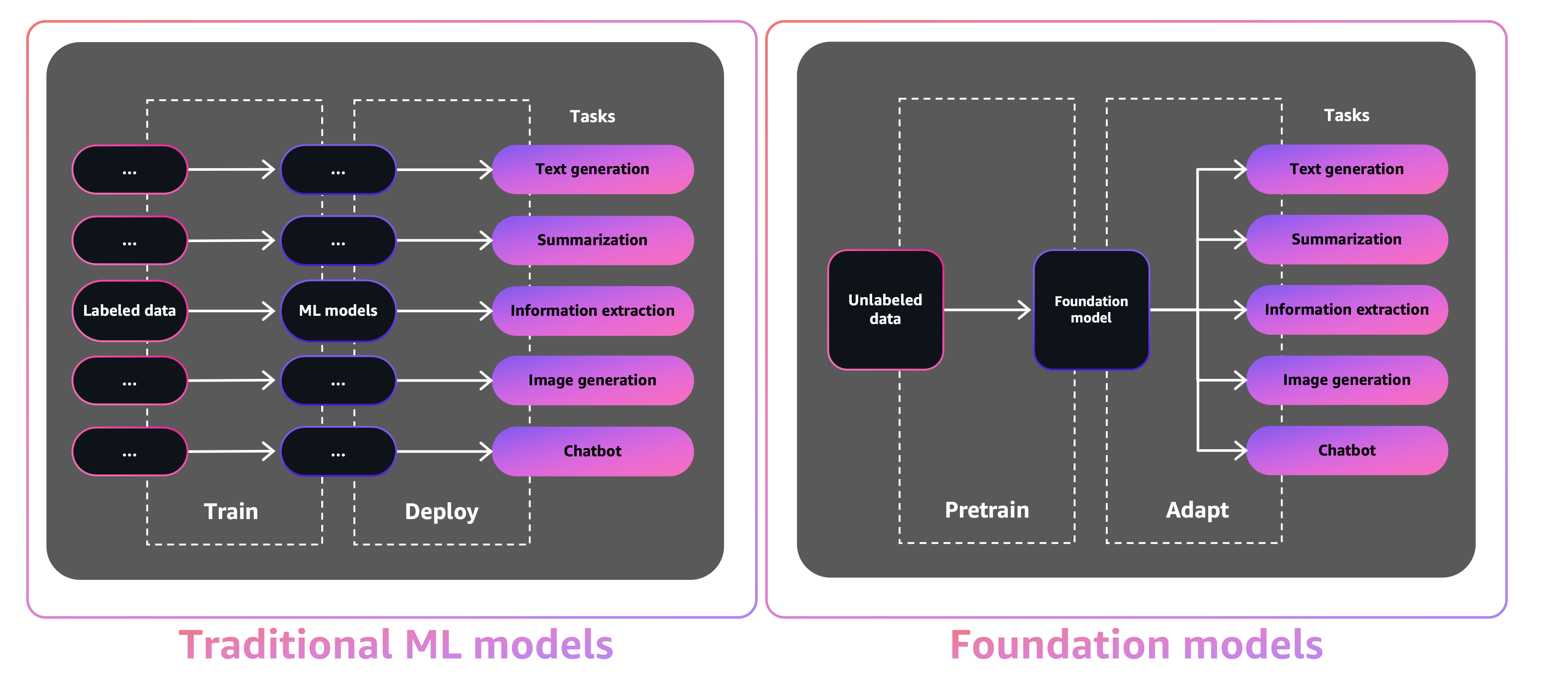

Generativ AI er en type AI som kan skape nytt innhold og ideer, inkludert samtaler, historier, bilder, videoer og musikk. Som all AI, er generativ AI drevet av ML-modeller – veldig store modeller som er forhåndsopplært på store datakorpora og ofte referert til som grunnmodeller (FM).

Størrelsen og den generelle karakteren til FM-er gjør dem forskjellige fra tradisjonelle ML-modeller, som vanligvis utfører spesifikke oppgaver, som å analysere tekst for følelser, klassifisere bilder og forutsi trender.

Med tradisjonelle ML-modeller, for å oppnå hver spesifikk oppgave, må du samle merkede data, trene en modell og distribuere den modellen. Med grunnmodeller, i stedet for å samle merkede data for hver modell og trene flere modeller, kan du bruke den samme forhåndstrente FM til å tilpasse ulike oppgaver. Du kan også tilpasse FM-er for å utføre domenespesifikke funksjoner som er differensierende for virksomhetene dine, ved å bruke bare en liten brøkdel av dataene og beregningen som kreves for å trene en modell fra bunnen av.

Generativ AI har potensial til å forstyrre mange bransjer ved å revolusjonere måten innhold skapes og konsumeres på. Produksjon av originalt innhold, kodegenerering, forbedring av kundeservice og dokumentoppsummering er typiske brukstilfeller av generativ AI.

Amazon SageMaker JumpStart gir forhåndsopplærte, åpen kildekode-modeller for et bredt spekter av problemtyper for å hjelpe deg med å komme i gang med ML. Du kan trinnvis trene og justere disse modellene før utrulling. JumpStart tilbyr også løsningsmaler som setter opp infrastruktur for vanlige brukstilfeller, og kjørbare eksempelnotatbøker for ML med Amazon SageMaker.

Med over 600 forhåndstrente modeller tilgjengelig og vokser hver dag, lar JumpStart utviklere raskt og enkelt inkorporere banebrytende ML-teknikker i produksjonsarbeidsflytene deres. Du kan få tilgang til de forhåndstrente modellene, løsningsmalene og eksemplene via JumpStart-landingssiden i Amazon SageMaker Studio. Du kan også få tilgang til JumpStart-modeller ved å bruke SageMaker Python SDK. For informasjon om hvordan du bruker JumpStart-modeller programmatisk, se Bruk SageMaker JumpStart-algoritmer med forhåndstrente modeller.

I april 2023 ble AWS avduket Amazonas grunnfjell, som gir en måte å bygge generative AI-drevne apper via forhåndstrente modeller fra oppstart, inkludert AI21 Labs, Antropiskog Stabilitet AI. Amazon Bedrock tilbyr også tilgang til Titan Foundation-modeller, en familie av modeller som er opplært internt av AWS. Med den serverløse opplevelsen til Amazon Bedrock kan du enkelt finne den riktige modellen for dine behov, komme raskt i gang, tilpasse FM-er privat med dine egne data, og enkelt integrere og distribuere dem i applikasjonene dine ved å bruke AWS-verktøyene og -funksjonene du er kjent med med (inkludert integrasjoner med SageMaker ML-funksjoner som Amazon SageMaker-eksperimenter å teste ulike modeller og Amazon SageMaker-rørledninger å administrere FM-ene dine i stor skala) uten å måtte administrere noen infrastruktur.

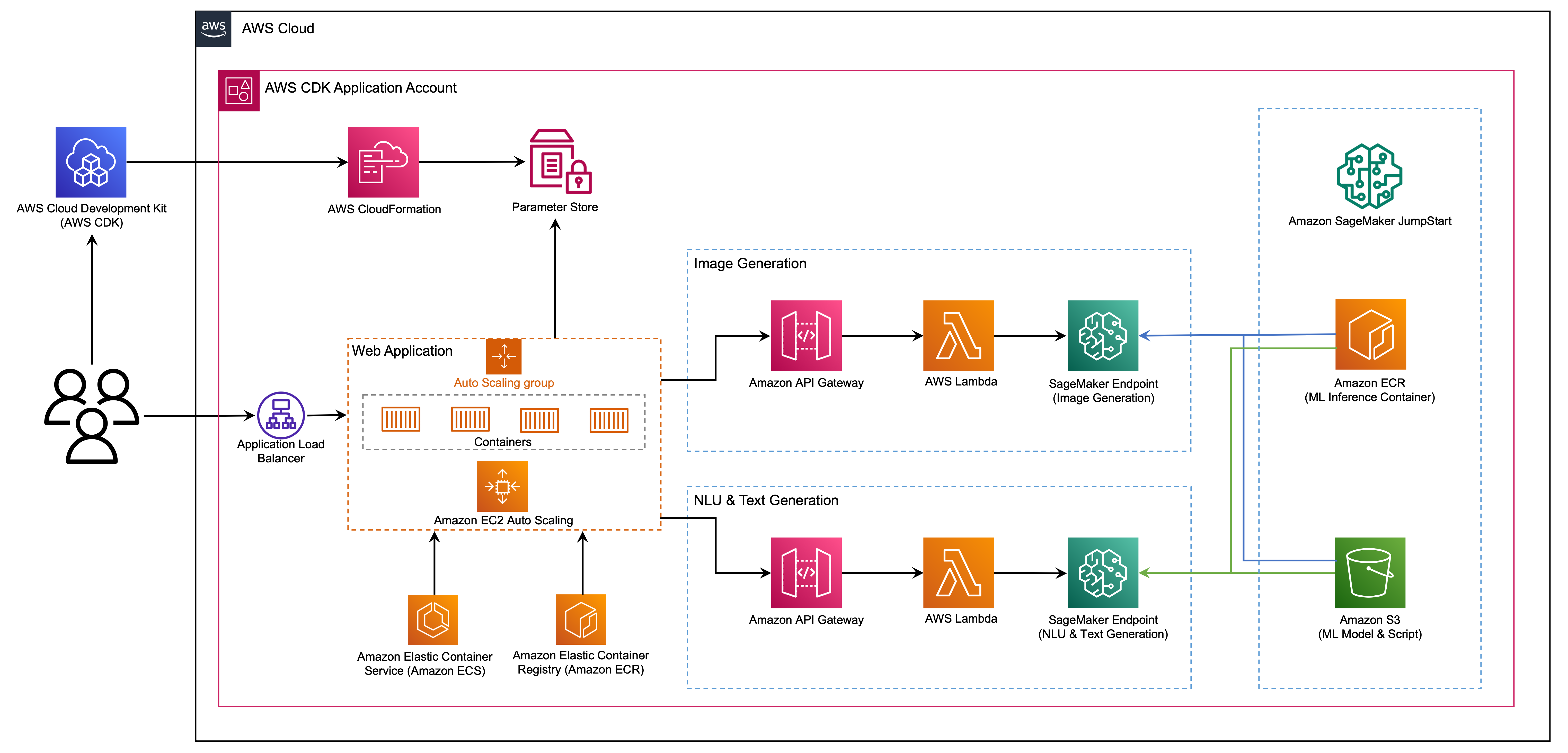

I dette innlegget viser vi hvordan du distribuerer bilde- og tekstgenerative AI-modeller fra JumpStart ved å bruke AWS skyutviklingssett (AWS CDK). AWS CDK er et rammeverk for programvareutvikling med åpen kildekode for å definere skyapplikasjonsressursene dine ved å bruke kjente programmeringsspråk som Python.

Vi bruker Stable Diffusion-modellen for bildegenerering og FLAN-T5-XL-modellen for naturlig språkforståelse (NLU) og tekstgenerering fra Klemme ansiktet i JumpStart.

Løsningsoversikt

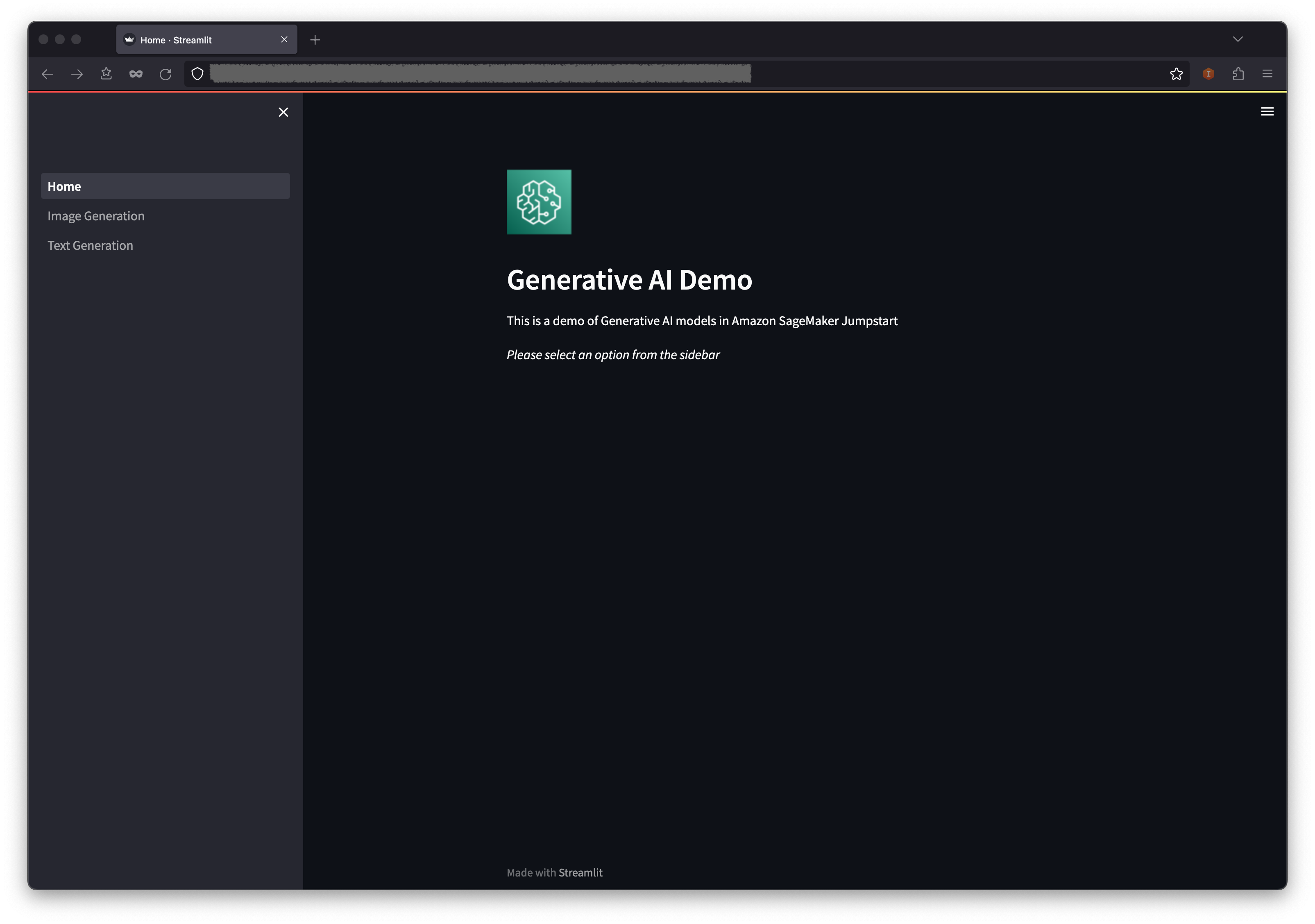

Nettapplikasjonen er bygget på Strømbelyst, et åpen kildekode Python-bibliotek som gjør det enkelt å lage og dele vakre, tilpassede nettapper for ML og datavitenskap. Vi hoster webapplikasjonen ved hjelp av Amazon Elastic Container Service (Amazon ECS) med AWS Fargate og den er tilgjengelig via en Application Load Balancer. Fargate er en teknologi som du kan bruke med Amazon ECS til å kjøre containere uten å måtte administrere servere eller klynger eller virtuelle maskiner. De generative AI-modellendepunktene lanseres fra JumpStart-bilder i Amazon Elastic Container Registry (Amazon ECR). Modelldata lagres på Amazon enkel lagringstjeneste (Amazon S3) i JumpStart-kontoen. Nettapplikasjonen samhandler med modellene via Amazon API-gateway og AWS Lambda fungerer som vist i følgende diagram.

API Gateway gir webapplikasjonen og andre klienter et standard RESTful-grensesnitt, samtidig som de skjermer Lambda-funksjonene som har grensesnitt med modellen. Dette forenkler klientapplikasjonskoden som bruker modellene. API Gateway-endepunktene er offentlig tilgjengelige i dette eksemplet, noe som gir mulighet for å utvide denne arkitekturen til å implementere forskjellige API-tilgangskontroller og integrere med andre applikasjoner.

I dette innlegget leder vi deg gjennom følgende trinn:

- Installer AWS kommandolinjegrensesnitt (AWS CLI) og AWS CDK v2 på din lokale maskin.

- Klon og sett opp AWS CDK-applikasjonen.

- Distribuer AWS CDK-applikasjonen.

- Bruk bildegenererings-AI-modellen.

- Bruk AI-modellen for tekstgenerering.

- Se de distribuerte ressursene på AWS-administrasjonskonsoll.

Vi gir en oversikt over koden i dette prosjektet i vedlegget på slutten av dette innlegget.

Forutsetninger

Du må ha følgende forutsetninger:

Du kan distribuere infrastrukturen i denne opplæringen fra din lokale datamaskin, eller du kan bruke AWS Cloud9 som din distribusjonsarbeidsstasjon. AWS Cloud9 kommer forhåndslastet med AWS CLI, AWS CDK og Docker. Hvis du velger AWS Cloud9, skape miljøet fra AWS-konsoll.

Den estimerte kostnaden for å fullføre dette innlegget er $50, forutsatt at du lar ressursene kjøre i 8 timer. Sørg for at du sletter ressursene du oppretter i dette innlegget for å unngå pågående belastninger.

Installer AWS CLI og AWS CDK på din lokale maskin

Hvis du ikke allerede har AWS CLI på din lokale maskin, se Installere eller oppdatere den nyeste versjonen av AWS CLI og Konfigurering av AWS CLI.

Installer AWS CDK Toolkit globalt ved å bruke følgende nodepakkebehandlingskommando:

Kjør følgende kommando for å bekrefte riktig installasjon og skriv ut versjonsnummeret til AWS CDK:

Sørg for at du har Docker installert på din lokale maskin. Utfør følgende kommando for å bekrefte versjonen:

Klon og sett opp AWS CDK-applikasjonen

På din lokale maskin, klone AWS CDK-applikasjonen med følgende kommando:

Naviger til prosjektmappen:

Før vi distribuerer applikasjonen, la oss gå gjennom katalogstrukturen:

De stack mappen inneholder koden for hver stabel i AWS CDK-applikasjonen. De code mappen inneholder koden for Lambda-funksjonene. Depotet inneholder også nettapplikasjonen som ligger under mappen web-app.

De cdk.json filen forteller AWS CDK Toolkit hvordan programmet skal kjøres.

Denne applikasjonen ble testet i us-east-1 Region, men den skal fungere i enhver region som har de nødvendige tjenestene og inferensforekomsttypen ml.g4dn.4xlarge spesifisert i app.py.

Sett opp et virtuelt miljø

Dette prosjektet er satt opp som et standard Python-prosjekt. Lag et virtuelt Python-miljø ved å bruke følgende kode:

Bruk følgende kommando for å aktivere det virtuelle miljøet:

Hvis du er på en Windows-plattform, aktiverer du det virtuelle miljøet som følger:

Etter at det virtuelle miljøet er aktivert, oppgrader pip til den nyeste versjonen:

Installer de nødvendige avhengighetene:

Før du distribuerer en AWS CDK-applikasjon, må du starte opp en plass i kontoen din og regionen du distribuerer til. For å starte opp i standardregionen din, utfør følgende kommando:

Hvis du vil distribuere til en bestemt konto og region, utfør følgende kommando:

For mer informasjon om dette oppsettet, besøk Komme i gang med AWS CDK.

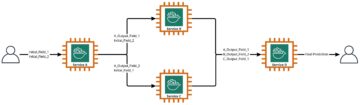

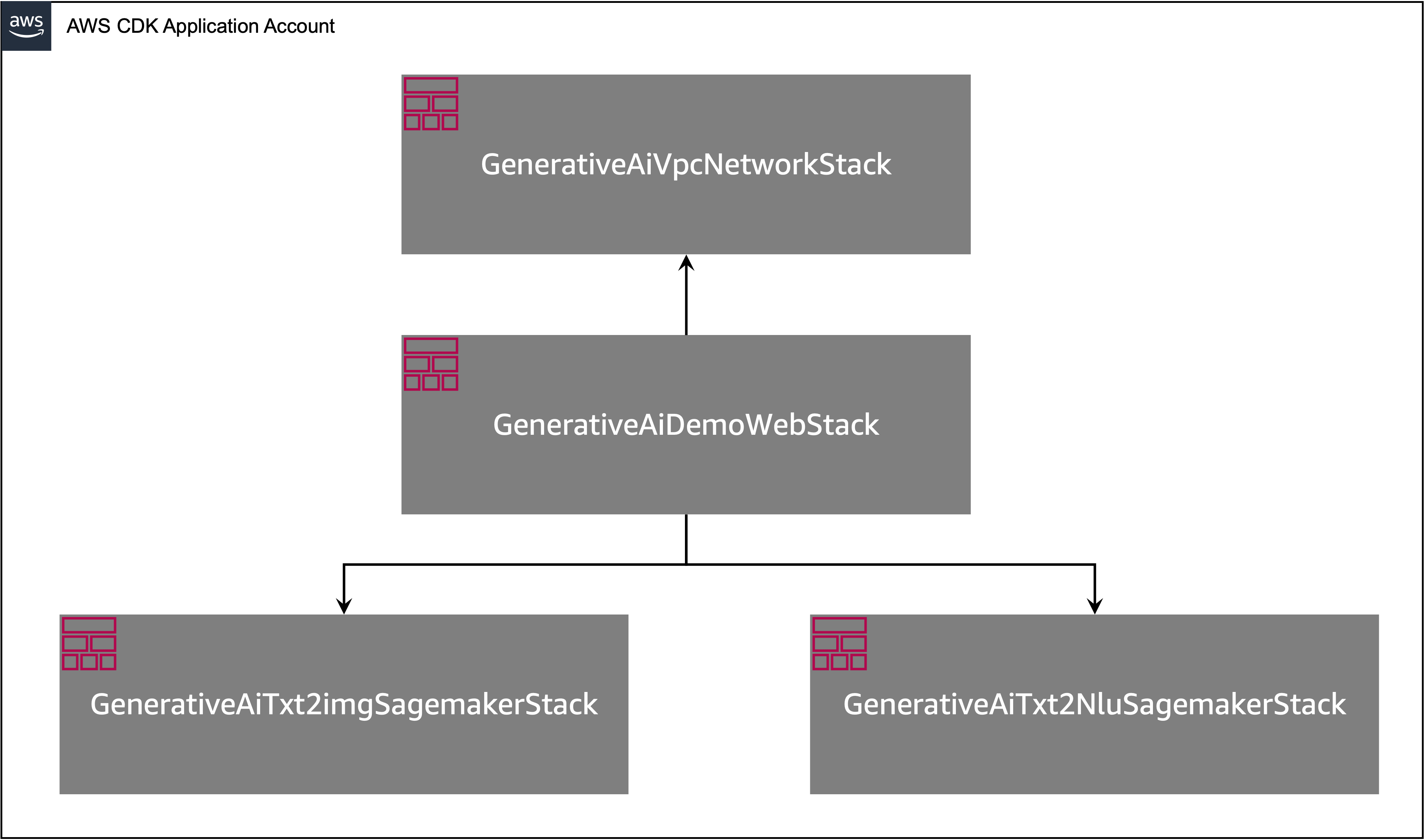

AWS CDK-applikasjonsstabelstruktur

AWS CDK-applikasjonen inneholder flere stabler, som vist i følgende diagram.

Du kan liste stablene i AWS CDK-applikasjonen din med følgende kommando:

Følgende er andre nyttige AWS CDK-kommandoer:

- cdk ls – Viser alle stabler i appen

- cdk synth – Avgir det syntetiserte AWS skyformasjon mal

- cdk distribuere – Distribuerer denne stabelen til din standard AWS-konto og region

- cdk diff – Sammenligner den utplasserte stabelen med gjeldende tilstand

- cdk dokumenter – Åpner AWS CDK-dokumentasjonen

Den neste delen viser deg hvordan du distribuerer AWS CDK-applikasjonen.

Distribuer AWS CDK-applikasjonen

AWS CDK-applikasjonen vil bli distribuert til standardregionen basert på arbeidsstasjonskonfigurasjonen. Hvis du vil tvinge utplasseringen i en bestemt region, angir du AWS_DEFAULT_REGION miljøvariabel tilsvarende.

På dette tidspunktet kan du distribuere AWS CDK-applikasjonen. Først starter du VPC-nettverksstakken:

Hvis du blir bedt om det, skriv inn y for å fortsette med utplasseringen. Du bør se en liste over AWS-ressurser som klargjøres i stabelen. Dette trinnet tar rundt 3 minutter å fullføre.

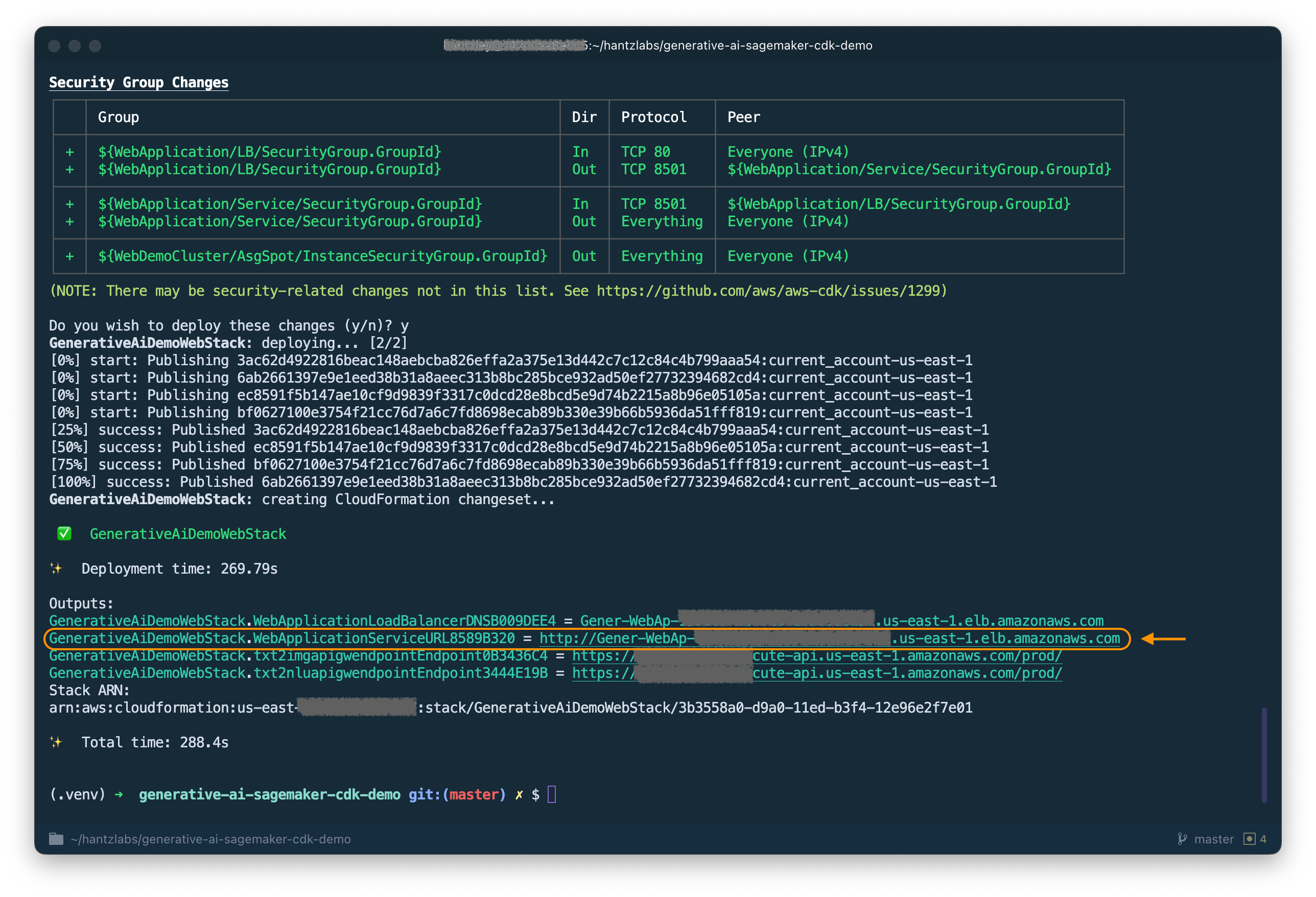

Deretter starter du nettapplikasjonsstabelen:

Etter å ha analysert stabelen, vil AWS CDK vise ressurslisten i stabelen. Skriv inn y for å fortsette med distribusjonen. Dette trinnet tar rundt 5 minutter.

Noter ned WebApplicationServiceURL fra utgangen til bruk senere. Du kan også hente den på AWS CloudFormation-konsollen, under GenerativeAiDemoWebStack stable utganger.

Nå, lanser bildegenererings AI-modellens endepunktstabel:

Dette trinnet tar rundt 8 minutter. Bildegenereringsmodellens endepunkt er distribuert, vi kan nå bruke det.

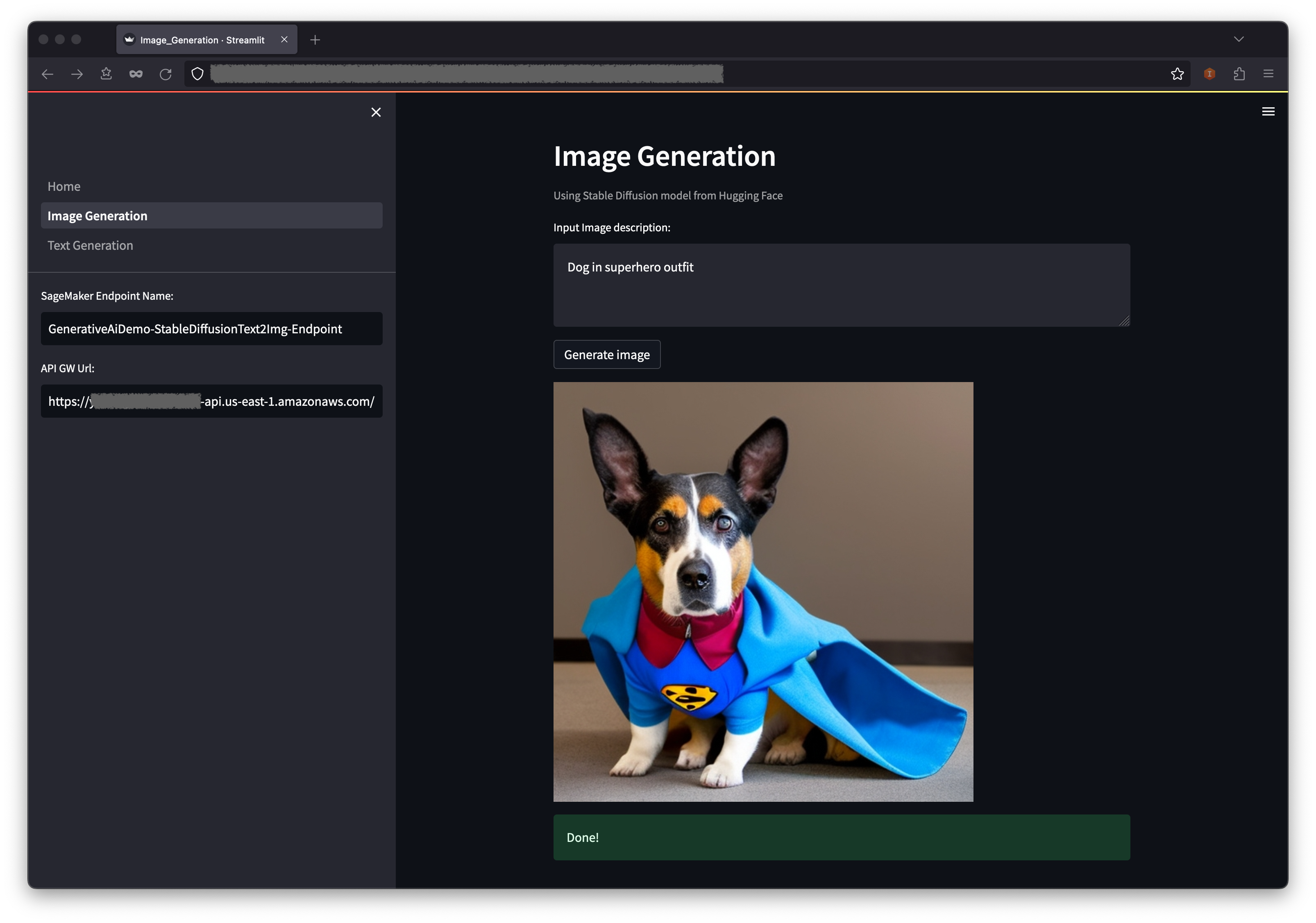

Bruk bildegenererings-AI-modellen

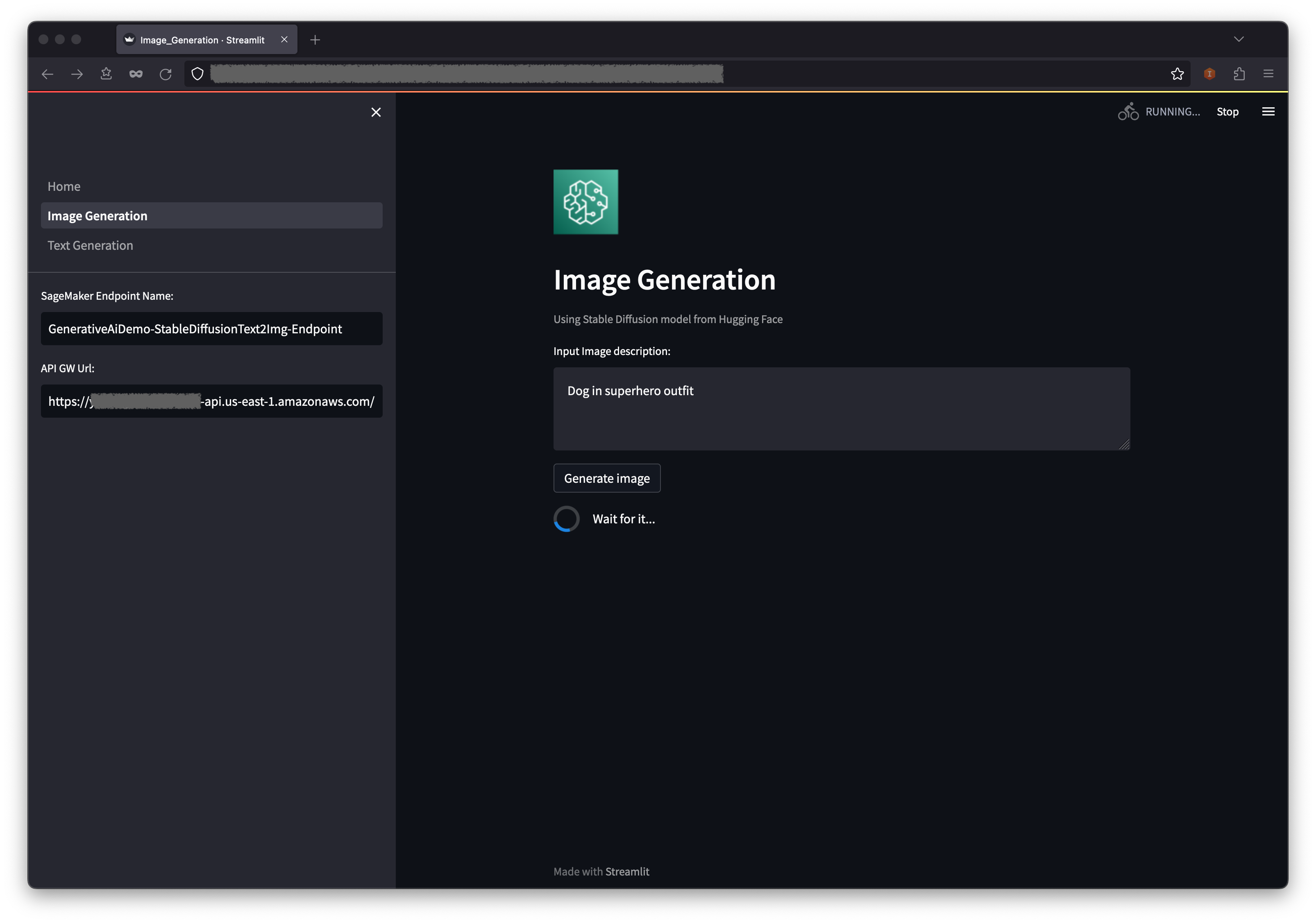

Det første eksemplet viser hvordan man bruker Stable Diffusion, en kraftig generativ modelleringsteknikk som gjør det mulig å lage bilder av høy kvalitet fra tekstmeldinger.

- Få tilgang til nettapplikasjonen ved å bruke

WebApplicationServiceURLfra utgangen avGenerativeAiDemoWebStacki nettleseren din.

- Velg i navigasjonsruten Bildegenerering.

- De SageMaker endepunktnavn og API GW URL feltene vil være forhåndsutfylt, men du kan endre forespørselen for bildebeskrivelsen hvis du vil.

- Velg Generer bilde.

- Applikasjonen vil ringe til SageMaker-endepunktet. Det tar noen sekunder. Et bilde med egenskapene i bildebeskrivelsen din vil vises.

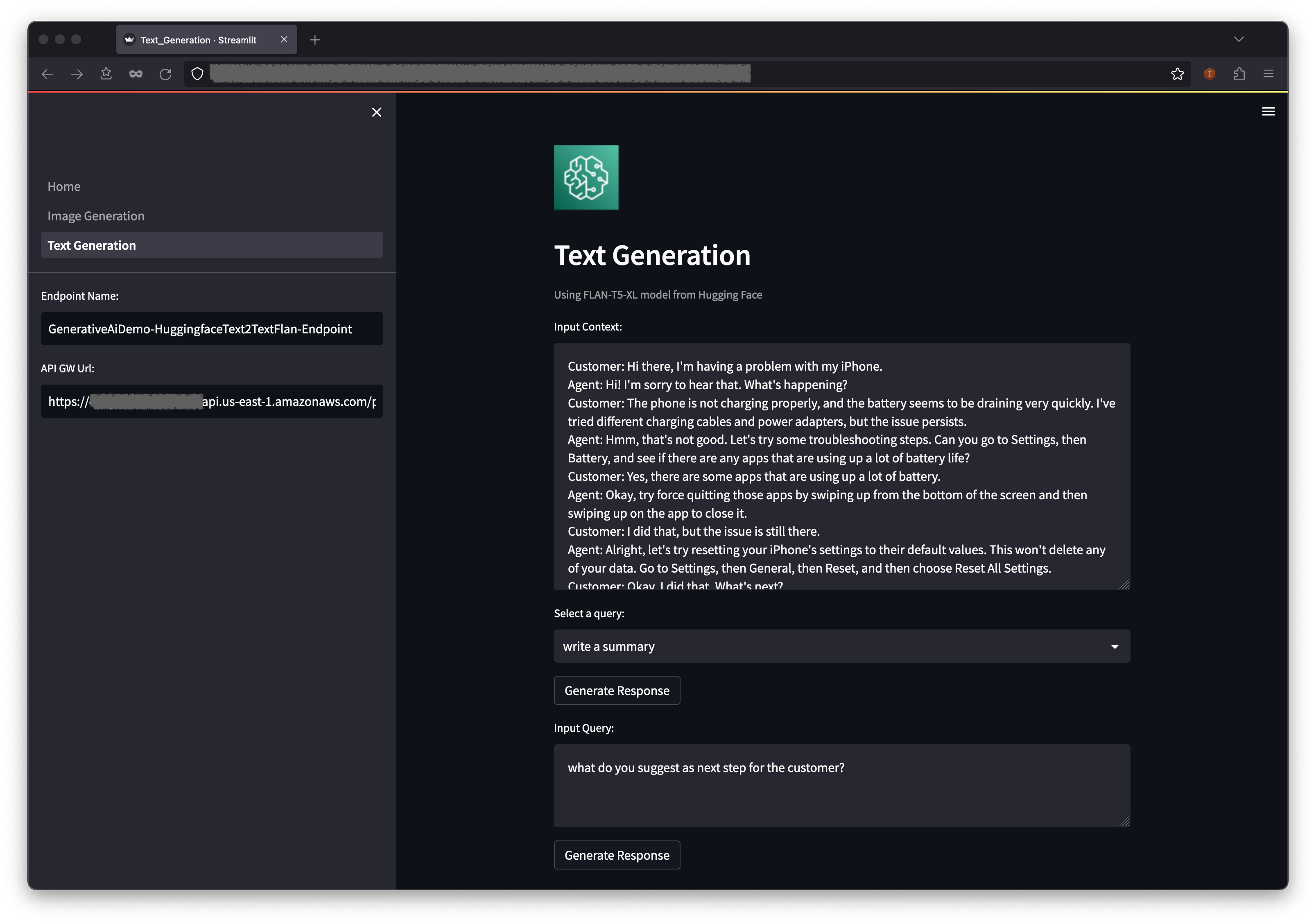

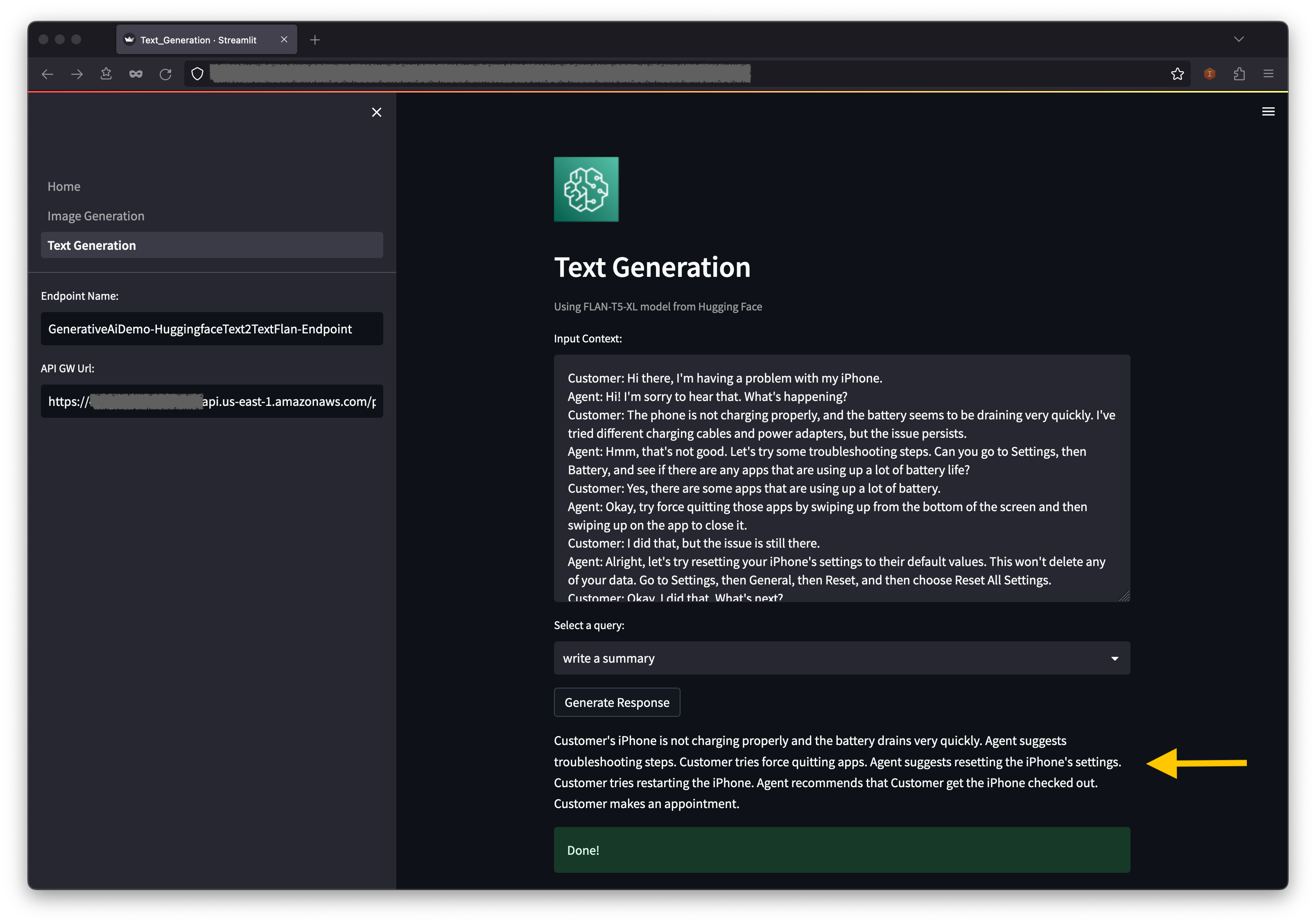

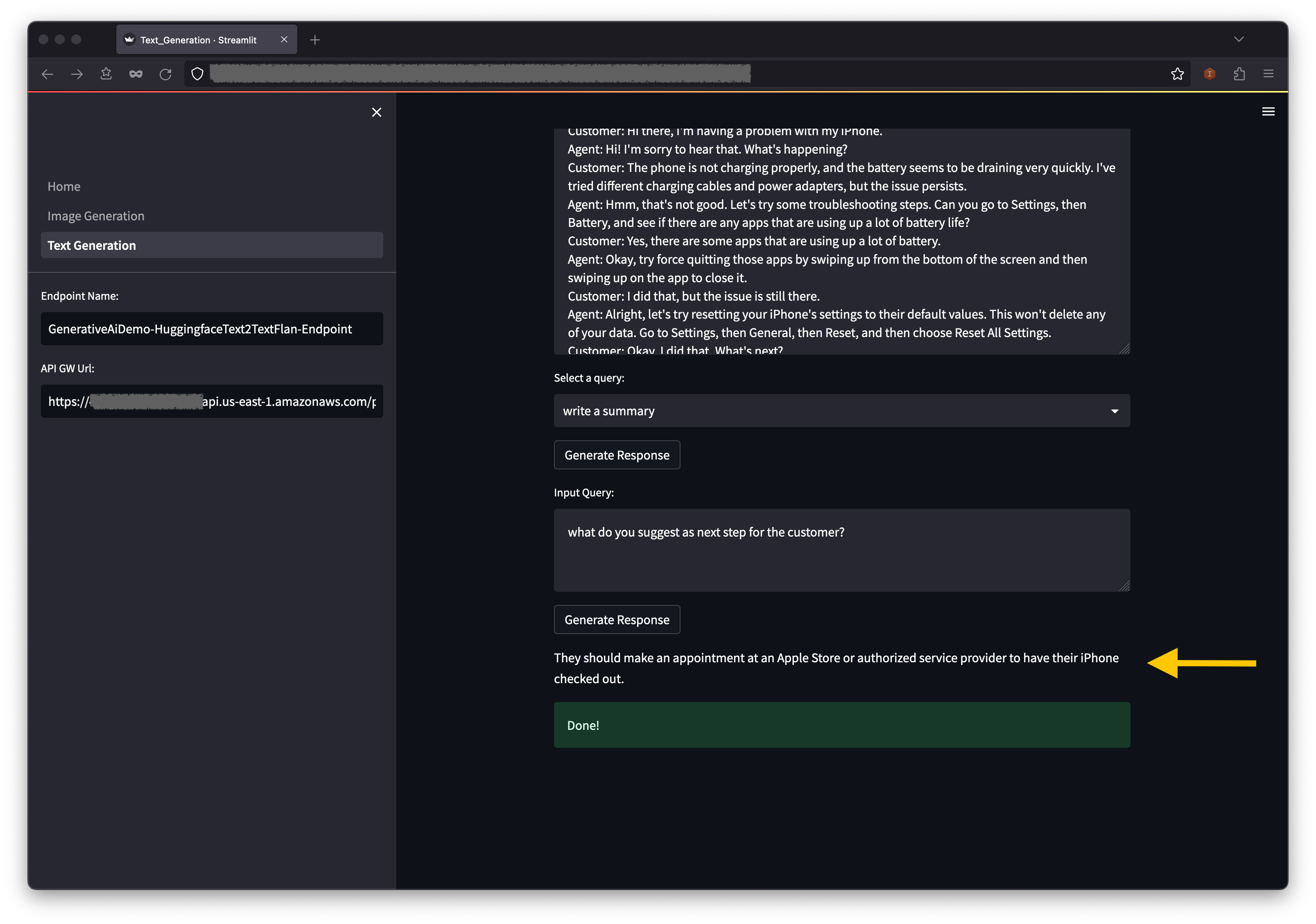

Bruk AI-modellen for tekstgenerering

Det andre eksemplet dreier seg om bruk av FLAN-T5-XL-modellen, som er en grunnleggende eller stor språkmodell (LLM), for å oppnå kontekstlæring for tekstgenerering, samtidig som den adresserer et bredt spekter av naturlig språkforståelse (NLU) og naturlig språkgenereringsoppgaver (NLG).

Noen miljøer kan begrense antallet endepunkter du kan starte om gangen. Hvis dette er tilfelle, kan du starte ett SageMaker-endepunkt om gangen. For å stoppe et SageMaker-endepunkt i AWS CDK-appen, må du ødelegge den utplasserte endepunktstabelen og før du starter den andre endepunktstabelen. For å skru ned endepunktet for bildegenerering AI-modellen, utfør følgende kommando:

Start deretter tekstgenererings AI-modellens endepunktstabel:

Skriv inn y ved ledeteksten.

Etter at tekstgenereringsmodellens endepunktstabel er lansert, fullfør følgende trinn:

- Gå tilbake til nettapplikasjonen og velg Tekstgenerering i navigasjonsruten.

- De Inndatakontekst feltet er forhåndsutfylt med en samtale mellom en kunde og en agent angående et problem med kundens telefon, men du kan angi din egen kontekst hvis du vil.

- Under konteksten finner du noen forhåndsutfylte søk på rullegardinmenyen. Velg et søk og velg Generer respons.

- Du kan også legge inn ditt eget søk i Inngangsspørring felt og velg deretter Generer respons.

Se de distribuerte ressursene på konsollen

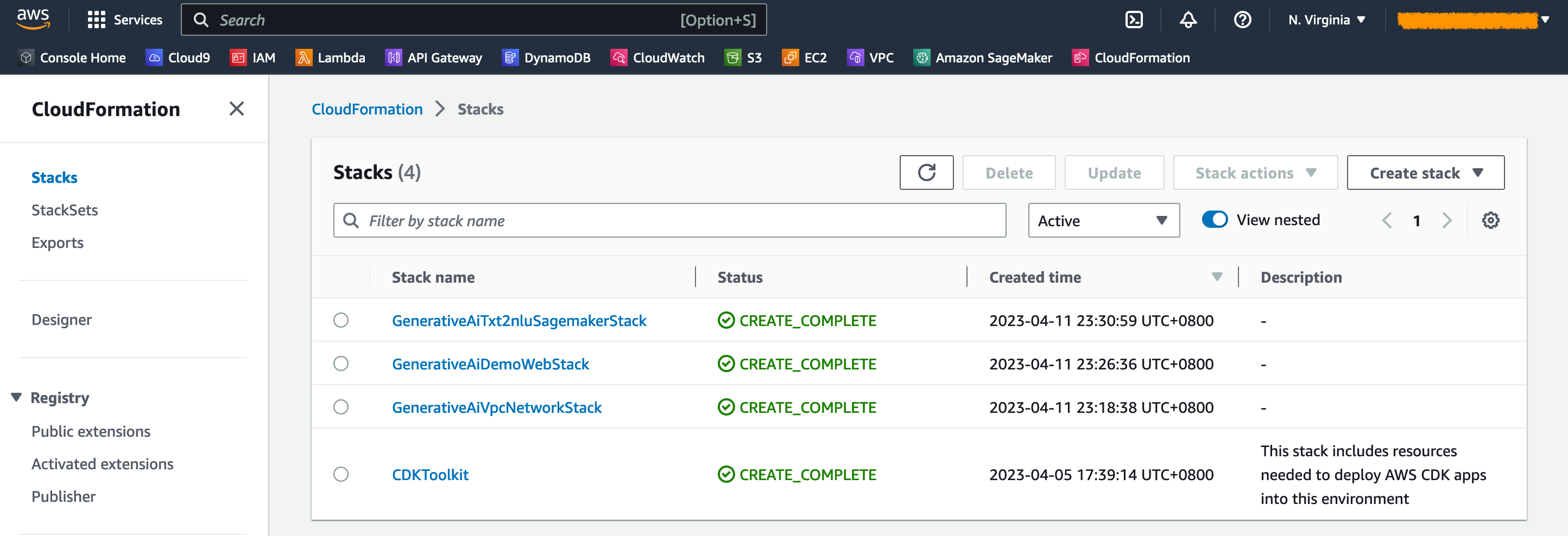

Velg på AWS CloudFormation-konsollen Stabler i navigasjonsruten for å se stablene som er distribuert.

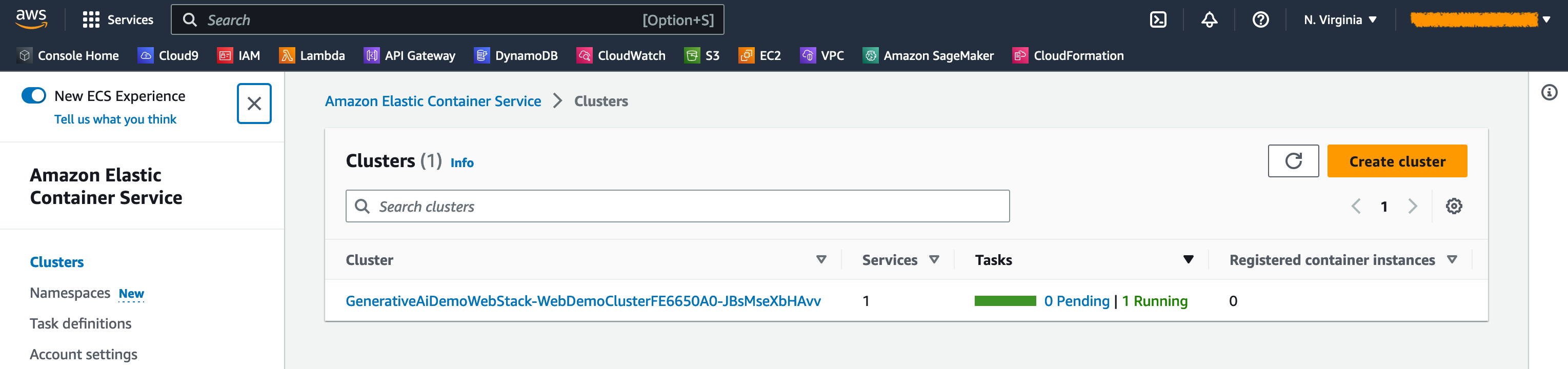

På Amazon ECS-konsollen kan du se klyngene på klynger side.

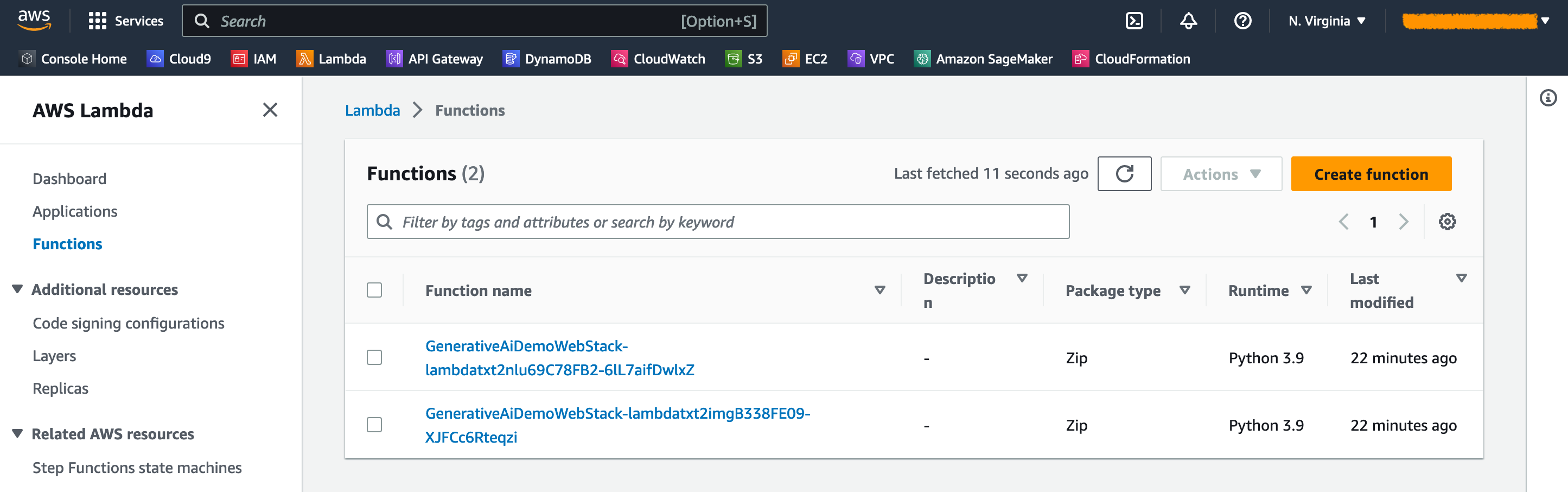

På AWS Lambda-konsollen kan du se funksjonene på Funksjoner side.

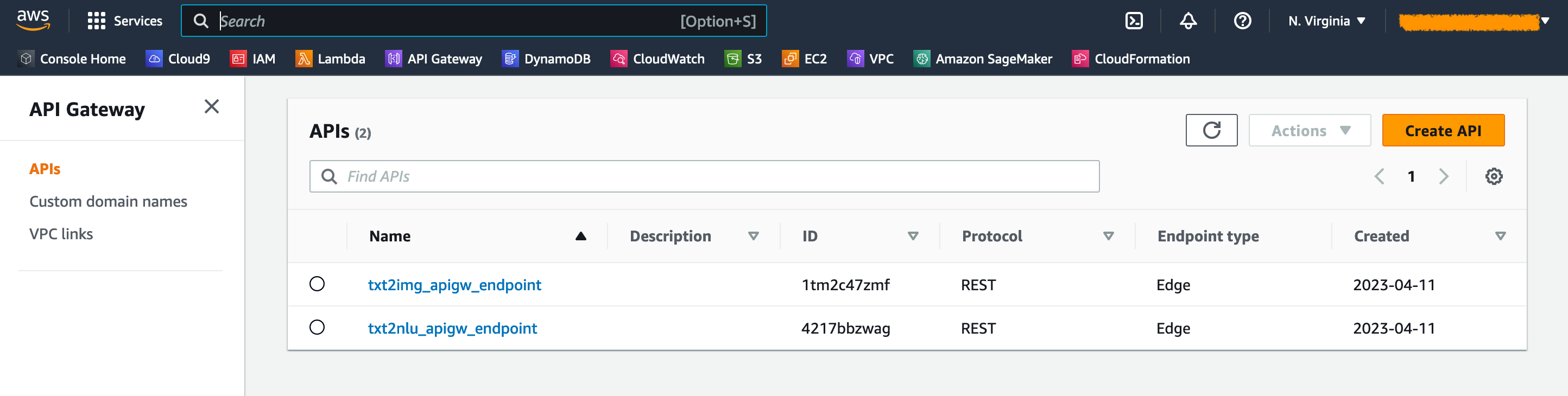

På API Gateway-konsollen kan du se API Gateway-endepunktene på APIer side.

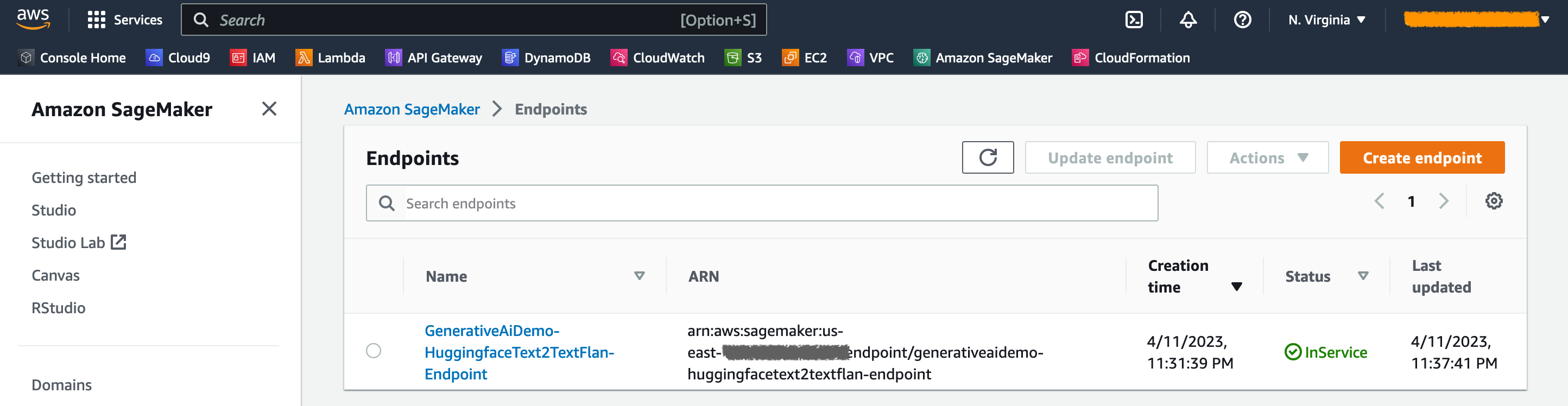

På SageMaker-konsollen kan du se de utplasserte modellendepunktene på endepunkter side.

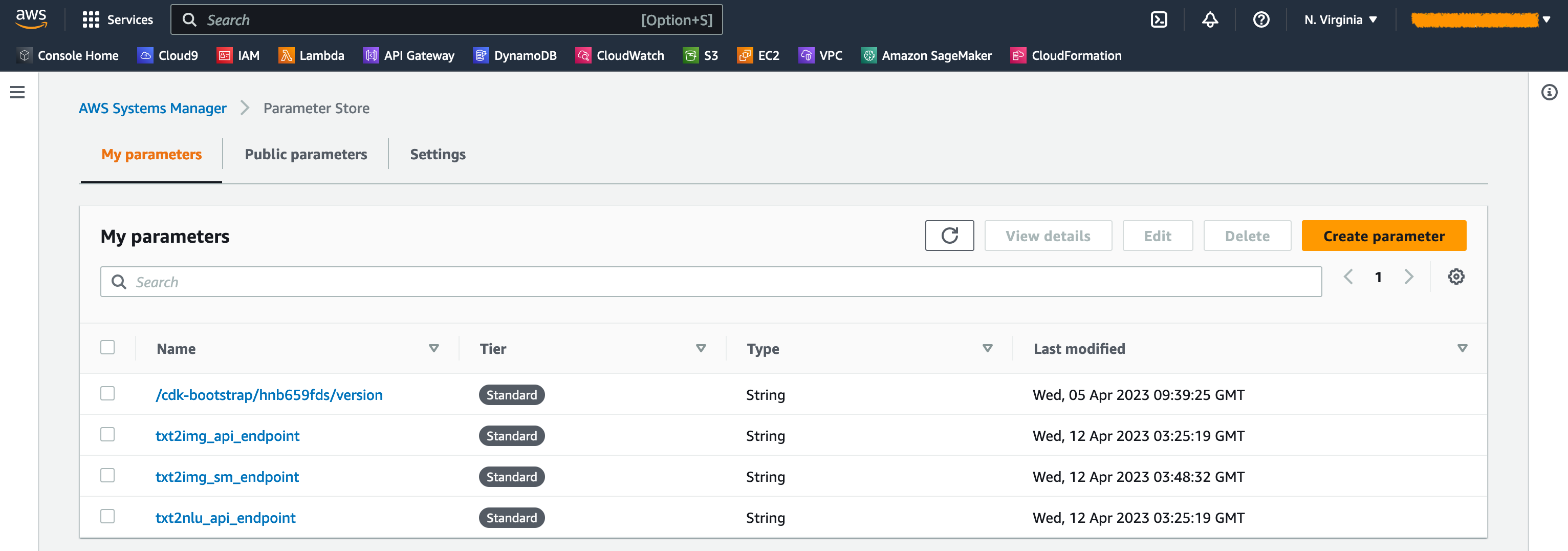

Når stablene er lansert, genereres noen parametere. Disse lagres i AWS Systems Manager Parameter Store. For å se dem, velg Parameterlager i navigasjonsruten på AWS systemansvarlig konsollen.

Rydd opp

For å unngå unødvendige kostnader, ryd opp i all infrastrukturen som er opprettet med følgende kommando på arbeidsstasjonen:

Enter y ved ledeteksten. Dette trinnet tar rundt 10 minutter. Sjekk om alle ressursene er slettet på konsollen. Slett også aktiva S3-bøttene opprettet av AWS CDK på Amazon S3-konsollen, samt aktivalagrene på Amazon ECR.

konklusjonen

Som vist i dette innlegget, kan du bruke AWS CDK til å distribuere generative AI-modeller i JumpStart. Vi viste et bildegenereringseksempel og et tekstgenereringseksempel ved bruk av et brukergrensesnitt drevet av Streamlit, Lambda og API Gateway.

Du kan nå bygge dine generative AI-prosjekter ved å bruke forhåndstrente AI-modeller i JumpStart. Du kan også utvide dette prosjektet for å finjustere grunnmodellene for bruksområdet ditt og kontrollere tilgangen til API Gateway-endepunkter.

Vi inviterer deg til å teste løsningen og bidra til prosjektet på GitHub. Del tankene dine om denne opplæringen i kommentarfeltet!

Lisenssammendrag

Denne prøvekoden er gjort tilgjengelig under en modifisert MIT-lisens. Se LISENS fil for mer informasjon. Se også gjennom de respektive lisensene for stabil diffusjon og flan-t5-xl modeller på Hugging Face.

Om forfatterne

Hantzley Tauckoor er en APJ Partner Solutions Architecture Leader basert i Singapore. Han har 20 års erfaring i IKT-bransjen som spenner over flere funksjonsområder, inkludert løsningsarkitektur, forretningsutvikling, salgsstrategi, rådgivning og ledelse. Han leder et team av Senior Solutions Architects som gjør det mulig for partnere å utvikle felles løsninger, bygge tekniske kapasiteter og styre dem gjennom implementeringsfasen når kundene migrerer og moderniserer applikasjonene sine til AWS.

Hantzley Tauckoor er en APJ Partner Solutions Architecture Leader basert i Singapore. Han har 20 års erfaring i IKT-bransjen som spenner over flere funksjonsområder, inkludert løsningsarkitektur, forretningsutvikling, salgsstrategi, rådgivning og ledelse. Han leder et team av Senior Solutions Architects som gjør det mulig for partnere å utvikle felles løsninger, bygge tekniske kapasiteter og styre dem gjennom implementeringsfasen når kundene migrerer og moderniserer applikasjonene sine til AWS.

Kwonyul Choi er en CTO hos BABITALK, en koreansk oppstart av skjønnhetspleieplattform, basert i Seoul. Før denne rollen jobbet Kownyul som Software Development Engineer hos AWS med fokus på AWS CDK og Amazon SageMaker.

Kwonyul Choi er en CTO hos BABITALK, en koreansk oppstart av skjønnhetspleieplattform, basert i Seoul. Før denne rollen jobbet Kownyul som Software Development Engineer hos AWS med fokus på AWS CDK og Amazon SageMaker.

Arunprasath Shankar er en senior AI/ML-spesialistløsningsarkitekt med AWS, og hjelper globale kunder med å skalere AI-løsningene sine effektivt og effektivt i skyen. På fritiden liker Arun å se sci-fi-filmer og høre på klassisk musikk.

Arunprasath Shankar er en senior AI/ML-spesialistløsningsarkitekt med AWS, og hjelper globale kunder med å skalere AI-løsningene sine effektivt og effektivt i skyen. På fritiden liker Arun å se sci-fi-filmer og høre på klassisk musikk.

Satish Upreti er en Migration Lead PSA og Security SME i partnerorganisasjonen i APJ. Satish har 20 års erfaring innen private sky- og offentlige skyteknologier på stedet. Siden han begynte i AWS i august 2020 som migrasjonsspesialist, gir han omfattende teknisk rådgivning og støtte til AWS-partnere for å planlegge og implementere komplekse migrasjoner.

Satish Upreti er en Migration Lead PSA og Security SME i partnerorganisasjonen i APJ. Satish har 20 års erfaring innen private sky- og offentlige skyteknologier på stedet. Siden han begynte i AWS i august 2020 som migrasjonsspesialist, gir han omfattende teknisk rådgivning og støtte til AWS-partnere for å planlegge og implementere komplekse migrasjoner.

Vedlegg: Kodegjennomgang

I denne delen gir vi en oversikt over koden i dette prosjektet.

AWS CDK-applikasjon

Hoved-AWS CDK-applikasjonen er inneholdt i app.py filen i rotkatalogen. Prosjektet består av flere stabler, så vi må importere stabler:

Vi definerer våre generative AI-modeller og får de relaterte URIene fra SageMaker:

Funksjonen get_sagemaker_uris henter all modellinformasjon fra JumpStart. Se script/sagemaker_uri.py.

Deretter instansierer vi stablene:

Den første stabelen som lanseres er VPC-stakken, GenerativeAiVpcNetworkStack. Nettapplikasjonsstakken, GenerativeAiDemoWebStack, er avhengig av VPC-stakken. Avhengigheten gjøres gjennom parameter overføring vpc=network_stack.vpc.

Se app.py for hele koden.

VPC nettverksstabel

I GenerativeAiVpcNetworkStack-stakken oppretter vi en VPC med et offentlig undernett og et privat undernett som spenner over to tilgjengelighetssoner:

Se /stack/generative_ai_vpc_network_stack.py for hele koden.

Demo webapplikasjonsstabel

I GenerativeAiDemoWebStack-stakken lanserer vi Lambda-funksjoner og respektive API Gateway-endepunkter som nettapplikasjonen samhandler med SageMaker-modellens endepunkter. Se følgende kodebit:

Nettapplikasjonen er containerisert og vert på Amazon ECS med Fargate. Se følgende kodebit:

Se /stack/generative_ai_demo_web_stack.py for hele koden.

Bildegenerering SageMaker modell endepunktstabel

GenerativeAiTxt2imgSagemakerStack-stakken oppretter bildegenereringsmodellens endepunkt fra JumpStart og lagrer endepunktnavnet i Systems Manager Parameter Store. Denne parameteren vil bli brukt av webapplikasjonen. Se følgende kode:

Se /stack/generative_ai_txt2img_sagemaker_stack.py for hele koden.

NLU og tekstgenerering SageMaker modell endepunktstabel

GenerativeAiTxt2nluSagemakerStack-stakken oppretter NLU- og tekstgenereringsmodellendepunktet fra JumpStart og lagrer endepunktnavnet i Systems Manager Parameter Store. Denne parameteren vil også bli brukt av webapplikasjonen. Se følgende kode:

Se /stack/generative_ai_txt2nlu_sagemaker_stack.py for hele koden.

Webapplikasjon

Nettapplikasjonen ligger i /web-app katalog. Det er en Streamlit-applikasjon som er containerisert i henhold til Dockerfile:

For å lære mer om Streamlit, se Strømbelyst dokumentasjon.

- SEO-drevet innhold og PR-distribusjon. Bli forsterket i dag.

- PlatoAiStream. Web3 Data Intelligence. Kunnskap forsterket. Tilgang her.

- Minting the Future med Adryenn Ashley. Tilgang her.

- Kjøp og selg aksjer i PRE-IPO-selskaper med PREIPO®. Tilgang her.

- kilde: https://aws.amazon.com/blogs/machine-learning/deploy-generative-ai-models-from-amazon-sagemaker-jumpstart-using-the-aws-cdk/

- : har

- :er

- $OPP

- 1

- 10

- 100

- 20

- 20 år

- 2020

- 2023

- 7

- 8

- 9

- a

- Om oss

- adgang

- aksesseres

- tilgjengelig

- tilsvar

- Logg inn

- Oppnå

- tvers

- tilpasse

- adressering

- vedta

- Adopsjon

- forfremmelse

- råd

- Agent

- AI

- AI-drevet

- AI / ML

- algoritmer

- Alle

- tillate

- allerede

- også

- Amazon

- Amazon API-gateway

- Amazon SageMaker

- Amazon SageMaker JumpStart

- Amazon Web Services

- an

- analyserer

- og

- noen

- api

- app

- Søknad

- søknader

- apps

- April

- arkitektur

- ER

- områder

- rundt

- AS

- Eiendeler

- At

- oppmerksomhet

- August

- tilgjengelighet

- tilgjengelig

- unngå

- AWS

- AWS Cloud9

- AWS skyformasjon

- AWS Lambda

- tilbake

- swing

- basert

- BAT

- BE

- vakker

- Beauty

- før du

- være

- tro

- mellom

- Bootstrap

- bred

- nett~~POS=TRUNC leseren~~POS=HEADCOMP

- bygge

- bygget

- virksomhet

- forretningsutvikling

- bedrifter

- men

- by

- ring

- CAN

- evner

- Kapasitet

- fanget

- hvilken

- saken

- saker

- CD

- Sentre

- endring

- egenskaper

- avgifter

- sjekk

- Velg

- kunde

- klienter

- Cloud

- Cloud9

- kode

- kommer

- Felles

- vanligvis

- fullføre

- komplekse

- Beregn

- datamaskin

- Konfigurasjon

- Konsoll

- konstruere

- konsulent

- forbrukes

- inneholdt

- Container

- inneholder

- innhold

- kontekst

- bidra

- kontroll

- Samtale

- samtaler

- korrigere

- Kostnad

- skape

- opprettet

- skaper

- skaperverket

- CTO

- Gjeldende

- skikk

- kunde

- kundeopplevelse

- Kundeservice

- Kunder

- tilpasse

- skjærekant

- dato

- datavitenskap

- dag

- tiår

- Misligholde

- definerer

- demonstrert

- demonstrerer

- Avhengighet

- avhengig

- utplassere

- utplassert

- utplasserings

- distribusjon

- Distribueres

- beskrivelse

- ødelegge

- utvikle

- utviklere

- Utvikling

- forskjellig

- kringkasting

- Vise

- Avbryte

- Docker

- dokument

- gjort

- ikke

- ned

- hver enkelt

- lett

- lett

- effektivt

- effektivt

- muliggjøre

- muliggjør

- slutt

- Endpoint

- ingeniør

- Enter

- Miljø

- miljøer

- anslått

- Hver

- hver dag

- alles

- eksempel

- eksempler

- spennende

- erfaring

- utvide

- omfattende

- Face

- falsk

- kjent

- familie

- Egenskaper

- Noen få

- felt

- Felt

- filet

- Finn

- Først

- Fokus

- etter

- følger

- Til

- Tving

- Fundament

- brøkdel

- Rammeverk

- fra

- fullt

- funksjon

- funksjonelle

- funksjoner

- gateway

- samle

- samle

- generell

- generert

- generasjonen

- generative

- Generativ AI

- få

- gå

- Global

- Globalt

- Økende

- Ha

- å ha

- he

- hjelpe

- hjelpe

- høykvalitets

- hans

- Hjemprodukt

- vert

- vert

- TIMER

- Hvordan

- Hvordan

- HTML

- http

- HTTPS

- IKT

- Ideer

- if

- bilde

- bilder

- fantasi

- iverksette

- gjennomføring

- importere

- in

- Inkludert

- innlemme

- bransjer

- industri

- Infinite

- Bøyepunkt

- informasjon

- Infrastruktur

- installere

- installasjon

- installerte

- f.eks

- i stedet

- integrere

- integrasjoner

- interaktiv

- Interface

- inn

- invitere

- utstedelse

- IT

- sammenføyning

- ledd

- jpg

- JSON

- Koreansk

- landing

- Språk

- språk

- stor

- seinere

- siste

- lansere

- lansert

- lansere

- føre

- leder

- Ledelse

- Fører

- LÆRE

- læring

- Permisjon

- Bibliotek

- Tillatelse

- lisenser

- i likhet med

- BEGRENSE

- linje

- Liste

- Lytting

- lister

- LLM

- laste

- lokal

- ligger

- maskin

- maskinlæring

- maskiner

- laget

- Hoved

- gjøre

- GJØR AT

- administrer

- ledelse

- leder

- mange

- massive

- Meny

- kunne

- migrere

- migrasjon

- minutter

- MIT

- ML

- modell

- modeller

- modern

- modifisert

- mer

- Filmer

- flere

- musikk

- må

- navn

- Naturlig

- Natur

- Navigasjon

- Trenger

- behov

- nettverk

- Ny

- neste

- node

- nå

- Antall

- of

- Tilbud

- on

- ONE

- pågående

- bare

- åpen kildekode

- Programvare med åpen kildekode

- åpner

- or

- rekkefølge

- organisasjon

- original

- Annen

- vår

- produksjon

- enn

- oversikt

- egen

- pakke

- side

- brød

- paradigmet

- parameter

- parametere

- partner

- partnere

- Passerer

- Utfør

- fase

- telefon

- bilde

- fly

- plattform

- plato

- Platon Data Intelligence

- PlatonData

- Point

- mulighet

- Post

- potensiell

- powered

- kraftig

- forutsetninger

- Skrive ut

- Før

- privat

- Problem

- Produksjon

- Programmering

- programmerings språk

- prosjekt

- prosjekter

- gi

- gir

- offentlig

- Offentlig sky

- offentlig

- Python

- spørsmål

- raskt

- område

- rask

- raskt

- klar

- nylig

- referert

- om

- region

- i slekt

- Repository

- påkrevd

- Krav

- ressurs

- Ressurser

- de

- anmeldelse

- revolusjonerer

- ikke sant

- Rolle

- root

- Kjør

- rennende

- sagemaker

- salg

- samme

- Skala

- sci-fi

- Vitenskap

- skraper

- SDK

- Sekund

- sekunder

- Seksjon

- sikkerhet

- se

- frø

- SELV

- senior

- sentiment

- Seoul

- server~~POS=TRUNC

- Servere

- tjeneste

- Tjenester

- sett

- oppsett

- Del

- skift

- bør

- Vis

- viste

- vist

- Viser

- Enkelt

- siden

- Singapore

- Størrelse

- liten

- EMS

- So

- Software

- programvareutvikling

- løsning

- Solutions

- noen

- kilde

- Rom

- spesialist

- spesifikk

- spesifisert

- stabil

- stable

- Stabler

- Standard

- startet

- oppstart

- startups

- Trinn

- Steps

- Stopp

- lagring

- oppbevare

- lagret

- butikker

- Stories

- Strategi

- struktur

- subnett

- støtte

- Systemer

- tar

- Oppgave

- oppgaver

- lag

- Teknisk

- teknikker

- Technologies

- Teknologi

- forteller

- maler

- test

- tester

- Det

- De

- deres

- Dem

- deretter

- Disse

- denne

- Gjennom

- tid

- titan

- til

- verktøykasse

- verktøy

- tradisjon

- tradisjonelle

- Tog

- trent

- Kurs

- Transform

- Trender

- sant

- virkelig

- SVING

- tutorial

- to

- typen

- typer

- typisk

- typisk

- etter

- forståelse

- avduket

- oppdatering

- oppgradering

- bruke

- bruk sak

- brukt

- Bruker

- Brukergrensesnitt

- ved hjelp av

- bruke

- ulike

- enorme

- verifisere

- versjon

- av

- videoer

- Se

- virtuelle

- nesten

- Besøk

- ønsker

- var

- se

- Vei..

- we

- web

- Webapplikasjon

- webtjenester

- VI VIL

- hvilken

- mens

- bred

- Bred rekkevidde

- utbredt

- Wikipedia

- vil

- vinduer

- med

- uten

- Arbeid

- arbeidet

- arbeidsflyt

- arbeidsstasjon

- år

- Du

- Din

- zephyrnet

- soner