Dette innlegget ble skrevet i samarbeid med Ankur Goyal og Karthikeyan Chokappa fra PwC Australias Cloud & Digital-virksomhet.

Kunstig intelligens (AI) og maskinlæring (ML) blir en integrert del av systemer og prosesser, og muliggjør beslutninger i sanntid, og dermed driver topp- og bunnlinjeforbedringer på tvers av organisasjoner. Å sette en ML-modell i produksjon i stor skala er imidlertid utfordrende og krever et sett med beste praksis. Mange bedrifter har allerede dataforskere og ML-ingeniører som kan bygge toppmoderne modeller, men å ta modeller til produksjon og vedlikeholde modellene i stor skala er fortsatt en utfordring. Manuelle arbeidsflyter begrenser ML livssyklusoperasjoner for å bremse utviklingsprosessen, øke kostnadene og kompromittere kvaliteten på sluttproduktet.

Maskinlæringsoperasjoner (MLOps) bruker DevOps-prinsipper på ML-systemer. Akkurat som DevOps kombinerer utvikling og drift for software engineering, kombinerer MLOps ML engineering og IT-drift. Med den raske veksten i ML-systemer og i sammenheng med ML-teknikk, gir MLOps kapasiteter som er nødvendige for å håndtere den unike kompleksiteten til den praktiske anvendelsen av ML-systemer. Totalt sett krever ML-brukstilfeller en lett tilgjengelig integrert løsning for å industrialisere og effektivisere prosessen som tar en ML-modell fra utvikling til produksjonsdistribusjon i skala ved hjelp av MLOps.

For å møte disse kundeutfordringene utviklet PwC Australia Machine Learning Ops Accelerator som et sett med standardiserte prosess- og teknologifunksjoner for å forbedre operasjonaliseringen av AI/ML-modeller som muliggjør tverrfunksjonelt samarbeid på tvers av team gjennom ML-livssyklusoperasjoner. PwC Machine Learning Ops Accelerator, bygget på toppen av AWS native-tjenester, leverer en passende løsning som enkelt integreres i ML-brukstilfellene for kunder på tvers av alle bransjer. I dette innlegget fokuserer vi på å bygge og distribuere en ML-brukssak som integrerer ulike livssykluskomponenter i en ML-modell, som muliggjør kontinuerlig integrasjon (CI), kontinuerlig levering (CD), kontinuerlig opplæring (CT) og kontinuerlig overvåking (CM).

Løsningsoversikt

I MLOps involverer en vellykket reise fra data til ML-modeller til anbefalinger og spådommer i forretningssystemer og prosesser flere avgjørende trinn. Det innebærer å ta resultatet av et eksperiment eller en prototype og gjøre det om til et produksjonssystem med standardkontroller, kvalitet og tilbakemeldingssløyfer. Det er mye mer enn bare automatisering. Det handler om å forbedre organisasjonspraksis og levere resultater som er repeterbare og reproduserbare i stor skala.

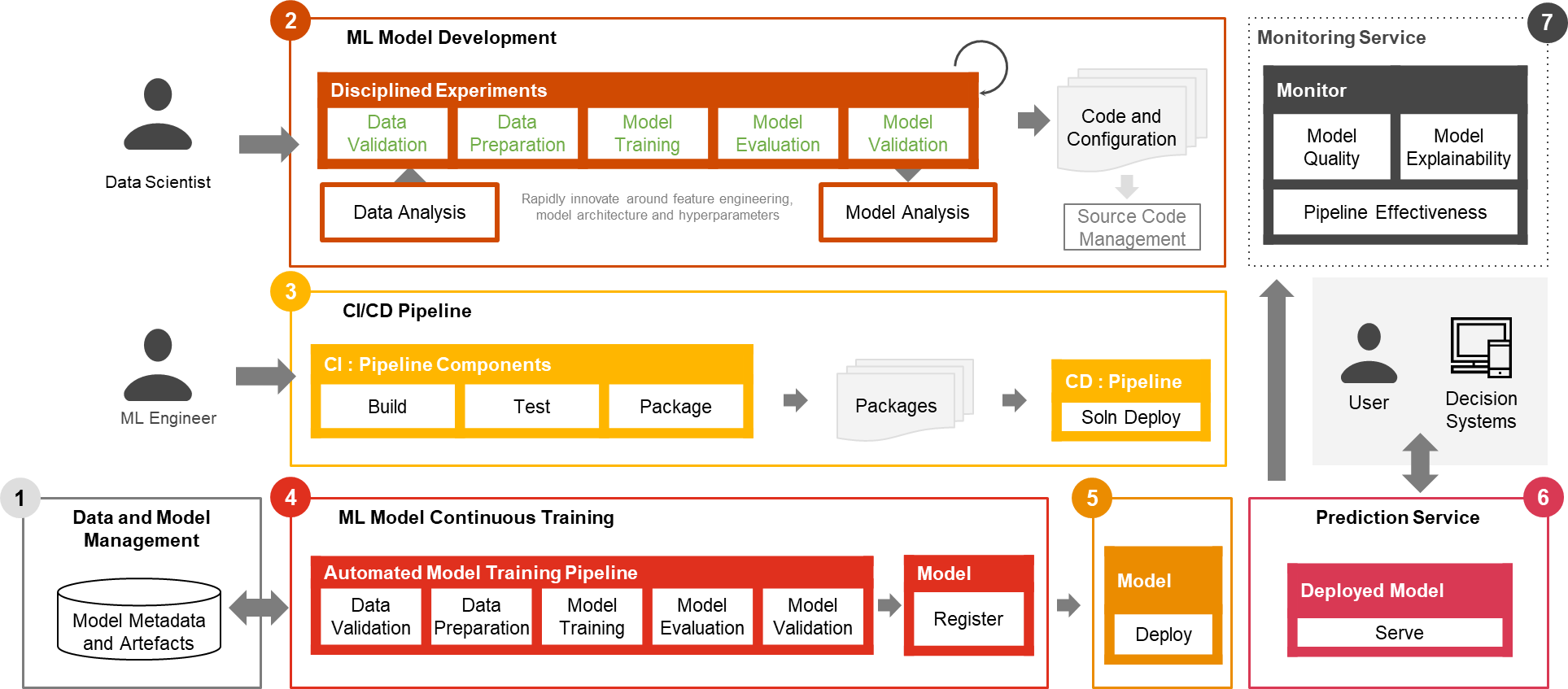

Bare en liten brøkdel av en virkelig ML-brukssak omfatter selve modellen. De ulike komponentene som trengs for å bygge en integrert avansert ML-kapasitet og kontinuerlig drifte den i skala er vist i figur 1. Som illustrert i følgende diagram, omfatter PwC MLOps Accelerator syv viktige integrerte funksjoner og iterative trinn som muliggjør CI, CD, CT og CM av en ML-brukssak. Løsningen drar fordel av AWS native funksjoner fra Amazon SageMaker, bygge et fleksibelt og utvidbart rammeverk rundt dette.

Figur 1 -- PwC Machine Learning Ops Accelerator evner

I et ekte bedriftsscenario kan det finnes flere trinn og stadier av testing for å sikre streng validering og distribusjon av modeller på tvers av forskjellige miljøer.

- Data- og modellstyring gi en sentral funksjon som styrer ML-artefakter gjennom hele livssyklusen. Det muliggjør revisjon, sporbarhet og samsvar. Det fremmer også delbarhet, gjenbrukbarhet og oppdagelse av ML-ressurser.

- ML modellutvikling lar ulike personas utvikle en robust og reproduserbar modelltreningspipeline, som omfatter en sekvens av trinn, fra datavalidering og transformasjon til modelltrening og evaluering.

- Kontinuerlig integrasjon/levering forenkler den automatiserte byggingen, testingen og pakkingen av modelltreningspipelinen og distribuerer den inn i målutførelsesmiljøet. Integrasjoner med CI/CD-arbeidsflyter og dataversjon fremmer MLOps beste praksis som styring og overvåking for iterativ utvikling og dataversjon.

- ML modell kontinuerlig opplæring kapasitet utfører treningspipeline basert på omskoleringstriggere; det vil si når nye data blir tilgjengelige eller modellytelsen synker under en forhåndsinnstilt terskel. Den registrerer den trente modellen hvis den kvalifiserer som en vellykket modellkandidat og lagrer treningsartefakter og tilhørende metadata.

- Modellutplassering gir tilgang til den registrerte, opplærte modellen for å gjennomgå og godkjenne for produksjonsutgivelse og muliggjør modellpakking, testing og distribusjon i prediksjonstjenestemiljøet for produksjonsservering.

- Prediksjonstjeneste kapasitet starter den utplasserte modellen for å gi prediksjon gjennom online-, batch- eller streamingmønstre. Servering runtime fanger også opp modellserveringslogger for kontinuerlig overvåking og forbedringer.

- Kontinuerlig overvåking overvåker modellen for prediktiv effektivitet for å oppdage modellforfall og tjenesteeffektivitet (latency, pipeline gjennom og utførelsesfeil)

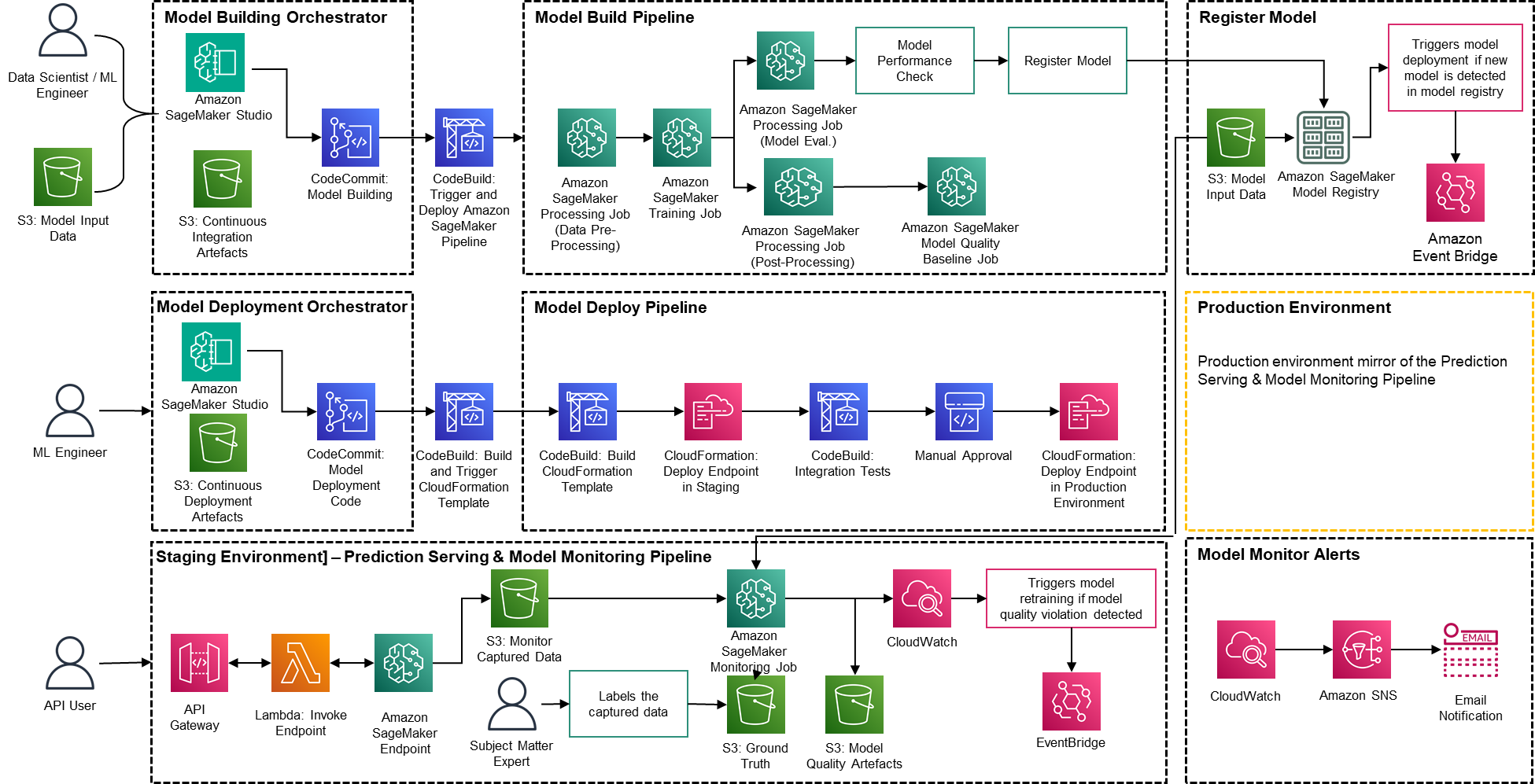

PwC Machine Learning Ops Accelerator-arkitektur

Løsningen er bygget på toppen av AWS-native tjenester som bruker Amazon SageMaker og serverløs teknologi for å holde ytelsen og skalerbarheten høy og driftskostnadene lave.

Figur 2 – PwC Machine Learning Ops Accelerator-arkitektur

- PwC Machine Learning Ops Accelerator gir en persondrevet tilgangsrett for utbygging, bruk og drift som gjør det mulig for ML-ingeniører og dataforskere å automatisere distribusjon av rørledninger (opplæring og servering) og raskt reagere på endringer i modellkvalitet. Amazon SageMaker Rolle Manager brukes til å implementere rollebasert ML-aktivitet, og Amazon S3 brukes til å lagre inndata og artefakter.

- Solution bruker eksisterende modellopprettingsressurser fra kunden og bygger et fleksibelt og utvidbart rammeverk rundt dette ved å bruke AWS native-tjenester. Det er bygget integrasjoner mellom Amazon S3, Git og AWS CodeCommit som tillater datasettversjon med minimal fremtidig administrasjon.

- AWS CloudFormation-malen er generert ved hjelp av AWS Cloud Development Kit (AWS CDK). AWS CDK gir muligheten til å administrere endringer for den komplette løsningen. Den automatiserte pipelinen inkluderer trinn for klar modelllagring og metrisk sporing.

- PwC MLOps Accelerator er designet for å være modulær og leveres som infrastruktur-som-kode (IaC) for å tillate automatiske distribusjoner. Implementeringsprosessen bruker AWS CodeCommit, AWS CodeBuild, AWS CodePipeline, og AWS CloudFormation-mal. Komplett ende-til-ende-løsning for å operasjonalisere en ML-modell er tilgjengelig som distribuerbar kode.

- Gjennom en serie IaC-maler distribueres tre distinkte komponenter: modellbygging, modelldistribusjon og modellovervåking og prediksjonsservering, ved hjelp av Amazon SageMaker-rørledninger

- Modellbyggingspipeline automatiserer modellopplærings- og evalueringsprosessen og muliggjør godkjenning og registrering av den trente modellen.

- Rørledning for modelldistribusjon sørger for den nødvendige infrastrukturen for å distribuere ML-modellen for batch- og sanntidsslutninger.

- Modellovervåking og prediksjonsserveringsrørledning distribuerer infrastrukturen som kreves for å betjene spådommer og overvåke modellytelse.

- PwC MLOps Accelerator er designet for å være agnostisk for ML-modeller, ML-rammeverk og kjøretidsmiljøer. Løsningen tillater velkjent bruk av programmeringsspråk som Python og R, utviklingsverktøy som Jupyter Notebook og ML-rammeverk gjennom en konfigurasjonsfil. Denne fleksibiliteten gjør det enkelt for dataforskere å kontinuerlig forbedre modeller og distribuere dem ved å bruke deres foretrukne språk og miljø.

- Løsningen har innebygde integrasjoner for å bruke enten forhåndsbygde eller tilpassede verktøy for å tildele merkeoppgavene ved hjelp av Amazon SageMaker Ground Truth for opplæringsdatasett for å gi kontinuerlig opplæring og overvåking.

- End-to-end ML-pipeline er bygget ved hjelp av SageMaker native funksjoner (Amazon SageMaker Studio , Amazon SageMaker Model Building Pipelines, Amazon SageMaker-eksperimenterog Amazon SageMaker-endepunkter).

- Løsningen bruker Amazon SageMaker innebygde muligheter for modellversjon, modelllinjesporing, modelldeling og serverløs slutning med Amazon SageMaker modellregister.

- Når modellen er i produksjon, overvåker løsningen kontinuerlig kvaliteten på ML-modeller i sanntid. Amazon SageMaker modellmonitor brukes til å kontinuerlig overvåke modeller i produksjon. Amazon CloudWatch-logger brukes til å samle inn loggfiler som overvåker modellstatusen, og varsler sendes ved hjelp av Amazon SNS når kvaliteten på modellen når visse terskler. Innfødte loggere som (boto3) brukes til å registrere kjørestatus for å fremskynde feilsøking.

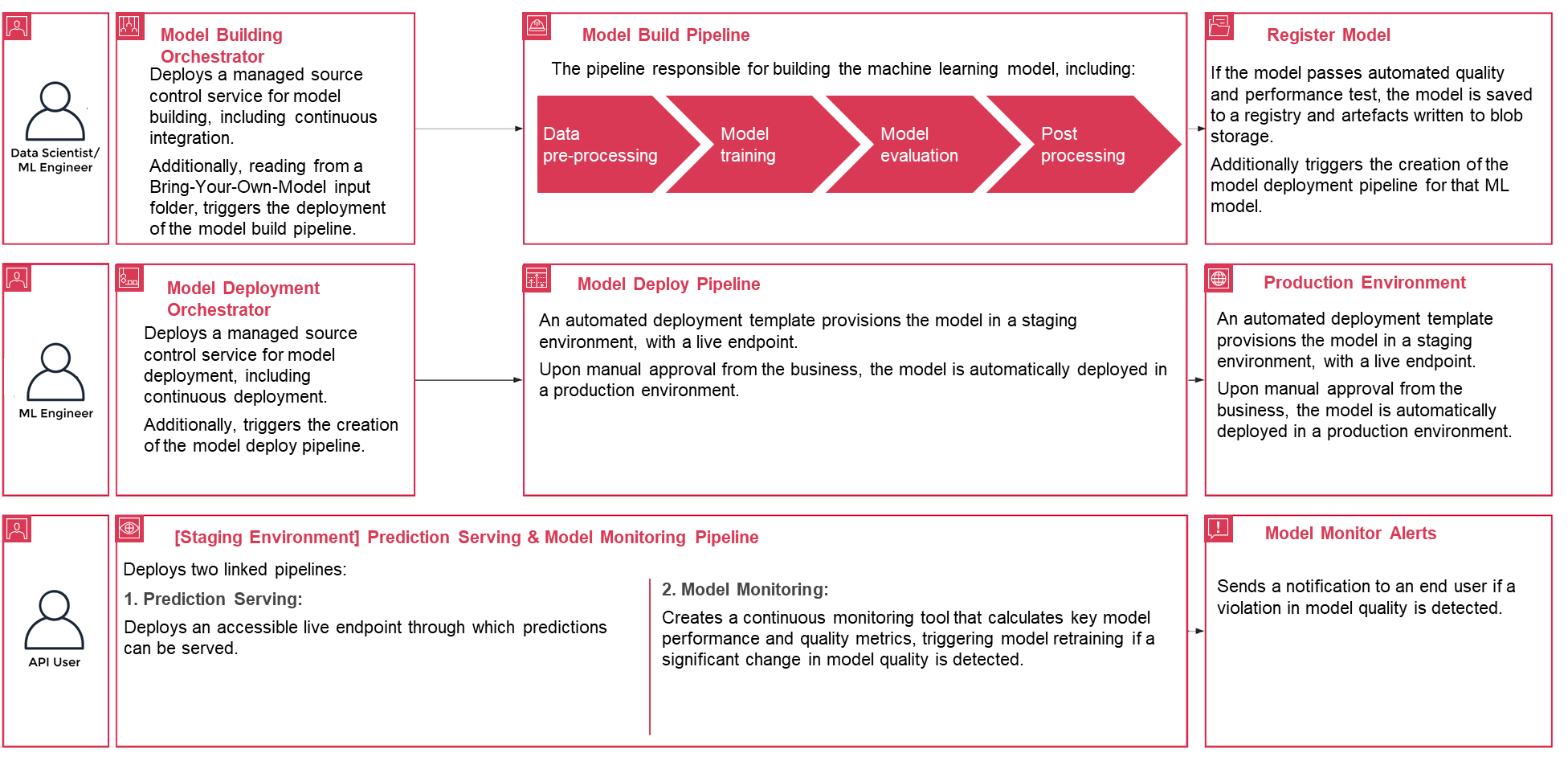

Gjennomgang av løsningen

Følgende gjennomgang dykker ned i standardtrinnene for å lage MLOps-prosessen for en modell som bruker PwC MLOps Accelerator. Denne gjennomgangen beskriver et brukstilfelle av en MLOps-ingeniør som ønsker å distribuere pipeline for en nylig utviklet ML-modell ved å bruke en enkel definisjons-/konfigurasjonsfil som er intuitiv.

Figur 3 – PwC Machine Learning Ops Accelerator prosesslivssyklus

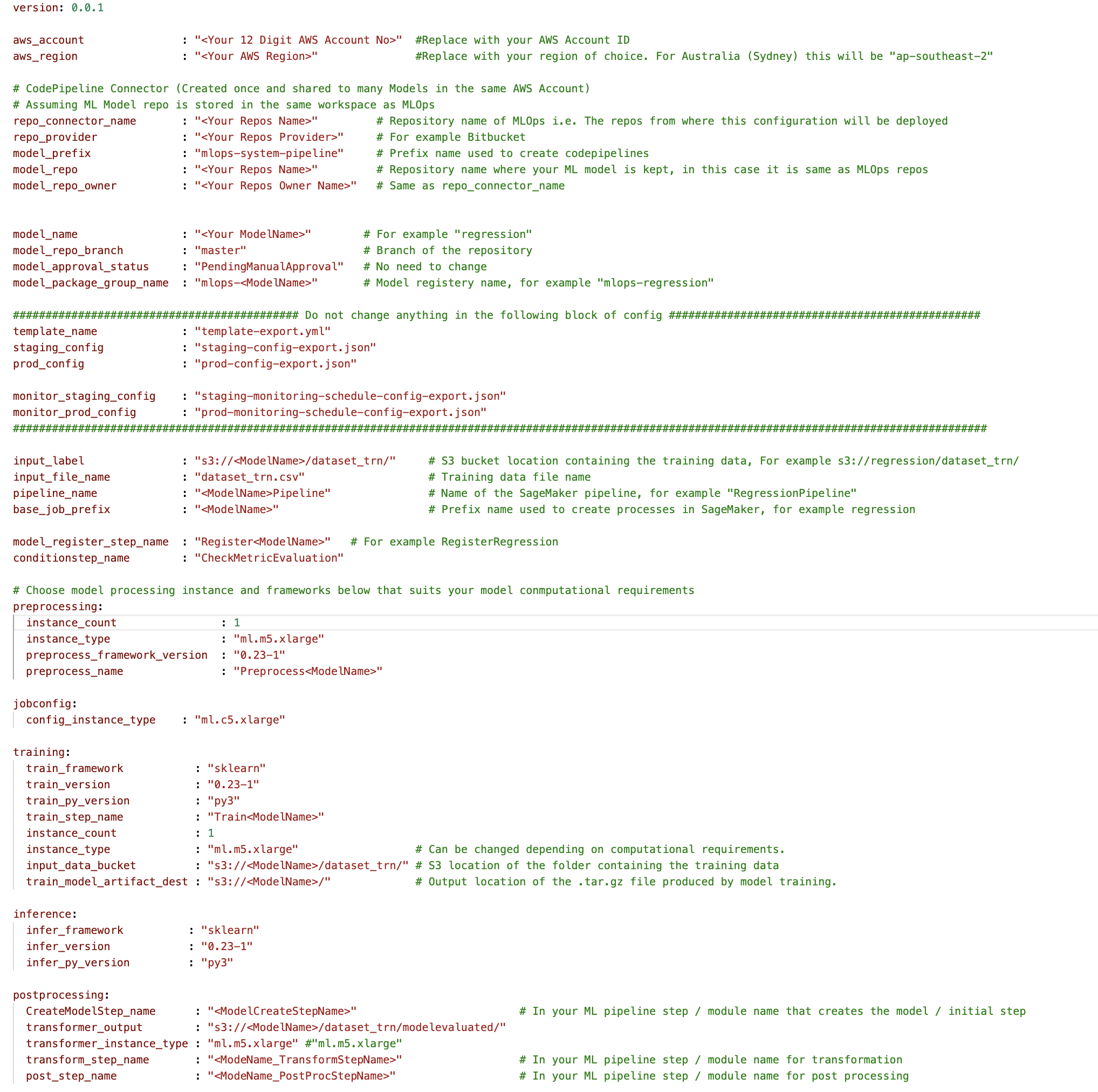

- For å komme i gang, meld deg på PwC MLOps akselerator for å få tilgang til løsningsartefakter. Hele løsningen er drevet fra én konfigurasjons YAML-fil (

config.yaml) per modell. Alle detaljene som kreves for å kjøre løsningen er inneholdt i den konfigurasjonsfilen og lagret sammen med modellen i et Git-depot. Konfigurasjonsfilen vil tjene som input for å automatisere arbeidsflyttrinn ved å eksternalisere viktige parametere og innstillinger utenfor koden. - ML-ingeniøren må fylles ut

config.yamlfil og utløs MLOps-rørledningen. Kunder kan konfigurere en AWS-konto, depotet, modellen, dataene som brukes, pipelinenavnet, opplæringsrammeverket, antall forekomster som skal brukes til opplæring, slutningsrammeverket og eventuelle før- og etterbehandlingstrinn og flere andre konfigurasjoner for å sjekke modellkvalitet, skjevhet og forklaringsevne.

Figur 4 – Machine Learning Ops Accelerator-konfigurasjon YAML

- En enkel YAML-fil brukes til å konfigurere hver modells opplærings-, distribusjons-, overvåkings- og kjøretidskrav. Først når

config.yamler riktig konfigurert og lagret ved siden av modellen i sitt eget Git-lager, kalles modellbyggende orkestrator. Den kan også lese fra en Bring-Your-Own-Model som kan konfigureres gjennom YAML for å utløse distribusjon av modellbygg-pipeline. - Alt etter dette punktet er automatisert av løsningen og trenger ikke involvering av verken ML-ingeniøren eller dataforskeren. Rørledningen som er ansvarlig for å bygge ML-modellen inkluderer dataforbehandling, modellopplæring, modellevaluering og ost-behandling. Hvis modellen består automatiserte kvalitets- og ytelsestester, lagres modellen i et register, og artefakter skrives til Amazon S3-lagring i henhold til definisjonene i YAML-filene. Dette utløser opprettelsen av modelldistribusjonspipeline for den ML-modellen.

Figur 5 – Eksempel på arbeidsflyt for modelldistribusjon

- Deretter leverer en automatisert distribusjonsmal modellen i et oppsamlingsmiljø med et live-endepunkt. Ved godkjenning blir modellen automatisk distribuert i produksjonsmiljøet.

- Løsningen distribuerer to sammenkoblede rørledninger. Prediksjonsservering distribuerer et tilgjengelig live-endepunkt der prediksjoner kan betjenes. Modellovervåking skaper et kontinuerlig overvåkingsverktøy som beregner nøkkelmodellytelse og kvalitetsmålinger, og utløser omskolering av modellen hvis en betydelig endring i modellkvalitet oppdages.

- Nå som du har gått gjennom opprettelsen og den første utrullingen, kan MLOps-ingeniøren konfigurere feilvarsler for å bli varslet for problemer, for eksempel når en rørledning ikke klarer å utføre den tiltenkte jobben.

- MLOps handler ikke lenger om å pakke, teste og distribuere skytjenestekomponenter som ligner på en tradisjonell CI/CD-distribusjon; det er et system som automatisk skal distribuere en annen tjeneste. For eksempel distribuerer modellopplæringspipelinen automatisk modelldistribusjonspipelinen for å aktivere prediksjonstjeneste, som igjen aktiverer modellovervåkingstjenesten.

konklusjonen

Oppsummert er MLOps avgjørende for enhver organisasjon som har som mål å distribuere ML-modeller i produksjonssystemer i stor skala. PwC utviklet en akselerator for å automatisere bygging, distribusjon og vedlikehold av ML-modeller ved å integrere DevOps-verktøy i modellutviklingsprosessen.

I dette innlegget utforsket vi hvordan PwC-løsningen er drevet av AWS native ML-tjenester og hjelper til med å ta i bruk MLOps-praksis slik at bedrifter kan øke hastigheten på AI-reisen og få mer verdi fra ML-modellene deres. Vi gikk gjennom trinnene en bruker ville ta for å få tilgang til PwC Machine Learning Ops Accelerator, kjøre rørledningene og distribuere en ML-brukssak som integrerer ulike livssykluskomponenter i en ML-modell.

For å komme i gang med MLOps-reisen din på AWS Cloud i stor skala og kjøre ML-produksjonsarbeidsmengdene dine, meld deg på PwC Machine Learning Operations.

Om forfatterne

Kiran Kumar Ballari er en hovedløsningsarkitekt hos Amazon Web Services (AWS). Han er en evangelist som elsker å hjelpe kunder med å utnytte ny teknologi og bygge repeterbare industriløsninger for å løse problemene deres. Han er spesielt lidenskapelig opptatt av programvareutvikling, Generativ AI og å hjelpe bedrifter med AI/ML-produktutvikling.

Kiran Kumar Ballari er en hovedløsningsarkitekt hos Amazon Web Services (AWS). Han er en evangelist som elsker å hjelpe kunder med å utnytte ny teknologi og bygge repeterbare industriløsninger for å løse problemene deres. Han er spesielt lidenskapelig opptatt av programvareutvikling, Generativ AI og å hjelpe bedrifter med AI/ML-produktutvikling.

Ankur Goyal er direktør i PwC Australias Cloud and Digital-praksis, med fokus på Data, Analytics og AI. Ankur har lang erfaring med å støtte offentlige og private organisasjoner med å drive teknologitransformasjoner og designe innovative løsninger ved å utnytte dataressurser og teknologier.

Ankur Goyal er direktør i PwC Australias Cloud and Digital-praksis, med fokus på Data, Analytics og AI. Ankur har lang erfaring med å støtte offentlige og private organisasjoner med å drive teknologitransformasjoner og designe innovative løsninger ved å utnytte dataressurser og teknologier.

Karthikeyan Chokappa (KC) er leder i PwC Australias sky- og digitale praksis, med fokus på data, analyse og kunstig intelligens. KC er lidenskapelig opptatt av å designe, utvikle og distribuere ende-til-ende analyseløsninger som transformerer data til verdifulle beslutningsressurser for å forbedre ytelse og utnyttelse og redusere de totale eierkostnadene for tilkoblede og intelligente ting.

Karthikeyan Chokappa (KC) er leder i PwC Australias sky- og digitale praksis, med fokus på data, analyse og kunstig intelligens. KC er lidenskapelig opptatt av å designe, utvikle og distribuere ende-til-ende analyseløsninger som transformerer data til verdifulle beslutningsressurser for å forbedre ytelse og utnyttelse og redusere de totale eierkostnadene for tilkoblede og intelligente ting.

Rama Lankalapalli er Sr. Partner Solutions Architect hos AWS, og jobber med PwC for å akselerere klientenes migreringer og moderniseringer til AWS. Han jobber på tvers av ulike bransjer for å akselerere deres bruk av AWS Cloud. Hans ekspertise ligger i å bygge effektive og skalerbare skyløsninger, drive innovasjon og modernisering av kundeapplikasjoner ved å utnytte AWS-tjenester og etablere robuste skyfundamenter.

Rama Lankalapalli er Sr. Partner Solutions Architect hos AWS, og jobber med PwC for å akselerere klientenes migreringer og moderniseringer til AWS. Han jobber på tvers av ulike bransjer for å akselerere deres bruk av AWS Cloud. Hans ekspertise ligger i å bygge effektive og skalerbare skyløsninger, drive innovasjon og modernisering av kundeapplikasjoner ved å utnytte AWS-tjenester og etablere robuste skyfundamenter.

Jeejee Unwalla er en Senior Solutions Architect i AWS som liker å veilede kunder i å løse utfordringer og tenke strategisk. Han brenner for teknologi og data og muliggjør innovasjon.

Jeejee Unwalla er en Senior Solutions Architect i AWS som liker å veilede kunder i å løse utfordringer og tenke strategisk. Han brenner for teknologi og data og muliggjør innovasjon.

- SEO-drevet innhold og PR-distribusjon. Bli forsterket i dag.

- PlatoData.Network Vertical Generative Ai. Styrk deg selv. Tilgang her.

- PlatoAiStream. Web3 Intelligence. Kunnskap forsterket. Tilgang her.

- PlatoESG. Karbon, CleanTech, Energi, Miljø, Solenergi, Avfallshåndtering. Tilgang her.

- PlatoHelse. Bioteknologisk og klinisk etterretning. Tilgang her.

- kilde: https://aws.amazon.com/blogs/machine-learning/driving-advanced-analytics-outcomes-at-scale-using-amazon-sagemaker-powered-pwcs-machine-learning-ops-accelerator/

- : har

- :er

- :ikke

- $OPP

- 1

- 100

- 1951

- 2024

- 32

- 33

- 7

- a

- evne

- Om oss

- akselerere

- akselerator

- adgang

- tilgjengelig

- Logg inn

- tvers

- aktivitet

- Ytterligere

- adresse

- adoptere

- Adopsjon

- avansert

- Fordel

- Etter

- AI

- AI / ML

- mål

- Varsler

- Alle

- tillate

- tillater

- langs

- sammen

- allerede

- også

- Amazon

- Amazon SageMaker

- Amazon Web Services

- Amazon Web Services (AWS)

- an

- analytics

- og

- En annen

- noen

- Søknad

- søknader

- gjelder

- hensiktsmessig

- godkjenning

- godkjenne

- arkitektur

- ER

- rundt

- AS

- Eiendeler

- assosiert

- At

- revisjonsevne

- Australia

- automatisere

- Automatisert

- automatiserer

- Automatisk

- automatisk

- Automatisering

- tilgjengelig

- AWS

- AWS skyformasjon

- basert

- BE

- blir

- bli

- vært

- under

- BEST

- beste praksis

- mellom

- Bias

- bygge

- bygge ut

- Bygning

- bygger

- bygget

- innebygd

- virksomhet

- bedrifter

- men

- by

- beregner

- CAN

- kandidat

- evner

- evne

- fangst

- fanger

- saken

- saker

- CD

- sentral

- viss

- utfordre

- utfordringer

- utfordrende

- endring

- Endringer

- sjekk

- Cloud

- kode

- samarbeid

- samle

- skurtreskerne

- Selskaper

- fullføre

- kompleksiteten

- samsvar

- komponenter

- består

- kompromiss

- Konfigurasjon

- konfigurert

- tilkoblet

- inneholdt

- kontekst

- kontinuerlig

- kontinuerlig

- kontroller

- Kostnad

- Kostnader

- skape

- skaper

- skaperverket

- kritisk

- avgjørende

- skikk

- kunde

- Kunder

- dato

- dataforsker

- datasett

- avgjørelse

- avgjørelser

- definisjoner

- levert

- levere

- leverer

- levering

- utplassere

- utplassert

- utplasserings

- distribusjon

- distribusjoner

- Distribueres

- designet

- utforme

- detaljer

- oppdage

- oppdaget

- utvikle

- utviklet

- utvikle

- Utvikling

- utviklingsverktøy

- forskjellig

- digitalt

- Regissør

- distinkt

- diverse

- do

- gjør

- ned

- drevet

- kjøring

- hver enkelt

- lette

- lett

- effektivitet

- effektiv

- enten

- muliggjøre

- muliggjør

- muliggjør

- ende til ende

- Endpoint

- ingeniør

- Ingeniørarbeid

- Ingeniører

- sikre

- Enterprise

- Hele

- rett

- Miljø

- miljøer

- feil

- spesielt

- etablere

- evaluering

- evangelist

- eksempel

- Utfører

- gjennomføring

- eksisterer

- eksisterende

- fremskynde

- erfaring

- eksperiment

- ekspertise

- utforsket

- omfattende

- Omfattende erfaring

- mislykkes

- Failure

- kjent

- Egenskaper

- tilbakemelding

- Figur

- filet

- Filer

- slutt~~POS=TRUNC

- fleksibilitet

- fleksibel

- Fokus

- fokuserte

- etter

- Til

- Foundations

- brøkdel

- Rammeverk

- rammer

- fra

- framtid

- Gevinst

- generert

- generative

- Generativ AI

- få

- gå

- borte

- styresett

- reglene

- Ground

- Vekst

- håndtere

- Ha

- he

- hjelpe

- hjelpe

- hjelper

- Høy

- hans

- Hits

- Hvordan

- Men

- HTML

- HTTPS

- if

- iverksette

- viktig

- forbedre

- forbedringer

- bedre

- in

- inkluderer

- Øke

- bransjer

- industri

- Infrastruktur

- innledende

- Innovasjon

- innovative

- inngang

- integrert

- integrert

- Integrerer

- Integrering

- integrering

- integrasjoner

- Intelligens

- Intelligent

- tiltenkt

- inn

- intuitiv

- påkalt

- engasjement

- saker

- IT

- DET ER

- selv

- Jobb

- reise

- jpg

- bare

- Hold

- nøkkel

- Kumar

- merking

- Språk

- språk

- Ventetid

- læring

- Leverage

- utnytte

- ligger

- Livssyklus

- i likhet med

- BEGRENSE

- avstamning

- knyttet

- leve

- logg

- lenger

- elsker

- Lav

- maskin

- maskinlæring

- Vedlike

- GJØR AT

- administrer

- ledelse

- leder

- håndbok

- mange

- Kan..

- metadata

- metrisk

- Metrics

- minimal

- ML

- MLOps

- modell

- modeller

- modulære

- Overvåke

- overvåking

- skjermer

- mer

- mye

- navn

- innfødt

- nødvendig

- Trenger

- nødvendig

- Ny

- Ny teknologi

- Nei.

- bærbare

- varslinger

- Antall

- of

- on

- gang

- ONE

- på nett

- betjene

- Drift

- or

- organisasjon

- organisasjoner

- Annen

- utfall

- utenfor

- samlet

- egen

- eierskap

- emballasje

- parametere

- del

- partner

- passerer

- lidenskapelig

- mønstre

- for

- ytelse

- rørledning

- plato

- Platon Data Intelligence

- PlatonData

- Point

- Post

- powered

- Praktisk

- praksis

- praksis

- prediksjon

- Spådommer

- trekkes

- Principal

- prinsipper

- privat

- privat sektor

- problemer

- prosess

- Prosesser

- Produkt

- produktutvikling

- Produksjon

- Programmering

- programmerings språk

- fremme

- fremmer

- prototype

- gi

- gir

- offentlig

- Sette

- PWC

- Python

- kvalitet

- R

- rask

- raskt

- Lese

- lett

- ekte

- virkelige verden

- sanntids

- nylig

- anbefalinger

- redusere

- avgrense

- registrert

- registre

- Registrering

- registret

- slipp

- forblir

- repeterbar

- Repository

- krever

- påkrevd

- Krav

- Krever

- spenstig

- Svare

- ansvarlig

- resultere

- anmeldelse

- streng

- robust

- Rolle

- Kjør

- rennende

- runtime

- sagemaker

- lagret

- skalerbarhet

- skalerbar

- Skala

- scenario

- Forsker

- forskere

- sektor

- senior

- sendt

- Sequence

- Serien

- betjene

- servert

- server~~POS=TRUNC

- tjeneste

- Tjenester

- servering

- sett

- innstillinger

- syv

- flere

- deling

- bør

- vist

- signifikant

- lignende

- Enkelt

- langsom

- liten

- So

- Software

- software engineering

- løsning

- Solutions

- LØSE

- løse

- fart

- stadier

- iscenesettelse

- Standard

- startet

- starter

- state-of-the-art

- status

- Steps

- lagring

- oppbevare

- lagret

- butikker

- rett fram

- strategisk

- streaming

- effektivisere

- vellykket

- slik

- SAMMENDRAG

- Støtte

- system

- Systemer

- Ta

- tar

- ta

- Target

- oppgaver

- lag

- tech

- Technologies

- Teknologi

- mal

- maler

- Testing

- tester

- enn

- Det

- De

- deres

- Dem

- derved

- Disse

- ting

- tenker

- denne

- tre

- terskel

- Gjennom

- hele

- tid

- til

- verktøy

- verktøy

- topp

- Totalt

- Sporbarhet

- Sporing

- tradisjonelle

- trent

- Kurs

- Transform

- Transformation

- transformasjoner

- utløse

- utløsende

- SVING

- Turning

- to

- unik

- upon

- bruk

- bruke

- bruk sak

- brukt

- Bruker

- bruker

- ved hjelp av

- validering

- Verdifull

- verdi

- ulike

- av

- gikk

- walkthrough

- ønsker

- var

- we

- web

- webtjenester

- når

- hvilken

- HVEM

- vil

- med

- innenfor

- arbeidsflyt

- arbeidsflyt

- arbeid

- virker

- ville

- skrevet

- yaml

- Din

- zephyrnet