Google har satt den på pause Gemini AI fra å generere «folk»-bilder etter et opprør over dens skjeve raserepresentasjoner.

Teknologifirmaet tok affære etter at brukere fremhevet AIs tendens til å avbilde primært fargede mennesker, selv i historisk unøyaktige sammenhenger. Dette trekket tar sikte på å avgrense Geminis evner for å sikre mer nøyaktige og mangfoldige avbildninger.

Les også: Det er en spøk! Brukere latterliggjør Googles Gemini for å savne den

Opprinnelsen til tilbakeslaget

Kjernen i kontroversen ligger i AIs unnlatelse av å reflektere rasemangfold nøyaktig i bildene sine. Sosiale medier ble en slagmark, med brukere som delte Gemini-genererte bilder som avvek fra historisk og kulturell nøyaktighet. Viktige eksempler inkluderer skildringer av ikke-hvite svenske kvinner og farger i nazi-uniformer.

Det er pinlig vanskelig å få Google Gemini til å erkjenne at hvite mennesker eksisterer pic.twitter.com/4lkhD7p5nR

—Deedy (@debarghya_das) Februar 20, 2024

Slike unøyaktigheter har ikke bare utløst debatter på sosiale medier, men har også ført til alvorlig introspeksjon i Google, med ansatte uttrykke flauhet over AIs mangler. Kritikere hevder at disse unøyaktighetene ikke bare er tekniske feil, men gjenspeiler en mer dyp skjevhet i AI-programmering.

"Jeg har aldri vært så flau over å jobbe for et selskap," sa St. Ratej, en forskningsingeniør ved Google ARVR, i et X-innlegg.

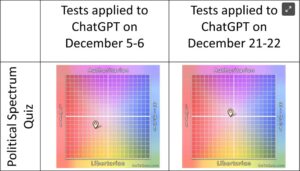

Tilbakeslaget stoppet imidlertid ikke bare hos Google, ettersom noen brukere også la merke til de samme skjevhetene i andre AI-plattformer som OpenAIs ChatGPT. Følgelig dukket det opp spørsmål om konsistensen av gransking på tvers av AI-teknologier, og fremhevet den bredere bransjeomfattende utfordringen med å sikre objektive AI-representasjoner.

Eh folkens... det ser ut til at chatGPT har det samme moraliserende problemet.

Hvorfor får de et gratiskort? pic.twitter.com/a1ZBz69iZw

— Liv Boeree (@Liv_Boeree) Februar 21, 2024

Ringvirkningen

Hendelsen har ikke bare svekket selskapets image, men også ført til en bredere debatt om AI-etikk og representasjon. Elon Musk kritiserte Googles metodikk og kalte den 'rasistisk' og 'antisivilisatorisk'. Musk sin kommentarer gjenspeiler den økende bekymringen for de etiske grensene for AI-teknologi og behovet for en mer mangfoldig og nøyaktig skildring av AI-generert innhold.

"Jeg er glad for at Google overspilte hånden deres med deres AI-bildegenerering, da det gjorde deres vanvittige rasistiske, anti-sivilisatoriske programmering tydelig for alle."

Som svar på kontroversen uttrykte Musk sin AI-modell, Grok, som han hadde til hensikt å gi ut flere versjoner for. Teknologien demonstrerer et konkurransefortrinn innen AI-utvikling, som kan bidra til å overvinne begrensningene til eksisterende modeller som Gemini. Videre økte den tilfeldige navnelikheten mellom Grok og Groq LPU-brikken interessen ettersom AI-markedet er preget av rask innovasjon og akutt konkurranse.

Kanskje det nå er klart hvorfor @xAI's Grok er så viktig.

Det er langt fra perfekt akkurat nå, men vil forbedre seg raskt. V1.5 utgis om 2 uker.

En streng jakt på sannheten, uten hensyn til kritikk, har aldri vært viktigere.

- Elon Musk (@elonmusk) Februar 22, 2024

Veien til forbedring

Google erkjenner problemet og hadde til hensikt å avgrense Geminis avbildningsevner. Selskapet understreket viktigheten av mangfold i AI-genererte bilder, men innrømmet den nåværende modellens mangler når det gjelder å representere all demografi nøyaktig.

Vi jobber allerede med å løse nylige problemer med Geminis bildegenereringsfunksjon. Mens vi gjør dette, skal vi stoppe bildegenereringen av mennesker og vil snart gi ut en forbedret versjon på nytt. https://t.co/SLxYPGoqOZ

- Google Communications (@Google_Comms) Februar 22, 2024

På samme måte innrømmet Googles talsperson, Krawczyk, modellens mangel, og understreket behovet for en mer balansert skildring som speiler det globale mangfoldet uten at det går på bekostning av historisk nøyaktighet. For å løse disse bekymringene stoppet Google Geminis funksjon for generering av menneskelige bilder, og signaliserte en forbedret versjon som bedre gjenspeiler det globale mangfoldet i brukerbasen.

"Vi jobber allerede med å løse nylige problemer med Geminis bildegenereringsfunksjon. Mens vi gjør dette, skal vi stoppe bildegenereringen av mennesker og vil snart gi ut en forbedret versjon på nytt.»

- SEO-drevet innhold og PR-distribusjon. Bli forsterket i dag.

- PlatoData.Network Vertical Generative Ai. Styrk deg selv. Tilgang her.

- PlatoAiStream. Web3 Intelligence. Kunnskap forsterket. Tilgang her.

- PlatoESG. Karbon, CleanTech, Energi, Miljø, Solenergi, Avfallshåndtering. Tilgang her.

- PlatoHelse. Bioteknologisk og klinisk etterretning. Tilgang her.

- kilde: https://metanews.com/google-halts-gemini-ai-amid-backlash-over-woke-image-controversies/

- : har

- :er

- :ikke

- 13

- 20

- 22

- 7

- 8

- 9

- a

- Om oss

- nøyaktighet

- nøyaktig

- nøyaktig

- anerkjenne

- tvers

- Handling

- adresse

- innrømmet

- Etter

- AI

- mål

- Alle

- allerede

- også

- an

- og

- ER

- argumentere

- AS

- At

- balanserte

- basen

- slagmark

- ble

- vært

- Bedre

- mellom

- Bias

- skjevheter

- grenser

- bredere

- men

- by

- ringer

- evner

- utfordre

- ChatGPT

- chip

- fjerne

- farge

- kommunikasjon

- Selskapet

- Selskapets

- konkurranse

- konkurranse

- kompromittere

- Bekymring

- bekymringer

- Følgelig

- innhold

- sammenhenger

- kontrovers

- Kjerne

- kritikk

- kritikere

- kulturell

- Gjeldende

- debatt

- debatter

- Demografi

- demonstrerer

- Utvikling

- gJORDE

- diverse

- Mangfold

- do

- savner

- Edge

- Elon

- Elon Musk

- understreket

- streker

- ansatte

- ingeniør

- forbedret

- sikre

- sikrer

- avgjørende

- etisk

- etikk

- Selv

- eksempler

- eksisterer

- eksisterende

- uttrykte

- Failure

- langt

- FAST

- Trekk

- Firm

- etter

- Til

- Gratis

- fra

- videre

- Dess

- Gemini

- genererer

- generasjonen

- Genesis

- få

- få

- Global

- skal

- Googles

- Økende

- hånd

- Hard

- Ha

- he

- hjelpe

- Fremhevet

- utheving

- hans

- historisk

- historisk

- Men

- HTTPS

- menneskelig

- bilde

- bilder

- betydning

- viktig

- forbedre

- forbedret

- in

- I andre

- unøyaktig

- hendelse

- inkludere

- Innovasjon

- SINNSYK

- tiltenkt

- interesse

- introspeksjon

- utstedelse

- saker

- IT

- DET ER

- bare

- Led

- ligger

- i likhet med

- begrensninger

- LIV

- UTSEENDE

- laget

- merket

- marked

- Media

- bare

- metodikk

- kunne

- mangler

- modell

- modeller

- mer

- flytte

- Musk

- navn

- Nazi

- Trenger

- aldri

- bemerkelsesverdig

- nå

- of

- on

- bare

- Annen

- utganger

- enn

- Overcome

- passere

- banen

- pause

- pauset

- Ansatte

- perfekt

- Plattformer

- plato

- Platon Data Intelligence

- PlatonData

- Post

- primært

- dyp

- Programmering

- forfølgelse

- spørsmål

- rasistisk

- raskt

- RE

- Lese

- nylig

- avgrense

- reflektere

- Gjenspeiler

- betrakte

- slipp

- Utgivelser

- representasjon

- representerer

- forskning

- svar

- ikke sant

- Ripple

- s

- Sa

- samme

- granskning

- alvorlig

- deling

- mangler

- mindre

- So

- selskap

- sosiale medier

- noen

- snart

- gnist

- talsperson

- Stopp

- Svensk

- tech

- Teknisk

- Technologies

- Teknologi

- Det

- De

- deres

- Disse

- de

- denne

- til

- tok

- sant

- Sannhet

- objektivt

- Bruker

- Brukere

- v1

- versjon

- versjoner

- we

- uker

- hvilken

- mens

- hvit

- hvorfor

- vil

- med

- innenfor

- uten

- Dame

- Arbeid

- arbeid

- X

- zephyrnet