Introduksjon

Barneskolelæreren din viste deg sannsynligvis ikke hvordan du legger til 20-sifrede tall. Men hvis du vet hvordan du legger til mindre tall, trenger du bare papir og blyant og litt tålmodighet. Begynn med en-plassen og arbeid mot venstre trinn for trinn, og snart vil du enkelt stable kvintillioner.

Problemer som dette er lette for mennesker, men bare hvis vi nærmer oss dem på riktig måte. "Hvordan vi mennesker løser disse problemene er ikke å "stirre på det og så skrive ned svaret," sa Eran Malach, en maskinlæringsforsker ved Harvard University. "Vi går faktisk gjennom trinnene."

Denne innsikten har inspirert forskere som studerer de store språkmodellene som driver chatboter som ChatGPT. Selv om disse systemene kan treffe spørsmål som involverer noen få trinn med aritmetikk, vil de ofte flub problemer som involverer mange trinn, som å beregne summen av to store tall. Men i 2022, et team av Google-forskere viste at å be språkmodeller om å generere trinnvise løsninger gjorde at modellene kunne løse problemer som tidligere hadde virket utenfor deres rekkevidde. Teknikken deres, kalt chain-of-thought prompting, ble snart utbredt, selv om forskere slet med å forstå hva som får det til å fungere.

Nå har flere team utforsket kraften i tankekjede-resonnement ved å bruke teknikker fra en mystisk gren av teoretisk informatikk kalt beregningskompleksitetsteori. Det er det siste kapittelet i en forskningslinje som bruker kompleksitetsteori for å studere språkmodellers iboende evner og begrensninger. Disse anstrengelsene avklarer hvor vi kan forvente at modeller mislykkes, og de kan peke mot nye tilnærminger for å bygge dem.

"De fjerner noe av magien," sa Dimitris Papailiopoulos, en maskinlæringsforsker ved University of Wisconsin, Madison. "Det er en god ting."

Trening av transformatorer

Store språkmodeller er bygget rundt matematiske strukturer kalt kunstige nevrale nettverk. De mange "nevronene" i disse nettverkene utfører enkle matematiske operasjoner på lange rekker av tall som representerer individuelle ord, og omformer hvert ord som går gjennom nettverket til et annet. Detaljene i denne matematiske alkymien avhenger av et annet sett med tall kalt nettverkets parametere, som kvantifiserer styrken til forbindelsene mellom nevroner.

For å trene en språkmodell til å produsere sammenhengende utganger, starter forskere vanligvis med et nevralt nettverk hvis parametere alle har tilfeldige verdier, og mater det deretter mengder av data fra hele Internett. Hver gang modellen ser en ny tekstblokk, prøver den å forutsi hvert ord etter tur: Den gjetter det andre ordet basert på det første, det tredje basert på de to første, og så videre. Den sammenligner hver prediksjon med den faktiske teksten, og justerer deretter parameterne for å redusere forskjellen. Hver tweak endrer bare modellens spådommer en liten bit, men på en eller annen måte gjør deres kollektive effekt det mulig for en modell å reagere sammenhengende på input den aldri har sett.

Forskere har trent nevrale nettverk for å behandle språk i 20 år. Men arbeidet tok virkelig fart i 2017, da forskere ved Google introduserte en ny type nettverk kalt en transformator.

"Dette ble foreslått for syv år siden, noe som virker som forhistorie," sa Pablo Barceló, en maskinlæringsforsker ved det pavelige katolske universitetet i Chile.

Det som gjorde transformatorer så transformative er at det er enkelt å skalere dem opp – for å øke antall parametere og mengden treningsdata – uten å gjøre trening uoverkommelig dyrt. Før transformatorer hadde nevrale nettverk på det meste noen hundre millioner parametere; i dag har de største transformatorbaserte modellene mer enn en billion. Mye av forbedringen i språkmodellytelsen de siste fem årene kommer fra bare oppskalering.

Transformatorer gjorde dette mulig ved å bruke spesielle matematiske strukturer kalt oppmerksomhetshoder, som gir dem et slags fugleperspektiv av teksten de leser. Når en transformator leser en ny tekstblokk, skanner oppmerksomhetshodene raskt hele greia og identifiserer relevante sammenhenger mellom ordene – og merker kanskje at det fjerde og åttende ordet sannsynligvis vil være mest nyttig for å forutsi det 10. Deretter sender oppmerksomhetshodene ord videre til et enormt nett av nevroner kalt et feedforward-nettverk, som utfører den tunge tallknusingen som trengs for å generere spådommene som hjelper den å lære.

Ekte transformatorer har flere lag med oppmerksomhetshoder atskilt av feedforward-nettverk, og spytter bare ut spådommer etter det siste laget. Men på hvert lag har oppmerksomhetshodene allerede identifisert den mest relevante konteksten for hvert ord, så det beregningsintensive fremmatingstrinnet kan skje samtidig for hvert ord i teksten. Det setter fart på treningsprosessen, og gjør det mulig å trene transformatorer på stadig større sett med data. Enda viktigere, det lar forskere spre den enorme beregningsbelastningen med å trene et massivt nevralt nettverk over mange prosessorer som jobber sammen.

For å få mest mulig ut av massive datasett, "må du gjøre modellene virkelig store," sa David Chiang, en maskinlæringsforsker ved University of Notre Dame. "Det kommer bare ikke til å være praktisk å trene dem med mindre det er parallellisert."

Den parallelle strukturen som gjør det så enkelt å trene transformatorer hjelper imidlertid ikke etter trening - på det tidspunktet er det ikke nødvendig å forutsi ord som allerede eksisterer. Under ordinær drift sender transformatorer ut ett ord om gangen, og slår hver utgang tilbake til inngangen før de genererer neste ord, men de sitter fortsatt fast med en arkitektur optimalisert for parallell prosessering.

Etter hvert som transformatorbaserte modeller vokste og visse oppgaver fortsatte å gi dem problemer, begynte noen forskere å lure på om presset mot mer parallelliserbare modeller hadde kostet. Var det en måte å forstå oppførselen til transformatorer teoretisk?

Kompleksiteten til transformatorer

Teoretiske studier av nevrale nettverk møter mange vanskeligheter, spesielt når de prøver å gjøre rede for trening. Nevrale nettverk bruker en velkjent prosedyre for å justere parametrene deres i hvert trinn i treningsprosessen. Men det kan være vanskelig å forstå hvorfor denne enkle prosedyren konvergerer på et godt sett med parametere.

I stedet for å vurdere hva som skjer under trening, studerer noen forskere de iboende egenskapene til transformatorer ved å forestille seg at det er mulig å justere parametrene deres til alle vilkårlige verdier. Dette tilsvarer å behandle en transformator som en spesiell type programmerbar datamaskin.

"Du har en dataenhet, og du vil vite, 'Vel, hva kan den gjøre? Hva slags funksjoner kan den beregne?'» sa Chiang.

Dette er de sentrale spørsmålene i det formelle studiet av beregning. Feltet dateres tilbake til 1936, da Alan Turing først forestilte seg en fantasifull enhet, nå kalt en Turing-maskin, som kunne utføre enhver beregning ved å lese og skrive symboler på et uendelig bånd. Beregningskompleksitetsteoretikere ville senere bygge videre på Turings arbeid ved å bevise at beregningsproblemer naturlig faller inn i forskjellige kompleksitetsklasser definert av ressursene som kreves for å løse dem.

I 2019, Barceló og to andre forskere beviste at en idealisert versjon av en transformator med et fast antall parametere kan være like kraftig som en Turing-maskin. Hvis du setter opp en transformator for gjentatte ganger å mate utgangen tilbake som en inngang og sette parameterne til de riktige verdiene for det spesifikke problemet du vil løse, vil den til slutt spytte ut det riktige svaret.

Dette resultatet var et utgangspunkt, men det var avhengig av noen urealistiske forutsetninger som sannsynligvis ville overvurdert kraften til transformatorer. I årene etter har forskere jobbet med å utvikle mer realistiske teoretiske rammer.

En slik innsats begynte i 2021, da William Merrill, nå doktorgradsstudent ved New York University, forlot et toårig stipendium ved Allen Institute for Artificial Intelligence i Seattle. Mens han var der, hadde han analysert andre typer nevrale nettverk ved å bruke teknikker som virket som en dårlig passform for transformatorers parallellarkitektur. Kort tid før han dro, slo han av en prat med Allen Institute for AI-forsker Ashish Sabharwal, som hadde studert kompleksitetsteori før han gikk over til AI-forskning. De begynte å mistenke at kompleksitetsteori kunne hjelpe dem å forstå grensene for transformatorer.

«Det virket bare som om det er en enkel modell; det må være noen begrensninger som man bare kan sette fast, sa Sabharwal.

Paret analyserte transformatorer ved å bruke en gren av beregningskompleksitetsteori, kalt kretskompleksitet, som ofte brukes til å studere parallellberegning og hadde nylig blitt brukt til forenklede versjoner av transformatorer. I løpet av året etter foredlet de flere av de urealistiske forutsetningene i tidligere arbeid. For å studere hvordan den parallelle strukturen til transformatorer kan begrense deres evner, vurderte paret tilfellet der transformatorer ikke matet utgangen tilbake til inngangen deres - i stedet måtte deres første utgang være det endelige svaret. De beviste at transformatorene i dette teoretiske rammeverket ikke kunne løse noen beregningsproblemer som ligger utenfor en bestemt kompleksitetsklasse. Og mange matematiske problemer, inkludert relativt enkle som å løse lineære ligninger, antas å ligge utenfor denne klassen.

I utgangspunktet viste de at parallellitet kostet - i hvert fall når transformatorer måtte spytte ut et svar med en gang. "Transformatorer er ganske svake hvis måten du bruker dem på er at du gir innspill, og du bare forventer et umiddelbart svar," sa Merrill.

Tankeeksperimenter

Merrill og Sabharwals resultater reiste et naturlig spørsmål – hvor mye kraftigere blir transformatorer når de får lov til å resirkulere utgangene sine? Barceló og hans medforfattere hadde studert denne saken i deres 2019-analyse av idealiserte transformatorer, men med mer realistiske antakelser forble spørsmålet åpent. Og i de mellomliggende årene hadde forskere oppdaget tankekjede, noe som ga spørsmålet en ny relevans.

Merrill og Sabharwal visste at deres rent matematiske tilnærming ikke kunne fange opp alle aspekter av tankekjede-resonnement i ekte språkmodeller, der ordlyden i ledeteksten kan være veldig viktig. Men uansett hvordan en prompt er formulert, så lenge den får en språkmodell til å gi ut trinnvise løsninger, kan modellen i prinsippet gjenbruke resultatene av mellomtrinn ved påfølgende passeringer gjennom transformatoren. Det kan gi en måte å unngå grensene for parallell beregning.

I mellomtiden hadde et team fra Peking University tenkt i lignende baner, og deres foreløpige resultater var positive. I en artikkel fra mai 2023 identifiserte de noen matematiske problemer som burde være umulige for vanlige transformatorer i Merrill og Sabharwals rammeverk, og viste at mellomtrinn gjorde at transformatorene kunne løse disse problemene.

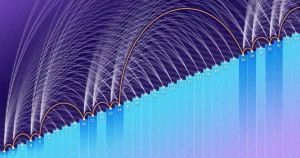

I oktober fulgte Merrill og Sabharwal opp sitt tidligere arbeid med en detaljert teoretisk studie av beregningskraften til tankekjeden. De kvantifiserte hvordan den ekstra beregningskraften avhenger av antall mellomtrinn en transformator har lov til å bruke før den må spytte ut et endelig svar. Generelt forventer forskere at det passende antallet mellomtrinn for å løse ethvert problem vil avhenge av størrelsen på input til problemet. For eksempel krever den enkleste strategien for å legge til to 20-sifrede tall dobbelt så mange mellomliggende addisjonstrinn som den samme tilnærmingen til å legge til to 10-sifrede tall.

Eksempler som dette tyder på at transformatorer ikke vil tjene mye på å bruke bare noen få mellomtrinn. Merrill og Sabharwal beviste faktisk at tankekjeden først virkelig begynner å hjelpe når antall mellomtrinn vokser proporsjonalt med størrelsen på innspillet, og mange problemer krever at antallet mellomtrinn blir mye større.

Grundigheten i resultatet imponerte forskerne. "De har virkelig festet dette," sa Daniel Hsu, en maskinlæringsforsker ved Columbia University.

Merrill og Sabharwals nylige arbeid indikerer at tankekjede ikke er et universalmiddel - i prinsippet kan det hjelpe transformatorer med å løse vanskeligere problemer, men bare på bekostning av mye beregningsinnsats.

"Vi er interessert i forskjellige måter å omgå begrensningene til transformatorer med ett trinn," sa Merrill. "Tankekjede er én vei, men denne artikkelen viser at det kanskje ikke er den mest økonomiske måten."

Tilbake til virkeligheten

Likevel advarer forskere om at denne typen teoretiske analyser bare kan avsløre så mye om ekte språkmodeller. Positive resultater - bevis på at transformatorer i prinsippet kan løse visse problemer - betyr ikke at en språkmodell faktisk vil lære disse løsningene under trening.

Og til og med resultater som tar for seg begrensningene til transformatorer kommer med forbehold: De indikerer at ingen transformator kan løse visse problemer perfekt i alle tilfeller. Selvfølgelig er det en ganske høy bar. "Det kan være spesielle tilfeller av problemet som det kan håndtere helt fint," sa Hsu.

Til tross for disse forbeholdene tilbyr det nye verket en mal for å analysere ulike typer nevrale nettverksarkitekturer som til slutt kan erstatte transformatorer. Hvis en kompleksitetsteorianalyse antyder at visse typer nettverk er kraftigere enn andre, vil det være bevis på at disse nettverkene kan klare seg bedre i den virkelige verden også.

Chiang understreket også at forskning på begrensningene til transformatorer er desto mer verdifull ettersom språkmodeller i økende grad brukes i et bredt spekter av virkelige applikasjoner, noe som gjør det lett å overvurdere deres evner.

"Det er faktisk mange ting som de ikke gjør så bra, og vi må være veldig, veldig klar over hva begrensningene er," sa Chiang. "Det er derfor denne typen arbeid er veldig viktig."

- SEO-drevet innhold og PR-distribusjon. Bli forsterket i dag.

- PlatoData.Network Vertical Generative Ai. Styrk deg selv. Tilgang her.

- PlatoAiStream. Web3 Intelligence. Kunnskap forsterket. Tilgang her.

- PlatoESG. Karbon, CleanTech, Energi, Miljø, Solenergi, Avfallshåndtering. Tilgang her.

- PlatoHelse. Bioteknologisk og klinisk etterretning. Tilgang her.

- kilde: https://www.quantamagazine.org/how-chain-of-thought-reasoning-helps-neural-networks-compute-20240321/

- : har

- :er

- :ikke

- :hvor

- ][s

- $OPP

- 10.

- 20

- 20 år

- 2017

- 2019

- 2021

- 2022

- 2023

- a

- evner

- Om oss

- Logg inn

- tvers

- faktiske

- faktisk

- legge til

- legge

- tillegg

- adresse

- justere

- Etter

- siden

- AI

- ai forskning

- Alan

- Alan Turing

- Alchemy

- Alle

- allen

- tillatt

- tillater

- langs

- allerede

- også

- beløp

- beløp

- an

- analyse

- analysert

- analyserer

- og

- En annen

- besvare

- noen

- søknader

- tilnærming

- tilnærminger

- hensiktsmessig

- vilkårlig

- Arcane

- arkitektur

- arkitekturer

- ER

- rundt

- kunstig

- kunstig intelligens

- AS

- spør

- aspekter

- antagelser

- At

- oppmerksomhet

- borte

- tilbake

- Bar

- basert

- BE

- ble

- bli

- vært

- før du

- begynte

- begynner

- atferd

- Bedre

- mellom

- Beyond

- Bit

- Blokker

- Branch

- bygge

- Bygning

- bygget

- men

- by

- beregning

- som heter

- CAN

- evner

- fangst

- saken

- saker

- årsaker

- forsiktighet

- sentral

- viss

- kjede

- Endringer

- Kapittel

- chatbots

- ChatGPT

- Chile

- klasse

- SAMMENHENGENDE

- Collective

- COLUMBIA

- Kom

- kommer

- kompleksitet

- beregningen

- beregnings

- regnekraft

- beregningsmessig

- Beregn

- datamaskin

- informatikk

- databehandling

- Tilkoblinger

- Vurder

- ansett

- kontekst

- fortsatte

- Samtale

- korrigere

- Kostnad

- kunne

- Kurs

- dato

- datasett

- datoer

- definert

- avhenge

- avhenger

- detaljer

- utvikle

- enhet

- gJORDE

- forskjell

- forskjellig

- vanskelig

- vanskeligheter

- oppdaget

- do

- gjør

- ikke

- ikke

- ned

- under

- hver enkelt

- Tidligere

- lette

- lett

- effekt

- innsats

- innsats

- Åttende

- aktivert

- muliggjør

- enorm

- ligninger

- spesielt

- unngå

- Selv

- etter hvert

- Hver

- bevis

- eksempel

- eksisterer

- forvente

- dyrt

- utforsket

- ekstra

- Face

- FAIL

- Fall

- Noen få

- felt

- slutt~~POS=TRUNC

- slutt

- Først

- passer

- fem

- fikset

- fulgt

- etter

- Til

- formell

- Fjerde

- Rammeverk

- rammer

- fra

- funksjoner

- Gevinst

- general

- generere

- genererer

- få

- få

- Gi

- Giving

- skal

- god

- fikk

- klasse

- oppgradere

- vokste

- Grow

- Vokser

- HAD

- håndtere

- skje

- skjer

- hardere

- harvard

- Harvard University

- Ha

- he

- .

- tung

- hjelpe

- hjelper

- Høy

- hans

- Hvordan

- Hvordan

- http

- HTTPS

- Mennesker

- hundre

- identifisert

- identifisere

- if

- trodd

- umiddelbar

- viktig

- umulig

- imponert

- forbedring

- in

- Inkludert

- Øke

- stadig

- faktisk

- indikerer

- indikerer

- individuelt

- Infinite

- ING

- inngang

- innganger

- innsiden

- innsikt

- inspirert

- i stedet

- Institute

- Intelligens

- interessert

- Internet

- gripe inn

- inn

- egenverdi

- introdusert

- involverer

- IT

- DET ER

- bare

- Type

- slag

- Vet

- Språk

- stor

- større

- største

- Siste

- seinere

- siste

- lag

- lag

- LÆRE

- læring

- minst

- forlater

- løgn

- i likhet med

- Sannsynlig

- BEGRENSE

- begrensninger

- grenser

- linje

- lineær

- linjer

- laste

- Lang

- Lot

- maskin

- maskinlæring

- laget

- magazine

- magi

- gjøre

- GJØR AT

- Making

- mange

- massive

- math

- matematiske

- Saken

- Kan..

- merrill

- kunne

- millioner

- modell

- modeller

- mer

- mest

- flytting

- mye

- flere

- må

- Naturlig

- Trenger

- nødvendig

- nettverk

- nettverk

- nevrale

- nevrale nettverket

- nevrale nettverk

- Nerveceller

- aldri

- Ny

- New York

- neste

- Nei.

- merke seg

- nå

- Antall

- tall

- oktober

- of

- off

- Tilbud

- ofte

- on

- ONE

- seg

- bare

- videre til

- åpen

- drift

- Drift

- optimalisert

- vanlig

- Annen

- andre

- ut

- produksjon

- utganger

- utenfor

- enn

- par

- universalmiddel

- Papir

- Parallel

- parametere

- passere

- passerer

- Past

- Tålmodighet

- Peking

- perfekt

- Utfør

- ytelse

- kanskje

- Sted

- plato

- Platon Data Intelligence

- PlatonData

- Point

- dårlig

- positiv

- mulig

- makt

- kraftig

- Praktisk

- forutsi

- forutsi

- prediksjon

- Spådommer

- innledende

- pen

- forrige

- tidligere

- prinsipp

- sannsynligvis

- Problem

- problemer

- prosedyren

- prosess

- prosessering

- prosessorer

- produsere

- programmerbar

- bevis

- Andelen

- foreslått

- beviste

- gi

- beviser

- rent

- Skyv

- Quantamagazin

- kvantifisert

- spørsmål

- spørsmål

- raskt

- ganske

- hevet

- tilfeldig

- område

- å nå

- Lesning

- ekte

- virkelige verden

- realistisk

- Reality

- virkelig

- nylig

- redusere

- raffinert

- relativt

- relevans

- relevant

- forble

- fjerne

- GJENTATTE GANGER

- erstatte

- representerer

- krever

- påkrevd

- Krever

- forskning

- forsker

- forskere

- Ressurser

- Svare

- resultere

- Resultater

- gjenbruk

- avsløre

- ikke sant

- Sa

- samme

- Skala

- skalering

- skanne

- Skole

- Vitenskap

- Seattle

- Sekund

- syntes

- synes

- sett

- Sees

- sett

- sett

- syv

- flere

- Om kort tid

- bør

- Vis

- viste

- Viser

- lignende

- Enkelt

- forenklet

- ganske enkelt

- samtidig

- siden

- Størrelse

- mindre

- So

- Solutions

- LØSE

- løse

- noen

- en eller annen måte

- snart

- spesiell

- spesifikk

- hastigheter

- spre

- stabling

- Begynn

- Start

- Trinn

- Steps

- Still

- Strategi

- styrke

- struktur

- strukturer

- Student

- studert

- studier

- Studer

- Studerer

- senere

- slik

- foreslår

- foreslår

- Systemer

- tandem

- oppgaver

- lag

- lag

- teknikk

- teknikker

- mal

- tekst

- enn

- Det

- De

- deres

- Dem

- deretter

- teoretiske

- teori

- Der.

- Disse

- de

- ting

- ting

- tenker

- Tredje

- denne

- De

- trodde

- Gjennom

- tid

- til

- i dag

- tok

- mot

- Tog

- Kurs

- transformative

- transformator

- transformers

- behandling

- Trillion

- problemer

- prøve

- Turing

- SVING

- tweak

- tweaks

- To ganger

- to

- typen

- typer

- typisk

- forstå

- universitet

- med mindre

- bruke

- brukt

- nyttig

- bruker

- ved hjelp av

- Verdifull

- Verdier

- versjon

- versjoner

- veldig

- Se

- gå

- ønsker

- var

- Vei..

- måter

- we

- svak

- web

- webp

- VI VIL

- velkjent

- var

- Hva

- når

- om

- hvilken

- mens

- hele

- hvem sin

- hvorfor

- bred

- Bred rekkevidde

- utbredt

- vil

- med

- uten

- lurer

- ord

- ordlyden

- ord

- Arbeid

- arbeidet

- arbeid

- verden

- ville

- skrive

- skriving

- år

- år

- york

- Du

- zephyrnet