Dette innlegget er skrevet sammen med Jan Paul Assendorp, Thomas Lietzow, Christopher Masch, Alexander Meinert, Dr. Lars Palzer, Jan Schillemans fra SIGNAL IDUNA.

Hos SIGNAL IDUNA, et stort tysk forsikringsselskap, gjenoppfinner vi oss selv med vårt transformasjonsprogram VISION2023 for å bli enda mer kundeorientert. To aspekter er sentrale i denne transformasjonen: omorganisering av store deler av arbeidsstyrken til tverrfunksjonelle og smidige team, og å bli et virkelig datadrevet selskap. Her er mottoet «You build it, you run it» et viktig krav for et tverrfunksjonelt team som bygger et data- eller maskinlæringsprodukt (ML). Dette setter stramme begrensninger på hvor mye arbeid teamet kan bruke på å produsere og drive et produkt.

Dette innlegget viser hvordan SIGNAL IDUNA takler denne utfordringen og bruker AWS Cloud for å gjøre det mulig for tverrfunksjonelle team å bygge og operasjonalisere sine egne ML-produkter. For dette formål introduserer vi først organisasjonsstrukturen til smidige team, som setter de sentrale kravene til skyinfrastrukturen som brukes til å utvikle og drive et produkt. Deretter viser vi hvordan tre sentrale team hos SIGNAL IDUNA gjør det mulig for tverrfunksjonelle team å bygge dataprodukter i AWS Cloud med minimal assistanse, ved å tilby en passende arbeidsflyt og infrastrukturløsninger som enkelt kan brukes og tilpasses. Til slutt gjennomgår vi vår tilnærming og sammenligner den med en mer klassisk tilnærming hvor utvikling og drift er strengere atskilt.

Agile@SI – grunnlaget for organisasjonsendringer

Siden starten av 2021 har SIGNAL IDUNA begynt å sette sin strategi Agile@SI ut i livet og etablere smidige metoder for å utvikle kundeorienterte løsninger på tvers av hele selskapet [1]. Tidligere oppgaver og mål blir nå utført av tverrfunksjonelle team, kalt tropper. Disse troppene bruker smidige metoder (som Scrum-rammeverket), tar sine egne beslutninger og bygger kundeorienterte produkter. Vanligvis er troppene lokalisert i forretningsdivisjoner, som markedsføring, og mange har stor vekt på å bygge datadrevne og ML-drevne produkter. Som et eksempel er typiske brukstilfeller i forsikring forutsigelse av kundeavgang og produktanbefaling.

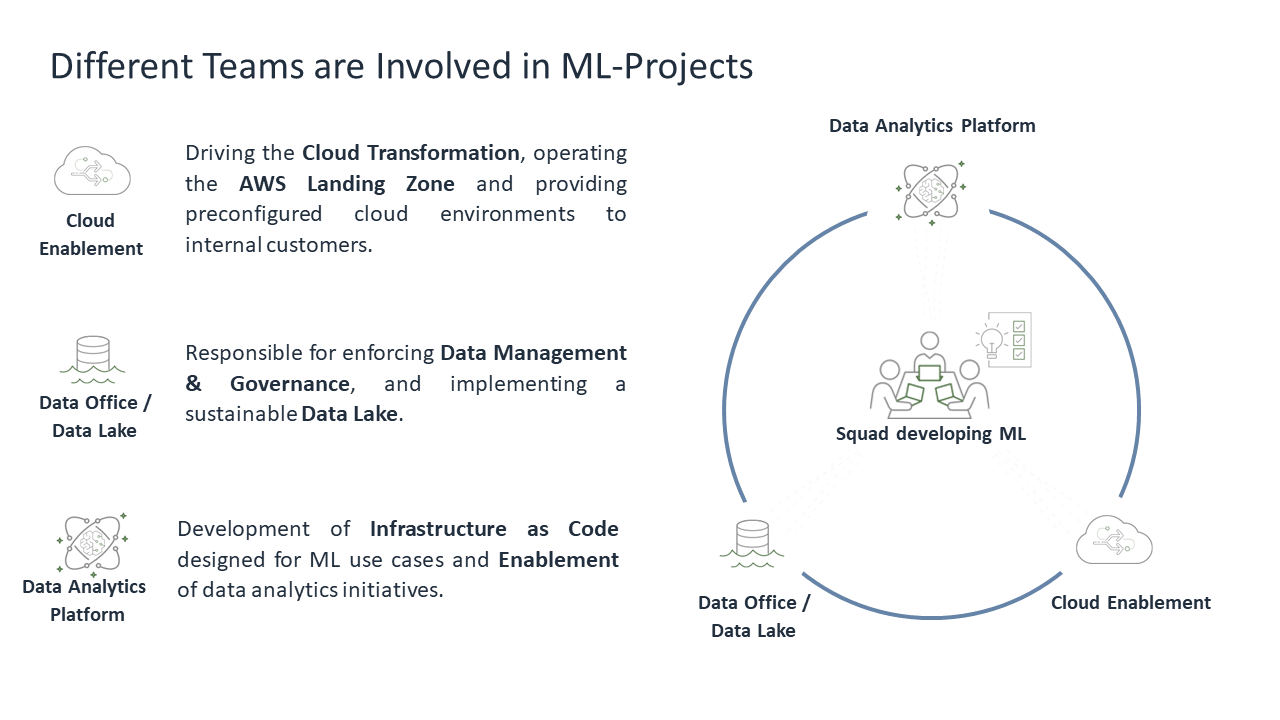

På grunn av kompleksiteten til ML, er det utfordrende å lage en ML-løsning av en enkelt tropp, og krever derfor samarbeid mellom forskjellige lag.

SIGNAL IDUNA har tre essensielle team som støtter å lage ML-løsninger. Omgitt av disse tre troppene er teamet som er ansvarlig for utviklingen og den langsiktige driften og av ML-løsningen. Denne tilnærmingen følger AWS delt ansvarsmodell [2].

På bildet over er alle troppene representert i en oversikt.

Skyaktivering

Den underliggende skyinfrastrukturen for hele organisasjonen leveres av troppen Cloud Enablement. Det er deres oppgave å gjøre det mulig for teamene å bygge produkter på skyteknologier på egenhånd. Dette forbedrer tiden til å markedsføre nye produkter som ML, og det følger prinsippet om "Du bygger det, du kjører det".

Datakontor/Data Lake

Flytting av data inn i skyen, samt å finne riktig datasett, støttes av troppen Data Office/Data Lake. De setter opp en datakatalog som kan brukes til å søke og velge nødvendige datasett. Målet deres er å etablere datatransparens og styring. I tillegg er de ansvarlige for å etablere og drifte en Data Lake som hjelper team med å få tilgang til og behandle relevante data.

Dataanalyseplattform

Squad Data Analytics Platform (DAP) er et sky- og ML-fokusert team hos SIGNAL IDUNA som er dyktige i ML-teknikk, datateknikk, så vel som datavitenskap. Vi muliggjør interne team som bruker offentlig sky for ML ved å tilby infrastrukturkomponenter og kunnskap. Våre produkter og tjenester presenteres i detalj i den følgende delen.

Gjør det mulig for tverrfunksjonelle team å bygge ML-løsninger

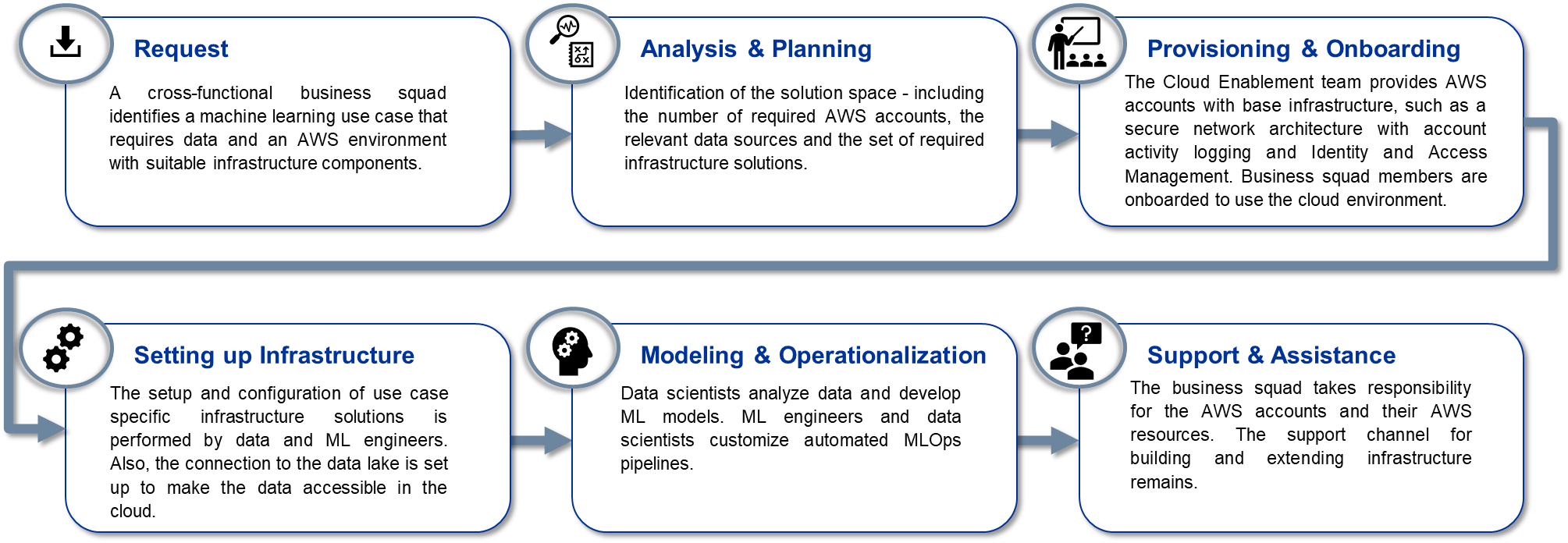

For å gjøre det mulig for tverrfunksjonelle team hos SIGNAL IDUNA å bygge ML-løsninger, trenger vi en rask og allsidig måte å levere gjenbrukbar skyinfrastruktur på, samt en effektiv arbeidsflyt for onboarding-team for å utnytte skyfunksjonene.

For dette formål opprettet vi en standardisert onboarding- og støtteprosess, og leverte modulære infrastrukturmaler som Infrastructure as Code (IaC). Disse malene inneholder infrastrukturkomponenter designet for vanlige ML-brukstilfeller som enkelt kan skreddersys til kravene til en spesifikk brukstilfelle.

Arbeidsflyten til å bygge ML-løsninger

Det er tre tekniske hovedroller involvert i å bygge og drifte ML-løsninger: Dataforskeren, ML-ingeniøren og en dataingeniør. Hver rolle er en del av den tverrfunksjonelle troppen og har ulike ansvarsområder. Dataforskeren har nødvendig domenekunnskap om funksjonelle så vel som tekniske krav til brukssaken. ML-ingeniøren spesialiserer seg på å bygge automatiserte ML-løsninger og modellimplementering. Og dataingeniøren sørger for at dataene flyter fra lokale og i skyen.

Prosessen med å tilby plattformen er som følger:

Infrastrukturen til den spesifikke brukssaken er definert i IaC og versjonert i et sentralt prosjektlager. Dette inkluderer også rørledninger for modelltrening og utplassering, samt andre datavitenskapsrelaterte kodeartefakter. Dataforskere, ML-ingeniører og dataingeniører har tilgang til prosjektlageret og kan konfigurere og oppdatere all infrastrukturkoden autonomt. Dette gjør at teamet raskt kan endre infrastrukturen om nødvendig. Imidlertid kan ML-ingeniøren alltid støtte i utvikling og oppdatering av infrastruktur eller ML-modeller.

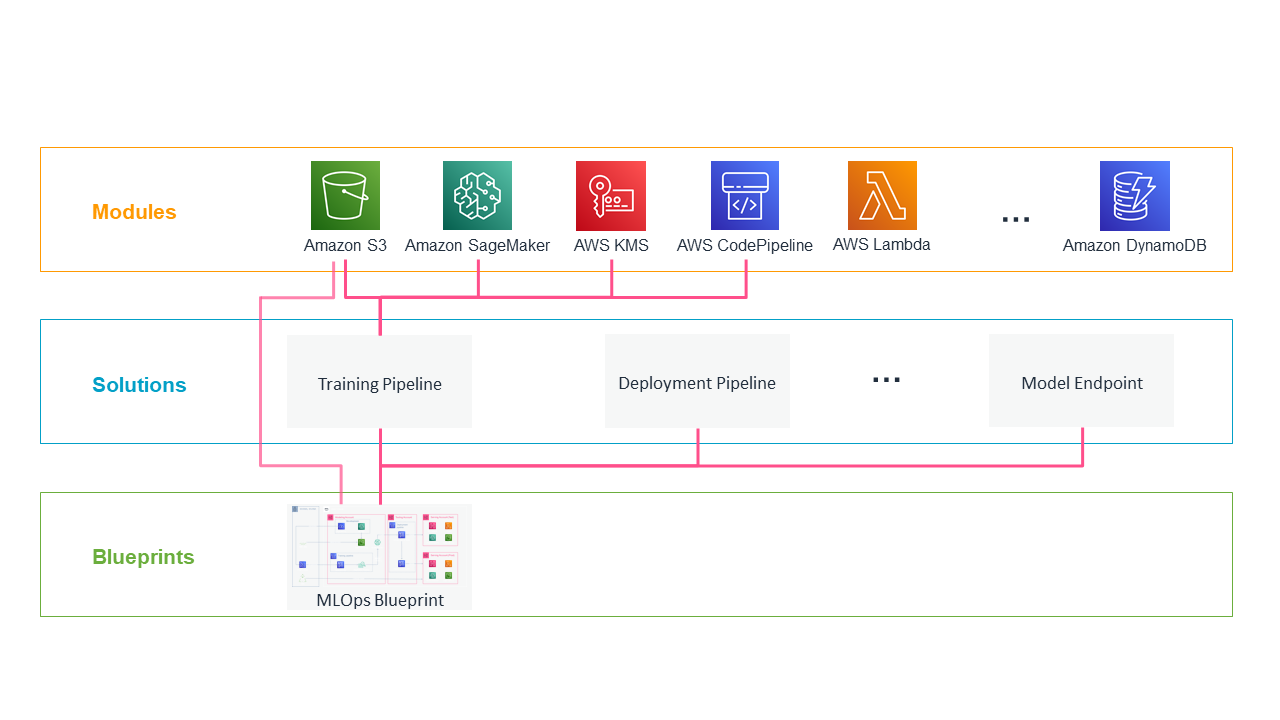

Gjenbrukbare og modulære infrastrukturkomponenter

De hierarkiske og modulære IaC-ressursene er implementert i terra og inkluderer infrastruktur for vanlig datavitenskap og ETL-brukstilfeller. Dette lar oss gjenbruke infrastrukturkode og håndheve nødvendige retningslinjer for sikkerhet og samsvar, for eksempel bruk AWS Key Management Service (KMS) kryptering for data, samt innkapsling av infrastruktur i Amazon Virtual Private Cloud (VPC) miljøer uten direkte internettilgang.

Den hierarkiske IaC-strukturen er som følger:

- Moduler innkapsle grunnleggende AWS-tjenester med den nødvendige konfigurasjonen for sikkerhet og tilgangsadministrasjon. Dette inkluderer beste praksis-konfigurasjoner som forhindring av offentlig tilgang til Amazon Simple Storage Service (S3) bøtter, eller håndheve kryptering for alle lagrede filer.

- I noen tilfeller trenger du en rekke tjenester for å automatisere prosesser, for eksempel å distribuere ML-modeller i forskjellige stadier. Derfor definerte vi Solutions som en bunt av ulike moduler i en felles konfigurasjon for ulike typer oppgaver.

- I tillegg tilbyr vi komplett Blueprints som kombinerer løsninger i ulike miljøer for å møte de mange potensielle behovene til et prosjekt. I MLOps-planen vår definerer vi en distribuerbar infrastruktur for opplæring, klargjøring og overvåking av ML-modeller som er integrert og distribuert i AWS-kontoer. Vi diskuterer ytterligere detaljer i neste avsnitt.

Disse produktene er versjonert i et sentralt depot av DAP-troppen. Dette lar oss kontinuerlig forbedre vår IaC og vurdere nye funksjoner fra AWS, som f.eks Amazon SageMaker Modellregister. Hvert lag kan referere til disse ressursene, parameterisere dem etter behov, og til slutt distribuere dem i sine egne AWS-kontoer.

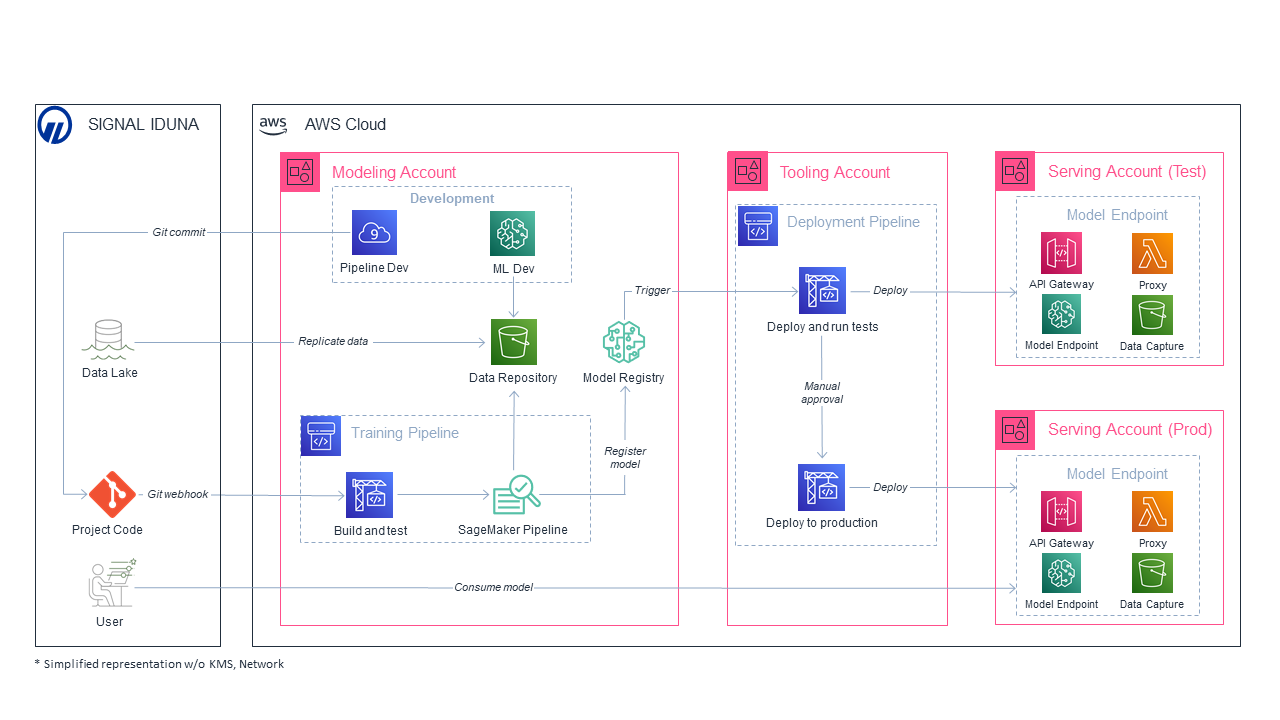

MLOps arkitektur

Vi tilbyr en klar-til-bruk planløsning med spesifikke løsninger for å dekke hele MLOps-prosessen. Planen inneholder infrastruktur fordelt på fire AWS-kontoer for å bygge og distribuere ML-modeller. Dette lar oss isolere ressurser og arbeidsflyter for de forskjellige trinnene i MLOps-prosessen. Følgende figur viser flerkontoarkitekturen, og vi beskriver hvordan ansvaret over spesifikke trinn i prosessen er fordelt mellom de ulike tekniske rollene.

De modellering konto inkluderer tjenester for utvikling av ML-modeller. For det første bruker dataingeniøren en ETL-prosess for å gi relevante data fra SIGNAL IDUNA-datasjøen, den sentraliserte gatewayen for datadrevne arbeidsflyter i AWS-skyen. Deretter kan datasettet brukes av dataforskeren til å trene og evaluere modellkandidater. Når den er klar for omfattende eksperimenter, integreres en modellkandidat i en automatisert treningspipeline av ML-ingeniøren. Vi bruker Amazon SageMaker Pipelines for å automatisere trening, hyperparameterinnstilling og modellevaluering i stor skala. Dette inkluderer også modellavstamning og en standardisert godkjenningsmekanisme for modeller som skal settes opp for distribusjon i produksjon. Automatiserte enhetstester og kodeanalyse sikrer kvalitet og pålitelighet av koden for hvert trinn i rørledningen, slik som dataforbehandling, modellopplæring og evaluering. Når en modell er evaluert og godkjent, bruker vi Amazon SageMaker ModelPackages som et grensesnitt til den trente modellen og relevante metadata.

De verktøy konto inneholder automatiserte CI/CD-rørledninger med forskjellige stadier for testing og distribusjon av trente modeller. I teststadiet blir modeller distribuert inn i servering-nonprod regnskap. Selv om modellkvalitet blir evaluert i opplæringspipelinen før modellen settes opp for produksjon, kjører vi her ytelses- og integrasjonstester i et isolert testmiljø. Etter å ha bestått teststadiet, distribueres modellene i serverings-prod konto som skal integreres i produksjonsarbeidsflyter.

Å separere stadiene i MLOps-arbeidsflyten i forskjellige AWS-kontoer lar oss isolere utvikling og testing fra produksjon. Derfor kan vi håndheve en streng tilgangs- og sikkerhetspolicy. Videre sikrer skreddersydde IAM-roller at spesifikke tjenester bare kan få tilgang til data og andre tjenester som kreves for dens omfang, etter prinsippet om minst privilegium. Tjenester innenfor serveringsmiljøene kan i tillegg gjøres tilgjengelige for eksterne forretningsprosesser. For eksempel kan en forretningsprosess forespørre et endepunkt i serverings-prod-miljøet for modellprediksjoner.

Fordeler med vår tilnærming

Denne prosessen har mange fordeler sammenlignet med en streng separasjon av utvikling og drift for både ML-modellene, så vel som den nødvendige infrastrukturen:

- Isolasjon: Hvert team mottar sitt eget sett med AWS-kontoer som er fullstendig isolert fra andre teams miljøer. Dette gjør det enkelt å administrere tilgangsrettigheter og holde dataene private for de som har rett til å jobbe med dem.

- Skyaktivering: Teammedlemmer med lite tidligere erfaring i sky-DevOps (som mange dataforskere) kan enkelt se hele prosessen med å designe og administrere infrastruktur siden (nesten) ingenting er skjult for dem bak en sentral tjeneste. Dette skaper en bedre forståelse av infrastrukturen, som igjen kan hjelpe dem med å lage datavitenskapelige produkter mer effektivt.

- Produkteierskap: Bruken av forhåndskonfigurerte infrastrukturløsninger og administrerte tjenester holder barrieren for å administrere et ML-produkt i produksjon svært lav. Derfor kan en dataforsker enkelt ta eierskap til en modell som settes i produksjon. Dette minimerer den velkjente risikoen for å unnlate å sette en modell i produksjon etter utvikling.

- Innovasjon: Siden ML-ingeniører er involvert lenge før en modell er klar til å settes i produksjon, kan de lage infrastrukturløsninger som egner seg for nye brukstilfeller mens dataforskerne utvikler en ML-modell.

- Tilpasningsevne: Siden IaC-løsningen utviklet av DAP er fritt tilgjengelig, kan ethvert team enkelt tilpasse disse for å matche et spesifikt behov for deres brukstilfelle.

- Åpen kilde: Alle nye infrastrukturløsninger kan enkelt gjøres tilgjengelige via den sentrale DAP-kodereposen for å brukes av andre team. Over tid vil dette skape en rik kodebase med infrastrukturkomponenter skreddersydd for ulike brukstilfeller.

Oppsummering

I dette innlegget illustrerte vi hvordan tverrfunksjonelle team hos SIGNAL IDUNA blir satt i stand til å bygge og kjøre ML-produkter på AWS. Sentralt i vår tilnærming er bruken av et dedikert sett med AWS-kontoer for hvert team i kombinasjon med skreddersydde IaC-planer og løsninger. Disse to komponentene gjør det mulig for et tverrfunksjonelt team å skape og drifte infrastruktur for produksjonskvalitet. På sin side kan de ta fullt ende-til-ende-eierskap av ML-produktene sine.

Referere til Amazon SageMaker Model Building Pipelines – Amazon SageMaker for å lære mer.

Finn mer informasjon om ML på AWS på vår offisielle side.

Referanser

[1] https://www.handelsblatt.com/finanzen/versicherungsbranche-vorbild-spotify-signal-iduna-wird-von-einer-handwerker-versicherung-zum-agilen-konzern/27381902.html

[2] https://blog.crisp.se/wp-content/uploads/2012/11/SpotifyScaling.pdf

[3] https://aws.amazon.com/compliance/shared-responsibility-model/

Om forfatterne

Jan Paul Assendorp er en ML-ingeniør med et sterkt datavitenskapelig fokus. Han bygger ML-modeller og automatiserer modellopplæring og distribusjon i produksjonsmiljøer.

Jan Paul Assendorp er en ML-ingeniør med et sterkt datavitenskapelig fokus. Han bygger ML-modeller og automatiserer modellopplæring og distribusjon i produksjonsmiljøer.

Thomas Lietzow er Scrum Master of the squad Data Analytics Platform.

Thomas Lietzow er Scrum Master of the squad Data Analytics Platform.

Christopher Masch er produkteier av troppen Data Analytics Platform med kunnskap innen datateknikk, datavitenskap og ML-teknikk.

Christopher Masch er produkteier av troppen Data Analytics Platform med kunnskap innen datateknikk, datavitenskap og ML-teknikk.

Alexander Meinert er en del av Data Analytics Platform-teamet og jobber som ML-ingeniør. Startet med statistikk, vokste på datavitenskapelige prosjekter, fant lidenskap for ML-metoder og arkitektur.

Alexander Meinert er en del av Data Analytics Platform-teamet og jobber som ML-ingeniør. Startet med statistikk, vokste på datavitenskapelige prosjekter, fant lidenskap for ML-metoder og arkitektur.

Dr. Lars Palzer er dataforsker og en del av Data Analytics Platform-teamet. Etter å ha hjulpet til med å bygge MLOps-arkitekturkomponentene, bruker han dem nå til å bygge ML-produkter.

Dr. Lars Palzer er dataforsker og en del av Data Analytics Platform-teamet. Etter å ha hjulpet til med å bygge MLOps-arkitekturkomponentene, bruker han dem nå til å bygge ML-produkter.

Jan Schillemans er en ML-ingeniør med en programvareingeniørbakgrunn. Han fokuserer på å bruke beste praksis for programvareutvikling på ML-miljøer (MLOps).

Jan Schillemans er en ML-ingeniør med en programvareingeniørbakgrunn. Han fokuserer på å bruke beste praksis for programvareutvikling på ML-miljøer (MLOps).

- Myntsmart. Europas beste Bitcoin og Crypto Exchange.

- Platoblokkkjede. Web3 Metaverse Intelligence. Kunnskap forsterket. FRI TILGANG.

- CryptoHawk. Altcoin Radar. Gratis prøveperiode.

- Kilde: https://aws.amazon.com/blogs/machine-learning/how-signal-iduna-operationalizes-machine-learning-projects-on-aws/

- "

- 100

- 2021

- adgang

- Logg inn

- tvers

- Handling

- fordeler

- smidig

- Alle

- Selv

- Amazon

- analyse

- analytics

- påføring

- tilnærming

- arkitektur

- Automatisert

- tilgjengelig

- AWS

- være

- BEST

- beste praksis

- bygge

- Bygning

- XNUMX bunk

- virksomhet

- evner

- saker

- utfordre

- Cloud

- sky infrastruktur

- kode

- samarbeid

- kombinasjon

- Felles

- Selskapet

- sammenlignet

- samsvar

- Konfigurasjon

- inneholder

- Opprette

- dato

- Data Analytics

- datavitenskap

- dataforsker

- dedikert

- utplassere

- utplasserings

- distribusjon

- utforme

- detalj

- utvikle

- utviklet

- utvikle

- Utvikling

- forskjellig

- diskutere

- distribueres

- domene

- lett

- kryptering

- Endpoint

- ingeniør

- Ingeniørarbeid

- Ingeniører

- Miljø

- avgjørende

- etablere

- eksempel

- erfaring

- FAST

- Egenskaper

- Figur

- Endelig

- Først

- Fokus

- fokuserte

- etter

- funnet

- Fundament

- Rammeverk

- fullt

- Mål

- styresett

- hjelpe

- hjelper

- her.

- Hvordan

- HTTPS

- bilde

- implementert

- viktig

- forbedre

- inkludere

- informasjon

- Infrastruktur

- forsikring

- integrert

- integrering

- Interface

- Internet

- involvert

- IT

- nøkkel

- kunnskap

- stor

- LÆRE

- læring

- lite

- Lang

- maskin

- maskinlæring

- ledelse

- administrerende

- marked

- Marketing

- Match

- medlemmer

- Meta

- ML

- modell

- modeller

- modulære

- overvåking

- Nye funksjoner

- nye produkter

- tilby

- offisiell

- onboarding

- drift

- organisasjon

- Annen

- eieren

- ytelse

- plattform

- Politikk

- politikk

- prediksjon

- Spådommer

- Forebygging

- privat

- prosess

- Prosesser

- Produkt

- Produksjon

- Produkter

- program

- prosjekt

- prosjekter

- gi

- offentlig

- Offentlig sky

- kvalitet

- Repository

- påkrevd

- Krav

- Ressurser

- ansvarlig

- anmeldelse

- Risiko

- Kjør

- Skala

- Vitenskap

- Forsker

- forskere

- Søk

- sikkerhet

- tjeneste

- Tjenester

- servering

- sett

- delt

- Enkelt

- Software

- software engineering

- Solutions

- spesialisert

- bruke

- Scene

- Begynn

- startet

- statistikk

- lagring

- Strategi

- sterk

- I ettertid

- støtte

- Støttes

- omgitt

- oppgaver

- lag

- Teknisk

- Technologies

- test

- Testing

- tester

- tid

- Kurs

- Transformation

- Åpenhet

- Oppdater

- us

- bruke

- bruke

- virtuelle

- Se

- HVEM

- innenfor

- uten

- Arbeid

- arbeidsstyrke

- virker