Dette innlegget er skrevet av Ramdev Wudali og Kiran Mantripragada fra Thomson Reuters.

I 1992, Thomson Reuters (TR) ga ut sin første AI juridiske forskningstjeneste, WIN (Westlaw Is Natural), en innovasjon på den tiden, ettersom de fleste søkemotorer kun støttet boolske termer og koblinger. Siden den gang har TR oppnådd mange flere milepæler ettersom AI-produktene og -tjenestene deres kontinuerlig vokser i antall og variasjon, og støtter fagfolk innen juridiske, skattemessige, regnskapsmessige, compliance- og nyhetstjenester over hele verden, med milliarder av maskinlæring (ML)-innsikt generert hvert år .

Med denne enorme økningen av AI-tjenester, var neste milepæl for TR å effektivisere innovasjon og lette samarbeid. Standardiser bygging og gjenbruk av AI-løsninger på tvers av forretningsfunksjoner og AI-utøveres personas, samtidig som du sikrer overholdelse av bedriftens beste praksis:

- Automatiser og standardiser den repeterende udifferensierte ingeniørarbeidet

- Sikre nødvendig isolasjon og kontroll av sensitive data i henhold til vanlige styringsstandarder

- Gi enkel tilgang til skalerbare dataressurser

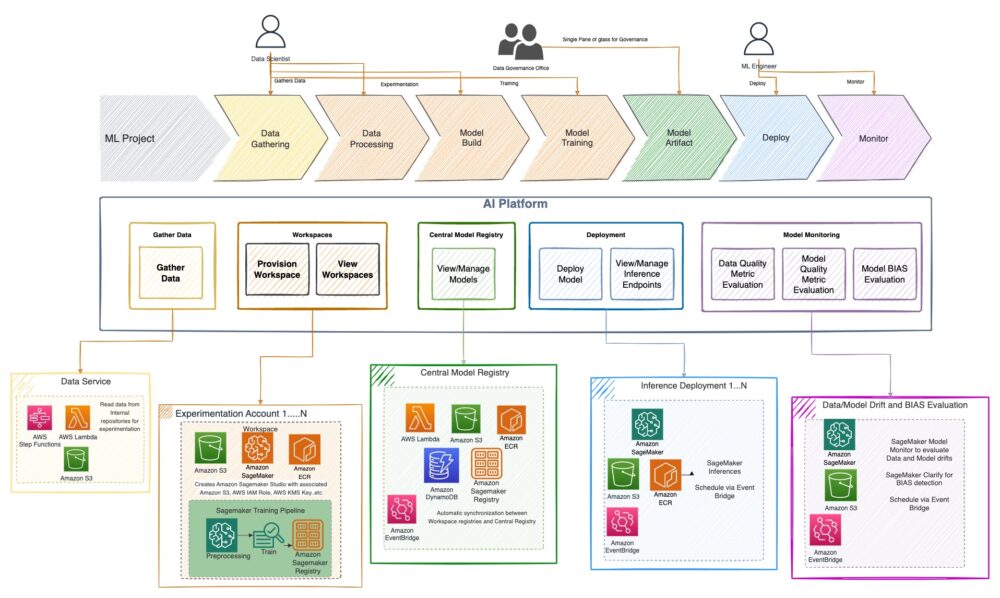

For å oppfylle disse kravene bygde TR Enterprise AI-plattformen rundt følgende fem pilarer: en datatjeneste, eksperimenteringsarbeidsområde, sentralt modellregister, modelldistribusjonstjeneste og modellovervåking.

I dette innlegget diskuterer vi hvordan TR og AWS samarbeidet om å utvikle TRs første Enterprise AI-plattform noensinne, et nettbasert verktøy som vil gi muligheter som spenner fra ML-eksperimentering, opplæring, et sentralt modellregister, modelldistribusjon og modellovervåking. Alle disse egenskapene er bygget for å møte TRs stadig utviklende sikkerhetsstandarder og tilby enkle, sikre og kompatible tjenester til sluttbrukere. Vi deler også hvordan TR muliggjorde overvåking og styring for ML-modeller opprettet på tvers av ulike forretningsenheter med én enkelt glassrute.

Utfordringene

Historisk ved TR har ML vært en funksjon for team med avanserte dataforskere og ingeniører. Team med svært dyktige ressurser var i stand til å implementere komplekse ML-prosesser i henhold til deres behov, men ble raskt svært silo. Siled tilnærminger ga ikke noen synlighet for å gi styring i ekstremt kritiske beslutningstaking spådommer.

TR-bedriftsteam har stor domenekunnskap; Imidlertid gjør de tekniske ferdighetene og den tunge ingeniørinnsatsen som kreves i ML det vanskelig å bruke deres dype ekspertise til å løse forretningsproblemer med kraften til ML. TR ønsker å demokratisere kompetansen, gjøre den tilgjengelig for flere personer i organisasjonen.

Ulike team i TR følger sin egen praksis og metodikk. TR ønsker å bygge funksjonene som spenner over hele ML-livssyklusen til sine brukere for å akselerere leveringen av ML-prosjekter ved å la team fokusere på forretningsmål og ikke på den repeterende udifferensierte ingeniørinnsatsen.

I tillegg fortsetter regelverket rundt data og etisk AI å utvikle seg, og krever felles styringsstandarder på tvers av TRs AI-løsninger.

Løsningsoversikt

TRs Enterprise AI-plattform ble tenkt å tilby enkle og standardiserte tjenester til forskjellige personer, og tilby muligheter for alle stadier av ML-livssyklusen. TR har identifisert fem hovedkategorier som modulariserer alle TRs krav:

- Datatjeneste – For å muliggjøre enkel og sikker tilgang til bedriftens dataressurser

- Eksperimenteringsarbeidsområde – Å gi muligheter til å eksperimentere og trene ML-modeller

- Sentralt modellregister – En bedriftskatalog for modeller bygget på tvers av ulike forretningsenheter

- Modelldistribusjonstjeneste – For å tilby ulike slutningsdistribusjonsalternativer i henhold til TRs bedrifts CI/CD-praksis

- Modellovervåkingstjenester – Å gi muligheter til å overvåke data og modellskjevhet og drift

Som vist i følgende diagram, er disse mikrotjenestene bygget med noen få nøkkelprinsipper i tankene:

- Fjern den udifferensierte ingeniørarbeidet fra brukerne

- Gi de nødvendige egenskapene ved å klikke på en knapp

- Sikre og styr alle funksjoner i henhold til TRs bedriftsstandarder

- Ta med en enkelt glassrute for ML-aktiviteter

TRs AI Platform-mikrotjenester er bygget med Amazon SageMaker som kjernemotor, AWS-serverløse komponenter for arbeidsflyter og AWS DevOps-tjenester for CI/CD-praksis. SageMaker Studio brukes til eksperimentering og trening, og SageMaker modellregisteret brukes til å registrere modeller. Det sentrale modellregisteret består av både SageMaker modellregister og en Amazon DynamoDB tabellen. SageMaker vertstjenester brukes til å distribuere modeller, mens SageMaker modellmonitor og SageMaker Avklare brukes til å overvåke modeller for drift, skjevhet, tilpassede metriske kalkulatorer og forklarbarhet.

De følgende avsnittene beskriver disse tjenestene i detalj.

Datatjeneste

En tradisjonell ML-prosjektlivssyklus starter med å finne data. Generelt bruker dataforskere 60 % eller mer av tiden sin på å finne de riktige dataene når de trenger det. Akkurat som enhver organisasjon har TR flere datalagre som fungerer som et enkelt sannhetspunkt for forskjellige datadomener. TR identifiserte to viktige bedriftsdatalagre som gir data for de fleste av deres ML-brukstilfeller: et objektlager og et relasjonsdatalager. TR bygde en AI Platform-datatjeneste for å sømløst gi tilgang til begge datalagrene fra brukernes eksperimenteringsarbeidsområder og fjerne byrden fra brukerne for å navigere i komplekse prosesser for å skaffe data på egenhånd. TRs AI-plattform følger alle samsvar og beste praksis definert av data- og modellstyringsteamet. Dette inkluderer en obligatorisk Data Impact Assessment som hjelper ML-utøvere til å forstå og følge den etiske og hensiktsmessige bruken av data, med formelle godkjenningsprosesser for å sikre riktig tilgang til dataene. Kjernen i denne tjenesten, så vel som alle plattformtjenester, er sikkerhet og samsvar i henhold til beste praksis fastsatt av TR og bransjen.

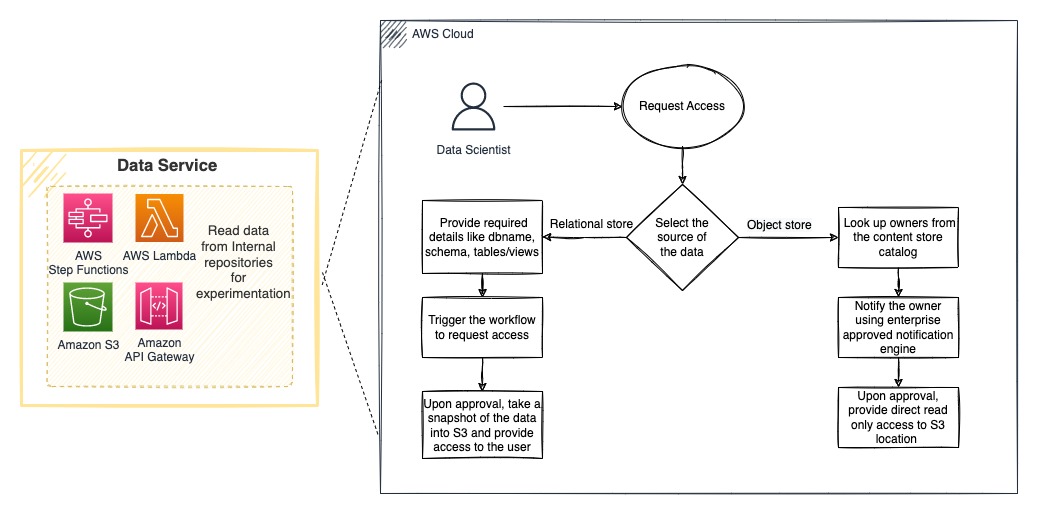

Amazon enkel lagringstjeneste (Amazon S3) objektlagring fungerer som en innholdsdatainnsjø. TR bygde prosesser for sikker tilgang til data fra innholdsdatasjøen til brukernes eksperimenteringsarbeidsområder, samtidig som nødvendig autorisasjon og revisjonsevne ble opprettholdt. Snowflake brukes som bedriftens relasjonsdatalager. På brukerforespørsel og basert på godkjenning fra dataeieren, gir AI Platform-datatjenesten et øyeblikksbilde av dataene til brukeren lett tilgjengelig i deres eksperimenteringsarbeidsområde.

Å få tilgang til data fra ulike kilder er et teknisk problem som enkelt kan løses. Men kompleksiteten TR har løst er å bygge godkjenningsarbeidsflyter som automatiserer identifisering av dataeieren, sende en tilgangsforespørsel, sørge for at dataeieren blir varslet om at de har en ventende tilgangsforespørsel, og basert på godkjenningsstatusen iverksette tiltak for å gi data til rekvirenten. Alle hendelsene gjennom denne prosessen spores og logges for reviderbarhet og samsvar.

Som vist i følgende diagram, bruker TR AWS trinnfunksjoner å orkestrere arbeidsflyten og AWS Lambda for å kjøre funksjonaliteten. Amazon API-gateway brukes til å eksponere funksjonaliteten med et API-endepunkt som skal konsumeres fra deres nettportal.

Modelleksperimentering og utvikling

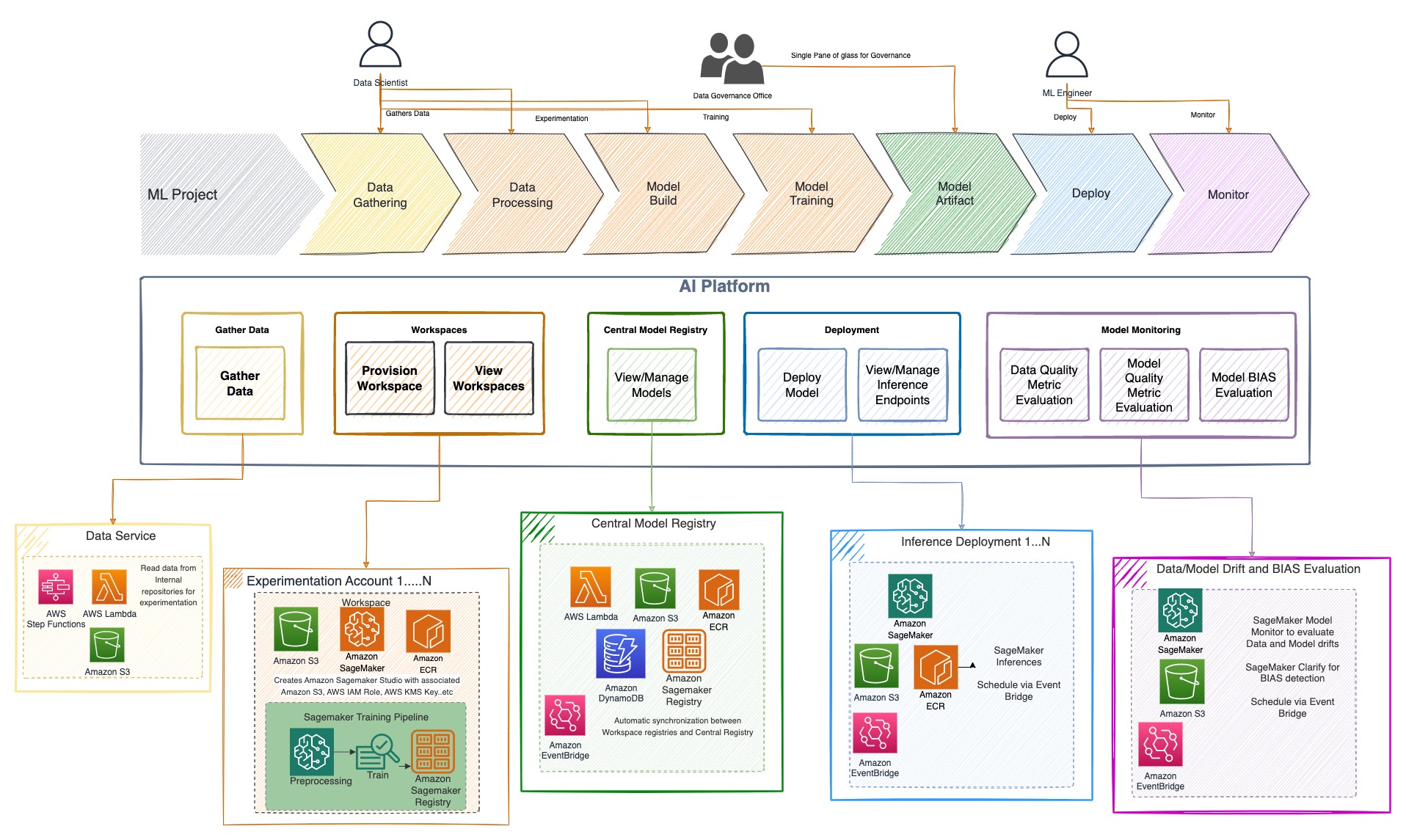

En viktig funksjon for å standardisere ML-livssyklusen er et miljø som lar dataforskere eksperimentere med forskjellige ML-rammeverk og datastørrelser. Å aktivere et slikt sikkert, kompatibelt miljø i skyen i løpet av få minutter, fritar dataforskere fra byrden med å håndtere skyinfrastruktur, nettverkskrav og sikkerhetsstandardtiltak, for å fokusere i stedet på datavitenskapsproblemet.

TR bygger et eksperimenteringsarbeidsområde som tilbyr tilgang til tjenester som f.eks AWS Lim, Amazon EMR, og SageMaker Studio for å muliggjøre databehandling og ML-funksjoner som følger bedriftens skysikkerhetsstandarder og nødvendig kontoisolering for hver forretningsenhet. TR har støtt på følgende utfordringer under implementeringen av løsningen:

- Orkestrering var tidlig ikke helt automatisert og innebar flere manuelle trinn. Det var ikke lett å spore opp hvor det oppsto problemer. TR overvant denne feilen ved å orkestrere arbeidsflytene ved hjelp av Step Functions. Med bruk av Step Functions ble det mye enklere å bygge komplekse arbeidsflyter, administrere tilstander og feilhåndtering.

- riktig AWS identitets- og tilgangsadministrasjon (IAM) rolledefinisjon for eksperimenteringsarbeidsområdet var vanskelig å definere. For å overholde TRs interne sikkerhetsstandarder og minst privilegerte modell ble arbeidsområderollen opprinnelig definert med innebygde retningslinjer. Følgelig vokste den innebygde policyen med tiden og ble ordrik, og overskred grensen for policystørrelse som er tillatt for IAM-rollen. For å dempe dette, byttet TR til å bruke flere kundeadministrerte retningslinjer og referere til dem i arbeidsområdets rolledefinisjon.

- TR nådde av og til standard ressursgrensene som ble brukt på AWS-kontonivå. Dette forårsaket sporadiske feil ved lansering av SageMaker-jobber (for eksempel opplæringsjobber) på grunn av ønsket ressurstypegrense nådd. TR jobbet tett med SageMaker serviceteam om dette problemet. Dette problemet ble løst etter at AWS-teamet lanserte SageMaker som en støttet tjeneste i Tjenestekvoter i juni 2022.

I dag kan dataforskere ved TR starte et ML-prosjekt ved å opprette et uavhengig arbeidsområde og legge til nødvendige teammedlemmer for å samarbeide. Ubegrenset skala som tilbys av SageMaker er tilgjengelig ved å gi dem tilpassede kjernebilder med varierte størrelser. SageMaker Studio ble raskt en avgjørende komponent i TRs AI-plattform og har endret brukeratferd fra å bruke begrensede skrivebordsapplikasjoner til skalerbare og flyktige spesialbygde motorer. Følgende diagram illustrerer denne arkitekturen.

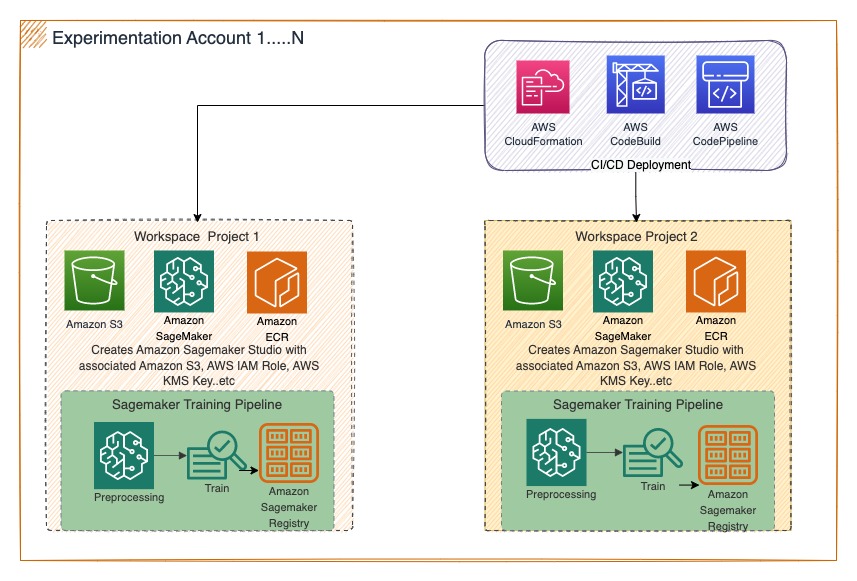

Sentralt modellregister

Modellregisteret gir et sentralt arkiv for alle TRs maskinlæringsmodeller, muliggjør risiko- og helsestyring av disse på en standardisert måte på tvers av forretningsfunksjoner, og effektiviserer potensielle modellers gjenbruk. Derfor måtte tjenesten gjøre følgende:

- Gi muligheten til å registrere både nye og eldre modeller, enten de er utviklet innenfor eller utenfor SageMaker

- Implementer styringsarbeidsflyter, slik at dataforskere, utviklere og interessenter kan se og i fellesskap administrere livssyklusen til modellene

- Øk åpenheten og samarbeidet ved å lage en sentralisert oversikt over alle modeller på tvers av TR sammen med metadata og helsemålinger

TR startet designet med bare SageMaker-modellregisteret, men et av TRs hovedkrav er å gi muligheten til å registrere modeller som er opprettet utenfor SageMaker. TR evaluerte forskjellige relasjonsdatabaser, men endte opp med å velge DynamoDB fordi metadataskjemaet for modeller som kommer fra eldre kilder vil være svært forskjellig. TR ønsket heller ikke å pålegge brukerne noe ekstra arbeid, så de implementerte en sømløs automatisk synkronisering mellom AI Platform-arbeidsområdet SageMaker-registrene til det sentrale SageMaker-registeret ved hjelp av Amazon EventBridge regler og nødvendige IAM-roller. TR forbedret det sentrale registret med DynamoDB for å utvide mulighetene til å registrere eldre modeller som ble opprettet på brukernes skrivebord.

TRs AI Platform sentrale modellregister er integrert i AI Platform-portalen og gir et visuelt grensesnitt for å søke etter modeller, oppdatere modellmetadata og forstå modellgrunnlinjeberegninger og periodiske tilpassede overvåkingsberegninger. Følgende diagram illustrerer denne arkitekturen.

Modellutplassering

TR identifiserte to hovedmønstre for å automatisere distribusjon:

- Modeller utviklet med SageMaker gjennom SageMaker batch-transformeringsjobber for å få slutninger på en foretrukket tidsplan

- Modeller utviklet utenfor SageMaker på lokale skrivebord ved bruk av åpen kildekode-biblioteker, gjennom ta med din egen container-tilnærming ved å bruke SageMaker-behandlingsjobber for å kjøre tilpasset slutningskode, som en effektiv måte å migrere disse modellene uten å refaktorisere koden

Med AI Platform-distribusjonstjenesten kan TR-brukere (dataforskere og ML-ingeniører) identifisere en modell fra katalogen og distribuere en slutningsjobb i deres valgte AWS-konto ved å gi de nødvendige parameterne gjennom en UI-drevet arbeidsflyt.

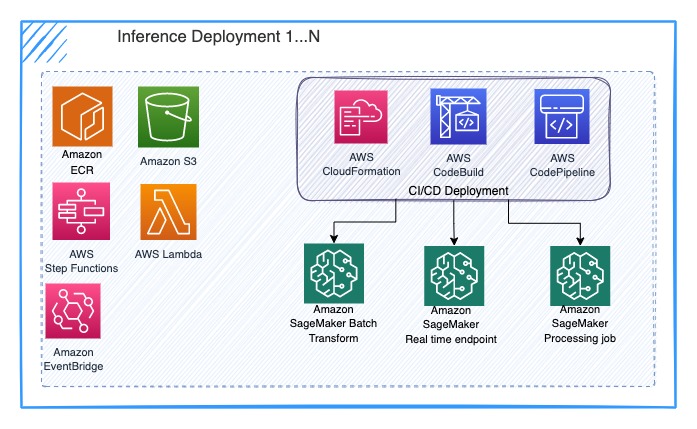

TR automatiserte denne distribusjonen ved å bruke AWS DevOps-tjenester som AWS CodePipeline og AWS CodeBuild. TR bruker Step Functions til å orkestrere arbeidsflyten for lesing og forhåndsbehandling av data for å lage SageMaker-slutningsjobber. TR distribuerer de nødvendige komponentene som kode ved hjelp av AWS skyformasjon maler. Følgende diagram illustrerer denne arkitekturen.

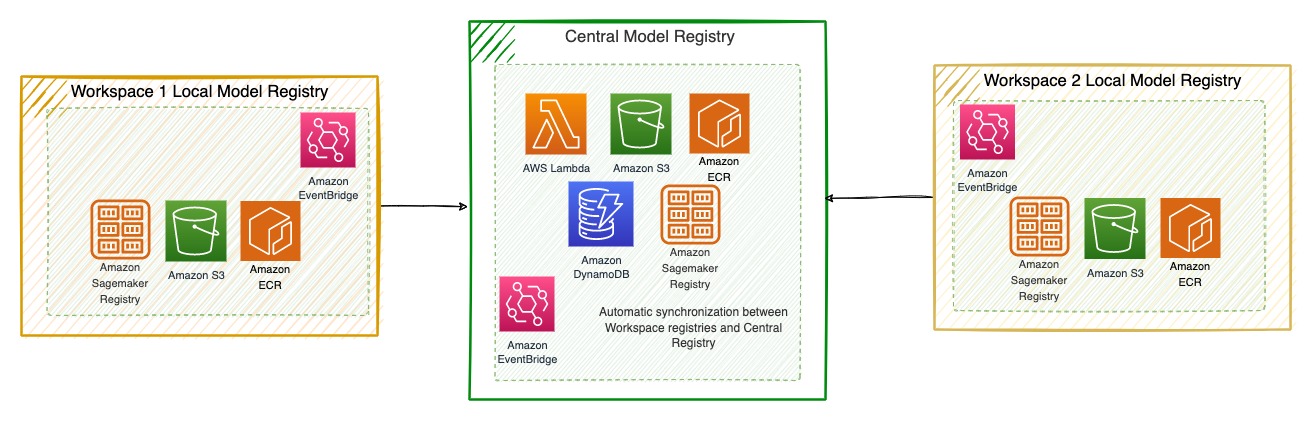

Modellovervåking

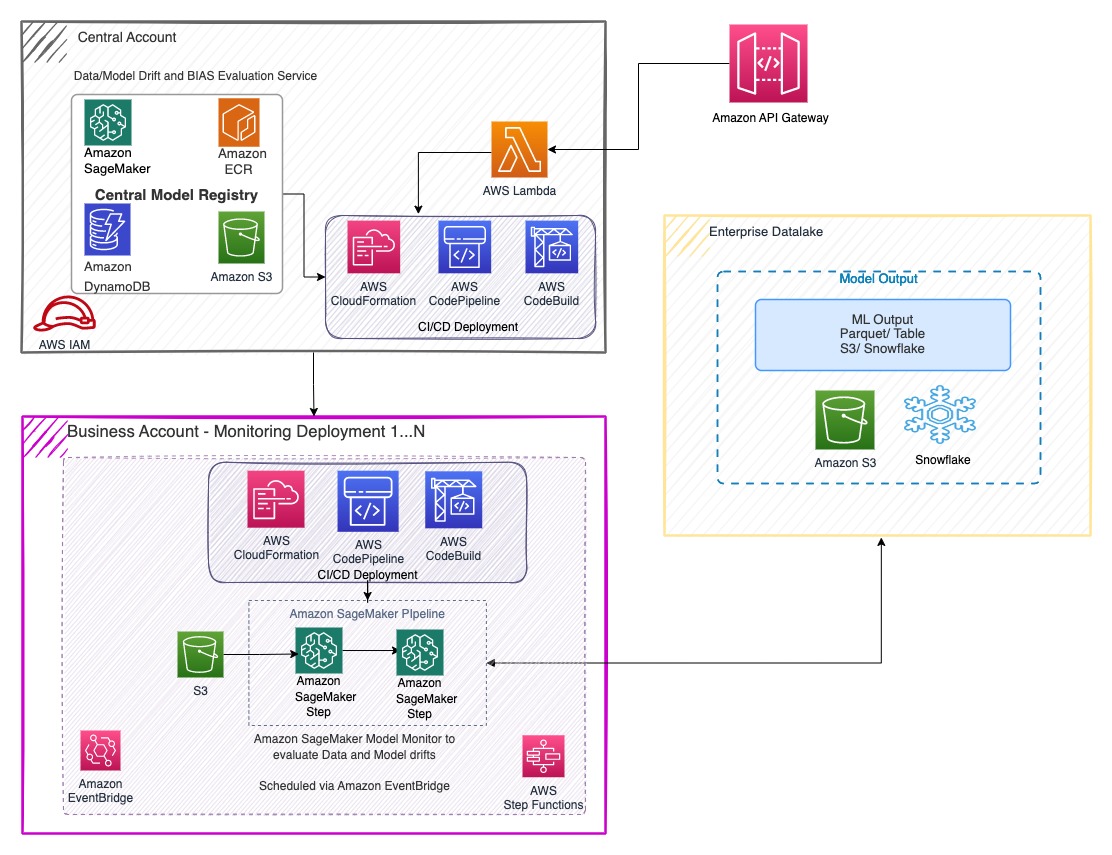

ML-livssyklusen er ikke komplett uten å kunne overvåke modeller. TRs virksomhetsstyringsteam gir også mandat og oppfordrer forretningsteam til å overvåke modellytelsen deres over tid for å møte eventuelle regulatoriske utfordringer. TR startet med overvåking av modeller og data for drift. TR brukte SageMaker Model Monitor for å gi en datagrunnlinje og slutningsgrunnsannhet for å periodisk overvåke hvordan TRs data og slutninger driver. Sammen med SageMaker modellovervåkingsberegninger, forbedret TR overvåkingsevnen ved å utvikle tilpassede målinger spesifikke for modellene deres. Dette vil hjelpe TRs dataforskere til å forstå når de skal omskolere modellen sin.

Sammen med driftovervåking ønsker TR også å forstå skjevhet i modellene. Ut-av-boksen-funksjonene til SageMaker Clarify brukes til å bygge TRs bias-tjeneste. TR overvåker både data- og modellskjevhet og gjør disse beregningene tilgjengelige for brukerne gjennom AI Platform-portalen.

For å hjelpe alle team med å ta i bruk disse bedriftsstandardene, har TR gjort disse tjenestene uavhengige og lett tilgjengelige via AI Platform-portalen. TRs forretningsteam kan gå inn i portalen og distribuere en modellovervåkingsjobb eller bias-overvåkingsjobb på egenhånd og kjøre dem etter deres foretrukne tidsplan. De blir varslet om statusen til jobben og beregningene for hver kjøring.

TR brukte AWS-tjenester for CI/CD-distribusjon, arbeidsflytorkestrering, serverløse rammeverk og API-endepunkter for å bygge mikrotjenester som kan utløses uavhengig, som vist i følgende arkitektur.

Resultater og fremtidige forbedringer

TRs AI-plattform ble lansert i Q3 2022 med alle de fem hovedkomponentene: en datatjeneste, eksperimenteringsarbeidsområde, sentralt modellregister, modelldistribusjon og modellovervåking. TR gjennomførte interne opplæringsøkter for sine forretningsenheter for å komme ombord på plattformen og tilbød dem selvstyrte opplæringsvideoer.

AI-plattformen har gitt kapasiteter til TRs team som aldri har eksistert før; det har åpnet et bredt spekter av muligheter for TRs virksomhetsstyringsteam til å forbedre samsvarsstandarder og sentralisere registeret, og gi en enkelt glassrute på tvers av alle ML-modeller i TR.

TR erkjenner at ingen produkter er på sitt beste ved første utgivelse. Alle TRs komponenter er på forskjellige modenhetsnivåer, og TRs Enterprise AI Platform-team er i en kontinuerlig forbedringsfase for å iterativt forbedre produktfunksjonene. TRs nåværende utviklingspipeline inkluderer å legge til flere SageMaker-slutningsalternativer som sanntids-, asynkrone og multi-modell-endepunkter. TR planlegger også å legge til modellforklaring som en funksjon til modellovervåkingstjenesten. TR planlegger å bruke forklaringsmulighetene til SageMaker Clarify for å utvikle sin interne forklaringstjeneste.

konklusjonen

TR kan nå behandle enorme mengder data sikkert og bruke avanserte AWS-funksjoner for å ta et ML-prosjekt fra idé til produksjon i løpet av uker, sammenlignet med månedene det tok før. Med de ferdige funksjonene til AWS-tjenester kan team innen TR registrere og overvåke ML-modeller for første gang noensinne, og oppnå samsvar med deres utviklende modellstyringsstandarder. TR satte datavitere og produktteam i stand til å slippe kreativiteten løs for å løse de mest komplekse problemene.

For å vite mer om TRs Enterprise AI-plattform på AWS, sjekk ut AWS re:Invent 2022-økt. Hvis du vil lære hvordan TR akselererte bruken av maskinlæring ved å bruke AWS datalab programmet, se case study.

Om forfatterne

Ramdev Wudali er en dataarkitekt som hjelper arkitekten og bygge AI/ML-plattformen for å gjøre det mulig for dataforskere og forskere å utvikle maskinlæringsløsninger ved å fokusere på datavitenskapen og ikke på infrastrukturbehovene. På fritiden elsker han å brette papir for å lage origami-tesselasjoner, og å ha på seg respektløse T-skjorter.

Ramdev Wudali er en dataarkitekt som hjelper arkitekten og bygge AI/ML-plattformen for å gjøre det mulig for dataforskere og forskere å utvikle maskinlæringsløsninger ved å fokusere på datavitenskapen og ikke på infrastrukturbehovene. På fritiden elsker han å brette papir for å lage origami-tesselasjoner, og å ha på seg respektløse T-skjorter.

Kiran Mantripragada er seniordirektør for AI Platform hos Thomson Reuters. AI Platform-teamet er ansvarlig for å aktivere AI-programvareapplikasjoner i produksjonsgrad og aktivere arbeidet til dataforskere og maskinlæringsforskere. Med en lidenskap for vitenskap, AI og ingeniørkunst liker Kiran å bygge bro mellom forskning og produktisering for å bringe den virkelige innovasjonen til AI til sluttforbrukerne.

Kiran Mantripragada er seniordirektør for AI Platform hos Thomson Reuters. AI Platform-teamet er ansvarlig for å aktivere AI-programvareapplikasjoner i produksjonsgrad og aktivere arbeidet til dataforskere og maskinlæringsforskere. Med en lidenskap for vitenskap, AI og ingeniørkunst liker Kiran å bygge bro mellom forskning og produktisering for å bringe den virkelige innovasjonen til AI til sluttforbrukerne.

Bhavana Chirumamilla er en Sr. Resident Architect ved AWS. Hun er lidenskapelig opptatt av data og ML-operasjoner, og bringer mye entusiasme for å hjelpe bedrifter med å bygge data- og ML-strategier. På fritiden liker hun tiden med familien på reise, fotturer, hagearbeid og se på dokumentarer.

Bhavana Chirumamilla er en Sr. Resident Architect ved AWS. Hun er lidenskapelig opptatt av data og ML-operasjoner, og bringer mye entusiasme for å hjelpe bedrifter med å bygge data- og ML-strategier. På fritiden liker hun tiden med familien på reise, fotturer, hagearbeid og se på dokumentarer.

Srinivasa Shaik er løsningsarkitekt ved AWS med base i Boston. Han hjelper bedriftskunder med å akselerere reisen til skyen. Han er lidenskapelig opptatt av containere og maskinlæringsteknologier. På fritiden liker han å tilbringe tid med familien, lage mat og reise.

Srinivasa Shaik er løsningsarkitekt ved AWS med base i Boston. Han hjelper bedriftskunder med å akselerere reisen til skyen. Han er lidenskapelig opptatt av containere og maskinlæringsteknologier. På fritiden liker han å tilbringe tid med familien, lage mat og reise.

Qingwei Li er maskinlæringsspesialist hos Amazon Web Services. Han fikk sin doktorgrad i operasjonsforskning etter at han brøt sin rådgivers forskningsbevilgningskonto og ikke klarte å levere Nobelprisen han lovet. For tiden hjelper han kunder i finans- og forsikringsbransjen med å bygge maskinlæringsløsninger på AWS. På fritiden liker han å lese og undervise.

Qingwei Li er maskinlæringsspesialist hos Amazon Web Services. Han fikk sin doktorgrad i operasjonsforskning etter at han brøt sin rådgivers forskningsbevilgningskonto og ikke klarte å levere Nobelprisen han lovet. For tiden hjelper han kunder i finans- og forsikringsbransjen med å bygge maskinlæringsløsninger på AWS. På fritiden liker han å lese og undervise.

- SEO-drevet innhold og PR-distribusjon. Bli forsterket i dag.

- Platoblokkkjede. Web3 Metaverse Intelligence. Kunnskap forsterket. Tilgang her.

- kilde: https://aws.amazon.com/blogs/machine-learning/how-thomson-reuters-built-an-ai-platform-using-amazon-sagemaker-to-accelerate-delivery-of-ml-projects/

- 100

- 2022

- 7

- a

- I stand

- Om oss

- akselerere

- akselerert

- adgang

- tilgjengelig

- Ifølge

- Logg inn

- Regnskap og administrasjon

- oppnådd

- oppnå

- erverve

- tvers

- Handling

- handlinger

- Ytterligere

- adresse

- adoptere

- avansert

- Etter

- AI

- AI-plattform

- AI-tjenester

- AI / ML

- Alle

- tillater

- sammen

- Amazon

- Amazon SageMaker

- Amazon Web Services

- beløp

- og

- api

- søknader

- anvendt

- tilnærming

- tilnærminger

- godkjenning

- arkitektur

- rundt

- autorisasjon

- automatisere

- Automatisert

- Automatisk

- tilgjengelig

- AWS

- basert

- Baseline

- fordi

- før du

- være

- BEST

- beste praksis

- mellom

- Bias

- milliarder

- boston

- BRO

- bringe

- Bringer

- Broke

- bygge

- Bygning

- bygger

- bygget

- byrde

- virksomhet

- forretningsfunksjoner

- evner

- saker

- katalog

- kategorier

- forårsaket

- sentral

- sentralisert

- utfordringer

- sjekk

- velge

- valgt ut

- tett

- Cloud

- sky infrastruktur

- Cloud Security

- kode

- samarbeide

- samarbeidet

- samarbeid

- samlet sett

- kommer

- Felles

- sammenlignet

- fullføre

- komplekse

- kompleksitet

- samsvar

- kompatibel

- komponent

- komponenter

- Omfattet

- databehandling

- forbrukes

- Forbrukere

- Container

- Containere

- innhold

- fortsette

- kontinuerlig

- kontroll

- Kjerne

- skape

- opprettet

- Opprette

- kreativitet

- kritisk

- avgjørende

- Gjeldende

- I dag

- skikk

- Kunder

- dato

- Data Lake

- databehandling

- datavitenskap

- databaser

- Beslutningstaking

- dyp

- dyp ekspertise

- Misligholde

- leverer

- levering

- demokrat

- utplassere

- distribusjon

- Distribueres

- beskrive

- utforming

- desktop

- detalj

- bestemmes

- utvikle

- utviklet

- utviklere

- utvikle

- Utvikling

- forskjellig

- vanskelig

- Regissør

- diskutere

- dokumentarer

- domene

- domener

- ned

- Tidlig

- enklere

- lett

- effektivt

- effektiv

- innsats

- empowered

- muliggjøre

- aktivert

- muliggjør

- muliggjør

- oppmuntrer

- Endpoint

- Motor

- Ingeniørarbeid

- Ingeniører

- Motorer

- forbedret

- sikre

- sikrer

- Enterprise

- bedrifter

- entusiasme

- Miljø

- feil

- avgjørende

- etisk

- evaluert

- hendelser

- NOEN GANG

- utvikle seg

- utvikling

- eksempel

- eksperiment

- ekspertise

- utvide

- ekstremt

- legge til rette

- Mislyktes

- familie

- Trekk

- Egenskaper

- Noen få

- slutt~~POS=TRUNC

- finansiell

- økonomiske tjenester

- Finn

- finne

- Først

- første gang

- Fokus

- fokusering

- følge

- etter

- følger

- formell

- rammer

- fra

- Innfri

- fullt

- funksjonalitet

- funksjoner

- framtid

- mellomrom

- general

- generert

- få

- glass

- Go

- Mål

- styresett

- innvilge

- Ground

- Økende

- Håndtering

- Hard

- Helse

- hjelpe

- hjelpe

- hjelper

- svært

- Hosting

- Hvordan

- Men

- HTML

- HTTPS

- identifisert

- identifisere

- identifisering

- Identitet

- bilder

- Påvirkning

- iverksette

- implementert

- implementere

- pålegge

- forbedre

- in

- inkluderer

- Øke

- uavhengig

- uavhengig av hverandre

- industri

- Infrastruktur

- innledende

- Innovasjon

- innsikt

- i stedet

- forsikring

- integrert

- Interface

- intern

- involvert

- isolasjon

- utstedelse

- IT

- Jobb

- Jobb

- reise

- nøkkel

- Vet

- kunnskap

- innsjø

- lansere

- lansert

- lansere

- LÆRE

- læring

- Legacy

- Lovlig

- Nivå

- nivåer

- bibliotekene

- BEGRENSE

- grenser

- leve

- lokal

- maskin

- maskinlæring

- laget

- større

- GJØR AT

- Making

- administrer

- ledelse

- administrerende

- mandater

- måte

- håndbok

- mange

- modenhet

- målinger

- medlemmer

- metadata

- metoder

- metrisk

- Metrics

- microservices

- migrere

- milepæl

- milepæler

- tankene

- minutter

- Minske

- ML

- modell

- modeller

- Overvåke

- overvåking

- skjermer

- måneder

- mer

- mest

- flere

- Naturlig

- Naviger

- Trenger

- behov

- nettverk

- Ny

- nyheter

- neste

- Nobel pris

- Antall

- objekt

- sporadisk

- tilbudt

- tilby

- Tilbud

- Ombord

- ONE

- åpen kildekode

- åpnet

- Drift

- alternativer

- orkestre

- organisasjon

- opprinnelig

- utenfor

- egen

- eieren

- brød

- Papir

- parametere

- lidenskap

- lidenskapelig

- mønstre

- Ansatte

- ytelse

- periodisk

- fase

- rørledning

- planlegging

- planer

- plattform

- plato

- Platon Data Intelligence

- PlatonData

- Point

- Politikk

- politikk

- Portal

- muligheter

- Post

- potensiell

- makt

- praksis

- Spådommer

- trekkes

- primære

- prinsipper

- premie

- Problem

- problemer

- prosess

- Prosesser

- prosessering

- Produkt

- Produksjon

- Produkter

- fagfolk

- program

- prosjekt

- prosjekter

- lovet

- gi

- forutsatt

- gir

- gi

- Q3

- q3 2022

- raskt

- område

- spenner

- RE

- nådd

- Lesning

- ekte

- sanntids

- mottatt

- registrere

- registret

- forskrifter

- regulatorer

- slipp

- utgitt

- fjerne

- Repository

- anmode

- påkrevd

- Krav

- forskning

- forskere

- ressurs

- Ressurser

- ansvarlig

- Reuters

- Risiko

- Rolle

- roller

- regler

- Kjør

- sagemaker

- SageMaker Inference

- skalerbar

- Skala

- planlegge

- Vitenskap

- forskere

- sømløs

- sømløst

- Søk

- Søkemotorer

- seksjoner

- sikre

- sikret

- sikkert

- sikkerhet

- sending

- senior

- sensitive

- betjene

- server~~POS=TRUNC

- tjeneste

- Tjenester

- sesjoner

- flere

- Del

- vist

- Enkelt

- siden

- enkelt

- Størrelse

- størrelser

- dyktig

- ferdigheter

- Snapshot

- So

- Software

- løsning

- Solutions

- LØSE

- Kilder

- spesialist

- spesifikk

- bruke

- utgifter

- Scene

- interessenter

- standardisere

- standarder

- startet

- starter

- Stater

- status

- Trinn

- Steps

- lagring

- oppbevare

- butikker

- strategier

- effektivisere

- studio

- slik

- Støttes

- Støtte

- byttet om

- synkronisering

- bord

- Ta

- skatt

- Undervisning

- lag

- lag

- Teknisk

- tekniske ferdigheter

- Technologies

- maler

- vilkår

- De

- deres

- derfor

- Thomson Reuters

- Gjennom

- hele

- tid

- til

- verktøy

- Sporing

- tradisjonelle

- Tog

- Kurs

- Transform

- Åpenhet

- Traveling

- enorm

- utløst

- forstå

- enhet

- lomper

- frigjøre

- ubegrenset

- Oppdater

- bruke

- Bruker

- Brukere

- variasjon

- ulike

- enorme

- av

- videoer

- Se

- synlighet

- se

- web

- webtjenester

- Web-basert

- uker

- om

- mens

- bred

- Bred rekkevidde

- vil

- vinne

- innenfor

- uten

- Arbeid

- arbeidet

- arbeidsflyt

- verdensomspennende

- ville

- år

- Din

- zephyrnet