AutoML lar deg utlede rask, generell innsikt fra dataene dine rett i begynnelsen av et maskinlæringsprosjekt (ML)-prosjektlivssyklus. Å forstå på forhånd hvilke forbehandlingsteknikker og algoritmetyper som gir best resultater, reduserer tiden til å utvikle, trene og distribuere den riktige modellen. Den spiller en avgjørende rolle i hver modells utviklingsprosess og lar dataforskere fokusere på de mest lovende ML-teknikkene. I tillegg gir AutoML en baseline modellytelse som kan tjene som et referansepunkt for datavitenskapsteamet.

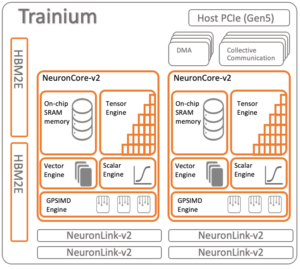

Et AutoML-verktøy bruker en kombinasjon av forskjellige algoritmer og forskjellige forbehandlingsteknikker på dataene dine. For eksempel kan den skalere dataene, utføre univariat funksjonsvalg, utføre PCA ved forskjellige variansterskelnivåer og bruke klynging. Slike forbehandlingsteknikker kan brukes individuelt eller kombineres i en rørledning. Deretter vil et AutoML-verktøy trene forskjellige modelltyper, for eksempel lineær regresjon, Elastic-Net eller Random Forest, på forskjellige versjoner av det forhåndsbehandlede datasettet og utføre hyperparameteroptimalisering (HPO). Amazon SageMaker Autopilot eliminerer de tunge løftingene til bygnings ML-modeller. Etter å ha levert datasettet, utforsker SageMaker Autopilot automatisk forskjellige løsninger for å finne den beste modellen. Men hva om du vil distribuere din skreddersydde versjon av en AutoML-arbeidsflyt?

Dette innlegget viser hvordan du oppretter en skreddersydd AutoML-arbeidsflyt på Amazon SageMaker ved hjelp av Amazon SageMaker Automatisk modellinnstilling med eksempelkode tilgjengelig i en GitHub repo.

Løsningsoversikt

For denne brukssaken, la oss anta at du er en del av et datavitenskapsteam som utvikler modeller i et spesialisert domene. Du har utviklet et sett med tilpassede forbehandlingsteknikker og valgt en rekke algoritmer som du vanligvis forventer skal fungere godt med ML-problemet ditt. Når du jobber med nye ML-brukstilfeller, vil du først utføre en AutoML-kjøring ved å bruke dine forbehandlingsteknikker og algoritmer for å begrense omfanget av potensielle løsninger.

For dette eksempelet bruker du ikke et spesialisert datasett; i stedet jobber du med California Housing-datasettet du vil importere fra Amazon enkel lagringstjeneste (Amazon S3). Fokuset er å demonstrere den tekniske implementeringen av løsningen ved hjelp av SageMaker HPO, som senere kan brukes på ethvert datasett og domene.

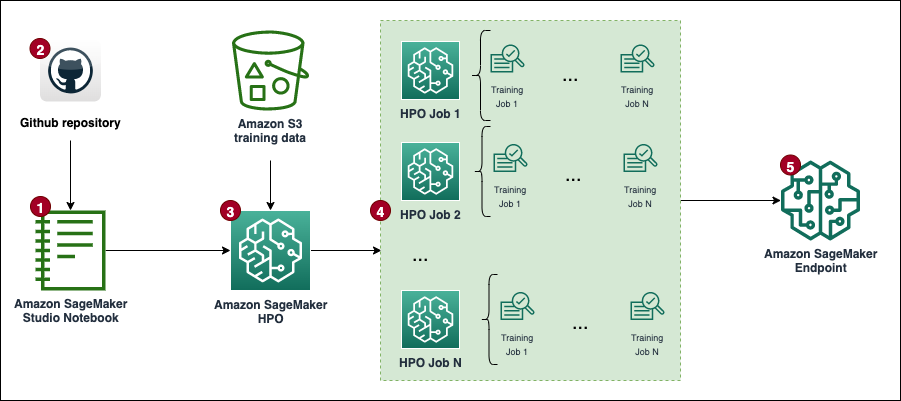

Følgende diagram presenterer den generelle arbeidsflyten for løsningen.

Forutsetninger

Følgende er forutsetninger for å fullføre gjennomgangen i dette innlegget:

Implementer løsningen

Hele koden er tilgjengelig i GitHub repo.

Trinnene for å implementere løsningen (som angitt i arbeidsflytdiagrammet) er som følger:

- Opprett en notisbokforekomst og spesifiser følgende:

- Til Notatbokforekomsttype, velg mlt3 medium.

- Til Elastisk slutning, velg none.

- Til Plattformidentifikator, velg Amazon Linux 2, Jupyter Lab 3.

- Til IAM-rolle, velg standard

AmazonSageMaker-ExecutionRole. Hvis den ikke eksisterer, opprett en ny AWS identitets- og tilgangsadministrasjon (IAM) rolle og legge ved AmazonSageMakerFullAccess IAM-policy.

Merk at du bør opprette en utførelsesrolle og policy med minimalt omfang i produksjonen.

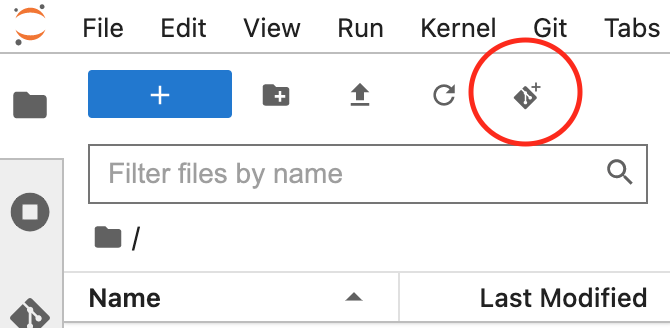

- Åpne JupyterLab-grensesnittet for din bærbare instans og klon GitHub-repoen.

Du kan gjøre det ved å starte en ny terminaløkt og kjøre git clone <REPO> kommando eller ved å bruke UI-funksjonaliteten, som vist i følgende skjermbilde.

- Åpne

automl.ipynbnotatbokfil, velgconda_python3kjerne, og følg instruksjonene for å utløse en sett med HPO-jobber.

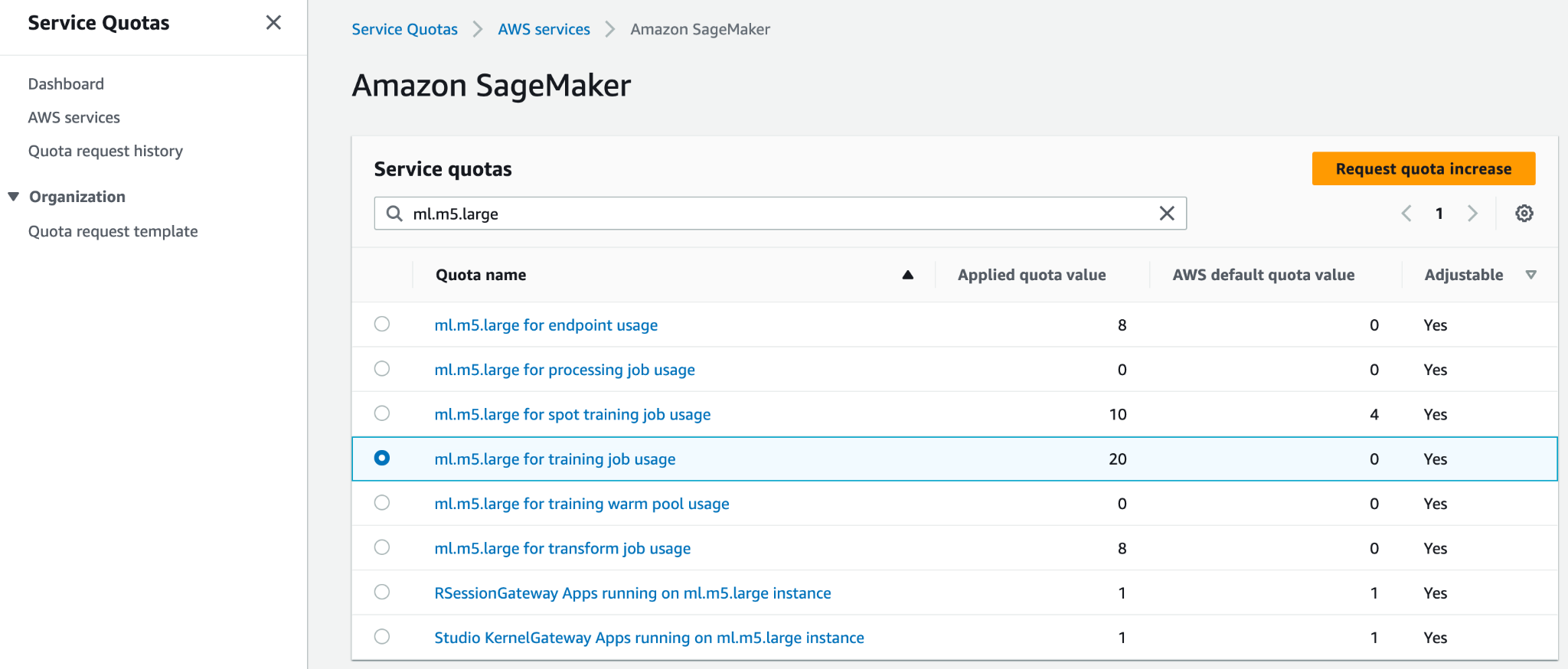

For å kjøre koden uten endringer, må du øke tjenestekvoten for ml.m5.large for treningsjobbbruk og Antall forekomster på tvers av alle treningsjobber. AWS tillater som standard bare 20 parallelle SageMaker-treningsjobber for begge kvotene. Du må be om en kvoteøkning til 30 for begge. Begge kvoteendringene bør vanligvis godkjennes innen få minutter. Referere til Ber om kvoteøkning for mer informasjon.

Hvis du ikke vil endre kvoten, kan du ganske enkelt endre verdien av MAX_PARALLEL_JOBS variabel i skriptet (for eksempel til 5).

- Hver HPO-jobb vil fullføre et sett med treningsjobb forsøk og angi modellen med optimale hyperparametre.

- Analyser resultatene og implementere modellen med best ytelse.

Denne løsningen vil medføre kostnader på AWS-kontoen din. Kostnaden for denne løsningen vil avhenge av antall og varighet av HPO-treningsjobber. Når disse øker, vil kostnadene også øke. Du kan redusere kostnadene ved å begrense treningstiden og konfigurere TuningJobCompletionCriteriaConfig i henhold til instruksjonene diskutert senere i dette innlegget. For prisinformasjon, se Amazon SageMaker-priser.

I de følgende avsnittene diskuterer vi notatboken mer detaljert med kodeeksempler og trinnene for å analysere resultatene og velge den beste modellen.

Førstegangs oppsett

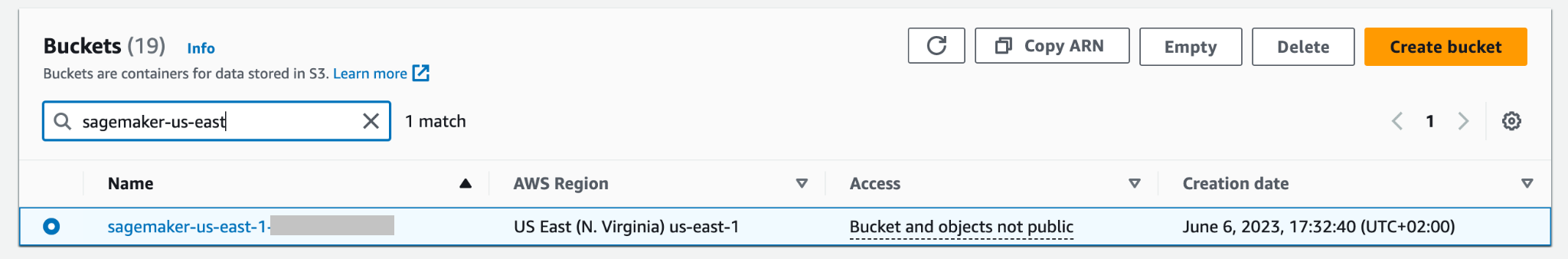

La oss starte med å kjøre Importer og oppsett delen i custom-automl.ipynb notisbok. Den installerer og importerer alle nødvendige avhengigheter, instansierer en SageMaker-sesjon og -klient, og setter standardregionen og S3-bøtten for lagring av data.

Dataforberedelse

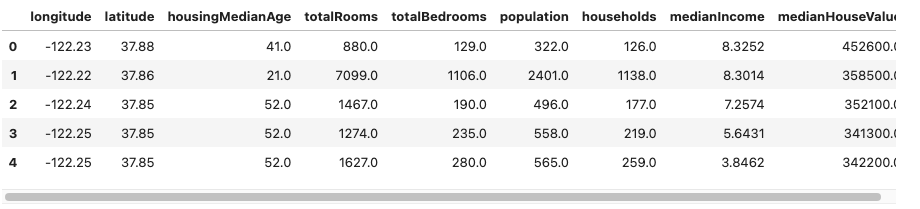

Last ned California Housing-datasettet og klargjør det ved å kjøre Last ned data delen av notatboken. Datasettet er delt inn i trenings- og testdatarammer og lastet opp til SageMaker-sesjons standard S3-bøtte.

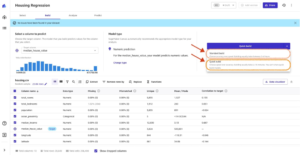

Hele datasettet har totalt 20,640 9 poster og XNUMX kolonner, inkludert målet. Målet er å forutsi medianverdien til et hus (medianHouseValue kolonne). Følgende skjermbilde viser de øverste radene i datasettet.

Mal for opplæringsskript

AutoML-arbeidsflyten i dette innlegget er basert på scikit lære forbehandling av rørledninger og algoritmer. Målet er å generere en stor kombinasjon av forskjellige forbehandlingsrørledninger og algoritmer for å finne oppsettet som gir best ytelse. La oss begynne med å lage et generisk opplæringsskript, som vedvares lokalt på den bærbare forekomsten. I dette skriptet er det to tomme kommentarblokker: en for å injisere hyperparametere og den andre for preprocessing-model pipeline-objektet. De vil bli injisert dynamisk for hver forbehandlingsmodellkandidat. Hensikten med å ha ett generisk skript er å holde implementeringen DRY (ikke gjenta deg selv).

Lag forbehandling og modellkombinasjoner

De preprocessors ordboken inneholder en spesifikasjon av forbehandlingsteknikker brukt på alle inndatafunksjoner i modellen. Hver oppskrift er definert ved hjelp av en Pipeline eller en FeatureUnion objekt fra scikit-learn, som lenker sammen individuelle datatransformasjoner og stabler dem sammen. For eksempel, mean-imp-scale er en enkel oppskrift som sikrer at manglende verdier beregnes ved å bruke gjennomsnittsverdier for respektive kolonner og at alle funksjoner skaleres ved hjelp av Standard Scaler. I kontrast, den mean-imp-scale-pca oppskriften lenker sammen noen flere operasjoner:

- Beregn manglende verdier i kolonner med gjennomsnittet.

- Bruk funksjonsskalering ved å bruke gjennomsnitt og standardavvik.

- Beregn PCA på toppen av inngangsdataene ved en spesifisert variansterskelverdi og flette den sammen med de imputerte og skalerte inngangsfunksjonene.

I dette innlegget er alle inndatafunksjoner numeriske. Hvis du har flere datatyper i inndatasettet ditt, bør du spesifisere en mer komplisert pipeline der forskjellige forbehandlingsgrener brukes på forskjellige funksjonstypesett.

De models ordboken inneholder spesifikasjoner av forskjellige algoritmer som du tilpasser datasettet til. Hver modelltype kommer med følgende spesifikasjon i ordboken:

- script_output – Peker på plasseringen av treningsskriptet som brukes av estimatoren. Dette feltet fylles ut dynamisk når

modelsordbok er kombinert medpreprocessorsordbok. - innsett – Definerer kode som skal settes inn i

script_draft.pyog deretter lagret underscript_output. Nøkkelen“preprocessor”er med hensikt tom fordi denne plasseringen er fylt med en av forprosessorene for å lage flere modell-forprosessorkombinasjoner. - hyperparametere – Et sett med hyperparametere som er optimalisert av HPO-jobben.

- include_cls_metadata – Flere konfigurasjonsdetaljer kreves av SageMaker

Tunerklasse.

Et fullstendig eksempel på models ordboken er tilgjengelig i GitHub-depotet.

Deretter, la oss iterere gjennom preprocessors og models ordbøker og lag alle mulige kombinasjoner. For eksempel hvis din preprocessors ordboken inneholder 10 oppskrifter og du har 5 modelldefinisjoner i models ordbok, inneholder den nyopprettede pipelines-ordboken 50 preprosessormodell-pipelines som evalueres under HPO. Merk at individuelle pipeline-skript ikke er opprettet ennå på dette tidspunktet. Den neste kodeblokken (celle 9) i Jupyter-notebooken itererer gjennom alle preprosessor-modellobjekter i pipelines ordbok, setter inn alle relevante kodebiter og vedvarer en pipeline-spesifikk versjon av skriptet lokalt i notatboken. Disse skriptene brukes i de neste trinnene når du oppretter individuelle estimatorer som du kobler til HPO-jobben.

Definer estimatorer

Du kan nå jobbe med å definere SageMaker Estimators som HPO-jobben bruker etter at skriptene er klare. La oss starte med å lage en innpakningsklasse som definerer noen vanlige egenskaper for alle estimatorer. Det arver fra SKLearn klasse og spesifiserer rollen, antall forekomster og type, samt hvilke kolonner som brukes av skriptet som funksjoner og målet.

La oss bygge estimators ordbok ved å iterere gjennom alle skript generert før og plassert i scripts katalog. Du instansierer en ny estimator ved å bruke SKLearnBase klasse, med et unikt estimatornavn og ett av skriptene. Merk at estimators ordboken har to nivåer: toppnivået definerer en pipeline_family. Dette er en logisk gruppering basert på typen modeller som skal evalueres og er lik lengden på models ordbok. Det andre nivået inneholder individuelle forprosessortyper kombinert med de gitte pipeline_family. Denne logiske grupperingen er nødvendig når du oppretter HPO-jobben.

Definer HPO-tuner-argumenter

For å optimalisere å sende argumenter inn i HPO Tuner klasse, den HyperparameterTunerArgs dataklassen initialiseres med argumenter som kreves av HPO-klassen. Den leveres med et sett med funksjoner som sikrer at HPO-argumenter returneres i et format som forventes når du distribuerer flere modelldefinisjoner samtidig.

Den neste kodeblokken bruker den tidligere introduserte HyperparameterTunerArgs dataklasse. Du lager en annen ordbok kalt hp_args og generere et sett med inngangsparametere som er spesifikke for hver estimator_family fra estimators ordbok. Disse argumentene brukes i neste trinn ved initialisering av HPO-jobber for hver modellfamilie.

Lag HPO-tunerobjekter

I dette trinnet lager du individuelle tunere for hver estimator_family. Hvorfor oppretter du tre separate HPO-jobber i stedet for å lansere bare én på tvers av alle estimatorer? De HyperparameterTuner klasse er begrenset til 10 modelldefinisjoner knyttet til den. Derfor er hver HPO ansvarlig for å finne den beste preprosessoren for en gitt modellfamilie og justere den modellfamiliens hyperparametre.

Følgende er noen flere punkter angående oppsettet:

- Optimaliseringsstrategien er Bayesian, noe som betyr at HPO aktivt overvåker ytelsen til alle forsøk og navigerer optimaliseringen mot mer lovende hyperparameterkombinasjoner. Tidlig stopp bør settes til Av or Auto når du arbeider med en Bayesiansk strategi, som håndterer den logikken selv.

- Hver HPO-jobb kjører for maksimalt 100 jobber og kjører 10 jobber parallelt. Hvis du har å gjøre med større datasett, vil du kanskje øke det totale antallet jobber.

- I tillegg kan det være lurt å bruke innstillinger som kontrollerer hvor lenge en jobb kjører og hvor mange jobber din HPO utløser. En måte å gjøre det på er å angi maksimal kjøretid i sekunder (for dette innlegget setter vi den til 1 time). En annen er å bruke den nylig utgitte

TuningJobCompletionCriteriaConfig. Den tilbyr et sett med innstillinger som overvåker fremdriften til jobbene dine og bestemmer om det er sannsynlig at flere jobber vil forbedre resultatet. I dette innlegget setter vi maksimalt antall treningsjobber som ikke blir bedre til 20. På den måten, hvis poengsummen ikke blir bedre (for eksempel fra den førtiende prøveperioden), trenger du ikke betale for de gjenværende prøvene førmax_jobser nådd.

La oss nå iterere gjennom tuners og hp_args ordbøker og utløser alle HPO-jobber i SageMaker. Legg merke til bruken av wait-argumentet satt til False, som betyr at kjernen ikke vil vente til resultatene er fullførte og du kan utløse alle jobber samtidig.

Det er sannsynlig at ikke alle treningsjobber vil fullføres, og noen av dem kan bli stoppet av HPO-jobben. Grunnen til dette er TuningJobCompletionCriteriaConfig– Optimaliseringen fullføres hvis noen av de angitte kriteriene er oppfylt. I dette tilfellet, når optimaliseringskriteriene ikke blir bedre for 20 påfølgende jobber.

Analyser resultater

Celle 15 i notatboken sjekker om alle HPO-jobber er fullførte og kombinerer alle resultater i form av en panda-dataramme for videre analyse. Før vi analyserer resultatene i detalj, la oss ta en titt på SageMaker-konsollen på høyt nivå.

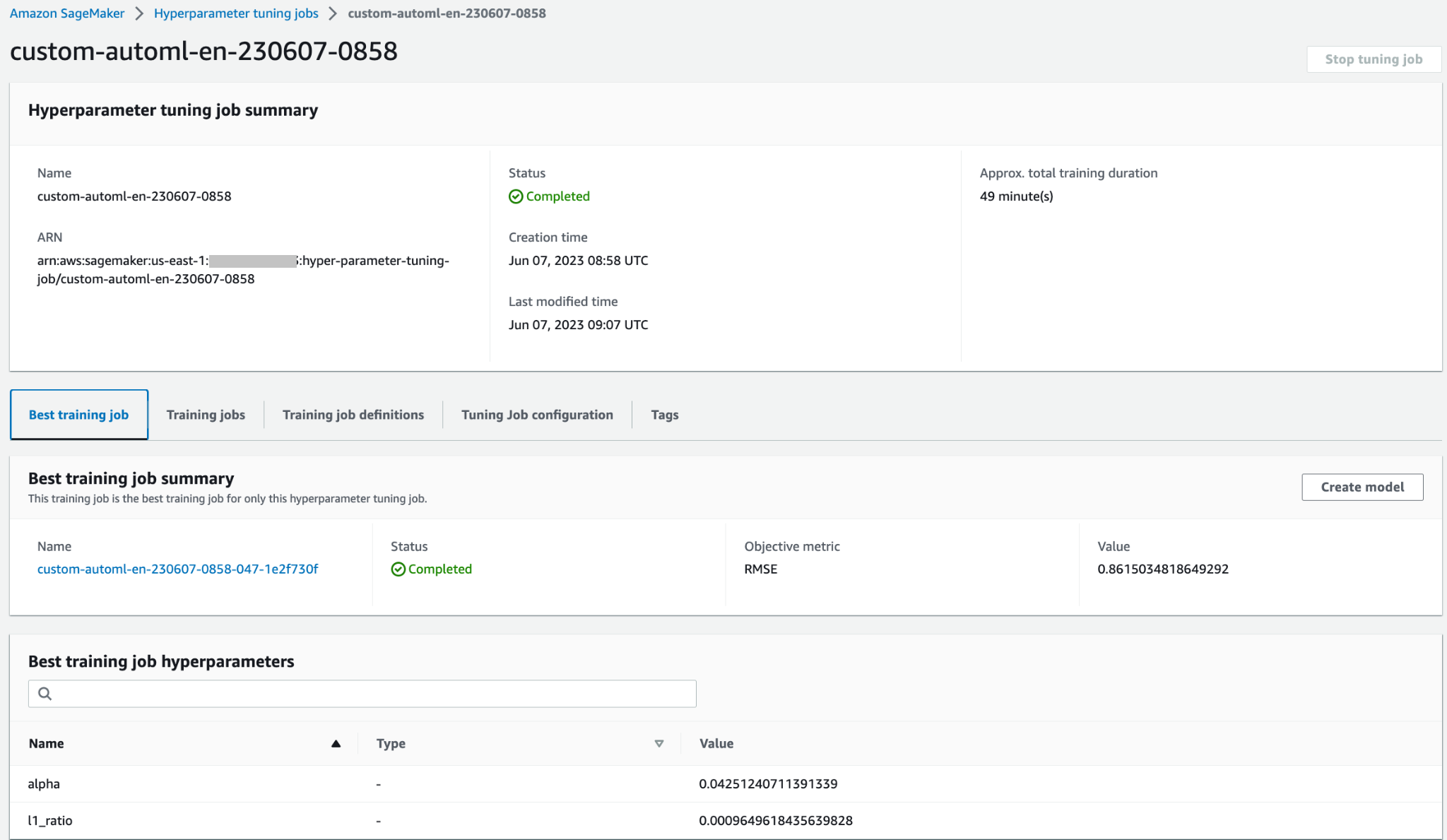

På toppen av Hyperparameter tuning jobber side, kan du se dine tre lanserte HPO-jobber. Alle var ferdige tidlig og utførte ikke alle 100 treningsjobbene. I det følgende skjermbildet kan du se at Elastic-Net-modellfamilien fullførte det høyeste antallet forsøk, mens andre ikke trengte så mange treningsjobber for å finne det beste resultatet.

Du kan åpne HPO-jobben for å få tilgang til flere detaljer, for eksempel individuelle treningsjobber, jobbkonfigurasjon og informasjon og ytelse for den beste treningsjobben.

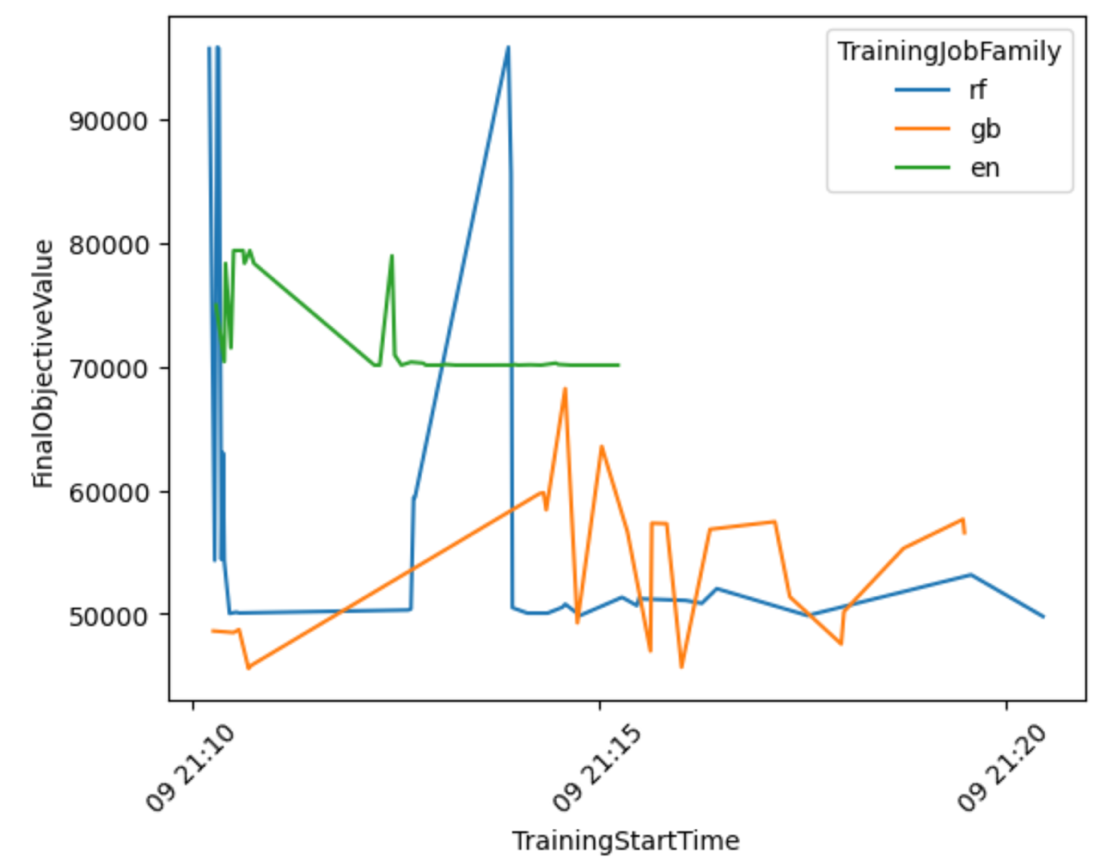

La oss lage en visualisering basert på resultatene for å få mer innsikt i AutoML arbeidsflytytelsen på tvers av alle modellfamilier.

Fra følgende graf kan du konkludere at Elastic-Net modellens ytelse svingte mellom 70,000 80,000 og XNUMX XNUMX RMSE og stoppet til slutt, da algoritmen ikke var i stand til å forbedre ytelsen til tross for å prøve forskjellige forbehandlingsteknikker og hyperparameterverdier. Det virker også som RandomForest ytelsen varierte mye avhengig av hyperparametersettet som ble utforsket av HPO, men til tross for mange forsøk kunne det ikke gå under 50,000 XNUMX RMSE-feilen. GradientBoosting oppnådde den beste ytelsen allerede fra starten og gikk under 50,000 XNUMX RMSE. HPO prøvde å forbedre dette resultatet ytterligere, men klarte ikke å oppnå bedre ytelse på tvers av andre hyperparameterkombinasjoner. En generell konklusjon for alle HPO-jobber er at det ikke var nødvendig med så mange jobber for å finne det settet med hyperparametere med best ytelse for hver algoritme. For å forbedre resultatet ytterligere, må du eksperimentere med å lage flere funksjoner og utføre ekstra funksjonsutvikling.

Du kan også undersøke en mer detaljert visning av modell-forprosessor-kombinasjonen for å trekke konklusjoner om de mest lovende kombinasjonene.

Velg den beste modellen og distribuer den

Følgende kodebit velger den beste modellen basert på den laveste oppnådde målverdien. Du kan deretter distribuere modellen som et SageMaker-endepunkt.

Rydd opp

For å forhindre uønskede belastninger på AWS-kontoen din, anbefaler vi at du sletter AWS-ressursene du brukte i dette innlegget:

- På Amazon S3-konsollen tømmer du dataene fra S3-bøtten der treningsdataene ble lagret.

- Stopp forekomsten av den bærbare datamaskinen på SageMaker-konsollen.

- Slett modellendepunktet hvis du implementerte det. Endepunkter bør slettes når de ikke lenger er i bruk, fordi de faktureres etter utplassert tid.

konklusjonen

I dette innlegget viste vi frem hvordan du lager en tilpasset HPO-jobb i SageMaker ved å bruke et tilpasset utvalg av algoritmer og forbehandlingsteknikker. Spesielt demonstrerer dette eksemplet hvordan man automatiserer prosessen med å generere mange opplæringsskript og hvordan man bruker Python-programmeringsstrukturer for effektiv distribusjon av flere parallelle optimaliseringsjobber. Vi håper denne løsningen vil danne stillaset for alle tilpassede modelljusteringsjobber du vil distribuere ved hjelp av SageMaker for å oppnå høyere ytelse og raskere ML-arbeidsflytene dine.

Sjekk ut følgende ressurser for å utdype kunnskapen din om hvordan du bruker SageMaker HPO:

Om forfatterne

Konrad Semsch er senior ML Solutions Architect hos Amazon Web Services Data Lab Team. Han hjelper kunder med å bruke maskinlæring for å løse forretningsutfordringene deres med AWS. Han liker å finne opp og forenkle for å gi kundene enkle og pragmatiske løsninger for deres AI/ML-prosjekter. Han er mest lidenskapelig opptatt av MlOps og tradisjonell datavitenskap. Utenom jobben er han en stor fan av windsurfing og kitesurfing.

Konrad Semsch er senior ML Solutions Architect hos Amazon Web Services Data Lab Team. Han hjelper kunder med å bruke maskinlæring for å løse forretningsutfordringene deres med AWS. Han liker å finne opp og forenkle for å gi kundene enkle og pragmatiske løsninger for deres AI/ML-prosjekter. Han er mest lidenskapelig opptatt av MlOps og tradisjonell datavitenskap. Utenom jobben er han en stor fan av windsurfing og kitesurfing.

Tunfisk Ersoy er Senior Solutions Architect hos AWS. Hennes primære fokus er å hjelpe offentlige kunder med å ta i bruk skyteknologier for arbeidsbelastningen deres. Hun har bakgrunn fra applikasjonsutvikling, bedriftsarkitektur og kontaktsenterteknologier. Hennes interesser inkluderer serverløse arkitekturer og AI/ML.

Tunfisk Ersoy er Senior Solutions Architect hos AWS. Hennes primære fokus er å hjelpe offentlige kunder med å ta i bruk skyteknologier for arbeidsbelastningen deres. Hun har bakgrunn fra applikasjonsutvikling, bedriftsarkitektur og kontaktsenterteknologier. Hennes interesser inkluderer serverløse arkitekturer og AI/ML.

- SEO-drevet innhold og PR-distribusjon. Bli forsterket i dag.

- PlatoData.Network Vertical Generative Ai. Styrk deg selv. Tilgang her.

- PlatoAiStream. Web3 Intelligence. Kunnskap forsterket. Tilgang her.

- PlatoESG. Karbon, CleanTech, Energi, Miljø, Solenergi, Avfallshåndtering. Tilgang her.

- PlatoHelse. Bioteknologisk og klinisk etterretning. Tilgang her.

- kilde: https://aws.amazon.com/blogs/machine-learning/implement-a-custom-automl-job-using-pre-selected-algorithms-in-amazon-sagemaker-automatic-model-tuning/

- : har

- :er

- :ikke

- :hvor

- $OPP

- 000

- 1

- 10

- 100

- 12

- 13

- 14

- 15%

- 20

- 2000

- 22

- 25

- 28

- 30

- 39

- 50

- 7

- 70

- 8

- 80

- 9

- a

- I stand

- Om oss

- adgang

- Ifølge

- Logg inn

- Oppnå

- oppnådd

- tvers

- aktivt

- Ytterligere

- I tillegg

- adoptere

- Etter

- AI / ML

- sikte

- algoritme

- algoritmer

- Alle

- tillate

- tillater

- allerede

- også

- Amazon

- Amazon SageMaker

- Amazon Web Services

- an

- analyse

- analysere

- analyserer

- og

- En annen

- noen

- Søknad

- Applikasjonutvikling

- anvendt

- gjelder

- Påfør

- godkjent

- arkitektur

- ER

- argument

- argumenter

- AS

- anta

- At

- feste

- auto

- automatisere

- Automatisk

- automatisk

- AutoML

- tilgjengelig

- AWS

- bakgrunn

- basen

- basert

- Baseline

- Bayesiansk

- BE

- fordi

- før du

- Begynnelsen

- under

- BEST

- Bedre

- mellom

- Stor

- Blokker

- Blocks

- både

- grener

- bygge

- Bygning

- virksomhet

- men

- knapp

- by

- california

- ring

- som heter

- CAN

- kandidat

- saken

- saker

- sentrum

- kjeder

- utfordringer

- endring

- Endringer

- avgifter

- Sjekker

- Velg

- klasse

- CLF

- kunde

- Cloud

- Cluster

- gruppering

- kode

- Kolonne

- kolonner

- kombinasjon

- kombinasjoner

- kombinert

- skurtreskerne

- kommer

- kommentere

- Felles

- fullføre

- Terminado

- fullført

- komplisert

- konkluderer

- konklusjon

- Gjennomføre

- Konfigurasjon

- påfølgende

- Konsoll

- kontakt

- kontakt senter

- inneholder

- kontrast

- kontroll

- Kostnad

- Kostnader

- kunne

- skape

- opprettet

- Opprette

- kriterier

- avgjørende

- I dag

- skikk

- Kunder

- dato

- datavitenskap

- datasett

- håndtering

- bestemme

- utdype

- Misligholde

- definert

- definerer

- definere

- definisjoner

- demonstrere

- demonstrerer

- avhenge

- avhengig

- avhengig

- utplassere

- utplassert

- utplasserings

- distribusjon

- Derive

- Til tross for

- detalj

- detaljert

- detaljer

- utvikle

- utviklet

- Utvikling

- utvikler

- avvik

- DIKT

- forskjellig

- kataloger

- diskutere

- diskutert

- do

- ikke

- domene

- ikke

- ned

- tegne

- tørk

- varighet

- under

- dynamisk

- hver enkelt

- Tidlig

- effektiv

- eliminerer

- muliggjøre

- Endpoint

- Ingeniørarbeid

- sikre

- sikrer

- Enterprise

- Hele

- fullstendig

- lik

- feil

- evaluere

- evaluert

- etter hvert

- Hver

- undersøke

- eksempel

- eksempler

- gjennomføring

- eksisterer

- forvente

- forventet

- eksperiment

- forklarte

- utforsket

- utforsker

- falsk

- familier

- familie

- vifte

- Trekk

- Egenskaper

- Noen få

- felt

- filet

- fylt

- Finn

- finne

- Først

- passer

- fem

- Fokus

- følge

- etter

- følger

- Til

- skog

- skjema

- format

- RAMME

- fra

- foran

- fullt

- funksjon

- funksjonalitet

- funksjoner

- videre

- general

- generere

- generert

- genererer

- få

- gå

- GitHub

- gitt

- Go

- mål

- skal

- graf

- hånd

- Håndterer

- Ha

- å ha

- he

- tung

- tung løfting

- hjelpe

- hjelper

- her

- høyt nivå

- høyere

- høyest

- håp

- time

- hus

- husholdninger

- bolig

- Hvordan

- Hvordan

- HTML

- http

- HTTPS

- Optimalisering av hyperparameter

- Innstilling av hyperparameter

- Identitet

- if

- iverksette

- gjennomføring

- importere

- import

- forbedre

- bedre

- in

- inkludere

- Inkludert

- Øke

- indikerer

- individuelt

- individuelt

- informasjon

- inngang

- innganger

- Setter inn

- innsikt

- f.eks

- i stedet

- instruksjoner

- integrering

- med hensikt

- interesser

- Interface

- inn

- introdusert

- IT

- DET ER

- selv

- Jobb

- Jobb

- jpg

- bare

- bare én

- Hold

- nøkkel

- kunnskap

- lab

- stor

- større

- seinere

- lansert

- lansere

- læring

- venstre

- Lengde

- Nivå

- nivåer

- Livssyklus

- løfte

- i likhet med

- Sannsynlig

- begrense

- linux

- laste

- lokalt

- ligger

- plassering

- logikk

- logisk

- Lang

- lenger

- Se

- Lot

- lavest

- maskin

- maskinlæring

- mange

- maksimal

- Kan..

- bety

- midler

- Flett

- møtte

- Metrics

- kunne

- minutter

- mangler

- ML

- MLOps

- modell

- modeller

- modifisere

- Overvåke

- skjermer

- mer

- mest

- flere

- navn

- smal

- navigerer

- Trenger

- Ny

- nylig

- neste

- Nei.

- none

- bærbare

- bemerket

- nå

- Antall

- følelsesløs

- objekt

- Målet

- gjenstander

- of

- off

- Tilbud

- on

- gang

- ONE

- bare

- åpen

- Drift

- optimal

- optimalisering

- Optimalisere

- optimalisert

- or

- rekkefølge

- OS

- Annen

- andre

- ut

- produksjon

- utenfor

- enn

- samlet

- side

- pandaer

- Parallel

- parametere

- del

- Spesielt

- Passerer

- lidenskapelig

- banen

- Betale

- Utfør

- ytelse

- utfører

- vedvarer

- stykker

- rørledning

- plato

- Platon Data Intelligence

- PlatonData

- spiller

- støpsel

- Point

- poeng

- politikk

- befolkningen

- mulig

- Post

- potensiell

- pragmatisk

- forutsi

- Predictor

- Forbered

- forutsetninger

- gaver

- forebygge

- tidligere

- prising

- primære

- Skrive ut

- Problem

- prosess

- produsere

- Produksjon

- Programmering

- Progress

- prosjekt

- prosjekter

- lovende

- egenskaper

- gi

- gir

- gi

- offentlig

- formål

- Python

- tilfeldig

- rask

- nådd

- klar

- grunnen til

- nylig

- .

- anbefaler

- poster

- redusere

- reduserer

- referere

- referanse

- om

- regex

- region

- utgitt

- relevant

- gjenværende

- fjerne

- gjenta

- Repository

- anmode

- krever

- påkrevd

- Ressurser

- de

- ansvarlig

- begrenset

- resultere

- Resultater

- retur

- ikke sant

- Rolle

- Kjør

- rennende

- går

- runtime

- sagemaker

- SageMaker Automatisk modellinnstilling

- lagret

- Skala

- skalering

- Vitenskap

- forskere

- scikit lære

- omfang

- Resultat

- script

- skript

- Sekund

- sekunder

- Seksjon

- seksjoner

- sektor

- se

- synes

- valgt

- utvalg

- SELV

- senior

- separat

- betjene

- server~~POS=TRUNC

- tjeneste

- Tjenester

- Session

- sett

- sett

- innstillinger

- oppsett

- hun

- bør

- showcased

- vist

- Viser

- Enkelt

- forenkle

- ganske enkelt

- tekstutdrag

- So

- løsning

- Solutions

- LØSE

- noen

- spesialisert

- spesifikk

- spesifikasjon

- spesifikasjoner

- spesifisert

- fart

- splittet

- stable

- Standard

- Begynn

- Start

- status

- Trinn

- Steps

- Stopp

- stoppet

- stoppe

- lagring

- lagret

- lagring

- Strategi

- struktur

- strukturer

- I ettertid

- slik

- Støttes

- bord

- skreddersydd

- Ta

- Target

- lag

- Teknisk

- teknikker

- Technologies

- terminal

- test

- Testing

- Det

- De

- deres

- Dem

- deretter

- Der.

- derfor

- Disse

- de

- denne

- De

- tre

- terskel

- Gjennom

- tid

- til

- sammen

- verktøy

- topp

- Totalt

- mot

- tradisjonelle

- Tog

- Kurs

- transformasjoner

- prøve

- forsøk

- prøvd

- utløse

- utløst

- utløsende

- prøver

- tuning

- to

- typen

- typer

- typisk

- ui

- etter

- forståelse

- unik

- til

- uønsket

- lastet opp

- bruk

- bruke

- bruk sak

- brukt

- bruker

- ved hjelp av

- VALIDERE

- verdi

- Verdier

- variabel

- variert

- ulike

- versjon

- versjoner

- Se

- visualisering

- W

- vente

- walkthrough

- ønsker

- var

- Vei..

- we

- web

- webtjenester

- VI VIL

- var

- Hva

- når

- mens

- om

- hvilken

- hvorfor

- vil

- med

- innenfor

- uten

- Arbeid

- arbeidsflyt

- arbeidsflyt

- arbeid

- ville

- skrive

- ennå

- Du

- Din

- deg selv

- zephyrnet