"Intelligent dokumentbehandling (IDP)-løsninger trekker ut data for å støtte automatisering av høyvolum, repeterende dokumentbehandlingsoppgaver og for analyse og innsikt. IDP bruker naturlige språkteknologier og datasyn for å trekke ut data fra strukturert og ustrukturert innhold, spesielt fra dokumenter, for å støtte automatisering og utvidelse.» – Gartner

Målet med Amazons intelligente dokumentbehandling (IDP) er å automatisere behandlingen av store mengder dokumenter ved hjelp av maskinlæring (ML) for å øke produktiviteten, redusere kostnader forbundet med menneskelig arbeidskraft og gi en sømløs brukeropplevelse. Kunder bruker en betydelig mengde tid og krefter på å identifisere dokumenter og trekke ut viktig informasjon fra dem for ulike brukstilfeller. I dag, Amazon Comprehend støtter klassifisering for rene tekstdokumenter, som krever at du forhåndsbehandler dokumenter i semi-strukturerte formater (skannet, digital PDF eller bilder som PNG, JPG, TIFF) og deretter bruke ren tekstutdata for å kjøre slutninger med tilpasset klassifisering modell. Tilsvarende for tilpasset enhetsgjenkjenning i sanntid kreves forhåndsbehandling for å trekke ut tekst for semistrukturerte dokumenter som PDF- og bildefiler. Denne totrinnsprosessen introduserer kompleksiteten i arbeidsflyter for dokumentbehandling.

I fjor, vi annonsert støtte for opprinnelige dokumentformater med egendefinert navngitt enhetsgjenkjenning (NER) asynkrone jobber. I dag er vi glade for å kunngjøre ett-trinns dokumentklassifisering og sanntidsanalyse for NER for semistrukturerte dokumenter i opprinnelige formater (PDF, TIFF, JPG, PNG) ved bruk av Amazon Comprehend. Spesielt kunngjør vi følgende funksjoner:

- Støtte for dokumenter i opprinnelige formater for tilpasset klassifisering i sanntidsanalyse og asynkrone jobber

- Støtte for dokumenter i opprinnelige formater for tilpasset enhetsgjenkjenning i sanntid

Med denne nye utgivelsen støtter Amazon Comprehend tilpasset klassifisering og tilpasset enhetsgjenkjenning (NER) dokumenter i formater som PDF, TIFF, PNG og JPEG direkte, uten å måtte trekke ut UTF8-kodet ren tekst fra dem. Følgende figur sammenligner den forrige prosessen med den nye prosedyren og støtten.

Denne funksjonen forenkler dokumentbehandlingsarbeidsflytene ved å eliminere eventuelle forhåndsbehandlingstrinn som kreves for å trekke ut ren tekst fra dokumenter, og reduserer den totale tiden som kreves for å behandle dem.

I dette innlegget diskuterer vi en IDP-arbeidsflytløsningsdesign på høyt nivå, noen få industribrukstilfeller, de nye funksjonene til Amazon Comprehend og hvordan du bruker dem.

Oversikt over løsning

La oss starte med å utforske et vanlig bruksområde i forsikringsbransjen. En typisk forsikringsskadeprosess involverer en skadepakke som kan inneholde flere dokumenter. Når et forsikringskrav sendes inn, inkluderer det dokumenter som forsikringskravskjema, hendelsesrapporter, identitetsdokumenter og tredjepartskravdokumenter. Volumet av dokumenter for å behandle og avgjøre et forsikringskrav kan løpe opp til hundrevis og til og med tusenvis av sider, avhengig av typen krav og forretningsprosesser som er involvert. Representanter og dommere for forsikringskrav bruker vanligvis hundrevis av timer manuelt på å sikte, sortere og trekke ut informasjon fra hundrevis eller til og med tusenvis av krav.

I likhet med brukssaken for forsikringsbransjen, behandler betalingsbransjen også store mengder semistrukturerte dokumenter for grenseoverskridende betalingsavtaler, fakturaer og valutautskrifter. Bedriftsbrukere bruker mesteparten av tiden sin på manuelle aktiviteter som å identifisere, organisere, validere, trekke ut og sende nødvendig informasjon til nedstrømsapplikasjoner. Denne manuelle prosessen er kjedelig, repeterende, feilutsatt, dyr og vanskelig å skalere. Andre bransjer som står overfor lignende utfordringer inkluderer boliglån og utlån, helsevesen og biovitenskap, juridisk, regnskap og skatteforvaltning. Det er ekstremt viktig for virksomheter å behandle så store mengder dokumenter i tide med et høyt nivå av nøyaktighet og nominell manuell innsats.

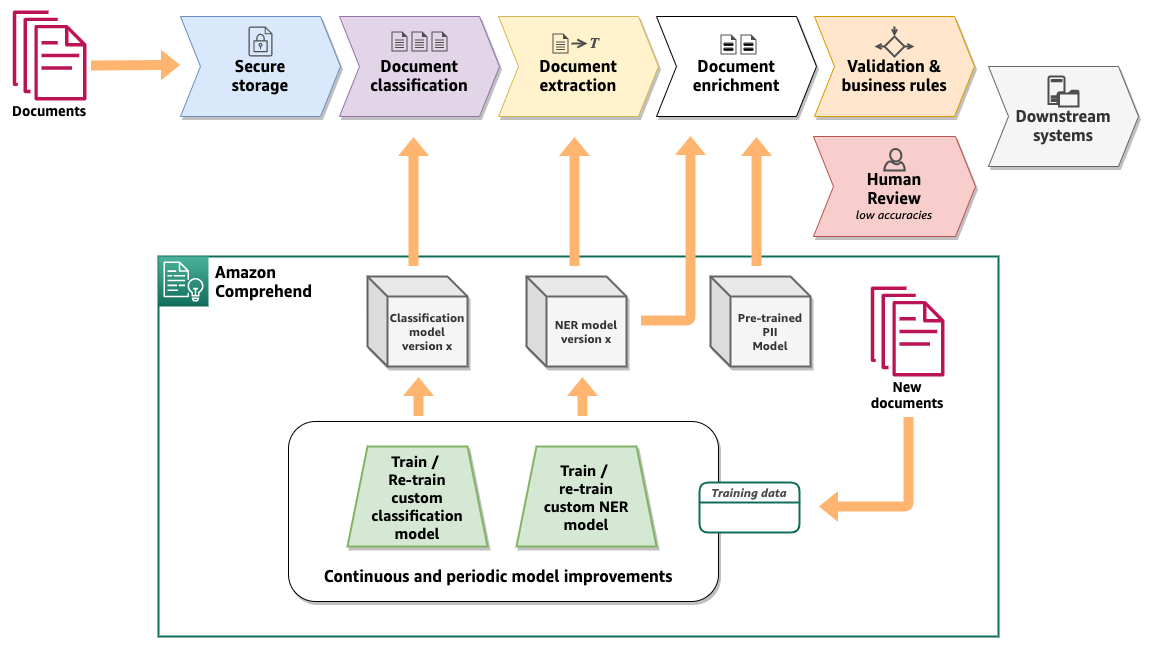

Amazon Comprehend gir nøkkelfunksjoner for å automatisere dokumentklassifisering og informasjonsutvinning fra et stort volum av dokumenter med høy nøyaktighet, på en skalerbar og kostnadseffektiv måte. Følgende diagram viser en logisk arbeidsflyt for IDP med Amazon Comprehend. Kjernen i arbeidsflyten består av dokumentklassifisering og informasjonsutvinning ved bruk av NER med tilpassede Amazon Comprehend-modeller. Diagrammet viser også hvordan de tilpassede modellene kontinuerlig kan forbedres for å gi høyere nøyaktighet etter hvert som dokumenter og forretningsprosesser utvikler seg.

Tilpasset dokumentklassifisering

Med tilpasset Amazon Comprehend-klassifisering kan du organisere dokumentene dine i forhåndsdefinerte kategorier (klasser). På et høyt nivå er følgende trinn for å sette opp en tilpasset dokumentklassifisering og utføre dokumentklassifisering:

- Forbered opplæringsdata for å trene en tilpasset dokumentklassifiserer.

- Tren opp en kundedokumentklassifiserer med opplæringsdataene.

- Etter at modellen er opplært, kan du eventuelt distribuere et sanntidsendepunkt.

- Utfør dokumentklassifisering med enten en asynkron jobb eller i sanntid ved å bruke endepunktet.

Trinn 1 og 2 gjøres vanligvis i begynnelsen av et IDP-prosjekt etter at dokumentklassene som er relevante for forretningsprosessen er identifisert. En tilpasset klassifiseringsmodell kan deretter omskoleres med jevne mellomrom for å forbedre nøyaktigheten og introdusere nye dokumentklasser. Du kan trene en tilpasset klassifiseringsmodell enten i flerklasse-modus or multi-label-modus. Trening kan utføres for hver på en av to måter: ved å bruke en CSV-fil, eller ved å bruke en utvidet manifestfil. Referere til Utarbeide treningsdata for mer informasjon om opplæring av en tilpasset klassifiseringsmodell. Etter at en tilpasset klassifiseringsmodell er opplært, kan et dokument klassifiseres enten ved å bruke sanntidsanalyse eller en asynkron jobb. Sanntidsanalyse krever en endepunkt som skal distribueres med den opplærte modellen og er best egnet for små dokumenter avhengig av bruksområdet. For et stort antall dokumenter er en asynkron klassifiseringsjobb best egnet.

Tren en tilpasset dokumentklassifiseringsmodell

For å demonstrere den nye funksjonen trente vi en tilpasset klassifiseringsmodell i multi-label-modus, som kan klassifisere forsikringsdokumenter i en av syv forskjellige klasser. Klassene er INSURANCE_ID, PASSPORT, LICENSE, INVOICE_RECEIPT, MEDICAL_TRANSCRIPTION, DISCHARGE_SUMMARYog CMS1500. Vi ønsker å klassifisere eksempeldokumenter i opprinnelig PDF-, PNG- og JPEG-format, lagret i en Amazon enkel lagringstjeneste (Amazon S3) bøtte, ved hjelp av klassifiseringsmodellen. For å starte en asynkron klassifiseringsjobb, fullfør følgende trinn:

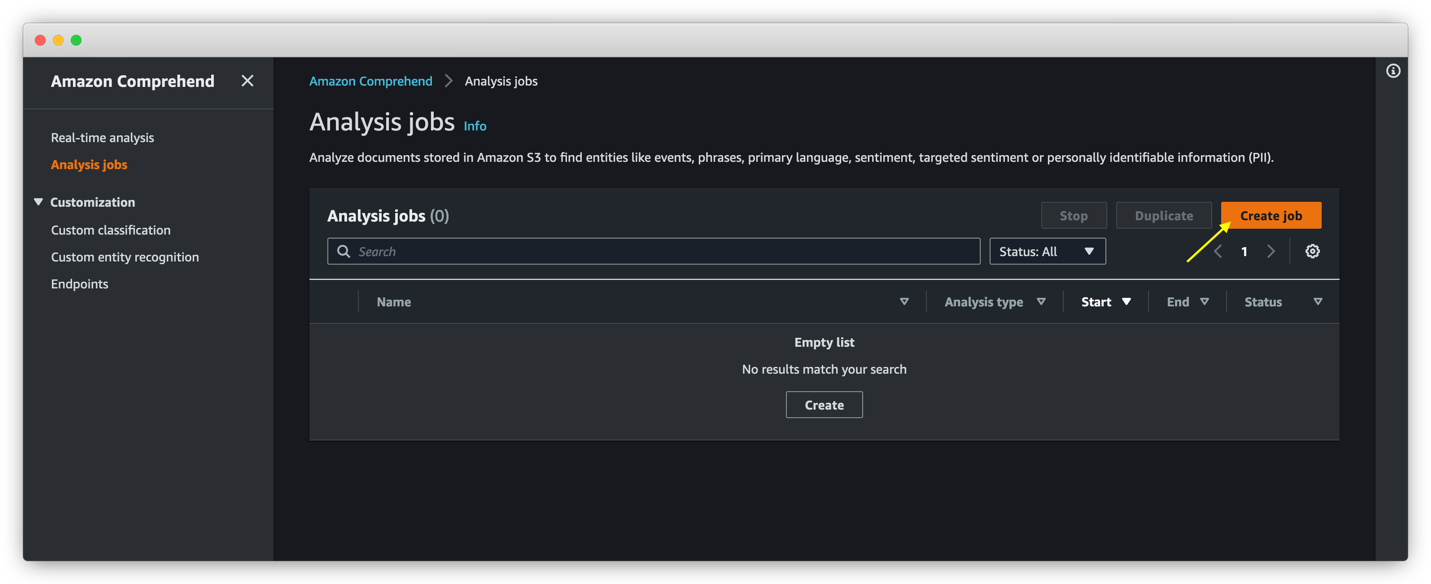

- Velg på Amazon Comprehend-konsollen Analyse jobber i navigasjonsruten.

- Velg Lag jobb.

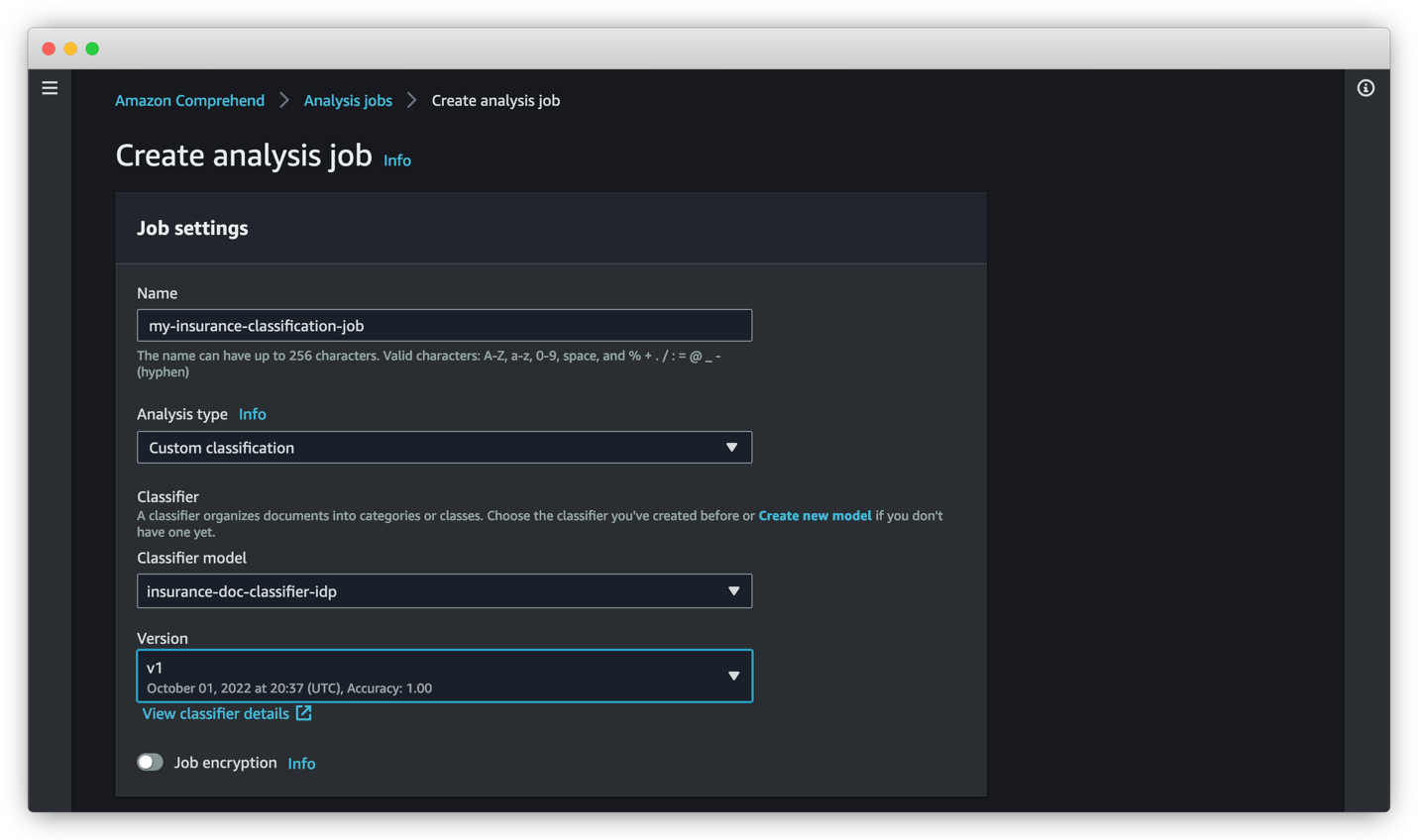

- Til Navn, skriv inn et navn for klassifiseringsjobben.

- Til Analysetype¸ velg Tilpasset klassifisering.

- Til Klassifiseringsmodell, velg den riktige trente klassifiseringsmodellen.

- Til Versjon, velg riktig modellversjon.

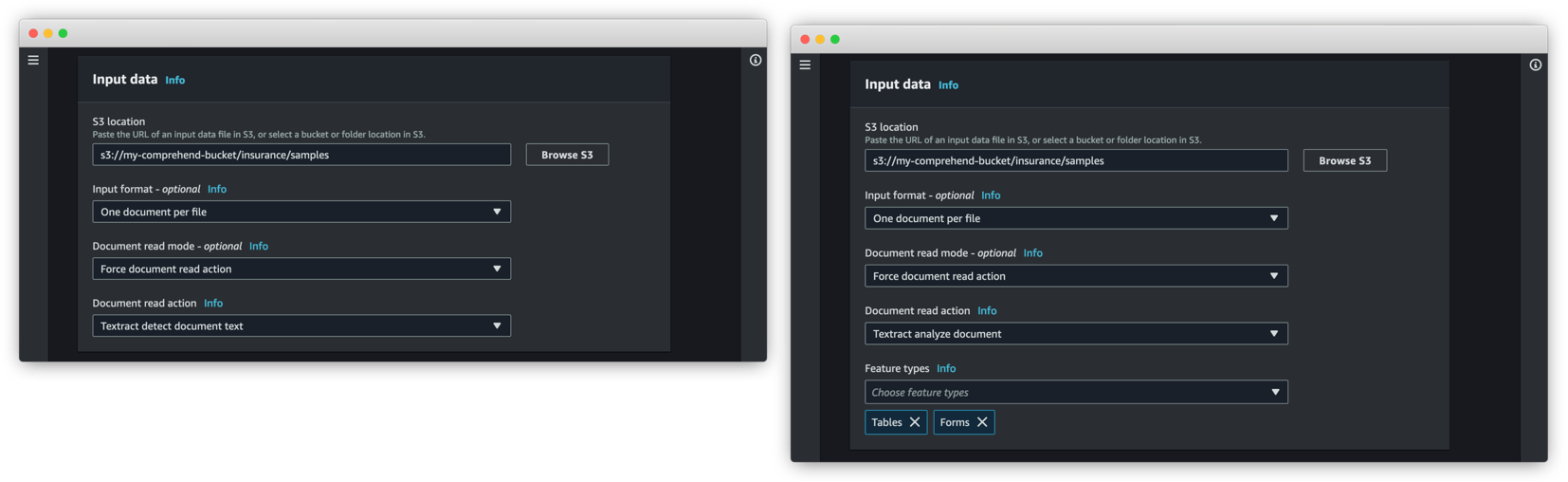

på Inndata seksjonen, oppgir vi stedet der dokumentene våre er lagret.

- Til Input format, velg Ett dokument per fil.

- Til Dokumentlesemodus¸ velg Tving handling for dokumentlesing.

- Til Dokumentles handling, velg Textract oppdage dokumenttekst.

Dette gjør at Amazon Comprehend kan bruke amazontekst Oppdag Dokumenttekst API for å lese dokumentene før du kjører klassifiseringen. De DetectDocumentText API er nyttig for å trekke ut linjer og ord med tekst fra dokumentene. Du kan også velge Textract-analysedokument forum Dokumentles handling, i så fall bruker Amazon Comprehend Amazon Textract Analyser Dokument API for å lese dokumentene. Med AnalyzeDocument API, kan du velge å trekke ut tabeller, Skjemaer, eller begge. De Dokumentlesemodus alternativet gjør det mulig for Amazon Comprehend å trekke ut teksten fra dokumenter bak kulissene, noe som bidrar til å redusere det ekstra trinnet med å trekke ut tekst fra dokumentet, som kreves i arbeidsflyten vår for dokumentbehandling.

Den tilpassede klassifiseringen Amazon Comprehend kan også behandle rå JSON-svar generert av DetectDocumentText og AnalyzeDocument APIer, uten modifikasjoner eller forbehandling. Dette er nyttig for eksisterende arbeidsflyter der Amazon Textract er involvert i å trekke ut tekst fra dokumentene allerede. I dette tilfellet kan JSON-utdataene fra Amazon Textract mates direkte til Amazon Comprehend-dokumentklassifiserings-API-ene.

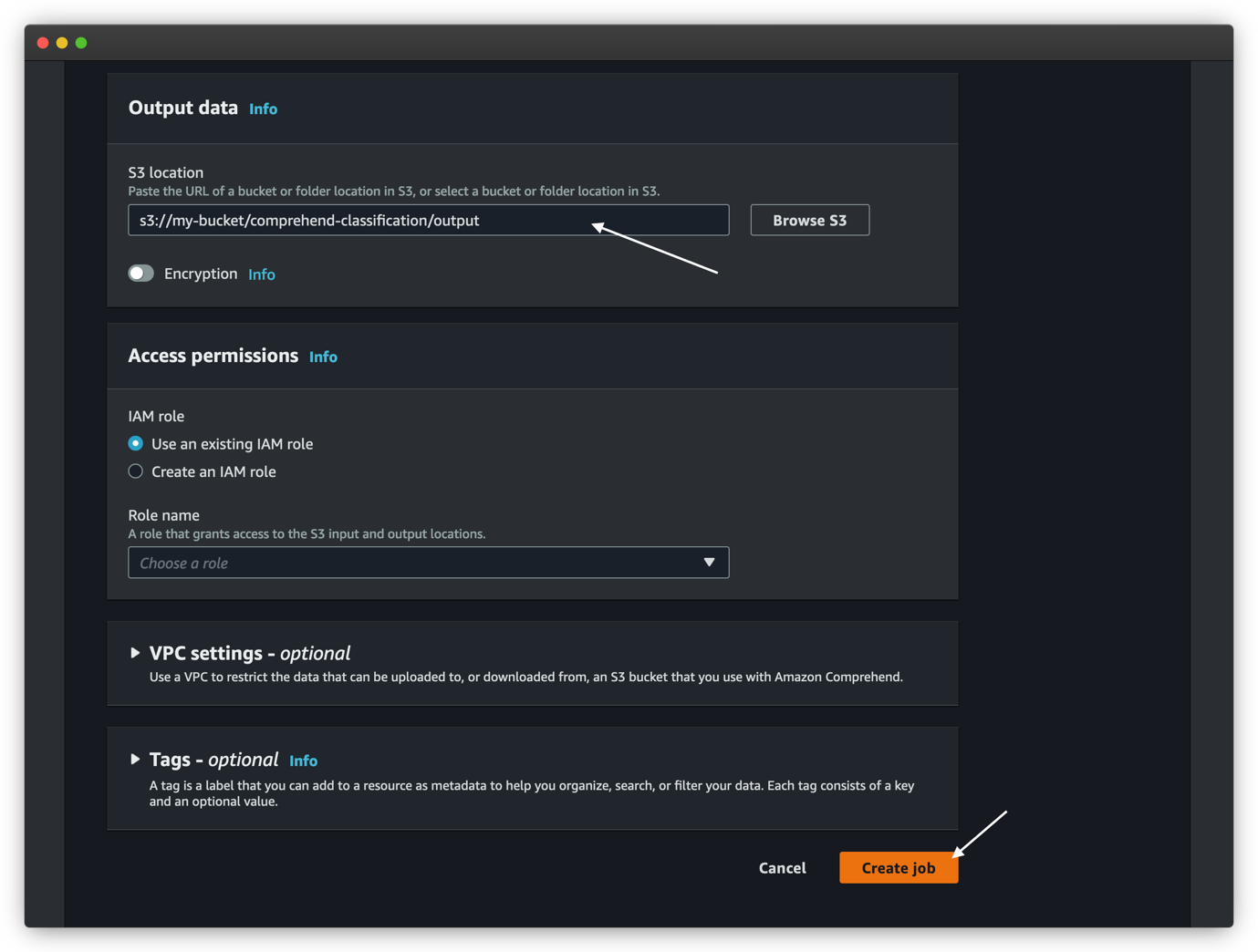

- på Utdata seksjon, for S3 beliggenhet, spesifiser et Amazon S3-sted der du vil at den asynkrone jobben skal skrive resultatene av slutningen.

- La de resterende alternativene være standard.

- Velg Lag jobb å starte jobben.

Du kan se statusen til jobben på Analyse jobber side.

Når jobben er fullført, kan vi se utdataene fra analysejobben, som er lagret på Amazon S3-lokasjonen som er oppgitt under jobbkonfigurasjonen. Klassifiseringsutdataene for vårt enkeltsides PDF-eksempel CMS1500-dokument er som følger. Utdataene er en fil i JSON-linjeformat, som har blitt formatert for å forbedre lesbarheten.

Det foregående eksemplet er et enkeltsides PDF-dokument; tilpasset klassifisering kan imidlertid også håndtere flersidige PDF-dokumenter. Når det gjelder dokumenter med flere sider, inneholder utdataene flere JSON-linjer, der hver linje er klassifiseringsresultatet for hver av sidene i et dokument. Følgende er et eksempel på flere siders klassifiseringsutdata:

Anerkjennelse av tilpasset enhet

Med en egendefinert enhetsgjenkjenner fra Amazon Comprehend kan du analysere dokumenter og trekke ut enheter som produktkoder eller forretningsspesifikke enheter som passer dine spesielle behov. På et høyt nivå er følgende trinn for å konfigurere en tilpasset enhetsgjenkjenner og utføre enhetsdeteksjon:

- Forbered treningsdata for å trene en tilpasset enhetsgjenkjenner.

- Tren opp en egendefinert enhetsgjenkjenner med treningsdataene.

- Etter at modellen er opplært, kan du eventuelt distribuere et sanntidsendepunkt.

- Utfør enhetsdeteksjon med enten en asynkron jobb eller i sanntid ved å bruke endepunktet.

En tilpasset enhetsgjenkjenningsmodell kan periodisk omskoleres for å forbedre nøyaktigheten og for å introdusere nye enhetstyper. Du kan trene en tilpasset enhetsgjenkjennermodell med begge enhet lister or merknader. I begge tilfeller lærer Amazon Comprehend om typen dokumenter og konteksten der enhetene oppstår for å bygge en enhetsgjenkjenningsmodell som kan generalisere for å oppdage nye enheter. Referere til Forberedelse av treningsdata for å lære mer om forberedelse av opplæringsdata for tilpasset enhetsgjenkjenner.

Etter at en tilpasset enhetsgjenkjenningsmodell er trent, kan enhetsdeteksjon gjøres enten ved å bruke sanntidsanalyse eller en asynkron jobb. Sanntidsanalyse krever en endepunkt som skal distribueres med den opplærte modellen og er best egnet for små dokumenter avhengig av bruksområdet. For et stort antall dokumenter er en asynkron klassifiseringsjobb best egnet.

Tren opp en tilpasset enhetsgjenkjenningsmodell

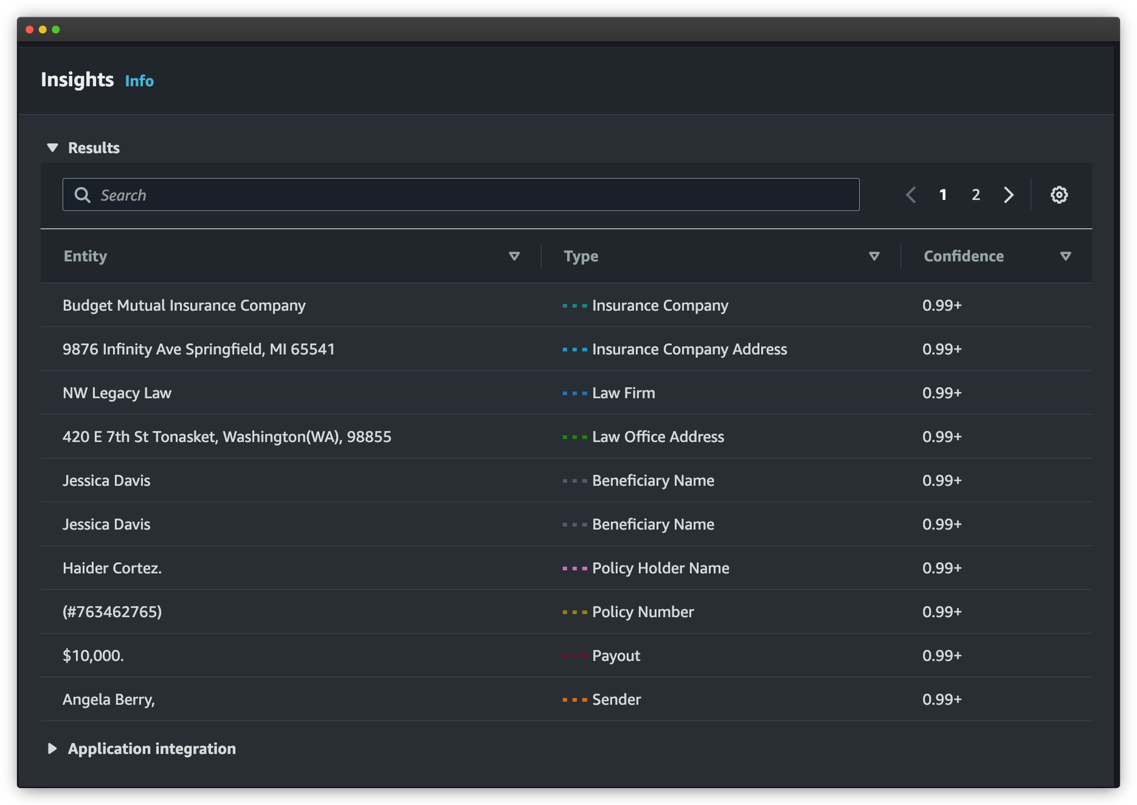

For å demonstrere enhetsdeteksjonen i sanntid, trente vi opp en tilpasset enhetsgjenkjenningsmodell med forsikringsdokumenter og utvidede manifestfiler ved å bruke tilpassede merknader og implementerte endepunktet ved å bruke den opplærte modellen. Entitetstypene er Law Firm, Law Office Address, Insurance Company, Insurance Company Address, Policy Holder Name, Beneficiary Name, Policy Number, Payout, Required Actionog Sender. Vi ønsker å oppdage enheter fra eksempeldokumenter i opprinnelig PDF-, PNG- og JPEG-format, lagret i en S3-bøtte, ved å bruke gjenkjennelsesmodellen.

Merk at du kan bruke en egendefinert enhetsgjenkjenningsmodell som er opplært med PDF-dokumenter for å trekke ut egendefinerte enheter fra PDF-, TIFF-, bilde-, Word- og ren tekstdokumenter. Hvis modellen din er opplært ved å bruke tekstdokumenter og en enhetsliste, kan du bare bruke vanlige tekstdokumenter for å trekke ut enhetene.

Vi må oppdage enheter fra et eksempeldokument i alle originale PDF-, PNG- og JPEG-formater ved å bruke gjenkjennelsesmodellen. For å starte en synkron enhetsdeteksjonsjobb, fullfør følgende trinn:

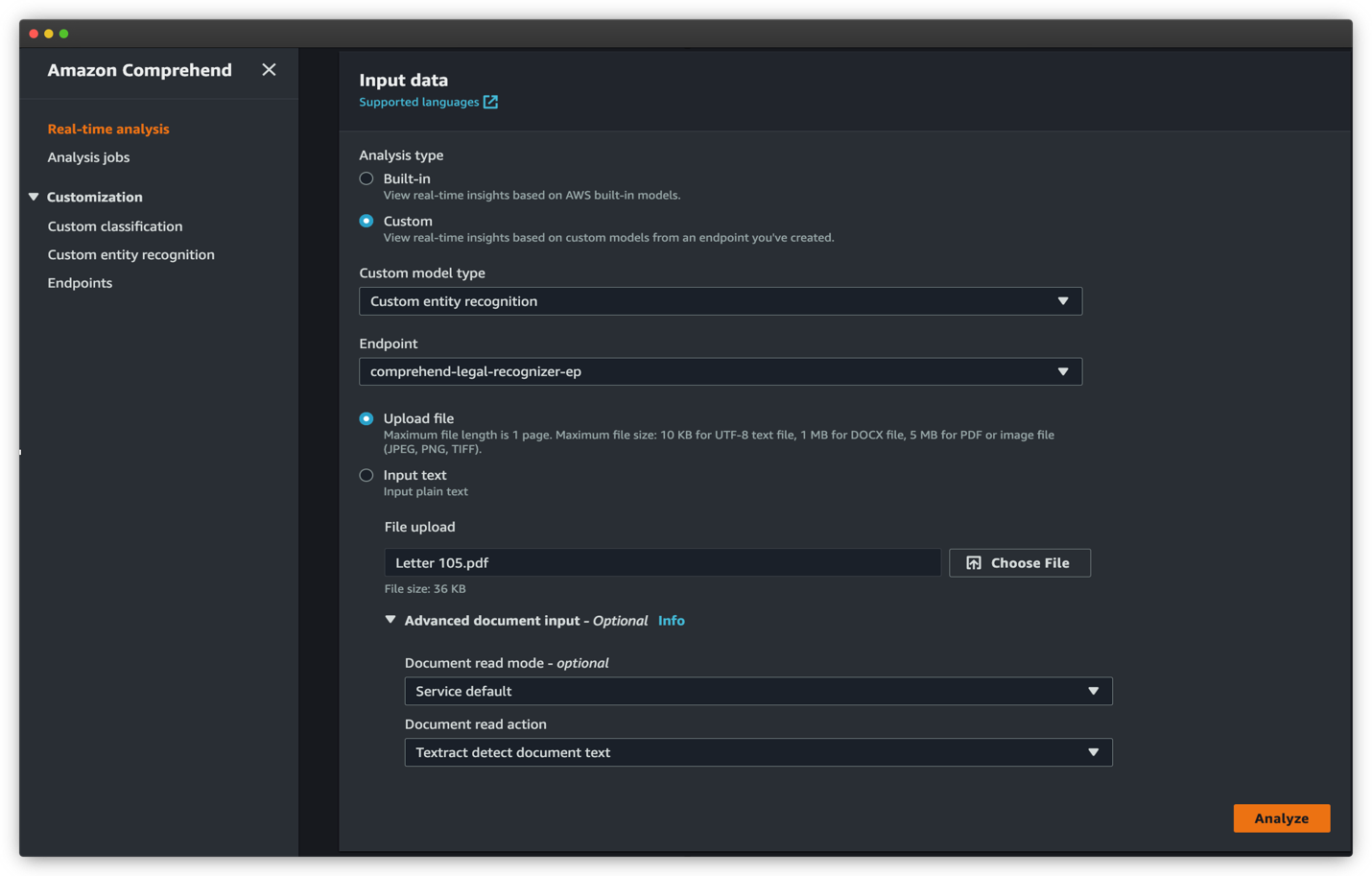

- Velg på Amazon Comprehend-konsollen Sanntidsanalyse i navigasjonsruten.

- Under Analysetype, plukke ut Custom.

- Til Anerkjennelse av tilpasset enhet, velg den tilpassede modelltypen.

- Til Endpoint, velg sanntidsendepunktet du opprettet for enhetsgjenkjenningsmodellen din.

- Plukke ut Last opp fil Og velg Velg Fil for å laste opp PDF- eller bildefilen for slutning.

- Utvid Avansert dokumentinntasting seksjon og for Dokumentlesemodus, velg Tjenestestandard.

- Til Dokumentles handling, velg Textract oppdage dokumenttekst.

- Velg Analyser å analysere dokumentet i sanntid.

De anerkjente enhetene er oppført i Insights seksjon. Hver enhet inneholder enhetsverdien (teksten), typen enhet som definert av deg under treningsprosessen, og den tilsvarende konfidenspoengsummen.

For flere detaljer og en fullstendig gjennomgang av hvordan du trener en tilpasset enhetsgjenkjenningsmodell og bruker den til å utføre asynkron inferens ved bruk av asynkrone analysejobber, se Trekk ut egendefinerte enheter fra dokumenter i deres opprinnelige format med Amazon Comprehend.

konklusjonen

Dette innlegget demonstrerte hvordan du kan klassifisere og kategorisere semistrukturerte dokumenter i deres opprinnelige format og oppdage forretningsspesifikke enheter fra dem ved å bruke Amazon Comprehend. Du kan bruke sanntids-API-er for brukstilfeller med lav latens, eller bruke asynkrone analysejobber for massedokumentbehandling.

Som et neste trinn oppfordrer vi deg til å besøke Amazon Comprehend GitHub repository for fullstendige kodeeksempler for å prøve ut disse nye funksjonene. Du kan også besøke Amazon Comprehend utviklerveiledning og Amazon Forstå utviklerressurser for videoer, opplæringsprogrammer, blogger og mer.

Om forfatterne

Wrick Talukdar er seniorarkitekt med Amazon Comprehend Service-teamet. Han jobber med AWS-kunder for å hjelpe dem å ta i bruk maskinlæring i stor skala. Utenom jobben liker han å lese og fotografere.

Wrick Talukdar er seniorarkitekt med Amazon Comprehend Service-teamet. Han jobber med AWS-kunder for å hjelpe dem å ta i bruk maskinlæring i stor skala. Utenom jobben liker han å lese og fotografere.

Anjan Biswas er en senior AI Services Solutions Architect med fokus på AI/ML og Data Analytics. Anjan er en del av det verdensomspennende AI-tjenesteteamet og jobber med kunder for å hjelpe dem med å forstå og utvikle løsninger på forretningsproblemer med AI og ML. Anjan har over 14 års erfaring med å jobbe med globale forsyningskjeder, produksjons- og detaljhandelsorganisasjoner, og hjelper aktivt kunder med å komme i gang og skalere på AWS AI-tjenester.

Anjan Biswas er en senior AI Services Solutions Architect med fokus på AI/ML og Data Analytics. Anjan er en del av det verdensomspennende AI-tjenesteteamet og jobber med kunder for å hjelpe dem med å forstå og utvikle løsninger på forretningsproblemer med AI og ML. Anjan har over 14 års erfaring med å jobbe med globale forsyningskjeder, produksjons- og detaljhandelsorganisasjoner, og hjelper aktivt kunder med å komme i gang og skalere på AWS AI-tjenester.

Godwin Sahayaraj Vincent er en Enterprise Solutions Architect hos AWS som brenner for maskinlæring og gir veiledning til kunder for å designe, distribuere og administrere deres AWS-arbeidsbelastninger og -arkitekturer. På fritiden elsker han å spille cricket med vennene sine og tennis med de tre barna sine.

Godwin Sahayaraj Vincent er en Enterprise Solutions Architect hos AWS som brenner for maskinlæring og gir veiledning til kunder for å designe, distribuere og administrere deres AWS-arbeidsbelastninger og -arkitekturer. På fritiden elsker han å spille cricket med vennene sine og tennis med de tre barna sine.

- Avansert (300)

- AI

- ai kunst

- ai art generator

- du har en robot

- Amazon Comprehend

- kunstig intelligens

- sertifisering av kunstig intelligens

- kunstig intelligens i bankvirksomhet

- kunstig intelligens robot

- kunstig intelligens roboter

- programvare for kunstig intelligens

- AWS maskinlæring

- blockchain

- blockchain konferanse ai

- coingenius

- samtale kunstig intelligens

- kryptokonferanse ai

- dall sin

- dyp læring

- google det

- maskinlæring

- plato

- plato ai

- Platon Data Intelligence

- Platon spill

- PlatonData

- platogaming

- skala ai

- syntaks

- zephyrnet