Vi har trent og åpner for et nevralt nett kalt Whisper som nærmer seg robusthet og nøyaktighet på menneskelig nivå på engelsk talegjenkjenning.

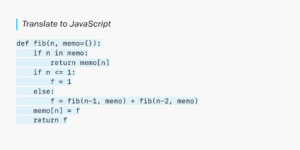

Vis kode

Se modellkort

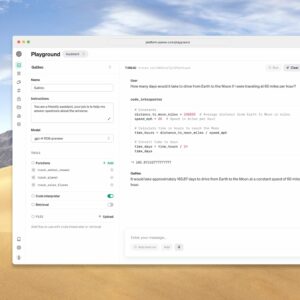

Eksempler på hviske:

Whisper er et automatisk talegjenkjenning (ASR) system som er trent på 680,000 XNUMX timer med flerspråklig og multitask overvåket data samlet inn fra nettet. Vi viser at bruk av et så stort og mangfoldig datasett fører til forbedret robusthet overfor aksenter, bakgrunnsstøy og fagspråk. Dessuten muliggjør det transkripsjon på flere språk, samt oversettelse fra disse språkene til engelsk. Vi er åpne kildemodeller og inferenskode for å tjene som grunnlag for å bygge nyttige applikasjoner og for videre forskning på robust talebehandling.

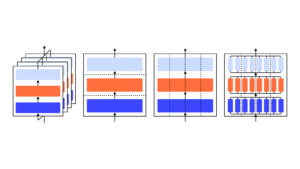

Whisper-arkitekturen er en enkel ende-til-ende-tilnærming, implementert som en koder-dekoder-transformator. Inngangslyd deles opp i 30 sekunders biter, konverteres til et log-Mel-spektrogram og sendes deretter til en koder. En dekoder er opplært til å forutsi den korresponderende tekstteksten, blandet med spesielle symboler som leder den enkelte modellen til å utføre oppgaver som språkidentifikasjon, tidsstempler på frasenivå, flerspråklig taletranskripsjon og til engelsk taleoversettelse.

Andre eksisterende tilnærminger bruker ofte mindre, tettere sammenkoblede lyd-tekst-treningsdatasett, eller bruk bred, men uovervåket lydforopplæring. Fordi Whisper ble trent på et stort og mangfoldig datasett og ikke ble finjustert til noen spesifikke, slår det ikke modeller som spesialiserer seg på LibriSpeech-ytelse, en kjent konkurransedyktig målestokk innen talegjenkjenning. Men når vi måler Whispers nullskuddsytelse på tvers av mange forskjellige datasett, finner vi at den er mye mer robust og gjør 50 % færre feil enn disse modellene.

Omtrent en tredjedel av Whispers lyddatasett er ikke-engelsk, og det får vekselvis oppgaven med å transkribere på originalspråket eller oversette til engelsk. Vi finner at denne tilnærmingen er spesielt effektiv for å lære tale til tekst-oversettelse og overgår den overvåkede SOTA-en på CoVoST2 til engelsk oversettelse zero-shot.

Vi håper Whispers høye nøyaktighet og brukervennlighet vil tillate utviklere å legge til talegrensesnitt til et mye bredere sett med applikasjoner. Sjekk ut papir, modellkortog kode for å lære mer detaljer og prøve Whisper.

- AI

- ai kunst

- ai art generator

- du har en robot

- kunstig intelligens

- sertifisering av kunstig intelligens

- kunstig intelligens i bankvirksomhet

- kunstig intelligens robot

- kunstig intelligens roboter

- programvare for kunstig intelligens

- blockchain

- blockchain konferanse ai

- coingenius

- samtale kunstig intelligens

- kryptokonferanse ai

- dall sin

- dyp læring

- google det

- maskinlæring

- OpenAI

- plato

- plato ai

- Platon Data Intelligence

- Platon spill

- PlatonData

- platogaming

- forskning

- skala ai

- syntaks

- zephyrnet