Å kunne dekode hjernebølger kan hjelpe pasienter som har mistet evnen til å snakke til å kommunisere igjen, og kan til slutt gi nye måter for mennesker å samhandle med datamaskiner. Nå har Meta-forskere vist at de kan fortelle hvilke ord noen er hørsel ved hjelp av opptak fra ikke-invasive hjerneskanninger.

Vår evne til å sondere menneskelig hjerneaktiviteten har forbedret seg betydelig de siste tiårene ettersom forskere har utviklet en rekke hjerne-datamaskingrensesnitt (BCI) teknologier som kan gi et vindu inn i våre tanker og intensjoner.

De mest imponerende resultatene har kommet fra invasive opptaksenheter, som implanterer elektroder direkte inn i hjerne gray saken, kombinert med AI som kan lære å tolket hjernens signaler. De siste årene har dette madet mulig å avkode hele setninger fra noens nevrale aktivitet med 97 prosent nøyaktighet, og oversette forsøkt håndskriftbevegelser direkte inn i tekst ved sammenlignbare hastigheterle til teksting.

Men å måtte implantere elektroder i noens hjerne har åpenbare ulemper. Disse risikofylte prosedyrene er bare medisinsk forsvarlige for pasienter som trenger hjerneregistrering for å hjelpe til med å løse andre medisinske problemer, for eksempel epilepsi. Og nevrale prober brytes ned over tid, noe som øker muligheten for å måtte erstatte dem regelmessig.

Det er grunnen til at forskere ved Metas AI-forskningsavdeling bestemte seg for å undersøke om de kunne oppnå lignende mål uten å kreve farlig hjerneoperasjony. I et papir publisert på forhåndsutskriftsserveren arXiv, teamet rapporterte at de har utviklet et AI-system som kan forutsi hvilke ord noen lytter til basert på hjerneaktivitet registrert med ikke-invasiv hjernedatamaskingrensesnitt.

"Det er åpenbart ekstremt invasivt å sette en elektrode i hjernen til noen, sier Jean Remi King, en forsker ved Facebook Artificial Intelligence Research (FAIR) Lab, fortalte TIME. "Så vi ønsket å prøve å bruke ikke-invasive registreringer av hjerneaktivitet. Og målet var å bygge et AI-system som kan dekode hjerneresponser på talte historier.»

Forskerne stolte på fire eksisterende datasett for hjerneaktivitet samlet inn fra 169 personer mens de lyttet til opptak av folk som snakket. Hver frivillig ble registrert ved hjelp av enten magneto-encefalografi (MEG) eller elektroencefalografi (EEG), som bruker forskjellige typer sensorer for å fange opp den elektriske aktiviteten til hjernen fra utsiden av hodeskallen.

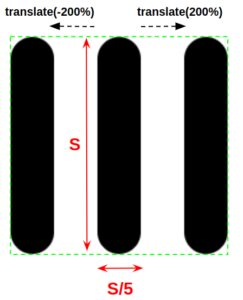

Deres tilnærming innebærerd dele hjernen og lyddata inn i tre-andre lange utdrag og mater den inn i et nevralt nettverk som deretter ser uted for mønstre som cOuld koble de to. Etter å ha trent AI på mange timer med disse dataene, testet de den på tidligere usett data.

Systemet presterte best på et av MEG-datasettene, der det oppnådde en topp-10-nøyaktighet på 72.5 prosent. Det betyr at når den rangerte 10 ord med høyest sannsynlighet for å være knyttet til hjernebølgesegmentet, var det riktige ordet der 72.5 prosent av tiden.

Det høres kanskje ikke bra ut, men det er viktig å huske at det plukket fra et potensielt vokabular på 793 ord. Systemet scoret 67.2 prosent på det andre MEG-datasettet, men klarte seg dårligere på EEG-datasettene, og ble topp-10 nøyaktigheter på bare 31.4 og 19.1.

Dette er tydeligvis fortsatt et stykke unna et praktisk system, men det representerer betydelig fremgang på et vanskelig problem. Ikke-invasive BCI-er har mye dårligere signal-til-støy-forhold, så å dechiffrere nevral aktivitet på denne måten er utfordrende, men hvis det lykkes, kan det resultere i en langt mer anvendelig teknologi.

Ikke alle er overbevist om at det er et løsbart problem. Thomas Knopfel fra Imperial College London fortalte New Scientist at det å prøve å undersøke tanker ved å bruke disse ikke-invasive tilnærmingene var som "prøver å streame en HD-film over gammeldagse analoge telefonmodemer,” og stilte spørsmål ved om slike tilnærminger noen gang vil nå praktiske nøyaktighetsnivåer.

Selskaper som Elon Musks Neuralink satser også på at vi til slutt vil komme over vår pysete rundt invasive tilnærminger ettersom teknologien forbedres, og åpner døren for vanlige mennesker som får hjerneimplantater.

Men forskningen fra teamet ved Meta er på et veldig tidlig stadium, og det er store muligheter for forbedringer. Og de kommersielle mulighetene for alle som kan knekke ikke-invasiv hjerneskanning vil sannsynligvis gi mye motivasjon for å prøve.