Generert med Midjourney

NeurIPS 2023-konferansen, som ble holdt i den pulserende byen New Orleans fra 10. til 16. desember, hadde spesiell vekt på generative AI og store språkmodeller (LLM). I lys av de siste banebrytende fremskritt på dette området, var det ingen overraskelse at disse temaene dominerte diskusjonene.

Et av kjernetemaene på årets konferanse var søken etter mer effektive AI-systemer. Forskere og utviklere søker aktivt etter måter å konstruere AI som ikke bare lærer raskere enn nåværende LLM-er, men som også har forbedrede resonneringsevner samtidig som de bruker færre dataressurser. Denne jakten er avgjørende i kappløpet mot å oppnå Artificial General Intelligence (AGI), et mål som synes stadig mer oppnåelig i overskuelig fremtid.

De inviterte samtalene på NeurIPS 2023 var en refleksjon av disse dynamiske og raskt utviklende interessene. Forelesere fra ulike sfærer av AI-forskning delte sine siste prestasjoner, og ga et vindu til banebrytende AI-utvikling. I denne artikkelen fordyper vi oss i disse foredragene, trekker ut og diskuterer de viktigste takeawayene og læringene, som er avgjørende for å forstå dagens og fremtidige landskap for AI-innovasjon.

NextGenAI: The Delusion of Scaling and the Future of Generative AI

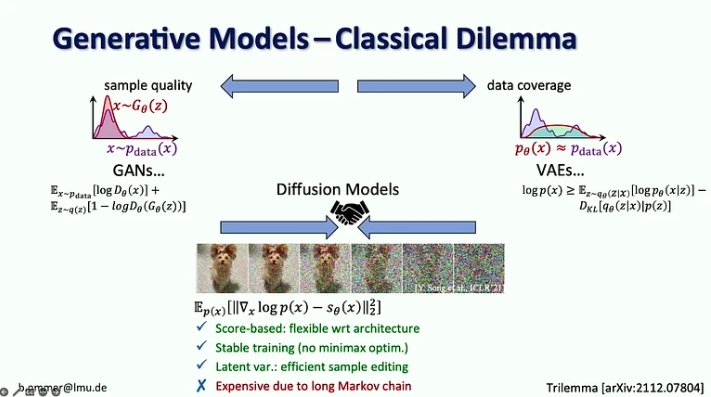

In snakket hans, Björn Ommer, leder for Computer Vision & Learning Group ved Ludwig Maximilian University of München, delte hvordan laboratoriet hans kom til å utvikle stabil diffusjon, noen lærdommer de lærte fra denne prosessen, og den nylige utviklingen, inkludert hvordan vi kan blande diffusjonsmodeller med flytmatching, gjenfinningsforsterkning og LoRA-tilnærminger, blant annet.

Viktige takeaways:

- I en alder av Generativ AI flyttet vi fra fokuset på persepsjon i synsmodeller (dvs. objektgjenkjenning) til å forutsi de manglende delene (f.eks. bilde- og videogenerering med diffusjonsmodeller).

- I 20 år var datasyn fokusert på benchmark-forskning, som bidro til å fokusere på de mest fremtredende problemene. I Generative AI har vi ingen standarder å optimalisere for, noe som åpnet feltet for alle til å gå i sin egen retning.

- Diffusjonsmodeller kombinerer fordelene med tidligere generative modeller ved å være poengbaserte med en stabil treningsprosedyre og effektiv prøveredigering, men de er dyre på grunn av deres lange Markov-kjede.

- Utfordringen med sterke sannsynlighetsmodeller er at de fleste bitene går inn i detaljer som knapt kan oppfattes av det menneskelige øyet, mens koding av semantikk, som betyr mest, tar bare noen få biter. Skalering alene ville ikke løse dette problemet fordi etterspørselen etter dataressurser vokser 9 ganger raskere enn GPU-tilførselen.

- Den foreslåtte løsningen er å kombinere styrken til diffusjonsmodeller og ConvNets, spesielt effektiviteten til konvolusjoner for å representere lokale detaljer og uttrykksevnen til diffusjonsmodeller for langdistansekontekst.

- Björn Ommer foreslår også å bruke en flow-matching-tilnærming for å muliggjøre høyoppløselig bildesyntese fra små latente diffusjonsmodeller.

- En annen tilnærming til å øke effektiviteten av bildesyntese er å fokusere på scenekomposisjon mens du bruker gjenfinningsforstørrelse for å fylle ut detaljene.

- Til slutt introduserte han iPoke-tilnærmingen for kontrollert stokastisk videosyntese.

Hvis dette dybdeinnholdet er nyttig for deg, abonner på vår AI-e-postliste å bli varslet når vi slipper nytt materiale.

De mange ansiktene til ansvarlig AI

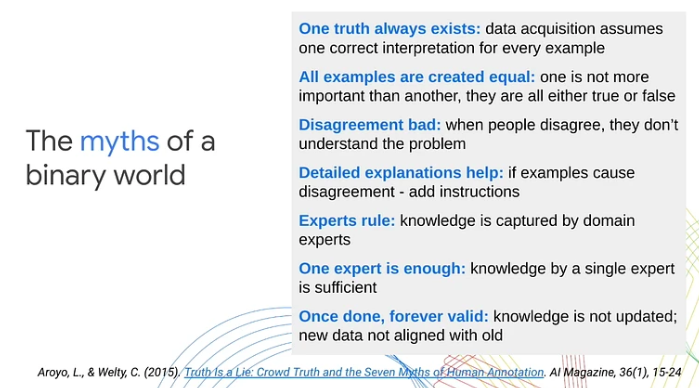

In presentasjonen hennes, Lora Aroyo, en forsker ved Google Research, fremhevet en nøkkelbegrensning i tradisjonelle maskinlæringsmetoder: deres avhengighet av binære kategoriseringer av data som positive eller negative eksempler. Denne overforenklingen, hevdet hun, overser den komplekse subjektiviteten som ligger i scenarier og innhold i den virkelige verden. Gjennom ulike brukstilfeller demonstrerte Aroyo hvordan innholds tvetydighet og den naturlige variasjonen i menneskelige synspunkter ofte fører til uunngåelige uenigheter. Hun understreket viktigheten av å behandle disse uenighetene som meningsfulle signaler i stedet for bare støy.

Her er viktige ting fra foredraget:

- Uenighet mellom menneskelige laboratorier kan være produktive. I stedet for å behandle alle svar som enten riktige eller gale, introduserte Lora Aroyo «sannhet ved uenighet», en tilnærming til distribusjonssannhet for å vurdere påliteligheten til data ved å utnytte uenighet hos vurderere.

- Datakvalitet er vanskelig selv med eksperter fordi eksperter er like uenige som crowdlabers. Disse uenighetene kan være mye mer informative enn svar fra en enkelt ekspert.

- I sikkerhetsevalueringsoppgaver er eksperter uenige i 40 % av eksemplene. I stedet for å prøve å løse disse uenighetene, må vi samle flere slike eksempler og bruke dem til å forbedre modellene og evalueringsverdiene.

- Lora Aroyo presenterte også sine Sikkerhet med mangfold metode for å granske dataene med tanke på hva i dem og hvem som har kommentert dem.

- Denne metoden produserte et benchmark-datasett med variasjon i LLM-sikkerhetsvurderinger på tvers av ulike demografiske grupper av vurderere (totalt 2.5 millioner vurderinger).

- For 20 % av samtalene var det vanskelig å avgjøre om chatbot-svaret var trygt eller usikkert, da det var omtrent like mange respondenter som merket dem som enten trygge eller usikre.

- Mangfoldet av vurderere og data spiller en avgjørende rolle i evaluering av modeller. Å unnlate å anerkjenne det brede spekteret av menneskelige perspektiver og tvetydigheten i innholdet kan hindre tilpasningen av maskinlæringsytelse til virkelige forventninger.

- 80 % av AI-sikkerhetsinnsatsen er allerede ganske bra, men de resterende 20 % krever en dobling av innsatsen for å adressere kantsaker og alle variantene i mangfoldets uendelige rom.

Koherensstatistikk, egengenerert erfaring og hvorfor unge mennesker er mye smartere enn nåværende AI

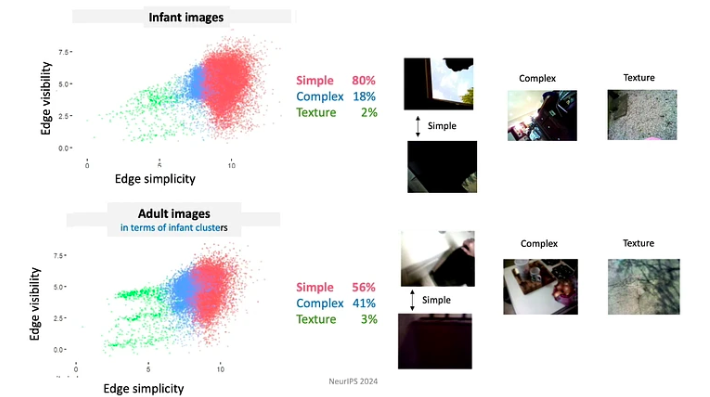

In snakken hennes, Linda Smith, en fremtredende professor ved Indiana University Bloomington, utforsket temaet sparsomhet med data i læringsprosessene til spedbarn og små barn. Hun fokuserte spesielt på gjenkjenning av objekter og navnelæring, og fordypet seg i hvordan statistikken over egengenererte opplevelser av spedbarn tilbyr potensielle løsninger på utfordringen med sparsomhet med data.

Viktige takeaways:

- I en alder av tre har barn utviklet evnen til å være one-shot-elever på forskjellige domener. På mindre enn 16,000 1,000 våkne timer frem til deres fjerde bursdag, klarer de å lære over XNUMX objektkategorier, mestre syntaksen til morsmålet og absorbere de kulturelle og sosiale nyansene i miljøet.

- Dr. Linda Smith og teamet hennes oppdaget tre prinsipper for menneskelig læring som lar barn fange så mye fra så sparsomme data:

- Elevene kontrollerer innspillet, fra øyeblikk til øyeblikk former og strukturerer de innspillene. For eksempel, i løpet av de første månedene av livet, har babyer en tendens til å se mer på gjenstander med enkle kanter.

- Siden babyer kontinuerlig utvikler seg i kunnskap og evner, følger de en svært begrenset læreplan. Dataene de blir eksponert for er organisert på svært viktige måter. For eksempel bruker babyer under 4 måneder mest tid på å se på ansikter, omtrent 15 minutter i timen, mens de eldre enn 12 måneder fokuserer primært på hender, og observerer dem i omtrent 20 minutter i timen.

- Læringsepisoder består av en serie sammenkoblede opplevelser. Romlige og tidsmessige korrelasjoner skaper sammenheng, som igjen letter dannelsen av varige minner fra engangshendelser. For eksempel, når barn får et tilfeldig utvalg av leker, fokuserer de ofte på noen få "favoritt" leker. De engasjerer seg med disse lekene ved hjelp av repeterende mønstre, noe som hjelper til med raskere læring av objektene.

- Forbigående (arbeids)minner vedvarer lenger enn sanseinndata. Egenskaper som forbedrer læringsprosessen inkluderer multimodalitet, assosiasjoner, prediktive relasjoner og aktivering av tidligere minner.

- For rask læring trenger du en allianse mellom mekanismene som genererer dataene og mekanismene som lærer.

Sketching: kjerneverktøy, læringsforsterkning og adaptiv robusthet

Jelani Nelson, professor i elektroteknikk og informatikk ved UC Berkeley, introduserte konseptet "dataskisser" – en minnekomprimert representasjon av et datasett som fortsatt gjør det mulig å svare på nyttige spørsmål. Selv om foredraget var ganske teknisk, ga det en utmerket oversikt over noen grunnleggende skisseverktøy, inkludert nyere fremskritt.

Viktige takeaways:

- CountSketch, kjerneskisseverktøyet, ble først introdusert i 2002 for å løse problemet med "heavy hitters", og rapporterte en liten liste over de mest hyppige elementene fra den gitte strømmen av varer. CountSketch var den første kjente sublineære algoritmen som ble brukt til dette formålet.

- To ikke-streamingapplikasjoner for tunge slagere inkluderer:

- Interiør punktbasert metode (IPM) som gir en asymptotisk raskeste kjente algoritme for lineær programmering.

- HyperAttention-metode som adresserer beregningsutfordringen som utgjøres av den økende kompleksiteten til lange kontekster som brukes i LLM-er.

- Mye nylig arbeid har vært fokusert på å designe skisser som er robuste for adaptiv interaksjon. Hovedideen er å bruke innsikt fra adaptiv dataanalyse.

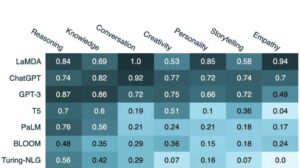

Utover skaleringspanel

Dette flott panel på store språkmodeller ble moderert av Alexander Rush, en førsteamanuensis ved Cornell Tech og en forsker ved Hugging Face. De andre deltakerne inkluderte:

- Aakanksha Chowdhery – Forsker ved Google DeepMind med forskningsinteresser innen systemer, LLM-foropplæring og multimodalitet. Hun var en del av teamet som utviklet PaLM, Gemini og Pathways.

- Angela Fan – Forsker ved Meta Generative AI med forskningsinteresser innen justering, datasentre og flerspråklighet. Hun deltok i utviklingen av Llama-2 og Meta AI Assistant.

- Percy Liang – Professor ved Stanford som forsker på skapere, åpen kildekode og generative agenter. Han er direktør for Center for Research on Foundation Models (CRFM) i Stanford og grunnleggeren av Together AI.

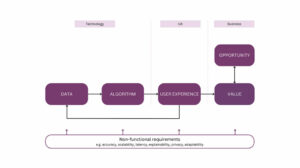

Diskusjonen fokuserte på fire nøkkelemner: (1) arkitektur og ingeniørkunst, (2) data og justering, (3) evaluering og åpenhet, og (4) skapere og bidragsytere.

Her er noen av takeawayene fra dette panelet:

- Å trene gjeldende språkmodeller er ikke iboende vanskelig. Hovedutfordringen med å trene en modell som Llama-2-7b ligger i infrastrukturkravene og behovet for å koordinere mellom flere GPUer, datasentre osv. Men hvis antallet parametere er lite nok til å tillate trening på en enkelt GPU, selv en bachelor kan klare det.

- Mens autoregressive modeller vanligvis brukes for tekstgenerering og diffusjonsmodeller for å generere bilder og videoer, har det vært eksperimenter med å snu disse tilnærmingene. Spesielt i Gemini-prosjektet brukes en autoregressiv modell for bildegenerering. Det har også vært undersøkelser for å bruke diffusjonsmodeller for tekstgenerering, men disse har ennå ikke vist seg å være tilstrekkelig effektive.

- Gitt den begrensede tilgjengeligheten av engelskspråklige data for treningsmodeller, utforsker forskere alternative tilnærminger. En mulighet er å trene multimodale modeller på en kombinasjon av tekst, video, bilder og lyd, med forventning om at ferdigheter lært fra disse alternative modalitetene kan overføres til tekst. Et annet alternativ er bruk av syntetiske data. Det er viktig å merke seg at syntetiske data ofte blander seg inn i ekte data, men denne integrasjonen er ikke tilfeldig. Tekst publisert på nettet gjennomgår vanligvis menneskelig kurasjon og redigering, noe som kan gi ekstra verdi for modellopplæring.

- Åpne fundamentmodeller blir ofte sett på som gunstige for innovasjon, men potensielt skadelige for AI-sikkerhet, ettersom de kan utnyttes av ondsinnede aktører. Dr. Percy Liang hevder imidlertid at åpne modeller også bidrar positivt til sikkerheten. Han argumenterer for at ved å være tilgjengelige gir de flere forskere muligheter til å utføre AI-sikkerhetsforskning og gjennomgå modellene for potensielle sårbarheter.

- I dag krever annoteringsdata betydelig mer ekspertise på annoteringsdomenet sammenlignet med for fem år siden. Men hvis AI-assistenter utfører som forventet i fremtiden, vil vi motta mer verdifull tilbakemeldingsdata fra brukere, noe som reduserer avhengigheten av omfattende data fra annotatorer.

Systemer for grunnmodeller og fundamentmodeller for systemer

In denne samtalen, Christopher Ré, en førsteamanuensis ved Institutt for informatikk ved Stanford University, viser hvordan grunnmodeller endret systemene vi bygger. Han utforsker også hvordan man effektivt bygger fundamentmodeller, låner innsikt fra databasesystemforskning, og diskuterer potensielt mer effektive arkitekturer for fundamentmodeller enn Transformer.

Her er de viktigste tipsene fra denne foredraget:

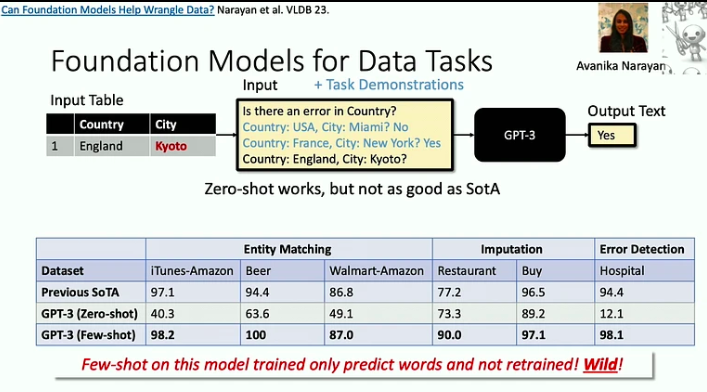

- Grunnmodeller er effektive for å løse problemer med «død med 1000 kutt», der hver enkelt oppgave kan være relativt enkel, men den store bredden og variasjonen av oppgaver utgjør en betydelig utfordring. Et godt eksempel på dette er datarenseproblemet, som LLM-er nå kan bidra til å løse mye mer effektivt.

- Etter hvert som akseleratorer blir raskere, dukker ofte minnet opp som en flaskehals. Dette er et problem som databaseforskere har tatt tak i i flere tiår, og vi kan ta i bruk noen av deres strategier. For eksempel minimerer Flash Attention-tilnærmingen input/output-flyter gjennom blokkering og aggressiv fusjon: hver gang vi får tilgang til en informasjon, utfører vi så mange operasjoner som mulig.

- Det er en ny klasse med arkitekturer, forankret i signalbehandling, som kan være mer effektiv enn Transformer-modellen, spesielt ved håndtering av lange sekvenser. Signalbehandling gir stabilitet og effektivitet, og legger grunnlaget for innovative modeller som S4.

Online forsterkende læring i digitale helseintervensjoner

In snakken hennes, Susan Murphy, professor i statistikk og informatikk ved Harvard University, delte de første løsningene på noen av utfordringene de står overfor i utviklingen av online RL-algoritmer for bruk i digitale helseintervensjoner.

Her er noen få ting fra presentasjonen:

- Dr. Susan Murphy diskuterte to prosjekter hun har jobbet med:

- HeartStep, der aktiviteter har blitt foreslått basert på data fra smarttelefoner og bærbare trackere, og

- Oralytics for oral helsecoaching, hvor intervensjoner var basert på engasjementdata mottatt fra en elektronisk tannbørste.

- Når forskerne utvikler en atferdspolicy for en AI-agent, må forskerne sikre at den er autonom og gjennomførbart kan implementeres i det bredere helsevesenet. Dette innebærer å sikre at tiden som kreves for en persons engasjement er rimelig, og at de anbefalte handlingene er både etisk forsvarlige og vitenskapelig plausible.

- De primære utfordringene med å utvikle en RL-agent for digitale helseintervensjoner inkluderer å håndtere høye støynivåer, ettersom folk lever livet sitt og kanskje ikke alltid er i stand til å svare på meldinger, selv om de ønsker det, i tillegg til å håndtere sterke, forsinkede negative effekter .

Som du kan se, har NeurIPS 2023 gitt et lysende innblikk i fremtiden til AI. De inviterte samtalene fremhevet en trend mot mer effektive, ressursbevisste modeller og utforskning av nye arkitekturer utover tradisjonelle paradigmer.

Liker du denne artikkelen? Registrer deg for flere AI-forskningsoppdateringer.

Vi gir beskjed når vi gir ut flere sammendragsartikler som denne.

I slekt

- SEO-drevet innhold og PR-distribusjon. Bli forsterket i dag.

- PlatoData.Network Vertical Generative Ai. Styrk deg selv. Tilgang her.

- PlatoAiStream. Web3 Intelligence. Kunnskap forsterket. Tilgang her.

- PlatoESG. Karbon, CleanTech, Energi, Miljø, Solenergi, Avfallshåndtering. Tilgang her.

- PlatoHelse. Bioteknologisk og klinisk etterretning. Tilgang her.

- kilde: https://www.topbots.com/neurips-2023-invited-talks/

- : har

- :er

- :ikke

- :hvor

- $OPP

- 000

- 1

- 10

- 10.

- 11

- 12

- 12 måneder

- 125

- 13

- 14

- 15%

- 154

- 16

- 16.

- 17

- 20

- 20 år

- 2023

- 32

- 35%

- 41

- 58

- 7

- 70

- 710

- 8

- 9

- a

- evne

- I stand

- Om oss

- akseleratorer

- adgang

- tilgjengelig

- prestasjoner

- oppnå

- anerkjenne

- tvers

- handlinger

- Aktivering

- aktivt

- Aktiviteter

- aktører

- adaptive

- legge til

- Ytterligere

- adresse

- adresser

- adressering

- adoptere

- fremskritt

- fordeler

- alder

- Agent

- agenter

- aggressiv

- AGI

- siden

- AI

- AI-assistent

- ai forskning

- AI-systemer

- hjelpemidler

- Alexander

- algoritme

- algoritmer

- innretting

- Alle

- Allianse

- tillate

- alene

- allerede

- også

- alternativ

- Selv

- alltid

- tvetydighet

- blant

- an

- analyse

- og

- En annen

- noen

- søknader

- tilnærming

- tilnærminger

- ca

- ER

- argumentert

- argumenterer

- Artikkel

- artikler

- kunstig

- kunstig generell intelligens

- AS

- vurdere

- Assistent

- assistenter

- Førsteamanuensis

- foreninger

- sortiment

- At

- oppnåelig

- oppmerksomhet

- lyd

- autonom

- tilgjengelighet

- basert

- BE

- fordi

- bli

- vært

- atferd

- være

- benchmark

- benchmarks

- gunstig

- Berkeley

- mellom

- Beyond

- Blend

- blander

- blokkering

- Låne

- både

- bredde

- bredere

- bygge

- men

- by

- kom

- CAN

- evner

- fangst

- saker

- kategorier

- sentrum

- Sentre

- kjede

- utfordre

- utfordringer

- endret

- chatbot

- Barn

- Christopher

- City

- klasse

- Rengjøring

- coaching

- samle

- kombinasjon

- kombinere

- sammenlignet

- komplekse

- kompleksitet

- sammensetning

- beregnings

- datamaskin

- informatikk

- Datamaskin syn

- databehandling

- konsept

- Gjennomføre

- Konferanse

- konstruere

- tidkrevende

- innhold

- kontekst

- sammenhenger

- kontinuerlig

- bidra

- bidragsytere

- kontroll

- kontrolleres

- samtaler

- koordinere

- Kjerne

- cornell

- korrigere

- korrelasjoner

- kunne

- skape

- skaperne

- mengde

- avgjørende

- kulturell

- konservering

- Gjeldende

- Curriculum

- skjærekant

- dato

- dataanalyse

- datasentre

- Database

- håndtering

- tiår

- Desember

- bestemme

- DeepMind

- Forsinket

- dybden

- Etterspørsel

- krav

- demografiske

- demonstrert

- Avdeling

- utforme

- detalj

- detaljer

- utvikle

- utviklet

- utviklere

- utvikle

- Utvikling

- utviklingen

- vanskelig

- kringkasting

- digitalt

- Digital helse

- retning

- Regissør

- oppdaget

- diskutert

- diskutere

- diskusjon

- diskusjoner

- Fornem

- Mangfold

- domene

- domener

- dominert

- ikke

- dobling

- dr

- to

- under

- dynamisk

- e

- hver enkelt

- Edge

- Effektiv

- effekter

- effektivitet

- effektiv

- effektivt

- innsats

- innsats

- enten

- elektronisk

- framgår

- vekt

- understreket

- muliggjøre

- muliggjør

- koding

- engasjere

- engasjement

- Ingeniørarbeid

- forbedre

- forbedret

- nok

- sikre

- sikrer

- Miljø

- lik

- spesielt

- avgjørende

- etc

- evaluere

- evaluering

- Selv

- hendelser

- alle

- utvikle seg

- utvikling

- eksempel

- eksempler

- utmerket

- forventning

- forventninger

- forventet

- dyrt

- erfaring

- Erfaringer

- eksperimenter

- Expert

- ekspertise

- eksperter

- Exploited

- leting

- utforsket

- utforsker

- Utforske

- utsatt

- omfattende

- øye

- Face

- ansikter

- forenkler

- sviktende

- vifte

- raskere

- raskeste

- tilbakemelding

- Noen få

- færre

- felt

- fyll

- Først

- fem

- Blitz

- flyten

- Flows

- Fokus

- fokuserte

- følge

- Til

- overskuelig

- formasjon

- Fundament

- Grunnleggeren

- fire

- Fjerde

- hyppig

- ofte

- fra

- fundamental

- fusjon

- framtid

- Gemini

- general

- generell intelligens

- generere

- genererer

- generasjonen

- generative

- Generativ AI

- gitt

- gir

- Glimpse

- Go

- mål

- god

- GPU

- GPU

- banebrytende

- Gruppe

- Gruppens

- Økende

- HAD

- Håndtering

- hender

- skadelig

- Utnyttelse

- harvard

- Harvard University

- Ha

- he

- hode

- Helse

- helsetjenester

- tung

- Held

- hjelpe

- hjulpet

- her

- Høy

- høy oppløsning

- Fremhevet

- svært

- hindre

- hans

- time

- TIMER

- Hvordan

- Hvordan

- Men

- http

- HTTPS

- menneskelig

- Mennesker

- i

- Tanken

- if

- Illuminerende

- bilde

- bilder

- implementert

- betydning

- viktig

- forbedre

- in

- dyptgående

- inkludere

- inkludert

- Inkludert

- økende

- stadig

- individuelt

- uunngåelig

- Infinite

- informasjon

- informative

- Infrastruktur

- iboende

- iboende

- Innovasjon

- innovative

- inngang

- innsikt

- f.eks

- i stedet

- integrering

- Intelligens

- interaksjon

- sammenhengende

- interesser

- intervensjoner

- inn

- introdusert

- invitert

- IT

- varer

- jpg

- dommer

- nøkkel

- Vet

- kunnskap

- kjent

- lab

- merking

- landskap

- Språk

- stor

- varig

- siste

- legging

- føre

- ledende

- LÆRE

- lært

- elever

- læring

- lærer

- Legacy

- mindre

- Lessons

- la

- nivåer

- ligger

- lett

- i likhet med

- sannsynligheten

- begrensning

- Begrenset

- linda

- Liste

- Bor

- LLM

- lokal

- Lang

- lenger

- Se

- ser

- maskin

- maskinlæring

- mailing

- Hoved

- administrer

- administrerende

- mange

- Master

- matchende

- materiale

- Saker

- max bredde

- Kan..

- meningsfylt

- mekanismer

- Minner

- Minne

- bare

- meldinger

- Meta

- metode

- Metrics

- kunne

- millioner

- minimerer

- minutter

- mangler

- modell

- modeller

- øyeblikk

- måneder

- mer

- mer effektivt

- mest

- flyttet

- mye

- flere

- må

- navn

- innfødt

- Naturlig

- Trenger

- negativ

- Ny

- New Orleans

- Nei.

- Bråk

- none

- note

- roman

- nå

- skyggelegging

- Antall

- objekt

- gjenstander

- of

- tilby

- tilby

- Tilbud

- ofte

- eldre

- on

- ONE

- på nett

- bare

- åpen

- åpen kildekode

- åpnet

- Drift

- Muligheter

- Optimalisere

- Alternativ

- or

- Munnhelse

- Organisert

- orleans

- Annen

- Andre deltakere

- andre

- vår

- enn

- oversikt

- egen

- palm

- panel

- paradigmer

- parametere

- del

- deltakere

- deltok

- Spesielt

- spesielt

- deler

- Past

- pathways

- mønstre

- Ansatte

- for

- persepsjon

- Utfør

- ytelse

- prospektet

- brikke

- plato

- Platon Data Intelligence

- PlatonData

- plausibel

- spiller

- politikk

- poserte

- positiv

- positivt

- besitter

- mulighet

- mulig

- potensiell

- potensielt

- forutsi

- presentere

- presentasjon

- presentert

- forrige

- primært

- primære

- prinsipper

- Problem

- problemer

- prosedyren

- prosess

- Prosesser

- prosessering

- produsert

- produktiv

- Professor

- dypt

- Programmering

- prosjekt

- prosjekter

- fremtredende

- egenskaper

- utprøvd

- gi

- forutsatt

- publisert

- formål

- forfølgelse

- kvalitet

- spørsmål

- søken

- ganske

- Race

- tilfeldig

- område

- rask

- raskt

- heller

- rangeringer

- ekte

- virkelige verden

- rimelig

- motta

- mottatt

- nylig

- anerkjennelse

- anbefales

- redusere

- refleksjon

- relasjoner

- relativt

- slipp

- pålitelighet

- avhengighet

- gjenværende

- repeterende

- Rapportering

- representasjon

- representerer

- krever

- påkrevd

- Krav

- forskning

- forsker

- forskere

- løse

- Ressurser

- Svare

- respondentene

- svar

- svar

- ansvarlig

- anmeldelse

- robust

- Rolle

- forankret

- omtrent

- jag

- trygge

- Sikkerhet

- skalering

- scenarier

- scene

- Vitenskap

- VITENSKAPER

- Forsker

- se

- søker

- synes

- sett

- semantikk

- Serien

- forme

- delt

- hun

- Viser

- undertegne

- Signal

- signaler

- signifikant

- betydelig

- Enkelt

- enkelt

- ferdigheter

- liten

- smartere

- smartphones

- So

- selskap

- løsning

- Solutions

- LØSE

- noen

- Lyd

- kilde

- Rom

- romlig

- spesielt

- bruke

- Stabilitet

- stabil

- stanford

- Stanford University

- statistikk

- Still

- strategier

- stream

- styrker

- sterk

- strukturering

- slik

- foreslår

- SAMMENDRAG

- levere

- overraskelse

- Susan

- syntaks

- syntese

- syntetisk

- syntetiske data

- system

- Systemer

- Takeaways

- tar

- Snakk

- Snakker

- Oppgave

- oppgaver

- lag

- tech

- Teknisk

- tendens

- vilkår

- tekst

- enn

- Det

- De

- Fremtiden

- deres

- Dem

- temaer

- Der.

- Disse

- de

- denne

- De

- tre

- Gjennom

- tid

- til

- sammen

- verktøy

- verktøy

- TOPPBOTS

- Tema

- temaer

- Totalt

- mot

- Trackers

- tradisjonelle

- Kurs

- overføre

- transformator

- Åpenhet

- behandling

- Trend

- Sannhet

- prøver

- SVING

- to

- typisk

- etter

- undergår

- forståelse

- universitet

- oppdateringer

- bruke

- brukt

- Brukere

- ved hjelp av

- vanligvis

- benyttes

- Verdifull

- verdi

- variasjon

- ulike

- levende

- video

- videoer

- synspunkter

- syn

- Sikkerhetsproblemer

- W3

- var

- måter

- we

- bærbar

- VI VIL

- var

- Hva

- når

- når som helst

- mens

- om

- hvilken

- mens

- HVEM

- hvorfor

- bred

- Bred rekkevidde

- vil

- vindu

- ønske

- med

- Arbeid

- arbeid

- Feil

- år

- ennå

- Du

- Young

- zephyrnet