To trygt distribuere kraftig, generell kunstig intelligens i fremtiden, må vi sikre at maskinlæringsmodeller handler i samsvar med menneskelige intensjoner. Denne utfordringen har blitt kjent som justeringsproblem.

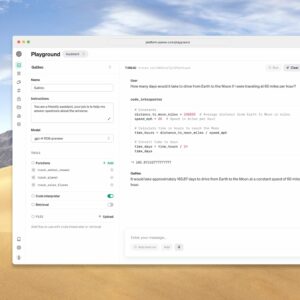

En skalerbar løsning på innrettingsproblemet må fungere på oppgaver der modellutdata er vanskelige eller tidkrevende for mennesker å evaluere. For å teste skalerbare innrettingsteknikker trente vi en modell for å oppsummere hele bøker, som vist i følgende eksempler.[1] Modellen vår fungerer ved først å oppsummere små deler av en bok, deretter oppsummere disse sammendragene til et sammendrag på høyere nivå, og så videre.

Vår beste modell er finjustert fra GPT-3 og genererer fornuftige sammendrag av hele bøker, noen ganger til og med som samsvarer med gjennomsnittskvaliteten på menneskeskrevne sammendrag: den oppnår en vurdering på 6/7 (ligner på gjennomsnittlig menneskeskrevne sammendrag) fra mennesker som har lest boken 5 % av tiden og en 5/7 vurdering 15 % av gangene. Vår modell oppnår også toppmoderne resultater på BookSum datasett for boklengde oppsummering. En svarmodell med null skudd kan bruke modellens sammendrag for å oppnå konkurransedyktige resultater på NarrativeQA datasett for svar på spørsmål i boklengde.[2]

Vår tilnærming: Å kombinere forsterkende læring fra menneskelig tilbakemelding og rekursiv oppgavedekomponering

Vurder oppgaven med å oppsummere et tekststykke. Stor forhåndstrente modeller er ikke så gode til å oppsummere. Tidligere fant vi at trening en modell med forsterkende læring fra menneskelig tilbakemelding bidro til å tilpasse modellsammendrag med menneskelige preferanser på korte innlegg og artikler. Men å bedømme sammendrag av hele bøker krever mye krefter å gjøre direkte siden et menneske trenger å lese hele boken, noe som tar mange timer.

For å løse dette problemet bruker vi i tillegg rekursiv oppgavenedbrytning: vi prosedyremessig deler opp en vanskelig oppgave i enklere. I dette tilfellet deler vi opp å oppsummere et langt tekststykke til å oppsummere flere kortere stykker. Sammenlignet med en ende-til-ende-opplæringsprosedyre, har rekursiv oppgavedekomponering følgende fordeler:

- Dekomponering gjør at mennesker kan evaluere modellsammendrag raskere ved å bruke sammendrag av mindre deler av boken i stedet for å lese kildeteksten.

- Det er lettere å spore prosessen med å skrive sammendrag. For eksempel kan du spore for å finne hvor i den originale teksten enkelte hendelser fra sammendraget skjer. Se selv på vår oppsummeringsutforsker!

- Metoden vår kan brukes til å oppsummere bøker med ubegrenset lengde, ubegrenset av kontekstlengden til transformatormodellene vi bruker.

Hvorfor vi jobber med dette

Thans arbeidet er en del av vårt pågående forskning til å samkjøre avanserte AI-systemer, som er nøkkelen til vårt oppdrag. Ettersom vi trener modellene våre til å utføre stadig mer komplekse oppgaver, vil det bli stadig vanskeligere for mennesker å gjøre informerte evalueringer av modellenes resultater. Dette gjør det vanskeligere å oppdage subtile problemer i modellutdata som kan føre til negative konsekvenser når disse modellene distribueres. Derfor ønsker vi at vår evne til å evaluere modellene våre skal øke etter hvert som deres evner øker.

Vår nåværende tilnærming til dette problemet er å gi mennesker mulighet til å evaluere utdata fra maskinlæringsmodeller ved å bruke assistanse fra andre modeller. I dette tilfellet, for å evaluere boksammendrag, styrker vi mennesker med individuelle kapittelsammendrag skrevet av modellen vår, noe som sparer dem tid når de evaluerer disse sammendragene i forhold til å lese kildeteksten. Vår fremgang med bokoppsummering er det første storstilte empiriske arbeidet med skaleringsjusteringsteknikker.

Fremover forsker vi på bedre måter å hjelpe mennesker med å evaluere modellatferd, med målet om å finne teknikker som skaleres for å tilpasse kunstig generell intelligens.

Vi er alltid på utkikk etter flere dyktige folk til å bli med oss; så hvis dette arbeidet interesserer deg, vær så snill søke om å bli med i teamet vårt!

- 10

- 11

- 28

- 67

- 7

- 77

- 84

- 9

- Om oss

- Handling

- adresse

- avansert

- fordeler

- AI

- tilnærming

- artikler

- kunstig

- kunstig intelligens

- gjennomsnittlig

- bli

- være

- BEST

- bøker

- evner

- utfordre

- Kapittel

- sammenlignet

- komplekse

- kontroll

- Kjerne

- kunne

- Gjeldende

- dato

- utplassere

- effekt

- bemyndige

- hendelser

- eksempel

- tilbakemelding

- Først

- etter

- Forward

- funnet

- framtid

- general

- mål

- god

- HTTPS

- menneskelig

- Mennesker

- Øke

- individuelt

- Intelligens

- interesser

- IT

- bli medlem

- nøkkel

- kjent

- stor

- føre

- læring

- Lang

- ser

- maskin

- maskinlæring

- GJØR AT

- Making

- matchende

- medium

- Oppdrag

- modell

- modeller

- mer

- Annen

- Papir

- Ansatte

- brikke

- innlegg

- kraftig

- Problem

- problemer

- prosess

- formål

- kvalitet

- spørsmål

- raskt

- vurdering

- RE

- Lesning

- slipp

- forskning

- Resultater

- skalerbar

- Skala

- skalering

- valgt

- Kort

- lignende

- liten

- So

- løsning

- state-of-the-art

- Systemer

- talentfull

- oppgaver

- teknikker

- test

- Kilden

- tid

- tidkrevende

- Kurs

- us

- bruke

- W3

- HVEM

- vinduer

- Arbeid

- arbeid

- virker