Mężczyzna siedział nieruchomo na krześle, wpatrując się uważnie w kawałek ciasta na stole przed nim. Przewody wystawały z implantów elektrod w jego mózgu. Po bokach znajdowały się dwa gigantyczne ramiona robota, każde większe niż cała górna część jego ciała. Jeden trzymał nóż, drugi widelec.

„Tnij i jedz jedzenie. Przesuń prawą rękę do przodu, aby zacząć — rozkazał robotyczny głos.

Mężczyzna skoncentrował się na przesunięciu do przodu częściowo sparaliżowanej prawej ręki. Jego nadgarstek ledwie drgnął, ale prawa ręka robota płynnie poszybowała do przodu, umieszczając czubek widelca w pobliżu ciasta. Kolejny lekki ruch lewej ręki wysłał nóż do przodu.

Kilka rozkazów później mężczyzna z radością otworzył usta i pochłonął smakołyk wielkości kęsa, przycięty według osobistych preferencji z pomocą jego awatarów-robotów. Minęło około 30 lat, odkąd mógł się wyżywić.

Większość z nas nie zastanawia się dwa razy nad używaniem obu rąk jednocześnie – jedzeniem nożem i widelcem, otwieraniem butelki, przytulaniem ukochanej osoby, wylegiwaniem się na kanapie i obsługą kontrolera do gier wideo. Koordynacja przychodzi naturalnie do naszych mózgów.

Jednak rekonstrukcja tego bezwysiłkowego ruchu między dwiema kończynami przeszkodziła interfejs mózg-maszyna (BMI) eksperci od lat. Główną przeszkodą jest sam poziom złożoności: według jednego oszacowania, używanie kończyn robota do codziennych zadań życiowych może wymagać 34 stopni swobody, co stanowi wyzwanie nawet dla najbardziej wyrafinowanych konfiguracji BMI.

Nowe badania, prowadzony przez dr Francesco V. Tenore z Johns Hopkins University, znalazł genialne obejście. Roboty stają się coraz bardziej autonomiczne dzięki uczeniu maszynowemu. Zamiast traktować kończyny robota jako zwykłą maszynerię, dlaczego nie wykorzystać ich wyrafinowanego programowania, aby człowiek i robot mogli dzielić się kontrolą?

„To podejście do wspólnej kontroli ma na celu wykorzystanie wewnętrznych możliwości interfejsu mózg-maszyna i systemu robotycznego, tworząc środowisko „najlepsze z obu światów”, w którym użytkownik może spersonalizować zachowanie inteligentnej protezy” powiedziany Dr Francesco Tenore.

Podobnie jak zautomatyzowany system lotu, ta współpraca pozwala człowiekowi „pilotować” robota, skupiając się tylko na rzeczach, które mają największe znaczenie — w tym przypadku na tym, jak duże jest ucięcie każdego kawałka ciasta — pozostawiając bardziej przyziemne operacje na wpół- autonomiczny robot.

Zespół ma nadzieję, że te „systemy neurorobotyczne” – prawdziwe połączenie między sygnałami neuronowymi mózgu a inteligentnymi algorytmami robota – mogą „poprawić niezależność i funkcjonalność użytkownika”.

Double Trouble

Mózg wysyła sygnały elektryczne do naszych mięśni, aby kontrolować ruch i dostosowuje te instrukcje na podstawie otrzymywanych informacji zwrotnych – na przykład kodujących nacisk lub pozycję kończyny w przestrzeni. Urazy rdzenia kręgowego lub inne choroby, które uszkadzają tę autostradę sygnalizacyjną, odcinają kontrolę mózgu nad mięśniami, prowadząc do paraliżu.

BMI zasadniczo budują most przez uszkodzony układ nerwowy, umożliwiając przepływ poleceń nerwowych – niezależnie od tego, czy chodzi o operowanie zdrowymi kończynami, czy założoną protezę. Od przywracania pisma ręcznego i mowy po postrzeganie stymulacji i kontrolowanie robotycznych kończyn, wskaźniki BMI utorowały drogę do przywrócenia ludziom życia.

Jednak technologię nęka niepokojąca czkawka: podwójna kontrola. Jak dotąd sukces w BMI ograniczał się w dużej mierze do poruszania jedną kończyną – ciałem lub w inny sposób. Jednak w życiu codziennym potrzebujemy obu rąk do najprostszych zadań – przeoczonej supermocy, którą naukowcy nazywają „ruchami dwuręcznymi”.

W 2013 roku zaprezentował pionier BMI, dr Miguel Nicolelis z Duke University pierwszy dowód że dwuręczna kontrola z BMI nie jest niemożliwa. U dwóch małp, którym wszczepiono mikromacierze elektrod, sygnały neuronowe z około 500 neuronów były wystarczające, aby pomóc małpom kontrolować dwa wirtualne ramiona, używając tylko swoich umysłów do rozwiązania skomputeryzowanego zadania w celu uzyskania (dosłownie) soczystej nagrody. Choć był to obiecujący pierwszy krok, ówcześni eksperci zastanawiałem się czy konfiguracja może pracować z bardziej złożonymi czynnościami ludzkimi.

Pomocna dłoń

W nowym badaniu przyjęto inne podejście: wspólna wspólna kontrola. Pomysł jest prosty. Jeśli używanie sygnałów neuronowych do sterowania obydwoma ramionami robota jest zbyt skomplikowane dla samych implantów mózgowych, dlaczego nie pozwolić inteligentnej robotyce na odciążenie przetwarzania?

W praktyce roboty są najpierw wstępnie zaprogramowane na kilka prostych ruchów, pozostawiając człowiekowi miejsce na kontrolowanie specyfiki w oparciu o jego preferencje. To jak jazda robota i człowieka na rowerze tandemowym: maszyna pedałuje z różną prędkością w oparciu o instrukcje algorytmiczne, podczas gdy mężczyzna kontroluje kierownicę i hamulce.

Aby skonfigurować system, zespół najpierw wytrenował algorytm dekodowania umysłu ochotnika. 49-letni mężczyzna doznał urazu rdzenia kręgowego około 30 lat przed badaniem. Nadal miał minimalny ruch w ramieniu i łokciu i mógł wyprostować nadgarstki. Jednak jego mózg już dawno stracił kontrolę nad palcami, pozbawiając go jakiejkolwiek kontroli motorycznej.

Zespół najpierw wszczepił sześć mikromacierzy elektrod w różne części jego kory. Po lewej stronie jego mózgu – która kontroluje jego stronę dominującą, po prawej stronie – umieścili dwie matryce odpowiednio w obszarach motorycznym i czuciowym. Odpowiednie prawe obszary mózgu — kontrolujące jego niedominującą rękę — otrzymały po jednej macierzy.

Następnie zespół poinstruował mężczyznę, aby wykonał serię ruchów ręką najlepiej, jak potrafił. Każdy gest – zginanie lewego lub prawego nadgarstka, otwieranie lub szczypanie ręki – był przypisany do kierunku ruchu. Na przykład zgięcie prawego nadgarstka podczas wyprostowania lewego (i odwrotnie) odpowiadało ruchowi w kierunkach poziomych; obie ręce otwierają lub ściskają kody w celu uzyskania ruchu pionowego.

Przez cały czas zespół zbierał sygnały neuronowe kodujące każdy ruch ręki. Dane zostały wykorzystane do wytrenowania algorytmu dekodowania zamierzonego gestu i zasilania zewnętrznej pary robotycznych ramion scifi, z około 85-procentowym sukcesem.

Niech Je Ciasto

Ramiona robota również zostały przeszkolone. Korzystając z symulacji, zespół najpierw dał ramionom wyobrażenie o tym, gdzie ciasto będzie na talerzu, gdzie talerz zostanie ustawiony na stole i w przybliżeniu, jak daleko ciasto będzie od ust uczestnika. Dopracowali także prędkość i zakres ruchu ramion robota — w końcu nikt nie chce widzieć gigantycznego ramienia robota, trzymającego się spiczastym widelcem, lecącego w twoją twarz ze zwisającym, zniekształconym kawałkiem ciasta.

W tej konfiguracji uczestnik mógł częściowo kontrolować pozycję i orientację ramion, z maksymalnie dwoma stopniami swobody po każdej stronie — na przykład, pozwalając mu na poruszanie dowolnym ramieniem lewo-prawo, przód-tył lub obracanie lewo-prawo . Robot tymczasem zajął się resztą zawiłości ruchu.

Aby jeszcze bardziej wspomóc współpracę, głos robota wywoływał każdy krok, aby pomóc zespołowi wyciąć kawałek ciasta i przynieść go do ust uczestnika.

Mężczyzna wykonał pierwszy ruch. Koncentrując się na ruchu prawego nadgarstka, ustawił prawą rękę robota w kierunku ciasta. Robot następnie przejął kontrolę, automatycznie przesuwając czubek widelca do ciasta. Mężczyzna mógł wtedy zdecydować o dokładnym ustawieniu widelca, korzystając z przeszkolonych sterowników neuronowych.

Po ustawieniu robot automatycznie przesunął rękę dzierżącą nóż w lewo od widelca. Mężczyzna ponownie wykonał poprawki, aby przyciąć ciasto do pożądanego rozmiaru, zanim robot automatycznie pokroił ciasto i podniósł je do ust.

„Spożywanie ciasta było opcjonalne, ale uczestnik zdecydował się to zrobić, ponieważ było pyszne” – powiedzieli autorzy.

Badanie obejmowało 37 prób, z których większość stanowiła kalibracja. Ogólnie rzecz biorąc, mężczyzna wykorzystał swój umysł do zjedzenia siedmiu kawałków ciastek, wszystkich „rozsądnych rozmiarów” i bez upuszczenia żadnego.

Z pewnością nie jest to system, który wkrótce pojawi się w Twoim domu. Oparta na gigantycznej parze ramion robotycznych opracowanych przez DARPA, konfiguracja wymaga obszernej, wstępnie zaprogramowanej wiedzy robota, co oznacza, że w danym momencie może on wykonywać tylko jedno zadanie. Na razie badanie jest bardziej eksploracyjnym dowodem słuszności koncepcji, w jaki sposób łączyć sygnały neuronowe z autonomią robota w celu dalszego rozszerzania możliwości BMI.

Ale jako protetyka coraz mądrzejszy i bardziej przystępny cenowo, zespół patrzy w przyszłość.

„Ostatecznym celem jest regulowana autonomia, która wykorzystuje wszelkie dostępne sygnały BMI

ich maksymalna skuteczność, umożliwiająca człowiekowi kontrolowanie kilku stopni swobody (DOF), które najbardziej bezpośrednio wpływają na jakościowe wykonanie zadania, podczas gdy robot zajmuje się resztą” – powiedział zespół. Przyszłe badania będą badać – i przesuwać – granice tych połączeń umysłowych człowieka i robota.

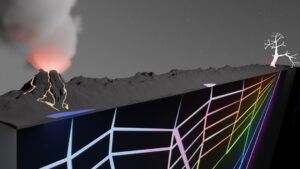

Kredytowych Image: Laboratorium Fizyki Stosowanej Johnsa Hopkinsa

- Coinsmart. Najlepsza w Europie giełda bitcoinów i kryptowalut.

- Platoblockchain. Web3 Inteligencja Metaverse. Wzmocniona wiedza. DARMOWY DOSTĘP.

- CryptoJastrząb. Radar Altcoin. Bezpłatna wersja próbna.

- Źródło: https://singularityhub.com/2022/07/05/a-paralyzed-man-used-his-mind-to-control-two-robotic-arms-to-eat-cake/

- "

- 2022

- a

- zdolność

- O nas

- w poprzek

- zajęcia

- przystępne

- przed

- algorytm

- algorytmiczny

- Wszystkie kategorie

- Pozwalać

- pozwala

- Inne

- stosowany

- podejście

- w przybliżeniu

- ARM

- Autorzy

- zautomatyzowane

- automatycznie

- autonomiczny

- dostępny

- awatary

- paski

- zanim

- jest

- BEST

- pomiędzy

- ciało

- Mózg

- BRIDGE

- błyskotliwy

- przynieść

- budować

- wezwanie

- możliwości

- który

- walizka

- wyzwanie

- współpraca

- przyjście

- kompleks

- złożoności

- pojęcie

- kontrola

- kontroler

- kontroli

- koordynacja

- Odpowiedni

- mógłby

- Tworzenie

- kredyt

- dane

- różne

- bezpośrednio

- choroby

- dominujący

- Podwójna

- Książę

- każdy

- jeść

- skuteczność

- umożliwiając

- Środowisko

- istotnie

- oszacowanie

- codzienny

- przykład

- Rozszerzać

- eksperci

- rozciągać się

- rozległy

- Twarz

- informacja zwrotna

- w porządku

- i terminów, a

- lot

- pływ

- skupienie

- jedzenie

- widelec

- Naprzód

- znaleziono

- Wolność

- od

- z przodu

- Funkcjonalność

- dalej

- przyszłość

- gra

- gest

- cel

- uchwyt

- pomoc

- Strona główna

- nadzieję

- Poziomy

- W jaki sposób

- How To

- Jednak

- HTTPS

- człowiek

- pomysł

- Rezultat

- niemożliwy

- coraz bardziej

- Interfejs

- IT

- Johns Hopkins University

- wiedza

- duży

- większe

- prowadzący

- nauka

- Doprowadziło

- poziom

- Dźwignia

- wykorzystuje

- Ograniczony

- życie

- załadować

- długo

- poszukuje

- maszyna

- uczenie maszynowe

- maszyny

- zrobiony

- Większość

- mężczyzna

- Materia

- znaczy

- nic

- umysły

- jeszcze

- większość

- ruch

- ruch

- przeniesienie

- Blisko

- Następny

- koncepcja

- otwarcie

- działać

- operacyjny

- operacje

- Inne

- Inaczej

- ogólny

- procent

- jest gwarancją najlepszej jakości, które mogą dostarczyć Ci Twoje monitory,

- osobisty

- personalizować

- Fizyka

- kawałek

- pionier

- nękany

- position

- ustawione

- power

- nacisk

- przetwarzanie

- Programowanie

- obiecujący

- dowód

- dowód koncepcji

- zasięg

- Odebrane

- wymagać

- Wymaga

- REST

- robot

- robotyka

- Rolka

- Powiedział

- nauka

- Naukowcy

- Serie

- zestaw

- ustawienie

- kilka

- Share

- shared

- Prosty

- ponieważ

- pojedynczy

- SIX

- Rozmiar

- mądry

- So

- ROZWIĄZANIA

- kilka

- wyrafinowany

- Typ przestrzeni

- prędkość

- prędkości

- początek

- Nadal

- badania naukowe

- Badanie

- sukces

- system

- Stuknij

- zadania

- zespół

- tech

- REGULAMIN

- Testowanie

- Połączenia

- rzeczy

- czas

- typ

- w kierunku

- Pociąg

- leczyć

- leczenia

- ostateczny

- uniwersytet

- us

- różnorodny

- Wideo

- Wirtualny

- Głos

- czy

- Podczas

- bez

- Praca

- by

- lat

- Twój