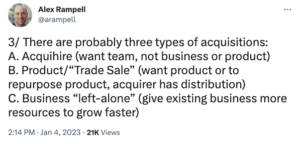

To jest edytowana wersja posta, który pierwotnie został uruchomiony tutaj.

Neuronauka i sztuczna inteligencja mają długą, splecioną historię. Pionierzy sztucznej inteligencji postrzegali zasady organizacji mózgu jako inspirację do tworzenia inteligentnych maszyn. W zaskakującym odwróceniu sztuczna inteligencja pomaga nam teraz zrozumieć źródło inspiracji: ludzki mózg. To podejście polegające na wykorzystaniu sztucznej inteligencji do budowania modeli mózgu jest określane jako neuroAI. W ciągu najbliższej dekady będziemy coraz bardziej precyzyjni w silico modele mózgu, zwłaszcza modele naszych dwóch najwybitniejszych zmysłów, wzroku i słuchu. Dzięki temu będziemy mogli na żądanie pobierać i wykorzystywać modele sensoryczne z taką samą wygodą, z jaką możemy wykonywać rozpoznawanie obiektów lub przetwarzanie języka naturalnego.

Wielu neurologów i badaczy sztucznej inteligencji jest – co zrozumiałe! – bardzo podekscytowany tym: mózgi na żądanie! Odkrywanie, co to znaczy widzieć, czuć, być człowiekiem! Mniej znany jest fakt, że istnieją szerokie praktyczne zastosowania w przemyśle. Od dawna jestem badaczem w tej dziedzinie, od czasu mojego doktoratu pracowałem nad tym, jak mózg przekształca widzenie w znaczenie. Widziałem postęp w tej dziedzinie od samego początku i myślę, że teraz jest czas, aby zbadać, w jaki sposób neuroAI może napędzać większą kreatywność i poprawiać nasze zdrowie.

Przewiduję, że neuroAI najpierw znajdzie szerokie zastosowanie w sztuce i reklamie, zwłaszcza w połączeniu z nowymi generatywnymi modelami AI, takimi jak GPT-3 i DALL-E. Chociaż obecne generatywne modele AI mogą tworzyć twórczą sztukę i media, nie mogą powiedzieć, czy te media ostatecznie przekażą wiadomość zamierzonym odbiorcom – ale neuroAI może. Na przykład możemy zastąpić metodę prób i błędów grup fokusowych i testów A/B i bezpośrednio stworzyć media, które komunikują dokładnie to, czego chcemy. Ogromna presja rynkowa wokół tej aplikacji stworzy pozytywny cykl, który ulepszy modele neuroAI.

Powstałe ulepszone modele umożliwią zastosowanie w medycynie w medycynie, od pomocy osobom z problemami neurologicznymi po poprawę zdolności studni. Wyobraź sobie tworzenie odpowiednich obrazów i dźwięków, które pomogą osobie szybciej odzyskać wzrok lub słuch po zabiegu LASIK lub po wszczepieniu implantu ślimakowego.

Te innowacje będą znacznie silniejsze dzięki innym technologiom, które pojawią się w rurze: rzeczywistości rozszerzonej i interfejsom mózg-komputer. Jednak, aby w pełni wykorzystać potencjalną użyteczność systemów sensorycznych do pobrania na żądanie, musimy wypełnić obecne luki w narzędziach, talentach i finansowaniu.

W tym artykule wyjaśnię, czym jest neuroAI, jak może zacząć ewoluować i wpływać na nasze życie, w jaki sposób uzupełnia inne innowacje i technologie oraz co jest potrzebne, aby popchnąć ją do przodu.

Co to jest neuroAI?

NeuroAI to rozwijająca się dyscyplina, której celem jest 1) badanie mózgu, aby nauczyć się budować lepszą sztuczną inteligencję oraz 2) wykorzystanie sztucznej inteligencji do lepszego zrozumienia mózgu. Jednym z podstawowych narzędzi neuroAI jest wykorzystanie sztucznych sieci neuronowych do tworzenia komputerowych modeli określonych funkcji mózgu. Podejście to zostało zapoczątkowane w 2014 roku, kiedy naukowcy z MIT i Columbia wykazali, że głębokie sztuczne sieci neuronowe mogą wyjaśniać reakcje w części mózgu, która rozpoznaje obiekty: w korze dolno-skroniowej (IT). Wprowadzili podstawowy przepis na porównanie sztucznej sieci neuronowej z mózgiem. Korzystając z tego przepisu i powtarzając iteracyjne testy procesów mózgowych – rozpoznawanie kształtu, przetwarzanie ruchu, przetwarzanie mowy, kontrola ramienia, pamięć przestrzenna – naukowcy budują mozaikę modeli komputerowych mózgu.

Przepis na porównanie mózgów do maszyn

Jak więc zbudować model NeuroAI? Od momentu powstania w 2014 r. pole stosuje tę samą podstawową recepturę:

1. Trenować sztuczne sieci neuronowe in silico w celu rozwiązania zadania, na przykład rozpoznawania obiektów. Powstała sieć nazywana jest zoptymalizowaną pod kątem zadań. Co ważne, zwykle obejmuje to szkolenie tylko na obrazach, filmach i dźwiękach, a nie na danych mózgowych.

2. Porównaj pośrednie aktywacje wytrenowanych sztucznych sieci neuronowych z nagraniami z prawdziwego mózgu. Porównanie odbywa się za pomocą technik statystycznych, takich jak regresja liniowa lub reprezentacyjna analiza podobieństwa.

3. Wybierz najlepiej działający model jako obecnie najlepszy model tych obszarów mózgu.

Ten przepis można zastosować z danymi zebranymi wewnątrz mózgu z pojedynczych neuronów lub z nieinwazyjnych technik, takich jak magnetoencefalografia (MEG) lub funkcjonalne obrazowanie rezonansem magnetycznym (fMRI).

Model neuroAI części mózgu ma dwie kluczowe cechy. Jest to obliczalne: możemy podać temu modelowi komputerowemu bodziec, który powie nam, jak zareaguje obszar mózgu. Jest to również rozróżnialne: jest to głęboka sieć neuronowa, którą możemy optymalizować w taki sam sposób, jak optymalizujemy modele, które rozwiązują rozpoznawanie wizualne i przetwarzanie języka naturalnego. Oznacza to, że neuronaukowcy uzyskują dostęp do wszystkich potężnych narzędzi, które napędzają rewolucję głębokiego uczenia się, w tym systemów algebry tensorów, takich jak PyTorch i TensorFlow.

Co to znaczy? Przeszliśmy od niezrozumienia dużych fragmentów mózgu do możliwości pobrania dobrych modeli w mniej niż dekadę. Dzięki odpowiednim inwestycjom wkrótce będziemy mieli doskonałe modele dużych kawałków mózgu. System wizualny był pierwszym modelem; układ słuchowy nie był daleko w tyle; a inne obszary z pewnością upadną jak domino, gdy nieustraszeni neuronaukowcy pospieszą, by rozwiązać tajemnice mózgu. Oprócz zaspokojenia naszej intelektualnej ciekawości – wielki motywator dla naukowców! – ta innowacja pozwoli każdemu programiście pobrać dobre modele mózgu i odblokować niezliczone aplikacje.

Obszary zastosowań

Sztuka i reklama

Zacznijmy od tego prostego założenia: 99% mediów, których doświadczamy, to nasze oczy i uszy. Istnieją całe branże, które można sprowadzić do dostarczania odpowiednich pikseli i tonów do tych zmysłów: sztuki wizualne, projektowanie, filmy, gry, muzyka i reklama to tylko kilka z nich. To nie nasze oczy i uszy same w sobie interpretują te doświadczenia, ponieważ są one jedynie czujnikami: to nasze mózgi nadają sens tej informacji. Media są tworzone po to, by informować, bawić, wywoływać pożądane emocje. Ale ustalenie, czy wiadomość na obrazie, profesjonalnym zdjęciu w głowę lub reklamie jest odbierana zgodnie z przeznaczeniem, jest frustrującym ćwiczeniem opartym na próbach i błędach: ludzie muszą być w pętli, aby ustalić, czy wiadomość trafi, co jest kosztowne i czasochłonne. trawiący.

Wielkoskalowe usługi online znalazły sposoby na obejście tego problemu, automatyzując próby i błędy: testy A/B. Google słynie przetestowano, który z 50 odcieni niebieskiego należy zastosować dla linków na stronie wyników wyszukiwania. Według The Guardian najlepszy wybór spowodował wzrost przychodów w stosunku do poziomu bazowego 200 mln USD w 2009 r., czyli mniej więcej 1% ówczesnych przychodów Google. Netflix dostosowuje miniatury do widza, aby zoptymalizować jego wrażenia użytkownika. Metody te są dostępne dla internetowych gigantów o ogromnym ruchu, które mogą przezwyciężyć hałas związany z zachowaniem ludzi.

Co by było, gdybyśmy mogli przewidzieć, jak ludzie zareagują na media, zanim uzyskają jakiekolwiek dane? Umożliwiłoby to małym firmom optymalizację swoich materiałów pisemnych i stron internetowych, pomimo niewielkiej istniejącej wcześniej trakcji. NeuroAI jest coraz bliżej zdolności przewidywania, jak ludzie zareagują na materiały wizualne. Na przykład badacze w Adobe pracujemy nad narzędziami przewidywać i kierować uwagę wzrokową na ilustracjach.

Naukowcy zademonstrowali również edycję zdjęć w celu ich wykonania bardziej zapadające w pamięć wizualnie lub estetycznie przyjemny. Może być używany na przykład do automatycznego wybierania profesjonalnego zdjęcia głowy najlepiej dopasowanego do obrazu, który ludzie chcą sobie wyobrazić – profesjonalnego, poważnego lub kreatywnego. Sztuczne sieci neuronowe potrafią nawet znaleźć sposoby przekazywania wiadomości skuteczniej niż realistyczne obrazy. CLIP OpenAI można zbadać, aby znaleźć obrazy dostosowane do emocji. Obraz najlepiej pasujący do koncepcji szoku nie byłby nie na miejscu obok Krzyku Muncha.

W ciągu ostatniego roku OpenAI i Google zademonstrowały sieci sztuki generatywnej z imponującą zdolnością generowania fotorealistycznych obrazów z podpowiedzi tekstowych. Jeszcze nie doszliśmy do tego momentu dla muzyki, ale wraz z tempem postępu modeli generatywnych z pewnością stanie się to w ciągu najbliższych kilku lat. Budując maszyny, które słyszą jak ludzie, możemy być w stanie zdemokratyzować produkcję muzyczną, dając każdemu możliwość robienia tego, co potrafią wysoko wykwalifikowani producenci muzyczni: komunikowania właściwych emocji podczas refrenu, czy to melancholii, czy radości; stworzyć ucha melodii; lub sprawić, by utwór był nieodparcie taneczny.

Rynek wywiera ogromną presję na optymalizację mediów audiowizualnych, stron internetowych, a zwłaszcza reklam, a my już integrujemy neuroAI i sztukę algorytmiczną w tym procesie. Ta presja doprowadzi do pozytywnego cyklu, w którym neuroAI stanie się lepsza i bardziej użyteczna, gdy więcej zasobów zostanie przeznaczonych na praktyczne zastosowania. Efektem ubocznym jest to, że otrzymamy bardzo dobre modele mózgu, które przydadzą się daleko poza reklamami.

Dostępność i projektowanie algorytmiczne

Jednym z najbardziej ekscytujących zastosowań neuroAI jest dostępność. Większość mediów jest przeznaczona dla „przeciętnej” osoby, jednak wszyscy inaczej przetwarzamy informacje wizualne i słuchowe. 8% mężczyzn i 0.5% kobiet jest daltonistami od czerwono-zielonego koloru, a duża ilość mediów nie jest dostosowana do ich potrzeb. Obecnie istnieje wiele produktów, które symulują ślepotę barw, ale wymagają od osoby z normalnym widzeniem kolorów interpretowania wyników i wprowadzania niezbędnych zmian. Statyczne odwzorowanie kolorów również nie sprawdza się w przypadku tych potrzeb, ponieważ niektóre materiały nie zachowują swojej semantyki dzięki ponownemu odwzorowaniu kolorów (np. wykresy, które stają się trudne do odczytania). Moglibyśmy zautomatyzować generowanie materiałów i stron internetowych bezpiecznych dla daltonistów za pomocą metod neuroAI, które zachowują semantykę istniejącej grafiki.

Innym przykładem jest pomoc osobom z trudnościami w uczeniu się, takimi jak dysleksja, które dotykają do 10% ludzi na całym świecie. Jednym z podstawowych problemów w dysleksji jest: wrażliwość na zatłoczenie, co jest trudnością w rozpoznawaniu kształtów o podobnych cechach leżących u podstaw, w tym lustrzanie symetrycznych literach, takich jak p i q. Anne Harrington i Arturo Deza z MIT pracują nad modelami neuroAI które modelują ten efekt i uzyskanie bardzo obiecujących wyników. Wyobraź sobie, że bierzesz modele dyslektycznego systemu wizualnego do projektowania czcionek, które są zarówno estetyczne, jak i łatwiejsze do odczytania. Mając odpowiednie dane o układzie wzrokowym konkretnej osoby, możemy nawet dostosować czcionkę do konkretnej osoby, który okazał się obiecujący w poprawie wydajności czytania. Czekają tu potencjalnie duże ulepszenia jakości życia.

Zdrowie

Wielu neurologów wchodzi w tę dziedzinę z nadzieją, że ich badania będą miały pozytywny wpływ na zdrowie człowieka, w szczególności osób żyjących z zaburzeniami neurologicznymi lub problemami ze zdrowiem psychicznym. Mam wielką nadzieję, że neuroAI odblokuje nowe terapie: mając dobry model mózgu, możemy stworzyć odpowiednie bodźce, aby dotarły do niego właściwe wiadomości, tak jak klucz pasuje do zamka. W tym sensie neuroAI można zastosować podobnie do algorytmicznego projektowania leków, ale zamiast małych cząsteczek dostarczamy obrazy i dźwięki.

Najbardziej dostępne problemy dotyczą receptorów oczu i uszu, które są już dobrze scharakteryzowane. Setki tysięcy ludzi otrzymało implanty ślimakowe, neuroprotezy, które elektrycznie stymulują ślimak ucha, umożliwiając głuchym lub niedosłyszącym ponowne słyszenie. Te implanty, które zawierają kilkadziesiąt elektrod, mogą być trudne w użyciu w hałaśliwym otoczeniu z wieloma głośnikami. Model mózgu może zoptymalizować wzór stymulacji implantu wzmacniać mowę. Niezwykłe jest to, że ta technologia, opracowana dla osób z implantami, może zostać zaadaptowana, aby pomóc osobom bez implantów lepiej rozumieć mowę poprzez modyfikowanie dźwięków w czasie rzeczywistym, niezależnie od tego, czy mają zaburzenia przetwarzania słuchowego, czy po prostu często przebywają w głośnym otoczeniu.

Wiele osób doświadcza zmian w swoich systemach sensorycznych przez całe życie, niezależnie od tego, czy chodzi o powrót do zdrowia po operacji zaćmy, czy krótkowzroczność z wiekiem. Wiemy, że po takiej zmianie ludzie mogą nauczyć się reinterpretować świat poprawnie poprzez powtarzanie, zjawisko zwane uczeniem percepcyjnym. Możemy być w stanie zmaksymalizować tę percepcyjną naukę, aby ludzie mogli szybciej i skuteczniej odzyskać swoje umiejętności. Podobny pomysł może pomóc osobom, które utraciły zdolność płynnego poruszania kończynami po udarze. Gdybyśmy potrafili znaleźć odpowiednią sekwencję ruchów, aby optymalnie wzmocnić mózg, moglibyśmy pomóc osobom po udarze odzyskać więcej funkcji, na przykład płynniej chodzić lub po prostu trzymać filiżankę kawy bez rozlewania. Oprócz pomagania ludziom w odzyskaniu utraconych funkcji fizycznych, ten sam pomysł może pomóc zdrowym ludziom osiągnąć szczytową sprawność sensoryczną – czy to baseballiści, łucznicy, czy patolodzy.

Wreszcie mogliśmy zobaczyć, jak te idee są stosowane w leczeniu zaburzeń nastroju. Chodziłem na wiele pokazów sztuki wizualnej, aby rozładować nudę podczas pandemii, co niesamowicie poprawiło mi nastrój. Sztuka wizualna i muzyka mogą podnieść nas na duchu i jest to dowód na to, że możemy być w stanie dostarczyć terapie na zaburzenia nastroju poprzez zmysły. Wiemy, że kontrolowanie aktywności określonych części mózgu za pomocą stymulacji elektrycznej może złagodzić odporną na leczenie depresję; być może kontrolowanie aktywności mózgu pośrednio za pomocą zmysłów mogłoby wykazywać podobne efekty. Wdrażając proste modele – nisko wiszące owoce – które wpływają na dobrze rozumiane części mózgu, zaczniemy budować bardziej złożone modele, które mogą pomóc ludzkiemu zdrowiu.

Umożliwienie trendów technologicznych

NeuroAI zajmie wiele lat, zanim zostanie oswojona i wdrożona w aplikacjach, a także przechwyci inne pojawiające się trendy technologiczne. Tutaj podkreślam w szczególności dwa trendy, które sprawią, że neuroAI będzie znacznie silniejsza: rzeczywistość rozszerzona (AR), która może precyzyjnie dostarczać bodźce; oraz interfejsy mózg-komputer (BCI), które mogą mierzyć aktywność mózgu w celu sprawdzenia, czy bodźce działają w oczekiwany sposób.

Rzeczywistość rozszerzona

Trendem, który sprawi, że aplikacje neuroAI będą znacznie potężniejsze, jest przyjęcie okularów rozszerzonej rzeczywistości. Rzeczywistość rozszerzona (AR) ma potencjał, aby stać się wszechobecną platformą obliczeniową, ponieważ AR integruje się z codziennym życiem.

Hipoteza Michaela Abrasha, głównego naukowca w Meta Reality Labs, głosi, że jeśli zbudujesz wystarczająco wydajne okulary AR, wszyscy będą ich potrzebować. To oznacza budowanie światowej sławy okulary, które mogą tworzyć trwałe, zablokowane na świecie wirtualne obiekty; lekkie i modne oprawki, jak para Ray-Banów; i dające prawdziwe supermoce, takie jak możliwość naturalnie wchodzić w interakcje z ludźmi bez względu na odległość i poprawa słuchu. Jeśli potrafisz je zbudować - ogromne wyzwanie techniczne - okulary AR mogą podążać trajektorią podobną do iPhone'a, tak że każdy będzie miał jedną (lub podróbkę) 5 lat po premierze.

Aby to urzeczywistnić, Meta wydała 10 miliardów dolarów w zeszłym roku na badania i rozwój dla metaverse. Chociaż nie wiemy na pewno, co zamierza Apple, są silne oznaki, że pracują nad okularami AR. Tak więc po stronie podaży istnieje ogromny nacisk, aby AR się urzeczywistniła.

Dzięki temu powszechnie dostępne będzie urządzenie wyświetlające, które jest znacznie potężniejsze niż dzisiejsze ekrany statyczne. Jeśli to podąża za trajektorią VR, w końcu będzie mieć zintegrowane śledzenie oczu. Oznaczałoby to szeroko dostępny sposób prezentowania bodźców, który jest znacznie bardziej kontrolowany niż jest to obecnie możliwe, marzenie neuronaukowców. A te urządzenia mogą mieć daleko idące zastosowania zdrowotne, jak powiedział Michael Abrash w 2017 roku, takich jak poprawa widzenia przy słabym oświetleniu lub umożliwienie ludziom normalnego życia pomimo zwyrodnienia plamki żółtej.

Znaczenie neuroAI jest jasne: moglibyśmy dostarczać odpowiedni bodziec w wysoce kontrolowany sposób w sposób ciągły w codziennym życiu. Dotyczy to wzroku i być może mniej oczywistego dla słuchu, ponieważ możemy dostarczyć dźwięk przestrzenny. Oznacza to, że nasze narzędzia do wprowadzania terapii neuroAI dla osób z problemami neurologicznymi lub do poprawy dostępności staną się znacznie potężniejsze.

BCI

Dzięki świetnemu wyświetlaczowi i głośnikom możemy precyzyjnie kontrolować główne dane wejściowe do mózgu. Kolejnym, potężniejszym etapem dostarczania bodźców za pomocą zmysłów jest sprawdzenie, czy mózg reaguje w oczekiwany sposób, poprzez interfejs mózg-komputer (BCI) tylko do odczytu. W ten sposób możemy zmierzyć wpływ bodźców na mózg, a jeśli nie są one zgodne z oczekiwaniami, możemy odpowiednio je dostosować w tak zwanej kontroli w pętli zamkniętej.

Żeby było jasne, nie mówię tutaj o metodach BCI, takich jak chip Neuralink lub stymulatory głębokiego mózgu, które wchodzą do wnętrza czaszki; do tych celów wystarczy nieinwazyjny pomiar aktywności mózgu poza czaszką. Nie ma też potrzeby bezpośredniej stymulacji mózgu: okulary i słuchawki to wszystko, czego potrzebujesz, aby kontrolować większość bodźców mózgowych.

Istnieje wiele nieinwazyjnych BCI tylko do odczytu, które są obecnie skomercjalizowane lub są w przygotowaniu, które można wykorzystać do sterowania w pętli zamkniętej. Oto kilka przykładów:

- EEG. Elektroencefalografia mierzy aktywność elektryczną mózgu poza czaszką. Ponieważ czaszka działa jak przewodnik objętości, EEG ma wysoką rozdzielczość czasową, ale niską rozdzielczość przestrzenną. Chociaż ma to ograniczone zastosowanie konsumenckie do produktów do medytacji (muza) i niszowych zastosowań neuromarketingowych, jestem uparty na niektórych z jego zastosowań w kontekście kontroli w pętli zamkniętej. EEG może być znacznie silniejsze, gdy ma się kontrolę nad bodźcem, ponieważ możliwe jest skorelowanie prezentowanego bodźca z sygnałem EEG i dekodowanie tego, na co dana osoba zwracała uwagę (wywoływane potencjalne metody). Rzeczywiście, firma NextMind, która wykonała oparte na EEG „kliknięcie w myślach” w oparciu o wywołane potencjały, została przejęta przez Snap, która teraz tworzy produkty AR. OpenBCI jest planowanie wypuścić zestaw słuchawkowy, który integruje czujniki EEG z wysokiej klasy zestawem słuchawkowym Aero firmy Varjo. Nie wyliczałbym EEG.

- fMRI. Funkcjonalne obrazowanie metodą rezonansu magnetycznego mierzy niewielkie zmiany w utlenowaniu krwi związane z aktywnością nerwową. Jest powolny, nie jest przenośny, wymaga własnego pokoju i jest bardzo drogi. Jednak fMRI pozostaje jedyną technologią, która może nieinwazyjnie i przestrzennie precyzyjnie odczytywać aktywność głęboko w mózgu. Istnieją dwa paradygmaty, które są dość dojrzałe i istotne dla kontroli neuronowej w pętli zamkniętej. Pierwszym z nich jest biofeedback oparty na fMRI. Podpole fMRI pokazuje, że ludzie mogą modulować aktywność mózgu, prezentując ją wizualnie na ekranie lub słuchawkach. Drugi to mapowanie korowe, w tym podejścia takie jak pola receptywne populacji i szacowanie selektywności wokseli za pomocą klipów filmowych lub podcasty, które pozwalają ocenić, jak różne obszary mózgu reagują na różne bodźce wzrokowe i słuchowe. Te dwie metody wskazują, że powinno być możliwe oszacowanie, w jaki sposób interwencja neuroAI wpływa na mózg i sterowanie nim, aby był bardziej skuteczny.

- fNIRS. Funkcjonalna spektroskopia w bliskiej podczerwieni wykorzystuje rozproszone światło do oszacowania objętości krwi mózgowej między nadajnikiem a receptorem. Polega na tym, że krew jest nieprzezroczysta, a zwiększona aktywność nerwowa prowadzi do opóźnionego napływu krwi do danej objętości mózgu (ta sama zasada, co fMRI). Konwencjonalny NIRS ma niską rozdzielczość przestrzenną, ale dzięki bramkowaniu czasowemu (TD-NIRS) i ogromnemu nadpróbkowaniu (rozproszonej tomografii optycznej), rozdzielczość przestrzenna jest znacznie lepsza. Na froncie akademickim Grupa Joe Culvera w WUSTL zademonstrowali dekodowanie filmów z kory wzrokowej. Na froncie handlowym Kernel jest teraz produkcja i wysyłka zestawów słuchawkowych TD-NIRS które są imponującymi osiągnięciami inżynierii. Jest to obszar, w którym ludzie wciąż naciskają, a postęp jest szybki; moja stara grupa w Meta wykazała 32-krotną poprawę stosunku sygnału do szumu (który można przeskalować do >300) w powiązanej technice.

- MEG. Magnetoencefalografia mierzy niewielkie zmiany w polach magnetycznych, lokalizując w ten sposób aktywność mózgu. MEG jest podobny do EEG pod tym względem, że mierzy zmiany w polu elektromagnetycznym, ale nie cierpi na przewodnictwo objętościowe i dlatego ma lepszą rozdzielczość przestrzenną. Przenośny MEG, który nie wymaga chłodzenia, byłby przełomem w przypadku nieinwazyjnego BCI. Ludzie robią postępy w dziedzinie magnetometrów pompowanych optycznie, a pojedyncze czujniki OPM można kupić na wolnym rynku od producentów takich jak QuSpin.

Oprócz tych lepiej znanych technik, niektóre technologie ciemnych koni, takie jak holografia cyfrowa, tomografia fotoakustyczna i ultradźwięki funkcjonalne, mogą prowadzić do szybkich zmian paradygmatu w tej przestrzeni.

Chociaż nieinwazyjny BCI klasy konsumenckiej jest wciąż w powijakach, istnieje wiele presji rynkowych związanych z przypadkami użycia AR, które sprawią, że ciasto będzie większe. Rzeczywiście, poważnym problemem dla AR jest sterowanie urządzeniem: nie chcesz chodzić z kontrolerem lub mruczeć do okularów, jeśli możesz tego uniknąć. Firmy dość poważnie podchodzą do rozwiązania tego problemu, o czym świadczy wykupienie przez Facebooka CTRL+Labs w 2019, Snap przejmuje NextMind, a Valve łączy siły z OpenBCI. W związku z tym prawdopodobnie zobaczymy, jak szybko rozwijają się niskowymiarowe BCI. Wielowymiarowe BCI mogą podążać tą samą trajektorią, jeśli znajdą zabójczą aplikację, taką jak AR. Możliwe, że rodzaje aplikacji neuroAI, za którymi opowiadam się tutaj, są dokładnie właściwym przypadkiem użycia tej technologii.

Jeśli możemy kontrolować dane wejściowe do oczu i uszu, a także precyzyjnie mierzyć stany mózgu, możemy dostarczać terapie oparte na neuroAI w sposób monitorowany, aby uzyskać maksymalną skuteczność.

Czego brakuje na boisku

Podstawowa nauka stojąca za aplikacjami NeuroAI szybko dojrzewa i istnieje szereg pozytywnych trendów, które zwiększą jego ogólne zastosowanie. Czego więc brakuje, aby wprowadzić na rynek aplikacje neuroAI?

- Obróbka. Inne poddziedziny AI odniosły ogromne korzyści dzięki zestawom narzędzi, które umożliwiają szybki postęp i udostępnianie wyników. Obejmuje to biblioteki algebr tensorów, takie jak Tensorflow i PyTorch, środowiska szkoleniowe, takie jak OpenAI Gym, oraz ekosystemy do udostępniania danych i modeli, takie jak 🤗 HuggingFace. Scentralizowane repozytorium modeli i metod, a także zestawy ewaluacyjne, potencjalnie wykorzystujące obfite dane symulacyjne, pchną tę dziedzinę do przodu. Istnieje już silna społeczność organizacji zajmujących się neuronauką o otwartym kodzie źródłowym, które mogą służyć jako naturalni gospodarze tych wysiłków.

- Talent. Na styku neuronauki i sztucznej inteligencji jest znikoma liczba miejsc, w których prowadzi się badania i rozwój. Obszar Zatoki, z laboratoriami w Stanford i Berkeley oraz obszar miejski w Bostonie z licznymi laboratoriami w MIT i Harvardzie, prawdopodobnie zobaczą większość inwestycji z istniejącego wcześniej ekosystemu kapitału wysokiego ryzyka. Trzecim prawdopodobnym ośrodkiem jest Montreal w Kanadzie, podniesiony przez ogromne wydziały neuronauki w McGill i Universite de Montreal, w połączeniu z przyciąganiem Mila, instytutu sztucznej inteligencji założonego przez pioniera sztucznej inteligencji Yoshuę Bengio. Nasza dziedzina skorzystałaby z wyspecjalizowanych programów doktoranckich i centrów doskonałości w neuroAI, aby rozpocząć komercjalizację.

- Nowe modele finansowania i komercjalizacji zastosowań medycznych. Zastosowania medyczne mają długą drogę do komercjalizacji, a chroniona własność intelektualna jest zwykle warunkiem wstępnym uzyskania środków na zmniejszenie ryzyka inwestycji w technologię. Innowacje oparte na sztucznej inteligencji są notorycznie trudne do opatentowania, a oprogramowanie jako urządzenie medyczne (SaMD) dopiero zaczyna pojawiać się na rynku, co sprawia, że droga do komercjalizacji jest niepewna. Będziemy potrzebować funduszy, które skupiają się na łączeniu wiedzy z zakresu sztucznej inteligencji i technologii medycznej, aby pielęgnować tę rodzącą się dziedzinę.

Zbudujmy neuroAI

Naukowcy i filozofowie od niepamiętnych czasów zastanawiali się, jak działają mózgi. W jaki sposób cienki arkusz bibuły o powierzchni metra kwadratowego pozwala nam widzieć, słyszeć, czuć i myśleć? NeuroAI pomaga nam uporać się z tymi głębokimi pytaniami, budując modele systemów neurologicznych w komputerach. Zaspokajając to fundamentalne pragnienie wiedzy – co to znaczy być człowiekiem? – neuronaukowcy budują też narzędzia, które mogą pomóc milionom ludzi żyć bogatszym życiem.

Opublikowano 4 sierpnia 2022 r

Technologia, innowacyjność i przyszłość, jak mówią ci, którzy ją budują.

Poglądy wyrażone w „postach” (w tym w artykułach, podcastach, filmach i mediach społecznościowych) są poglądami osób tam cytowanych i niekoniecznie są poglądami AH Capital Management, LLC („a16z”) lub jej odpowiednich podmiotów stowarzyszonych. Niektóre informacje w nim zawarte zostały pozyskane ze źródeł zewnętrznych, w tym od spółek portfelowych funduszy zarządzanych przez a16z. Chociaż pochodzi ze źródeł uważanych za wiarygodne, a16z nie zweryfikował niezależnie takich informacji i nie składa żadnych oświadczeń dotyczących trwałej dokładności informacji lub ich adekwatności w danej sytuacji.

Te treści są udostępniane wyłącznie w celach informacyjnych i nie należy ich traktować jako porady prawnej, biznesowej, inwestycyjnej lub podatkowej. Powinieneś skonsultować się w tych sprawach z własnymi doradcami. Odniesienia do jakichkolwiek papierów wartościowych lub aktywów cyfrowych służą wyłącznie celom ilustracyjnym i nie stanowią rekomendacji inwestycyjnej ani oferty świadczenia usług doradztwa inwestycyjnego. Ponadto treść ta nie jest skierowana ani przeznaczona do użytku przez jakichkolwiek inwestorów lub potencjalnych inwestorów iw żadnym wypadku nie można na nich polegać przy podejmowaniu decyzji o zainwestowaniu w jakikolwiek fundusz zarządzany przez a16z. (Oferta inwestycji w fundusz a16z zostanie złożona wyłącznie na podstawie memorandum dotyczącego oferty prywatnej, umowy subskrypcyjnej i innej odpowiedniej dokumentacji takiego funduszu i należy ją przeczytać w całości.) Wszelkie inwestycje lub spółki portfelowe wymienione, wymienione lub opisane nie są reprezentatywne dla wszystkich inwestycji w pojazdy zarządzane przez a16z i nie można zapewnić, że inwestycje będą opłacalne lub że inne inwestycje dokonane w przyszłości będą miały podobne cechy lub wyniki. Lista inwestycji dokonanych przez fundusze zarządzane przez Andreessena Horowitza (z wyłączeniem inwestycji, w przypadku których emitent nie wyraził zgody na publiczne ujawnienie przez a16z, jak również niezapowiedzianych inwestycji w aktywa cyfrowe będące w obrocie publicznym) jest dostępna pod adresem https://a16z.com/investments/.

Przedstawione w nich wykresy i wykresy służą wyłącznie do celów informacyjnych i nie należy na nich polegać przy podejmowaniu jakichkolwiek decyzji inwestycyjnych. Wyniki historyczne nie wskazują na przyszłe wyniki. Treść jest aktualna tylko we wskazanej dacie. Wszelkie prognozy, szacunki, prognozy, cele, perspektywy i / lub opinie wyrażone w tych materiałach mogą ulec zmianie bez powiadomienia i mogą się różnić lub być sprzeczne z opiniami wyrażonymi przez innych. Proszę zobaczyć https://a16z.com/disclosures aby uzyskać dodatkowe ważne informacje.

- Andreessen Horowitz

- Dane biologiczne i naukowe

- Bitcoin

- blockchain

- zgodność z technologią blockchain

- konferencja blockchain

- coinbase

- pomysłowość

- Zgoda

- konferencja kryptograficzna

- wydobycie kryptograficzne

- kryptowaluta

- Zdecentralizowane

- DeFi

- Zasoby cyfrowe

- ethereum

- uczenie maszynowe

- niezamienny żeton

- plato

- Platon Ai

- Analiza danych Platona

- Platoblockchain

- PlatoDane

- platogaming

- Wielokąt

- dowód stawki

- W3

- zefirnet