Wykrywanie oszustw to ważny problem, który ma zastosowanie w usługach finansowych, mediach społecznościowych, handlu elektronicznym, grach i innych branżach. W tym poście przedstawiono implementację rozwiązania do wykrywania oszustw przy użyciu modelu Relational Graph Convolutional Network (RGCN) do przewidywania prawdopodobieństwa, że transakcja jest oszukańcza zarówno w trybie wnioskowania transdukcyjnego, jak i indukcyjnego. Możesz wdrożyć naszą implementację do Amazon Sage Maker punkt końcowy jako rozwiązanie do wykrywania oszustw w czasie rzeczywistym, bez konieczności zewnętrznego przechowywania wykresów lub orkiestracji, co znacznie zmniejsza koszty wdrożenia modelu.

Firmy poszukujące w pełni zarządzanej usługi AWS AI do wykrywania oszustw mogą również skorzystać Wykrywacz oszustw Amazon, którego możesz użyć do identyfikowania podejrzanych płatności online, wykrywania nowych oszustw na koncie, zapobiegania nadużyciom w ramach okresu próbnego i programów lojalnościowych lub poprawy wykrywania przejmowania kont.

Omówienie rozwiązania

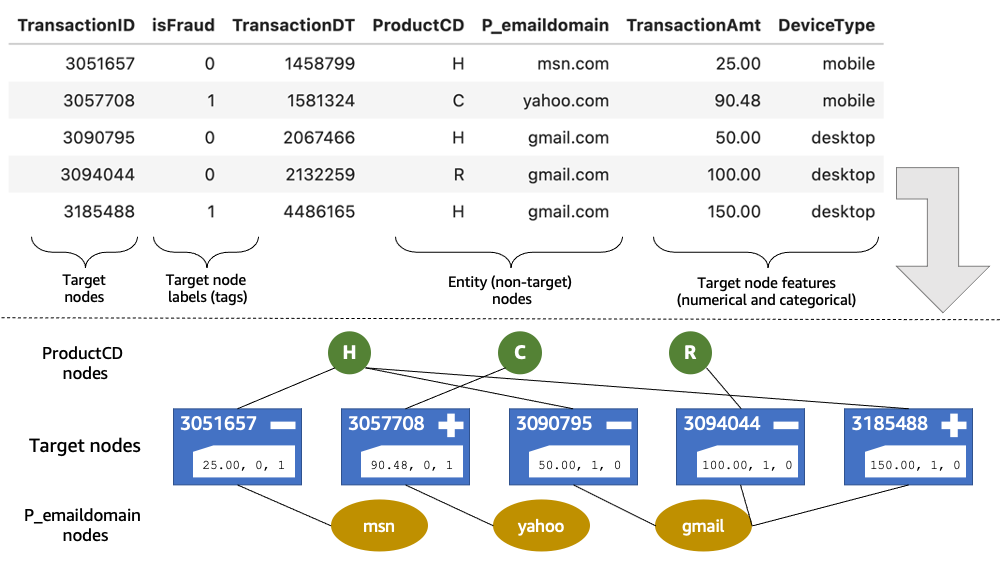

Na poniższym diagramie opisano przykładową sieć transakcji finansowych, która obejmuje różne typy informacji. Każda transakcja zawiera informacje, takie jak identyfikatory urządzeń, identyfikatory Wi-Fi, adresy IP, lokalizacje fizyczne, numery telefonów i inne. Zestawy danych transakcji przedstawiamy za pomocą heterogenicznego grafu, który zawiera różne typy węzłów i krawędzi. Następnie problem wykrywania oszustw jest traktowany jako zadanie klasyfikacji węzłów na tym grafie heterogenicznym.

Grafowe sieci neuronowe (GNN) okazały się bardzo obiecujące w rozwiązywaniu problemów związanych z wykrywaniem oszustw, przewyższając popularne metody nadzorowanego uczenia się, takie jak drzewa decyzyjne ze wspomaganiem gradientowym lub w pełni połączone sieci typu feed-forward w zestawach danych porównawczych. W typowej konfiguracji wykrywania oszustw podczas fazy uczenia model GNN jest szkolony na zestawie oznaczonych transakcji. Każda transakcja szkoleniowa jest opatrzona binarną etykietą wskazującą, czy jest oszukańcza. Ten przeszkolony model może być następnie użyty do wykrywania nieuczciwych transakcji wśród zestawu nieoznakowanych transakcji podczas fazy wnioskowania. Istnieją dwa różne tryby wnioskowania: wnioskowanie transdukcyjne i wnioskowanie indukcyjne (które omówimy więcej w dalszej części tego wpisu).

Modele oparte na GNN, takie jak RGCN, mogą wykorzystywać informacje topologiczne, łącząc zarówno strukturę grafu, jak i cechy węzłów i krawędzi, aby poznać sensowną reprezentację, która odróżnia złośliwe transakcje od legalnych transakcji. RGCN może skutecznie uczyć się reprezentowania różnych typów węzłów i krawędzi (relacji) poprzez osadzanie heterogenicznych grafów. Na powyższym diagramie każda transakcja jest modelowana jako węzeł docelowy, a kilka jednostek powiązanych z każdą transakcją jest modelowanych jako typy węzłów innych niż docelowe, np. ProductCD i P_emaildomain. Węzły docelowe mają przypisane cechy liczbowe i jakościowe, podczas gdy inne typy węzłów są pozbawione cech. Model RGCN uczy się osadzania dla każdego typu węzła niedocelowego. W przypadku osadzania węzła docelowego operacja splotowa jest używana do obliczenia jego osadzania przy użyciu jego funkcji i osadzeń sąsiedztwa. W pozostałej części postu używamy zamiennie terminów GNN i RGCN.

Warto zauważyć, że alternatywne strategie, takie jak traktowanie jednostek niedocelowych jako cech i kodowanie ich na gorąco, byłyby często niewykonalne ze względu na dużą liczność tych jednostek. I odwrotnie, zakodowanie ich jako jednostek grafu umożliwia modelowi GNN wykorzystanie niejawnej topologii w relacjach jednostek. Na przykład transakcje wykorzystujące wspólny numer telefonu ze znanymi nieuczciwymi transakcjami również z większym prawdopodobieństwem będą nieuczciwe.

Reprezentacja grafów stosowana przez GNN stwarza pewną złożoność w ich implementacji. Jest to szczególnie prawdziwe w przypadku aplikacji takich jak wykrywanie oszustw, w których reprezentacja grafu może zostać rozszerzona podczas wnioskowania o nowo dodane węzły, które odpowiadają podmiotom nieznanym podczas uczenia modelu. Ten scenariusz wnioskowania jest zwykle określany jako tryb indukcyjny. W przeciwieństwie, tryb transdukcyjny to scenariusz zakładający, że reprezentacja grafu skonstruowana podczas uczenia modelu nie zmieni się podczas wnioskowania. Modele GNN są często oceniane w trybie transdukcyjnym przez konstruowanie reprezentacji wykresów z połączonego zestawu przykładów uczących i testowych, przy jednoczesnym maskowaniu etykiet testowych podczas wstecznej propagacji. Dzięki temu reprezentacja grafu jest statyczna, a model GNN nie wymaga implementacji operacji rozszerzania grafu o nowe węzły podczas wnioskowania. Niestety nie można założyć statycznej reprezentacji wykresu podczas wykrywania nieuczciwych transakcji w rzeczywistych warunkach. Dlatego podczas wdrażania modeli GNN do wykrywania oszustw w środowiskach produkcyjnych wymagana jest obsługa wnioskowania indukcyjnego.

Ponadto wykrywanie nieuczciwych transakcji w czasie rzeczywistym ma kluczowe znaczenie, zwłaszcza w przypadkach biznesowych, w których istnieje tylko jedna szansa na powstrzymanie nielegalnych działań. Na przykład nieuczciwi użytkownicy mogą zachować się złośliwie tylko raz z kontem i nigdy więcej nie używać tego samego konta. Wnioskowanie w czasie rzeczywistym na temat modeli GNN wprowadza dodatkową złożoność do implementacji. Często konieczne jest wdrożenie operacji wyodrębniania podgrafów w celu obsługi wnioskowania w czasie rzeczywistym. Operacja wyodrębniania podgrafów jest potrzebna, aby zmniejszyć opóźnienie wnioskowania, gdy reprezentacja grafu jest duża, a przeprowadzanie wnioskowania na całym grafie staje się zbyt kosztowne. Algorytm wnioskowania indukcyjnego w czasie rzeczywistym z modelem RGCN działa w następujący sposób:

- Biorąc pod uwagę partię transakcji i przeszkolony model RGCN, rozszerz reprezentację grafu o jednostki z partii.

- Przypisz wektory osadzania nowych węzłów niedocelowych ze średnim wektorem osadzania ich odpowiedniego typu węzła.

- Wyodrębnij podgraf wywołany przez k-hop out-neighborhood węzłów docelowych z partii.

- Wykonaj wnioskowanie na podgrafie i zwróć wyniki predykcji dla węzłów docelowych partii.

- Wyczyść reprezentację wykresu, usuwając nowo dodane węzły (ten krok gwarantuje, że wymagania dotyczące pamięci dla wnioskowania o modelu pozostaną stałe).

Kluczowym wkładem tego wpisu jest przedstawienie modelu RGCN implementującego algorytm wnioskowania indukcyjnego w czasie rzeczywistym. Możesz wdrożyć naszą implementację RGCN na punkcie końcowym SageMaker jako rozwiązanie do wykrywania oszustw w czasie rzeczywistym. Nasze rozwiązanie nie wymaga zewnętrznego przechowywania wykresów ani orkiestracji i znacznie zmniejsza koszty wdrożenia modelu RGCN do zadań związanych z wykrywaniem oszustw. Model implementuje również transdukcyjny tryb wnioskowania, umożliwiając nam przeprowadzanie eksperymentów w celu porównania wydajności modelu w trybach indukcyjnym i transdukcyjnym. Dostęp do kodu modelu i notatników z eksperymentami można uzyskać z witryny Przykłady AWS Repozytorium GitHub.

Ten post jest oparty na poście Zbuduj oparte na GNN rozwiązanie do wykrywania oszustw w czasie rzeczywistym przy użyciu Amazon SageMaker, Amazon Neptune i biblioteki Deep Graph Library. W poprzednim poście zbudowano oparte na RGCN rozwiązanie do wykrywania oszustw w czasie rzeczywistym przy użyciu SageMaker, Amazon Neptuni Biblioteka Deep Graph (DGL). Wcześniejsze rozwiązanie wymagało użycia bazy danych Neptune jako zewnętrznego magazynu wykresów AWS Lambda do orkiestracji w celu wnioskowania w czasie rzeczywistym i zawierał tylko eksperymenty w trybie transdukcyjnym.

Model RGCN przedstawiony w tym poście implementuje wszystkie operacje algorytmu wnioskowania indukcyjnego w czasie rzeczywistym, używając tylko DGL jako zależności i nie wymaga zewnętrznego przechowywania wykresów ani orkiestracji do wdrożenia.

Najpierw oceniamy wydajność modelu RGCN w trybach transdukcyjnych i indukcyjnych na zestawie danych porównawczych. Zgodnie z oczekiwaniami wydajność modelu w trybie indukcyjnym jest nieco niższa niż w trybie transdukcyjnym. Badamy również wpływ hiperparametru k na wydajność modelu. Hiperparametr k kontroluje liczbę przeskoków wykonywanych w celu wyodrębnienia podwykresu w kroku 3 algorytmu wnioskowania w czasie rzeczywistym. Wyższe wartości k stworzy większe podgrafy i może prowadzić do lepszej wydajności wnioskowania kosztem większego opóźnienia. W związku z tym przeprowadzamy również eksperymenty czasowe, aby ocenić wykonalność modelu RGCN dla aplikacji w czasie rzeczywistym.

Dataset

Używamy Zbiór danych o oszustwach IEEE-CIS, ten sam zestaw danych, który był używany w poprzednim pisać. Zestaw danych zawiera ponad 590,000 XNUMX rekordów transakcji, które mają binarną etykietę oszustwa (tzw isFraud kolumna). Dane są podzielone na dwie tabele: transakcja i tożsamość. Jednak nie wszystkie rekordy transakcji zawierają odpowiednie informacje o tożsamości. Dołączamy do dwóch stolików na TransactionID kolumnie, co pozostawia nam w sumie 144,233 XNUMX rekordów transakcji. Sortujemy tabelę według znacznika czasu transakcji (tzw TransactionDT kolumna) i utwórz podział procentowy 80/20 według czasu, generując odpowiednio 115,386 28,847 i XNUMX XNUMX transakcji do szkolenia i testowania.

Aby uzyskać więcej informacji na temat zestawu danych i sposobu formatowania go w celu spełnienia wymagań wejściowych DGL, zobacz Wykrywanie oszustw w heterogenicznych sieciach za pomocą Amazon SageMaker i Deep Graph Library.

Konstrukcja wykresu

Używamy TransactionID kolumna do generowania węzłów docelowych. Używamy następujących kolumn do generowania 11 typów węzłów innych niż docelowe:

card1przezcard6ProductCDaddr1iaddr2P_emaildomainiR_emaildomain

Używamy 38 kolumn jako cech kategorycznych węzłów docelowych:

M1przezM9DeviceTypeiDeviceInfoid_12przezid_38

Używamy 382 kolumn jako liczbowych cech węzłów docelowych:

TransactionAmtdist1idist2id_01przezid_11C1przezC14D1przezD15V1przezV339

Nasz graf zbudowany z transakcji szkoleniowych zawiera 217,935 2,653,878 węzłów i XNUMX XNUMX XNUMX krawędzi.

Hiperparametry

Inne parametry są ustawione tak, aby odpowiadały parametrom podanym w poprzednim kroku pisać. Poniższy fragment ilustruje trenowanie modelu RGCN w trybach transdukcyjnym i indukcyjnym:

Tryb indukcyjny a tryb transdukcyjny

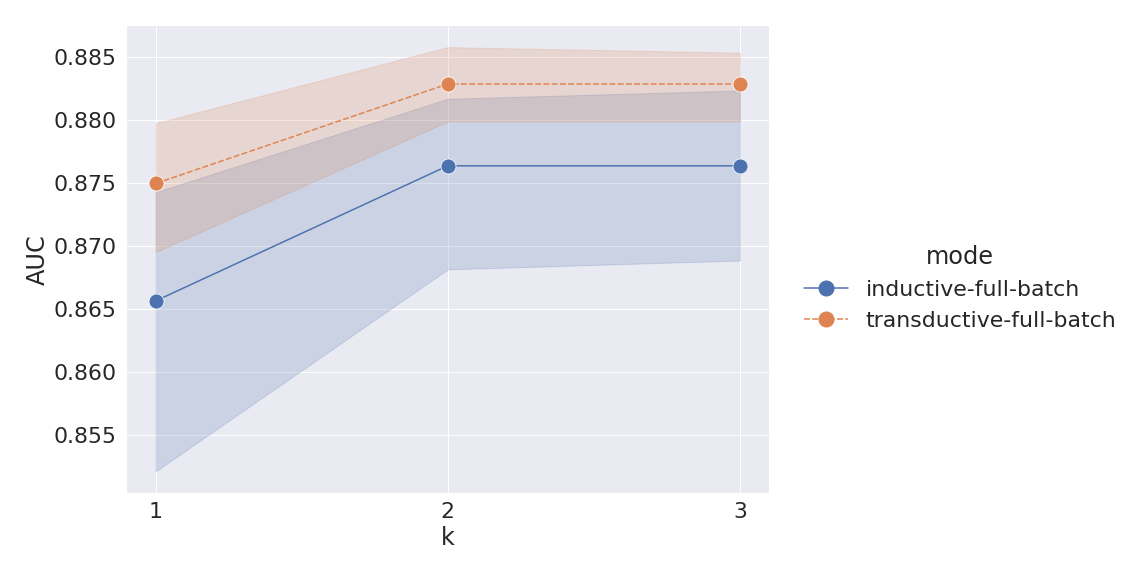

Wykonujemy pięć prób dla trybu indukcyjnego i pięć prób dla trybu transdukcyjnego. Dla każdej próby trenujemy model RGCN i zapisujemy go na dysku, uzyskując 10 modeli. Każdy model oceniamy na przykładach testowych, jednocześnie zwiększając liczbę przeskoków (parametr k) używany do wyodrębnienia podwykresu do wnioskowania, ustawienia k do 1, 2 i 3. Przewidujemy jednocześnie wszystkie przykłady testów i obliczamy wynik AUC ROC dla każdej próby. Poniższy wykres przedstawia średnią i 95% przedziały ufności wyników AUC.

Widzimy, że wydajność w trybie transdukcyjnym jest nieco wyższa niż w trybie indukcyjnym. Dla k=2, średnie wyniki AUC dla trybu indukcyjnego i transdukcyjnego wynoszą odpowiednio 0.876 i 0.883. Jest to oczekiwane, ponieważ model RGCN jest w stanie nauczyć się osadzania wszystkich węzłów encji w trybie transdukcyjnym, w tym w zbiorze testowym. W przeciwieństwie do tego, tryb indukcyjny pozwala modelowi uczyć się tylko osadzania węzłów encji, które są obecne w przykładach uczących, a zatem niektóre węzły muszą być wypełnione średnią podczas wnioskowania. Jednocześnie spadek wydajności między trybami transdukcyjnym i indukcyjnym nie jest znaczący, a nawet w trybie indukcyjnym model RGCN osiąga dobre wyniki z AUC na poziomie 0.876. Obserwujemy również, że wydajność modelu nie poprawia się dla wartości k>2. To implikuje to ustawienie k=2 wyodrębniłoby wystarczająco duży podwykres podczas wnioskowania, co dałoby optymalną wydajność. Obserwację tę potwierdza również nasz następny eksperyment.

Warto również zauważyć, że dla trybu transdukcyjnego AUC naszego modelu wynoszące 0.883 jest wyższe niż odpowiadające mu AUC wynoszące 0.870 podane w poprzednim pisać. Używamy większej liczby kolumn jako liczbowych i kategorycznych cech węzłów docelowych, co może wyjaśniać wyższy wynik AUC. Zauważamy również, że eksperymenty w poprzednim poście obejmowały tylko jedną próbę.

Wnioskowanie na małej partii

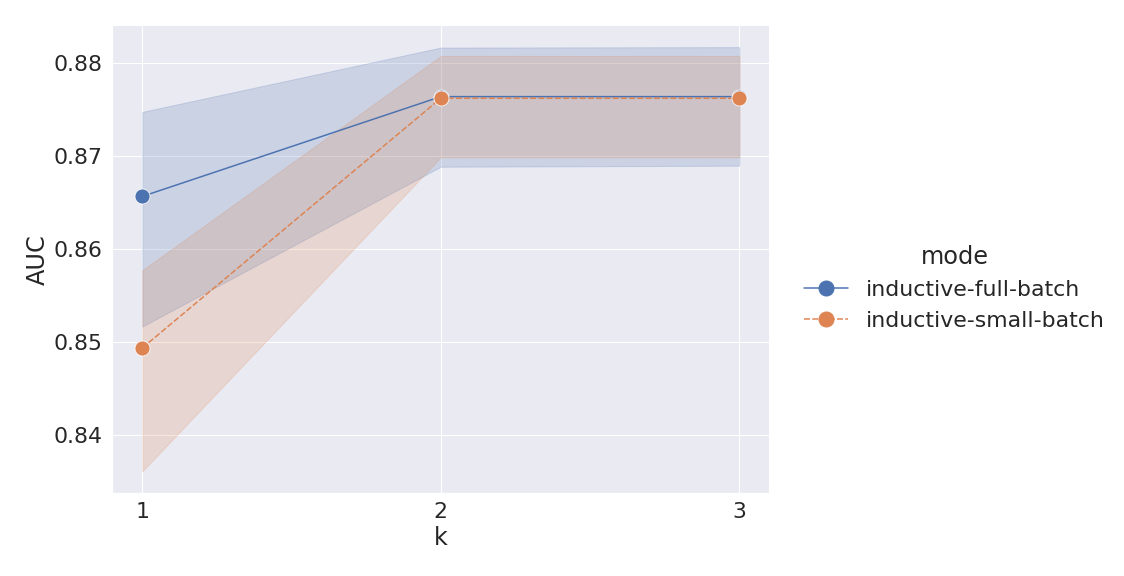

W tym eksperymencie oceniamy model RGCN w ustawieniu wnioskowania o małej partii. Używamy pięciu modeli, które zostały przeszkolone w trybie indukcyjnym w poprzednim eksperymencie. Porównujemy wydajność tych modeli podczas przewidywania w dwóch ustawieniach: wnioskowanie pełne i małe partie. W celu wnioskowania o pełnej partii przewidujemy cały zestaw testowy, tak jak to miało miejsce w poprzednim eksperymencie. W przypadku wnioskowania o małych partiach przewidujemy w małych partiach, dzieląc zestaw testowy na 28 partii o równej wielkości, z około 1,000 transakcji w każdej partii. Obliczamy wyniki AUC dla obu ustawień przy użyciu różnych wartości k. Poniższy wykres przedstawia średnie i 95% przedziały ufności dla ustawień wnioskowania pełnego i małego wsadu.

Obserwujemy tę wydajność dla wnioskowania o małej partii kiedy k=1 jest niższy niż dla pełnej partii. Jednak wydajność wnioskowania o małej partii jest zgodna z pełną partią, kiedy k>1. Można to przypisać znacznie mniejszym podgrafom wyodrębnianym dla małych partii. Potwierdzamy to porównując rozmiary podgrafów z rozmiarami całego grafu zbudowanego z transakcji uczących. Porównujemy rozmiary grafu pod względem liczby węzłów. Dla k=1 średni rozmiar podgrafu dla wnioskowania o małych partiach jest mniejszy niż 2% grafu uczącego. I dla pełnego wnioskowania o partii kiedy k=1, rozmiar podgrafu wynosi 22%. Gdy k=2, rozmiary podgrafów dla wnioskowania o małej i pełnej partii wynoszą odpowiednio 54% i 64%. Wreszcie rozmiary podgrafów dla obu ustawień wnioskowania osiągają 100% dla k=3. Innymi słowy, kiedy k>1, podwykres dla małej partii staje się wystarczająco duży, umożliwiając wnioskowaniu o małej partii osiągnięcie takiej samej wydajności, jak wnioskowanie o pełnej partii.

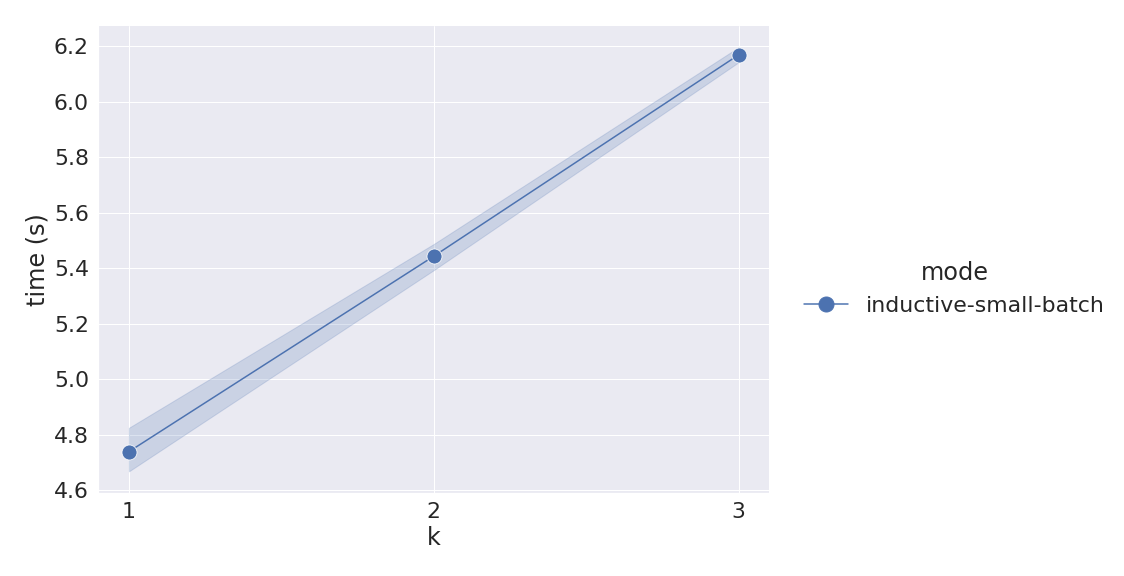

Rejestrujemy również opóźnienie prognozy dla każdej partii. Przeprowadzamy nasze eksperymenty na instancji ml.r5.12xlarge, ale możesz użyć mniejszej instancji z pamięcią 64 GB, aby przeprowadzić te same eksperymenty. Poniższy wykres przedstawia średnie i 95% przedziały ufności opóźnień przewidywania małych partii dla różnych wartości k.

Opóźnienie obejmuje wszystkie pięć kroków algorytmu wnioskowania indukcyjnego w czasie rzeczywistym. Widzimy to, kiedy k=2, przewidywanie na 1,030 transakcjach zajmuje średnio 5.4 sekundy, co daje przepustowość 190 transakcji na sekundę. Potwierdza to, że implementacja modelu RGCN jest odpowiednia do wykrywania oszustw w czasie rzeczywistym. Przypominamy również, że poprzedni pisać nie podał twardych wartości opóźnień dla ich implementacji.

Wnioski

Model RGCN wydany wraz z tym postem implementuje algorytm wnioskowania indukcyjnego w czasie rzeczywistym i nie wymaga zewnętrznego przechowywania wykresów ani orkiestracji. Parametr k w kroku 3 algorytmu określa liczbę przeskoków wykonanych w celu wyodrębnienia podgrafu do wnioskowania i skutkuje kompromisem między dokładnością modelu a opóźnieniem prognozy. Użyliśmy Zbiór danych o oszustwach IEEE-CIS w naszych eksperymentach i empirycznie potwierdziliśmy, że optymalna wartość parametru k dla tego zestawu danych wynosi 2, osiągając wynik AUC równy 0.876 i opóźnienie przewidywania mniejsze niż 6 sekund na 1,000 transakcji.

W tym poście opisano krok po kroku proces szkolenia i oceny modelu RGCN do wykrywania oszustw w czasie rzeczywistym. Dołączona klasa modelu implementuje metody dla całego cyklu życia modelu, w tym metody serializacji i deserializacji. Dzięki temu model może być używany do wykrywania oszustw w czasie rzeczywistym. Możesz wytrenować model jako estymator PyTorch SageMaker, a następnie wdrożyć go w punkcie końcowym SageMaker, używając następującego notatnik jako szablon. Punkt końcowy jest w stanie przewidzieć oszustwo na małych partiach surowych transakcji w czasie rzeczywistym. Możesz także użyć Polecający wnioskowanie Amazon SageMaker aby wybrać najlepszy typ instancji i konfigurację dla punktu końcowego wnioskowania na podstawie obciążeń.

Aby uzyskać więcej informacji na ten temat i implementację, zachęcamy do samodzielnego odkrywania i testowania naszych skryptów. Możesz uzyskać dostęp do notesów i powiązanego kodu klasy modelu z Przykłady AWS Repozytorium GitHub.

O autorach

Dmitrij Bespałow jest Senior Applied Scientist w Amazon Machine Learning Solutions Lab, gdzie pomaga klientom AWS z różnych branż przyspieszyć wdrażanie sztucznej inteligencji i chmury.

Dmitrij Bespałow jest Senior Applied Scientist w Amazon Machine Learning Solutions Lab, gdzie pomaga klientom AWS z różnych branż przyspieszyć wdrażanie sztucznej inteligencji i chmury.

Marka Ryana jest naukowcem stosowanym w Amazon Machine Learning Solutions Lab. Ma specyficzne doświadczenie w stosowaniu uczenia maszynowego do problemów w opiece zdrowotnej i naukach przyrodniczych. W wolnym czasie lubi czytać historię i fantastykę naukową.

Marka Ryana jest naukowcem stosowanym w Amazon Machine Learning Solutions Lab. Ma specyficzne doświadczenie w stosowaniu uczenia maszynowego do problemów w opiece zdrowotnej i naukach przyrodniczych. W wolnym czasie lubi czytać historię i fantastykę naukową.

Yanjun Qi jest starszym kierownikiem ds. nauk stosowanych w Amazon Machine Learning Solution Lab. Wprowadza innowacje i stosuje uczenie maszynowe, aby pomóc klientom AWS przyspieszyć wdrażanie sztucznej inteligencji i chmury.

Yanjun Qi jest starszym kierownikiem ds. nauk stosowanych w Amazon Machine Learning Solution Lab. Wprowadza innowacje i stosuje uczenie maszynowe, aby pomóc klientom AWS przyspieszyć wdrażanie sztucznej inteligencji i chmury.

- Dystrybucja treści i PR oparta na SEO. Uzyskaj wzmocnienie już dziś.

- Platoblockchain. Web3 Inteligencja Metaverse. Wzmocniona wiedza. Dostęp tutaj.

- Źródło: https://aws.amazon.com/blogs/machine-learning/build-a-gnn-based-real-time-fraud-detection-solution-using-the-deep-graph-library-without-using-external-graph-storage/

- 000

- 1

- 10

- 100

- 11

- 2%

- 28

- 7

- 95%

- a

- Zdolny

- O nas

- nadużycie

- przyśpieszyć

- dostęp

- dostęp

- Konto

- precyzja

- Osiąga

- osiągnięcia

- w poprzek

- zajęcia

- w dodatku

- dodatek

- Dodatkowy

- Adresy

- Przyjęcie

- Korzyść

- AI

- algorytm

- Wszystkie kategorie

- pozwala

- alternatywny

- Amazonka

- Uczenie maszynowe Amazon

- Amazon Neptun

- Amazon Sage Maker

- wśród

- i

- Zastosowanie

- aplikacje

- stosowany

- Stosowanie

- w przybliżeniu

- Szyk

- przydzielony

- powiązany

- przypuszczalny

- zwiększona

- średni

- AWS

- na podstawie

- bo

- staje się

- jest

- Benchmark

- Benchmarkingu

- BEST

- Ulepsz Swój

- pomiędzy

- marka

- budować

- Buduje

- wybudowany

- biznes

- nieść

- Etui

- szansa

- zmiana

- klasa

- klasyfikacja

- Chmura

- adopcja chmury

- kod

- Kolumna

- kolumny

- połączony

- łączenie

- porównać

- porównanie

- kompleksowość

- obliczać

- Prowadzenie

- pewność siebie

- systemu

- Potwierdzać

- ZATWARDZIAŁY

- połączony

- stały

- budowy

- Budowa

- zawiera

- kontrast

- wkład

- kontroli

- Odpowiedni

- Koszty:

- Stwórz

- tworzy

- istotny

- Klientów

- dane

- Baza danych

- zbiory danych

- decyzja

- głęboko

- Domyślnie

- zdefiniowane

- Zależność

- rozwijać

- wdrażanie

- Wdrożenie

- detale

- Wykrywanie

- urządzenie

- tak jak

- ZROBIŁ

- różne

- dyskutować

- Nie

- Spadek

- podczas

- każdy

- ecommerce

- efekt

- faktycznie

- Umożliwia

- umożliwiając

- zachęcać

- Punkt końcowy

- zapewnia

- Cały

- podmioty

- jednostka

- środowiska

- szczególnie

- oceniać

- oceniane

- oceny

- Parzyste

- Każdy

- przykład

- przykłady

- spodziewany

- drogi

- doświadczenie

- eksperyment

- Wyjaśniać

- odkryj

- rozciągać się

- zewnętrzny

- wyciąg

- Korzyści

- Fikcja

- W końcu

- budżetowy

- usługi finansowe

- i terminów, a

- następujący

- następujący sposób

- format

- oszustwo

- wykrywanie oszustw

- nieuczciwy

- Darmowy

- od

- pełny

- w pełni

- gier

- Generować

- otrzymać

- GitHub

- dobry

- wykres

- wspaniały

- Ciężko

- opieki zdrowotnej

- pomoc

- pomaga

- wyższy

- historia

- W jaki sposób

- How To

- Jednak

- HTML

- HTTPS

- zidentyfikować

- tożsamość

- Nielegalny

- wdrożenia

- realizacja

- wykonawczych

- narzędzia

- importować

- ważny

- podnieść

- in

- W innych

- włączony

- obejmuje

- Włącznie z

- wzrastający

- przemysłowa

- Informacja

- wkład

- przykład

- wprowadzono

- Przedstawia

- IP

- Adresy IP

- IT

- przystąpić

- Klawisz

- znany

- laboratorium

- Etykieta

- Etykiety

- duży

- większe

- Utajenie

- prowadzić

- UCZYĆ SIĘ

- nauka

- Biblioteka

- życie

- Life Sciences

- wifecycwe

- Prawdopodobnie

- załadować

- lokalizacji

- poszukuje

- Lojalność

- program lojalnościowy

- maszyna

- uczenie maszynowe

- kierownik

- Mecz

- wymowny

- Media

- Pamięć

- metody

- ML

- Moda

- model

- modele

- Tryby

- jeszcze

- niezbędny

- Neptun

- sieć

- sieci

- sieci neuronowe

- Nowości

- Następny

- węzeł

- węzły

- numer

- z naszej

- obserwować

- uzyskiwanie

- ONE

- Online

- płatności online

- działanie

- operacje

- Optymalny

- orkiestracja

- Inne

- lepsze wyniki

- własny

- pandy

- parametr

- parametry

- minęło

- płatności

- procent

- wykonać

- jest gwarancją najlepszej jakości, które mogą dostarczyć Ci Twoje monitory,

- wykonywania

- faza

- telefon

- fizyczny

- plato

- Analiza danych Platona

- PlatoDane

- Popularny

- Post

- przewidzieć

- przewidywanie

- przepowiednia

- teraźniejszość

- prezenty

- zapobiec

- poprzedni

- Wcześniejszy

- Problem

- problemy

- wygląda tak

- produkować

- Produkcja

- Program

- obietnica

- zapewniać

- pod warunkiem,

- płomień

- Qi

- Surowy

- dosięgnąć

- Czytający

- real

- Prawdziwy świat

- w czasie rzeczywistym

- rekord

- dokumentacja

- zmniejszyć

- zmniejsza

- redukcja

- , o którym mowa

- związane z

- relacje

- Relacje

- wydany

- usuwanie

- Zgłoszone

- reprezentować

- reprezentacja

- wymagać

- wymagany

- wymaganie

- osób

- REST

- wynikły

- Efekt

- powrót

- run

- Ryan

- sagemaker

- Wnioskowanie SageMakera

- taki sam

- Zapisz

- scenariusz

- nauka

- Fantastyka naukowa

- NAUKI

- Naukowiec

- skrypty

- druga

- sekund

- senior

- usługa

- Usługi

- zestaw

- ustawienie

- w panelu ustawień

- ustawienie

- kilka

- Share

- pokazane

- Targi

- znaczący

- znacznie

- pojedynczy

- Rozmiar

- rozmiary

- mały

- mniejszy

- So

- Obserwuj Nas

- Media społecznościowe

- rozwiązanie

- Rozwiązania

- kilka

- specyficzny

- prędkość

- dzielić

- Dzieli

- Ewolucja krok po kroku

- Cel

- zatrzymanie

- przechowywanie

- strategie

- Struktura

- Badanie

- podpunkt

- podgrafy

- taki

- Garnitur

- odpowiedni

- wsparcie

- podejrzliwy

- stół

- Brać

- Przejęcie

- trwa

- cel

- Zadanie

- zadania

- szablon

- REGULAMIN

- test

- Testowanie

- Połączenia

- Wykres

- ich

- a tym samym

- w związku z tym

- Przez

- wydajność

- czas

- znak czasu

- wyczucie czasu

- do

- także

- aktualny

- Kwota produktów:

- Pociąg

- przeszkolony

- Trening

- transakcja

- transakcje

- leczenia

- Drzewa

- próba

- Próby

- prawdziwy

- typy

- typowy

- us

- posługiwać się

- Użytkownicy

- zazwyczaj

- zatwierdzony

- wartość

- Wartości

- przez

- który

- Podczas

- Wi-Fi

- będzie

- bez

- słowa

- wartość

- by

- You

- Twój

- zefirnet