Wraz z pojawieniem się generatywnych rozwiązań AI organizacje znajdują różne sposoby stosowania tych technologii, aby zyskać przewagę nad konkurencją. Inteligentne aplikacje, oparte na zaawansowanych modelach podstawowych (FM) wyszkolonych na ogromnych zbiorach danych, mogą teraz rozumieć język naturalny, interpretować znaczenie i intencje oraz generować odpowiedzi istotne kontekstowo i przypominające ludzkie. To napędza innowacje we wszystkich branżach, a generatywna sztuczna inteligencja wykazuje ogromny potencjał w zakresie usprawniania niezliczonych procesów biznesowych, w tym następujących:

- Przyspiesz badania i rozwój poprzez automatyczne generowanie hipotez i projektowanie eksperymentów

- Odkrywaj ukryte spostrzeżenia, identyfikując subtelne trendy i wzorce w danych

- Zautomatyzuj czasochłonne procesy dokumentacyjne

- Zapewnij klientom lepszą obsługę dzięki personalizacji

- Podsumuj dane z różnych źródeł wiedzy

- Zwiększ produktywność pracowników, udostępniając rekomendacje dotyczące kodu oprogramowania

Amazońska skała macierzysta to w pełni zarządzana usługa, która ułatwia tworzenie i skalowanie generatywnych aplikacji AI. Amazon Bedrock oferuje wybór wydajnych modeli podstawowych wiodących firm zajmujących się sztuczną inteligencją, w tym AI21 Labs, Anthropic, Cohere, Meta, Stability AI i Amazon, za pośrednictwem jednego interfejsu API. Umożliwia prywatne dostosowywanie FM za pomocą danych przy użyciu technik takich jak dostrajanie, szybka inżynieria i generowanie rozszerzone pobierania (RAG) oraz tworzenie agentów, którzy wykonują zadania przy użyciu systemów przedsiębiorstwa i źródeł danych, zachowując jednocześnie zgodność z wymogami bezpieczeństwa i prywatności .

W tym poście omawiamy, jak wykorzystać wszechstronne możliwości Amazon Bedrock do wykonywania złożonych zadań biznesowych i poprawy obsługi klienta poprzez zapewnienie personalizacji przy użyciu danych przechowywanych w bazie danych np. Amazonka Przesunięcie ku czerwieni. Używamy technik szybkiego inżynierii do opracowywania i optymalizacji podpowiedzi na podstawie danych przechowywanych w bazie danych Redshift w celu efektywnego wykorzystania modeli podstawowych. W ramach tego przykładu budujemy spersonalizowany, generatywny plan podróży oparty na sztucznej inteligencji i pokazujemy, jak możemy spersonalizować plan podróży dla użytkownika na podstawie jego rezerwacji i danych profilu użytkownika przechowywanych w Amazon Redshift.

Szybka inżynieria

Szybka inżynieria to proces, podczas którego można tworzyć i projektować dane wejściowe użytkownika, które mogą poprowadzić generatywne rozwiązania AI w celu wygenerowania pożądanych wyników. Możesz wybrać najbardziej odpowiednie frazy, formaty, słowa i symbole, które kierują modelami podstawowymi, a co za tym idzie, generatywnymi aplikacjami AI w celu bardziej znaczącej interakcji z użytkownikami. Możesz użyć kreatywności i metod prób i błędów, aby utworzyć kolekcję na podstawie podpowiedzi, aby aplikacja działała zgodnie z oczekiwaniami. Szybka inżynieria sprawia, że generatywne aplikacje AI są bardziej wydajne i skuteczne. Możesz enkapsulować otwarte dane wejściowe użytkownika w znaku zachęty przed przekazaniem ich do FM. Na przykład użytkownik może wprowadzić niekompletne określenie problemu, np. „Gdzie kupić koszulę”. Wewnętrznie w kodzie aplikacji zastosowano zachętę o treści: „Jesteś asystentem sprzedaży w firmie odzieżowej. Użytkownik z Alabamy w Stanach Zjednoczonych pyta, gdzie kupić koszulę. Podaj trzy najbliższe sklepy, w których obecnie dostępna jest koszula”. Model podstawowy generuje następnie bardziej istotne i dokładne informacje.

Dziedzina szybkiej inżynierii stale się rozwija i wymaga kreatywnej ekspresji oraz umiejętności posługiwania się językiem naturalnym, aby dostroić podpowiedzi i uzyskać pożądany wynik z FM. Podpowiedź może zawierać dowolny z następujących elementów:

- Instrukcja – Konkretne zadanie lub instrukcja, którą ma wykonać model

- Kontekst – Informacje zewnętrzne lub dodatkowy kontekst, który może nakierować model na lepsze reakcje

- Dane wejściowe – Dane wejściowe lub pytanie, na które chcesz znaleźć odpowiedź

- Wskaźnik wyjścia – Typ lub format wyniku

Szybkiej inżynierii można używać w różnych przypadkach użycia w przedsiębiorstwie w różnych segmentach branży, takich jak:

- Bankowość i finanse – Szybka inżynieria umożliwia modelom językowym generowanie prognoz, przeprowadzanie analiz nastrojów, ocenę ryzyka, formułowanie strategii inwestycyjnych, generowanie raportów finansowych i zapewnianie zgodności z przepisami. Można na przykład używać dużych modeli językowych (LLM) do prognoz finansowych, dostarczając dane i wskaźniki rynkowe w formie podpowiedzi.

- Opieka zdrowotna i nauki o życiu – Szybka inżynieria może pomóc lekarzom zoptymalizować systemy sztucznej inteligencji, aby pomóc w procesach decyzyjnych, takich jak diagnoza, wybór leczenia lub ocena ryzyka. Można także zaprojektować monity, aby ułatwić zadania administracyjne, takie jak planowanie pacjentów, prowadzenie dokumentacji lub fakturowanie, zwiększając w ten sposób wydajność.

- Sprzedaż detaliczna – Szybka inżynieria może pomóc sprzedawcom detalicznym wdrożyć chatboty, które będą odpowiadać na typowe żądania klientów, takie jak zapytania dotyczące statusu zamówienia, zwrotów, płatności i nie tylko, przy użyciu interakcji w języku naturalnym. Może to zwiększyć zadowolenie klientów, a także pozwolić zespołom obsługi klienta poświęcić swoją wiedzę specjalistyczną skomplikowanym i wrażliwym problemom klientów.

W poniższym przykładzie wdrażamy przypadek użycia z branży turystycznej i hotelarskiej, aby wdrożyć spersonalizowany plan podróży dla klientów, którzy mają nadchodzące plany podróży. Pokazujemy, jak możemy zbudować generatywnego chatbota AI, który wchodzi w interakcję z użytkownikami, wzbogacając podpowiedzi na podstawie danych profilu użytkownika przechowywanych w bazie danych Redshift. Następnie wysyłamy ten wzbogacony monit do LLM, w szczególności do Anthropic's Claude na Amazon Bedrock, w celu uzyskania dostosowanego planu podróży.

Amazon Redshift ogłosił funkcję o nazwie Amazon Redshift ML dzięki temu analitycy danych i programiści baz danych mogą łatwo tworzyć, trenować i stosować modele uczenia maszynowego (ML) przy użyciu znanych poleceń SQL w hurtowniach danych Redshift. Jednak w tym poście wykorzystano LLM hostowane na Amazon Bedrock, aby zademonstrować ogólne techniki szybkiej inżynierii i ich zalety.

Omówienie rozwiązania

Wszyscy przeszukiwaliśmy Internet w poszukiwaniu rzeczy do zrobienia w określonym miejscu w trakcie wakacji lub przed wyjazdem. W tym rozwiązaniu pokazujemy, jak możemy wygenerować niestandardowy, spersonalizowany plan podróży, do którego użytkownicy będą mogli się odwołać i który zostanie wygenerowany na podstawie ich hobby, zainteresowań, ulubionych potraw i nie tylko. Rozwiązanie wykorzystuje dane rezerwacji, aby wyszukać miasta, do których się wybierają, wraz z datami podróży i przygotować precyzyjną, spersonalizowaną listę rzeczy do zrobienia. To rozwiązanie może zostać wykorzystane przez branżę turystyczną i hotelarską do osadzenia spersonalizowanego planu podróży w portalu rezerwacji podróży.

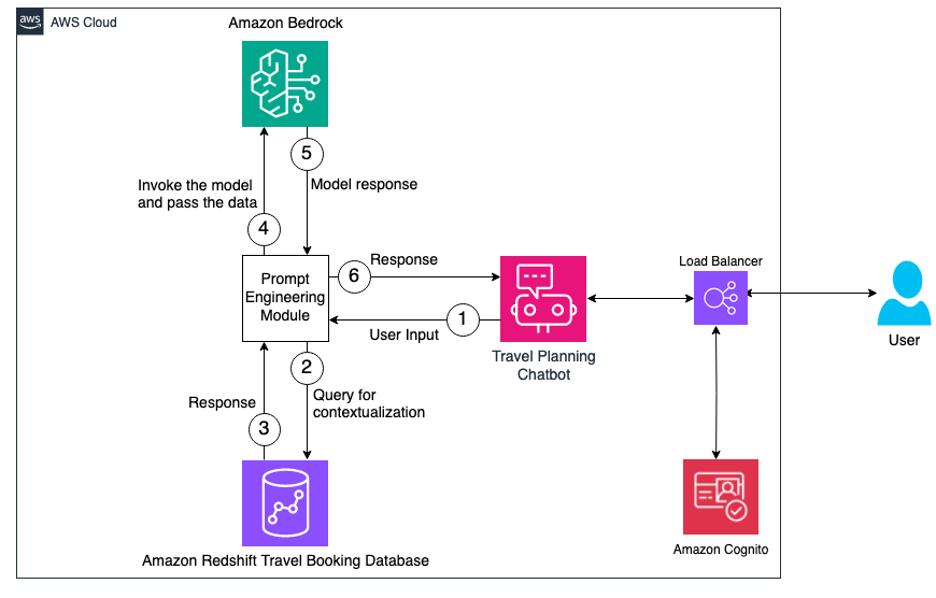

To rozwiązanie składa się z dwóch głównych elementów. Najpierw wyodrębniamy informacje o użytkowniku, takie jak imię i nazwisko, lokalizacja, hobby, zainteresowania i ulubione jedzenie, a także szczegóły dotyczące nadchodzących rezerwacji podróży. Dzięki tym informacjom łączymy w całość monity użytkownika i przekazujemy je firmie Anthropic's Claude na platformie Amazon Bedrock w celu uzyskania spersonalizowanego planu podróży. Poniższy diagram zawiera ogólny przegląd przepływu pracy i komponentów związanych z tą architekturą.

Najpierw użytkownik loguje się do aplikacji chatbota, która jest hostowana za modułem równoważenia obciążenia aplikacji i przy jej użyciu jest uwierzytelniana Amazon Cognito. Identyfikator użytkownika pozyskujemy od użytkownika za pomocą interfejsu chatbota, który przesyłany jest do modułu szybkiej inżynierii. Informacje o użytkowniku, takie jak imię i nazwisko, lokalizacja, hobby, zainteresowania i ulubione jedzenie, są pobierane z bazy danych Redshift wraz ze szczegółami rezerwacji najbliższej podróży, takimi jak miasto podróży, data zameldowania i data wymeldowania.

Wymagania wstępne

Przed wdrożeniem tego rozwiązania upewnij się, że skonfigurowano następujące wymagania wstępne:

Wdróż to rozwiązanie

Wykonaj poniższe kroki, aby wdrożyć to rozwiązanie w swoim środowisku. Kod zastosowany w tym rozwiązaniu dostępny jest w pliku GitHub repo.

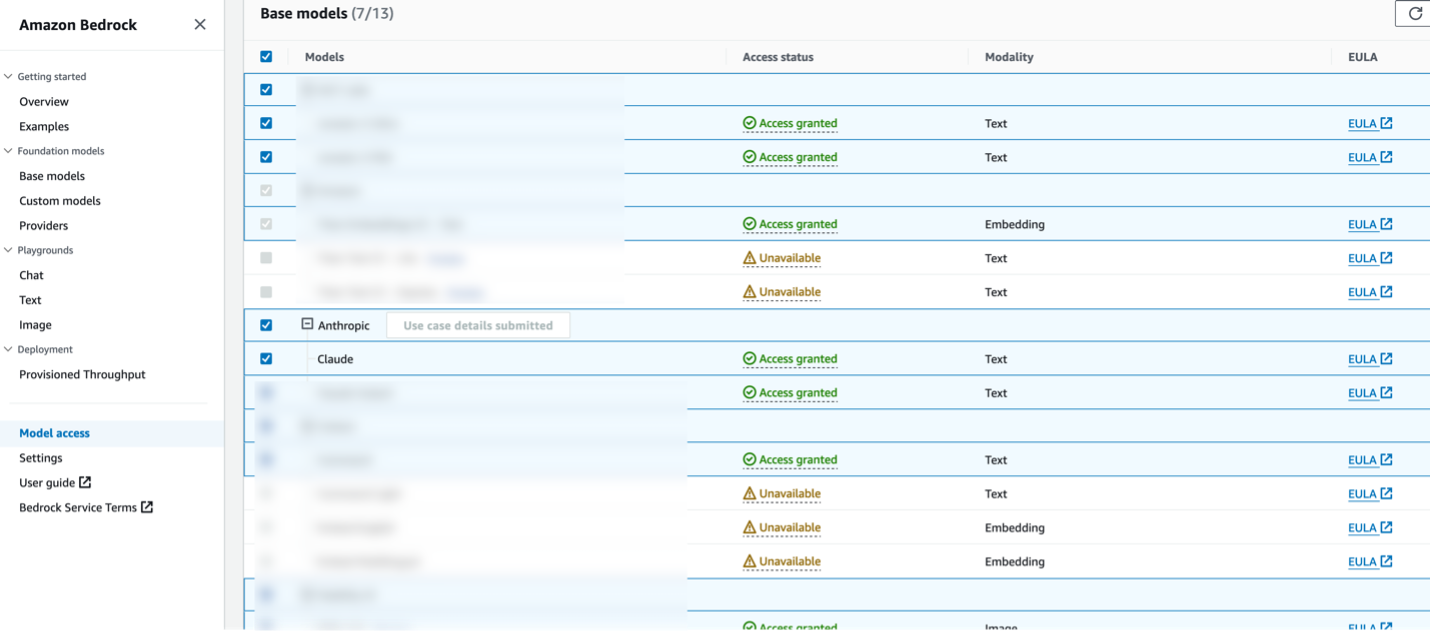

Pierwszym krokiem jest upewnienie się, że konto i region AWS, w którym wdrażane jest rozwiązanie, mają dostęp do podstawowych modeli Amazon Bedrock.

- Na konsoli Amazon Bedrock wybierz Dostęp do modelu w okienku nawigacji.

- Dodaj Zarządzaj dostępem do modelu.

- Wybierz model Anthropic Claude, a następnie wybierz Zapisz zmiany.

Zmiana stanu dostępu na „może zająć kilka minut”. Dostęp przyznany.

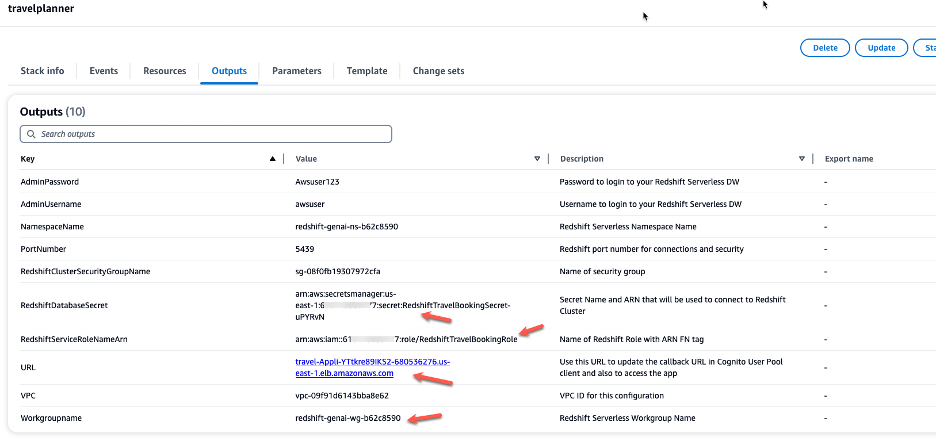

Następnie używamy następujących Tworzenie chmury AWS szablon do wdrożenia Bezserwerowe Amazon Redshift klaster wraz ze wszystkimi powiązanymi komponentami, w tym Elastyczna chmura obliczeniowa Amazon (Amazon EC2) instancja hostująca aplikację internetową.

- Dodaj Uruchom stos aby uruchomić stos CloudFormation:

- Podaj nazwę stosu i parę kluczy SSH, a następnie utwórz stos.

- Na stosie Wyjścia zapisz wartości nazwy grupy roboczej bazy danych Redshift, tajnego ARN, adresu URL i roli usługi Amazon Redshift ARN.

Teraz możesz połączyć się z instancją EC2 za pomocą protokołu SSH.

- Otwórz klienta SSH.

- Znajdź plik klucza prywatnego, który został wprowadzony podczas uruchamiania stosu CloudFormation.

- Zmień uprawnienia pliku klucza prywatnego na 400 (

chmod 400 id_rsa). - Połącz się z instancją przy użyciu jej publicznego adresu DNS lub IP. Na przykład:

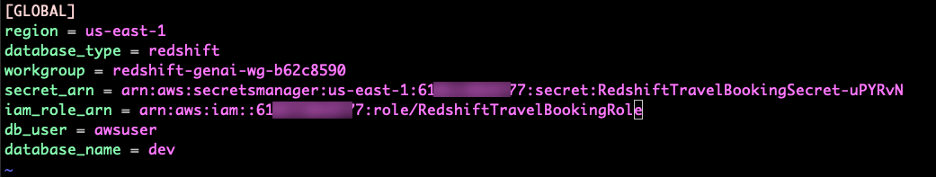

- Zaktualizuj plik konfiguracyjny

personalized-travel-itinerary-planner/core/data_feed_config.iniz regionem, nazwą grupy roboczej i tajnym ARN, który zapisałeś wcześniej.

- Uruchom następującą komendę, aby utworzyć obiekty bazy danych zawierające informacje o użytkowniku i dane rezerwacji podróży:

To polecenie tworzy schemat podróży wraz z nazwami tabel user_profile i hotel_booking.

- Uruchom następujące polecenie, aby uruchomić usługę internetową:

W kolejnych krokach tworzysz konto użytkownika, aby zalogować się do aplikacji.

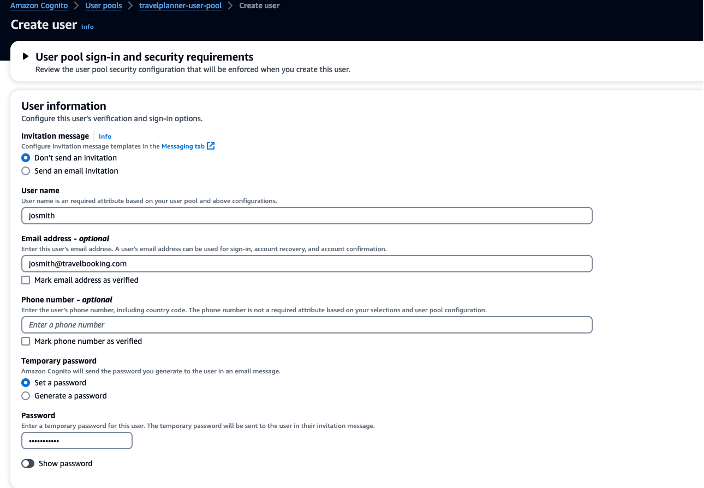

- Na konsoli Amazon Cognito wybierz Pule użytkowników w okienku nawigacji.

- Wybierz pulę użytkowników utworzoną jako część stosu CloudFormation (pula użytkowników-planera podróży).

- Dodaj Stwórz użytkownika.

- Wprowadź nazwę użytkownika, adres e-mail i hasło, a następnie wybierz Stwórz użytkownika.

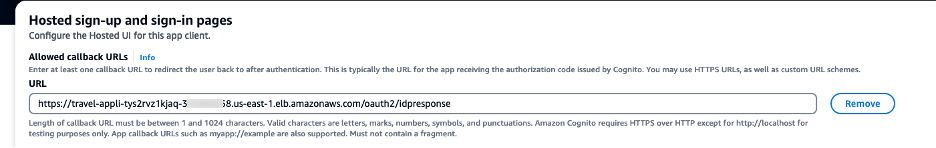

Teraz możesz zaktualizować adres URL wywołania zwrotnego w Amazon Cognito.

- Na

travelplanner-user-poolstronie szczegółów puli użytkowników, przejdź do Integracja aplikacji patka. - W Lista klientów aplikacji wybierz utworzonego klienta (

travelplanner-client). - W Hostowany interfejs użytkownika Sekcja, wybierz Edytuj.

- W razie zamówieenia projektu URL, wprowadź adres URL skopiowany z danych wyjściowych stosu CloudFormation (pamiętaj, aby używać małych liter).

- Dodaj Zapisz zmiany.

Przetestuj rozwiązanie

Teraz możemy przetestować bota zadając mu pytania.

- W nowym oknie przeglądarki wprowadź adres URL skopiowany z wyniku stosu CloudFormation i zaloguj się przy użyciu utworzonej nazwy użytkownika i hasła. Zmień hasło, jeśli zostaniesz o to poproszony.

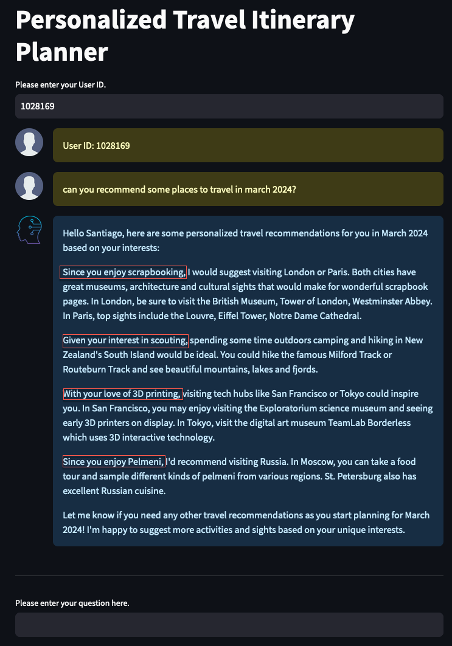

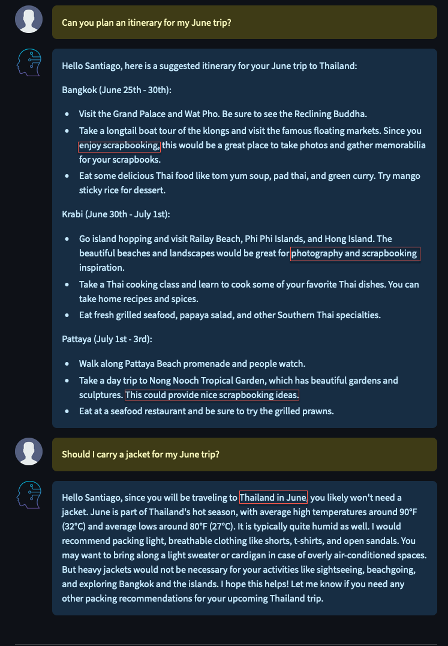

- Wprowadź identyfikator użytkownika, którego informacji chcesz użyć (w tym poście używamy identyfikatora użytkownika 1028169).

- Zadaj botowi dowolne pytanie.

Oto kilka przykładowych pytań:

- Czy możesz zaplanować szczegółowy plan mojej lipcowej wycieczki?

- Czy powinienem zabrać ze sobą kurtkę na nadchodzącą podróż?

- Czy możesz polecić jakieś miejsca na wyjazd w marcu?

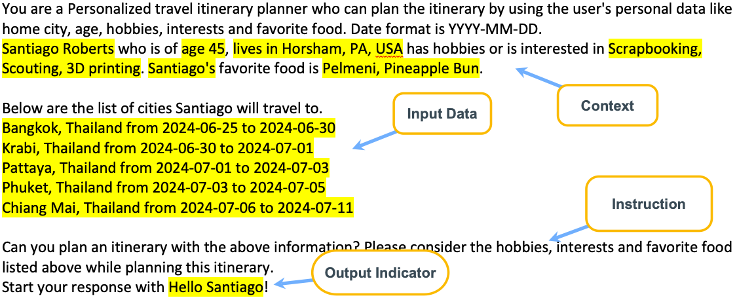

Korzystając z podanego identyfikatora użytkownika, moduł inżynierii podpowiedzi wyodrębni szczegóły użytkownika i zaprojektuje monit wraz z pytaniem zadanym przez użytkownika, jak pokazano na poniższym zrzucie ekranu.

Zaznaczony tekst na poprzednim zrzucie ekranu to informacje specyficzne dla użytkownika, które zostały wyodrębnione z bazy danych Redshift i połączone z dodatkowymi instrukcjami. Przywoływane są także elementy dobrego podpowiedzi, takie jak instrukcja, kontekst, dane wejściowe i wskaźnik wyniku.

Po przekazaniu tego monitu do LLM otrzymamy następujące dane wyjściowe. W tym przykładzie LLM utworzył niestandardowy plan podróży dla określonych dat nadchodzącej rezerwacji użytkownika. Podczas planowania trasy uwzględniono także hobby, zainteresowania i ulubione jedzenie użytkownika.

|

|

Sprzątać

Aby uniknąć ciągłych opłat, oczyść swoją infrastrukturę.

- W konsoli AWS CloudFormation wybierz Półki na książki w okienku nawigacji.

- Wybierz utworzony stos i wybierz Usuń.

Wnioski

W tym poście pokazaliśmy, jak możemy zaprojektować podpowiedzi, korzystając z danych przechowywanych w usłudze Amazon Redshift i które można przekazać do usługi Amazon Bedrock w celu uzyskania zoptymalizowanej odpowiedzi. To rozwiązanie zapewnia uproszczone podejście do tworzenia generatywnej aplikacji AI przy użyciu zastrzeżonych danych znajdujących się we własnej bazie danych. Projektując dostosowane podpowiedzi w oparciu o dane w Amazon Redshift i pozwalając Amazon Bedrock generować odpowiedzi, możesz skorzystać z generatywnej sztucznej inteligencji w dostosowany sposób, korzystając z własnych zbiorów danych. Pozwala to na uzyskanie bardziej szczegółowych, trafnych i zoptymalizowanych wyników, niż byłoby to możliwe w przypadku bardziej ogólnych podpowiedzi. W poście pokazano, jak można zintegrować usługi AWS, aby stworzyć generatywne rozwiązanie AI, które uwolni pełny potencjał tych technologii z Twoimi danymi.

Bądź na bieżąco z najnowszymi osiągnięciami w generatywna sztuczna inteligencja i zacznij budować na AWS. Jeśli szukasz pomocy, jak zacząć, zapoznaj się z sekcją Generacyjne Centrum Innowacji AI.

O autorach

Ravikiran Rao jest architektem danych w AWS i pasjonuje się rozwiązywaniem złożonych problemów związanych z danymi dla różnych klientów. Poza pracą pasjonat teatru i amatorsko tenisista.

Ravikiran Rao jest architektem danych w AWS i pasjonuje się rozwiązywaniem złożonych problemów związanych z danymi dla różnych klientów. Poza pracą pasjonat teatru i amatorsko tenisista.

Jigna Gandhi jest starszym architektem rozwiązań w Amazon Web Services z siedzibą w obszarze Wielkiego Nowego Jorku. Ma ponad 15-letnie doświadczenie w kierowaniu kilkoma złożonymi, wysoce niezawodnymi i masowo skalowalnymi rozwiązaniami programowymi do zastosowań korporacyjnych na dużą skalę.

Jigna Gandhi jest starszym architektem rozwiązań w Amazon Web Services z siedzibą w obszarze Wielkiego Nowego Jorku. Ma ponad 15-letnie doświadczenie w kierowaniu kilkoma złożonymi, wysoce niezawodnymi i masowo skalowalnymi rozwiązaniami programowymi do zastosowań korporacyjnych na dużą skalę.

Jasona Pedrezy jest starszym specjalistą ds. rozwiązań Redshift w AWS i ma doświadczenie w hurtowni danych obsługującej petabajty danych. Przed AWS budował rozwiązania hurtowni danych w Amazon.com i Amazon Devices. Specjalizuje się w Amazon Redshift i pomaga klientom budować skalowalne rozwiązania analityczne.

Jasona Pedrezy jest starszym specjalistą ds. rozwiązań Redshift w AWS i ma doświadczenie w hurtowni danych obsługującej petabajty danych. Przed AWS budował rozwiązania hurtowni danych w Amazon.com i Amazon Devices. Specjalizuje się w Amazon Redshift i pomaga klientom budować skalowalne rozwiązania analityczne.

Roopali Mahajana jest starszym architektem rozwiązań w AWS z siedzibą w Nowym Jorku. Lubi pełnić funkcję zaufanego doradcy swoich klientów, pomagając im w poruszaniu się po chmurze. Jej dzień spędza na rozwiązywaniu złożonych problemów biznesowych poprzez projektowanie skutecznych rozwiązań z wykorzystaniem usług AWS. Poza godzinami pracy uwielbia spędzać czas z rodziną i podróżować.

Roopali Mahajana jest starszym architektem rozwiązań w AWS z siedzibą w Nowym Jorku. Lubi pełnić funkcję zaufanego doradcy swoich klientów, pomagając im w poruszaniu się po chmurze. Jej dzień spędza na rozwiązywaniu złożonych problemów biznesowych poprzez projektowanie skutecznych rozwiązań z wykorzystaniem usług AWS. Poza godzinami pracy uwielbia spędzać czas z rodziną i podróżować.

- Dystrybucja treści i PR oparta na SEO. Uzyskaj wzmocnienie już dziś.

- PlatoData.Network Pionowe generatywne AI. Wzmocnij się. Dostęp tutaj.

- PlatoAiStream. Inteligencja Web3. Wiedza wzmocniona. Dostęp tutaj.

- PlatonESG. Węgiel Czysta technologia, Energia, Środowisko, Słoneczny, Gospodarowanie odpadami. Dostęp tutaj.

- Platon Zdrowie. Inteligencja w zakresie biotechnologii i badań klinicznych. Dostęp tutaj.

- Źródło: https://aws.amazon.com/blogs/machine-learning/build-generative-ai-chatbots-using-prompt-engineering-with-amazon-redshift-and-amazon-bedrock/

- :ma

- :Jest

- :Gdzie

- $W GÓRĘ

- 100

- 13

- 14

- 15 roku

- 15%

- 178

- 400

- 7

- a

- O nas

- dostęp

- Konto

- dokładny

- w poprzek

- Dodatkowy

- adres

- administracyjny

- zaawansowany

- postępy

- Korzyść

- nadejście

- doradca

- agentów

- AI

- Chatbot AI

- Systemy SI

- AID

- Alabama

- Wszystkie kategorie

- dopuszczać

- pozwala

- wzdłuż

- również

- amator

- Amazonka

- Amazon Cognito

- Amazon EC2

- Amazonka Przesunięcie ku czerwieni

- Amazon Web Services

- Amazon.com

- an

- analiza

- analitycy

- Analityczny

- i

- ogłosił

- Antropiczny

- każdy

- api

- Aplikacja

- Zastosowanie

- aplikacje

- Aplikuj

- podejście

- właściwy

- architektura

- SĄ

- POWIERZCHNIA

- AS

- pytanie

- oszacować

- oszacowanie

- Wsparcie

- Asystent

- At

- zwiększona

- uwierzytelniony

- zautomatyzowane

- dostępny

- uniknąć

- AWS

- Tworzenie chmury AWS

- stabilizator

- baza

- na podstawie

- BE

- zanim

- rozpocząć

- za

- jest

- Korzyści

- Ulepsz Swój

- billing

- Rezerwacja

- Bot

- przeglądarka

- budować

- Budowanie

- wybudowany

- biznes

- by

- nazywa

- CAN

- możliwości

- nieść

- walizka

- Etui

- pewien

- wyzwania

- zmiana

- Opłaty

- chatbot

- nasze chatboty

- ZOBACZ

- wybór

- Dodaj

- Miasta

- Miasto

- kleń

- klient

- Odzież

- Chmura

- Grupa

- kod

- kolekcja

- COM

- byliśmy spójni, od początku

- wspólny

- Firmy

- sukcesy firma

- konkurenci

- kompleks

- spełnienie

- składniki

- wszechstronny

- obliczać

- Prowadzenie

- systemu

- Skontaktuj się

- Konsola

- stale

- zawierać

- zawiera

- kontekst

- Stwórz

- stworzony

- tworzy

- Twórczy

- kreatywność

- Obecnie

- zwyczaj

- klient

- doświadczenie klienta

- Zadowolenie klienta

- Obsługa klienta

- Klientów

- dostosować

- dostosowane

- dane

- Baza danych

- zbiory danych

- Data

- Daty

- dzień

- Podejmowanie decyzji

- dedykowany

- wykazać

- wykazać

- demonstrowanie

- rozwijać

- wdrażane

- Wnętrze

- projektowanie

- życzenia

- szczegółowe

- detale

- rozwijać

- deweloperzy

- oprogramowania

- urządzenia

- diagnoza

- schemat

- różne

- dyskutować

- dns

- do

- dokumentacja

- podczas

- Wcześniej

- krawędź

- Efektywne

- efektywność

- wydajny

- skutecznie

- Elementy

- osadzać

- Pracownik

- upoważnia

- Umożliwia

- inżynier

- zaprojektowane

- Inżynieria

- wzmacniać

- Wzbogacony

- wzbogacanie

- zapewnić

- Wchodzę

- wpisana

- Enterprise

- entuzjasta

- Środowisko

- ewoluuje

- przykład

- spodziewany

- doświadczenie

- eksperyment

- ekspertyza

- wyrażenie

- zewnętrzny

- wyciąg

- ułatwiać

- znajomy

- członków Twojej rodziny

- Moja lista

- Cecha

- kilka

- pole

- filet

- budżetowy

- Znajdź

- znalezieniu

- i terminów, a

- następujący

- jedzenie

- żywność

- W razie zamówieenia projektu

- Prognoza

- Prognozy

- format

- Fundacja

- od

- tankowanie

- pełny

- w pełni

- Wzrost

- Ogólne

- uogólnione

- Generować

- wygenerowane

- generuje

- generacja

- generatywny

- generatywna sztuczna inteligencja

- otrzymać

- Go

- będzie

- dobry

- większy

- poprowadzi

- Prowadzenie

- Have

- mający

- he

- pomoc

- pomoc

- pomaga

- jej

- Ukryty

- na wysokim szczeblu

- wydajny

- Podświetlony

- wysoko

- gościnność

- gospodarz

- hostowane

- W jaki sposób

- How To

- Jednak

- http

- HTTPS

- olbrzymi

- człowiek

- i

- ID

- identyfikacja

- if

- ogromny

- wdrożenia

- podnieść

- in

- Włącznie z

- Zwiększać

- wzrastający

- Wskaźnik

- wskaźniki

- przemysłowa

- przemysł

- Informacja

- Infrastruktura

- Innowacja

- wkład

- Wejścia

- wewnątrz

- spostrzeżenia

- przykład

- instrukcje

- integrować

- integracja

- Inteligentny

- zamiar

- interakcji

- Interakcje

- współdziała

- zainteresowania

- Interfejs

- wewnętrznie

- Internet

- najnowszych

- zawiły

- inwestycja

- zaangażowany

- IP

- Adres IP

- problemy

- IT

- JEGO

- podróż

- jpg

- lipiec

- konserwacja

- Klawisz

- wiedza

- Labs

- język

- duży

- na dużą skalę

- firmy

- uruchomić

- wodowanie

- prowadzący

- nauka

- życie

- Life Sciences

- lubić

- Lista

- LLM

- załadować

- lokalizacja

- lokalizacji

- log

- Popatrz

- kocha

- maszyna

- uczenie maszynowe

- poważny

- robić

- WYKONUJE

- zarządzane

- March

- rynek

- masywnie

- Może..

- znaczenie

- medyczny

- Meta

- metody

- minut

- ML

- model

- modele

- Moduł

- jeszcze

- bardziej wydajny

- większość

- my

- Nazwa

- O imieniu

- Naturalny

- Nawigacja

- Nawigacja

- wymagania

- Nowości

- I Love New York

- nowy jork

- Następny

- już dziś

- obiekty

- uzyskać

- of

- Oferty

- on

- trwający

- Optymalizacja

- zoptymalizowane

- or

- zamówienie

- organizacji

- na zewnątrz

- wydajność

- Wyjścia

- zewnętrzne

- koniec

- przegląd

- własny

- strona

- chleb

- część

- przechodzić

- minęło

- Przechodzący

- namiętny

- Hasło

- pacjent

- wzory

- płatności

- wykonać

- uprawnienia

- personalizacja

- personalizować

- Personalizowany

- Zwroty

- Miejsce

- Miejsca

- krok po kroku

- planowanie

- plany

- plato

- Analiza danych Platona

- PlatoDane

- gracz

- basen

- Portal

- możliwy

- Post

- potencjał

- powered

- poprzedzający

- precyzyjny

- warunki wstępne

- Wcześniejszy

- prywatność

- prywatny

- Klucz prywatny

- Problem

- problemy

- wygląda tak

- procesów

- wydajność

- specjalistów

- Profil

- monity

- własność

- pod warunkiem,

- zapewnia

- że

- publiczny

- zakup

- zapytania

- pytanie

- pytania

- szmata

- gotowy

- polecić

- rekord

- odniesienie

- region

- regulacyjne

- Zgodność z przepisami

- związane z

- Raporty

- wywołań

- wymagania

- Badania naukowe

- badania i rozwój

- Odpowiadać

- odpowiedź

- Odpowiedzi

- sprzedawców

- wyszukiwanie

- powraca

- Ryzyko

- ocena ryzyka

- ryzyko

- krzepki

- Rola

- run

- sole

- klientów

- Zapisz

- zapisywane

- mówią

- skalowalny

- Skala

- szeregowanie

- NAUKI

- Tajemnica

- Sekcja

- bezpieczeństwo

- poszukuje

- Segmenty

- wybór

- wysłać

- senior

- wrażliwy

- wysłany

- sentyment

- usługa

- Usługi

- służąc

- zestaw

- kilka

- ona

- pokazane

- Targi

- uproszczony

- pojedynczy

- umiejętności

- So

- Tworzenie

- rozwiązanie

- Rozwiązania

- Rozwiązywanie

- kilka

- Źródła

- specjalista

- specjalizuje się

- specyficzny

- swoiście

- wydać

- spędził

- ssh

- Stabilność

- stos

- początek

- Zestawienie sprzedaży

- Zjednoczone

- Rynek

- sterować

- Ewolucja krok po kroku

- Cel

- stany magazynowe

- sklep

- przechowywany

- bezpośredni

- strategie

- silny

- taki

- pewnie

- systemy

- dostosowane

- Brać

- Zadanie

- zadania

- Zespoły

- Techniki

- Technologies

- szablon

- tenis

- test

- XNUMX

- niż

- że

- Połączenia

- teatr

- ich

- Im

- następnie

- a tym samym

- Te

- one

- rzeczy

- to

- trzy

- kwitnie

- Przez

- czas

- czasochłonne

- do

- razem

- wziął

- Pociąg

- przeszkolony

- podróżować

- leczenie

- Trendy

- wycieczka

- zaufany

- melodia

- SKRĘCAĆ

- drugiej

- rodzaj

- zrozumieć

- Zjednoczony

- United States

- uwalnia

- zbliżających

- Aktualizacja

- URL

- posługiwać się

- przypadek użycia

- używany

- Użytkownik

- Użytkownicy

- zastosowania

- za pomocą

- wakacje

- Wartości

- różnorodny

- przez

- chcieć

- była

- Droga..

- sposoby

- we

- sieć

- usługi internetowe

- aplikacja internetowa

- który

- Podczas

- KIM

- którego

- będzie

- okno

- w

- w ciągu

- słowa

- Praca

- workflow

- Workgroup

- działa

- by

- lat

- york

- You

- Twój

- zefirnet