Jesteśmy świadkami szybkiego wzrostu stosowania dużych modeli językowych (LLM), które wspierają generatywne aplikacje AI w różnych branżach. LLM są w stanie wykonywać różnorodne zadania, takie jak generowanie kreatywnych treści, odpowiadanie na zapytania za pośrednictwem chatbotów, generowanie kodu i nie tylko.

Organizacje, które chcą wykorzystywać LLM do zasilania swoich aplikacji, coraz bardziej ostrożnie podchodzą do prywatności danych, aby zapewnić utrzymanie zaufania i bezpieczeństwa w swoich generatywnych aplikacjach AI. Obejmuje to prawidłowe przetwarzanie danych osobowych klientów. Obejmuje to także zapobieganie rozpowszechnianiu obraźliwych i niebezpiecznych treści w LLM oraz sprawdzanie, czy dane generowane przez LLM podlegają tym samym zasadom.

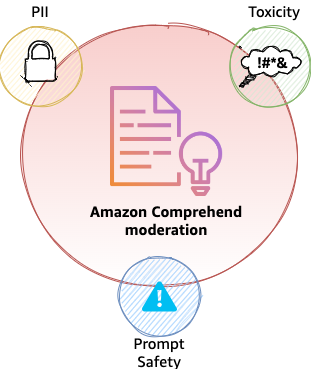

W tym poście omawiamy nowe funkcje obsługiwane przez Amazon Comprehend które umożliwiają bezproblemową integrację w celu zapewnienia prywatności danych, bezpieczeństwa treści i szybkiego bezpieczeństwa w nowych i istniejących aplikacjach generatywnej sztucznej inteligencji.

Amazon Comprehend to usługa przetwarzania języka naturalnego (NLP), która wykorzystuje uczenie maszynowe (ML) do odkrywania informacji w nieustrukturyzowanych danych i tekście w dokumentach. W tym poście omawiamy, dlaczego zaufanie i bezpieczeństwo w przypadku LLM są ważne dla Twoich obciążeń. Zagłębiamy się także w sposób, w jaki te nowe możliwości moderacji są wykorzystywane w popularnym środowisku rozwoju generatywnej sztucznej inteligencji LangChain aby wprowadzić konfigurowalny mechanizm zaufania i bezpieczeństwa dla Twojego przypadku użycia.

Dlaczego zaufanie i bezpieczeństwo w LLM są tak ważne?

Zaufanie i bezpieczeństwo są najważniejsze podczas pracy z LLM ze względu na ich ogromny wpływ na szeroką gamę aplikacji, od chatbotów obsługi klienta po generowanie treści. Ponieważ modele te przetwarzają ogromne ilości danych i generują reakcje podobne do ludzkich, wzrasta ryzyko niewłaściwego użycia lub niezamierzonych wyników. Zapewnienie działania tych systemów sztucznej inteligencji w granicach etycznych i niezawodnych ma kluczowe znaczenie nie tylko dla reputacji przedsiębiorstw, które z nich korzystają, ale także dla zachowania zaufania użytkowników końcowych i klientów.

Co więcej, w miarę jak LLM stają się coraz bardziej zintegrowane z naszymi codziennymi doświadczeniami cyfrowymi, ich wpływ na nasze postrzeganie, przekonania i decyzje rośnie. Zapewnienie zaufania i bezpieczeństwa dzięki LLM wykracza poza zwykłe środki techniczne; mówi o szerszej odpowiedzialności specjalistów i organizacji zajmujących się sztuczną inteligencją za przestrzeganie standardów etycznych. Stawiając na pierwszym miejscu zaufanie i bezpieczeństwo, organizacje nie tylko chronią swoich użytkowników, ale także zapewniają zrównoważony i odpowiedzialny rozwój sztucznej inteligencji w społeczeństwie. Może również pomóc zmniejszyć ryzyko generowania szkodliwych treści i pomóc w przestrzeganiu wymogów prawnych.

W dziedzinie zaufania i bezpieczeństwa moderowanie treści to mechanizm, który dotyczy różnych aspektów, w tym między innymi:

- Prywatności – Użytkownicy mogą niechcący podać tekst zawierający poufne informacje, zagrażając ich prywatności. Wykrywanie i redagowanie wszelkich informacji umożliwiających identyfikację jest niezbędne.

- Toksyczność – Rozpoznawanie i filtrowanie szkodliwych treści, takich jak mowa nienawiści, groźby lub nadużycia, jest sprawą najwyższej wagi.

- Intencja użytkownika – Określenie, czy dane wejściowe użytkownika (podpowiedź) są bezpieczne, czy niebezpieczne, ma kluczowe znaczenie. Niebezpieczne monity mogą w sposób wyraźny lub dorozumiany wyrażać złośliwe zamiary, takie jak żądanie informacji osobistych lub prywatnych oraz generowanie treści obraźliwych, dyskryminujących lub nielegalnych. Podpowiedzi mogą również w sposób dorozumiany wyrażać porady dotyczące kwestii medycznych, prawnych, politycznych, kontrowersyjnych, osobistych lub finansowych lub prosić o nie

Moderowanie treści za pomocą Amazon Comrehend

W tej sekcji omawiamy korzyści płynące z moderowania treści za pomocą Amazon Comprehend.

Zajmowanie się prywatnością

Amazon Comprehend już uwzględnia kwestię prywatności dzięki istniejącym możliwościom wykrywania i redagowania danych osobowych za pośrednictwem WykryjPIIEntities i Zawiera PIIEntities Pszczoła. Te dwa interfejsy API są wspierane przez modele NLP, które mogą wykryć dużą liczbę jednostek umożliwiających identyfikację, takich jak numery ubezpieczenia społecznego (SSN), numery kart kredytowych, nazwiska, adresy, numery telefonów i tak dalej. Aby zapoznać się z pełną listą podmiotów, zobacz Uniwersalne typy podmiotów umożliwiających identyfikację osób. DetectPII zapewnia również pozycję elementu PII na poziomie znaku w tekście; na przykład pozycja znaku początkowego elementu NAZWA (John Doe) w zdaniu „My name is Joch, zróbe” wynosi 12, a pozycja znaku końcowego to 19. Przesunięcia te można wykorzystać do maskowania lub redagowania wartości, zmniejszając w ten sposób ryzyko propagacji prywatnych danych do LLM.

Rozwiązanie problemu toksyczności i natychmiastowe zapewnienie bezpieczeństwa

Dzisiaj ogłaszamy dwie nowe funkcje Amazon Comprehend w postaci interfejsów API: Wykrywanie toksyczności za pośrednictwem DetectToxicContent API i szybką klasyfikację bezpieczeństwa poprzez ClassifyDocument API. Należy pamiętać, że DetectToxicContent to nowe API, natomiast ClassifyDocument to istniejący interfejs API, który teraz obsługuje szybką klasyfikację bezpieczeństwa.

Wykrywanie toksyczności

Dzięki wykrywaniu toksyczności Amazon Comprehend możesz identyfikować i oznaczać treści, które mogą być szkodliwe, obraźliwe lub nieodpowiednie. Ta funkcja jest szczególnie cenna w przypadku platform, na których użytkownicy generują treści, takich jak serwisy społecznościowe, fora, chatboty, sekcje komentarzy i aplikacje korzystające z LLM do generowania treści. Podstawowym celem jest utrzymanie pozytywnego i bezpiecznego środowiska poprzez zapobieganie rozprzestrzenianiu się toksycznych treści.

Podstawą modelu wykrywania toksyczności jest analiza tekstu w celu określenia prawdopodobieństwa, że zawiera on treści szerzące nienawiść, groźby, wulgaryzmy lub inne formy szkodliwego tekstu. Model jest szkolony na rozległych zbiorach danych zawierających przykłady zawartości zarówno toksycznej, jak i nietoksycznej. Interfejs API toksyczności ocenia dany fragment tekstu, aby zapewnić klasyfikację toksyczności i poziom pewności. Aplikacje generujące sztuczną inteligencję mogą następnie wykorzystać te informacje do podjęcia odpowiednich działań, takich jak zatrzymanie propagacji tekstu do LLM. W chwili pisania tego tekstu etykiety wykrywane przez interfejs API wykrywania toksyczności to: HATE_SPEECH, GRAPHIC, HARRASMENT_OR_ABUSE, SEXUAL, VIOLENCE_OR_THREAT, INSULT, PROFANITY. Poniższy kod demonstruje wywołanie API za pomocą Pythona Boto3 w celu wykrywania toksyczności Amazon Comrehend:

Szybka klasyfikacja bezpieczeństwa

Szybka klasyfikacja bezpieczeństwa za pomocą Amazon Comprehend pomaga sklasyfikować zachętę tekstową jako bezpieczną lub niebezpieczną. Ta funkcja jest kluczowa w przypadku aplikacji takich jak chatboty, wirtualni asystenci lub narzędzia do moderowania treści, w których zrozumienie bezpieczeństwa podpowiedzi może określić reakcje, działania lub propagację treści do LLM.

Zasadniczo szybka klasyfikacja bezpieczeństwa analizuje wkład człowieka pod kątem wszelkich wyraźnych lub ukrytych złośliwych zamiarów, takich jak żądanie informacji osobistych lub prywatnych oraz generowanie obraźliwych, dyskryminujących lub nielegalnych treści. Oznacza także podpowiedzi dotyczące szukania porad na tematy medyczne, prawne, polityczne, kontrowersyjne, osobiste lub finansowe. Szybka klasyfikacja zwraca dwie klasy, UNSAFE_PROMPT i SAFE_PROMPT, dla powiązanego tekstu, z powiązanym poziomem pewności dla każdego. Wynik zaufania mieści się w przedziale 0–1, a jego suma daje 1. Na przykład w chatbocie obsługi klienta tekst „Jak zresetować hasło?” sygnalizuje zamiar zasięgnięcia wskazówek dotyczących procedur resetowania hasła i jest oznaczony jako SAFE_PROMPT. Podobnie stwierdzenie typu „Chciałbym, żeby przydarzyło ci się coś złego” może zostać oznaczony jako mający potencjalnie szkodliwe zamiary i oznaczony jako UNSAFE_PROMPT. Należy zauważyć, że szybka klasyfikacja bezpieczeństwa koncentruje się przede wszystkim na wykrywaniu intencji na podstawie danych wejściowych człowieka (podpowiedzi), a nie tekstu wygenerowanego maszynowo (wyjścia LLM). Poniższy kod ilustruje sposób uzyskania dostępu do funkcji szybkiej klasyfikacji bezpieczeństwa za pomocą narzędzia ClassifyDocument OGIEŃ:

Należy pamiętać, że endpoint_arn w poprzednim kodzie jest dostarczany przez AWS Numer zasobu Amazona (ARN) wzoru arn:aws:comprehend:<region>:aws:document-classifier-endpoint/prompt-safety, Gdzie <region> to wybrany przez Ciebie region AWS, gdzie Usługa Amazon Comrehend jest dostępna.

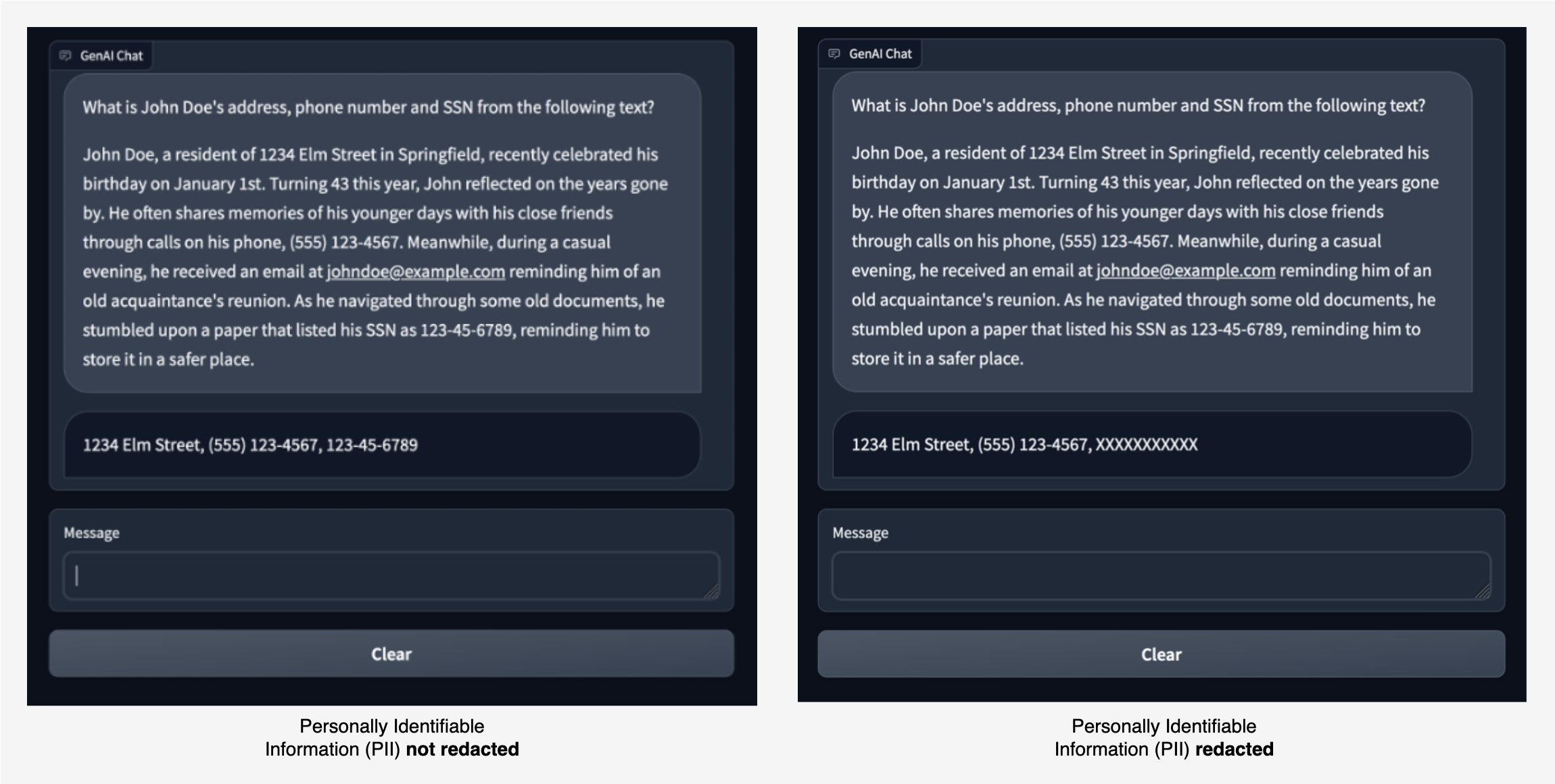

Aby zademonstrować te możliwości, zbudowaliśmy przykładową aplikację do czatu, w której prosimy LLM o wyodrębnienie z danego fragmentu tekstu elementów umożliwiających identyfikację osób, takich jak adres, numer telefonu i numer SSN. LLM znajduje i zwraca odpowiednie jednostki PII, jak pokazano na obrazku po lewej stronie.

Dzięki moderacji Amazon Comprehend możemy zredagować dane wejściowe do LLM i dane wyjściowe z LLM. Na obrazku po prawej stronie wartość SSN może zostać przekazana do LLM bez redakcji. Jednakże każda wartość SSN w odpowiedzi LLM jest redagowana.

Poniżej znajduje się przykład, w jaki sposób można całkowicie uniemożliwić dotarcie monitu zawierającego informacje umożliwiające identyfikację użytkownika do LLM. Ten przykład pokazuje, jak użytkownik zadaje pytanie zawierające informacje umożliwiające identyfikację użytkownika. Korzystamy z moderacji Amazon Comprehend, aby wykryć w monicie podmioty umożliwiające identyfikację osób i wyświetlić błąd, przerywając przepływ.

Powyższe przykłady czatów pokazują, jak moderacja Amazon Comrehend nakłada ograniczenia na wysyłanie danych do LLM. W poniższych sekcjach wyjaśniamy, jak ten mechanizm moderacji jest wdrażany za pomocą LangChain.

Integracja z LangChainem

Dzięki nieograniczonym możliwościom zastosowania LLM w różnych przypadkach użycia równie ważne stało się uproszczenie rozwoju generatywnych aplikacji AI. LangChain to popularna platforma open source, która ułatwia tworzenie generatywnych aplikacji AI. Moderacja Amazon Comprehend rozszerza platformę LangChain, oferując identyfikację i redakcję danych osobowych, wykrywanie toksyczności oraz możliwości szybkiej klasyfikacji bezpieczeństwa za pośrednictwem AmazonComprehendModerationChain.

AmazonComprehendModerationChain jest niestandardową implementacją Łańcuch podstawowy LangChain interfejs. Oznacza to, że aplikacje mogą używać tego łańcucha z własnym Łańcuchy LLM aby zastosować żądaną moderację do monitu wejściowego, a także do tekstu wyjściowego z LLM. Łańcuchy można budować łącząc wiele łańcuchów lub mieszając łańcuchy z innymi komponentami. Możesz użyć AmazonComprehendModerationChain z innymi łańcuchami LLM w celu opracowywania złożonych aplikacji AI w sposób modułowy i elastyczny.

Aby to lepiej wyjaśnić, w poniższych sekcjach podajemy kilka przykładów. Kod źródłowy dla AmazonComprehendModerationChain implementację można znaleźć w pliku Repozytorium open source LangChain. Pełną dokumentację interfejsu API można znaleźć w dokumentacji LangChain API dla Łańcuch moderacji Amazon Comrehend. Korzystanie z tego łańcucha moderacji jest tak proste, jak inicjowanie instancji klasy z domyślnymi konfiguracjami:

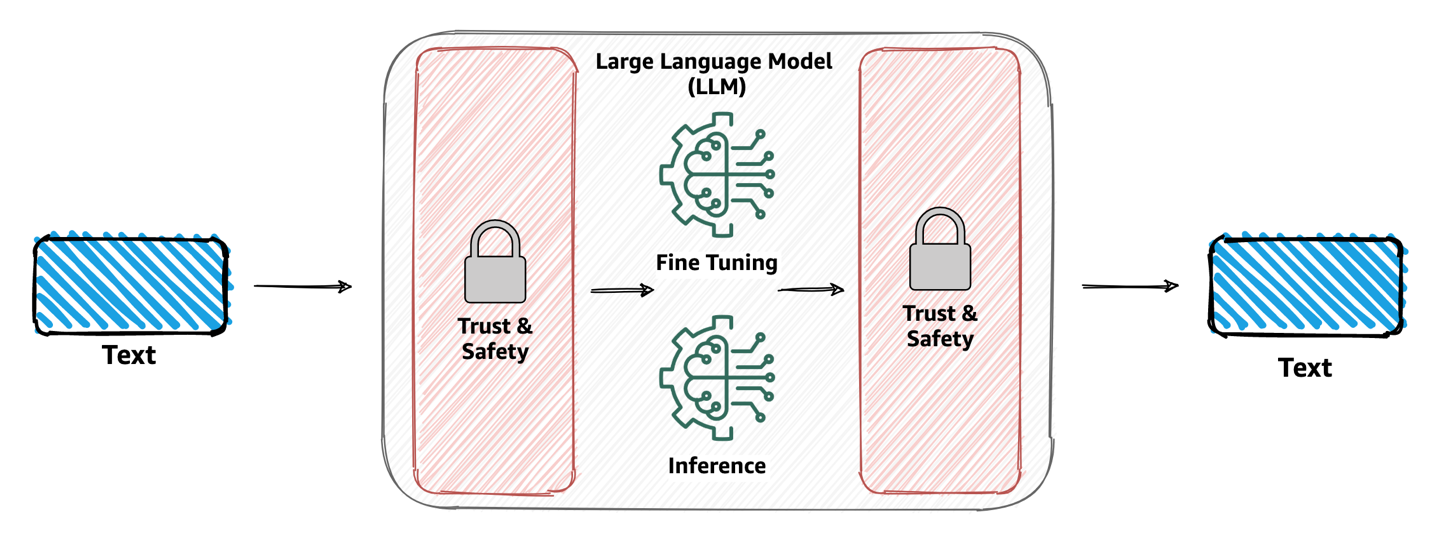

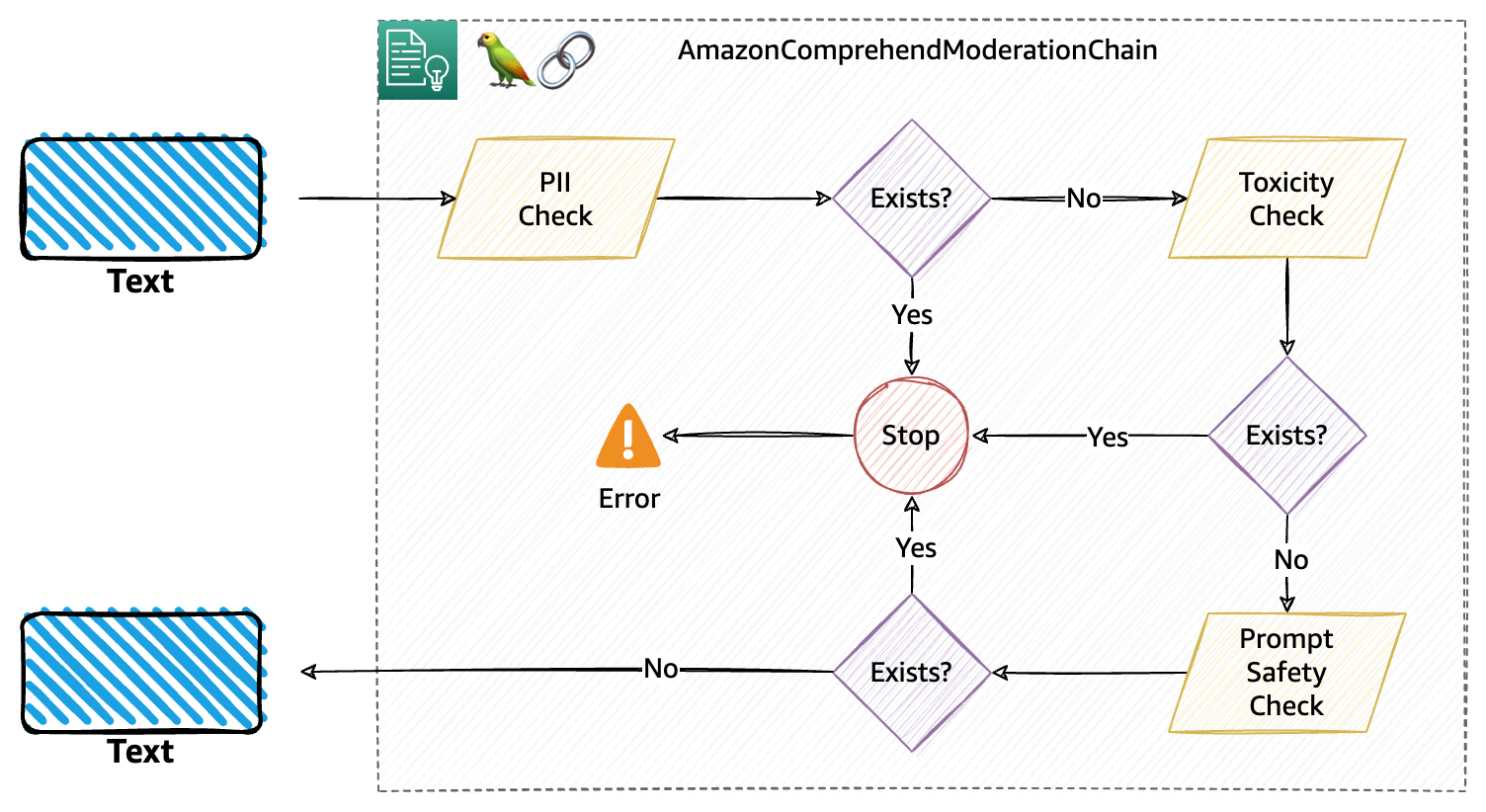

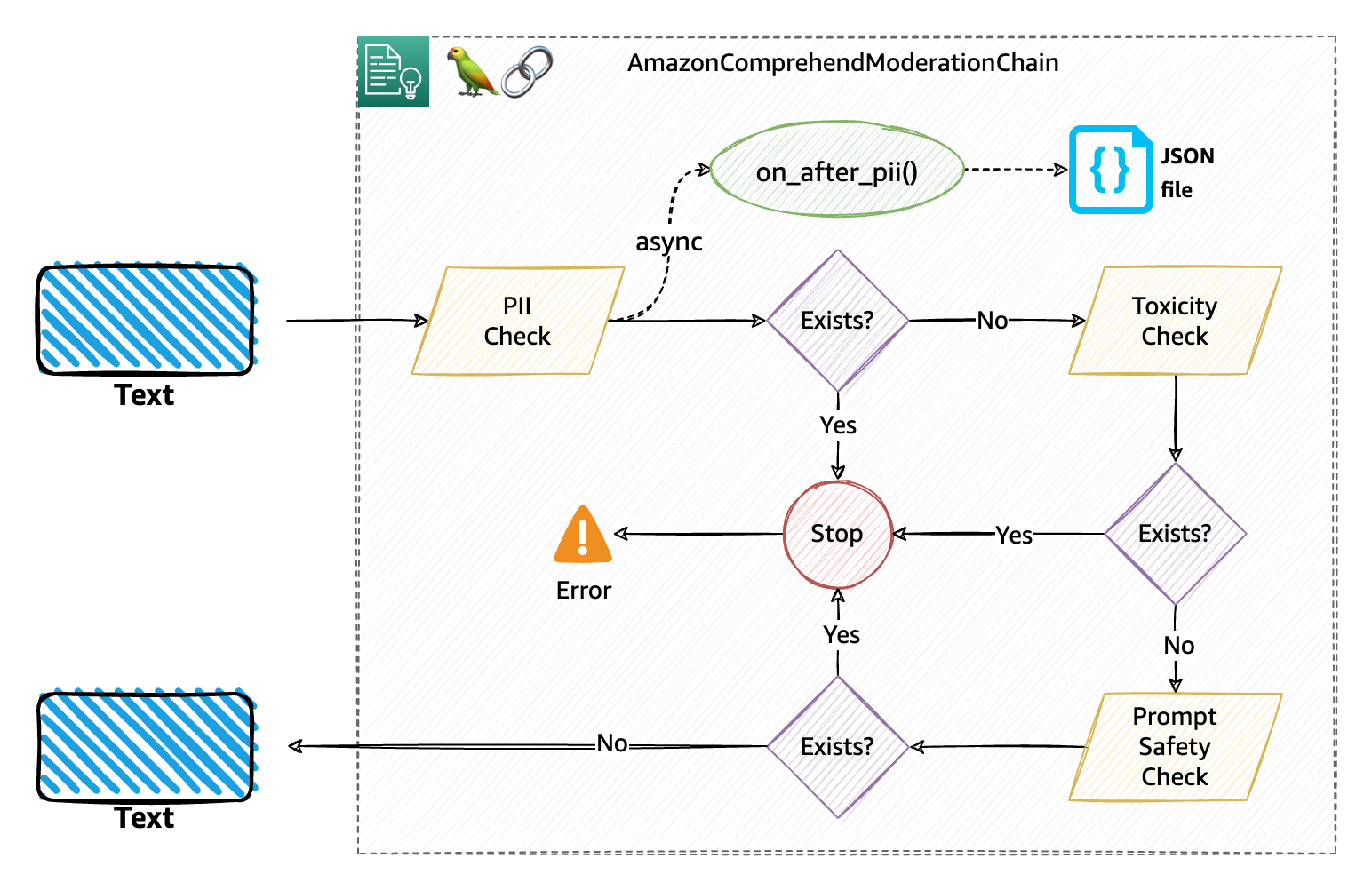

Za kulisami łańcuch moderacji przeprowadza trzy kolejne kontrole moderacji, a mianowicie informacje umożliwiające identyfikację, toksyczność i natychmiastowe bezpieczeństwo, jak wyjaśniono na poniższym schemacie. Jest to domyślny przepływ moderacji.

Poniższy fragment kodu przedstawia prosty przykład użycia łańcucha moderacji z plikiem Amazon FalconLite LLM (która jest skwantyzowaną wersją Model Falcona 40B SFT OASST-TOP1) hostowane w Hugging Face Hub:

W poprzednim przykładzie rozszerzamy nasz łańcuch o comprehend_moderation zarówno dla tekstu trafiającego do LLM, jak i tekstu generowanego przez LLM. Spowoduje to wykonanie domyślnej moderacji, która sprawdzi informacje umożliwiające identyfikację, toksyczność i wyświetli monit o klasyfikację bezpieczeństwa w tej kolejności.

Dostosuj moderację za pomocą konfiguracji filtrów

Możesz użyć AmazonComprehendModerationChain z określonymi konfiguracjami, co daje możliwość kontrolowania, jakie moderacje chcesz wykonać w swojej generatywnej aplikacji opartej na sztucznej inteligencji. W rdzeniu konfiguracji dostępne są trzy konfiguracje filtrów.

- ModeracjaPiiConfig – Służy do konfigurowania filtra PII.

- ModeracjaToksycznośćConfig – Służy do konfigurowania filtra zawartości toksycznej.

- ModeracjaIntentConfig – Służy do konfigurowania filtra intencji.

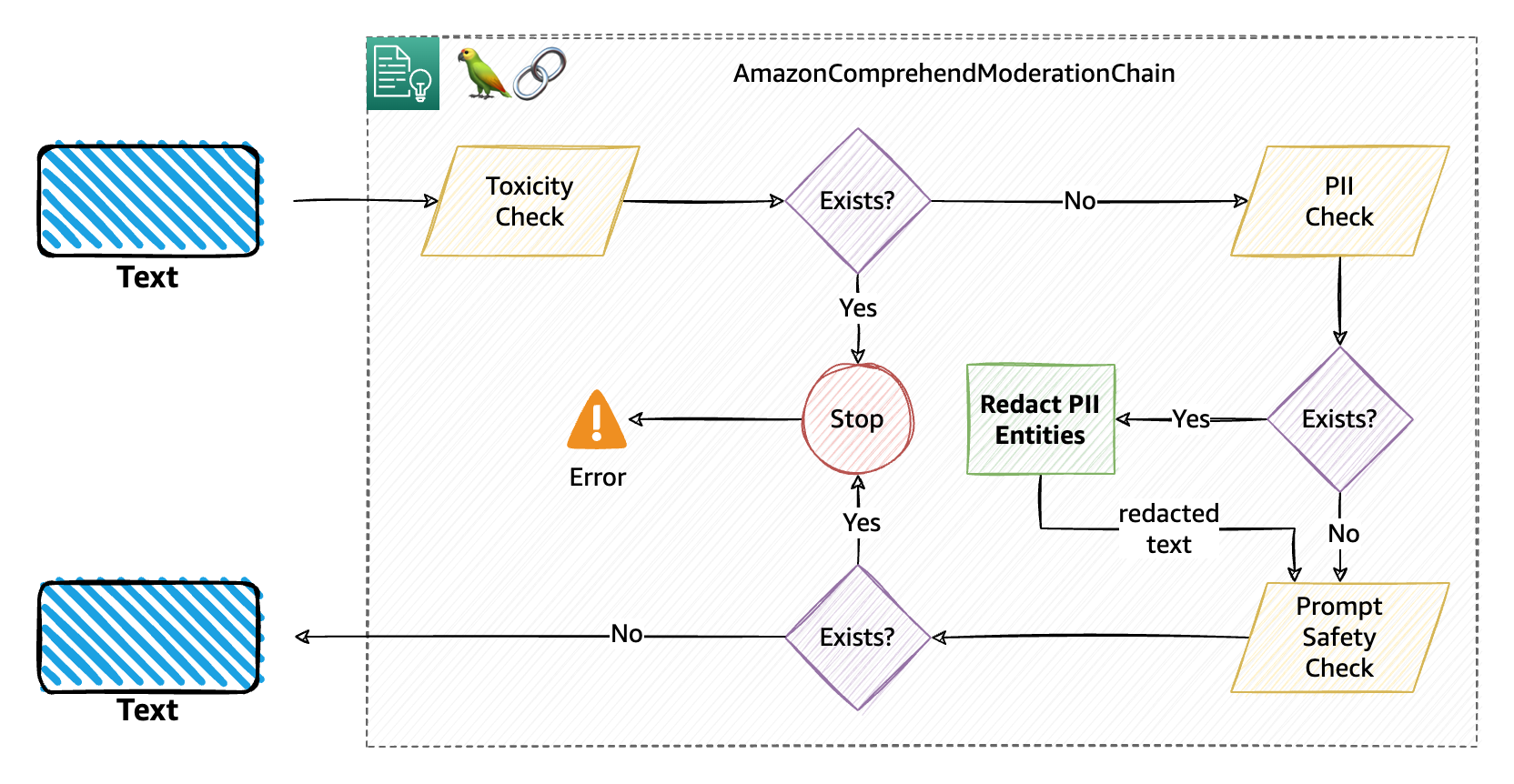

Możesz użyć każdej z tych konfiguracji filtrów, aby dostosować zachowanie moderacji. Konfiguracje każdego filtra mają kilka wspólnych parametrów i kilka unikalnych parametrów, którymi można je zainicjować. Po zdefiniowaniu konfiguracji należy użyć metody BaseModerationConfig class, aby zdefiniować kolejność, w jakiej filtry muszą być stosowane do tekstu. Na przykład w poniższym kodzie najpierw definiujemy trzy konfiguracje filtrów, a następnie określamy kolejność, w jakiej muszą być stosowane:

Zagłębmy się nieco głębiej, aby zrozumieć, co osiąga ta konfiguracja:

- Po pierwsze, dla filtra toksyczności określiliśmy próg 0.6. Oznacza to, że jeśli w tekście znajdzie się któraś z dostępnych toksycznych etykiet lub bytów z wynikiem większym niż próg, cały łańcuch zostanie przerwany.

- Jeśli w tekście nie ma toksycznych treści, sprawdzana jest informacja PII. W tym przypadku jesteśmy zainteresowani sprawdzeniem, czy tekst zawiera wartości SSN. Ponieważ

redactparametr jest ustawiony naTrue, łańcuch będzie maskował wykryte wartości SSN (jeśli istnieją), jeśli wynik zaufania jednostki SSN jest większy lub równy 0.5, z określonym znakiem maski (X). Jeśliredactjest ustawione naFalse, łańcuch zostanie przerwany w przypadku wykrycia dowolnego numeru SSN. - Na koniec łańcuch dokonuje natychmiastowej klasyfikacji bezpieczeństwa i zatrzymuje treści przed rozprzestrzenianiem się w dół łańcucha, jeśli zostaną one sklasyfikowane za pomocą

UNSAFE_PROMPTz wynikiem pewności większym lub równym 0.8.

Poniższy diagram ilustruje ten przepływ pracy.

W przypadku przerw w łańcuchu moderacji (w tym przykładzie dotyczy to filtrów toksyczności i natychmiastowej klasyfikacji bezpieczeństwa), łańcuch podniesie Wyjątek w Pythonie, zasadniczo zatrzymując trwający łańcuch i umożliwiając przechwycenie wyjątku (w bloku try-catch) i wykonanie dowolnej odpowiedniej akcji. Trzy możliwe typy wyjątków to:

ModerationPIIErrorModerationToxicityErrorModerationPromptSafetyError

Za pomocą można skonfigurować jeden filtr lub więcej niż jeden filtr BaseModerationConfig. W ramach tego samego łańcucha można także stosować filtry tego samego typu z różnymi konfiguracjami. Na przykład, jeśli Twój przypadek użycia dotyczy tylko informacji umożliwiających identyfikację, możesz określić konfigurację, która musi przerwać łańcuch w przypadku wykrycia numeru SSN; w przeciwnym razie musi dokonać redakcji informacji o wieku i nazwie podmiotów umożliwiających identyfikację. Konfigurację tego można zdefiniować w następujący sposób:

Korzystanie z wywołań zwrotnych i unikalnych identyfikatorów

Jeśli znasz koncepcję przepływów pracy, być może znasz ją również oddzwanianie. Wywołania zwrotne w przepływach pracy to niezależne fragmenty kodu uruchamiane po spełnieniu określonych warunków w przepływie pracy. Wywołanie zwrotne może blokować lub nie blokować przepływu pracy. Łańcuchy LangChain to w istocie przepływy pracy dla LLM. AmazonComprehendModerationChain pozwala na zdefiniowanie własnych funkcji wywołania zwrotnego. Początkowo implementacja ogranicza się wyłącznie do asynchronicznych (nieblokujących) funkcji wywołania zwrotnego.

To w praktyce oznacza, że jeśli użyjesz wywołań zwrotnych w łańcuchu moderacji, będą one działać niezależnie od działania łańcucha, bez jego blokowania. W przypadku łańcucha moderacji dostępne są opcje uruchamiania fragmentów kodu z dowolną logiką biznesową po uruchomieniu każdej moderacji, niezależnie od łańcucha.

Opcjonalnie możesz także podać dowolny unikalny ciąg znaków identyfikacyjnych podczas tworzenia pliku AmazonComprehendModerationChain aby umożliwić późniejsze rejestrowanie i analizę. Na przykład, jeśli używasz chatbota opartego na LLM, możesz chcieć śledzić użytkowników, którzy konsekwentnie dopuszczają się przemocy lub celowo lub nieświadomie ujawniają dane osobowe. W takich przypadkach konieczne staje się śledzenie pochodzenia takich podpowiedzi i być może przechowywanie ich w bazie danych lub odpowiednie rejestrowanie w celu podjęcia dalszych działań. Można przekazać unikalny identyfikator, który wyraźnie identyfikuje użytkownika, na przykład jego nazwę użytkownika lub adres e-mail albo nazwę aplikacji generującej monit.

Połączenie wywołań zwrotnych i unikalnych identyfikatorów zapewnia skuteczny sposób na wdrożenie łańcucha moderacji, który pasuje do Twojego przypadku użycia w znacznie bardziej spójny sposób z mniejszą ilością kodu i łatwiejszym w utrzymaniu. Procedura obsługi wywołania zwrotnego jest dostępna poprzez BaseModerationCallbackHandler, z trzema dostępnymi wywołaniami zwrotnymi: on_after_pii(), on_after_toxicity(), on_after_prompt_safety(). Każda z tych funkcji wywołania zwrotnego jest wywoływana asynchronicznie po przeprowadzeniu odpowiedniej kontroli moderacji w łańcuchu. Funkcje te otrzymują również dwa parametry domyślne:

- moderation_beacon – Słownik zawierający szczegółowe informacje, takie jak tekst, na którym przeprowadzono moderację, pełne wyjście JSON z API Amazon Comprehend, rodzaj moderacji oraz to, czy dostarczone etykiety (w konfiguracji) znalazły się w tekście, czy nie

- unikalny identyfikator – Unikalny identyfikator przypisany podczas inicjowania instancji

AmazonComprehendModerationChain.

Poniżej znajduje się przykład działania implementacji z wywołaniem zwrotnym. W tym przypadku zdefiniowaliśmy pojedyncze wywołanie zwrotne, które chcemy, aby łańcuch był uruchamiany po przeprowadzeniu kontroli PII:

Następnie używamy my_callback obiekt podczas inicjowania łańcucha moderacji, a także przekazać a unique_id. Możesz używać wywołań zwrotnych i unikalnych identyfikatorów z konfiguracją lub bez. Kiedy tworzysz podklasę BaseModerationCallbackHandler, musisz zaimplementować jedną lub wszystkie metody wywołania zwrotnego, w zależności od filtrów, których zamierzasz używać. Dla zwięzłości poniższy przykład pokazuje sposób użycia wywołań zwrotnych i unique_id bez żadnej konfiguracji:

Poniższy diagram wyjaśnia, jak działa ten łańcuch moderacji z wywołaniami zwrotnymi i unikalnymi identyfikatorami. W szczególności zaimplementowaliśmy wywołanie zwrotne PII, które powinno zapisać plik JSON z danymi dostępnymi w pliku moderation_beacon oraz unique_id przeszedł (w tym przypadku adres e-mail użytkownika).

W następujących Notatnik Pythona, zebraliśmy kilka różnych sposobów konfiguracji i korzystania z łańcucha moderacji z różnymi LLM, takimi jak LLM hostowane Amazon SageMaker JumpStart i gościł w Przytulanie twarzy Hub. Dołączyliśmy także przykładową aplikację do czatu, którą omawialiśmy wcześniej, poniżej Notatnik Pythona.

Wnioski

Potencjał transformacyjny dużych modeli językowych i generatywnej sztucznej inteligencji jest niezaprzeczalny. Jednakże ich odpowiedzialne i etyczne stosowanie zależy od rozwiązania kwestii zaufania i bezpieczeństwa. Dostrzegając wyzwania i aktywnie wdrażając środki łagodzące ryzyko, programiści, organizacje i całe społeczeństwo mogą wykorzystać zalety tych technologii, zachowując jednocześnie zaufanie i bezpieczeństwo, które stanowią podstawę ich pomyślnej integracji. Użyj Amazon Comprehend ContentModerationChain, aby dodać funkcje zaufania i bezpieczeństwa do dowolnego przepływu pracy LLM, w tym przepływów pracy Retrieval Augmented Generation (RAG) zaimplementowanych w LangChain.

Aby uzyskać informacje na temat tworzenia rozwiązań opartych na RAG przy użyciu bardzo dokładnego, opartego na uczeniu maszynowym (ML) LangChain i Amazon Kendra inteligentne wyszukiwanie, Widzieć - Szybko twórz aplikacje generatywnej sztucznej inteligencji o wysokiej dokładności na danych korporacyjnych przy użyciu Amazon Kendra, LangChain i dużych modeli językowych. W następnym kroku zapoznaj się z próbki kodu stworzyliśmy do korzystania z moderacji Amazon Comrehend z LangChain. Pełną dokumentację interfejsu API łańcucha moderacji Amazon Comprehend można znaleźć w LangChain Dokumentacja API.

O autorach

Wricka Talukdara jest starszym architektem w zespole Amazon Comprehend Service. Współpracuje z klientami AWS, aby pomóc im wdrożyć uczenie maszynowe na dużą skalę. Poza pracą lubi czytać i fotografować.

Wricka Talukdara jest starszym architektem w zespole Amazon Comprehend Service. Współpracuje z klientami AWS, aby pomóc im wdrożyć uczenie maszynowe na dużą skalę. Poza pracą lubi czytać i fotografować.

Anjana Biswasa jest starszym architektem rozwiązań usług AI ze szczególnym uwzględnieniem AI/ML i analizy danych. Anjan jest częścią ogólnoświatowego zespołu usług AI i współpracuje z klientami, pomagając im zrozumieć i opracować rozwiązania problemów biznesowych związanych ze sztuczną inteligencją i uczeniem się. Anjan ma ponad 14-letnie doświadczenie w pracy z globalnymi organizacjami zajmującymi się łańcuchem dostaw, produkcją i sprzedażą detaliczną oraz aktywnie pomaga klientom rozpocząć i skalować usługi AWS AI.

Anjana Biswasa jest starszym architektem rozwiązań usług AI ze szczególnym uwzględnieniem AI/ML i analizy danych. Anjan jest częścią ogólnoświatowego zespołu usług AI i współpracuje z klientami, pomagając im zrozumieć i opracować rozwiązania problemów biznesowych związanych ze sztuczną inteligencją i uczeniem się. Anjan ma ponad 14-letnie doświadczenie w pracy z globalnymi organizacjami zajmującymi się łańcuchem dostaw, produkcją i sprzedażą detaliczną oraz aktywnie pomaga klientom rozpocząć i skalować usługi AWS AI.

Nikhil Jha jest starszym kierownikiem ds. obsługi klienta w Amazon Web Services. Jego obszary zainteresowania obejmują AI/ML i analitykę. W wolnym czasie lubi grać z córką w badmintona i zwiedzać plener.

Nikhil Jha jest starszym kierownikiem ds. obsługi klienta w Amazon Web Services. Jego obszary zainteresowania obejmują AI/ML i analitykę. W wolnym czasie lubi grać z córką w badmintona i zwiedzać plener.

Podbródek jest specjalistą ds. rozwiązań AI/ML w Amazon Web Services. Pasjonatka matematyki stosowanej i uczenia maszynowego. Koncentruje się na projektowaniu inteligentnych rozwiązań przetwarzania dokumentów dla klientów AWS. Poza pracą lubi tańczyć salsę i bachatę.

Podbródek jest specjalistą ds. rozwiązań AI/ML w Amazon Web Services. Pasjonatka matematyki stosowanej i uczenia maszynowego. Koncentruje się na projektowaniu inteligentnych rozwiązań przetwarzania dokumentów dla klientów AWS. Poza pracą lubi tańczyć salsę i bachatę.

- Dystrybucja treści i PR oparta na SEO. Uzyskaj wzmocnienie już dziś.

- PlatoData.Network Pionowe generatywne AI. Wzmocnij się. Dostęp tutaj.

- PlatoAiStream. Inteligencja Web3. Wiedza wzmocniona. Dostęp tutaj.

- PlatonESG. Węgiel Czysta technologia, Energia, Środowisko, Słoneczny, Gospodarowanie odpadami. Dostęp tutaj.

- Platon Zdrowie. Inteligencja w zakresie biotechnologii i badań klinicznych. Dostęp tutaj.

- Źródło: https://aws.amazon.com/blogs/machine-learning/build-trust-and-safety-for-generative-ai-applications-with-amazon-comprehend-and-langchain/

- :ma

- :Jest

- :nie

- :Gdzie

- $W GÓRĘ

- 1

- 100

- 11

- 12

- 14

- 15%

- 17

- 19

- 500

- 7

- 8

- 9

- a

- zdolności

- zdolność

- O nas

- nadużycie

- dostęp

- Konto

- dokładny

- Osiąga

- w poprzek

- Działania

- działania

- aktywnie

- Dodaj

- adres

- Adresy

- adresowanie

- przylegać

- przyjąć

- Przyjęcie

- Rada

- Po

- wiek

- AI

- Usługi AI

- Systemy SI

- AI / ML

- Wszystkie kategorie

- dozwolony

- Pozwalać

- pozwala

- już

- również

- całkowicie

- Amazonka

- Amazon Comprehend

- Amazonka Kendra

- Amazon Web Services

- kwoty

- an

- analityka

- ćwiczenie

- i

- Ogłaszając

- odpowiedź

- każdy

- api

- Pszczoła

- odpowiedni

- Zastosowanie

- aplikacje

- stosowany

- dotyczy

- Aplikuj

- właściwy

- odpowiednio

- SĄ

- obszary

- AS

- zapytać

- pytanie

- aspekty

- przydzielony

- asystenci

- powiązany

- At

- zwiększać

- zwiększona

- dostępny

- AWS

- poparła

- Łazienka

- baza

- na podstawie

- BE

- bo

- stają się

- staje się

- zachowanie

- jest

- wierzenia

- Korzyści

- pomiędzy

- Poza

- Blokować

- bloking

- obie

- Granice

- szerszy

- budować

- budować zaufanie

- Budowanie

- wybudowany

- biznes

- biznes

- ale

- by

- wezwanie

- oddzwanianie

- nazywa

- CAN

- możliwości

- zdolność

- zdolny

- kapitał

- karta

- walizka

- Etui

- zapasy

- pewien

- łańcuch

- więzy

- wyzwania

- charakter

- chatbot

- nasze chatboty

- ZOBACZ

- kontrola

- Wykrywanie urządzeń szpiegujących

- broda

- wybór

- klasa

- Klasy

- klasyfikacja

- sklasyfikowany

- Klasyfikuj

- klient

- kod

- spoisty

- COM

- połączenie

- połączony

- komentarz

- wspólny

- kompleks

- składniki

- zrozumieć

- pojęcie

- zaniepokojony

- Obawy

- Warunki

- pewność siebie

- systemu

- kolejny

- konsekwentnie

- zawiera

- zawartość

- Generowanie treści

- kontrola

- kontrowersyjny

- rdzeń

- stworzony

- Tworzenie

- Twórczy

- kredyt

- Karta kredytowa

- krytyczny

- istotny

- zwyczaj

- klient

- Obsługa klienta

- Klientów

- konfigurowalny

- dostosować

- codziennie

- Taniec

- dane

- Analityka danych

- prywatność danych

- Baza danych

- zbiory danych

- Decyzje

- głębiej

- Domyślnie

- określić

- zdefiniowane

- sięgać

- wykazać

- demonstruje

- W zależności

- projektowanie

- życzenia

- detale

- wykryć

- wykryte

- Wykrywanie

- Ustalać

- rozwijać

- deweloperzy

- oprogramowania

- różne

- cyfrowy

- dyskutować

- omówione

- wyraźnie

- nurkować

- do

- dokument

- dokumentacja

- dokumenty

- łania

- na dół

- z powodu

- e

- każdy

- Wcześniej

- łatwiej

- faktycznie

- łatwy

- bądź

- więcej

- umożliwiać

- zakończenia

- Nieskończony

- zapewnić

- zapewnienie

- Enterprise

- podmioty

- jednostka

- Środowisko

- równy

- Równie

- błąd

- istota

- niezbędny

- istotnie

- etyczny

- przykład

- przykłady

- Z wyjątkiem

- wyjątek

- Przede wszystkim system został opracowany

- doświadczenie

- Doświadczenia

- Wyjaśniać

- wyjaśnione

- Objaśnia

- wyraźnie

- Exploring

- ekspresowy

- rozciąga się

- wyciąg

- Twarz

- znajomy

- Cecha

- Korzyści

- kilka

- filet

- filtrować

- filtracja

- filtry

- budżetowy

- Znajdź

- znajduje

- i terminów, a

- taflowy

- Flagi

- elastyczne

- pływ

- Skupiać

- koncentruje

- koncentruje

- następujący

- następujący sposób

- W razie zamówieenia projektu

- Nasz formularz

- format

- formularze

- Forum

- znaleziono

- Framework

- Francja

- od

- pełny

- Funkcje

- dalej

- Generować

- wygenerowane

- generujący

- generacja

- generatywny

- generatywna sztuczna inteligencja

- otrzymać

- gif

- Dać

- dany

- daje

- Globalne

- cel

- Goes

- będzie

- dobry

- większy

- Rośnie

- Wzrost

- poradnictwo

- Prowadzenie

- dzieje

- szkodliwy

- uprząż

- nienawidzić

- Have

- mający

- he

- pomoc

- pomoc

- pomaga

- wysoko

- zawiasy

- jego

- hostowane

- W jaki sposób

- How To

- Jednak

- HTML

- HTTPS

- Piasta

- człowiek

- podobny do człowieka

- i

- ID

- Identyfikacja

- identyfikator

- identyfikatory

- identyfikuje

- zidentyfikować

- identyfikacja

- if

- Nielegalny

- ilustruje

- obraz

- Rezultat

- wdrożenia

- realizacja

- realizowane

- wykonawczych

- importować

- znaczenie

- ważny

- in

- przypadkowo

- zawierać

- włączony

- obejmuje

- Włącznie z

- Zwiększać

- Zwiększenia

- coraz bardziej

- niezależny

- niezależnie

- przemysłowa

- wpływ

- Informacja

- początkowo

- wkład

- Wejścia

- Zapytania

- przykład

- zintegrowany

- integracja

- Inteligentny

- Inteligentne przetwarzanie dokumentów

- Zamierzam

- zamiar

- zainteresowany

- Interfejs

- przerwane

- najnowszych

- przedstawiać

- IT

- JEGO

- John

- JOHN DOE

- jpg

- json

- właśnie

- Etykiety

- język

- duży

- później

- nauka

- lewo

- Regulamin

- mniej

- lubić

- prawdopodobieństwo

- Ograniczony

- Lista

- mało

- trochę głębiej

- LLM

- log

- zalogowaniu

- logika

- poszukuje

- maszyna

- uczenie maszynowe

- utrzymać

- WYKONUJE

- kierownik

- sposób

- produkcja

- maska

- matematyka

- Materia

- Może..

- me

- znaczy

- środków

- mechanizm

- Media

- medyczny

- połączenie

- spełnione

- metody

- nadużycie

- Złagodzić

- Mieszanie

- ML

- model

- modele

- umiar

- Modułowa

- jeszcze

- dużo

- musi

- my

- Nazwa

- mianowicie

- Nazwy

- Naturalny

- Przetwarzanie języka naturalnego

- niezbędny

- Nowości

- Nowe funkcje

- Następny

- nlp

- Nie

- już dziś

- numer

- z naszej

- liczny

- przedmiot

- of

- obraźliwy

- oferta

- przesunięcia

- on

- ONE

- tylko

- koncepcja

- open source

- działać

- operacyjny

- Opcje

- or

- zamówienie

- organizacji

- pochodzenie

- Inne

- Inaczej

- ludzkiej,

- na zewnątrz

- wyniki

- na zewnątrz

- wydajność

- Wyjścia

- zewnętrzne

- koniec

- własny

- parametr

- parametry

- najważniejszy

- część

- szczególnie

- przechodzić

- minęło

- namiętny

- Hasło

- resetowanie hasła

- Wzór

- wykonać

- wykonywane

- wykonuje

- może

- osobisty

- Osobiście

- telefon

- fotografia

- kawałek

- sztuk

- Platformy

- plato

- Analiza danych Platona

- PlatoDane

- gra

- polityczny

- Popularny

- position

- pozytywny

- możliwości

- możliwy

- Post

- potencjał

- potencjalnie

- power

- powered

- mocny

- konserwowanie

- zapobieganie

- głównie

- pierwotny

- Zasady

- ustalanie priorytetów

- prywatność

- prywatny

- prywatna informacja

- problemy

- procedury

- wygląda tak

- przetwarzanie

- głęboki

- Postęp

- prawidłowo

- chronić

- zapewniać

- zapewnia

- Python

- pytanie

- podnieść

- zasięg

- zakresy

- szybki

- raczej

- osiągnięcie

- Czytający

- królestwo

- otrzymać

- rozpoznawanie

- zmniejszyć

- redukcja

- odnosić się

- region

- regulacyjne

- rzetelny

- reputacja

- zażądać

- wymagania

- Zasób

- osób

- odpowiedź

- Odpowiedzi

- odpowiedzialność

- odpowiedzialny

- Ograniczenia

- detaliczny

- powraca

- prawo

- Ryzyko

- ryzyko

- run

- s

- "bezpiecznym"

- Bezpieczeństwo

- sagemaker

- taki sam

- Skala

- Sceny

- wynik

- bezszwowy

- Sekcja

- działy

- bezpieczeństwo

- widzieć

- Szukajcie

- SAMEGO SIEBIE

- senior

- wrażliwy

- wysłany

- wyrok

- Sekwencja

- usługa

- Usługi

- zestaw

- ona

- powinien

- pokazać

- prezentacja

- pokazane

- Targi

- Sygnały

- Podobnie

- Prosty

- upraszczać

- pojedynczy

- Witryny

- skrawek

- So

- Obserwuj Nas

- Media społecznościowe

- Społeczeństwo

- Rozwiązania

- kilka

- coś

- Źródło

- Kod źródłowy

- Mówi

- specjalista

- specyficzny

- swoiście

- określony

- przemówienie

- standardy

- początek

- rozpoczęty

- Zestawienie sprzedaży

- Ewolucja krok po kroku

- Stop

- zatrzymanie

- sklep

- sznur

- Następnie

- udany

- taki

- w zestawie

- Dostawa

- łańcuch dostaw

- wsparcie

- podpory

- zrównoważone

- systemy

- Brać

- zadania

- zespół

- Techniczny

- Technologies

- szablon

- XNUMX

- niż

- że

- Połączenia

- Stolica

- Źródło

- ich

- Im

- następnie

- Tam.

- a tym samym

- Te

- one

- to

- zagrożenia

- trzy

- próg

- Przez

- czas

- do

- narzędzia

- śledzić

- przeszkolony

- transformacyjny

- Zaufaj

- próbować

- drugiej

- rodzaj

- typy

- odkryć

- niezaprzeczalny

- podbudować

- zrozumieć

- zrozumienie

- wyjątkowy

- uniwersalny

- Utrzymuj

- posługiwać się

- przypadek użycia

- używany

- Użytkownik

- Użytkownicy

- zastosowania

- za pomocą

- wykorzystać

- wykorzystany

- Cenny

- wartość

- Wartości

- różnorodność

- różnorodny

- Naprawiono

- wersja

- przez

- Wirtualny

- W

- chcieć

- była

- Droga..

- sposoby

- we

- sieć

- usługi internetowe

- DOBRZE

- były

- Co

- Co to jest

- jeśli chodzi o komunikację i motywację

- natomiast

- czy

- który

- Podczas

- KIM

- cały

- dlaczego

- szeroki

- Szeroki zasięg

- będzie

- chcieć

- w

- w ciągu

- bez

- świadkami

- Praca

- workflow

- przepływów pracy

- pracujący

- działa

- napisać

- pisanie

- X

- lat

- You

- Twój

- zefirnet