Klienci z branży opieki zdrowotnej i nauk przyrodniczych (HCLS) wykorzystują generatywną sztuczną inteligencję jako narzędzie umożliwiające lepsze wykorzystanie danych. Przypadki użycia obejmują podsumowania dokumentu, które pomagają czytelnikom skupić się na kluczowych punktach dokumentu i przekształcanie nieustrukturyzowanego tekstu w standardowe formaty w celu podkreślenia ważnych atrybutów. Dzięki unikalnym formatom danych i surowym wymaganiom regulacyjnym klienci szukają możliwości wyboru najbardziej wydajnego i opłacalnego modelu, a także możliwości przeprowadzenia niezbędnego dostosowania (dostrajania) w celu dopasowania do swojego przypadku biznesowego. W tym poście przeprowadzimy Cię przez proces wdrażania modelu dużego języka Falcon (LLM) przy użyciu Amazon SageMaker JumpStart oraz wykorzystanie modelu do podsumowania długich dokumentów za pomocą LangChain i Python.

Omówienie rozwiązania

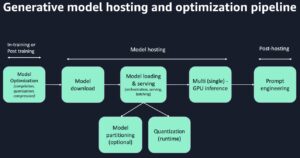

Amazon Sage Maker opiera się na dwudziestoletnim doświadczeniu firmy Amazon w tworzeniu rzeczywistych aplikacji ML, w tym rekomendacji produktów, personalizacji, inteligentnych zakupów, robotyki i urządzeń wspomaganych głosowo. SageMaker to usługa zarządzana zgodna ze standardem HIPAA, która zapewnia narzędzia umożliwiające analitykom danych, inżynierom uczenia maszynowego i analitykom biznesowym wprowadzanie innowacji za pomocą uczenia maszynowego. W SageMaker jest Studio Amazon SageMaker, zintegrowane środowisko programistyczne (IDE) zaprojektowane specjalnie z myślą o wspólnych przepływach pracy ML, które z kolei zawiera szeroką gamę rozwiązań szybkiego startu i wstępnie wyszkolonych modeli ML w zintegrowanym centrum o nazwie SageMaker JumpStart. Dzięki SageMaker JumpStart możesz używać wstępnie wytrenowanych modeli, takich jak Falcon LLM, z gotowymi przykładowymi notatnikami i obsługą SDK, aby eksperymentować i wdrażać te potężne modele transformatorów. Możesz używać SageMaker Studio i SageMaker JumpStart do wdrażania własnego modelu generatywnego i wysyłania zapytań do niego na swoim koncie AWS.

Możesz także mieć pewność, że dane ładunku wnioskowania nie opuszczą Twojej VPC. Można udostępniać modele jako punkty końcowe z jedną dzierżawą i wdrażać je z izolacją sieci. Co więcej, możesz wybierać i zarządzać wybranym zestawem modeli, który spełnia Twoje własne wymagania bezpieczeństwa, korzystając z funkcji centrum modeli prywatnych w SageMaker JumpStart i przechowując tam zatwierdzone modele. SageMaker jest objęty zakresem HIPAA BAA, SOC123, HITRUST CSF.

Połączenia Firma Falcon LLM to duży model językowy, trenowany przez naukowców z Technology Innovation Institute (TII) na ponad 1 bilionie tokenów przy użyciu AWS. Falcon ma wiele różnych odmian, a jego dwa główne składniki to Falcon 40B i Falcon 7B, składające się odpowiednio z 40 miliardów i 7 miliardów parametrów, z precyzyjnie dostrojonymi wersjami przeszkolonymi do określonych zadań, takich jak wykonywanie instrukcji. Falcon dobrze radzi sobie z różnymi zadaniami, w tym podsumowaniem tekstu, analizą nastrojów, odpowiadaniem na pytania i rozmowami. Ten post zawiera przewodnik, który możesz wykonać, aby wdrożyć Falcon LLM na swoim koncie AWS, korzystając z instancji zarządzanego notatnika za pośrednictwem SageMaker JumpStart w celu eksperymentowania z podsumowaniem tekstu.

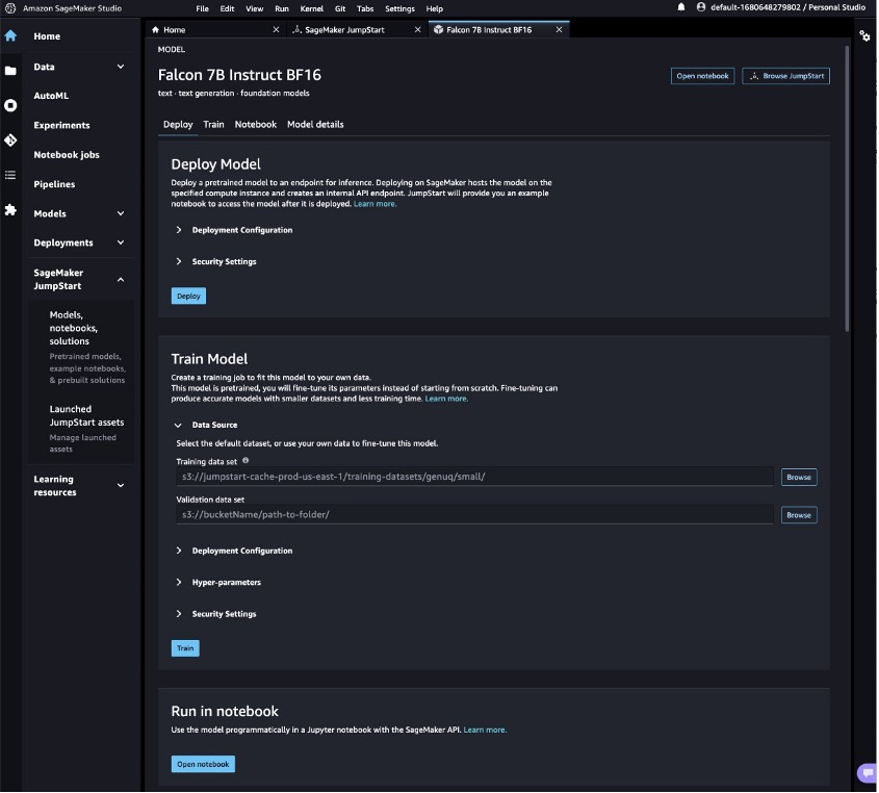

Centrum modeli SageMaker JumpStart zawiera kompletne notesy umożliwiające wdrażanie i wysyłanie zapytań do każdego modelu. W chwili pisania tego tekstu w centrum modeli SageMaker JumpStart dostępnych jest sześć wersji Falcona: Falcon 40B Instruct BF16, Falcon 40B BF16, Falcon 180B BF16, Falcon 180B Chat BF16, Falcon 7B Instruct BF16 i Falcon 7B BF16. W tym poście wykorzystano model Falcon 7B Instruct.

W poniższych sekcjach pokazujemy, jak rozpocząć podsumowywanie dokumentów, wdrażając Falcon 7B w SageMaker Jumpstart.

Wymagania wstępne

Do tego samouczka potrzebne będzie konto AWS z domeną SageMaker. Jeśli nie masz jeszcze domeny SageMaker, zapoznaj się z sekcją Na pokładzie do domeny Amazon SageMaker stworzyć jeden.

Rozmieść Falcona 7B za pomocą SageMaker JumpStart

Aby wdrożyć model, wykonaj następujące kroki:

- Przejdź do środowiska SageMaker Studio z konsoli SageMaker.

- W IDE, pod SageMaker Szybki start w okienku nawigacji wybierz Modele, notebooki, rozwiązania.

- Wdróż model Falcon 7B Instruct w punkcie końcowym w celu wyciągnięcia wniosków.

Spowoduje to otwarcie karty modelu Falcon 7B Instruct BF16. Na tej stronie znajdziesz Rozmieścić or Pociąg opcje, a także łącza umożliwiające otwarcie przykładowych notatników w SageMaker Studio. W tym poście do wdrożenia modelu wykorzystany zostanie przykładowy notatnik z SageMaker JumpStart.

- Dodaj Otwórz notatnik.

- Uruchom pierwsze cztery komórki notatnika, aby wdrożyć punkt końcowy Falcon 7B Instruct.

Możesz zobaczyć wdrożone modele JumpStart na stronie Uruchomiono zasoby JumpStart strona.

- W okienku nawigacji w obszarze Szybki start SageMakerawybierz Uruchomiono zasoby JumpStart.

- Wybierz Punkty końcowe modelu aby wyświetlić stan punktu końcowego.

Po wdrożeniu punktu końcowego Falcon LLM możesz wysłać zapytanie do modelu.

Uruchom swoje pierwsze zapytanie

Aby uruchomić zapytanie, wykonaj następujące kroki:

- Na filet menu, wybierz Nowości i Notatnik aby otworzyć nowy notatnik.

Możesz także pobrać wypełniony notatnik tutaj.

- Po wyświetleniu monitu wybierz obraz, jądro i typ instancji. W tym poście wybieramy obraz Data Science 3.0, jądro Python 3 i instancję ml.t3.medium.

- Zaimportuj moduły Boto3 i JSON, wprowadzając następujące dwie linie w pierwszej komórce:

- Naciśnij przycisk Shift + Enter do obsługi komórki.

- Następnie możesz zdefiniować funkcję, która będzie wywoływać Twój punkt końcowy. Ta funkcja pobiera ładunek słownikowy i używa go do wywołania klienta wykonawczego SageMaker. Następnie deserializuje odpowiedź i drukuje wprowadzony i wygenerowany tekst.

Ładunek zawiera zachętę jako dane wejściowe wraz z parametrami wnioskowania, które zostaną przekazane do modelu.

- Możesz użyć tych parametrów z podpowiedzią, aby dostroić dane wyjściowe modelu do swojego przypadku użycia:

Zapytanie z monitem podsumowującym

W tym poście wykorzystano przykładowy artykuł badawczy w celu zademonstrowania podsumowania. Przykładowy plik tekstowy dotyczy automatycznego podsumowania tekstu w literaturze biomedycznej. Wykonaj następujące kroki:

- Do pobrania PDF i skopiuj tekst do pliku o nazwie

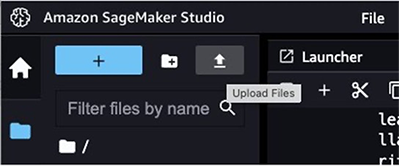

document.txt. - W SageMaker Studio wybierz ikonę przesyłania i prześlij plik do instancji SageMaker Studio.

Po wyjęciu z pudełka Falcon LLM zapewnia obsługę podsumowań tekstu.

- Stwórzmy funkcję, która do podsumowania użyje szybkich technik inżynieryjnych

document.txt:

Zauważysz, że w przypadku dłuższych dokumentów pojawia się błąd — Falcon, podobnie jak wszystkie inne LLM, ma ograniczenie liczby tokenów przekazywanych jako dane wejściowe. Możemy obejść ten limit, korzystając z ulepszonych możliwości podsumowania LangChain, które pozwalają na przekazanie znacznie większych danych wejściowych do LLM.

Zaimportuj i uruchom łańcuch podsumowań

LangChain to biblioteka oprogramowania typu open source, która umożliwia programistom i badaczom danych szybkie tworzenie, dostrajanie i wdrażanie niestandardowych aplikacji generatywnych bez zarządzania złożonymi interakcjami ML, powszechnie używanymi do wyodrębniania wielu typowych przypadków użycia generatywnych modeli języka AI w zaledwie kilku linie kodu. Wsparcie LangChain dla usług AWS obejmuje obsługę punktów końcowych SageMaker.

LangChain zapewnia dostępny interfejs dla LLM. Jego funkcje obejmują narzędzia do szybkiego tworzenia szablonów i szybkiego łączenia. Łańcuchów tych można używać do podsumowywania dokumentów tekstowych dłuższych niż te, które obsługuje model języka w jednym wywołaniu. Możesz użyć strategii zmniejszania mapy, aby podsumować długie dokumenty, dzieląc je na łatwe do zarządzania fragmenty, podsumowując je i łącząc (i ponownie podsumowując, jeśli to konieczne).

- Na początek zainstalujmy LangChain:

- Zaimportuj odpowiednie moduły i podziel długi dokument na części:

- Aby LangChain efektywnie współpracował z Falconem, musisz zdefiniować domyślne klasy obsługi treści dla poprawnych danych wejściowych i wyjściowych:

- Monity niestandardowe można zdefiniować jako

PromptTemplateobiektów, głównego narzędzia podpowiedzi za pomocą LangChain, w podejściu podsumowującym z redukcją mapy. Jest to krok opcjonalny, ponieważ monity o mapowanie i łączenie są domyślnie udostępniane, jeśli parametry w wywołaniu ładującym łańcuch podsumowań (load_summarize_chain) są nieokreślone.

- LangChain obsługuje LLM hostowane na punktach końcowych wnioskowania SageMaker, więc zamiast korzystać z zestawu AWS Python SDK, możesz zainicjować połączenie za pośrednictwem LangChain, aby uzyskać większą dostępność:

- Na koniec możesz załadować łańcuch podsumowań i uruchomić podsumowanie w dokumentach wejściowych, używając następującego kodu:

Ponieważ verbose parametr jest ustawiony na True, zobaczysz wszystkie pośrednie wyniki podejścia polegającego na zmniejszaniu mapy. Jest to przydatne do śledzenia sekwencji zdarzeń w celu uzyskania ostatecznego podsumowania. Dzięki temu podejściu polegającemu na zmniejszeniu mapy można skutecznie podsumowywać dokumenty znacznie dłużej, niż zwykle pozwala na to maksymalny limit tokenów wejściowych modelu.

Sprzątać

Po zakończeniu korzystania z punktu końcowego wnioskowania ważne jest, aby go usunąć, aby uniknąć ponoszenia niepotrzebnych kosztów związanych z następującymi wierszami kodu:

Korzystanie z innych modeli fundamentów w SageMaker JumpStart

Wykorzystywanie innych podstawowych modeli dostępnych w SageMaker JumpStart do podsumowywania dokumentów wymaga minimalnego nakładu pracy przy konfiguracji i wdrożeniu. LLM czasami różnią się strukturą formatów wejściowych i wyjściowych, a w miarę dodawania nowych modeli i gotowych rozwiązań do SageMaker JumpStart, w zależności od realizacji zadania, może być konieczne wprowadzenie następujących zmian w kodzie:

- Jeśli przeprowadzasz podsumowanie za pośrednictwem

summarize()(metoda bez użycia LangChain), może być konieczna zmiana struktury JSON plikupayloadparametru, a także obsługę zmiennej odpowiedzi w plikuquery_endpoint()funkcjonować - Jeśli przeprowadzasz podsumowanie za pośrednictwem LangChain

load_summarize_chain()może być konieczne zmodyfikowanie metodyContentHandlerTextSummarizationklasa, a konkretnietransform_input()itransform_output()funkcje, aby poprawnie obsłużyć ładunek, jakiego oczekuje LLM, i dane wyjściowe, które LLM zwraca

Modele podstawowe różnią się nie tylko takimi czynnikami, jak szybkość i jakość wnioskowania, ale także formatami wejściowymi i wyjściowymi. Zapoznaj się z odpowiednią stroną informacyjną LLM dotyczącą oczekiwanych danych wejściowych i wyjściowych.

Wnioski

Model Falcon 7B Instruct jest dostępny w centrum modeli SageMaker JumpStart i sprawdza się w wielu przypadkach użycia. W tym poście pokazano, jak wdrożyć własny punkt końcowy Falcon LLM w swoim środowisku za pomocą SageMaker JumpStart i przeprowadzić pierwsze eksperymenty w SageMaker Studio, co umożliwi szybkie prototypowanie modeli i płynne przejście do środowiska produkcyjnego. Dzięki Falcon i LangChain możesz skutecznie podsumowywać długoterminowe dokumenty z zakresu opieki zdrowotnej i nauk przyrodniczych na dużą skalę.

Aby uzyskać więcej informacji na temat pracy z generatywną sztuczną inteligencją w AWS, zobacz Ogłaszamy nowe narzędzia do budowania z generatywną sztuczną inteligencją w AWS. Możesz rozpocząć eksperymentowanie i tworzenie podsumowań dokumentów potwierdzających słuszność koncepcji aplikacji GenAI zorientowanych na opiekę zdrowotną i nauki przyrodnicze, korzystając z metody opisanej w tym poście. Gdy Amazońska skała macierzysta jest ogólnie dostępny, opublikujemy kolejny post pokazujący, jak można wdrożyć podsumowania dokumentów za pomocą Amazon Bedrock i LangChain.

O autorach

Johna Kitaoki jest architektem rozwiązań w Amazon Web Services. John pomaga klientom projektować i optymalizować obciążenia AI/ML w AWS, aby pomóc im osiągnąć cele biznesowe.

Johna Kitaoki jest architektem rozwiązań w Amazon Web Services. John pomaga klientom projektować i optymalizować obciążenia AI/ML w AWS, aby pomóc im osiągnąć cele biznesowe.

Josha Famestada jest architektem rozwiązań w Amazon Web Services. Josh współpracuje z klientami z sektora publicznego, aby budować i wdrażać podejścia oparte na chmurze, aby realizować priorytety biznesowe.

Josha Famestada jest architektem rozwiązań w Amazon Web Services. Josh współpracuje z klientami z sektora publicznego, aby budować i wdrażać podejścia oparte na chmurze, aby realizować priorytety biznesowe.

- Dystrybucja treści i PR oparta na SEO. Uzyskaj wzmocnienie już dziś.

- PlatoData.Network Pionowe generatywne AI. Wzmocnij się. Dostęp tutaj.

- PlatoAiStream. Inteligencja Web3. Wiedza wzmocniona. Dostęp tutaj.

- PlatonESG. Węgiel Czysta technologia, Energia, Środowisko, Słoneczny, Gospodarowanie odpadami. Dostęp tutaj.

- Platon Zdrowie. Inteligencja w zakresie biotechnologii i badań klinicznych. Dostęp tutaj.

- Źródło: https://aws.amazon.com/blogs/machine-learning/create-an-hcls-document-summarization-application-with-falcon-using-amazon-sagemaker-jumpstart/

- :ma

- :Jest

- :nie

- $W GÓRĘ

- 1

- 10

- 100

- 11

- 12

- 14

- 150

- 16

- 1M

- 20

- 40

- 400

- 50

- 500

- 7

- a

- zdolność

- ABSTRACT

- Akceptuje

- dostępność

- dostępny

- Konto

- Osiągać

- w dodatku

- Przyjęcie

- ponownie

- AI

- AI / ML

- Wszystkie kategorie

- dozwolony

- Pozwalać

- pozwala

- wzdłuż

- już

- również

- Amazonka

- Amazon Sage Maker

- Amazon SageMaker JumpStart

- Amazon Web Services

- an

- analiza

- analitycy

- i

- zwierzę

- zwierzęta

- Zastosowanie

- aplikacje

- podejście

- awanse

- zatwierdzony

- SĄ

- na około

- AS

- At

- atrybuty

- automatycznie

- dostępny

- uniknąć

- AWS

- na podstawie

- BE

- bo

- rozpocząć

- uważa,

- Miliard

- biomedyczny

- ciało

- Pudełko

- przerwa

- Przełamując

- budować

- Budowanie

- wybudowany

- biznes

- ale

- by

- wezwanie

- nazywa

- CAN

- Może uzyskać

- możliwości

- zdolność

- karta

- walizka

- Etui

- Komórki

- łańcuch

- więzy

- zmiana

- Zmiany

- wybory

- Dodaj

- Wybierając

- klasa

- Klasy

- klient

- Chmura

- kod

- współpracy

- połączyć

- łączenie

- wspólny

- powszechnie

- w porównaniu

- kompletny

- Zakończony

- kompleks

- Składa się

- pojęcie

- zwięzły

- połączenie

- Konsola

- zawierać

- zawartość

- opłacalne

- Koszty:

- Stwórz

- zwyczaj

- Klientów

- dostosowywanie

- dane

- nauka danych

- lat

- Domyślnie

- określić

- dostarczyć

- wykazać

- wykazać

- W zależności

- rozwijać

- wdrażane

- wdrażanie

- Wdrożenie

- Wnętrze

- deweloperzy

- rozwijanie

- oprogramowania

- urządzenia

- różne

- do

- dokument

- dokumenty

- Nie

- domena

- nie

- na dół

- pobieranie

- każdy

- Ziemia

- faktycznie

- umożliwiać

- Punkt końcowy

- Inżynieria

- Inżynierowie

- wzmocnione

- zapewnić

- wprowadzenie

- Środowisko

- błąd

- wydarzenia

- przykład

- wykonać

- spodziewany

- oczekuje

- doświadczenie

- eksperyment

- eksperymenty

- Twarz

- Czynniki

- fałszywy

- Korzyści

- kilka

- filet

- finał

- Znajdź

- i terminów, a

- dopasować

- Skupiać

- obserwuj

- następujący

- W razie zamówieenia projektu

- Fundacja

- cztery

- od

- funkcjonować

- Funkcje

- Ponadto

- ogólnie

- Generować

- wygenerowane

- generatywny

- generatywna sztuczna inteligencja

- otrzymać

- Gole

- większy

- uchwyt

- Prowadzenie

- Have

- opieki zdrowotnej

- pomoc

- pomaga

- Atrakcja

- hostowane

- W jaki sposób

- How To

- HTML

- HTTPS

- Piasta

- ICON

- if

- obraz

- wdrożenia

- realizacja

- importować

- ważny

- in

- zawierać

- obejmuje

- Włącznie z

- Informacja

- wprowadzać innowacje

- Innowacja

- wkład

- Wejścia

- zainstalować

- przykład

- zamiast

- Instytut

- instrukcje

- zintegrowany

- Inteligentny

- Interakcje

- Interfejs

- najnowszych

- izolacja

- IT

- JEGO

- John

- json

- właśnie

- Klawisz

- język

- duży

- większe

- uruchomiona

- Pozostawiać

- Biblioteka

- życie

- Life Sciences

- LIMIT

- linie

- linki

- literatura

- LLM

- załadować

- długo

- dłużej

- poszukuje

- Główny

- robić

- zarządzanie

- wykonalny

- zarządzane

- zarządzający

- wiele

- mapowanie

- maksymalny

- Może..

- średni

- Menu

- metoda

- minimalny

- ML

- model

- modele

- modyfikować

- Moduły

- jeszcze

- większość

- dużo

- Nawigacja

- niezbędny

- Potrzebować

- potrzebne

- sieć

- Nowości

- NIH

- normalnie

- notatnik

- Zauważyć..

- numer

- obiekty

- of

- on

- ONE

- tylko

- koncepcja

- open source

- Oprogramowanie typu open source

- Optymalizacja

- Opcje

- Inne

- opisane

- wydajność

- koniec

- własny

- strona

- chleb

- Papier

- parametr

- parametry

- minęło

- wykonać

- wykonywania

- wykonuje

- personalizacja

- plato

- Analiza danych Platona

- PlatoDane

- zwrotnica

- Post

- mocny

- wydruki

- prywatny

- wygląda tak

- Produkt

- Produkcja

- dowody

- prototyp

- zapewniać

- pod warunkiem,

- zapewnia

- zaopatrzenie

- publiczny

- publikować

- Python

- jakość

- pytanie

- szybko

- szybko

- czytelnicy

- gotowy

- Prawdziwy świat

- zalecenia

- odnosić się

- regulacyjne

- wymagania

- Wymaga

- Badania naukowe

- Badacze

- odpowiednio

- odpowiedź

- powrót

- robotyka

- run

- sagemaker

- Wnioskowanie SageMakera

- Skala

- nauka

- NAUKI

- Naukowcy

- zakres

- Sdk

- płynnie

- działy

- sektor

- bezpieczeństwo

- widzieć

- wybrany

- SAMEGO SIEBIE

- sentyment

- Sekwencja

- usługa

- Usługi

- zestaw

- ustawienie

- Zakupy

- Short

- pokazać

- pojedynczy

- SIX

- So

- Tworzenie

- Rozwiązania

- specyficzny

- swoiście

- prędkość

- początek

- rozpoczęty

- Rynek

- Ewolucja krok po kroku

- Cel

- przechowywania

- Strategia

- Ścisły

- Struktura

- studio

- taki

- streszczać

- PODSUMOWANIE

- wsparcie

- podpory

- trwa

- Zadanie

- zadania

- Techniki

- Technologia

- Innowacje technologiczne

- XNUMX

- niż

- że

- Połączenia

- ich

- Im

- następnie

- Tam.

- Te

- to

- Przez

- do

- razem

- żeton

- Żetony

- narzędzie

- narzędzia

- przeszkolony

- transformator

- transformatorowy

- przejście

- Trylion

- prawdziwy

- SKRĘCAĆ

- Tutorial

- drugiej

- rodzaj

- niezdefiniowany

- wyjątkowy

- niepotrzebny

- Uploading

- posługiwać się

- przypadek użycia

- używany

- zastosowania

- za pomocą

- zmienna

- różnorodność

- pojazd

- Wersje

- przez

- Zobacz i wysłuchaj

- spacer

- solucja

- we

- sieć

- usługi internetowe

- DOBRZE

- Co

- jeśli chodzi o komunikację i motywację

- który

- szeroki

- będzie

- w

- w ciągu

- bez

- Praca

- przepływów pracy

- pracujący

- działa

- napisać

- pisanie

- You

- Twój

- zefirnet