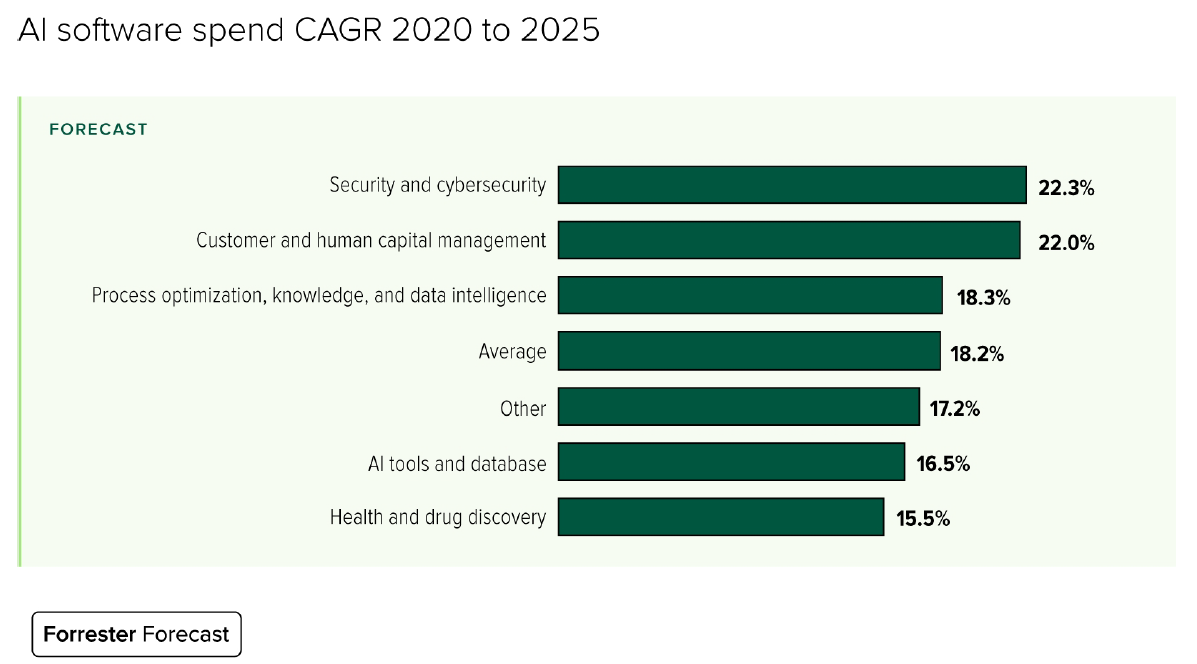

Z nowego raportu wynika, że do 2025 r. rynek oprogramowania opartego na sztucznej inteligencji (AI) wzrośnie z 2021 miliardów dolarów w 33 r. do 64 miliardów dolarów. Cyberbezpieczeństwo to najszybciej rosnąca kategoria wydatków na sztuczną inteligencję, w której obserwuje się wzrost wydatków o 22.3% złożonej rocznej stopy wzrostu (CAGR).

Tak wynika z „Globalnej prognozy oprogramowania AI na rok 2022” opracowanej przez firmę Forrester Research. „Cyberbezpieczeństwo to najszybciej rozwijająca się kategoria oprogramowania AI, skupiająca się na monitorowaniu ataków w czasie rzeczywistym i reagowaniu na nie” – stwierdza raport. Kolejne dwie kategorie, zarządzanie klientami i kapitałem ludzkim (22%) oraz optymalizacja procesów, wiedza i analiza danych (18.3%), również zawierają elementy cyberbezpieczeństwa, więc wpływ na twórców narzędzi bezpieczeństwa może być jeszcze większy.

Jest to zgodne z naciskiem, jaki firmy kładą na swoje oprogramowanie i usługi wzmocnione sztuczną inteligencją. Na przykład gigant kredytowy Visa ujawnił, że wydał na to pół miliarda dolarów analityka danych i sztuczna inteligencja w ciągu ostatnich pięciu lat. Wykorzystuje te narzędzia, wraz z konwencjonalnymi środkami bezpieczeństwa cybernetycznego, aby utrzymać wskaźnik oszustw na, jak twierdzi Visa, historycznie najniższym poziomie pomimo rozwoju handlu elektronicznego.

Organizacje mogą wdrażać sztuczną inteligencję w celu zapewnienia cyberbezpieczeństwa w dowolnym miejscu powtarzalne działania i oczekiwane zachowanie, w tym zarządzanie powierzchnią ataku, rozszerzone wykrywanie i reagowanie (XDR) oraz analiza zachowań użytkowników i podmiotów (UEBA). Forrester wymienia SentinelOne jako doskonały przykład historii sukcesu XDR, wskazując na Wzrost przychodów o 120% rok do roku w roku finansowym 2022. W marcu SentinelOne dodano wykrywanie i reagowanie na zagrożenia tożsamości na swoją platformę po przejęciu Attivo Networks.

Narzędzie AI może dowiedzieć się, jaka jest normalna aktywność na konkretnym urządzeniu lub koncie, a następnie oznaczyć, gdy ten punkt końcowy działa poza normą. Taki automatyczne wykrywanie jest bezcenne, biorąc pod uwagę niemożność zapewnienia wystarczającej liczby pracowników, aby ludzkie oczy obserwowały każdą część sieci. Naukowcy znajdują na to sposoby stosować duże modele językowe jak GPT-3 do zadań praktycznych, takich jak śledzenie sieci forów poświęconych exploitom. Aby zapewnić pewną perspektywę na taki rozwój wydarzeń, Dark Reading opublikował raport we wrześniu pt. „Jak uczenie maszynowe, sztuczna inteligencja i głębokie uczenie się poprawiają bezpieczeństwo cybernetyczne” – o tym, jak ocenić oświadczenia dostawcy dotyczące sztucznej inteligencji i zdefiniować kryteria jej sukcesu.

Jedną z przeszkód w galopie sztucznej inteligencji jest wyzwanie polegające na skonfigurowaniu systemu tak, aby sygnalizował to, co jest konieczne do oceny przez ludzkich analityków, bez powodowania zmęczenia czujnością. Ankieta przeprowadzona na początku 2022 r. wykazała, że prawie połowa (46%) pracowników ds. bezpieczeństwa IT stwierdziła, że stworzyła swoje systemy sztucznej inteligencji zbyt wiele fałszywych alertów aby się do nich odezwali. Optymista widziałby problem fałszywie dodatni jako szansę na rozwój, otwierając jednak nowy rynek usług dostrajających.

Więcej informacji znajdziesz na stronie Wpis na blogu Forrester Research o raporcie.

- blockchain

- portfele kryptowalutowe

- krypto-wymiana

- bezpieczeństwo cybernetyczne

- cyberprzestępcy

- Bezpieczeństwo cybernetyczne

- Mroczne czytanie

- Departament Bezpieczeństwa Wewnętrznego

- cyfrowe portfele

- zapora

- Kaspersky

- malware

- Mcafee

- NexBLOC

- plato

- Platon Ai

- Analiza danych Platona

- Gra Platona

- PlatoDane

- platogaming

- VPN

- zabezpieczenia stron internetowych