Przedsiębiorstwa starają się wykorzystać potencjał uczenia maszynowego (ML) do rozwiązywania złożonych problemów i poprawy wyników. Do niedawna budowanie i wdrażanie modeli uczenia maszynowego wymagało głębokich umiejętności technicznych i kodowania, w tym dostrajania modeli uczenia maszynowego i utrzymywania potoków operacyjnych. Od wprowadzenia w 2021 r. Płótno Amazon SageMaker umożliwiło analitykom biznesowym budowanie, wdrażanie i używanie różnorodnych modeli uczenia maszynowego – w tym modeli tabelarycznych, wizji komputerowej i przetwarzania języka naturalnego – bez pisania nawet linijki kodu. Zwiększyło to możliwości przedsiębiorstw w zakresie stosowania uczenia maszynowego w takich przypadkach, jak prognozowanie szeregów czasowych, przewidywanie odejścia klientów, analiza nastrojów, wykrywanie wad przemysłowych i wiele innych.

Zgodnie z zapowiedzią 5 października 2023 r., SageMaker Canvas rozszerzył obsługę modeli na modele podstawowe (FM) – duże modele językowe używane do generowania i podsumowywania treści. Z Wersja z 12 października 2023 r, SageMaker Canvas pozwala użytkownikom zadawać pytania i uzyskiwać odpowiedzi oparte na danych przedsiębiorstwa. Gwarantuje to, że wyniki są zależne od kontekstu, co otwiera dodatkowe przypadki użycia, w których można zastosować ML bez kodu do rozwiązania problemów biznesowych. Na przykład zespoły biznesowe mogą teraz formułować odpowiedzi zgodne ze specyficznym słownictwem i zasadami organizacji oraz szybciej przeszukiwać obszerne dokumenty, aby uzyskać odpowiedzi szczegółowe i oparte na treści tych dokumentów. Cała ta zawartość jest wykonywana w sposób prywatny i bezpieczny, zapewniając dostęp do wszystkich wrażliwych danych przy odpowiednim zarządzaniu i zabezpieczeniach.

Aby rozpocząć, administrator chmury konfiguruje i wypełnia dane Amazonka Kendra indeksy zawierające dane przedsiębiorstwa jako źródła danych dla SageMaker Canvas. Użytkownicy Canvas wybierają indeks, w którym znajdują się ich dokumenty, i mogą tworzyć pomysły, badać i eksplorować, wiedząc, że wyniki będą zawsze poparte ich źródłami prawdy. SageMaker Canvas wykorzystuje najnowocześniejsze FM z Amazońska skała macierzysta i Amazon SageMaker JumpStart. Rozmowy można rozpocząć z wieloma FM obok siebie, porównując wyniki i naprawdę udostępniając generatywną sztuczną inteligencję każdemu.

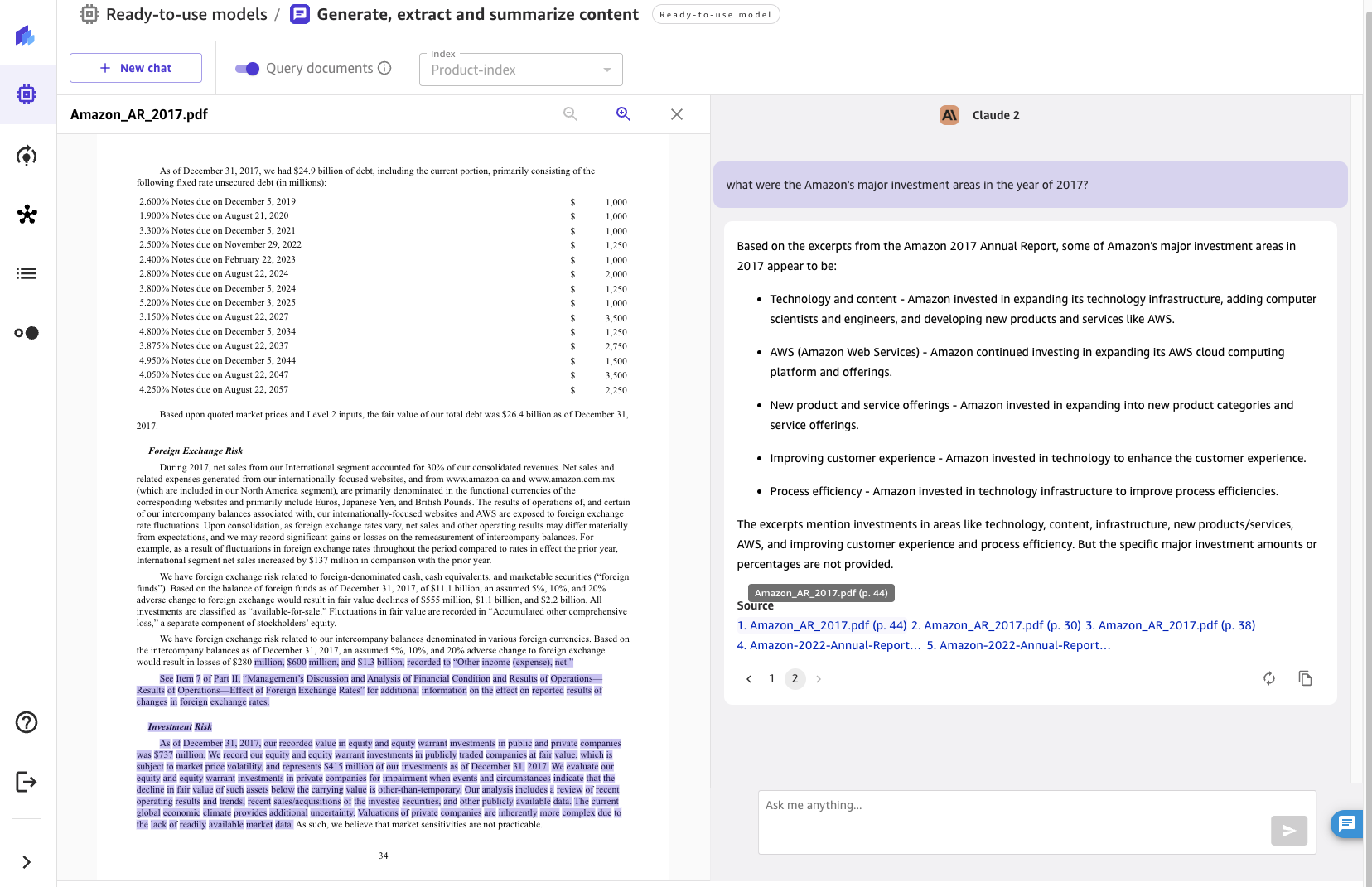

W tym poście dokonamy przeglądu niedawno udostępnionej funkcji, omówimy architekturę i przedstawimy przewodnik krok po kroku umożliwiający SageMaker Canvas wysyłanie zapytań do dokumentów z bazy wiedzy, jak pokazano na poniższym zrzucie ekranu.

Omówienie rozwiązania

Podstawowe modele mogą powodować halucynacje – reakcje, które są ogólne, niejasne, niepowiązane lub niezgodne z faktami. Generowanie rozszerzone odzyskiwania (RAG) jest często stosowaną metodą zmniejszania halucynacji. Architektury RAG służą do pobierania danych spoza FM, które są następnie wykorzystywane do uczenia się kontekstowego w celu odpowiedzi na zapytanie użytkownika. Dzięki temu FM może korzystać z danych z zaufanej bazy wiedzy i wykorzystywać tę wiedzę do odpowiadania na pytania użytkowników, zmniejszając ryzyko halucynacji.

Dzięki RAG dane zewnętrzne w stosunku do FM i wykorzystywane do wzmacniania podpowiedzi użytkownika mogą pochodzić z wielu różnych źródeł danych, takich jak repozytoria dokumentów, bazy danych lub interfejsy API. Pierwszym krokiem jest przekonwertowanie dokumentów i wszelkich zapytań użytkowników na zgodny format w celu przeprowadzenia wyszukiwania semantycznego pod kątem trafności. Aby zapewnić zgodność formatów, zbiór dokumentów lub biblioteka wiedzy oraz zapytania przesłane przez użytkowników są konwertowane na reprezentacje numeryczne przy użyciu modeli osadzania.

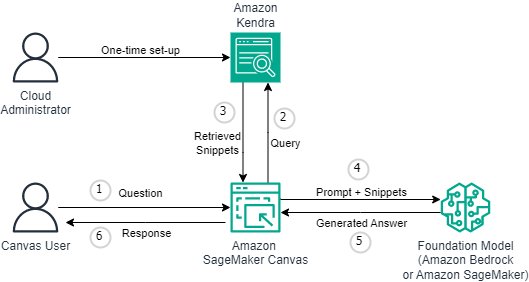

W tej wersji funkcjonalność RAG jest udostępniana bez użycia kodu i bezproblemowo. Przedsiębiorstwa mogą wzbogacić czat w Canvas dzięki Amazon Kendra jako podstawowemu systemowi zarządzania wiedzą. Poniższy diagram ilustruje architekturę rozwiązania.

Podłączenie SageMaker Canvas do Amazon Kendra wymaga jednorazowej konfiguracji. Szczegółowo opisujemy proces konfiguracji w części Konfigurowanie kanwy do wysyłania zapytań do dokumentów. Jeśli nie skonfigurowałeś jeszcze domeny SageMaker, zapoznaj się z sekcją Na pokładzie do domeny Amazon SageMaker.

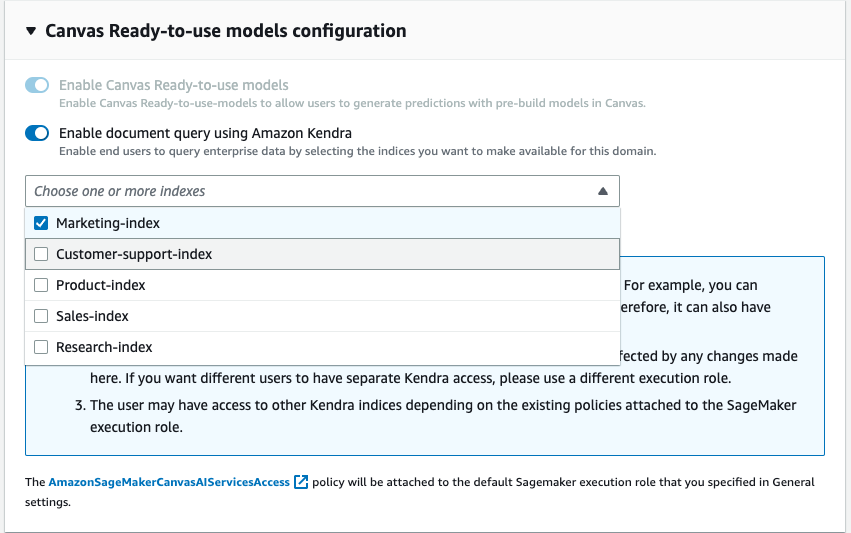

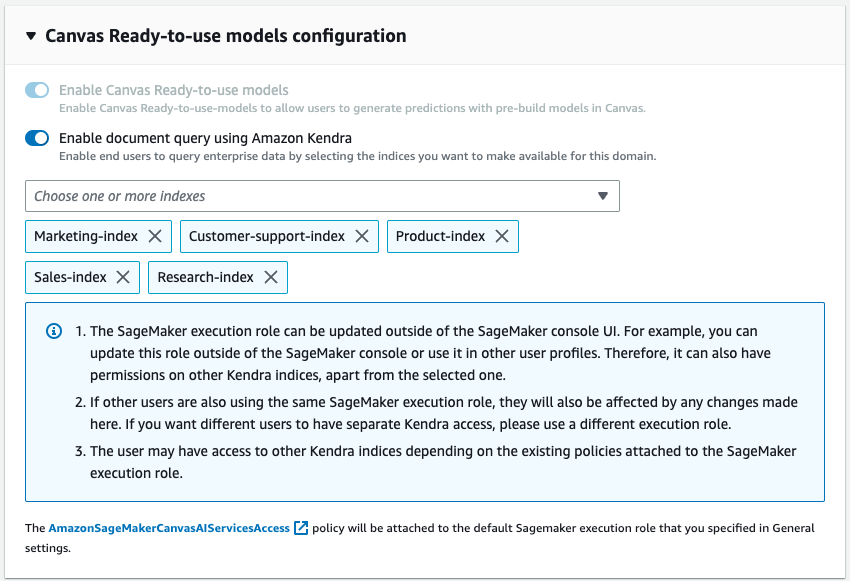

W ramach konfiguracji domeny administrator chmury może wybrać jeden lub więcej indeksów Kendra, o które analityk biznesowy może pytać podczas interakcji z FM za pośrednictwem SageMaker Canvas.

Po nawodnieniu i skonfigurowaniu indeksów Kendra analitycy biznesowi używają ich w SageMaker Canvas, rozpoczynając nowy czat i wybierając przełącznik „Zapytaj o dokumenty”. SageMaker Canvas będzie następnie zarządzać podstawową komunikacją pomiędzy Amazon Kendra a wybranym FM, aby wykonać następujące operacje:

- Zapytaj o indeksy Kendry, zadając pytanie od użytkownika.

- Pobierz fragmenty (i źródła) z indeksów Kendra.

- Zaprojektuj zachętę zawierającą fragmenty oryginalnego zapytania, tak aby model podstawowy mógł wygenerować odpowiedź na podstawie pobranych dokumentów.

- Przekaż wygenerowaną odpowiedź użytkownikowi wraz z odniesieniami do stron/dokumentów, które posłużyły do sformułowania odpowiedzi.

Konfigurowanie Canvas do wysyłania zapytań do dokumentów

W tej sekcji przeprowadzimy Cię przez kolejne etapy konfigurowania Canvas w celu wykonywania zapytań o dokumenty udostępniane przez indeksy Kendra. Powinieneś mieć następujące wymagania wstępne:

- Konfiguracja domeny SageMaker – Na pokładzie do domeny Amazon SageMaker

- Stwórz Indeks Kendry (lub więcej niż jeden)

- Skonfiguruj złącze Kendra Amazon S3 – postępuj zgodnie z Złącze Amazon S3 – i przesyłaj pliki PDF i inne dokumenty do zasobnika Amazon S3 powiązanego z indeksem Kendra

- Skonfiguruj IAM tak, aby Canvas miał odpowiednie uprawnienia, w tym te wymagane do wywoływania punktów końcowych Amazon Bedrock i/lub SageMaker – postępuj zgodnie z instrukcjami Skonfiguruj czat na płótnie dokumentacja

Teraz możesz zaktualizować domenę, aby mogła uzyskać dostęp do żądanych indeksów. W konsoli SageMaker dla danej domeny wybierz opcję Edytuj w zakładce Ustawienia domeny. Włącz przełącznik „Włącz zapytania dotyczące dokumentów za pomocą Amazon Kendra”, który można znaleźć w kroku Ustawienia kanwy. Po aktywacji wybierz jeden lub więcej indeksów Kendra, których chcesz używać z Canvas.

To wszystko, czego potrzeba, aby skonfigurować funkcję dokumentów zapytań Canvas. Użytkownicy mogą teraz przejść do czatu w Canvas i rozpocząć korzystanie z baz wiedzy dołączonych do domeny poprzez indeksy Kendra. Opiekunowie bazy wiedzy mogą w dalszym ciągu aktualizować źródło prawdy, a dzięki możliwości synchronizacji w Kendrze użytkownicy czatu będą automatycznie mogli bezproblemowo korzystać z aktualnych informacji.

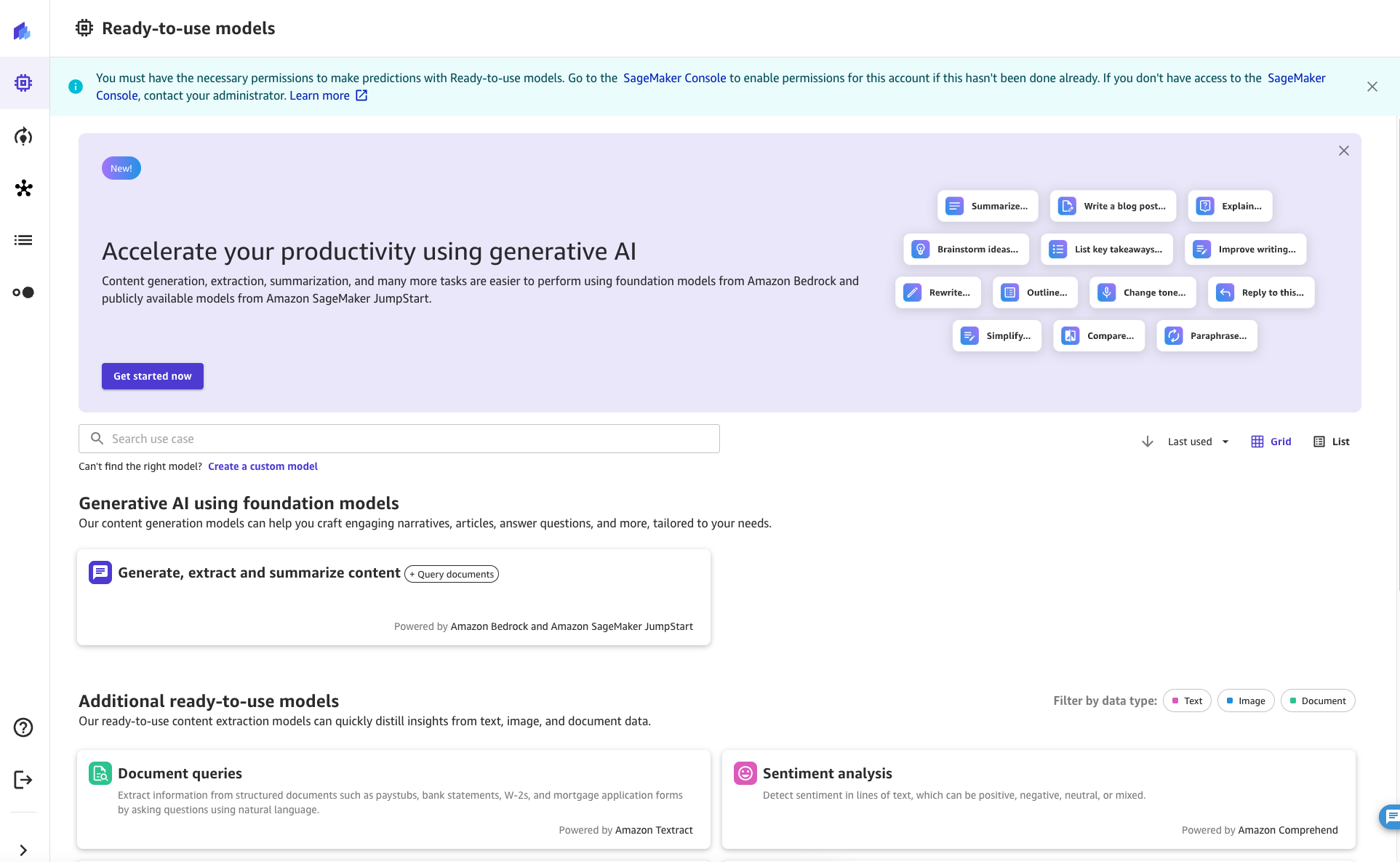

Korzystanie z funkcji Zapytania o dokumenty na czacie

Jako użytkownik SageMaker Canvas dostęp do funkcji Zapytania o dokumenty można uzyskać z poziomu czatu. Aby rozpocząć sesję czatu, kliknij lub wyszukaj przycisk „Generuj, wyodrębniaj i podsumowuj treść” na karcie Gotowe do użycia modele w SageMaker Canvas.

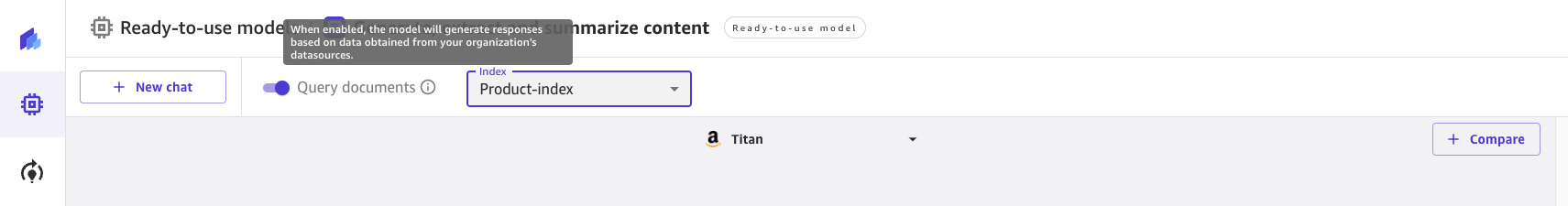

Tam możesz włączać i wyłączać Zapytania o dokumenty za pomocą przełącznika u góry ekranu. Aby dowiedzieć się więcej o tej funkcji, sprawdź monit informacyjny.

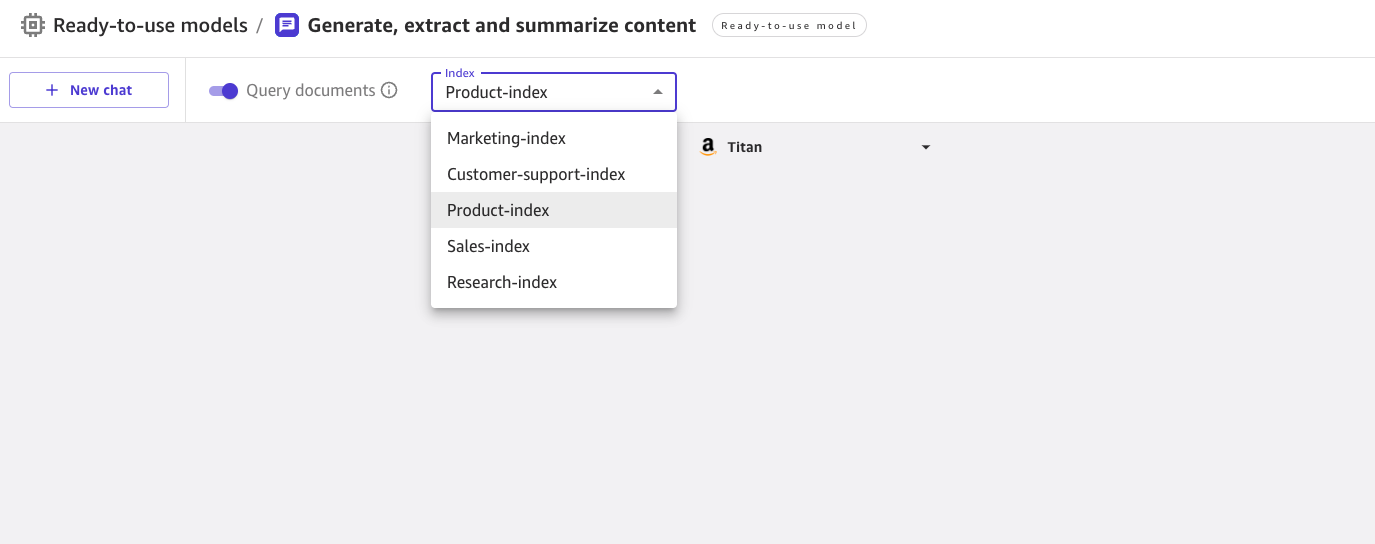

Gdy włączona jest opcja Zapytania o dokumenty, możesz wybierać spośród listy indeksów Kendra włączonych przez administratora chmury.

Możesz wybrać indeks podczas rozpoczynania nowego czatu. Możesz wtedy zadać pytanie w UX, a wiedza zostanie automatycznie pobrana z wybranego indeksu. Należy pamiętać, że po rozpoczęciu konwersacji względem określonego indeksu nie ma możliwości przełączenia na inny indeks.

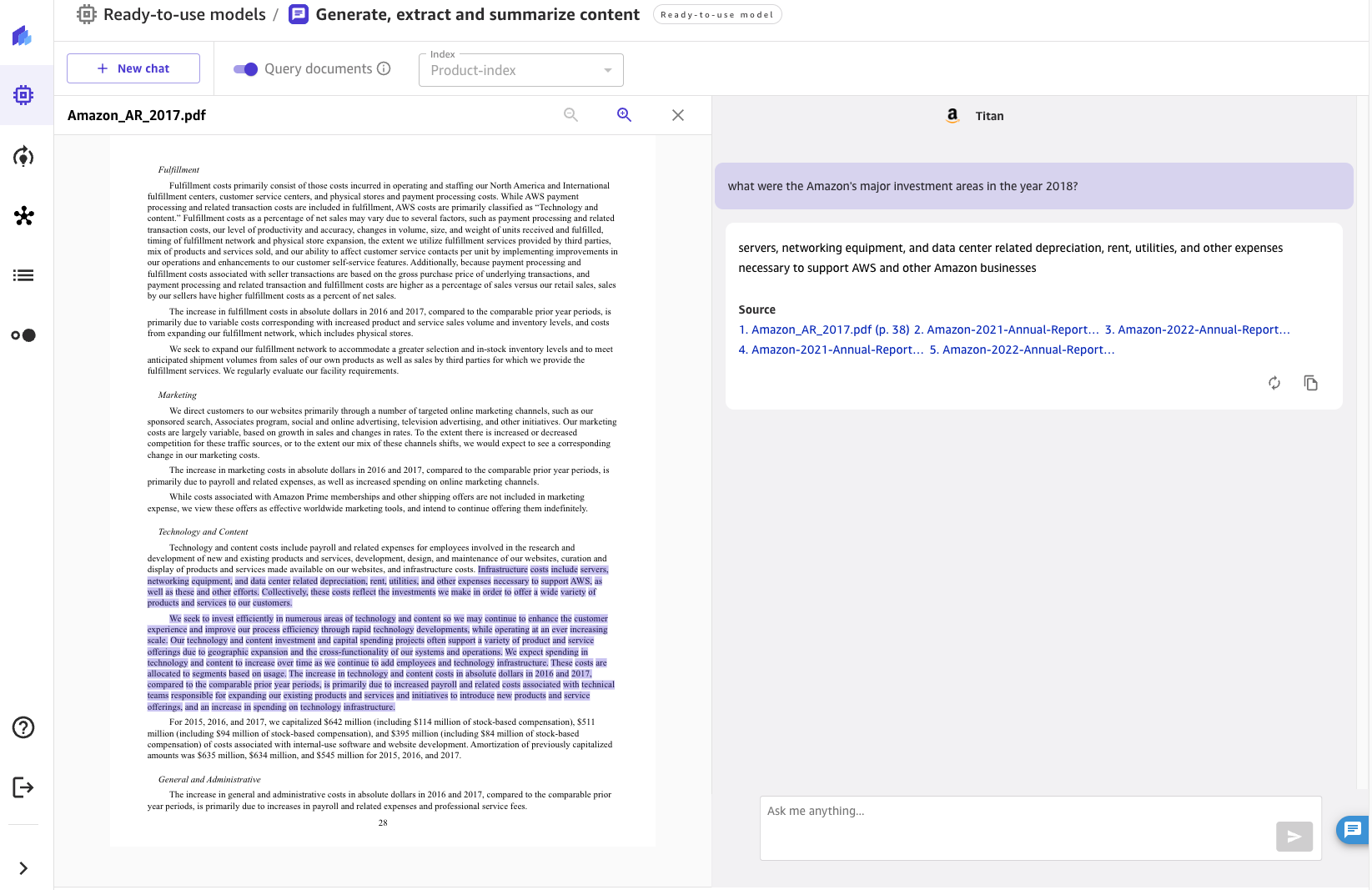

Na zadawane pytania na czacie zostanie wyświetlona odpowiedź wygenerowana przez FM wraz z dokumentami źródłowymi, które przyczyniły się do wygenerowania odpowiedzi. Po kliknięciu dowolnego dokumentu źródłowego Canvas otwiera podgląd dokumentu, podświetlając fragment wykorzystany przez FM.

Wnioski

Konwersacyjna sztuczna inteligencja ma ogromny potencjał transformacji doświadczeń klientów i pracowników, zapewniając asystentowi przypominającemu człowieka naturalne i intuicyjne interakcje, takie jak:

- Wykonywanie badań na dany temat lub wyszukiwanie i przeglądanie bazy wiedzy organizacji

- Podsumowanie dużej ilości treści w celu szybkiego zebrania spostrzeżeń

- Wyszukiwanie Podmiotów, Sentymentów, PII i innych przydatnych danych oraz zwiększanie wartości biznesowej nieustrukturyzowanych treści

- Generowanie projektów dokumentów i korespondencji biznesowej

- Tworzenie artykułów merytorycznych z różnych źródeł wewnętrznych (incydenty, dzienniki czatów, wiki)

Innowacyjna integracja interfejsów czatu, wyszukiwania wiedzy i FM umożliwia przedsiębiorstwom udzielanie dokładnych, odpowiednich odpowiedzi na pytania użytkowników, wykorzystując swoją wiedzę dziedzinową i źródła prawdy.

Łącząc SageMaker Canvas z bazami wiedzy w Amazon Kendra, organizacje mogą przechowywać swoje zastrzeżone dane we własnym środowisku, jednocześnie korzystając z najnowocześniejszych możliwości FM w zakresie języka naturalnego. Wraz z wprowadzeniem funkcji Query Documents w SageMaker Canvas ułatwiamy każdemu przedsiębiorstwu korzystanie z LLM i wiedzy przedsiębiorstwa jako źródła prawdy w celu zapewnienia bezpiecznego czatu. Cała ta funkcjonalność jest dostępna w formacie bez kodu, co pozwala firmom uniknąć wykonywania powtarzalnych i niewyspecjalizowanych zadań.

Aby dowiedzieć się więcej o SageMaker Canvas i o tym, jak ułatwia każdemu rozpoczęcie nauki maszynowej, zapoznaj się z sekcją Ogłoszenie SageMaker Canvas. Dowiedz się więcej o tym, jak SageMaker Canvas pomaga wspierać współpracę między analitykami danych i analitykami biznesowymi, czytając artykuł Twórz, udostępniaj i wdrażaj posty. Na koniec, aby dowiedzieć się, jak stworzyć własny przepływ pracy w ramach generowania rozszerzonego pobierania, zobacz SageMaker JumpStart RAG.

Referencje

Lewis, P., Perez, E., Piktus, A., Petroni, F., Karpukhin, V., Goyal, N., Küttler, H., Lewis, M., Yih, W., Rocktäschel, T., Riedel, S., Kiela, D. (2020). Generowanie wspomagane wyszukiwaniem dla zadań NLP wymagających dużej wiedzy. Postępy w neuronowych systemach przetwarzania informacji, 33, 9459-9474.

O autorach

Davide Gallitelli jest starszym specjalistą architektem rozwiązań w zakresie AI/ML. Mieszka w Brukseli i blisko współpracuje z klientami na całym świecie, którzy chcą wdrożyć technologie uczenia maszynowego o niskiej zawartości kodu/bez kodu oraz generatywnej sztucznej inteligencji. Od najmłodszych lat jest programistą, programować zaczął w wieku 7 lat. Naukę AI/ML rozpoczął na uniwersytecie i od tego czasu się w tym zakochał.

Davide Gallitelli jest starszym specjalistą architektem rozwiązań w zakresie AI/ML. Mieszka w Brukseli i blisko współpracuje z klientami na całym świecie, którzy chcą wdrożyć technologie uczenia maszynowego o niskiej zawartości kodu/bez kodu oraz generatywnej sztucznej inteligencji. Od najmłodszych lat jest programistą, programować zaczął w wieku 7 lat. Naukę AI/ML rozpoczął na uniwersytecie i od tego czasu się w tym zakochał.

Bilala Alama jest architektem rozwiązań dla przedsiębiorstw w AWS, specjalizującym się w branży usług finansowych. Przez większość dni Bilal pomaga klientom w budowaniu, ulepszaniu i zabezpieczaniu środowiska AWS w celu wdrożenia ich najważniejszych obciążeń. Ma rozległe doświadczenie w branży telekomunikacyjnej, sieciowej i tworzeniu oprogramowania. Ostatnio zastanawiał się nad wykorzystaniem AI/ML do rozwiązywania problemów biznesowych.

Bilala Alama jest architektem rozwiązań dla przedsiębiorstw w AWS, specjalizującym się w branży usług finansowych. Przez większość dni Bilal pomaga klientom w budowaniu, ulepszaniu i zabezpieczaniu środowiska AWS w celu wdrożenia ich najważniejszych obciążeń. Ma rozległe doświadczenie w branży telekomunikacyjnej, sieciowej i tworzeniu oprogramowania. Ostatnio zastanawiał się nad wykorzystaniem AI/ML do rozwiązywania problemów biznesowych.

Paszmeńska tajemnica jest Senior Product Managerem w AWS. Poza pracą Paszmina lubi wędrówki pełne przygód, fotografię i spędzanie czasu z rodziną.

Paszmeńska tajemnica jest Senior Product Managerem w AWS. Poza pracą Paszmina lubi wędrówki pełne przygód, fotografię i spędzanie czasu z rodziną.

Dana Sinnreicha jest starszym menedżerem produktu w AWS, pomagającym w demokratyzacji uczenia maszynowego z małą ilością kodu/bez kodu. Przed AWS Dan budował i komercjalizował platformy SaaS dla przedsiębiorstw oraz modele szeregów czasowych wykorzystywane przez inwestorów instytucjonalnych do zarządzania ryzykiem i konstruowania optymalnych portfeli. Poza pracą można go spotkać grającego w hokeja, nurkującego i czytającego science fiction.

Dana Sinnreicha jest starszym menedżerem produktu w AWS, pomagającym w demokratyzacji uczenia maszynowego z małą ilością kodu/bez kodu. Przed AWS Dan budował i komercjalizował platformy SaaS dla przedsiębiorstw oraz modele szeregów czasowych wykorzystywane przez inwestorów instytucjonalnych do zarządzania ryzykiem i konstruowania optymalnych portfeli. Poza pracą można go spotkać grającego w hokeja, nurkującego i czytającego science fiction.

- Dystrybucja treści i PR oparta na SEO. Uzyskaj wzmocnienie już dziś.

- PlatoData.Network Pionowe generatywne AI. Wzmocnij się. Dostęp tutaj.

- PlatoAiStream. Inteligencja Web3. Wiedza wzmocniona. Dostęp tutaj.

- PlatonESG. Węgiel Czysta technologia, Energia, Środowisko, Słoneczny, Gospodarowanie odpadami. Dostęp tutaj.

- Platon Zdrowie. Inteligencja w zakresie biotechnologii i badań klinicznych. Dostęp tutaj.

- Źródło: https://aws.amazon.com/blogs/machine-learning/empower-your-business-users-to-extract-insights-from-company-documents-using-amazon-sagemaker-canvas-generative-ai/

- :ma

- :Jest

- :nie

- :Gdzie

- ][P

- $W GÓRĘ

- 100

- 12

- 2020

- 2021

- 2023

- 225

- 7

- a

- zdolność

- Zdolny

- O nas

- przyśpieszony

- dostęp

- dostęp

- dostępny

- dokładny

- Dodatkowy

- przyjąć

- Po

- przed

- wiek

- AI

- AI / ML

- Wszystkie kategorie

- Pozwalać

- wzdłuż

- już

- zawsze

- Amazonka

- Amazonka Kendra

- Amazon Sage Maker

- Płótno Amazon SageMaker

- Amazon Web Services

- wśród

- an

- analiza

- analityk

- analitycy

- i

- ogłosił

- Inne

- odpowiedź

- każdy

- Pszczoła

- stosowany

- Aplikuj

- podejście

- właściwy

- architektura

- SĄ

- na około

- towary

- AS

- zapytać

- Asystent

- powiązany

- At

- zwiększać

- zwiększona

- automatycznie

- dostępny

- uniknąć

- AWS

- poparła

- baza

- na podstawie

- BE

- być

- jest

- korzystne

- pomiędzy

- Bruksela

- budować

- Budowanie

- wybudowany

- biznes

- biznes

- przycisk

- by

- powołanie

- CAN

- brezentowy

- możliwości

- zdolność

- zdobyć

- Etui

- ZOBACZ

- wybór

- Dodaj

- kliknij

- dokładnie

- Chmura

- kod

- Kodowanie

- współpraca

- kolekcja

- jak

- przyjście

- Komunikacja

- sukcesy firma

- porównanie

- zgodny

- kompleks

- komputer

- Wizja komputerowa

- systemu

- skonfigurowany

- Podłączanie

- zgodny

- Konsola

- skonstruować

- zawartość

- treść

- kontynuować

- przyczyniły

- Rozmowa

- rozmowy

- konwertować

- przeliczone

- Stwórz

- krytyczny

- klient

- Klientów

- dane

- Bazy danych

- Dni

- głęboko

- zdemokratyzować

- rozwijać

- wdrażanie

- opisać

- życzenia

- detal

- Wykrywanie

- Deweloper

- oprogramowania

- dyskutować

- różny

- nurkowanie

- dokument

- dokumenty

- domena

- e

- łatwiej

- łatwo

- osadzanie

- Pracownik

- upoważniać

- umożliwiać

- włączony

- Umożliwia

- wzbogacać

- zapewnia

- zapewnienie

- Enterprise

- przedsiębiorstwa

- podmioty

- Środowisko

- wszyscy

- przykład

- rozszerzony

- doświadczenie

- odkryj

- rozległy

- Szerokie doświadczenie

- zewnętrzny

- wyciąg

- Upadły

- członków Twojej rodziny

- Cecha

- Fikcja

- Akta

- W końcu

- budżetowy

- usługi finansowe

- i terminów, a

- Skupiać

- obserwuj

- następujący

- W razie zamówieenia projektu

- format

- Sprzyjać

- znaleziono

- Fundacja

- często

- od

- Funkcjonalność

- zbierać

- Generować

- wygenerowane

- generujący

- generacja

- generatywny

- generatywna sztuczna inteligencja

- otrzymać

- dany

- globus

- zarządzanie

- poprowadzi

- Prowadzenie

- uprząż

- Have

- he

- pomoc

- pomaga

- podświetlanie

- Piesze wędrówki

- jego

- W jaki sposób

- How To

- HTML

- http

- HTTPS

- if

- ilustruje

- ogromny

- podnieść

- in

- Włącznie z

- wzrastający

- wskaźnik

- indeksy

- Indeksy

- przemysłowy

- przemysł

- Informacja

- Innowacyjny

- spostrzeżenia

- instytucjonalny

- inwestorzy instytucjonalni

- integracja

- interakcji

- Interakcje

- interfejsy

- wewnętrzny

- najnowszych

- Wprowadzenie

- intuicyjny

- Inwestorzy

- IT

- JEGO

- jpg

- skok

- Trzymać

- Wiedząc

- wiedza

- Zarządzanie wiedzą

- język

- duży

- uruchomić

- UCZYĆ SIĘ

- nauka

- pozwala

- poziomy

- Chwytak

- Biblioteka

- Linia

- Lista

- poszukuje

- miłość

- maszyna

- uczenie maszynowe

- Utrzymywanie

- robić

- Dokonywanie

- zarządzanie

- i konserwacjami

- kierownik

- sposób

- wiele

- ML

- model

- modele

- jeszcze

- większość

- wielokrotność

- Naturalny

- Przetwarzanie języka naturalnego

- potrzebne

- sieci

- nerwowy

- Nowości

- nlp

- już dziś

- of

- poza

- on

- pewnego razu

- ONE

- otwarcie

- otwiera

- operacyjny

- operacje

- Optymalny

- or

- organizacji

- oryginalny

- Inne

- Pozostałe

- na zewnątrz

- wyniki

- wydajność

- Wyjścia

- zewnętrzne

- własny

- część

- wykonać

- wykonywane

- uprawnienia

- fotografia

- obraz

- Platformy

- plato

- Analiza danych Platona

- PlatoDane

- gra

- portfele

- możliwy

- Post

- potencjał

- power

- przepowiednia

- warunki wstępne

- teraźniejszość

- Podgląd

- poprzedni

- prywatny

- problemy

- wygląda tak

- przetwarzanie

- produkować

- Produkt

- product manager

- właściwy

- własność

- zapewniać

- pod warunkiem,

- że

- zapytania

- pytanie

- pytania

- szybko

- szybko

- Czytający

- niedawno

- zmniejszyć

- redukcja

- odnosić się

- referencje

- zwolnić

- wydany

- powtarzalne

- wymagany

- Wymaga

- Badania naukowe

- odpowiedź

- Odpowiedzi

- Efekt

- przeglądu

- Ryzyko

- s

- SaaS

- zabezpieczenia

- sagemaker

- nauka

- Fantastyka naukowa

- Naukowcy

- Ekran

- bezszwowy

- Szukaj

- Sekcja

- bezpieczne

- zabezpieczenia

- Szukajcie

- wybrany

- wybierając

- senior

- wrażliwy

- sentyment

- uczucia

- służył

- Usługi

- Sesja

- zestaw

- ustawienie

- w panelu ustawień

- ustawienie

- Share

- powinien

- pokazać

- pokazane

- ponieważ

- umiejętności

- So

- Tworzenie

- rozwoju oprogramowania

- rozwiązanie

- Rozwiązania

- ROZWIĄZANIA

- Źródło

- pozyskiwany

- Źródła

- specjalista

- specyficzny

- Spędzanie

- początek

- rozpoczęty

- Startowy

- state-of-the-art

- Ewolucja krok po kroku

- Cel

- Nadal

- taki

- streszczać

- wsparcie

- Przełącznik

- system

- zadania

- Zespoły

- Techniczny

- Technologies

- Telco

- zasady

- niż

- że

- Połączenia

- Informacje

- Źródło

- ich

- Im

- następnie

- Tam.

- to

- tych

- Przez

- czas

- do

- Top

- aktualny

- Przekształcać

- naprawdę

- zaufany

- strojenie

- SKRĘCAĆ

- dla

- zasadniczy

- uniwersytet

- aż do

- nowomodny

- Aktualizacja

- podnoszący na duchu

- posługiwać się

- używany

- Użytkownik

- Użytkownicy

- zastosowania

- za pomocą

- ux

- wartość

- różnorodność

- początku.

- wizja

- kłęby

- W

- spacer

- chcieć

- była

- we

- sieć

- usługi internetowe

- były

- jeśli chodzi o komunikację i motywację

- który

- Podczas

- będzie

- w

- w ciągu

- bez

- Praca

- workflow

- działa

- pisanie

- You

- młody

- Twój

- zefirnet