- 12 maja 2014 r.

- Wasilis Wryniotis

- . 4 komentarzy

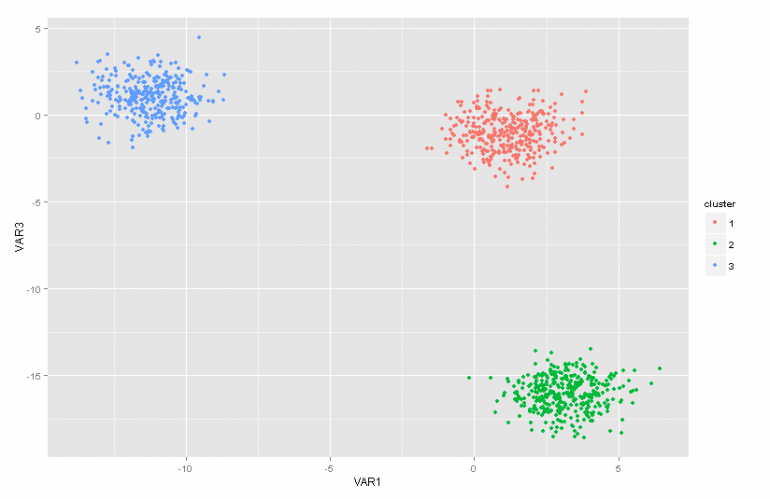

Ten wpis na blogu jest drugą częścią serii artykułów na temat modeli mieszanin Dirichlet Process. W poprzednim artykule mieliśmy przegląd kilku technik analizy skupień i omówiliśmy niektóre problemy/ograniczenia wynikające z ich używania. Ponadto przedstawiliśmy pokrótce modele mieszanin procesowych Dirichleta, omówiliśmy ich użyteczność oraz przedstawiliśmy niektóre z ich zastosowań.

Aktualizacja: Platforma uczenia maszynowego Datumbox jest teraz open-source i bezpłatna pobieranie. Zapoznaj się z pakietem com.datumbox.framework.machinelearning.clustering, aby zobaczyć implementację modeli mieszania procesów Dirichleta w Javie.

Modele mieszanek procesowych Dirichleta mogą być na początku nieco trudne do przełknięcia, głównie dlatego, że są to modele mieszanek nieskończonych z wieloma różnymi reprezentacjami. Na szczęście dobrym sposobem podejścia do tematu jest rozpoczęcie od modeli skończonych mieszanin z rozkładem Dirichleta, a następnie przejście do modeli nieskończonych.

W związku z tym w tym artykule pokrótce przedstawię kilka ważnych rozkładów, których będziemy potrzebować, użyjemy ich do skonstruowania modelu Dirichleta Prior z wielomianowym prawdopodobieństwem, a następnie przejdziemy do modelu skończonej mieszanki opartego na rozkładzie Dirichleta.

1. Dystrybucja beta

Połączenia Dystrybucja beta jest rodziną rozkładów ciągłych, która jest zdefiniowana w przedziale [0,1]. Jest sparametryzowany przez dwa dodatnie parametry a i b, a jego postać w dużym stopniu zależy od wyboru tych dwóch parametrów.

Rysunek 1: Rozkład beta dla różnych parametrów a, b

Rozkład Beta jest powszechnie używany do modelowania rozkładu względem prawdopodobieństw i ma następującą gęstość prawdopodobieństwa:

![]()

Równanie 1: Beta PDF

Gdzie Γ(x) jest funkcją gamma, a a, b parametrami rozkładu. Beta jest powszechnie używana jako rozkład wartości prawdopodobieństwa i daje nam prawdopodobieństwo, że modelowane prawdopodobieństwo jest równe określonej wartości P = p0. Z definicji rozkład Beta jest w stanie modelować prawdopodobieństwo wyników binarnych, które przyjmują wartości prawdziwe lub fałszywe. Parametry a i b można uznać za pseudoliczniki odpowiednio sukcesu i niepowodzenia. W ten sposób dystrybucja beta modeluje prawdopodobieństwo sukcesu przy danych a sukcesach i b niepowodzeniach.

2. Dystrybucja Dirichleta

Połączenia Dystrybucja Dirichleta jest uogólnieniem dystrybucji beta dla wielu wyników (lub innymi słowy jest używany dla wydarzeń z wieloma wynikami). Jest sparametryzowany k parametrami ai co musi być pozytywne. Rozkład Dirichleta jest równy rozkładowi Beta, gdy liczba zmiennych k = 2.

Rysunek 2: Rozkład Dirichleta dla różnych ai parametry

Rozkład Dirichleta jest powszechnie używany do modelowania rozkładu na prawdopodobieństwach i ma następującą gęstość prawdopodobieństwa:

![]()

Równanie 2: Dirichlet PDF

Gdzie Γ(x) jest funkcją gamma, pi przyjmować wartości w [0,1] i Σpi=1. Rozkład Dirichleta modeluje łączny rozkład pi i daje prawdopodobieństwo P1=p1,P2=p2,….,Pk-1=pk-1 z P.k=1 – Pi. Podobnie jak w przypadku Beta, ai parametry można traktować jako pseudoliczniki wystąpień każdego zdarzenia i. Rozkład Dirichleta służy do modelowania prawdopodobieństwa wystąpienia k rywalizujących zdarzeń i jest często oznaczany jako Dirichlet(a).

3. Przeor Dirichleta z prawdopodobieństwem wielomianowym

Jak wspomniano wcześniej, rozkład Dirichleta można postrzegać jako rozkład nad rozkładami prawdopodobieństwa. W przypadkach, w których chcemy modelować prawdopodobieństwo wystąpienia k zdarzeń, należy zastosować podejście bayesowskie Wielomianowe prawdopodobieństwo i priorytety Dirichleta .

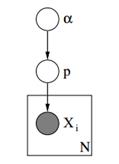

Poniżej możemy zobaczyć graficzny model takiego modelu.

Rysunek 3: Graficzny model przeorów Dirichleta z wielomianowym prawdopodobieństwem

W powyższym modelu graficznym α jest ak-wymiarowym wektorem z hiperparametrami a priori Dirichleta, p jest ak-wymiarowym wektorem z wartościami prawdopodobieństwa i xi jest wartością skalarną od 1 do k, która mówi nam, jakie zdarzenie miało miejsce. Na koniec powinniśmy zauważyć, że P jest zgodne z rozkładem Dirichleta sparametryzowanym wektorem α, a zatem P ~ Dirichlet(α), podczas gdy xi zmienne są zgodne z rozkładem dyskretnym (wielomianowym) sparametryzowanym wektorem p prawdopodobieństw. Podobne modele hierarchiczne można stosować w klasyfikacji dokumentów do reprezentowania rozkładów częstotliwości słów kluczowych w różnych tematach.

4. Model skończonej mieszaniny z rozkładem Dirichleta

Używając Dystrybucji Dirichleta możemy skonstruować Model skończonej mieszanki które można wykorzystać do klastrowania. Załóżmy, że mamy następujący model:

![]()

![]()

![]()

![]()

Równanie 3: Model mieszaniny skończonej z rozkładem Dirichleta

Powyższy model zakłada, co następuje: Mamy zbiór danych X zn obserwacjami i chcemy na nim przeprowadzić analizę skupień. K jest stałą liczbą skończoną, która pokazuje liczbę klastrów/komponentów, których użyjemy. Ci zmienne przechowują przypisanie do klastra obserwacji Xi, przyjmują wartości od 1 do k i podążają za rozkładem dyskretnym z parametrem p, który jest prawdopodobieństwem mieszaniny składników. F jest rozkładem generatywnym naszego X i jest sparametryzowany parametrem ![]() co zależy od przypisania do klastra każdej obserwacji. W sumie mamy k unikalnych

co zależy od przypisania do klastra każdej obserwacji. W sumie mamy k unikalnych ![]() parametry równe liczbie naszych klastrów. ten

parametry równe liczbie naszych klastrów. ten ![]() zmienna przechowuje parametry parametryzujące generatywną dystrybucję F i zakładamy, że podąża ona za bazą G0 dystrybucja. Zmienna p przechowuje wartości procentowe mieszaniny dla każdego z k skupień i podąża za Dirichletem z parametrami α/k. Ostatecznie α jest ak-wymiarowym wektorem z hiperparametrami (pseudoliczbami) rozkładu Dirichleta [2].

zmienna przechowuje parametry parametryzujące generatywną dystrybucję F i zakładamy, że podąża ona za bazą G0 dystrybucja. Zmienna p przechowuje wartości procentowe mieszaniny dla każdego z k skupień i podąża za Dirichletem z parametrami α/k. Ostatecznie α jest ak-wymiarowym wektorem z hiperparametrami (pseudoliczbami) rozkładu Dirichleta [2].

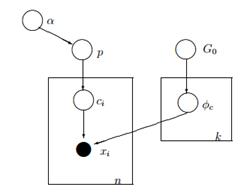

Rysunek 4: Model graficzny modelu skończonej mieszaniny z rozkładem Dirichleta

Prostszy i mniej matematyczny sposób wyjaśnienia modelu jest następujący. Zakładamy, że nasze dane można pogrupować w k klastrów. Każdy klaster ma swoje własne parametry ![]() a te parametry są wykorzystywane do generowania naszych danych. Parametry

a te parametry są wykorzystywane do generowania naszych danych. Parametry ![]() zakłada się, że podąża za pewnym rozkładem G0. Każda obserwacja jest reprezentowana przez wektor xi i ACi wartość, która wskazuje klaster, do którego należy. W konsekwencji ci może być postrzegana jako zmienna, która następuje po Rozkładzie Dyskretnym z parametrem p, który jest niczym innym jak prawdopodobieństwami mieszanin, czyli prawdopodobieństwem wystąpienia każdego skupienia. Biorąc pod uwagę, że zajmujemy się naszym problemem w sposób bayesowski, nie traktujemy parametru p jako stałego nieznanego wektora. Zamiast tego zakładamy, że P podąża za Dirichletem, który jest sparametryzowany przez hiperparametry α/k.

zakłada się, że podąża za pewnym rozkładem G0. Każda obserwacja jest reprezentowana przez wektor xi i ACi wartość, która wskazuje klaster, do którego należy. W konsekwencji ci może być postrzegana jako zmienna, która następuje po Rozkładzie Dyskretnym z parametrem p, który jest niczym innym jak prawdopodobieństwami mieszanin, czyli prawdopodobieństwem wystąpienia każdego skupienia. Biorąc pod uwagę, że zajmujemy się naszym problemem w sposób bayesowski, nie traktujemy parametru p jako stałego nieznanego wektora. Zamiast tego zakładamy, że P podąża za Dirichletem, który jest sparametryzowany przez hiperparametry α/k.

5. Praca z nieskończonymi k klastrami

Poprzedni model mieszany pozwala nam wykonywać nienadzorowane uczenie się, jest zgodny z podejściem bayesowskim i może zostać rozszerzony do struktury hierarchicznej. Niemniej jednak jest to model skończony, ponieważ wykorzystuje stałą predefiniowaną liczbę k skupień. W rezultacie wymaga to od nas określenia liczby komponentów przed wykonaniem Analizy skupień, a jak omówiliśmy wcześniej w większości aplikacji, jest to nieznana i niemożliwa do łatwego oszacowania.

Jednym ze sposobów rozwiązania tego problemu jest wyobrażenie sobie, że k ma bardzo dużą wartość, która dąży do nieskończoności. Innymi słowy, możemy sobie wyobrazić granicę tego modelu, gdy k dąży do nieskończoności. Jeśli tak jest, to widzimy, że pomimo tego, że liczba klastrów k jest nieskończona, rzeczywista liczba aktywnych klastrów (tych, które mają co najmniej jedną obserwację) nie może być większa niż n (czyli całkowita liczba obserwacji w naszym zbiorze danych). W rzeczywistości, jak zobaczymy później, liczba aktywnych klastrów będzie znacznie mniejsza niż n i będą one proporcjonalne do ![]() .

.

Oczywiście przyjęcie granicy k do nieskończoności nie jest trywialne. Powstaje kilka pytań, np. czy można przyjąć taką granicę, jak ten model będzie wyglądał i jak możemy skonstruować? i użyj takiego modelu.

W następnym artykule skupimy się dokładnie na tych pytaniach: zdefiniujemy Proces Dirichleta, przedstawimy różne reprezentacje DP, a na koniec skupimy się na Chińskim Procesie Restauracyjnym, który jest intuicyjnym i skutecznym sposobem skonstruowania Procesu Dirichleta.

Mam nadzieję, że ten post był dla Ciebie przydatny. Jeśli tak, poświęć chwilę na udostępnienie artykułu na Facebooku i Twitterze. 🙂.

- AI

- ai sztuka

- generator sztuki ai

- masz robota

- sztuczna inteligencja

- certyfikacja sztucznej inteligencji

- robot sztucznej inteligencji

- roboty sztucznej inteligencji

- oprogramowanie sztucznej inteligencji

- blockchain

- konferencja blockchain ai

- pomysłowość

- sztuczna inteligencja konwersacyjna

- konferencja kryptograficzna

- Dall's

- Skrzynka odniesienia

- głęboka nauka

- google to

- uczenie maszynowe

- Uczenie maszynowe i statystyki

- plato

- Platon Ai

- Analiza danych Platona

- Gra Platona

- PlatoDane

- platogaming

- skala ai

- składnia

- zefirnet