Fałszywe wiadomości, definiowane jako wiadomości, które przekazują lub zawierają fałszywe, sfabrykowane lub celowo wprowadzające w błąd informacje, pojawiały się już wraz z pojawieniem się prasy drukarskiej. Szybkie rozprzestrzenianie się fałszywych wiadomości i dezinformacji w Internecie nie tylko wprowadza w błąd opinię publiczną, ale może również mieć głęboki wpływ na społeczeństwo, politykę, gospodarkę i kulturę. Przykłady obejmują:

- Kultywowanie nieufności w mediach

- Podważanie procesu demokratycznego

- Rozpowszechnianie fałszywej lub zdyskredytowanej nauki (na przykład ruch antyszczepionkowy)

Postępy w sztucznej inteligencji (AI) i uczeniu maszynowym (ML) jeszcze bardziej ułatwiły tworzenie narzędzi do tworzenia i udostępniania fałszywych wiadomości. Wczesne przykłady obejmują zaawansowane boty społecznościowe i zautomatyzowane konta, które usprawniają początkowy etap rozpowszechniania fałszywych wiadomości. Ogólnie rzecz biorąc, dla opinii publicznej nie jest rzeczą trywialną ustalenie, czy takie konta to ludzie, czy boty. Ponadto boty społecznościowe nie są narzędziami nielegalnymi i wiele firm legalnie je kupuje w ramach swojej strategii marketingowej. Dlatego nie jest łatwo systematycznie ograniczać wykorzystanie botów społecznościowych.

Ostatnie odkrycia w dziedzinie generatywnej sztucznej inteligencji umożliwiają tworzenie treści tekstowych w niespotykanym dotąd tempie za pomocą dużych modeli językowych (LLM). LLM to generatywne modele tekstu AI z ponad 1 miliardem parametrów, które ułatwiają syntezę tekstu wysokiej jakości.

W tym poście opisujemy, w jaki sposób można wykorzystać LLM do rozwiązania powszechnego problemu wykrywania fałszywych wiadomości. Sugerujemy, aby LLM były wystarczająco zaawansowane do tego zadania, zwłaszcza jeśli ulepszono szybkie techniki, takie jak Łańcuch myśli i Reagować są używane w połączeniu z narzędziami do wyszukiwania informacji.

Zilustrujemy to tworząc plik LangChain aplikacja, która po otrzymaniu wiadomości informuje użytkownika, czy artykuł jest prawdziwy, czy fałszywy, używając języka naturalnego. Rozwiązanie również wykorzystuje Amazońska skała macierzysta, w pełni zarządzana usługa, która udostępnia modele podstawowe (FM) od Amazon i zewnętrznych dostawców modeli za pośrednictwem Konsola zarządzania AWS i interfejsy API.

LLM i fałszywe wiadomości

Zjawisko fałszywych wiadomości zaczęło szybko ewoluować wraz z pojawieniem się Internetu, a dokładniej mediów społecznościowych (Nielsen i in., 2017). W mediach społecznościowych fałszywe wiadomości mogą być szybko udostępniane w sieci użytkownika, co prowadzi do wyrobienia przez opinię publiczną błędnej zbiorowej opinii. Ponadto ludzie często propagują fałszywe wiadomości impulsywnie, ignorując faktyczność treści, jeśli wiadomość odpowiada ich osobistym normom (Tsipursky i in. 2018). Badania z zakresu nauk społecznych sugerują, że błąd poznawczy (błąd potwierdzenia, efekt modowego i błąd polegający na wspieraniu wyboru) jest jednym z najważniejszych czynników podejmowania irracjonalnych decyzji, zarówno pod względem tworzenia, jak i konsumpcji fałszywych wiadomości (Kim i in., 2021). Oznacza to również, że odbiorcy wiadomości dzielą się i konsumują informacje wyłącznie w celu wzmocnienia swoich przekonań.

Zdolność generatywnej sztucznej inteligencji do tworzenia bogatych treści tekstowych w niespotykanym dotychczas tempie pogłębia problem fałszywych wiadomości. Przykładem wartym wspomnienia jest technologia deepfake – łączenie różnych obrazów w oryginalnym filmie i generowanie innego filmu. Oprócz zamiaru dezinformacji, jaki wnoszą do tego ludzie, LLM stwarzają zupełnie nowy zestaw wyzwań:

- Błędy rzeczowe – W przypadku osób z wykształceniem wyższym ryzyko wystąpienia błędów merytorycznych jest zwiększone ze względu na charakter ich szkolenia i zdolność do kreatywności podczas tworzenia kolejnych słów w zdaniu. Trening LLM polega na wielokrotnym prezentowaniu modelu z niekompletnymi danymi wejściowymi, a następnie stosowaniu technik szkoleniowych ML, aż do prawidłowego uzupełnienia luk, ucząc się w ten sposób struktury języka i modelu świata opartego na języku. W rezultacie, chociaż LLM świetnie dopasowują i ponownie łączą wzorce („papugi stochastyczne”), nie radzą sobie z wieloma prostymi zadaniami wymagającymi logicznego rozumowania lub dedukcji matematycznej i mogą powodować halucynacje. Dodatkowo temperatura jest jednym z parametrów wejściowych LLM, który kontroluje zachowanie modelu podczas generowania kolejnego słowa w zdaniu. Wybierając wyższą temperaturę, model użyje słowa o niższym prawdopodobieństwie, zapewniając bardziej losową odpowiedź.

- Przydługi – Generowane teksty są zazwyczaj długie i brakuje im jasno określonej szczegółowości poszczególnych faktów.

- Brak sprawdzania faktów – Nie ma dostępnych standardowych narzędzi do sprawdzania faktów w procesie generowania tekstu.

Ogólnie rzecz biorąc, połączenie ludzkiej psychologii i ograniczeń systemów sztucznej inteligencji stworzyło idealną burzę do rozprzestrzeniania się fałszywych wiadomości i dezinformacji w Internecie.

Omówienie rozwiązania

LLM wykazują wyjątkowe zdolności w zakresie generowania, rozumienia i uczenia się języka za pomocą kilku strzałów. Szkolą się na ogromnym zbiorze tekstów z Internetu, gdzie jakość i dokładność wydobytego języka naturalnego może nie być zapewniona.

W tym poście przedstawiamy rozwiązanie do wykrywania fałszywych wiadomości w oparciu zarówno o podejście oparte na łańcuchu myśli, jak i ponownym działaniu (wnioskowanie i działanie). Najpierw omawiamy te dwie szybkie techniki inżynieryjne, a następnie pokazujemy ich implementację za pomocą LangChain i Amazon Bedrock.

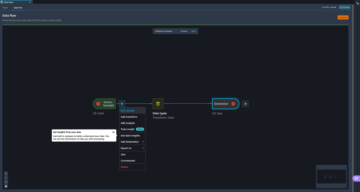

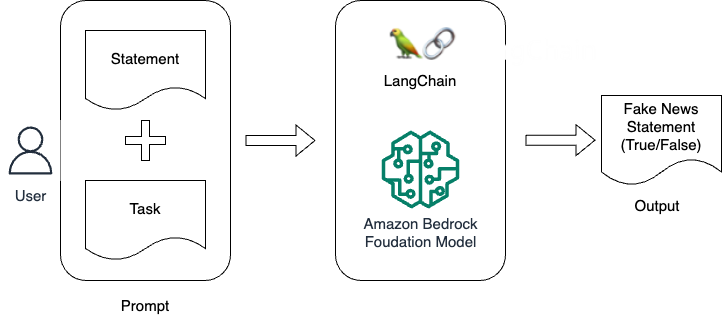

Poniższy diagram architektury przedstawia rozwiązanie naszego detektora fałszywych wiadomości.

Diagram architektury do wykrywania fałszywych wiadomości.

Używamy podzbioru Zbiór danych FEVER zawierające oświadczenie oraz podstawową prawdę o stwierdzeniu wskazującą na fałszywe, prawdziwe lub nieweryfikowalne twierdzenia (Thorne J. i in., 2018).

Przepływ pracy można podzielić na następujące etapy:

- Użytkownik wybiera jedno ze stwierdzeń, aby sprawdzić, czy jest fałszywe, czy prawdziwe.

- Oświadczenie i zadanie wykrywania fałszywych wiadomości są włączone do zachęty.

- Podpowiedź jest przekazywana do LangChain, który wywołuje FM w Amazon Bedrock.

- Amazon Bedrock zwraca odpowiedź na żądanie użytkownika ze stwierdzeniem Prawda lub Fałsz.

W tym poście używamy modelu Claude v2 firmy Anthrophic (anthropic.claude-v2). Claude to generatywny LLM oparty na badaniach Anthropic nad tworzeniem niezawodnych, interpretowalnych i sterowalnych systemów AI. Stworzony przy użyciu technik takich jak sztuczna inteligencja konstytucyjna i trening nieszkodliwości, Claude wyróżnia się przemyślanym dialogiem, tworzeniem treści, złożonym rozumowaniem, kreatywnością i kodowaniem. Jednakże, korzystając z Amazon Bedrock i naszej architektury rozwiązań, mamy również elastyczność wyboru spośród innych FM dostarczanych przez Amazonka, Laboratoria AI21, Przystać do siebie, Stabilność ai.

Szczegóły implementacji znajdziesz w poniższych sekcjach. Kod źródłowy jest dostępny w repozytorium GitHub.

Wymagania wstępne

Do tego samouczka potrzebny jest terminal bash z językiem Python 3.9 lub nowszym zainstalowanym w systemie Linux, Mac lub podsystemie Windows dla systemu Linux oraz konto AWS.

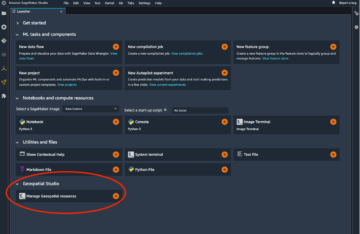

Zalecamy również użycie albo Studio Amazon SageMaker notatnik, o Chmura AWS9 przykład lub Elastyczna chmura obliczeniowa Amazon (Amazon EC2) instancja.

Wdrażaj wykrywanie fałszywych wiadomości za pomocą interfejsu API Amazon Bedrock

Rozwiązanie wykorzystuje interfejs API Amazon Bedrock, do którego można uzyskać dostęp za pomocą Interfejs wiersza poleceń AWS (AWS CLI), AWS SDK dla Pythona (Boto3)Lub Amazon Sage Maker zeszyt. Patrz Podręcznik użytkownika Amazon Bedrock po więcej informacji. W tym poście używamy interfejsu API Amazon Bedrock za pośrednictwem pakietu AWS SDK dla Pythona.

Skonfiguruj środowisko API Amazon Bedrock

Aby skonfigurować środowisko API Amazon Bedrock, wykonaj następujące kroki:

- Pobierz najnowszą wersję Boto3 lub zaktualizuj ją:

- Upewnij się, że skonfigurowałeś poświadczenia AWS za pomocą pliku

aws configurepolecenie lub przekaż je do klienta Boto3. - Zainstaluj najnowszą wersję LangChain:

Możesz teraz przetestować swoją konfigurację, korzystając z następującego skryptu powłoki Pythona. Skrypt tworzy instancję klienta Amazon Bedrock przy użyciu Boto3. Następnie wywołujemy list_foundation_models API umożliwiające pobranie listy modeli fundamentów dostępnych do użycia.

Po pomyślnym uruchomieniu poprzedniego polecenia powinieneś otrzymać listę FM z Amazon Bedrock.

LangChain jako szybkie rozwiązanie łączenia łańcuchowego

Aby wykryć fałszywe wiadomości dla danego zdania, postępujemy zgodnie z procesem rozumowania zerowego łańcucha myśli (Wei J. i in., 2022), który składa się z następujących kroków:

- Początkowo model próbuje stworzyć wypowiedź na temat pojawiających się wiadomości.

- Model tworzy wypunktowaną listę twierdzeń.

- Dla każdego stwierdzenia model określa, czy stwierdzenie jest prawdziwe, czy fałszywe. Należy pamiętać, że stosując tę metodologię, model opiera się wyłącznie na swojej wiedzy wewnętrznej (wagi obliczone w fazie przedtreningowej), aby wydać werdykt. Informacje te nie są na tym etapie weryfikowane z żadnymi danymi zewnętrznymi.

- Biorąc pod uwagę fakty, model odpowiada PRAWDA lub FAŁSZ dla danego stwierdzenia w podpowiedzi.

Aby osiągnąć te kroki, używamy LangChain, frameworku do tworzenia aplikacji opartych na modelach językowych. Ta struktura pozwala nam rozszerzać FM poprzez łączenie różnych komponentów w celu tworzenia zaawansowanych przypadków użycia. W tym rozwiązaniu korzystamy z wbudowanego Prosty łańcuch sekwencyjny w LangChain, aby utworzyć prosty łańcuch sekwencyjny. Jest to bardzo przydatne, ponieważ możemy pobrać dane wyjściowe z jednego łańcucha i wykorzystać je jako dane wejściowe w innym.

Amazon Bedrock jest zintegrowany z LangChain, więc wystarczy utworzyć jego instancję, przekazując plik model_id podczas tworzenia instancji obiektu Amazon Bedrock. W razie potrzeby parametry wnioskowania o modelu można udostępnić za pomocą pliku model_kwargs argument, taki jak:

- maxTokenCount – Maksymalna liczba tokenów w wygenerowanej odpowiedzi

- zatrzymajSekwencje – Sekwencja zatrzymania stosowana w modelu

- temperatura – Wartość z zakresu 0–1, gdzie 0 oznacza najbardziej deterministyczną, a 1 najbardziej kreatywną

- Top – Wartość z zakresu 0–1, używana do kontrolowania wyborów żetonów w oparciu o prawdopodobieństwo potencjalnych wyborów

Jeśli po raz pierwszy używasz podstawowego modelu Amazon Bedrock, poproś o dostęp do modelu, wybierając go z listy modeli na stronie Dostęp do modelu page na konsoli Amazon Bedrock, czyli w naszym przypadku jest to claude-v2 firmy Anthropic.

Następująca funkcja definiuje łańcuch podpowiedzi Łańcucha Myśli, o którym wspominaliśmy wcześniej, służący do wykrywania fałszywych wiadomości. Funkcja przyjmuje jako argumenty obiekt Amazon Bedrock (llm) i zachętę użytkownika (q). LangChaina Szablon podpowiedzi Funkcjonalność służy tutaj do predefiniowania przepisu na generowanie podpowiedzi.

Poniższy kod wywołuje funkcję, którą zdefiniowaliśmy wcześniej i podaje odpowiedź. Oświadczenie jest TRUE or FALSE. TRUE oznacza, że złożone oświadczenie zawiera prawdziwe fakty, oraz FALSE oznacza, że stwierdzenie zawiera co najmniej jeden błędny fakt.

Przykład instrukcji i odpowiedzi modelu znajduje się w następujących wynikach:

ReAct i narzędzia

W poprzednim przykładzie model poprawnie zidentyfikował, że stwierdzenie jest fałszywe. Jednak ponowne złożenie zapytania pokazuje niezdolność modelu do rozróżnienia poprawności faktów. Model nie posiada narzędzi umożliwiających weryfikację prawdziwości stwierdzeń znajdujących się poza jego własną pamięcią treningową, więc kolejne uruchomienia tego samego monitu mogą doprowadzić go do błędnego oznaczenia fałszywych stwierdzeń jako prawdziwych. W poniższym kodzie masz inną wersję tego samego przykładu:

Jedną z technik gwarantujących prawdziwość jest ReAct. Reagować (Yao S. i in., 2023) to szybka technika, która rozszerza model podstawowy o przestrzeń akcji agenta. W tym poście, a także w artykule ReAct, przestrzeń akcji implementuje wyszukiwanie informacji za pomocą akcji wyszukiwania, wyszukiwania i kończenia z prostego internetowego interfejsu API Wikipedii.

Powodem użycia ReAct w porównaniu z Chain-of-Thought jest wykorzystanie zewnętrznego wyszukiwania wiedzy w celu ulepszenia podstawowego modelu w celu wykrycia, czy dana wiadomość jest fałszywa czy prawdziwa.

W tym poście używamy implementacji ReAct firmy LangChain za pośrednictwem agenta ZERO_SHOT_REACT_DESCRIPTION. Modyfikujemy poprzednią funkcję, aby zaimplementować ReAct i korzystać z Wikipedii, korzystając z funkcji loading_tools z pliku langchain.agents.

Musimy także zainstalować pakiet Wikipedii:

!pip install Wikipedia

Poniżej znajduje się nowy kod:

Poniżej znajduje się wynik poprzedniej funkcji, biorąc pod uwagę tę samą instrukcję, która została użyta wcześniej:

Sprzątać

Aby zaoszczędzić koszty, usuń wszystkie zasoby wdrożone w ramach samouczka. Jeśli uruchomiłeś instancję AWS Cloud9 lub EC2, możesz ją usunąć za pomocą konsoli lub korzystając z interfejsu CLI AWS. Podobnie możesz usunąć notatnik SageMaker, który mogłeś utworzyć za pomocą konsoli SageMaker.

Ograniczenia i związane z nimi prace

Obszar wykrywania fałszywych wiadomości jest aktywnie badany w środowisku naukowym. W tym poście wykorzystaliśmy techniki Chain-of-Thought i ReAct i przy ocenie technik skupiliśmy się jedynie na trafności klasyfikacji techniki podpowiedzi (czy dane stwierdzenie jest prawdziwe czy fałszywe). Dlatego nie uwzględniliśmy innych ważnych aspektów, takich jak szybkość odpowiedzi, ani nie rozszerzyliśmy rozwiązania na dodatkowe źródła wiedzy poza Wikipedią.

Chociaż ten post skupiał się na dwóch technikach, Chain-of-Thought i ReAct, w obszernej pracy zbadano, w jaki sposób LLM mogą wykrywać, eliminować lub łagodzić fałszywe wiadomości. Lee i in. zaproponował zastosowanie modelu koder-dekoder wykorzystujący NER (rozpoznawanie nazwanych jednostek) do maskowania nazwanych podmiotów, aby mieć pewność, że zamaskowany token rzeczywiście wykorzystuje wiedzę zakodowaną w modelu językowym. Chern i in. opracował FacTool, który wykorzystuje zasady Chain-of-Thought do wyodrębniania roszczeń z podpowiedzi i w konsekwencji zbierania odpowiednich dowodów na roszczenia. Następnie LLM ocenia zasadność roszczenia na podstawie odzyskanej listy dowodów. Du E. i in. przedstawia podejście uzupełniające, w którym wiele LLM proponuje i omawia swoje indywidualne odpowiedzi i procesy rozumowania w wielu rundach, aby uzyskać wspólną ostateczną odpowiedź.

Na podstawie literatury widzimy, że skuteczność LLM w wykrywaniu fałszywych wiadomości wzrasta, gdy LLM są wzbogacane o wiedzę zewnętrzną i możliwość konwersacji między agentami. Jednakże podejścia te są bardziej złożone obliczeniowo, ponieważ wymagają wielu wywołań i interakcji modelu, dłuższych podpowiedzi i długich wywołań w warstwie sieci. Ostatecznie ta złożoność przekłada się na wzrost całkowitego kosztu. Przed wdrożeniem podobnych rozwiązań w produkcji zalecamy ocenę stosunku ceny do wydajności.

Wnioski

W tym poście zagłębiliśmy się w to, jak wykorzystać LLM do rozwiązania powszechnego problemu fałszywych wiadomości, który jest jednym z głównych wyzwań współczesnego społeczeństwa. Zaczęliśmy od nakreślenia wyzwań, jakie stwarzają fałszywe wiadomości, z naciskiem na ich potencjał wpływania na nastroje społeczne i powodowania zakłóceń społecznych.

Następnie wprowadziliśmy koncepcję LLM jako zaawansowanych modeli sztucznej inteligencji, które są szkolone na znacznej ilości danych. Dzięki temu obszernemu szkoleniu modele te mogą poszczycić się imponującą znajomością języka, co pozwala im tworzyć tekst przypominający ludzki. Dzięki tej możliwości zademonstrowaliśmy, jak można wykorzystać LLM w walce z fałszywymi wiadomościami, stosując dwie różne techniki szybkiego reagowania: Chain-of-Thought i ReAct.

Podkreśliliśmy, jak LLM mogą ułatwić usługi sprawdzania faktów na niezrównaną skalę, biorąc pod uwagę ich zdolność do szybkiego przetwarzania i analizowania ogromnych ilości tekstu. Potencjał analizy w czasie rzeczywistym może prowadzić do wczesnego wykrywania i powstrzymywania fałszywych wiadomości. Zilustrowaliśmy to, tworząc skrypt w języku Python, który po wydaniu oświadczenia podkreśla użytkownikowi, czy artykuł jest prawdziwy, czy fałszywy, używając języka naturalnego.

Zakończyliśmy podkreśleniem ograniczeń obecnego podejścia, a zakończyliśmy nutą nadziei, podkreślając, że przy odpowiednich zabezpieczeniach i ciągłym udoskonalaniu LLM mogą stać się niezbędnymi narzędziami w walce z fałszywymi wiadomościami.

Chcielibyśmy usłyszeć od ciebie. Daj nam znać, co myślisz w sekcji komentarzy lub skorzystaj z forum problemów w witrynie repozytorium GitHub.

Zastrzeżenie: Kod podany w tym poście jest przeznaczony wyłącznie do celów edukacyjnych i eksperymentalnych. Nie należy na nim polegać w przypadku wykrywania fałszywych wiadomości lub dezinformacji w rzeczywistych systemach produkcyjnych. Nie gwarantuje się dokładności ani kompletności wykrywania fałszywych wiadomości za pomocą tego kodu. Użytkownicy powinni zachować ostrożność i zachować należytą staranność przed użyciem tych technik w wrażliwych zastosowaniach.

Aby rozpocząć korzystanie z Amazon Bedrock, odwiedź stronę Konsola Amazon Bedrock.

O autorach

Anamaria Todor jest głównym architektem rozwiązań z siedzibą w Kopenhadze w Danii. Swój pierwszy komputer zobaczyła w wieku 4 lat i od tego czasu nie porzuciła informatyki, gier wideo i inżynierii. Pracowała na różnych stanowiskach technicznych, od freelancera, programisty full-stack, po inżyniera danych, kierownika technicznego i dyrektora ds. technologii, w różnych firmach w Danii, koncentrując się na branżach gier i reklamy. Od ponad 3 lat pracuje w AWS, pracując jako główny architekt rozwiązań, koncentrując się głównie na naukach przyrodniczych i sztucznej inteligencji/ML. Anamaria posiada tytuł licencjata w dziedzinie inżynierii stosowanej i informatyki, tytuł magistra informatyki oraz ponad 10-letnie doświadczenie w AWS. Kiedy nie pracuje ani nie gra w gry wideo, trenuje dziewczyny i profesjonalistki w zakresie zrozumienia i odnalezienia swojej ścieżki poprzez technologię.

Anamaria Todor jest głównym architektem rozwiązań z siedzibą w Kopenhadze w Danii. Swój pierwszy komputer zobaczyła w wieku 4 lat i od tego czasu nie porzuciła informatyki, gier wideo i inżynierii. Pracowała na różnych stanowiskach technicznych, od freelancera, programisty full-stack, po inżyniera danych, kierownika technicznego i dyrektora ds. technologii, w różnych firmach w Danii, koncentrując się na branżach gier i reklamy. Od ponad 3 lat pracuje w AWS, pracując jako główny architekt rozwiązań, koncentrując się głównie na naukach przyrodniczych i sztucznej inteligencji/ML. Anamaria posiada tytuł licencjata w dziedzinie inżynierii stosowanej i informatyki, tytuł magistra informatyki oraz ponad 10-letnie doświadczenie w AWS. Kiedy nie pracuje ani nie gra w gry wideo, trenuje dziewczyny i profesjonalistki w zakresie zrozumienia i odnalezienia swojej ścieżki poprzez technologię.

Marcela Castro jest starszym architektem rozwiązań z siedzibą w Oslo w Norwegii. Na swoim stanowisku Marcel pomaga klientom w zakresie architektury, projektowania i rozwoju infrastruktury zoptymalizowanej pod kątem chmury. Jest członkiem zespołu ambasadorów AWS Generative AI, którego celem jest kierowanie i wspieranie klientów z regionu EMEA w ich podróży związanej z generatywną sztuczną inteligencją. Uzyskał stopień doktora informatyki w Szwecji oraz tytuł magistra i licencjata w dziedzinie elektrotechniki i telekomunikacji w Brazylii.

Marcela Castro jest starszym architektem rozwiązań z siedzibą w Oslo w Norwegii. Na swoim stanowisku Marcel pomaga klientom w zakresie architektury, projektowania i rozwoju infrastruktury zoptymalizowanej pod kątem chmury. Jest członkiem zespołu ambasadorów AWS Generative AI, którego celem jest kierowanie i wspieranie klientów z regionu EMEA w ich podróży związanej z generatywną sztuczną inteligencją. Uzyskał stopień doktora informatyki w Szwecji oraz tytuł magistra i licencjata w dziedzinie elektrotechniki i telekomunikacji w Brazylii.

- Dystrybucja treści i PR oparta na SEO. Uzyskaj wzmocnienie już dziś.

- PlatoData.Network Pionowe generatywne AI. Wzmocnij się. Dostęp tutaj.

- PlatoAiStream. Inteligencja Web3. Wiedza wzmocniona. Dostęp tutaj.

- PlatonESG. Węgiel Czysta technologia, Energia, Środowisko, Słoneczny, Gospodarowanie odpadami. Dostęp tutaj.

- Platon Zdrowie. Inteligencja w zakresie biotechnologii i badań klinicznych. Dostęp tutaj.

- Źródło: https://aws.amazon.com/blogs/machine-learning/harness-large-language-models-in-fake-news-detection/

- :ma

- :Jest

- :nie

- :Gdzie

- $ 100 mln

- $W GÓRĘ

- 1

- 10

- 100

- 12

- 13

- 14

- 20

- 2022

- 21

- 26%

- 27

- 32

- 36

- 7

- 9

- a

- zdolność

- O nas

- powyżej

- AC

- akademicki

- badania naukowe

- Akademia

- dostęp

- dostęp

- dostępny

- Konto

- Konta

- precyzja

- Osiągać

- osiągnięcia

- w poprzek

- gra aktorska

- Działania

- działania

- aktywnie

- aktorzy

- faktycznie

- Dodaj

- dodatek

- Dodatkowy

- zaawansowany

- nadejście

- Reklama

- ponownie

- przed

- Agent

- agentów

- AI

- Modele AI

- Systemy SI

- AI / ML

- AL

- Wszystkie kategorie

- pozwala

- sam

- również

- Chociaż

- Amazonka

- Amazon EC2

- Amazon Web Services

- Ambasador

- amerykański

- wśród

- kwoty

- an

- analiza

- w czasie rzeczywistym sprawiają,

- Starożytny

- i

- Rocznie

- Inne

- odpowiedź

- odpowiedzi

- Antropiczny

- każdy

- api

- Pszczoła

- pojawia się

- Zastosowanie

- aplikacje

- stosowany

- wyznaczony

- podejście

- awanse

- w przybliżeniu

- architektura

- SĄ

- argument

- argumenty

- na około

- artykuł

- sztuczny

- sztuczna inteligencja

- Sztuczna inteligencja (AI)

- Sztuka

- AS

- aspekty

- oceniając

- oceny

- Założenia

- zapewniony

- astronomia

- At

- Próby

- zwiększać

- zwiększona

- rozszerzenia

- zautomatyzowane

- dostępny

- Stephen Schwartz wygrywa

- AWS

- Chmura AWS9

- baza

- na podstawie

- bash

- Bitwa

- BE

- bo

- stają się

- staje

- być

- zanim

- zachowanie

- za

- jest

- wierzenia

- oprócz

- pomiędzy

- Poza

- stronniczość

- Miliard

- biologia

- biomedyczny

- ciało

- obie

- boty

- Brazylia

- przynieść

- Złamany

- wbudowany

- biznesmen

- ale

- by

- wezwanie

- Połączenia

- CAN

- możliwości

- zdolność

- Pojemność

- walizka

- Etui

- Spowodować

- ostrożność

- Wiek

- łańcuch

- więzy

- wyzwania

- chang

- ZOBACZ

- chemia

- chiński

- wybory

- Dodaj

- roszczenie

- roszczenia

- klasa

- klasyfikacja

- wyraźnie

- klient

- Zamknij

- Cloud9

- Coaching

- kod

- Kodowanie

- poznawczy

- zbierać

- Collective

- Studentki

- COLUMBIA

- połączenie

- komentarze

- wspólny

- powszechnie

- społeczność

- Firmy

- porównanie

- uzupełniający

- kompletny

- kompleks

- kompleksowość

- składniki

- w składzie

- obliczać

- komputer

- Computer Science

- pojęcie

- zawarta

- Potwierdzać

- potwierdzenie

- spójnik

- w konsekwencji

- za

- zgodny

- składa się

- Konsola

- konsumować

- Konsumenci

- konsumpcja

- Ograniczenie

- zawiera

- zawartość

- Tworzenie treści

- ciągły

- wkład

- kontrola

- kontroli

- Rozmowa

- skorygowania

- prawidłowo

- Koszty:

- Koszty:

- mógłby

- kraje

- kraj

- Stwórz

- stworzony

- tworzy

- Tworzenie

- tworzenie

- Twórczy

- kreatywność

- Listy uwierzytelniające

- CTO

- kultura

- okiełznać

- Aktualny

- Klientów

- dane

- debata

- Decyzje

- zdefiniowane

- Definiuje

- Stopień

- demokratyczny

- wykazać

- demonstruje

- demonstrowanie

- Dania

- Departament

- wdrażane

- wdrażanie

- Wnętrze

- detale

- wykryć

- Wykrywanie

- Ustalać

- określa

- rozwinięty

- Deweloper

- rozwijanie

- oprogramowania

- wydarzenia

- Dialog

- różne

- pracowitość

- kierunek

- dyskutować

- dezinformacja

- Wyświetlacz

- zakłócenia

- rozróżniać

- nieufność

- Lekarz

- robi

- Nie

- na dół

- dr

- napęd

- z powodu

- podczas

- e

- E i T

- każdy

- Wcześniej

- Wcześnie

- zarabiać

- zdobył

- Ziemia

- łatwiej

- łatwo

- ekonomia

- gospodarka

- edukacyjny

- wychowawcy

- efekt

- skuteczność

- bądź

- wyeliminować

- gdzie indziej

- EMEA

- powstanie

- nacisk

- umożliwiając

- zakończony

- inżynier

- Inżynieria

- ulepszenia

- zapewnić

- wprowadzenie

- podmioty

- jednostka

- Środowisko

- Równość

- Błędy

- szczególnie

- ustanowiony

- oceny

- Parzyste

- wydarzenia

- ewoluuje

- przykład

- przykłady

- wyłącznie

- Ćwiczenie

- doświadczenie

- Wyjaśniać

- odkryj

- zbadane

- rozległy

- zewnętrzny

- wyciąg

- ułatwiać

- ułatwione

- fakt

- Czynniki

- fakty

- FAIL

- imitacja

- fałszywe wiadomości

- fałszywy

- sławny

- Płeć żeńska

- pole

- walka

- wypełnia się

- finał

- budżetowy

- Znajdź

- znalezieniu

- koniec

- i terminów, a

- pierwszy raz

- Elastyczność

- koncentruje

- koncentruje

- skupienie

- obserwuj

- następujący

- W razie zamówieenia projektu

- Nasz formularz

- formalny

- Forum

- Fundacja

- podstawowy

- Założony

- Framework

- od

- fu

- w pełni

- funkcjonować

- Funkcjonalność

- Games

- gier

- luki

- Płeć

- Równość płci

- Ogólne

- Generować

- wygenerowane

- generujący

- generacja

- generatywny

- generatywna sztuczna inteligencja

- otrzymać

- dziewczyny

- GitHub

- dany

- Go

- cel

- wspaniały

- Ziemia

- gwarancji

- miał

- uprząż

- Have

- he

- słyszeć

- pomoc

- pomaga

- jej

- tutaj

- wysokiej jakości

- wyższy

- pasemka

- wysoko

- jego

- historia

- posiada

- honor

- pełen nadziei

- obudowa

- W jaki sposób

- How To

- Jednak

- HTML

- http

- HTTPS

- człowiek

- i

- IBM

- zidentyfikowane

- if

- Nielegalny

- zilustrować

- zdjęcia

- Rezultat

- wdrożenia

- realizacja

- narzędzia

- importować

- ważny

- imponujący

- ulepszony

- in

- niemożność

- zawierać

- obejmuje

- Włącznie z

- Rejestrowy

- zawiera

- wzrosła

- Zwiększenia

- wskazuje

- indywidualny

- przemysłowa

- Informacja

- informuje

- Infrastruktura

- początkowy

- wkład

- wewnątrz

- zainstalować

- zainstalowany

- przykład

- Instytut

- instytucje

- zintegrowany

- Inteligencja

- zamiar

- Interakcje

- wewnętrzny

- Internet

- najnowszych

- wprowadzono

- inwokuje

- zaangażowany

- problem

- problemy

- IT

- JEGO

- podróż

- jpg

- json

- Sędziowie

- kenneth

- Wiedzieć

- wiedza

- znany

- Brak

- język

- duży

- Późno

- firmy

- łacina

- uruchomiona

- warstwa

- prowadzić

- prowadzący

- nauka

- najmniej

- prawnie

- niech

- życie

- Life Sciences

- lubić

- Ograniczenia

- Linia

- linki

- linux

- Lista

- Katalogowany

- literatura

- LLM

- logiczny

- dłużej

- wyszukiwania

- miłość

- mac

- maszyna

- uczenie maszynowe

- zrobiony

- głównie

- utrzymuje

- poważny

- robić

- WYKONUJE

- Dokonywanie

- zarządzane

- i konserwacjami

- wiele

- Marketing

- maska

- mistrzowski

- matematyczny

- matematyka

- maksymalny

- Może..

- znaczy

- Oznaczało

- Media

- medyczny

- lekarstwo

- członek

- Użytkownicy

- Pamięć

- wzmiankowany

- Metodologia

- Michigan

- milion

- kopalnie

- Mylna informacja

- zwodniczy

- MIT

- Złagodzić

- mieszać

- ML

- model

- modele

- modyfikować

- jeszcze

- większość

- ruch

- wielokrotność

- my

- O imieniu

- NASA

- narodowy

- Naturalny

- Natura

- Potrzebować

- potrzebne

- sieć

- nigdy

- Nowości

- aktualności

- Następny

- Nie

- Laureat Nagrody Nobla

- normy

- Norwegia

- dostojnik

- notatnik

- już dziś

- numer

- przedmiot

- obserwacja

- październik

- of

- oferowany

- często

- Stary

- on

- ONE

- Online

- tylko

- operacje

- Opinia

- or

- zamówienie

- oryginalny

- Inne

- Inaczej

- ludzkiej,

- wytyczne

- obrysowywanie

- wydajność

- wybitny

- koniec

- ogólny

- własny

- własność

- Pokój

- pakiet

- strona

- stron

- Papier

- parametry

- część

- przechodzić

- minęło

- Przechodzący

- Patenty

- ścieżka

- Wzór

- Ludzie

- doskonały

- wykonać

- osobisty

- faza

- PhD

- zjawisko

- filozofia

- Fizyka

- kawałek

- kluczowy

- plato

- Analiza danych Platona

- PlatoDane

- gra

- punkt

- polityka

- możliwy

- Post

- potencjał

- power

- powered

- przedstawione

- prezenty

- naciśnij

- rozpowszechniony

- poprzedni

- poprzednio

- głównie

- Główny

- Zasady

- druk

- Prasa drukarska

- Wcześniejszy

- nagrody

- Problem

- wygląda tak

- procesów

- produkować

- Produkcja

- specjalistów

- głęboki

- Program

- zaproponować

- zaproponowane

- zapewniać

- pod warunkiem,

- dostawców

- zapewnia

- że

- Psychologia

- publiczny

- zakup

- cele

- Python

- jakość

- ilość

- szybko

- radio

- przypadkowy

- zakresy

- w rankingu

- szybki

- szybko

- stosunek

- dosięgnąć

- React

- Prawdziwy świat

- w czasie rzeczywistym

- powód

- otrzymać

- Odebrane

- Przepis

- uznanie

- polecić

- odnosić się

- odnosi

- związane z

- stosunkowo

- rzetelny

- WIELOKROTNIE

- składnica

- zażądać

- wymagać

- wymagany

- Badania naukowe

- rezonuje

- Zasoby

- Odpowiadać

- odpowiedź

- Odpowiedzi

- odpowiedzialny

- powrót

- powraca

- Bogaty

- Ryzyko

- Rola

- role

- rundy

- run

- bieganie

- działa

- s

- zabezpieczenia

- sagemaker

- taki sam

- Zapisz

- zobaczył

- Skala

- Szkoła

- School of Engineering

- nauka

- NAUKI

- naukowy

- Naukowcy

- scenariusz

- Sdk

- Szukaj

- Sekcja

- działy

- widzieć

- wybierając

- senior

- wrażliwy

- wyrok

- sentyment

- Sekwencja

- usługa

- Usługi

- zestaw

- ustawienie

- Share

- shared

- Akcje

- dzielenie

- ona

- Powłoka

- powinien

- pokazać

- podobny

- Podobnie

- Prosty

- ponieważ

- siostra

- So

- Obserwuj Nas

- Media społecznościowe

- społeczne

- Społeczeństwo

- rozwiązanie

- Rozwiązania

- kilka

- Źródło

- Kod źródłowy

- Źródła

- Typ przestrzeni

- napięcie

- swoiście

- prędkość

- rozpiętość

- Rozpościerający się

- STAGE

- standard

- Stanford

- Uniwersytet Stanford

- rozpoczęty

- Zestawienie sprzedaży

- oświadczenia

- Zjednoczone

- Cel

- Stop

- burza

- Strategia

- wzmocnienie

- Struktura

- Studenci

- Badanie

- kolejny

- znaczny

- Z powodzeniem

- taki

- sugerować

- PODSUMOWANIE

- doładowania

- wsparcie

- pewnie

- Kołysać

- Szwecja

- szybko

- synteza

- systemy

- sprzęt

- Brać

- trwa

- Zadanie

- zadania

- zespół

- Techniczny

- technika

- Techniki

- techniczny

- Technologia

- telekomunikacja

- szablon

- terminal

- REGULAMIN

- test

- XNUMX

- tekstowy

- że

- Połączenia

- Informacje

- Źródło

- świat

- ich

- Im

- następnie

- Tam.

- a tym samym

- w związku z tym

- Te

- one

- myśleć

- innych firm

- to

- tych

- myśl

- Przez

- poprzez

- TIE

- czas

- Oś czasu

- do

- razem

- żeton

- Żetony

- narzędzia

- przeszkolony

- Trening

- prawdziwy

- Prawda

- Tutorial

- drugiej

- Ostatecznie

- podkreślone

- zrozumienie

- Zjednoczony

- United States

- Uniwersytety

- uniwersytet

- niezrównany

- bez precedensu

- aż do

- uaktualnienie

- na

- us

- posługiwać się

- używany

- Użytkownik

- Użytkownicy

- zastosowania

- za pomocą

- Wykorzystując

- wartość

- różnorodny

- Naprawiono

- Werdykt

- zweryfikowana

- zweryfikować

- wersja

- początku.

- przez

- Wideo

- gier wideo

- Odwiedzić

- była

- we

- sieć

- usługi internetowe

- DOBRZE

- Co

- jeśli chodzi o komunikację i motywację

- czy

- który

- Podczas

- KIM

- cały

- dlaczego

- Wikipedia

- będzie

- okna

- w

- w ciągu

- kobieta

- Kobieta

- Wygrał

- słowo

- słowa

- Praca

- pracował

- workflow

- pracujący

- świat

- wartość

- Źle

- lat

- You

- Twój

- zefirnet