Wikipedia obniżyła ocenę niezawodności CNET po tym, jak publikacja techniczna, działająca od 30 lat, wykorzystywała sztuczną inteligencję do generowania wiadomości, które okazały się plagiatem i zawierały błędy.

CNET opublikowany ponad 70 artykułów z zakresu porad finansowych napisanych przez sztuczną inteligencję w okresie od listopada 2022 r. do stycznia 2023 r. Artykuły zostały opublikowane pod tytułem „CNET Money Staff”.

Kontrola potwierdziła, że wiele artykułów zawierało błędy rzeczowe, poważne pominięcia i plagiat treści. CNET zatrzymany publikowanie artykułów napisanych przez sztuczną inteligencję po tym, jak wiadomości ukazały się na początku 2023 r., ale według Wikipedii szkody już zostały wyrządzone.

Przeczytaj także: CNET zawiesza sztuczną inteligencję po opublikowaniu serii złych artykułów

Obniżanie poziomu CNET opartego na sztucznej inteligencji

„CNET, zwykle uważany za zwykły serwis technologiczny [wiarygodne źródło], zaczął eksperymentalnie wyświetlać artykuły generowane przez sztuczną inteligencję, które są pełne błędów” – powiedział redaktor Wikipedii David Gerard, jak zgłaszane przez futuryzm.

„Jak dotąd eksperyment nie przebiega dobrze, choć nie powinien. Jeszcze żadnego nie znalazłem, ale każdy z artykułów, który znalazł się w artykule w Wikipedii, musi zostać usunięty”.

Gerard mówił, żeby rozpocząć a Spotkanie redaktorów Wikipedii w celu omówienia zawartości sztucznej inteligencji CNET w styczniu 2023 r. Redaktorzy wszechwiedzącego słownika internetowego prowadzą forum Wikipedia Reliable Sources lub Perennial Sources, na którym spotykają się, aby zdecydować, czy danemu źródłu wiadomości można ufać i wykorzystywać je w cytatach.

Na forum znajduje się tabela rankingowa serwisów informacyjnych według ich wiarygodności. Po wielu godzinach dyskusji redaktorzy zgodzili się, że Oparte na sztucznej inteligencji wersja CNET nie była godna zaufania i zdegradowała zawartość witryny do „ogólnie niewiarygodnej”.

„Cofnijmy się o krok i rozważmy, czego tu byliśmy świadkami” – powiedział inny redaktor Wikipedii, występujący pod pseudonimem „Bloodofox”.

„CNET wygenerowało mnóstwo treści za pomocą sztucznej inteligencji, wymieniło niektóre z nich jako napisane przez ludzi (!), stwierdziło, że wszystkie zostały zredagowane i sprawdzone przez ludzi, a następnie, gdy został złapany, wydało kilka „poprawek”, po czym nastąpiły ataki na dziennikarzy którzy o tym donieśli” – dodali.

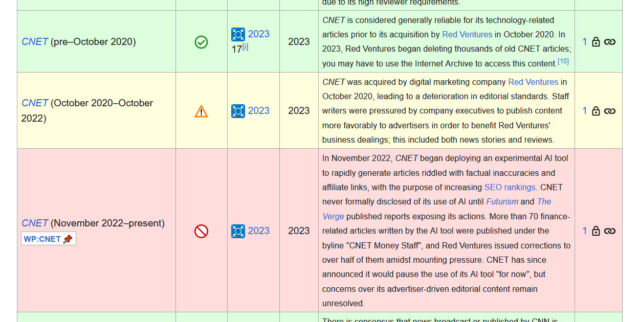

Źródła wieloletnie Wikipedii strona dzieli oceny niezawodności CNET na trzy okresy: 1. Okres poprzedzający październik 2020 r., kiedy CNET uznawano za „ogólnie niezawodne”; oraz 2. października 2020 r. do października 2022 r., gdzie Wikipedia nie oceniła witryny podążającej za nią $ 500 mln przejęcia przez Red Ventures.

Trzeci okres trwa od listopada 2022 r. do chwili obecnej. W tym okresie Wikipedia obniżyła ocenę CNET do „ogólnie niewiarygodnego” źródła po tym, jak witryna zwróciła się ku sztucznej inteligencji, „aby szybko generować artykuły pełne nieścisłości faktycznych i linków partnerskich”.

Google nie widzi problemu w AI

Według raportu Futurism sytuacja CNET zaczęła się pogarszać po przejęciu Red Ventures w 2020 r. Wikipedia podaje, że zmiana właściciela doprowadziła do „pogorszenia standardów redakcyjnych”, ponieważ Red Ventures rzekomo przedłożyła SEO nad jakość. Nie tylko CNET potajemnie eksperymentował ze sztuczną inteligencją w stajni.

Redaktorzy Wikipedii zwrócili także uwagę na inne problemy z niezawodnością dotyczące odrębnych witryn internetowych należących do Red Ventures, w tym Healthline i Bankrate. Według doniesień w witrynach edukacyjnych zamieszczano treści napisane przez sztuczną inteligencję bez ujawniania informacji i ludzkiego nadzoru.

„Red Ventures nie wyraziło się w najmniejszym stopniu przejrzyście w tej kwestii – firmę można w najlepszym razie określić jako oszukańczą” – stwierdził anonimowy redaktor Wikipedii Bloodofox.

W oświadczeniu dotyczącym obniżenia wersji Wikipedii i treści stworzonych przez sztuczną inteligencję CNET stwierdziło, że zapewnia „bezstronne wiadomości i porady dotyczące technologii”.

„Zaufano nam od prawie 30 lat dzięki naszym rygorystycznym standardom redakcyjnym i recenzjom produktów” – powiedział rzecznik Futurism. „Ważne jest, aby wyjaśnić, że CNET nie wykorzystuje aktywnie sztucznej inteligencji do tworzenia nowych treści. Chociaż nie mamy konkretnych planów ponownego uruchomienia, wszelkie przyszłe inicjatywy będą zgodne z naszą publiczną polityką dotyczącą sztucznej inteligencji”.

Decyzja Wikipedii podkreśla utrzymujące się obawy dotyczące wykorzystania sztucznej inteligencji do tworzenia artykułów w branży medialnej. Tymczasem, Google nie ma problemu z materiałem AI, o ile nie jest on używany do gry w algorytm wyszukiwania.

Według Google poradnictwo w przypadku treści generowanych przez sztuczną inteligencję firma twierdzi, że zawsze „wierzyła w moc sztucznej inteligencji, która może zmienić zdolność dostarczania przydatnych informacji”.

Google twierdzi, że jego systemy rankingowe skupiają się na jakości treści, a nie na sposobie ich tworzenia – czy to przez ludzi, czy przez sztuczną inteligencję. Ocenia wiedzę specjalistyczną, doświadczenie, autorytet i wiarygodność.

Firma zauważa jednak, że wykorzystywanie automatyzacji, w tym sztucznej inteligencji, do generowania treści, których głównym celem jest manipulowanie rankingiem w wynikach wyszukiwania, „stanowi naruszenie naszych zasad dotyczących spamu”.

- Dystrybucja treści i PR oparta na SEO. Uzyskaj wzmocnienie już dziś.

- PlatoData.Network Pionowe generatywne AI. Wzmocnij się. Dostęp tutaj.

- PlatoAiStream. Inteligencja Web3. Wiedza wzmocniona. Dostęp tutaj.

- PlatonESG. Węgiel Czysta technologia, Energia, Środowisko, Słoneczny, Gospodarowanie odpadami. Dostęp tutaj.

- Platon Zdrowie. Inteligencja w zakresie biotechnologii i badań klinicznych. Dostęp tutaj.

- Źródło: https://metanews.com/how-ai-generated-content-led-to-a-reliability-rating-downgrade-for-cnet/

- :ma

- :Jest

- :nie

- :Gdzie

- 1

- 2020

- 2022

- 2023

- 30

- 7

- 70

- 800

- a

- zdolność

- O nas

- Stosownie

- nabycie

- aktywnie

- w dodatku

- adresowanie

- Rada

- Program Partnerski

- Po

- uzgodniony

- AI

- algorytm

- Wszystkie kategorie

- rzekomo

- już

- również

- zawsze

- an

- i

- Anonimowy

- Inne

- każdy

- SĄ

- artykuł

- towary

- sztuczny

- sztuczna inteligencja

- AS

- At

- Ataki

- Audyt

- Automatyzacja

- z powrotem

- Łazienka

- BE

- bo

- być

- BEST

- pomiędzy

- przerwy

- Zepsuł się

- Pęczek

- ale

- by

- CAN

- złapany

- zmiana

- Wykres

- twierdził,

- CNET

- sukcesy firma

- ZATWARDZIAŁY

- Rozważać

- za

- zawarte

- zawartość

- mógłby

- Stwórz

- uszkodzić

- David

- debata

- zdecydować

- decyzja

- dostarczyć

- opisane

- ZROBIŁ

- ujawnienie

- dyskutować

- zrobić

- na dół

- Downgrade

- Obniżony

- podczas

- Wcześnie

- redaktor

- Zespół redakcyjny

- redaktorzy

- Błędy

- doświadczenie

- eksperyment

- eksperymentować

- ekspertyza

- daleko

- Korzyści

- budżetowy

- Porada finansowa

- znajduje

- Firma

- Skupiać

- obserwuj

- następnie

- następujący

- W razie zamówieenia projektu

- Forum

- znaleziono

- brzemienny

- od

- przyszłość

- gra

- Generować

- wygenerowane

- Gerard

- miejsce

- Goes

- będzie

- Google'a

- miał

- Have

- pomocny

- tutaj

- Wysoki

- pasemka

- GODZINY

- W jaki sposób

- HTTPS

- człowiek

- Ludzie

- i

- ważny

- in

- Włącznie z

- przemysł

- Informacja

- inicjatywy

- Inteligencja

- najnowszych

- z udziałem

- Wydany

- problemy

- IT

- JEGO

- styczeń

- Dziennikarze

- jpg

- Doprowadziło

- linki

- Katalogowany

- długo

- WYGLĄD

- utrzymać

- robić

- manipulowanie

- wiele

- materiał

- Maksymalna szerokość

- W międzyczasie

- Media

- branżowych

- Poznaj nasz

- pieniądze

- jeszcze

- Nazwa

- prawie

- Potrzebować

- Nowości

- aktualności

- Nie

- Uwagi

- listopad

- październik

- of

- on

- Online

- tylko

- działanie

- or

- zwykły

- Inne

- ludzkiej,

- na zewnątrz

- Wyloty

- koniec

- Przeoczenie

- własność

- Ludzie

- okres

- okresy

- plany

- plato

- Analiza danych Platona

- PlatoDane

- polityka

- polityka

- power

- teraźniejszość

- pierwotny

- priorytetowe

- Problem

- Wytworzony

- Produkt

- zapewnia

- publiczny

- Publikacja

- opublikowany

- Wydawniczy

- cel

- jakość

- Ranking

- szybko

- Kurs

- ocena

- Oceny

- Czytaj

- Czerwony

- traktować

- w sprawie

- niezawodność

- rzetelny

- zaufane źródła

- zdalnie

- Usunięto

- raport

- Zgłoszone

- podobno

- Efekt

- przeglądu

- zagadka

- rygorystyczny

- bieganie

- działa

- Powiedział

- mówią

- Szukaj

- seo

- oddzielny

- Serie

- poważny

- Witryny

- kilka

- Źródło

- Źródła

- spam

- Mówiąc

- specyficzny

- Rzecznik

- stabilny

- Personel

- standardy

- rozpoczęty

- Zestawienie sprzedaży

- Ewolucja krok po kroku

- historie

- systemy

- stół

- Brać

- tech

- niż

- że

- Połączenia

- ich

- następnie

- Te

- one

- rzeczy

- Trzeci

- to

- trzy

- czas

- do

- powiedział

- Przekształcać

- przezroczysty

- zaufany

- solidność

- godny zaufania

- Obrócony

- dla

- posługiwać się

- używany

- za pomocą

- zazwyczaj

- Ventures

- wersja

- sprawdzone

- NARUSZENIE

- była

- we

- Strona internetowa

- strony internetowe

- DOBRZE

- były

- Co

- jeśli chodzi o komunikację i motywację

- czy

- który

- Podczas

- KIM

- Wikipedia

- w

- bez

- świadkiem

- by

- napisany

- lat

- jeszcze

- zefirnet