Budowanie podstawowych modeli (FM) wymaga budowania, utrzymywania i optymalizowania dużych klastrów w celu uczenia modeli zawierających od dziesiątek do setek miliardów parametrów na ogromnych ilościach danych. Stworzenie odpornego środowiska, które poradzi sobie z awariami i zmianami środowiskowymi bez utraty dni lub tygodni postępu w szkoleniu modelu, to wyzwanie operacyjne, które wymaga wdrożenia skalowania klastra, proaktywnego monitorowania stanu, punktów kontrolnych zadań i możliwości automatycznego wznawiania szkolenia w przypadku wystąpienia awarii lub problemów .

Cieszymy się, że możemy się tym podzielić HyperPod Amazon SageMaker jest obecnie ogólnie dostępny, aby umożliwić podstawowe modele szkoleniowe z tysiącami akceleratorów nawet o 40% szybciej, zapewniając wysoce odporne środowisko szkoleniowe, eliminując jednocześnie niezróżnicowane podnoszenie ciężkich przedmiotów związane z obsługą klastrów szkoleniowych na dużą skalę. Dzięki SageMaker HyperPod specjaliści zajmujący się uczeniem maszynowym (ML) mogą trenować FM przez tygodnie i miesiące bez zakłóceń i bez konieczności radzenia sobie z problemami związanymi z awarią sprzętu.

Klienci tacy jak Stability AI używają SageMaker HyperPod do szkolenia swoich podstawowych modeli, w tym Stable Diffusion.

„Jako wiodąca firma zajmująca się generatywną sztuczną inteligencją typu open source, naszym celem jest maksymalizacja dostępności nowoczesnej sztucznej inteligencji. Budujemy podstawowe modele z dziesiątkami miliardów parametrów, które wymagają infrastruktury do optymalnego skalowania wydajności szkolenia. Dzięki zarządzanej infrastrukturze i bibliotekom optymalizacyjnym SageMaker HyperPod możemy skrócić czas i koszty szkoleń o ponad 50%. Dzięki temu nasze szkolenie modeli jest bardziej odporne i wydajne, co pozwala szybciej budować najnowocześniejsze modele”.

– Emad Mostaque, założyciel i dyrektor generalny Stability AI.

Aby zapewnić odporność całego cyklu opracowywania FM na awarie sprzętu, SageMaker HyperPod pomaga tworzyć klastry, monitorować stan klastrów, naprawiać i wymieniać wadliwe węzły na bieżąco, zapisywać częste punkty kontrolne i automatycznie wznawiać szkolenie bez utraty postępów. Ponadto SageMaker HyperPod jest wstępnie skonfigurowany Amazon Sage Maker rozproszone biblioteki szkoleniowe, w tym Biblioteka równoległości danych SageMaker (SMDDP) i Biblioteka równoległości modeli SageMaker (SMP), aby poprawić wydajność szkolenia FM poprzez ułatwienie dzielenia danych i modeli szkoleniowych na mniejsze fragmenty i przetwarzanie ich równolegle w węzłach klastra, przy pełnym wykorzystaniu infrastruktury obliczeniowej i sieciowej klastra. SageMaker HyperPod integruje menedżera obciążenia Slum w celu orkiestracji klastrów i zadań szkoleniowych.

Omówienie Menedżera obciążenia Slum

bełkot, wcześniej znane jako Simple Linux Utility for Resource Management, to narzędzie do planowania zadań umożliwiające uruchamianie zadań w rozproszonym klastrze obliczeniowym. Zapewnia także platformę do uruchamiania zadań równoległych przy użyciu Biblioteka zbiorowej komunikacji NVIDIA (NCCL) or Interfejs przekazywania wiadomości (MPI) standardy. Slurm to popularny system zarządzania zasobami klastra typu open source, szeroko stosowany w obliczeniach dużej wydajności (HPC) oraz w obciążeniach szkoleniowych związanych z generatywną sztuczną inteligencją i FM. SageMaker HyperPod zapewnia prosty sposób na uruchomienie klastra Slurm w ciągu kilku minut.

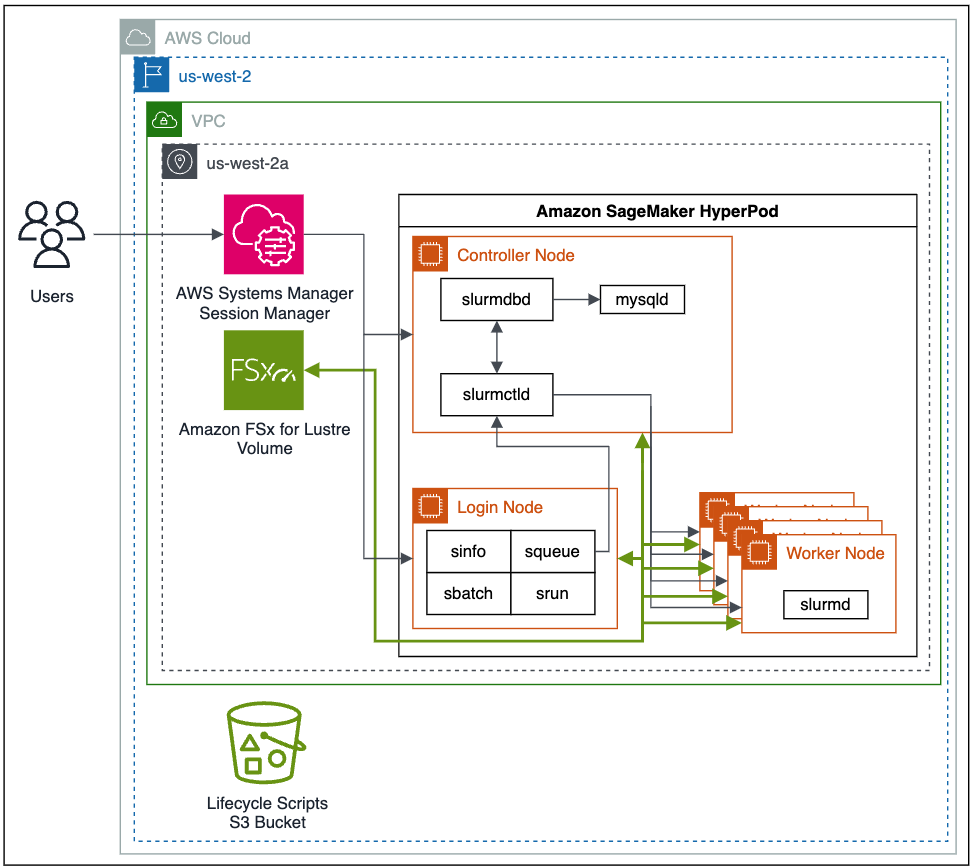

Poniżej znajduje się schemat architektury wysokiego poziomu przedstawiający interakcję użytkowników z SageMaker HyperPod oraz sposób interakcji różnych komponentów klastra ze sobą i innymi usługami AWS, takimi jak Amazon FSx dla Luster i Usługa Amazon Simple Storage (Amazonka S3).

Zadania Slurma są przesyłane za pomocą poleceń w wierszu poleceń. Polecenia do uruchamiania zadań Slurma to: srun i sbatch, srun polecenie uruchamia zadanie szkoleniowe w trybie interaktywnym i blokującym, oraz sbatch działa w trybie przetwarzania wsadowego i w trybie nieblokującym. srun jest najczęściej używany do wykonywania natychmiastowych zadań, podczas gdy sbatch można wykorzystać w późniejszych seriach zadań.

Aby uzyskać informacje na temat dodatkowych poleceń i konfiguracji Slurm, zobacz Dokumentacja Menedżera obciążenia Slum.

Funkcje automatycznego wznawiania i leczenia

Jedną z nowych funkcji SageMaker HyperPod jest możliwość automatycznego wznawiania zadań. Wcześniej, gdy węzeł roboczy uległ awarii podczas wykonywania zadania szkolenia lub dostrajania, zadaniem użytkownika było sprawdzenie stanu zadania, ponowne uruchomienie zadania od najnowszego punktu kontrolnego i dalsze monitorowanie zadania przez cały czas trwania zadania. W przypadku zadań szkoleniowych lub dostrajających, które muszą być wykonywane przez kilka dni, tygodni lub nawet miesięcy, staje się to kosztowne ze względu na dodatkowe obciążenie administracyjne związane z koniecznością spędzania cykli przez użytkownika na monitorowaniu i utrzymywaniu zadania w przypadku, gdy awarie węzłów, a także koszt czasu bezczynności kosztownych instancji obliczeniowych z przyspieszeniem.

SageMaker HyperPod zapewnia odporność zadań, korzystając z automatycznych kontroli stanu, wymiany węzłów i odzyskiwania zadań. Zadania Slurm w SageMaker HyperPod są monitorowane przy użyciu niestandardowej wtyczki Slurm SageMaker przy użyciu Struktura SPANKA. W przypadku niepowodzenia zadania szkoleniowego SageMaker HyperPod sprawdzi stan klastra za pomocą zestawu testów stanu. Jeśli w klastrze zostanie znaleziony wadliwy węzeł, SageMaker HyperPod automatycznie usunie węzeł z klastra, zastąpi go zdrowym węzłem i ponownie uruchomi zadanie uczenia. W przypadku korzystania z punktów kontrolnych w zadaniach szkoleniowych każde przerwane lub zakończone niepowodzeniem zadanie można wznowić od ostatniego punktu kontrolnego.

Omówienie rozwiązania

Aby wdrożyć SageMaker HyperPod, najpierw przygotuj środowisko, konfigurując plik Wirtualna prywatna chmura Amazon (Amazon VPC) sieci i grup zabezpieczeń, wdrażanie usług pomocniczych, takich jak FSx for Lustre w Twojej VPC i publikowanie skryptów cyklu życia Slurm w segmencie S3. Następnie wdrażasz i konfigurujesz SageMaker HyperPod oraz łączysz się z węzłem głównym, aby rozpocząć zadania szkoleniowe.

Wymagania wstępne

Zanim utworzysz SageMaker HyperPod, musisz najpierw skonfigurować VPC, utworzyć system plików FSx dla Lustre i skonfigurować segment S3 z żądanymi skryptami cyklu życia klastra. Potrzebujesz także najnowszej wersji programu Interfejs wiersza poleceń AWS (AWS CLI) i zainstalowana wtyczka CLI Menedżer sesji AWS, zdolność Menedżer systemów AWS.

SageMaker HyperPod jest w pełni zintegrowany z Twoją VPC. Informacje na temat tworzenia nowego VPC znajdziesz w artykule Utwórz domyślną VPC or Utwórz VPC. Aby umożliwić bezproblemowe połączenie z najwyższą wydajnością między zasobami, należy utworzyć wszystkie zasoby w tym samym regionie i strefie dostępności, a także upewnić się, że powiązane reguły grupy zabezpieczeń umożliwiają połączenie między zasobami klastra.

Następnie ty utwórz system plików FSx dla Luster. Będzie to służyć jako wysokowydajny system plików do wykorzystania podczas całego szkolenia modelowego. Upewnij się, że grupy zabezpieczeń FSx for Lustre i klastra umożliwiają komunikację przychodzącą i wychodzącą między zasobami klastra a systemem plików FSx for Lustre.

Aby skonfigurować skrypty cyklu życia klastra, które będą uruchamiane po wystąpieniu zdarzeń takich jak nowa instancja klastra, utwórz wiadro S3, a następnie skopiuj i opcjonalnie dostosuj domyślne skrypty cyklu życia. W tym przykładzie przechowujemy wszystkie skrypty cyklu życia w przedrostku segmentu lifecycle-scripts.

Najpierw pobierz przykładowe skrypty cyklu życia z pliku GitHub repo. Należy je dostosować tak, aby odpowiadały pożądanym zachowaniom klastra.

Następnie utwórz segment S3 do przechowywania dostosowanych skryptów cyklu życia.

Następnie skopiuj domyślne skrypty cyklu życia z katalogu lokalnego do żądanego segmentu i użyj prefiksu aws s3 sync:

Na koniec, należy skonfigurować klienta do uproszczonego połączenia z węzłem głównym klastra zainstaluj lub zaktualizuj interfejs CLI AWS i zainstaluj Wtyczka CLI menedżera sesji AWS aby umożliwić interaktywne połączenia terminali w celu administrowania klastrem i uruchamiania zadań szkoleniowych.

Klaster SageMaker HyperPod można utworzyć, korzystając z zasobów dostępnych na żądanie lub prosząc o rezerwację pojemności w programie SageMaker. Aby utworzyć rezerwację wydajności, utwórz żądanie zwiększenia przydziału w celu zarezerwowania określonych typów instancji obliczeniowych i alokacji wydajności na pulpicie nawigacyjnym Przydziały usług.

Skonfiguruj klaster szkoleniowy

Aby utworzyć klaster SageMaker HyperPod, wykonaj następujące kroki:

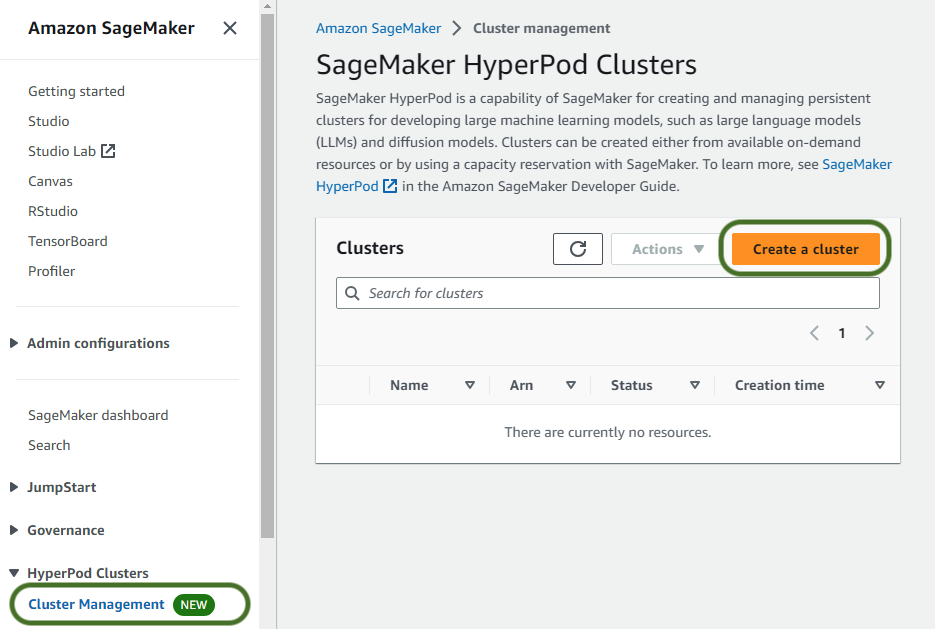

- W konsoli SageMaker wybierz Zarządzanie klastrem dla Klastry HyperPod w okienku nawigacji.

- Dodaj Utwórz klaster.

- Podaj nazwę klastra i opcjonalnie dowolne znaczniki, które mają zostać zastosowane do zasobów klastra, a następnie wybierz Następna.

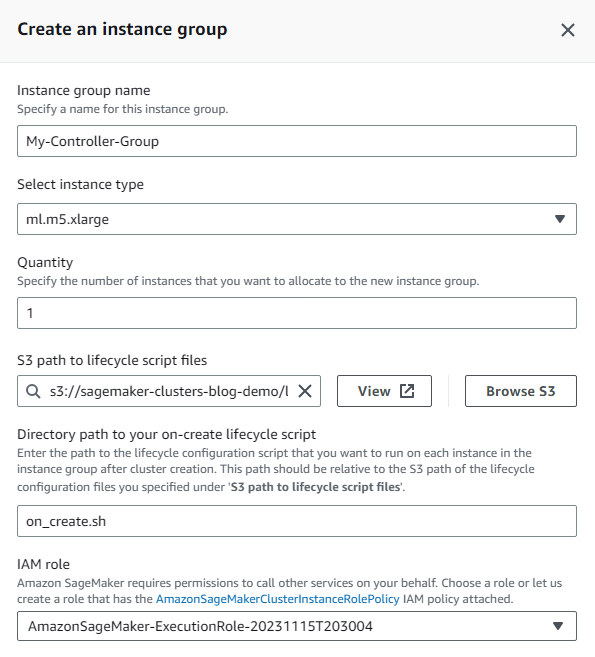

- Wybierz Utwórz grupę instancji i podaj nazwę grupy instancji, wymagany typ instancji, żądaną liczbę instancji oraz zasobnik S3 i ścieżkę prefiksu, do której wcześniej skopiowałeś skrypty cyklu życia klastra.

Zaleca się posiadanie różnych grup instancji dla węzłów kontrolera używanych do administrowania klastrem i przesyłania zadań oraz węzłów roboczych używanych do uruchamiania zadań szkoleniowych przy użyciu instancji obliczeń przyspieszonych. Opcjonalnie możesz skonfigurować dodatkową grupę instancji dla węzłów logowania.

- Najpierw utwórz grupę instancji kontrolera, która będzie zawierać węzeł główny klastra.

- Dla tej grupy instancji AWS Zarządzanie tożsamością i dostępem (IAM) rolę, wybierz Utwórz nową rolę i określ dowolne zasobniki S3, do których mają mieć dostęp instancje klastra w grupie instancji.

Wygenerowana rola domyślnie otrzyma dostęp tylko do odczytu do określonych zasobników.

- Dodaj Utwórz rolę.

- Wprowadź nazwę skryptu, który będzie uruchamiany podczas tworzenia każdej instancji w wierszu poleceń skryptu podczas tworzenia. W tym przykładzie wywoływany jest skrypt podczas tworzenia

on_create.sh.

- Dodaj Zapisz.

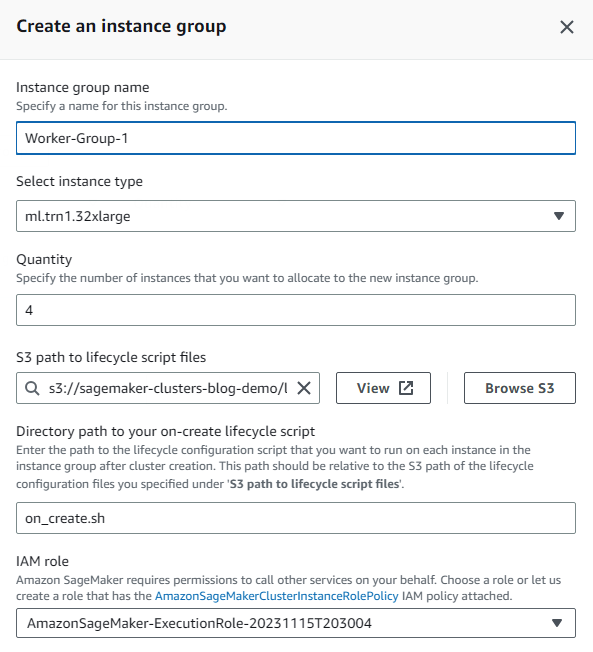

- Dodaj Utwórz grupę instancji , aby utworzyć grupę instancji roboczych.

- Podaj wszystkie wymagane szczegóły, w tym typ instancji i żądaną ilość.

W tym przykładzie do wykonania zadania szkoleniowego użyto czterech przyspieszonych instancji ml.trn1.32xl. Możesz użyć tej samej roli IAM co poprzednio lub dostosować rolę dla instancji roboczych. Podobnie możesz używać innych skryptów cyklu życia podczas tworzenia dla tej roboczej grupy instancji niż w przypadku poprzedniej grupy instancji.

- Dodaj Następna kontynuować.

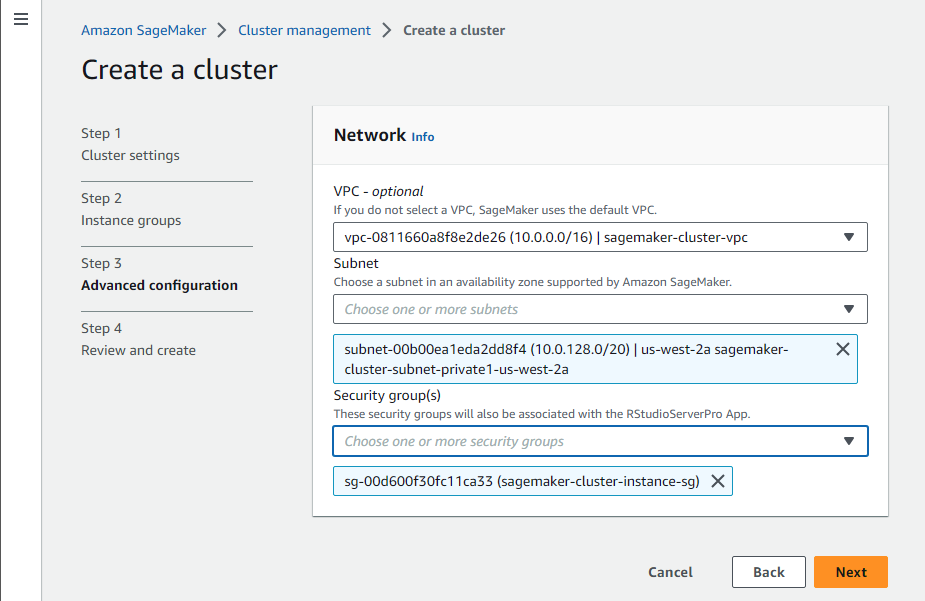

- Wybierz żądaną sieć VPC, podsieć i grupy zabezpieczeń dla instancji klastra.

Hostujemy instancje klastra w jednej strefie dostępności i jednej podsieci, aby zapewnić niskie opóźnienia.

Pamiętaj, że jeśli będziesz często uzyskiwać dostęp do danych S3, zaleca się utworzenie punktu końcowego VPC powiązanego z tablicą routingu podsieci prywatnej, aby zmniejszyć potencjalne koszty przesyłania danych.

- Dodaj Następna.

- Przejrzyj podsumowanie szczegółów klastra, a następnie wybierz Prześlij.

Alternatywnie, aby utworzyć SageMaker HyperPod za pomocą interfejsu CLI AWS, najpierw dostosuj parametry JSON użyte do utworzenia klastra:

Następnie użyj następującego polecenia, aby utworzyć klaster przy użyciu podanych danych wejściowych:

Wykonaj swoje pierwsze zadanie szkoleniowe z Llamą 2

Należy pamiętać, że korzystanie z modelu Llama 2 podlega licencji Meta. Aby pobrać wagi modeli i tokenizer, odwiedź stronę i zaakceptuj licencję przed zażądaniem dostępu Witryna internetowa Meta’s Hugging Face.

Po uruchomieniu klastra zaloguj się do Menedżera sesji, używając identyfikatora klastra, nazwy grupy instancji i identyfikatora instancji. Użyj następującego polecenia, aby wyświetlić szczegóły klastra:

Zanotuj identyfikator klastra zawarty w odpowiedzi w ramach klastra ARN.

Użyj poniższego polecenia, aby pobrać nazwę grupy instancji i identyfikator instancji potrzebne do zalogowania się do klastra.

Zanotuj InstanceGroupName oraz InstanceId w odpowiedzi, ponieważ zostaną one użyte do połączenia z instancją za pomocą Menedżera sesji.

Teraz używasz Menedżera sesji, aby zalogować się do węzła głównego lub jednego z węzłów logowania i uruchomić zadanie szkoleniowe:

Następnie przygotujemy środowisko i pobierzemy Llamę 2 oraz zbiór danych RedPajama. Aby zapoznać się z pełnym kodem i instrukcją krok po kroku, postępuj zgodnie z instrukcjami na stronie Szkolenie rozproszone AWSome Repozytorium GitHub.

Postępuj zgodnie z instrukcjami opisanymi w 2.test_cases/8.neuronx-nemo-megatron/README.md plik. Po wykonaniu kroków mających na celu przygotowanie środowiska, przygotowanie modelu, pobranie i tokenizację zbioru danych oraz wstępną kompilację modelu, należy dokonać edycji 6.pretrain-model.sh skrypt i sbatch polecenie przesyłania zadania, aby uwzględnić parametr umożliwiający skorzystanie z funkcji automatycznego wznawiania programu SageMaker HyperPod.

Edytuj sbatch wiersz, który będzie wyglądał następująco:

Po przesłaniu pracy otrzymasz JobID za pomocą którego możesz sprawdzić status zadania za pomocą następującego kodu:

Dodatkowo możesz monitorować zadanie, postępując zgodnie z protokołem wyników zadania, używając następującego kodu:

Sprzątać

Aby usunąć klaster SageMaker HyperPod, użyj konsoli SageMaker lub następującego polecenia AWS CLI:

Wnioski

W tym poście pokazano, jak przygotować środowisko AWS, wdrożyć pierwszy klaster SageMaker HyperPod i wytrenować model Llama 7 o parametrach 2 miliardów. SageMaker HyperPod jest obecnie ogólnie dostępny w regionie obu Ameryk (Północna Wirginia, Ohio i Oregon), Azji i Pacyfiku (Singapur, Sydney i Tokio) oraz Europy (Frankfurt, Irlandia i Sztokholm). Można je wdrożyć za pośrednictwem konsoli SageMaker, AWS CLI i AWS SDK i obsługują rodziny instancji p4d, p4de, p5, trn1, inf2, g5, c5, c5n, m5 i t3.

Aby dowiedzieć się więcej o SageMaker HyperPod, odwiedź stronę HyperPod Amazon SageMaker.

O autorach

Brada Dorana jest starszym technicznym menedżerem konta w Amazon Web Services, zajmującym się generatywną sztuczną inteligencją. Odpowiada za rozwiązywanie wyzwań inżynieryjnych dla klientów generatywnej AI w segmencie cyfrowego rynku biznesowego. Pochodzi ze środowiska zajmującego się tworzeniem infrastruktury i oprogramowania, a obecnie kontynuuje studia doktoranckie i badania w zakresie sztucznej inteligencji i uczenia maszynowego.

Brada Dorana jest starszym technicznym menedżerem konta w Amazon Web Services, zajmującym się generatywną sztuczną inteligencją. Odpowiada za rozwiązywanie wyzwań inżynieryjnych dla klientów generatywnej AI w segmencie cyfrowego rynku biznesowego. Pochodzi ze środowiska zajmującego się tworzeniem infrastruktury i oprogramowania, a obecnie kontynuuje studia doktoranckie i badania w zakresie sztucznej inteligencji i uczenia maszynowego.

Keity Watanabe jest starszym specjalistą ds. rozwiązań GenAI w Amazon Web Services, gdzie pomaga opracowywać rozwiązania do uczenia maszynowego przy użyciu projektów OSS, takich jak Slurm i Kubernetes. Jego doświadczenie obejmuje badania i rozwój uczenia maszynowego. Przed dołączeniem do AWS Keita pracował w branży e-commerce jako naukowiec opracowujący systemy wyszukiwania obrazów na potrzeby wyszukiwania produktów. Keita posiada tytuł doktora nauk ścisłych uzyskany na Uniwersytecie Tokijskim.

Keity Watanabe jest starszym specjalistą ds. rozwiązań GenAI w Amazon Web Services, gdzie pomaga opracowywać rozwiązania do uczenia maszynowego przy użyciu projektów OSS, takich jak Slurm i Kubernetes. Jego doświadczenie obejmuje badania i rozwój uczenia maszynowego. Przed dołączeniem do AWS Keita pracował w branży e-commerce jako naukowiec opracowujący systemy wyszukiwania obrazów na potrzeby wyszukiwania produktów. Keita posiada tytuł doktora nauk ścisłych uzyskany na Uniwersytecie Tokijskim.

Justin Pirtle jest głównym architektem rozwiązań w Amazon Web Services. Regularnie doradza klientom zajmującym się generatywną sztuczną inteligencją w zakresie projektowania, wdrażania i skalowania ich infrastruktury. Jest stałym prelegentem na konferencjach AWS, w tym re:Invent, a także innych wydarzeniach AWS. Justin posiada tytuł licencjata w dziedzinie systemów informacji zarządczej uzyskany na Uniwersytecie Teksasu w Austin oraz tytuł magistra inżynierii oprogramowania na Uniwersytecie w Seattle.

Justin Pirtle jest głównym architektem rozwiązań w Amazon Web Services. Regularnie doradza klientom zajmującym się generatywną sztuczną inteligencją w zakresie projektowania, wdrażania i skalowania ich infrastruktury. Jest stałym prelegentem na konferencjach AWS, w tym re:Invent, a także innych wydarzeniach AWS. Justin posiada tytuł licencjata w dziedzinie systemów informacji zarządczej uzyskany na Uniwersytecie Teksasu w Austin oraz tytuł magistra inżynierii oprogramowania na Uniwersytecie w Seattle.

- Dystrybucja treści i PR oparta na SEO. Uzyskaj wzmocnienie już dziś.

- PlatoData.Network Pionowe generatywne AI. Wzmocnij się. Dostęp tutaj.

- PlatoAiStream. Inteligencja Web3. Wiedza wzmocniona. Dostęp tutaj.

- PlatonESG. Węgiel Czysta technologia, Energia, Środowisko, Słoneczny, Gospodarowanie odpadami. Dostęp tutaj.

- Platon Zdrowie. Inteligencja w zakresie biotechnologii i badań klinicznych. Dostęp tutaj.

- Źródło: https://aws.amazon.com/blogs/machine-learning/introducing-amazon-sagemaker-hyperpod-to-train-foundation-models-at-scale/

- :Jest

- :Gdzie

- $W GÓRĘ

- 1

- 100

- 12

- 14

- 24

- 7

- a

- zdolność

- O nas

- przyśpieszony

- akceleratory

- Akceptuj

- dostęp

- dostępność

- Dostęp

- Konto

- w poprzek

- dodatek

- Dodatkowy

- Adresy

- administrować

- administracyjny

- Korzyść

- Po

- AI

- Wszystkie kategorie

- przydział

- dopuszczać

- pozwala

- również

- Amazonka

- Amazon Sage Maker

- Amazon Web Services

- Americas

- kwoty

- an

- i

- każdy

- Aplikuj

- architektoniczny

- SĄ

- powstać

- sztuczny

- sztuczna inteligencja

- Sztuczna inteligencja i uczenie maszynowe

- AS

- Azja

- Azja i Pacyfik

- powiązany

- At

- Austin

- zautomatyzowane

- automatycznie

- dostępność

- dostępny

- AWS

- tło

- BE

- staje się

- zanim

- zachowania

- pomiędzy

- miliardy

- bloking

- budować

- Budowanie

- biznes

- by

- nazywa

- CAN

- możliwości

- zdolność

- Pojemność

- ceo

- wyzwanie

- wyzwania

- Zmiany

- ZOBACZ

- Wykrywanie urządzeń szpiegujących

- Dodaj

- klient

- Grupa

- kod

- Collective

- byliśmy spójni, od początku

- Komunikacja

- Komunikacja

- sukcesy firma

- kompletny

- składniki

- obliczać

- computing

- konferencje

- systemu

- konfigurowanie

- Skontaktuj się

- połączenie

- połączenia

- Konsola

- kontynuować

- kontroler

- Koszty:

- kosztowny

- Koszty:

- Stwórz

- Tworzenie

- tworzenie

- Obecnie

- zwyczaj

- Klientów

- dostosować

- dostosowane

- cykl

- Cykle

- tablica rozdzielcza

- dane

- Dni

- sprawa

- Domyślnie

- Stopień

- rozwijać

- wdrażane

- wdrażanie

- projektowanie

- życzenia

- szczegółowe

- detale

- rozwijać

- rozwijanie

- oprogramowania

- różne

- Transmitowanie

- cyfrowy

- Zakłócenie

- dystrybuowane

- przetwarzanie rozproszone

- szkolenia rozproszone

- pobieranie

- z powodu

- podczas

- każdy

- ecommerce

- bądź

- eliminując

- umożliwiać

- Punkt końcowy

- Inżynieria

- zapewnić

- Cały

- Środowisko

- środowiskowy

- zapewniają

- Europie

- Parzyste

- wydarzenie

- wydarzenia

- przykład

- podniecony

- drogi

- dodatkowy

- Twarz

- Failed

- nie

- Brak

- Awarie

- rodzin

- szybciej

- wadliwy

- Cecha

- Korzyści

- filet

- i terminów, a

- koncentruje

- obserwuj

- następujący

- W razie zamówieenia projektu

- dawniej

- znaleziono

- Fundacja

- założyciel

- Założyciel i CEO

- cztery

- Framework

- Frankfurt

- częsty

- często

- od

- pełny

- w pełni

- ogólnie

- wygenerowane

- generatywny

- generatywna sztuczna inteligencja

- otrzymać

- GitHub

- cel

- będzie

- regulowane

- udzielony

- Zarządzanie

- Grupy

- uchwyt

- sprzęt komputerowy

- Have

- mający

- he

- głowa

- uzdrowienie

- Zdrowie

- zdrowy

- ciężki

- ciężkie podnoszenie

- pomaga

- Wysoki

- na wysokim szczeblu

- wysoka wydajność

- Najwyższa

- wysoko

- jego

- posiada

- gospodarz

- W jaki sposób

- How To

- HPC

- HTML

- http

- HTTPS

- Setki

- ID

- tożsamość

- Idle

- if

- obraz

- Natychmiastowy

- wdrożenia

- podnieść

- in

- zawierać

- włączony

- Włącznie z

- Zwiększać

- przemysł

- Informacja

- Systemy informacyjne

- Infrastruktura

- Wejścia

- zainstalować

- zainstalowany

- przykład

- instrukcje

- zintegrowany

- Integruje się

- Inteligencja

- interakcji

- interaktywne

- Interfejs

- przerwane

- najnowszych

- wprowadzenie

- zaangażowany

- Irlandia

- problemy

- IT

- Praca

- Oferty pracy

- łączący

- jpg

- json

- Justin

- znany

- duży

- na dużą skalę

- Utajenie

- później

- firmy

- prowadzący

- UCZYĆ SIĘ

- nauka

- biblioteki

- Biblioteka

- Licencja

- wifecycwe

- Modernizacja

- lubić

- Linia

- linux

- Lama

- miejscowy

- log

- Zaloguj Się

- Popatrz

- wygląda jak

- utraty

- niski

- maszyna

- uczenie maszynowe

- utrzymać

- Utrzymywanie

- robić

- WYKONUJE

- Dokonywanie

- zarządzane

- i konserwacjami

- kierownik

- rynek

- mistrzowski

- Materia

- Maksymalizuj

- Meta

- minut

- ML

- Moda

- model

- modele

- Nowoczesne technologie

- monitor

- monitorowane

- monitorowanie

- miesięcy

- jeszcze

- przeważnie

- Nazwa

- rodzimy

- Nawigacja

- Potrzebować

- potrzebne

- potrzeba

- sieć

- Nowości

- Nowe funkcje

- węzeł

- węzły

- noty

- już dziś

- Nvidia

- of

- Ohio

- on

- Na żądanie

- ONE

- koncepcja

- open source

- operacyjny

- operacyjny

- optymalizacja

- optymalizacji

- or

- orkiestracja

- Oregon

- Oss

- Inne

- ludzkiej,

- wydajność

- koniec

- Pacyfik

- chleb

- Parallel

- parametr

- parametry

- Przechodzący

- ścieżka

- wykonać

- jest gwarancją najlepszej jakości, które mogą dostarczyć Ci Twoje monitory,

- PhD

- plato

- Analiza danych Platona

- PlatoDane

- wtyczka

- Popularny

- Post

- potencjał

- Przygotować

- poprzedni

- poprzednio

- Główny

- Wcześniejszy

- prywatny

- Proaktywne

- kontynuować

- przetwarzanie

- Produkt

- Postęp

- projektowanie

- pod warunkiem,

- zapewnia

- że

- Wydawniczy

- ilość

- RE

- Zalecana

- regeneracja

- zmniejszyć

- odnosić się

- region

- regiony

- regularny

- regularnie

- usunąć

- naprawa

- obsługi produkcji rolnej, która zastąpiła

- wymiana

- zażądać

- wymagać

- Wymaga

- Badania naukowe

- badania i rozwój

- Rezerwacja

- rezerwować

- sprężysty

- Zasób

- Zasoby

- odpowiedź

- odpowiedzialny

- Resume

- Rola

- Routing

- reguły

- run

- bieganie

- działa

- sagemaker

- taki sam

- Zapisz

- Skala

- skalowaniem

- nauka

- Naukowiec

- scenariusz

- skrypty

- SDKS

- bezszwowy

- Szukaj

- Seattle

- bezpieczeństwo

- widzieć

- segment

- senior

- służyć

- usługa

- Usługi

- Sesja

- zestaw

- Share

- powinien

- pokazał

- Podobnie

- Prosty

- uproszczony

- Singapur

- pojedynczy

- mniejszy

- Tworzenie

- rozwoju oprogramowania

- Inżynieria oprogramowania

- Rozwiązania

- Rozwiązywanie

- Źródło

- Głośnik

- specjalista

- specyficzny

- określony

- wydać

- dzielić

- Stabilność

- stabilny

- standardy

- początek

- state-of-the-art

- Rynek

- Cel

- przechowywanie

- sklep

- bezpośredni

- badania naukowe

- uległość

- Zatwierdź

- składane

- podsieci

- taki

- Garnitur

- apartament

- PODSUMOWANIE

- wsparcie

- Wspierający

- pewnie

- sydney

- synchronizacja

- system

- systemy

- stół

- Brać

- Techniczny

- kilkadziesiąt

- terminal

- texas

- niż

- że

- Połączenia

- ich

- Im

- następnie

- Te

- one

- to

- tysiące

- Przez

- poprzez

- czas

- do

- już dziś

- tokenizować

- Tokio

- Pociąg

- Trening

- przenieść

- rodzaj

- typy

- dla

- uniwersytet

- University of Tokio

- Aktualizacja

- posługiwać się

- używany

- Użytkownik

- Użytkownicy

- zastosowania

- za pomocą

- użyteczność

- Wykorzystując

- różnorodny

- Naprawiono

- wersja

- przez

- Zobacz i wysłuchaj

- virginia

- Wirtualny

- Odwiedzić

- solucja

- była

- Droga..

- we

- sieć

- usługi internetowe

- tygodni

- DOBRZE

- jeśli chodzi o komunikację i motywację

- który

- Podczas

- szeroko

- Wikipedia

- będzie

- w

- w ciągu

- bez

- pracował

- pracownik

- by

- You

- Twój

- zefirnet