W zeszłym miesiącu program Networking and Information Technology Research and Development (NITRD) upamiętnił ich 30. rocznicę w Waszyngtonie. Możesz przeczytać pełne podsumowanie wydarzenia tutaj. W celu podkreślenia wpływu, jaki inwestycje federalne wywarły na społeczność badaczy komputerowych, podczas wydarzenia odbyło się pięć paneli, w których uczestnicy dyskutowali o kluczowych osiągnięciach w tej dziedzinie w ciągu ostatniej dekady i przyszłych kierunkach. Każdy panel koncentrował się na ważnym podobszarze badań komputerowych: Computing at Scale, Networking and Security, Artificial Intelligence/Machine Learning, Privacy and Internet of Things oraz Socially Responsible Computing.

Prywatność stała się ogromnym tematem rozmów nie tylko wśród społeczności badaczy komputerowych, ale we wszystkich dyscyplinach, zarówno w środowisku akademickim, jak i przemysłowym. Niekorzystne skutki dla prywatności wynikające z dostępności wielkoskalowych zbiorów danych są mnożone przez: połączone ze sobą czujniki, urządzenia i aktuatory które składają się na Internet Rzeczy (IoT). Moderowana przez Charles („Chuck”) Romine (NIST) oraz eksperci terenowi Ed Felten (Princeton), Marc Groman (Groman Consulting), Katerinę Megas (NIST) i Sunoo Park (Cornell), Panel 4: Prywatność i IoT omawia ważne tematy, takie jak kompromisy między wykorzystaniem danych a prywatnością oraz potencjalne cele badawcze, które pomogą w osiągnięciu skutecznych rozwiązań politycznych.

Romine zaczął od podkreślenia wspólnego wątku we wszystkich panelach: „mówiąc zarówno o korzyściach, jak i niezwykłych możliwościach dostarczanych przez inwestycje z funduszy federalnych, wraz z powiązanym ryzykiem”. IoT nie jest inny, zapewnia ludziom dostęp do informacji nie do zdobycia, umożliwia skuteczne kampanie reklamowe i dostosowywanie technologii do własnych upodobań, ale także zagraża prywatności użytkowników.

Jak zauważył Megas: „Całym powodem, dla którego podejmujemy ten wysiłek, jest to, że chcemy rzeczywiście zobaczyć, jak IoT jest rozpoznawany, a społeczeństwo może czerpać z tego korzyści”. Następnie podzieliła się potencjalnymi korzyściami i znaczeniem możliwości udostępniania danych w IoT. Istnieje „fenomenalna” skala urządzeń w IoT, które można wykorzystać do identyfikowania problemów w zbiorach danych, uczenia się rzeczy, które mają duży potencjał wpływu na jednostki i społeczeństwo, szkolenia technologii sztucznej inteligencji oraz umożliwiania małym innowacyjnym firmom testowanie ich urządzeń. Romine zapytała panelistów, jakie w rzeczywistości są zagrożenia prywatności w kontekście Internetu Rzeczy i udostępniania informacji.

Groman odpowiedział, najpierw wyjaśniając współzależność między prywatnością a Internetem Rzeczy. Strona prywatności IoT to podzbiór danych w ramach większego zbioru, który jest gromadzony, który dotyczy lub dotyczy ludzi. Czy ludzie wiedzą, że zbierane są o nich dane? Czy istnieje interfejs, w którym można wchodzić w interakcję z urządzeniem, dowiedzieć się, co gromadzi lub zmienić? Czy ludzie rozumieją, jakie informacje są gromadzone lub jakie wnioski są wyciągane przez urządzenie lub firmę z gromadzonych danych? Ze względu na strukturę zachęt pieniężnych i „ogromną” ilość, jaką firmy mogą zarobić na kapitalizacji takich danych, Groman wezwał ludzi do zwrócenia się do polityki w celu znalezienia rozwiązania.

„Celem tutaj jest maksymalizacja korzyści i minimalizacja szkód. Nie mamy w tym kraju polityki, ram prawnych ani regulacyjnych, które stwarzałyby zachęty do tego, aby się tam dostać” – Marc Groman

Sprzeciwiając się stanowisku Gromana, Romine zapytał panel o potencjał rozwiązania technologicznego.

Felten zasugerował, abyśmy zaczęli od dążenia do lepszego zrozumienia i stosowania kontroli informacji statystycznych oraz stworzenia narzędzi, które pozwolą ludziom na interakcję z ich danymi i łagodzą negatywne skutki. Park, który szczególnie interesuje się kryptograficznymi narzędziami ochrony prywatności, wymienił kilka sposobów, w jakie kryptografia może pomóc w tym zakresie.

„Kryptografia zapewnia zestaw narzędzi do budowania systemów, które mają konfiguracje przepływów informacji i obejmują bardziej szczegółową kontrolę nad dostępem”. – Sunoo Park

Jednym z narzędzi mogą być dowody z wiedzą zerową, które pozwalają na częściowe udostępnianie danych przy jednoczesnym utrzymaniu innych aspektów w tajemnicy przed podmiotami. Podała przykład bramkarza sprawdzającego identyfikatory, aby dostać się do baru – dzięki dowodom z wiedzą zerową możesz udowodnić, że masz 21 lat, bez podania adresu lub daty urodzenia również wymienionych w dowodzie.

Park ostrzegł, że chociaż kryptografia zapewnia „większą przestrzeń rozwiązań, którą możemy wykorzystać do budowania prywatności”, nie odpowiada na pytanie, jakie rzeczy powinniśmy budować za pomocą tych narzędzi ani jakie formy informacji uważamy za odpowiednie lub pożądane do udostępnienia. To jest coś, co musimy wypracować jako społeczeństwo i kwestia polityki.

Na koniec zapytano panelistów, dlaczego ludzi powinno to obchodzić. A jeśli nie mają nic do ukrycia? Rozśmieszając się z tłumu, Felten zażartował, że każdy ma coś do ukrycia. W poważniejszej notatce kontynuował podkreślanie potencjalnej szkody w profilowaniu danych.

„Ludzie budują kompleksowy model tego, kim jesteś i co prawdopodobnie zrobisz”. – Ed Felten

Już przerażająca myśl, te założenia mogą być błędne i czasami ograniczać możliwości i „swobodę działania” w przyszłości. Groman wskazał na inny wspólny wątek w dyskusjach panelowych – znaczenie uświadomienia sobie, że niektóre społeczności są nieproporcjonalnie dotknięte. Stawka może być wyższa, jeśli chodzi o zachowanie prywatności niektórych danych, niezależnie od tego, czy dotyczą one orientacji seksualnej, płci, rasy czy maltretowanych kobiet lub dzieci.

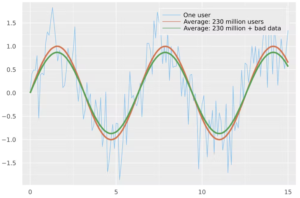

Podczas pytań i odpowiedzi były mówca z panelu 3, Ben Zorn, wspomniał o korzyściach płynących z wykorzystywania danych do trenowania sztucznej inteligencji. Zapytał, co można zrobić w przypadku wycieku prywatnych informacji przez zbiory danych wykorzystywane do szkolenia sztucznej inteligencji.

Felten zwrócił uwagę, że jeśli nie stosujesz rygorystycznej metody celowego zatrzymania napływu informacji, informacje będą płynąć. Dlatego tak ważne jest, aby skupić się na budowaniu rygorystycznych i dających się udowodnić metod takich jak uczenie maszynowe z zachowaniem prywatności i interfejsy do kontrolowania efektu spływania.

Megas podsumował to doskonale, że ostatecznie nie możemy wyszkolić wszystkich, ale możemy zapewnić ludziom strukturę, która pozwoli im myśleć o ryzyku i dać im narzędzia, które dadzą im większą kontrolę nad swoimi danymi. Pełne nagranie można obejrzeć na Strona internetowa CCC lub Kanał YouTube NITRD.

Wypatruj ostatniego bloga z tej serii, Panel 5: Jak technologia może przynieść korzyści społeczeństwu: poszerzanie perspektyw w badaniach podstawowych.