Niedawno wprowadziliśmy nową funkcję w Zestaw SDK Amazon SageMaker dla Pythona która umożliwia analitykom danych uruchamianie kodu uczenia maszynowego (ML) utworzonego w ich preferowanym zintegrowanym środowisku programistycznym (IDE) i notebookach wraz z powiązanymi zależnościami środowiska wykonawczego, jak Amazon Sage Maker zadania szkoleniowe przy minimalnych zmianach kodu do eksperymentów wykonywanych lokalnie. Analitycy danych zazwyczaj przeprowadzają kilka iteracji eksperymentów w modelach przetwarzania i uczenia danych podczas pracy nad dowolnym problemem uczenia maszynowego. Chcą uruchomić ten kod ML i przeprowadzić eksperymenty z łatwością użytkowania i minimalną zmianą kodu. Szkolenie modelowe Amazon SageMaker pomaga analitykom danych przeprowadzać w pełni zarządzane zadania szkoleniowe na dużą skalę w infrastrukturze obliczeniowej AWS. Szkolenie SageMaker pomaga również analitykom danych dzięki zaawansowanym narzędziom, takim jak Debuger Amazon SageMaker i Profiler do debugowania i analizowania ich zadań szkoleniowych na dużą skalę.

W przypadku klientów z niewielkimi budżetami, małymi zespołami i napiętymi harmonogramami każda nowa koncepcja i linia kodu przepisana pod kątem działania w SageMaker zmniejsza produktywność ich podstawowych zadań, a mianowicie przetwarzania danych i szkolenia modeli ML. Chcą napisać kod raz w wybranym przez siebie środowisku i móc bezproblemowo przejść od uruchamiania kodu w notebookach lub laptopach do uruchamiania kodu na dużą skalę przy użyciu funkcji SageMaker.

Dzięki tej nowej możliwości SageMaker Python SDK, analitycy danych mogą w ciągu kilku minut wprowadzić swój kod ML na platformę SageMaker Training. Wystarczy dodać jedną linię kodu do kodu ML, a SageMaker inteligentnie zrozumie Twój kod wraz z zestawami danych i konfiguracją środowiska roboczego i uruchomi go jako zadanie szkoleniowe SageMaker. Następnie możesz skorzystać z kluczowych możliwości platformy szkoleniowej SageMaker, takich jak możliwość łatwego skalowania zadań i innych powiązanych narzędzi, takich jak Debugger i Profiler. W tej wersji możesz uruchamiać lokalny kod Pythona uczenia maszynowego (ML) jako jednowęzłowe zadanie szkoleniowe Amazon SageMaker lub wiele zadań równoległych. Rozproszone zadania szkoleniowe (w wielu węzłach) nie są obsługiwane przez funkcje zdalne.

W tym poście pokażemy, jak wykorzystać tę nową możliwość do uruchomienia lokalnego kodu ML jako zadania szkoleniowego SageMaker.

Omówienie rozwiązania

Możesz teraz uruchomić swój kod ML zapisany w swoim IDE lub notatniku jako zadanie SageMaker Training, dodając adnotację do funkcji, która działa jako punkt wejścia do bazy kodu użytkownika, za pomocą prostego dekoratora. Po wywołaniu ta funkcja automatycznie wykonuje migawkę wszystkich powiązanych zmiennych, funkcji, pakietów, zmiennych środowiskowych i innych wymagań środowiska wykonawczego z kodu ML, serializuje je i przesyła jako zadanie szkoleniowe SageMaker. Integruje się z niedawno ogłoszonym Funkcja SageMaker Python SDK do ustawiania domyślnych wartości parametrów. Ta funkcja upraszcza konstrukcje SageMaker, których musisz się nauczyć, aby móc uruchamiać kod za pomocą SageMaker Training. Analitycy danych mogą pisać, debugować i iterować swój kod w dowolnym preferowanym środowisku IDE (takim jak Studio Amazon SageMaker, notatniki, VS Code lub PyCharm). Kiedy wszystko będzie gotowe, możesz dodać adnotację do swojej funkcji Pythona za pomocą pliku @remote decorator i uruchom go jako zadanie SageMaker na dużą skalę.

Ta funkcja przyjmuje znane obiekty języka Python typu open source jako argumenty i dane wyjściowe. Co więcej, nie musisz rozumieć zarządzania cyklem życia kontenera i możesz po prostu uruchamiać swoje obciążenia w różnych kontekstach obliczeniowych (takich jak lokalne środowisko IDE, Studio lub zadania szkoleniowe) przy minimalnych nakładach na konfigurację. Aby uruchomić dowolny kod lokalny jako zadanie SageMaker Training, ta funkcja określa konfiguracje wymagane do uruchomienia zadań, takie jak AWS Zarządzanie tożsamością i dostępem (IAM), klucz szyfrowania i konfigurację sieci z poziomu ustawień Studio lub IDE (które mogą być Ustawienia domyślne) i domyślnie przekazuje je do platformy. Masz swobodę dostosowywania swojego środowiska uruchomieniowego w zarządzanej infrastrukturze SageMaker przy użyciu wywnioskowanej konfiguracji lub zastąpienia ich na poziomie SDK, przekazując je jako argumenty do dekoratora.

Ta nowa funkcja SageMaker Python SDK przekształca kod ML w istniejącym środowisku obszaru roboczego oraz wszelki powiązany kod przetwarzania danych i zestawy danych w zadanie SageMaker Training. Ta funkcja szuka kodu ML opakowanego w plik @remote decorator i automatycznie tłumaczy go na zadanie, które działa w Studio lub lokalnym IDE, takim jak PyCharm.

W poniższych sekcjach omawiamy funkcje tej nowej możliwości oraz sposób uruchamiania funkcji Pythona jako zadań szkoleniowych SageMaker.

Wymagania wstępne

Aby skorzystać z tej nowej funkcji SageMaker Python SDK i uruchomić kod powiązany z tym postem, potrzebujesz następujących wymagań wstępnych:

- Konto AWS, które będzie zawierało wszystkie Twoje zasoby AWS

- Rola IAM umożliwiająca dostęp do SageMaker

- Dostęp do Studio lub instancji notatnika SageMaker lub IDE, takiego jak PyCharm

Użyj zestawu SDK z notebooków Studio i SageMaker

Możesz użyć tej możliwości w Studio, uruchamiając notatnik i opakowując swój kod za pomocą rozszerzenia @remote dekorator wewnątrz notebooka. Najpierw musisz zaimportować funkcję zdalną przy użyciu następującego kodu:

from sagemaker.remote_function import remoteGdy użyjesz funkcji dekoratora, ta funkcja automatycznie zinterpretuje funkcję Twojego kodu i uruchomi ją jako zadanie szkoleniowe SageMaker.

Możesz także użyć tej możliwości z instancji notatnika SageMaker. Najpierw musisz uruchomić instancję notatnika, otworzyć na niej Jupyter lub Jupyter Lab i uruchomić notatnik. Następnie zaimportuj funkcję zdalną, jak pokazano w poprzednim kodzie, i zawiń swój kod za pomocą @remote dekorator. Przykład użycia funkcji dekoratora i związanych z nią ustawień zamieszczamy w dalszej części tego wpisu.

Użyj zestawu SDK z lokalnego środowiska

Możesz także użyć tej możliwości z lokalnego środowiska IDE. Warunkiem koniecznym jest posiadanie tzw Interfejs wiersza poleceń AWS (AWS CLI), SageMaker Python SDK i AWS SDK dla Pythona (Boto3) zainstalowany w środowisku lokalnym. Musisz zaimportować te biblioteki do swojego kodu, ustawić sesję SageMaker, określić ustawienia i ozdobić swoją funkcję za pomocą @remote dekorator. W poniższym przykładowym kodzie uruchamiamy prostą funkcję dzielenia jako zadanie SageMaker Training:

import boto3

import sagemaker

from sagemaker.remote_function import remote sm_session = sagemaker.Session(boto_session=boto3.session.Session(region_name="us-west-2"))

settings = dict(

sagemaker_session=sm_session,

role=<IAM_ROLE_NAME>

instance_type="ml.m5.xlarge",

)

@remote(**settings)

def divide(x, y):

return x / y

if __name__ == "__main__":

print(divide(2, 3.0))Możemy użyć podobnej metodologii do uruchamiania zaawansowanych funkcji jako zadań szkoleniowych, jak pokazano w następnej sekcji.

Uruchamiaj funkcje Pythona jako zadania SageMaker

Nowa funkcja SageMaker Python SDK umożliwia uruchamianie funkcji Pythona jako Oferty pracy szkoleniowej SageMaker. Każdy kod Pythona, kod szkoleniowy ML opracowany przez analityków danych przy użyciu ich preferowanych lokalnych IDE (PyCharm, VS Code), notatników SageMaker lub notatników Studio można uruchomić jako zarządzane zadanie SageMaker.

W obciążeniach ML korzystających z tej możliwości powiązane zestawy danych, zależności i konfiguracje środowiska obszaru roboczego są serializowane przy użyciu kodu ML i uruchamiane jako zadanie SageMaker synchronicznie i asynchronicznie.

Możesz dodać a @remote adnotację dekoratora do dowolnego kodu Pythona, w tym lokalnego przetwarzania ML lub funkcji szkoleniowej, aby uruchomić je jako zarządzane zadanie szkoleniowe SageMaker, wykorzystując w ten sposób korzyści ze skali, wydajności i kosztów SageMaker. Można to osiągnąć przy minimalnych zmianach kodu, dodając dekorator do kodu funkcji Pythona. Wywołanie udekorowanej funkcji jest uruchamiane synchronicznie, a uruchomienie funkcji czeka na zakończenie zadania SageMaker.

W poniższym przykładzie używamy @remote decorator do uruchamiania zadań SageMaker w trybie dekoratora przy użyciu instancji ml.m5.large. SageMaker używa zadań szkoleniowych, aby uruchomić tę funkcję jako zadanie zarządzane.

from sagemaker.remote_function import remote

from numpy as np @remote(instance_type="ml.m5.large")

def matrix_multiply(a, b): return np.matmul(a, b) a = np.array([[1, 0], [0, 1]])

b = np.array([1, 2]) assert matrix_multiply(a, b) == np.array([1,2])Możesz także użyć trybu dekoratora do uruchamiania zadań SageMaker, pakietów Pythona i zależności. Możesz dołączyć zmienne środowiskowe, takie jak VPC, podsieci i grupy zabezpieczeń, aby uruchomić zadania szkoleniowe SageMaker w environment.yml plik. Dzięki temu inżynierowie i administratorzy ML mogą konfigurować te zmienne środowiskowe, aby analitycy danych mogli skupić się na budowaniu modelu ML i szybciej wykonywać iteracje. Zobacz następujący kod:

from sagemaker.remote_function import remote @remote(instance_type="ml.g4dn.xlarge",dependencies = "./environment.yml")

def train_hf_model(

train_input_path,test_input_path,s3_output_path = None,

*,epochs = 1, train_batch_size = 32, eval_batch_size = 64,

warmup_steps = 500,learning_rate = 5e-5

):

model_name = "distilbert-base-uncased"

model = AutoModelForSequenceClassification.from_pretrained(model_name)

... <TRUCNATED>

return os.path.join(s3_output_path, model_dir), eval_resultMożesz użyć RemoteExecutor aby asynchronicznie uruchamiać funkcje Pythona jako zadania SageMaker. Wykonawca asynchronicznie sonduje zadania SageMaker Training, aby zaktualizować status zadania. The RemoteExecutor klasa jest implementacją współbieżny.futures.Executor, który jest używany do asynchronicznego przesyłania zadań szkoleniowych SageMaker. Zobacz następujący kod:

from sagemaker.remote_function import RemoteExecutor def train_hf_model(

train_input_path,test_input_path,s3_output_path = None,

*,epochs = 1, train_batch_size = 32, eval_batch_size = 64,

warmup_steps = 500,learning_rate = 5e-5

):

model_name = "distilbert-base-uncased"

model = AutoModelForSequenceClassification.from_pretrained(model_name)

...<TRUNCATED>

return os.path.join(s3_output_path, model_dir), eval_result with RemoteExecutor(instance_type="ml.g4dn.xlarge", dependencies = './requirements.txt') as e:

future = e.submit(train_hf_model, train_input_path,test_input_path,s3_output_path,

epochs, train_batch_size, eval_batch_size,warmup_steps,learning_rate)Dostosuj środowisko wykonawcze

Tryb dekoratora i RemoteExecutor umożliwiają definiowanie i dostosowywanie środowisk wykonawczych dla zadania SageMaker. Zależności środowiska wykonawczego, w tym pakiety Pythona i zmienne środowiskowe dla zadań SageMaker, można określić w celu dostosowania środowiska wykonawczego. Aby uruchomić lokalny kod Pythona jako zadania zarządzane przez SageMaker, należy udostępnić SageMakerowi pakiet Pythona i zależności. Inżynierowie ML lub administratorzy nauki o danych mogą konfigurować konfiguracje sieci i zabezpieczeń, takie jak VPC, podsieci i grupy zabezpieczeń dla zadań SageMaker, dzięki czemu analitycy danych mogą korzystać z tych centralnie zarządzanych konfiguracji podczas uruchamiania zadań SageMaker. Możesz użyć albo A requirements.txt plik lub Conda environment.yaml plik.

Kiedy zależności są zdefiniowane za pomocą requirements.txt, pakiety zostaną zainstalowane przy użyciu pip w czasie wykonywania zadania. Jeśli obraz używany do uruchamiania zadania jest dostarczany ze środowiskami Conda, pakiety zostaną zainstalowane w środowisku Conda zadeklarowanym do użycia w zadaniach. Poniższy kod przedstawia przykład requirements.txt file:

datasets

transformers

torch

scikit-learn

s3fs==0.4.2

sagemaker>=2.148.0Możesz przekazać swoje Conda environment.yaml plik, aby utworzyć środowisko Conda, w którym chcesz, aby Twój kod był uruchamiany podczas zadania szkoleniowego. Jeśli obraz użyty do uruchomienia zadania deklaruje środowisko Conda do uruchomienia kodu, zaktualizujemy zadeklarowane środowisko Conda o podaną specyfikację. Poniższy kod jest przykładem pliku a Conda environment.yaml file:

name: sagemaker_example

channels: - conda-forge

dependencies: - python=3.10 - pandas - pip: - sagemakerAlternatywnie możesz ustawić dependencies=”auto_capture” aby umożliwić SageMaker Python SDK przechwycenie zainstalowanych zależności w aktywnym środowisku Conda. Musisz mieć aktywne środowisko Conda auto_capture pracować. Pamiętaj, że istnieją warunki wstępne auto_capture pracować; zalecamy przekazanie swoich zależności jako a requirement.txt or Conda environment.yml plik, jak opisano w poprzedniej sekcji.

Aby uzyskać więcej informacji, zobacz Uruchom lokalny kod jako zadanie szkoleniowe SageMaker.

Konfiguracje dla zadań SageMaker

Ustawienia związane z infrastrukturą można przenieść do pliku konfiguracyjnego, w którym mogą pomóc administratorzy. Wystarczy ustawić go tylko raz. Ustawienia infrastruktury obejmują konfigurację sieci, role IAM, Usługa Amazon Simple Storage (Amazon S3) dla danych wejściowych, wyjściowych i tagów. Odnosić się do Konfigurowanie i używanie ustawień domyślnych za pomocą zestawu SageMaker Python SDK by uzyskać więcej szczegółów.

SchemaVersion: '1.0'

SageMaker:

PythonSDK:

Modules:

RemoteFunction:

Dependencies: path/to/requirements.txt

EnvironmentVariables: {"EnvVarKey": "EnvVarValue"}

ImageUri: 366666666666.dkr.ecr.us-west-2.amazonaws.com/my-image:latest

InstanceType: ml.m5.large

RoleArn: arn:aws:iam::366666666666:role/MyRole

S3KmsKeyId: somekmskeyid

S3RootUri: s3://my-bucket/my-project

SecurityGroupIds:

- sg123

Subnets:

- subnet-1234

Tags:

- {"Key": "someTagKey", "Value": "someTagValue"}

VolumeKmsKeyId: somekmskeyidRealizacja

Modele uczenia głębokiego, takie jak PyTorch lub TensorFlow, można również uruchamiać w Studio, uruchamiając kod jako zadanie szkoleniowe w notatniku. Aby zaprezentować tę możliwość w Studio, możesz sklonować to repozytorium do swojego Studio i uruchomić notatnik znajdujący się w GitHub magazyn.

Ten przykład ilustruje przypadek użycia kompleksowej klasyfikacji tekstu binarnego. Korzystamy z biblioteki transformatorów Hugging Face i zestawów danych, aby dostroić wstępnie przeszkolony transformator w zakresie klasyfikacji tekstu binarnego. W szczególności wstępnie wytrenowany model zostanie dostrojony przy użyciu Zbiór danych IMDb.

Podczas klonowania repozytorium należy zlokalizować następujące pliki:

- konfiguracja.yaml – Większość argumentów dekoratora można przenieść do pliku konfiguracyjnego w celu oddzielenia ustawień związanych z infrastrukturą od bazy kodu

- przytulanie.ipynb – Zawiera kod do trenowania wstępnie wytrenowanego modelu HuggingFace, który zostanie dopracowany przy użyciu zestawu danych IMDB

- wymagania.txt – Ten plik zawiera wszystkie zależności do uruchomienia funkcji, która będzie używana w tym notatniku do uruchamiania kodu i zdalnego uruchamiania szkolenia w instancji GPU jako zadanie szkoleniowe

Po otwarciu notebooka zostanie wyświetlony monit o skonfigurowanie środowiska notebooka. Możesz wybrać obraz Data Science 3.0 z jądrem języka Python 3 i ml.m5.large jako typem wystąpienia szybkiego uruchamiania do uruchamiania kodu notesu. Ten typ instancji jest znacznie szybszy w uruchamianiu środowiska.

Zadanie szkoleniowe zostanie uruchomione w instancji ml.g4dn.xlarge zgodnie z definicją w pliku config.yaml file:

SchemaVersion: '1.0'

SageMaker:

PythonSDK:

Modules:

RemoteFunction:

# role arn is not required if in SageMaker Notebook instance or SageMaker Studio

# Uncomment the following line and replace with the right execution role if in a local IDE

# RoleArn: <IAM_ROLE_ARN>

InstanceType: ml.g4dn.xlarge

Dependencies: ./requirements.txtPołączenia requirements.txt Zależności plików, aby uruchomić funkcję uczenia modelu przytulania obejmują:

datasets

transformers

torch

scikit-learn

# lock s3fs to this specific version as more recent ones introduce dependency on aiobotocore, which is not compatible with botocore

s3fs==0.4.2

sagemaker>=2.148.0,<3Notatnik Hugging Face pokazuje, jak przeprowadzić szkolenie zdalnie za pośrednictwem @remote funkcja, która jest uruchamiana synchronicznie. W związku z tym funkcja uruchomiona w celu szkolenia modelu będzie czekać do zakończenia zadania szkolenia SageMaker. Szkolenie zostanie przeprowadzone zdalnie z instancją GPU, której typ instancji jest zdefiniowany w poprzednim pliku konfiguracyjnym.

Po uruchomieniu zadania szkoleniowego możesz uruchomić pozostałe komórki w notesie, aby sprawdzić metryki oceny i sklasyfikować tekst w naszym wyszkolonym modelu.

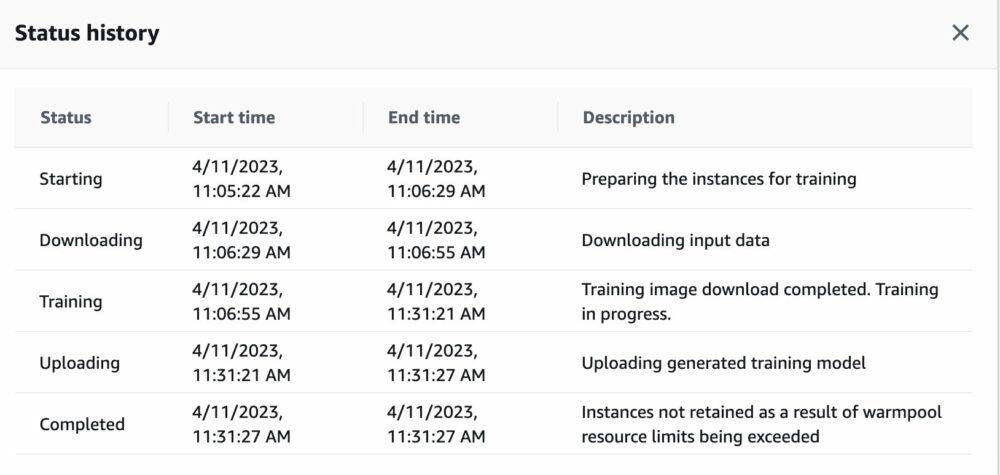

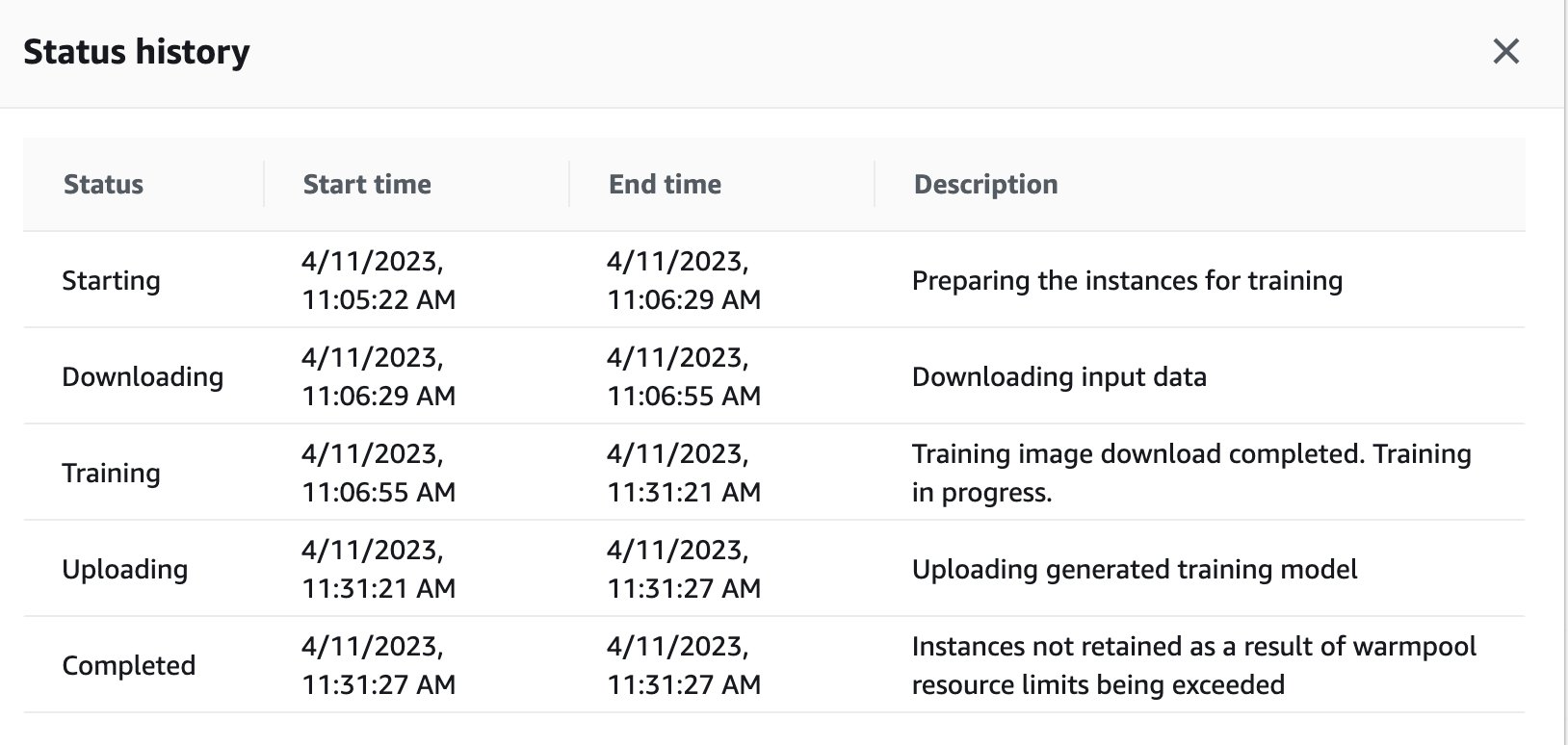

Możesz również wyświetlić stan zadania szkoleniowego, które zostało zdalnie uruchomione w instancji GPU na pulpicie nawigacyjnym SageMaker, przechodząc z powrotem do konsoli SageMaker.

Po zakończeniu zadania szkoleniowego kontynuuje wykonywanie instrukcji w notatniku w celu oceny i klasyfikacji. Podobne zadania można trenować i uruchamiać za pomocą funkcji zdalnego executora osadzonej w notatnikach Studio, aby przeprowadzać przebiegi asynchronicznie.

Integracja z eksperymentami SageMaker wewnątrz funkcji @remote

Możesz przekazać nazwę eksperymentu, nazwę przebiegu i inne parametry do funkcji zdalnej, aby utworzyć przebieg eksperymentów SageMaker. Poniższy przykład kodu importuje nazwę eksperymentu, nazwę przebiegu i parametry do zarejestrowania dla każdego przebiegu:

from sagemaker.remote_function import remote

from sagemaker.experiments.run import Run

# Define your remote function

@remote

def train(value_1, value_2, exp_name, run_name):

...

...

#Creates the experiment

with Run( experiment_name=exp_name, run_name=run_name, sagemaker_session=sagemaker_session

) as run:

...

...

#Define values for the parameters to log

run.log_parameter("param_1", value_1)

run.log_parameter("param_2", value_2)

...

...

#Define metrics to log

run.log_metric("metric_a", 0.5)

run.log_metric("metric_b", 0.1) # Invoke your remote function

train(1.0, 2.0, "my-exp-name", "my-run-name") W poprzednim przykładzie parametry p1 i p2 są rejestrowane w czasie w pętli treningowej. Typowe parametry mogą obejmować wielkość partii lub epoki. W przykładzie metryki A i B są rejestrowane dla biegu w czasie wewnątrz pętli treningowej. Typowe wskaźniki mogą obejmować dokładność lub stratę. Aby uzyskać więcej informacji, zobacz Utwórz eksperyment Amazon SageMaker.

Wnioski

W tym poście przedstawiliśmy nową funkcję SageMaker Python SDK, która umożliwia naukowcom danych uruchamianie ich kodu ML w preferowanym IDE jako zadania SageMaker Training. Omówiliśmy wymagania wstępne potrzebne do korzystania z tej możliwości wraz z jej funkcjami. Pokazaliśmy również, jak korzystać z tej możliwości w Studio, instancjach notatników SageMaker i lokalnym środowisku IDE. Ponadto udostępniliśmy przykładowe przykłady kodu, aby zademonstrować, jak korzystać z tej możliwości. Jako następny krok zalecamy wypróbowanie tej możliwości w swoim IDE lub SageMaker, postępując zgodnie z przykłady kodu wymieniony w tym poście.

O autorach

Dipankara Patro jest inżynierem ds. rozwoju oprogramowania w AWS SageMaker, opracowuje innowacje i buduje rozwiązania MLOps, aby pomóc klientom wdrażać rozwiązania AI/ML na dużą skalę. Posiada tytuł magistra informatyki, a jego obszary zainteresowań to bezpieczeństwo komputerowe, systemy rozproszone i sztuczna inteligencja/uczenie maszynowe.

Dipankara Patro jest inżynierem ds. rozwoju oprogramowania w AWS SageMaker, opracowuje innowacje i buduje rozwiązania MLOps, aby pomóc klientom wdrażać rozwiązania AI/ML na dużą skalę. Posiada tytuł magistra informatyki, a jego obszary zainteresowań to bezpieczeństwo komputerowe, systemy rozproszone i sztuczna inteligencja/uczenie maszynowe.

Farooq Sabir jest starszym architektem rozwiązań w zakresie sztucznej inteligencji i uczenia maszynowego w AWS. Posiada tytuł doktora i magistra inżynierii elektrycznej uzyskany na University of Texas w Austin oraz tytuł magistra informatyki uzyskany na Georgia Institute of Technology. Ma ponad 15-letnie doświadczenie zawodowe, a także lubi uczyć i mentorować studentów. W AWS pomaga klientom formułować i rozwiązywać ich problemy biznesowe w zakresie nauki o danych, uczenia maszynowego, wizji komputerowej, sztucznej inteligencji, optymalizacji numerycznej i pokrewnych dziedzin. Mieszka w Dallas w Teksasie i wraz z rodziną uwielbia podróżować i wyruszać w długie podróże.

Farooq Sabir jest starszym architektem rozwiązań w zakresie sztucznej inteligencji i uczenia maszynowego w AWS. Posiada tytuł doktora i magistra inżynierii elektrycznej uzyskany na University of Texas w Austin oraz tytuł magistra informatyki uzyskany na Georgia Institute of Technology. Ma ponad 15-letnie doświadczenie zawodowe, a także lubi uczyć i mentorować studentów. W AWS pomaga klientom formułować i rozwiązywać ich problemy biznesowe w zakresie nauki o danych, uczenia maszynowego, wizji komputerowej, sztucznej inteligencji, optymalizacji numerycznej i pokrewnych dziedzin. Mieszka w Dallas w Teksasie i wraz z rodziną uwielbia podróżować i wyruszać w długie podróże.

Manoj Ravi jest starszym menedżerem produktu w Amazon SageMaker. Pasjonuje się tworzeniem produktów sztucznej inteligencji nowej generacji oraz pracuje nad oprogramowaniem i narzędziami ułatwiającymi klientom uczenie maszynowe na dużą skalę. Posiada tytuł MBA uzyskany w Haas School of Business oraz tytuł magistra zarządzania systemami informatycznymi uzyskany na Carnegie Mellon University. W wolnym czasie Manoj lubi grać w tenisa i fotografować krajobrazy.

Manoj Ravi jest starszym menedżerem produktu w Amazon SageMaker. Pasjonuje się tworzeniem produktów sztucznej inteligencji nowej generacji oraz pracuje nad oprogramowaniem i narzędziami ułatwiającymi klientom uczenie maszynowe na dużą skalę. Posiada tytuł MBA uzyskany w Haas School of Business oraz tytuł magistra zarządzania systemami informatycznymi uzyskany na Carnegie Mellon University. W wolnym czasie Manoj lubi grać w tenisa i fotografować krajobrazy.

Szikhara Kwatry jest Architektem Rozwiązań Specjalistycznych AI/ML w Amazon Web Services, współpracując z wiodącym Globalnym Integratorem Systemów. Zdobył tytuł jednego z najmłodszych indyjskich mistrzów wynalazców z ponad 500 patentami w domenach AI/ML i IoT. Shikhar pomaga w projektowaniu, budowaniu i utrzymywaniu ekonomicznych, skalowalnych środowisk chmurowych dla organizacji oraz wspiera partnera GSI w budowaniu strategicznych rozwiązań branżowych na AWS. Shikhar lubi grać na gitarze, komponować muzykę i ćwiczyć uważność w wolnym czasie.

Szikhara Kwatry jest Architektem Rozwiązań Specjalistycznych AI/ML w Amazon Web Services, współpracując z wiodącym Globalnym Integratorem Systemów. Zdobył tytuł jednego z najmłodszych indyjskich mistrzów wynalazców z ponad 500 patentami w domenach AI/ML i IoT. Shikhar pomaga w projektowaniu, budowaniu i utrzymywaniu ekonomicznych, skalowalnych środowisk chmurowych dla organizacji oraz wspiera partnera GSI w budowaniu strategicznych rozwiązań branżowych na AWS. Shikhar lubi grać na gitarze, komponować muzykę i ćwiczyć uważność w wolnym czasie.

Vikrama Elango jest Starszym Architektem Rozwiązań Specjalistycznych AI/ML w AWS z siedzibą w Wirginii w USA. Obecnie koncentruje się na generatywnej sztucznej inteligencji, LLM, szybkiej inżynierii, optymalizacji wnioskowania dużych modeli i skalowaniu uczenia maszynowego w przedsiębiorstwach. Vikram pomaga klientom z branży finansowej i ubezpieczeniowej w projektowaniu i myśleniu przywództwem w tworzeniu i wdrażaniu aplikacji uczenia maszynowego na dużą skalę. W wolnym czasie lubi podróżować, wędrować, gotować i biwakować.

Vikrama Elango jest Starszym Architektem Rozwiązań Specjalistycznych AI/ML w AWS z siedzibą w Wirginii w USA. Obecnie koncentruje się na generatywnej sztucznej inteligencji, LLM, szybkiej inżynierii, optymalizacji wnioskowania dużych modeli i skalowaniu uczenia maszynowego w przedsiębiorstwach. Vikram pomaga klientom z branży finansowej i ubezpieczeniowej w projektowaniu i myśleniu przywództwem w tworzeniu i wdrażaniu aplikacji uczenia maszynowego na dużą skalę. W wolnym czasie lubi podróżować, wędrować, gotować i biwakować.

- Dystrybucja treści i PR oparta na SEO. Uzyskaj wzmocnienie już dziś.

- PlatoAiStream. Analiza danych Web3. Wiedza wzmocniona. Dostęp tutaj.

- Wybijanie przyszłości w Adryenn Ashley. Dostęp tutaj.

- Źródło: https://aws.amazon.com/blogs/machine-learning/run-your-local-machine-learning-code-as-amazon-sagemaker-training-jobs-with-minimal-code-changes/

- :ma

- :Jest

- :nie

- $W GÓRĘ

- 1

- 10

- 100

- 15 roku

- 500

- 7

- a

- zdolność

- Zdolny

- O nas

- dostęp

- Konto

- precyzja

- osiągnięty

- w poprzek

- aktywny

- Dzieje Apostolskie

- Dodaj

- dodanie

- dodatek

- Admin

- Administratorzy

- przyjąć

- zaawansowany

- Korzyść

- AI

- AI / ML

- AIDS

- Wszystkie kategorie

- pozwala

- wzdłuż

- również

- Amazonka

- Amazon Sage Maker

- Amazon Web Services

- an

- w czasie rzeczywistym sprawiają,

- i

- ogłosił

- każdy

- aplikacje

- SĄ

- obszary

- argumenty

- sztuczny

- sztuczna inteligencja

- Sztuczna inteligencja i uczenie maszynowe

- AS

- powiązany

- At

- Austin

- automatycznie

- dostępny

- AWS

- z powrotem

- baza

- na podstawie

- BE

- Korzyści

- Budżety

- budować

- Budowanie

- biznes

- by

- CAN

- możliwości

- zdobyć

- Carnegie Mellona

- nieść

- walizka

- Komórki

- zmiana

- Zmiany

- kanały

- wybór

- klasa

- klasyfikacja

- Klasyfikuj

- Chmura

- kod

- podstawa kodu

- Studentki

- byliśmy spójni, od początku

- wspólny

- zgodny

- kompletny

- obliczać

- komputer

- Computer Science

- Bezpieczeństwo komputera

- Wizja komputerowa

- pojęcie

- systemu

- Konsola

- zawierać

- Pojemnik

- zawiera

- konteksty

- ciągły

- rdzeń

- Koszty:

- mógłby

- pokrywa

- Stwórz

- Obecnie

- Klientów

- dostosować

- Dallas

- tablica rozdzielcza

- dane

- analiza danych

- nauka danych

- zbiory danych

- deklaruje

- Domyślnie

- Domyślnie

- zdefiniowane

- wykazać

- demonstruje

- Zależność

- rozwijać

- opisane

- Wnętrze

- detale

- rozwinięty

- Deweloper

- oprogramowania

- różne

- omówione

- dystrybuowane

- systemy rozproszone

- szkolenia rozproszone

- domeny

- zrobić

- nie

- podczas

- e

- każdy

- zdobył

- łatwość użycia

- łatwiej

- z łatwością

- bądź

- osadzone

- Umożliwia

- szyfrowanie

- koniec końców

- inżynier

- Inżynieria

- Inżynierowie

- przedsiębiorstwa

- wejście

- Środowisko

- środowiska

- epoka

- epoki

- ewaluację

- Każdy

- przykład

- przykłady

- egzekucja

- Przede wszystkim system został opracowany

- doświadczenie

- eksperyment

- Twarz

- znajomy

- członków Twojej rodziny

- FAST

- szybciej

- Cecha

- Korzyści

- kilka

- filet

- Akta

- budżetowy

- i terminów, a

- Elastyczność

- Skupiać

- koncentruje

- następujący

- W razie zamówieenia projektu

- Framework

- od

- w pełni

- funkcjonować

- Funkcje

- Ponadto

- przyszłość

- Futures

- generatywny

- generatywna sztuczna inteligencja

- dany

- Globalne

- Go

- GPU

- Grupy

- Have

- he

- pomoc

- pomaga

- jego

- posiada

- W jaki sposób

- How To

- HTML

- http

- HTTPS

- Przytulanie twarzy

- tożsamość

- if

- obraz

- realizacja

- importować

- import

- in

- zawierać

- Włącznie z

- Hindusi

- przemysł

- Informacja

- Systemy informacyjne

- Infrastruktura

- innowacyjne

- wkład

- zainstalowany

- przykład

- Instytut

- instrukcje

- ubezpieczenie

- zintegrowany

- Integruje się

- Inteligencja

- odsetki

- najnowszych

- przedstawiać

- wprowadzono

- Wynalazcy

- Internet przedmiotów

- IT

- iteracje

- JEGO

- Praca

- Oferty pracy

- jpg

- właśnie

- Klawisz

- laboratorium

- krajobraz

- laptopy

- duży

- na dużą skalę

- firmy

- uruchomić

- uruchomiona

- wodowanie

- Przywództwo

- prowadzący

- UCZYĆ SIĘ

- nauka

- niech

- pozwala

- biblioteki

- Biblioteka

- wifecycwe

- lubić

- lubi

- Linia

- miejscowy

- lokalnie

- usytuowany

- log

- zalogowany

- długo

- WYGLĄD

- od

- miłość

- maszyna

- uczenie maszynowe

- zrobiony

- Utrzymywanie

- robić

- WYKONUJE

- zarządzane

- i konserwacjami

- kierownik

- mistrz

- Może..

- Mellon

- Metodologia

- Metryka

- Uważność

- minimalny

- minut

- ML

- MLOps

- Moda

- model

- modele

- Moduły

- jeszcze

- większość

- ruch

- MS

- wielokrotność

- Muzyka

- Nazwa

- mianowicie

- żeglujący

- Potrzebować

- potrzebne

- sieć

- sieci

- Nowości

- Następny

- węzły

- notatnik

- już dziś

- tępy

- obiekty

- of

- on

- Onboard

- pewnego razu

- ONE

- tylko

- koncepcja

- open source

- optymalizacja

- or

- zamówienie

- organizacja

- OS

- Inne

- ludzkiej,

- na zewnątrz

- wydajność

- koniec

- Zastąp

- pakiet

- Pakiety

- pandy

- Parallel

- parametry

- szczególny

- partnerem

- przechodzić

- przebiegi

- Przechodzący

- namiętny

- Patenty

- ścieżka

- jest gwarancją najlepszej jakości, które mogą dostarczyć Ci Twoje monitory,

- fotografia

- Platforma

- plato

- Analiza danych Platona

- PlatoDane

- gra

- punkt

- Post

- Korzystny

- warunki wstępne

- poprzedni

- Problem

- problemy

- przetwarzanie

- Produkt

- product manager

- produktywny

- Produkty

- pod warunkiem,

- Python

- płomień

- gotowy

- niedawny

- niedawno

- polecić

- związane z

- zwolnić

- zdalny

- obsługi produkcji rolnej, która zastąpiła

- składnica

- wymagany

- wymagania

- REST

- powrót

- droga

- Rola

- role

- run

- bieganie

- sagemaker

- skalowalny

- Skala

- skalowaniem

- Szkoła

- nauka

- Naukowcy

- nauka-scikit

- Sdk

- płynnie

- Sekcja

- działy

- bezpieczeństwo

- widzieć

- senior

- oddzielny

- Usługi

- Sesja

- zestaw

- ustawienie

- w panelu ustawień

- ustawienie

- kilka

- powinien

- pokazać

- prezentacja

- pokazane

- Targi

- znacznie

- podobny

- Prosty

- po prostu

- pojedynczy

- Rozmiar

- mały

- Migawka

- So

- Tworzenie

- rozwoju oprogramowania

- Rozwiązania

- ROZWIĄZANIA

- specjalista

- specyficzny

- specyfikacja

- określony

- początek

- Startowy

- Rynek

- Ewolucja krok po kroku

- przechowywanie

- Strategiczny

- Studenci

- studio

- Zatwierdź

- podsieci

- taki

- Utrzymany

- podpory

- system

- systemy

- Brać

- trwa

- biorąc

- zadania

- Zespoły

- Technologia

- tensorflow

- texas

- Klasyfikacja tekstu

- że

- Połączenia

- ich

- Im

- następnie

- Tam.

- a tym samym

- w związku z tym

- Te

- one

- to

- myśl

- myśl przywództwo

- Przez

- czas

- Tytuł

- do

- narzędzia

- pochodnia

- w kierunku

- Pociąg

- przeszkolony

- Trening

- Transformatory

- podróżować

- Podróżowanie

- rozsierdzony

- rodzaj

- zazwyczaj

- dla

- zrozumieć

- uniwersytet

- Aktualizacja

- us

- posługiwać się

- przypadek użycia

- używany

- Użytkownicy

- za pomocą

- wartość

- Wartości

- wersja

- przez

- Zobacz i wysłuchaj

- virginia

- wizja

- vs

- vs kod

- czekać

- chcieć

- we

- sieć

- usługi internetowe

- jeśli chodzi o komunikację i motywację

- który

- Podczas

- będzie

- w

- w ciągu

- Praca

- pracujący

- działa

- by

- owinąć

- Owinięty

- napisać

- pisać kod

- napisany

- X

- lat

- You

- Najmłodszy

- Twój

- zefirnet