Generatywna sztuczna inteligencja (generatywna sztuczna inteligencja) wykazały imponujące możliwości generowania wysokiej jakości tekstu, obrazów i innej treści. Jednak modele te wymagają ogromnych ilości czystych, ustrukturyzowanych danych szkoleniowych, aby osiągnąć swój pełny potencjał. Większość rzeczywistych danych istnieje w nieustrukturyzowanych formatach, takich jak pliki PDF, które wymagają wstępnego przetworzenia, zanim będą mogły być efektywnie wykorzystane.

Zgodnie z IDCdane nieustrukturyzowane stanowią obecnie ponad 80% wszystkich danych biznesowych. Obejmuje to formaty takie jak e-maile, pliki PDF, zeskanowane dokumenty, obrazy, pliki audio i wideo i inne. Chociaż dane te zawierają cenne informacje, ich nieustrukturyzowany charakter utrudnia algorytmom sztucznej inteligencji interpretację i uczenie się na ich podstawie. Według Badanie Deloitte 2019tylko 18% przedsiębiorstw zgłosiło, że potrafi korzystać z danych nieustrukturyzowanych.

W miarę ciągłego przyspieszania wdrażania sztucznej inteligencji opracowanie skutecznych mechanizmów przetwarzania i uczenia się na podstawie nieustrukturyzowanych danych stanie się w przyszłości jeszcze ważniejsze. Mogłoby to obejmować lepsze narzędzia do wstępnego przetwarzania, techniki uczenia się z półnadzorem i postępy w przetwarzaniu języka naturalnego. Firmy, które najskuteczniej wykorzystują swoje nieustrukturyzowane dane, zyskają znaczną przewagę konkurencyjną dzięki sztucznej inteligencji. Czyste dane są ważne dla dobrej wydajności modelu. Wyodrębnione teksty nadal zawierają duże ilości bełkotu i szablonowego tekstu (np. czytaj HTML). Dane skradzione z Internetu często zawierają wiele duplikatów. Dane z mediów społecznościowych, recenzje lub dowolne treści generowane przez użytkowników mogą również zawierać treści toksyczne i stronnicze, dlatego może być konieczne ich odfiltrowanie przy użyciu kilku etapów wstępnego przetwarzania. Może również występować wiele treści niskiej jakości lub tekstów generowanych przez boty, które można odfiltrować za pomocą towarzyszących metadanych (np. odfiltrować odpowiedzi obsługi klienta, które otrzymały niskie oceny klientów).

Przygotowanie danych jest ważne na wielu etapach generowania rozszerzonego wyszukiwania (RAG) modele. Dokumenty źródłowe wiedzy wymagają wstępnego przetwarzania, takiego jak czyszczenie tekstu i generowanie osadzania semantycznego, aby można je było skutecznie indeksować i odzyskiwać. Zapytanie użytkownika w języku naturalnym również wymaga wstępnego przetworzenia, aby można je było zakodować w wektorze i porównać z osadzeniem dokumentu. Po pobraniu odpowiednich kontekstów mogą wymagać dodatkowego przetwarzania wstępnego, np. obcięcia, zanim zostaną połączone z zapytaniem użytkownika w celu utworzenia ostatecznego podpowiedzi dla modelu podstawowego. Płótno Amazon SageMaker obsługuje teraz kompleksowe możliwości przygotowywania danych obsługiwane przez Pogromca danych Amazon SageMaker. Dzięki tej integracji SageMaker Canvas zapewnia klientom kompleksową przestrzeń roboczą niewymagającą stosowania kodu, umożliwiającą przygotowywanie danych, budowanie i wykorzystywanie uczenia maszynowego oraz modeli podstawowych w celu skrócenia czasu od uzyskania danych do wniosków biznesowych. Możesz teraz łatwo odkrywać i agregować dane z ponad 50 źródeł danych oraz eksplorować i przygotowywać dane, korzystając z ponad 300 wbudowanych analiz i transformacji w interfejsie wizualnym SageMaker Canvas.

Omówienie rozwiązania

W tym poście pracujemy ze zbiorem danych dokumentacji PDF —Amazońska skała macierzysta podręcznik użytkownika. Ponadto pokazujemy, jak wstępnie przetworzyć zbiór danych dla RAG. W szczególności czyścimy dane i tworzymy artefakty RAG, aby odpowiedzieć na pytania dotyczące zawartości zbioru danych. Rozważmy następujący problem uczenia maszynowego (ML): użytkownik zadaje pytanie dotyczące modelu dużego języka (LLM): „Jak filtrować i wyszukiwać modele w Amazon Bedrock?”. LLM nie widział dokumentacji na etapie szkolenia lub dostrajania, dlatego nie byłby w stanie odpowiedzieć na pytanie i najprawdopodobniej będzie miał halucynacje. Naszym celem w tym poście jest znalezienie odpowiedniego fragmentu tekstu w pliku PDF (tj. RAG) i dołączenie go do podpowiedzi, umożliwiając w ten sposób LLM udzielenie odpowiedzi na pytania specyficzne dla tego dokumentu.

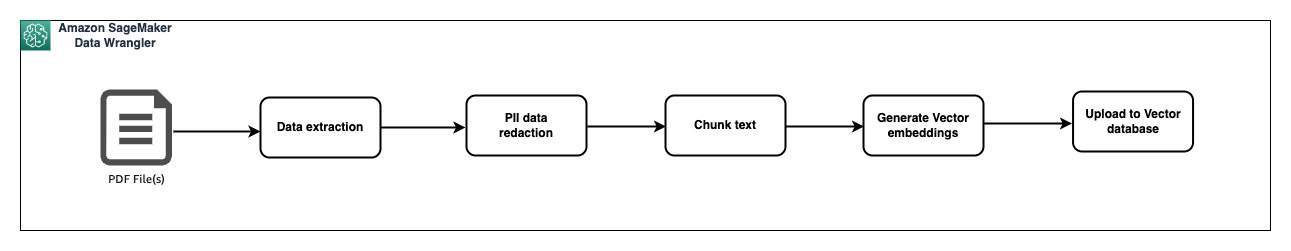

Poniżej pokazujemy, jak wykonać wszystkie te główne etapy przetwarzania wstępnego Płótno Amazon SageMaker (zasilane przez Pogromca danych Amazon SageMaker):

- Wyodrębnianie tekstu z dokumentu PDF (obsługiwane przez Texttract)

- Usuń poufne informacje (obsługiwane przez funkcję Comprehend)

- Podziel tekst na kawałki.

- Twórz osady dla każdego elementu (obsługiwane przez Bedrock).

- Przesyłanie, osadzanie w bazie danych wektorowych (obsługiwane przez OpenSearch)

Wymagania wstępne

W tym przewodniku powinieneś mieć następujące elementy:

Note: Utwórz domeny usługi OpenSearch, postępując zgodnie z instrukcjami tutaj. Dla uproszczenia wybierzmy opcję z główną nazwą użytkownika i hasłem, aby uzyskać precyzyjną kontrolę dostępu. Po utworzeniu domeny utwórz indeks wektorowy z następującymi mapowaniami, a wymiar wektorowy 1536 zostanie dopasowany do osadzonych elementów Amazon Titan:

Opis przejścia

Zbuduj przepływ danych

W tej sekcji opisujemy, w jaki sposób możemy zbudować przepływ danych w celu wyodrębnienia tekstu i metadanych z plików PDF, oczyszczenia i przetworzenia danych, wygenerowania osadzania za pomocą Amazon Bedrock i indeksowania danych w Amazon OpenSearch.

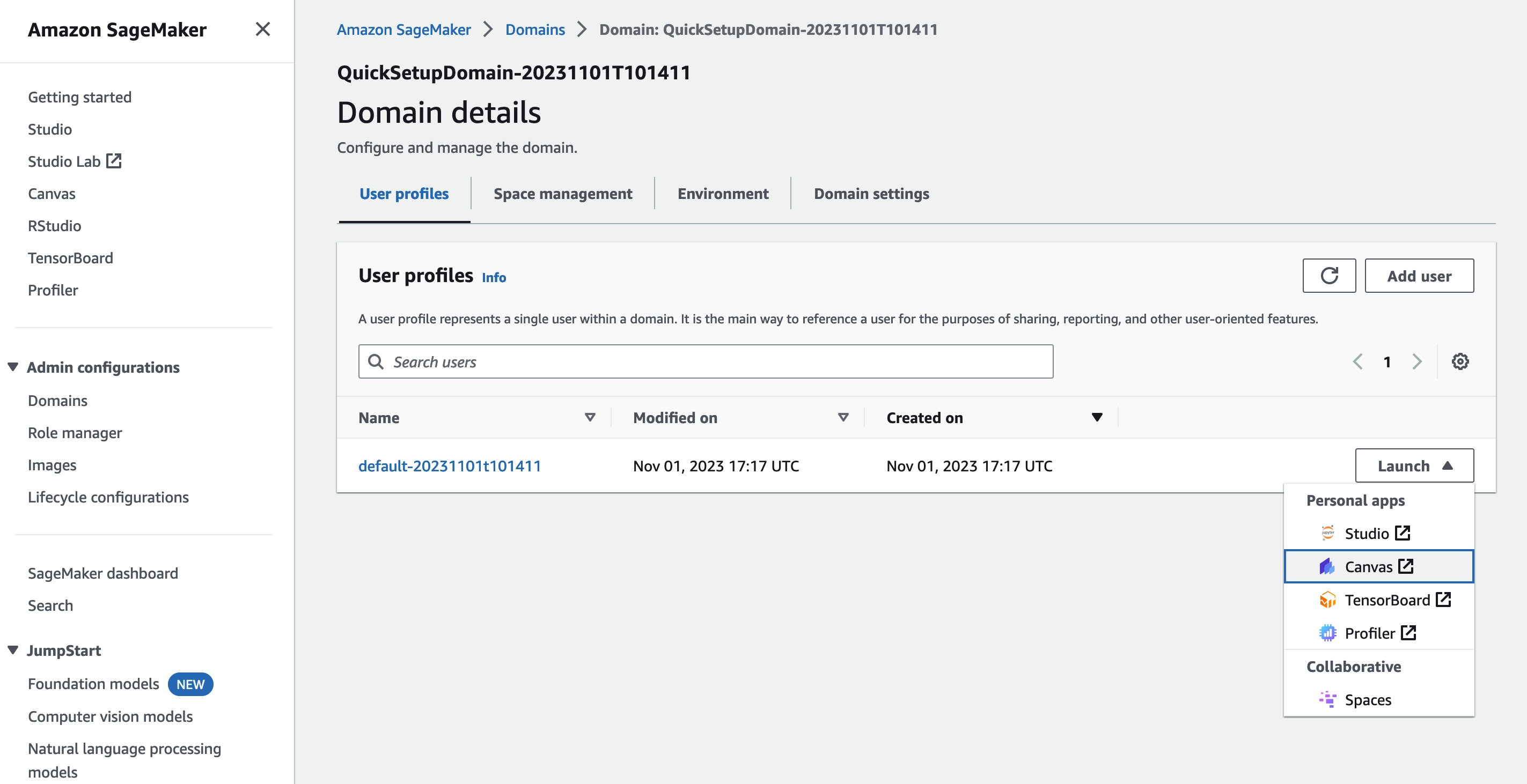

Uruchom SageMaker Canvas

Aby uruchomić SageMaker Canvas, wykonaj następujące kroki:

- Na Amazonii Konsola SageMakerawybierz domeny w okienku nawigacji.

- Wybierz swoją domenę.

- W menu uruchamiania wybierz Brezentowy.

Utwórz przepływ danych

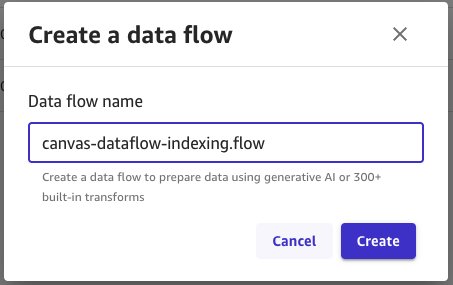

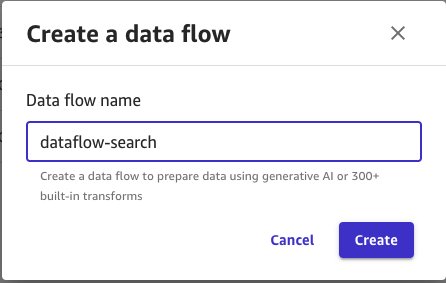

Wykonaj następujące kroki, aby utworzyć przepływ danych w SageMaker Canvas:

- Na stronie głównej SageMaker Canvas wybierz Poskramiacz danych.

- Dodaj Stwórz po prawej stronie, następnie podaj nazwę przepływu danych i wybierz Stwórz.

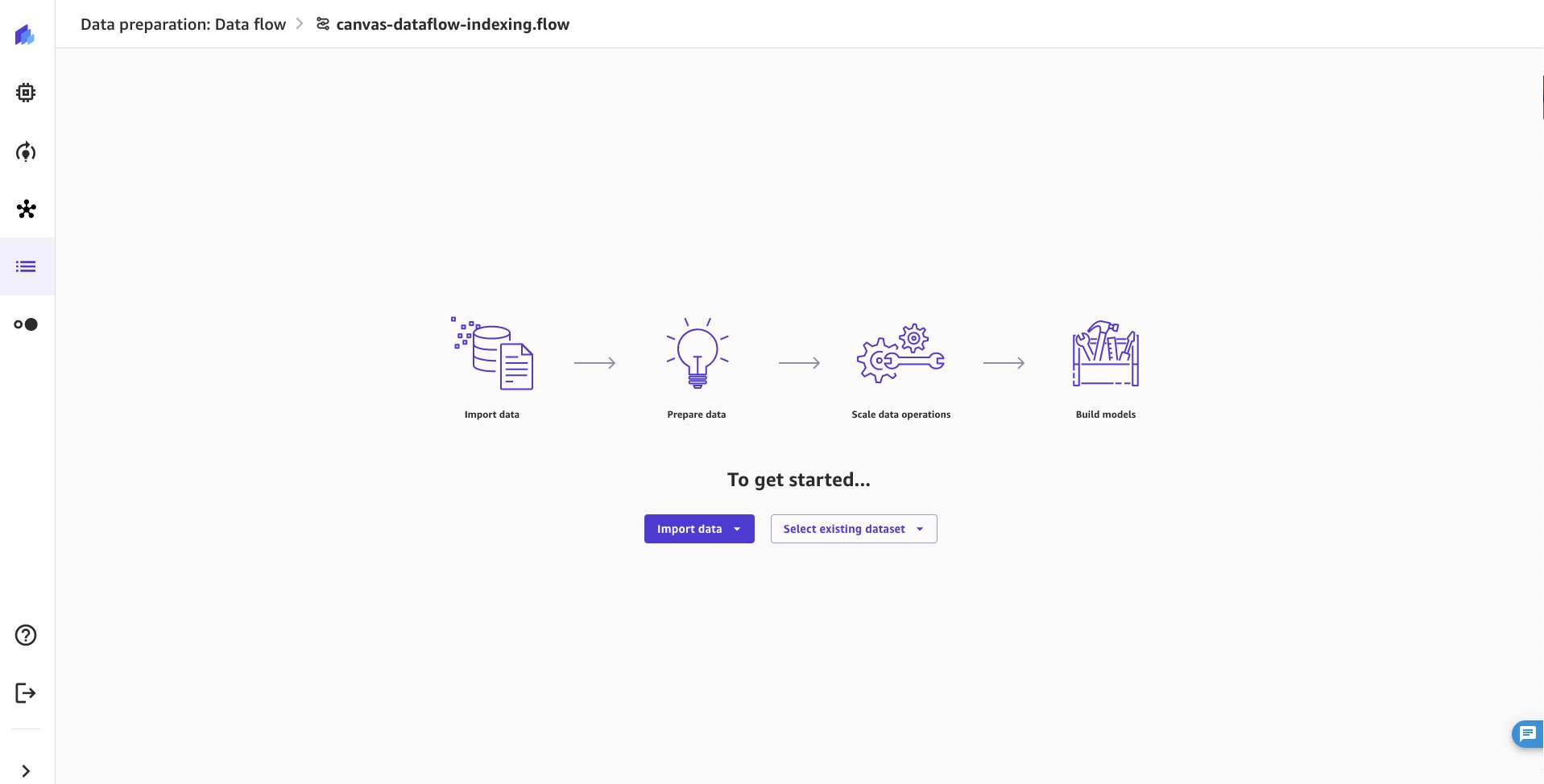

- Spowoduje to wylądowanie na stronie przepływu danych.

- Dodaj Importuj daty, wybierz dane tabelaryczne.

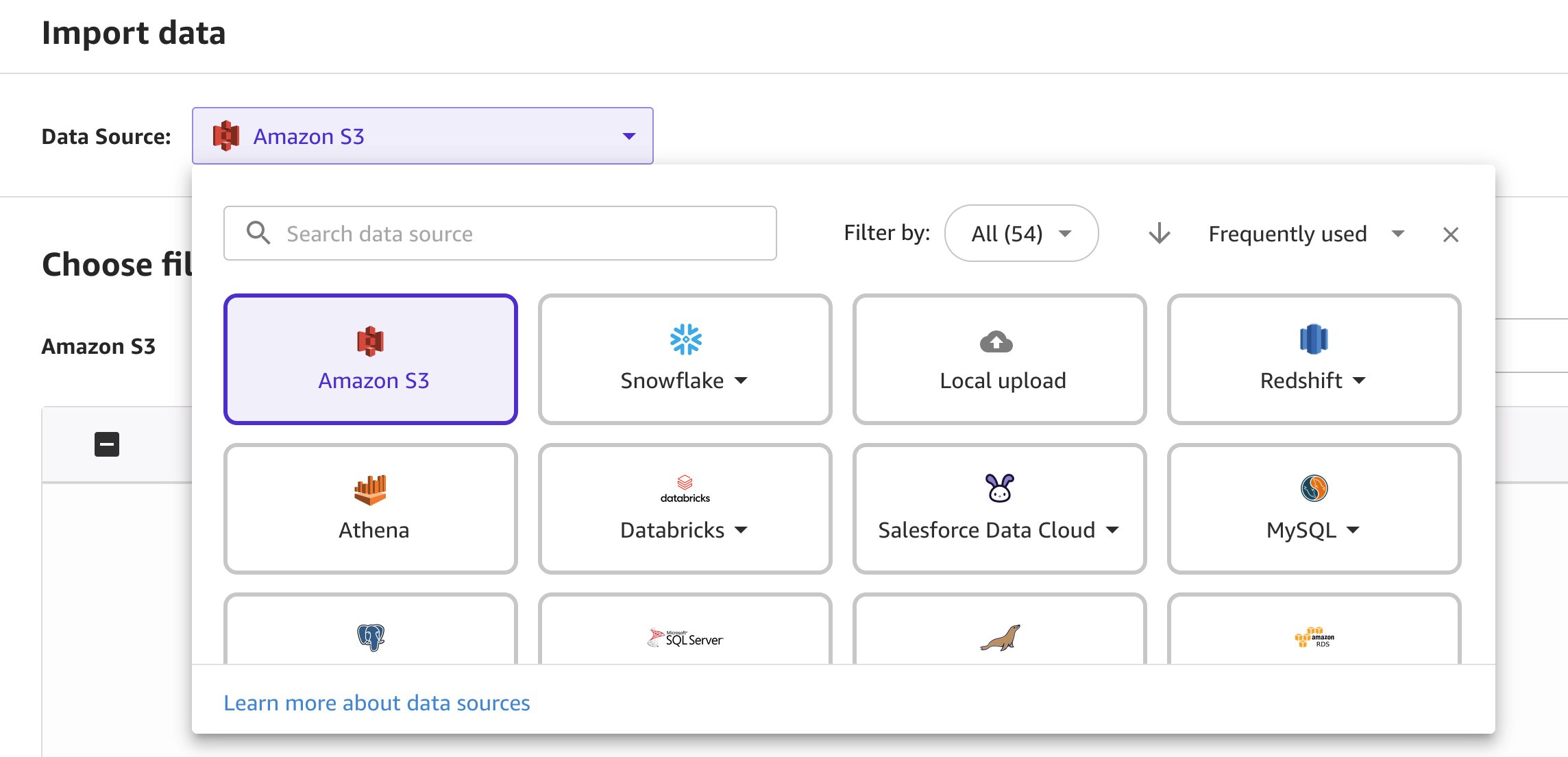

Teraz zaimportujmy dane z segmentu Amazon S3:

- Dodaj Importuj daty nastepnie: Tabelaryczny z rozwijanej listy.

- Źródło danych nastepnie: Amazon S3 z rozwijanej listy.

- Przejdź do pliku metadanych z lokalizacjami plików PDF i wybierz plik.

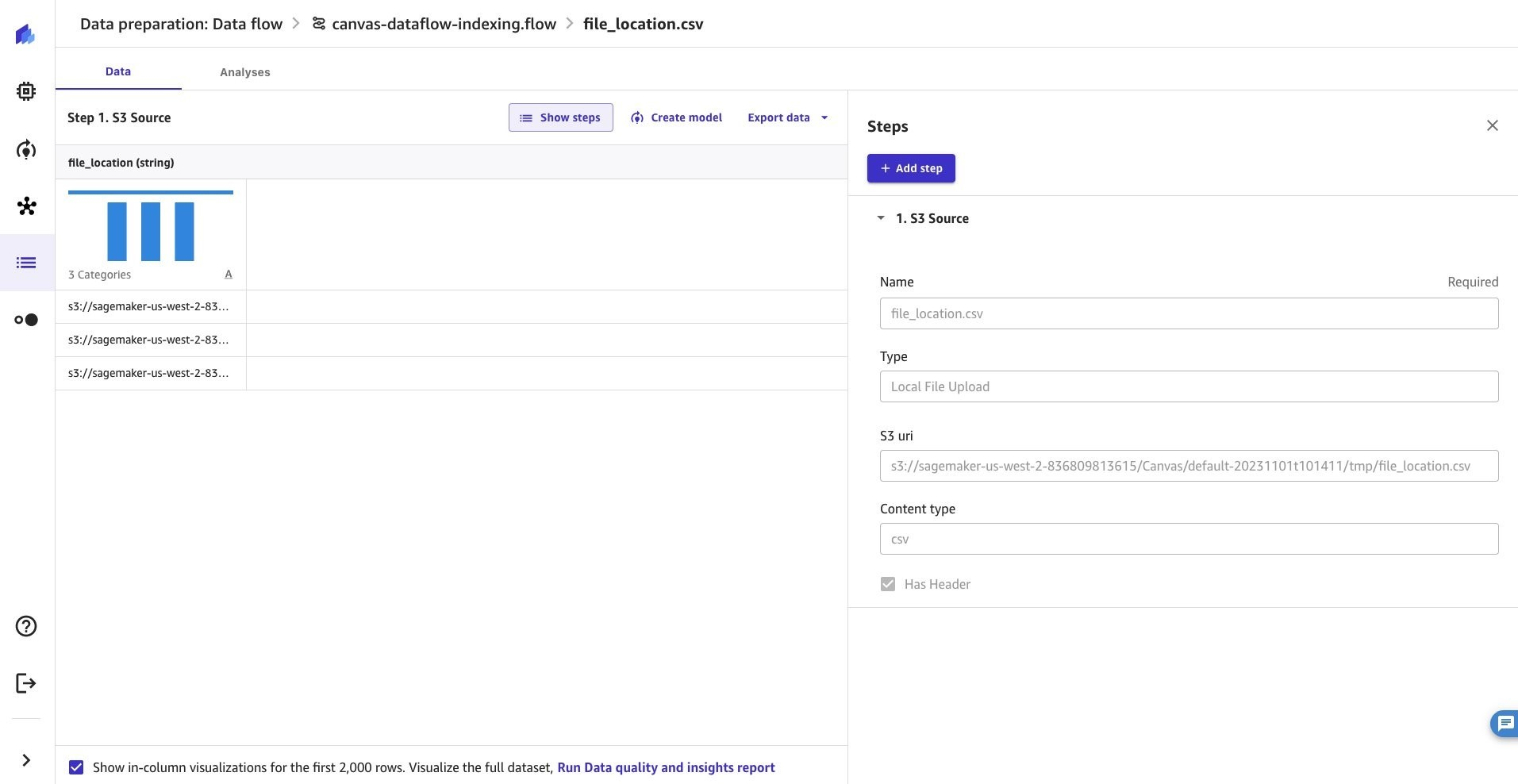

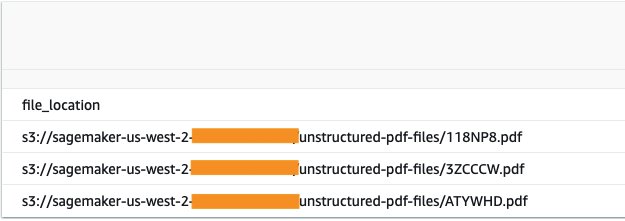

- Teraz plik metadanych jest ładowany do przepływu danych przygotowania danych i możemy przystąpić do dodawania kolejnych kroków w celu przekształcenia danych i indeksowania w Amazon Otwórz wyszukiwanie. W tym przypadku plik zawiera następujące metadane z lokalizacją każdego pliku w katalogu Amazon S3.

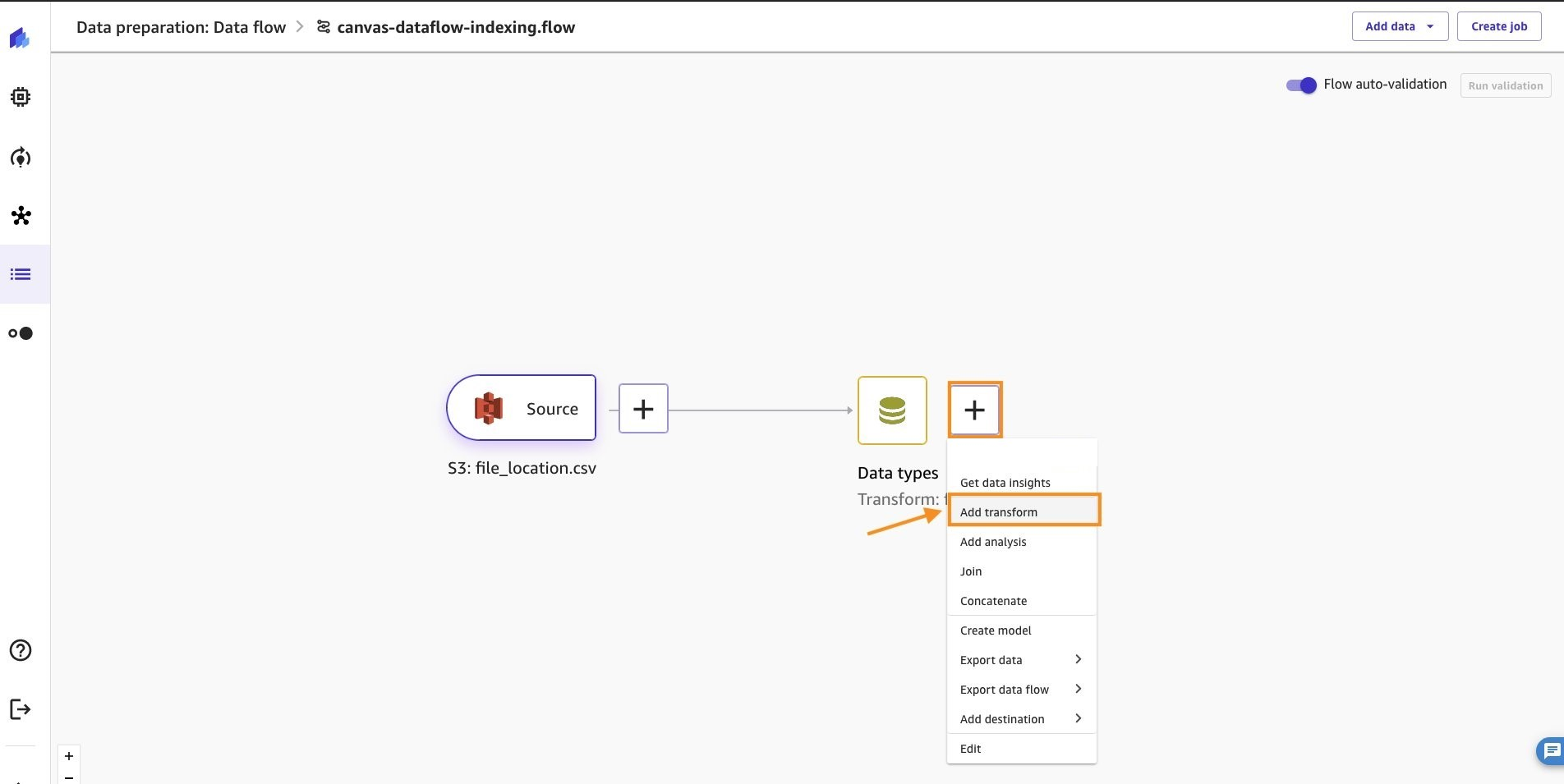

Aby dodać nową transformację, wykonaj następujące kroki:

- Wybierz znak plus i wybierz Dodaj transformację.

- Dodaj Dodaj krok i wybierz Niestandardowa transformacja.

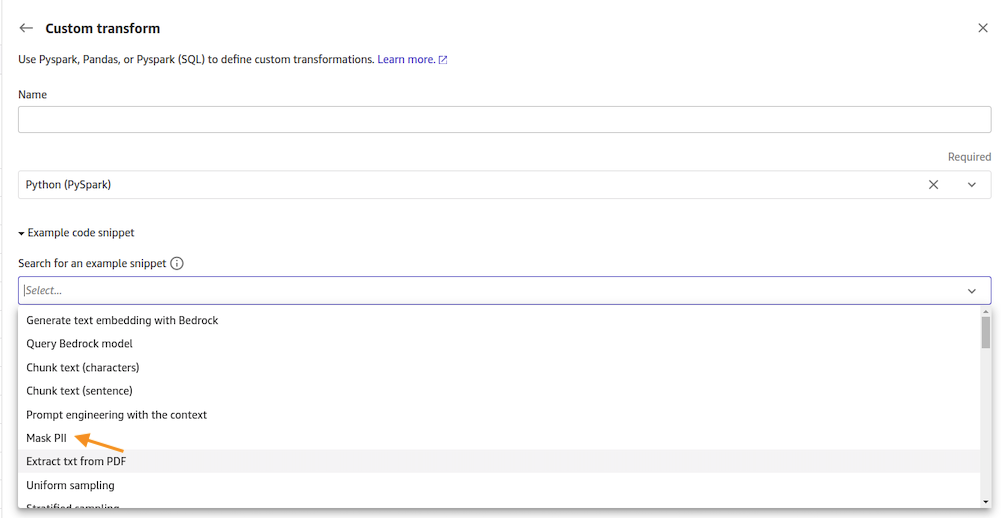

- Możesz utworzyć niestandardową transformację przy użyciu Pand, PySpark, funkcji zdefiniowanych przez użytkownika w języku Python i SQL PySpark. Wybierać Python (PySpark) dla tego przypadku użycia.

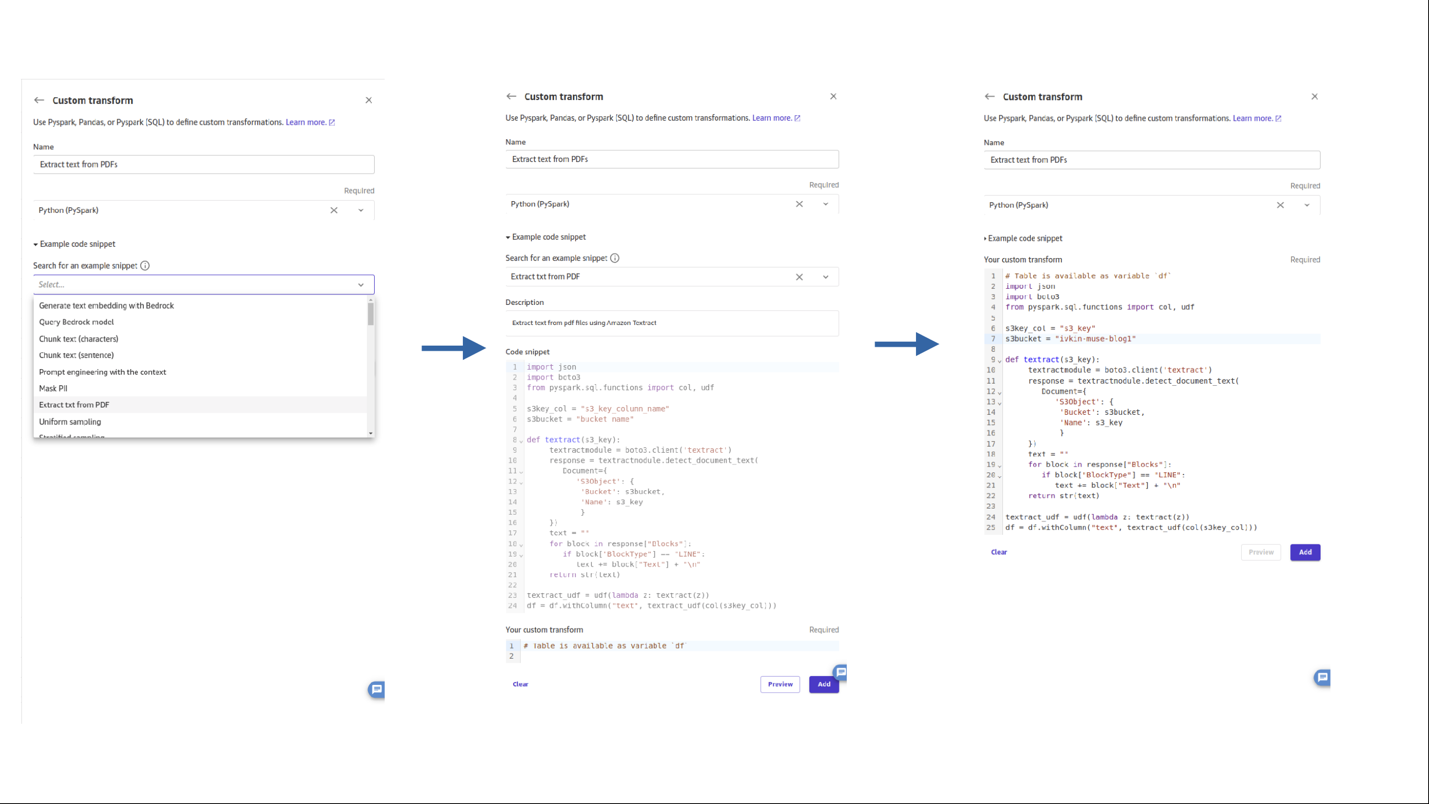

- Wprowadź nazwę kroku. Z przykładowych fragmentów kodu przeglądaj i wybierz wyodrębnij tekst z pdf. Wprowadź niezbędne zmiany we fragmencie kodu i wybierz Dodaj.

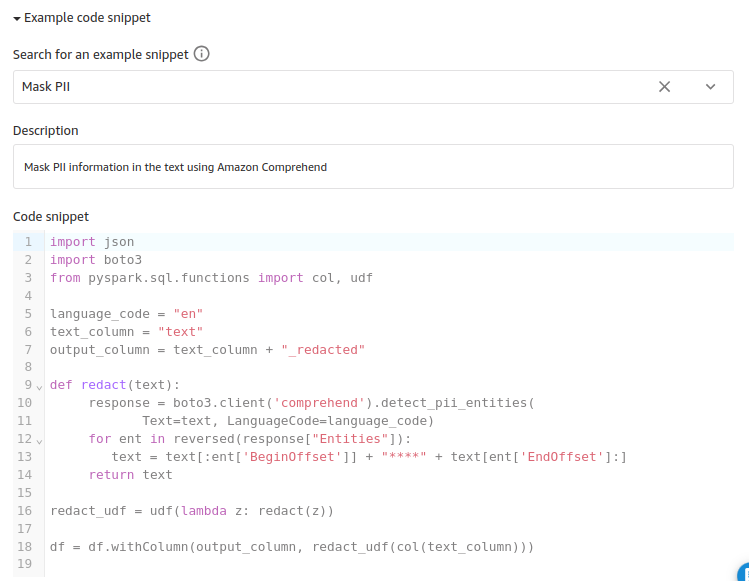

- Dodajmy krok, aby zredagować dane osobowe (PII) z wyodrębnionych danych poprzez wykorzystanie Amazon Comprehend, Wybierać Dodaj krok i wybierz Niestandardowa transformacja. I wybierz Pythona (PySpark).

Z przykładowych fragmentów kodu przeglądaj i wybierz maska PII. Wprowadź niezbędne zmiany we fragmencie kodu i wybierz Dodaj.

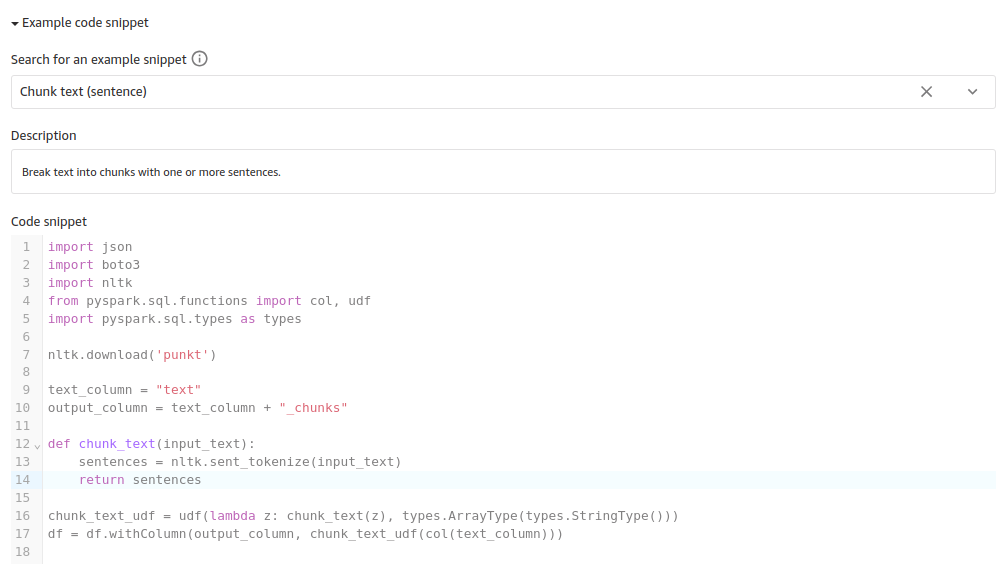

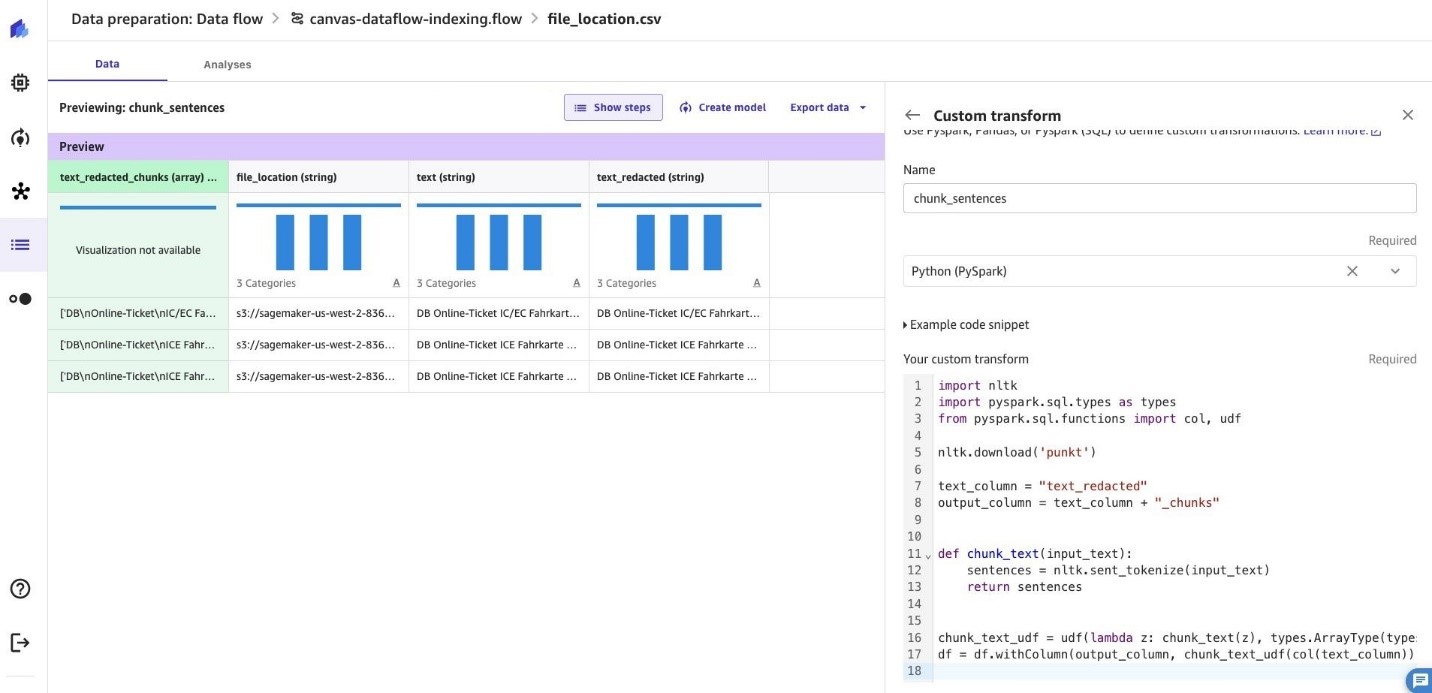

- Następnym krokiem jest podzielenie zawartości tekstowej. Wybierać Dodaj krok i wybierz Niestandardowa transformacja. I wybierz Pythona (PySpark).

Z przykładowych fragmentów kodu przeglądaj i wybierz Fragment tekstu. Wprowadź niezbędne zmiany we fragmencie kodu i wybierz Dodaj.

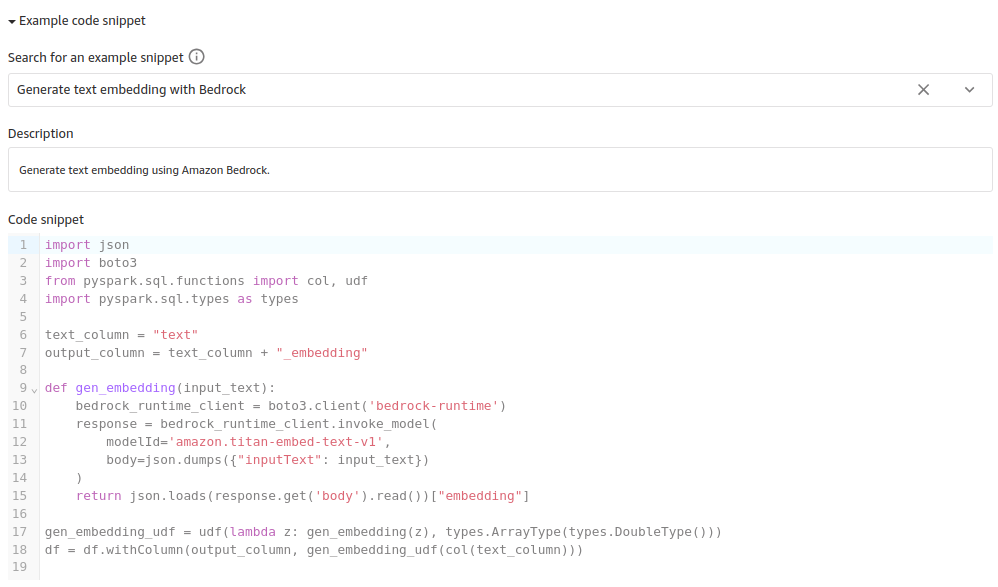

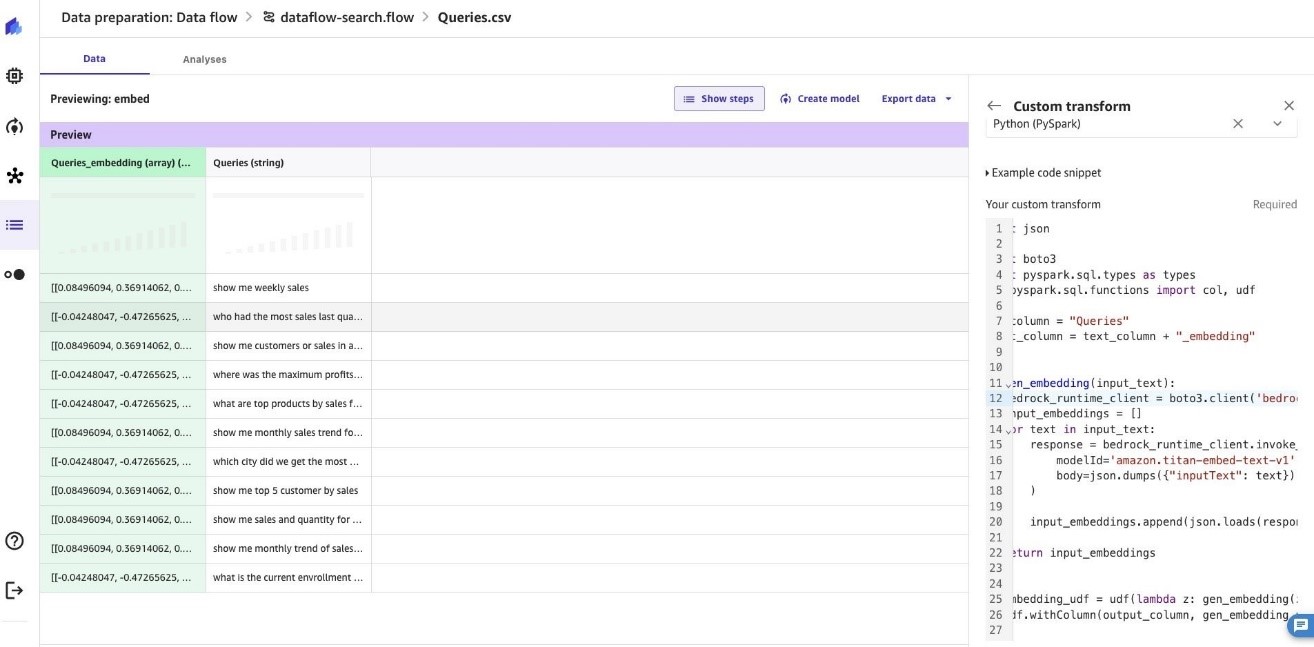

- Przekonwertujmy treść tekstową na osadzenie wektorowe za pomocą Amazońska skała macierzysta Model osadzania Titan. Wybierać Dodaj krok i wybierz Niestandardowa transformacja. I wybierz Pythona (PySpark).

Z przykładowych fragmentów kodu przeglądaj i wybierz Wygeneruj osadzanie tekstu za pomocą Bedrock. Wprowadź niezbędne zmiany we fragmencie kodu i wybierz Dodaj.

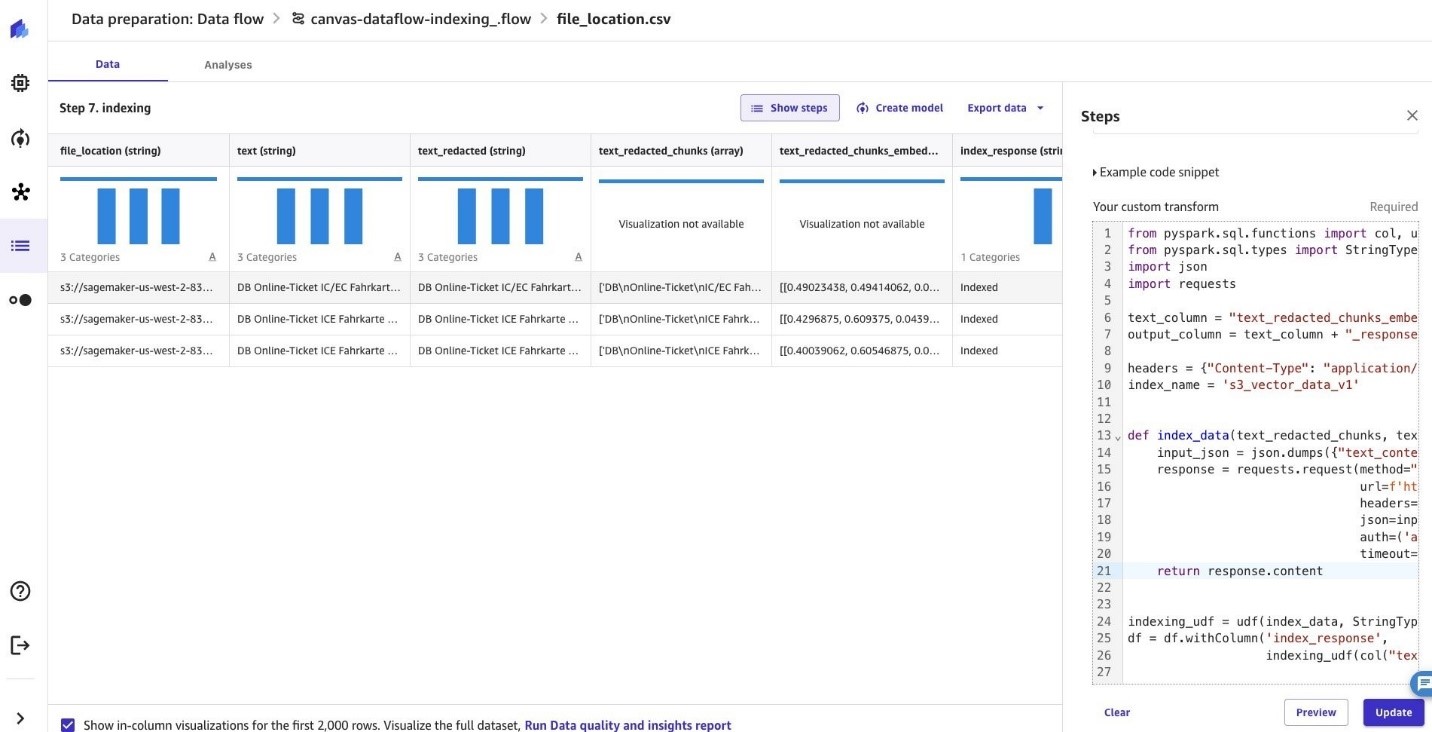

- Teraz dostępne jest osadzanie wektorów zawartości plików PDF. Przejdźmy dalej i zaindeksujmy dane w Amazon OpenSearch. Wybierać Dodaj krok i wybierz Niestandardowa transformacja. I wybierz Pythona (PySpark). Możesz przepisać poniższy kod, aby użyć preferowanej bazy danych wektorów. Dla uproszczenia używamy głównej nazwy użytkownika i hasła, aby uzyskać dostęp do interfejsów API OpenSearch. W przypadku obciążeń produkcyjnych wybierz opcję zgodną z zasadami Twojej organizacji.

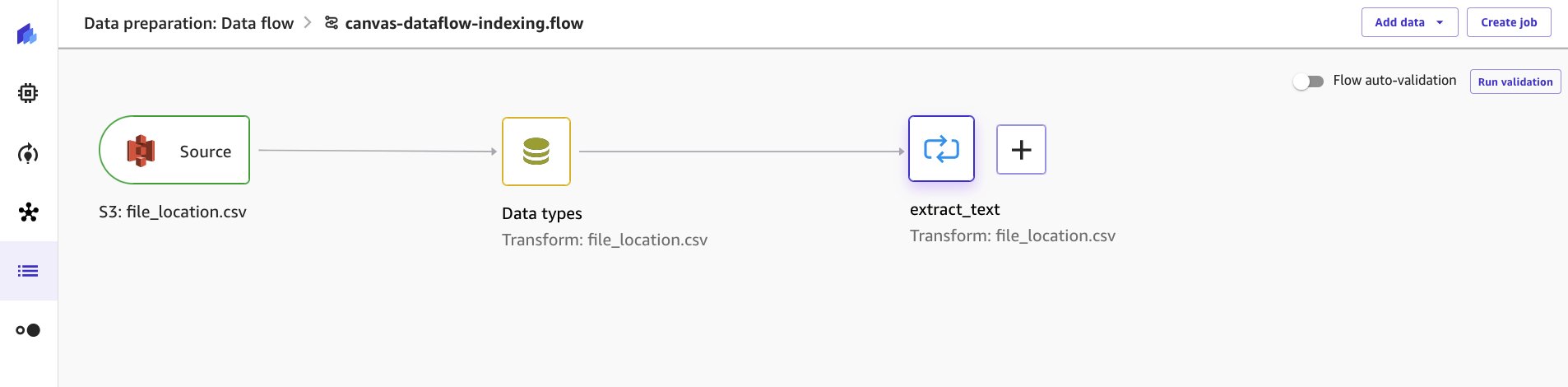

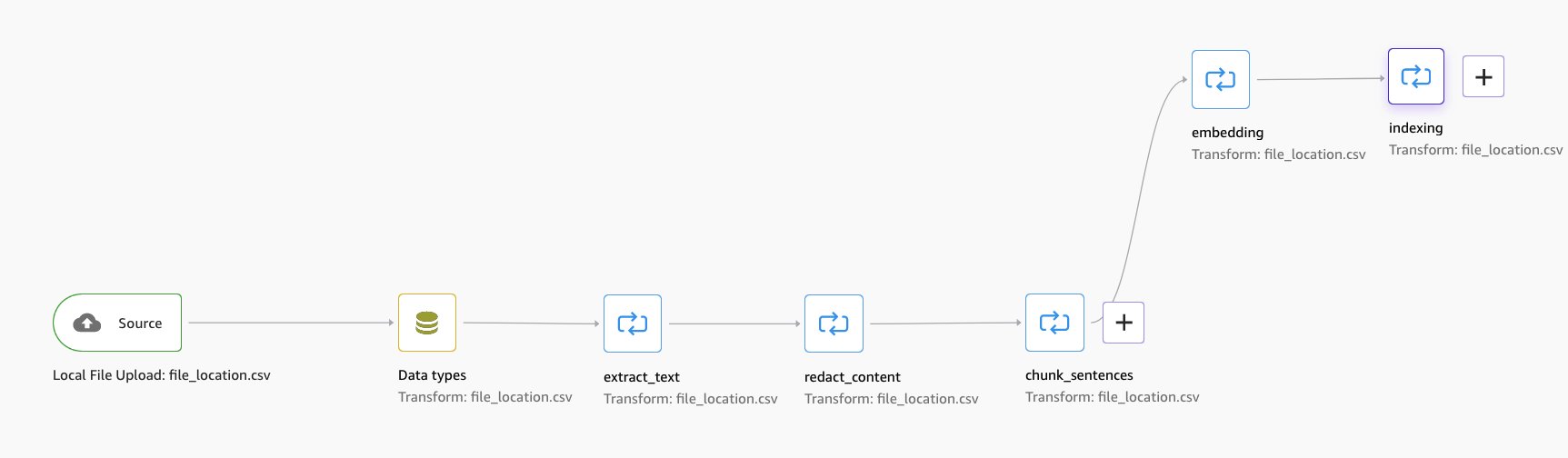

Ostatecznie utworzony przepływ danych będzie wyglądał następująco:

Dzięki temu przepływowi danych dane z pliku PDF zostały odczytane i zindeksowane za pomocą osadzania wektorów w Amazon OpenSearch. Teraz nadszedł czas, abyśmy utworzyli plik z zapytaniami, aby przeszukać zaindeksowane dane i zapisać je w lokalizacji Amazon S3. Skierujemy przepływ danych wyszukiwania do pliku i wygenerujemy plik z odpowiednimi wynikami w nowym pliku w lokalizacji Amazon S3.

Przygotowanie podpowiedzi

Po utworzeniu bazy wiedzy na podstawie naszego pliku PDF możemy ją przetestować, przeszukując bazę wiedzy pod kątem kilku przykładowych zapytań. Każde zapytanie przetworzymy w następujący sposób:

- Wygeneruj osadzenie dla zapytania (obsługiwane przez Amazon Bedrock)

- Baza danych wektorów zapytań dla kontekstu najbliższego sąsiada (obsługiwana przez Amazon OpenSearch)

- Połącz zapytanie i kontekst w zachętę.

- Zapytanie LLM z podpowiedzią (obsługiwane przez Amazon Bedrock)

- Na stronie głównej SageMaker Canvas wybierz Przygotowywanie danych.

- Dodaj Stwórz po prawej stronie, następnie podaj nazwę przepływu danych i wybierz Stwórz.

Załadujmy teraz pytania użytkownika, a następnie utwórz podpowiedź, łącząc pytanie i podobne dokumenty. Ten monit jest przekazywany LLM w celu wygenerowania odpowiedzi na pytanie użytkownika.

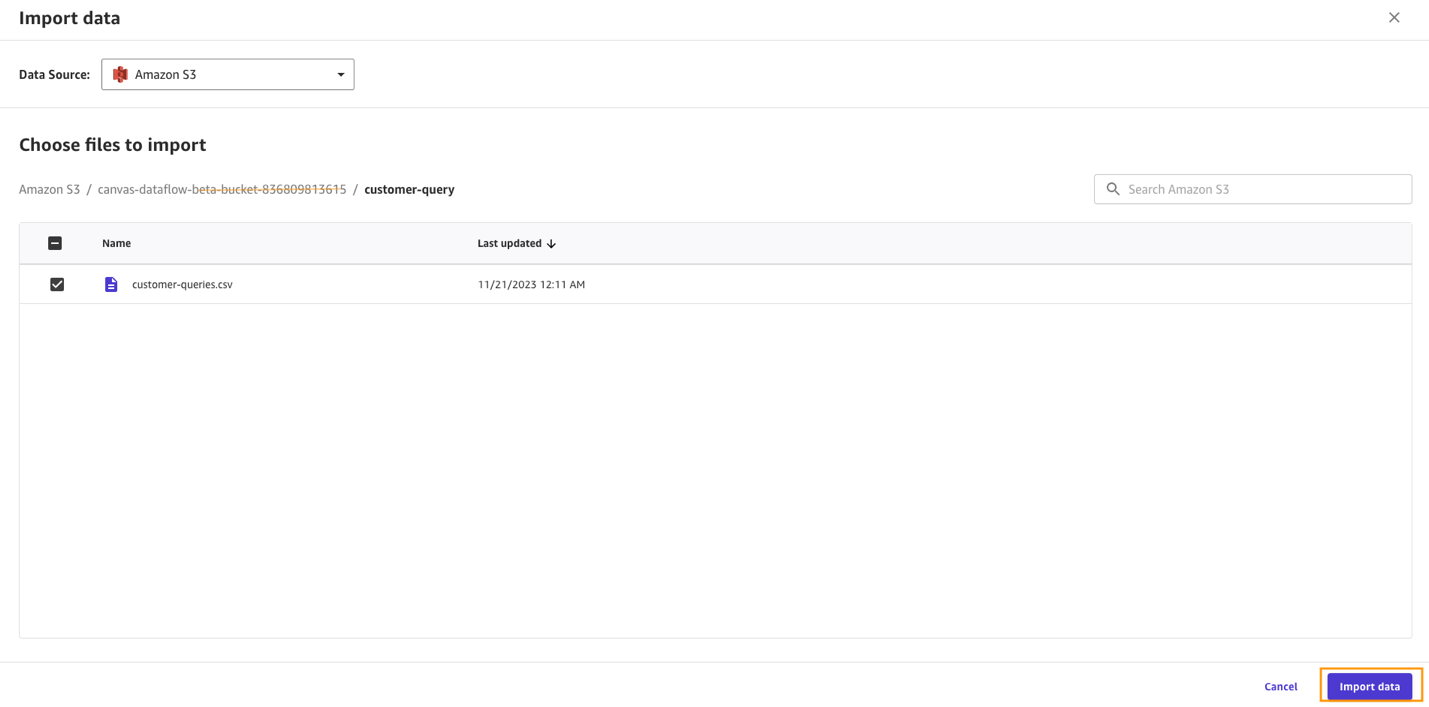

- Załadujmy plik csv z pytaniami użytkowników. Wybierać Zaimportować dane nastepnie: Tabelaryczny z rozwijanej listy.

- Źródło danych, nastepnie: Amazon S3 z listy rozwijanej. Alternatywnie możesz przesłać plik z zapytaniami użytkowników.

- Dodajmy niestandardową transformację, aby przekonwertować dane na osadzenie wektorowe, a następnie wyszukać powiązane osadzenia z Amazon OpenSearch, przed wysłaniem monitu do Amazon Bedrock z zapytaniem i kontekstem z bazy wiedzy. Aby wygenerować osadzenie dla zapytania, możesz użyć tego samego przykładowego fragmentu kodu Wygeneruj osadzanie tekstu za pomocą Bedrock wspomniane w kroku #7 powyżej.

Wywołajmy API Amazon OpenSearch, aby przeszukać odpowiednie dokumenty pod kątem wygenerowanych osadzonych wektorów. Dodaj niestandardową transformację za pomocą języka Python (PySpark).

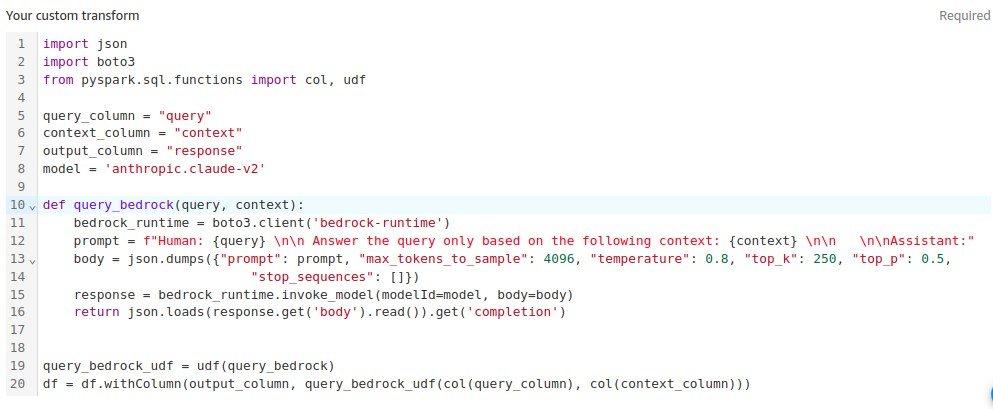

Dodajmy niestandardową transformację, aby wywołać API Amazon Bedrock w celu odpowiedzi na zapytanie, przekazując dokumenty z bazy wiedzy Amazon OpenSearch. Z przykładowych fragmentów kodu przeglądaj i wybierz Zapytanie o podłoże z kontekstem. Wprowadź niezbędne zmiany we fragmencie kodu i wybierz Dodaj.

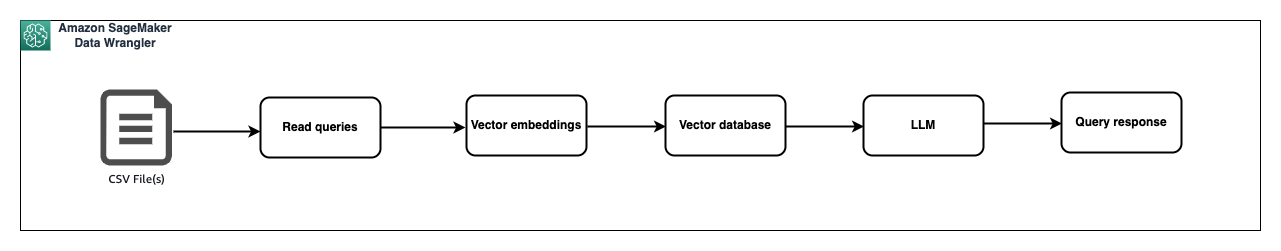

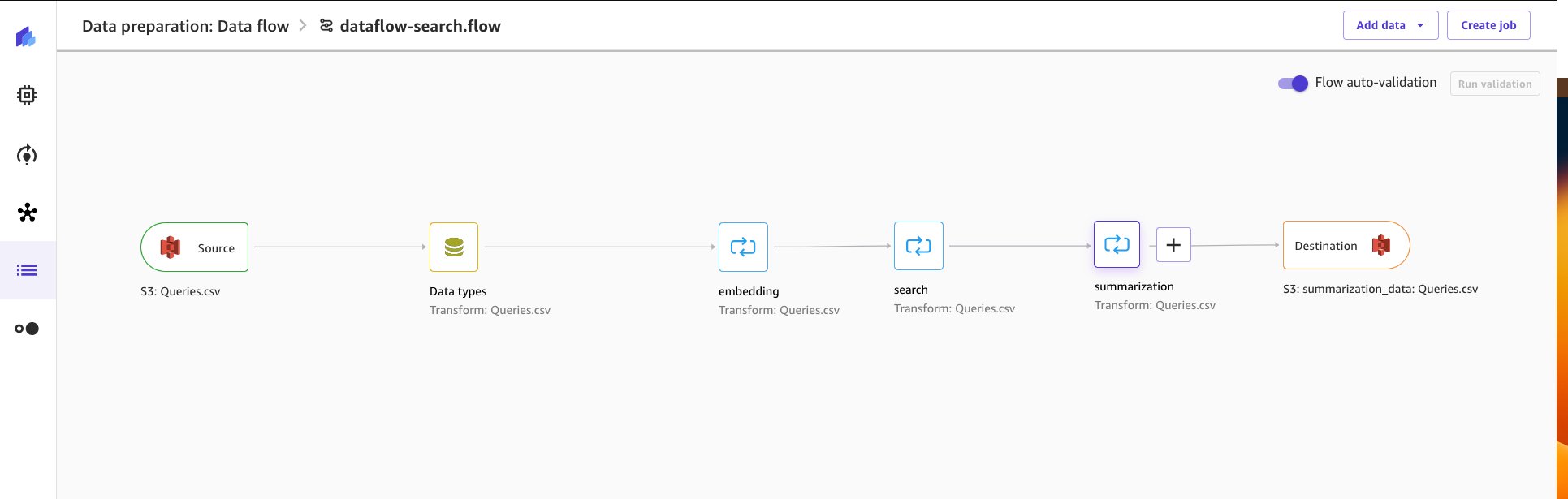

Podsumowując, przepływ danych oparty na pytaniach opartych na RAG jest następujący:

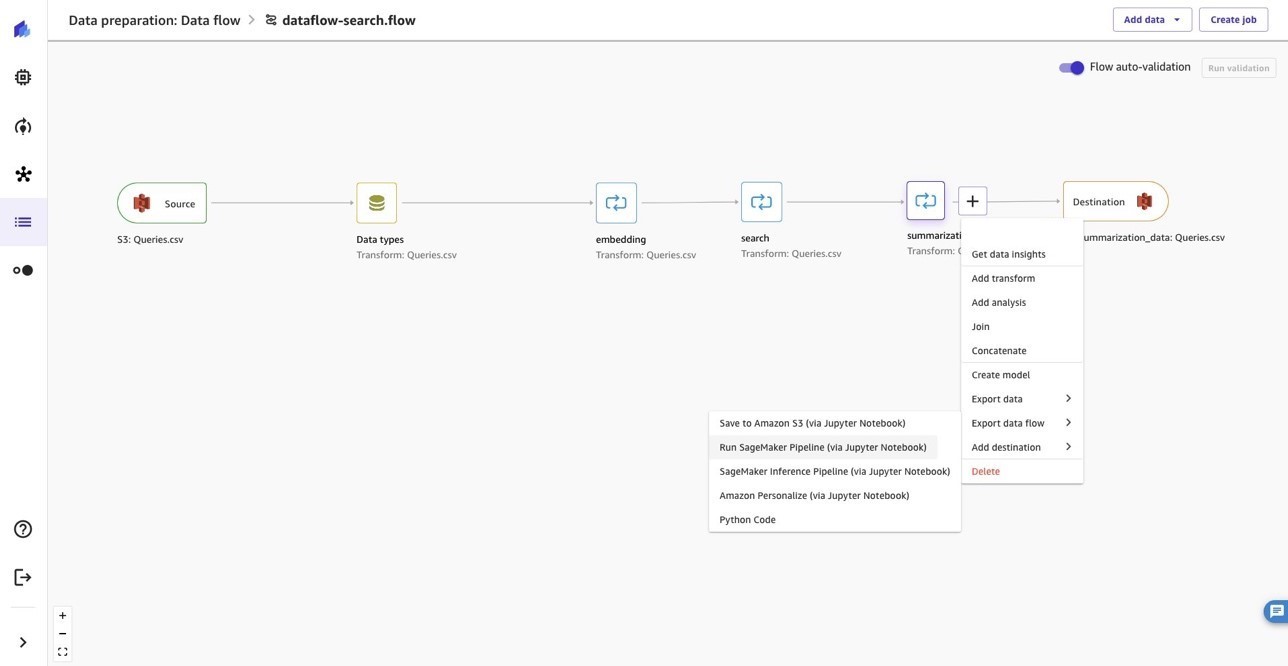

Praktycy uczenia maszynowego spędzają dużo czasu na tworzeniu kodu inżynierii funkcji, stosowaniu go do początkowych zestawów danych, trenowaniu modeli na opracowanych zbiorach danych i ocenie dokładności modelu. Biorąc pod uwagę eksperymentalny charakter tej pracy, nawet najmniejszy projekt prowadzi do wielu iteracji. Ten sam kod inżynierii funkcji jest często uruchamiany wielokrotnie, marnując czas i zasoby obliczeniowe na powtarzanie tych samych operacji. W dużych organizacjach może to spowodować jeszcze większą utratę produktywności, ponieważ różne zespoły często wykonują identyczne zadania lub nawet piszą zduplikowany kod inżynierii funkcji, ponieważ nie mają wiedzy na temat wcześniejszej pracy. Aby uniknąć ponownego przetwarzania funkcji, wyeksportujemy nasz przepływ danych do Amazon Potok SageMaker. Wybierzmy + przycisk po prawej stronie zapytania. Wybierz eksport przepływu danych i wybierz Uruchom potok SageMaker (za pośrednictwem notatnika Jupyter).

Sprzątanie

Aby uniknąć naliczania przyszłych opłat, usuń lub zamknij zasoby utworzone podczas obserwowania tego posta. Odnosić się do Wylogowanie z Amazon SageMaker Canvas by uzyskać więcej szczegółów.

Wnioski

W tym poście pokazaliśmy, jak kompleksowe możliwości Amazon SageMaker Canvas można uzyskać, wcielając się w rolę specjalisty ds. danych przygotowującego dane dla LLM. Interaktywne przygotowanie danych umożliwiło szybkie czyszczenie, przekształcanie i analizowanie danych w celu opracowania funkcji informacyjnych. Usuwając złożoność kodowania, SageMaker Canvas umożliwił szybką iterację w celu stworzenia wysokiej jakości zestawu danych szkoleniowych. Ten przyspieszony przepływ pracy doprowadził bezpośrednio do zbudowania, szkolenia i wdrożenia wydajnego modelu uczenia maszynowego, który ma wpływ na działalność biznesową. Dzięki kompleksowemu przygotowaniu danych i ujednoliconemu doświadczeniu od danych po spostrzeżenia, SageMaker Canvas umożliwia użytkownikom poprawę wyników uczenia maszynowego.

Zachęcamy do dowiedzenia się więcej poprzez eksplorację Pogromca danych Amazon SageMaker, Płótno Amazon SageMaker, Amazon Tytan modele, Amazońska skała macierzystai Amazon Usługa OpenSearch zbudować rozwiązanie, korzystając z przykładowej implementacji podanej w tym poście i zbioru danych odpowiedniego dla Twojej firmy. Jeśli masz pytania lub sugestie, zostaw komentarz.

O autorach

Ajjay Govindaram jest starszym architektem rozwiązań w AWS. Pracuje ze strategicznymi klientami, którzy wykorzystują AI/ML do rozwiązywania złożonych problemów biznesowych. Jego doświadczenie polega na zapewnianiu wskazówek technicznych oraz pomocy projektowej w przypadku wdrożeń aplikacji AI/ML na niewielką lub dużą skalę. Jego wiedza obejmuje architekturę aplikacji, big data, analitykę i uczenie maszynowe. Lubi słuchać muzyki podczas odpoczynku, przebywania na świeżym powietrzu i spędzania czasu z najbliższymi.

Ajjay Govindaram jest starszym architektem rozwiązań w AWS. Pracuje ze strategicznymi klientami, którzy wykorzystują AI/ML do rozwiązywania złożonych problemów biznesowych. Jego doświadczenie polega na zapewnianiu wskazówek technicznych oraz pomocy projektowej w przypadku wdrożeń aplikacji AI/ML na niewielką lub dużą skalę. Jego wiedza obejmuje architekturę aplikacji, big data, analitykę i uczenie maszynowe. Lubi słuchać muzyki podczas odpoczynku, przebywania na świeżym powietrzu i spędzania czasu z najbliższymi.

Nikita Iwkin jest starszym naukowcem stosowanym w Amazon SageMaker Data Wrangler i interesuje się uczeniem maszynowym i algorytmami czyszczenia danych.

Nikita Iwkin jest starszym naukowcem stosowanym w Amazon SageMaker Data Wrangler i interesuje się uczeniem maszynowym i algorytmami czyszczenia danych.

- Dystrybucja treści i PR oparta na SEO. Uzyskaj wzmocnienie już dziś.

- PlatoData.Network Pionowe generatywne AI. Wzmocnij się. Dostęp tutaj.

- PlatoAiStream. Inteligencja Web3. Wiedza wzmocniona. Dostęp tutaj.

- PlatonESG. Węgiel Czysta technologia, Energia, Środowisko, Słoneczny, Gospodarowanie odpadami. Dostęp tutaj.

- Platon Zdrowie. Inteligencja w zakresie biotechnologii i badań klinicznych. Dostęp tutaj.

- Źródło: https://aws.amazon.com/blogs/machine-learning/simplify-data-prep-for-gen-ai-with-amazon-sagemaker-data-wrangler/

- :ma

- :Jest

- :nie

- 100

- 14

- 20

- 25

- 28

- 50

- 7

- 8

- 804

- a

- Zdolny

- O nas

- powyżej

- przyśpieszyć

- przyśpieszony

- dostęp

- Stosownie

- Konta

- precyzja

- Dodaj

- Dodatkowy

- Przyjęcie

- zaliczki

- Korzyść

- Zalety

- Po

- ponownie

- agregat

- przed

- AI

- AI / ML

- Algorytmy

- Wyrównuje

- Wszystkie kategorie

- dozwolony

- również

- Amazonka

- Amazon Sage Maker

- Pogromca danych Amazon SageMaker

- Amazon Web Services

- kwoty

- an

- analizuje

- analityka

- Analizując

- i

- odpowiedź

- każdy

- api

- Zastosowanie

- stosowany

- Stosowanie

- architektura

- SĄ

- sztuczny

- sztuczna inteligencja

- AS

- Wsparcie

- At

- dołączać

- audio

- zwiększona

- dostępny

- uniknąć

- AWS

- baza

- na podstawie

- BE

- bo

- staje się

- być

- zanim

- jest

- Ulepsz Swój

- stronniczy

- Duży

- Big Data

- budować

- Budowanie

- wbudowany

- biznes

- biznes

- przycisk

- by

- wezwanie

- CAN

- brezentowy

- możliwości

- walizka

- Spowodować

- Zmiany

- Opłaty

- Dodaj

- kleń

- Sprzątanie

- kod

- Kodowanie

- łączenie

- komentarz

- Firmy

- w porównaniu

- konkurencyjny

- kompletny

- kompleks

- złożoności

- zrozumieć

- wszechstronny

- obliczać

- Rozważać

- Konsola

- zawierać

- zawiera

- zawartość

- treść

- kontekst

- konteksty

- ciągły

- kontrola

- konwertować

- Odpowiedni

- mógłby

- pokrywa

- Stwórz

- stworzony

- krytyczny

- zwyczaj

- klient

- Obsługa klienta

- Klientów

- dane

- Przygotowywanie danych

- Baza danych

- zbiory danych

- deloitte

- wykazać

- wdrażanie

- wdrożenia

- Wnętrze

- detale

- rozwijanie

- różne

- trudny

- Wymiary

- kierunek

- bezpośrednio

- odkryj

- do

- dokument

- dokumentacja

- dokumenty

- domena

- domeny

- na dół

- podczas

- e

- każdy

- z łatwością

- faktycznie

- wydajny

- skutecznie

- e-maile

- osadzanie

- upoważnia

- włączony

- umożliwiając

- zachęcać

- koniec końców

- inżynier

- zaprojektowane

- Inżynieria

- oceny

- Parzyste

- przykład

- istnieje

- doświadczenie

- doświadczać

- eksperymentalny

- odkryj

- Exploring

- eksport

- wyciąg

- Cecha

- Korzyści

- kilka

- Łąka

- filet

- filtrować

- finał

- Znajdź

- pływ

- następnie

- następujący

- następujący sposób

- W razie zamówieenia projektu

- Forbes

- Fundacja

- Fundamenty

- Darmowy

- od

- pełny

- Funkcje

- dalej

- przyszłość

- Wzrost

- Generować

- wygenerowane

- generujący

- generacja

- generatywny

- generatywna sztuczna inteligencja

- otrzymać

- Dać

- dany

- Globalne

- Go

- cel

- dobry

- większy

- Have

- he

- headers

- wysokiej jakości

- jego

- posiada

- Strona główna

- W jaki sposób

- How To

- Jednak

- HTML

- HTTPS

- i

- identiques

- if

- zdjęcia

- Rezultat

- realizacja

- importować

- ważny

- imponujący

- podnieść

- in

- obejmuje

- wskaźnik

- zindeksowane

- Informacja

- informacyjny

- początkowy

- spostrzeżenia

- instrukcje

- integracja

- Inteligencja

- interaktywne

- zainteresowania

- Interfejs

- Internet

- najnowszych

- angażować

- IT

- iteracja

- iteracje

- JEGO

- Oferty pracy

- jpg

- json

- wiedza

- Kraj

- język

- duży

- na dużą skalę

- uruchomić

- Wyprowadzenia

- UCZYĆ SIĘ

- nauka

- Pozostawiać

- Doprowadziło

- lewarowanie

- leży

- lubić

- Lista

- Słuchanie

- LLM

- załadować

- lokalizacja

- lokalizacji

- od

- Partia

- "kochanym"

- niski

- maszyna

- uczenie maszynowe

- Główny

- robić

- WYKONUJE

- maska

- masywny

- mistrz

- Może..

- Mechanizmy

- Media

- Menu

- Meta

- Metadane

- ML

- model

- modele

- skromny

- jeszcze

- większość

- wielokrotność

- Muzyka

- Nazwa

- Naturalny

- Przetwarzanie języka naturalnego

- Natura

- Nawigacja

- niezbędny

- Potrzebować

- Nowości

- Następny

- Nie

- notatnik

- już dziś

- of

- często

- on

- pewnego razu

- te

- tylko

- operacje

- Option

- or

- organizacja

- organizacji

- Inne

- ludzkiej,

- na zewnątrz

- wyniki

- na zewnątrz

- wydajność

- koniec

- strona

- pandy

- chleb

- Przechodzący

- Hasło

- jest gwarancją najlepszej jakości, które mogą dostarczyć Ci Twoje monitory,

- osobisty

- wybierać

- kawałek

- sztuk

- rurociąg

- plato

- Analiza danych Platona

- PlatoDane

- Proszę

- plus

- punkt

- polityka

- Post

- potencjał

- powered

- Korzystny

- przygotowanie

- Przygotować

- przygotowanie

- Wcześniejszy

- prawdopodobnie

- Problem

- problemy

- kontynuować

- wygląda tak

- przetwarzanie

- Produkcja

- wydajność

- profesjonalny

- projekt

- niska zabudowa

- pod warunkiem,

- zapewnia

- że

- Python

- zapytania

- pytanie

- pytania

- szybko

- zakresy

- szybki

- Oceny

- dosięgnąć

- Czytaj

- Prawdziwy świat

- Odebrane

- odnosić się

- związane z

- usuwanie

- Zgłoszone

- wywołań

- wymagać

- Wymaga

- Zasoby

- odpowiedź

- Odpowiedzi

- spoczynkowy

- Efekt

- powrót

- Recenzje

- prawo

- Rola

- run

- sagemaker

- taki sam

- Zapisz

- Naukowiec

- Szukaj

- poszukiwania

- Sekcja

- widziany

- wybierać

- wysyłanie

- senior

- wrażliwy

- usługa

- Usługi

- w panelu ustawień

- powinien

- pokazać

- pokazał

- zamknąć

- zamknąć

- bok

- znak

- znaczący

- podobny

- prostota

- upraszczać

- Rozmiar

- skrawek

- So

- Obserwuj Nas

- Media społecznościowe

- rozwiązanie

- Rozwiązania

- ROZWIĄZANIA

- kilka

- Źródło

- Źródła

- specyficzny

- swoiście

- wydać

- Spędzanie

- STAGE

- etapy

- Ewolucja krok po kroku

- Cel

- Nadal

- Strategiczny

- zbudowany

- PODSUMOWANIE

- podpory

- Badanie

- Brać

- Zespoły

- Techniczny

- Techniki

- test

- XNUMX

- że

- Połączenia

- Przyszłość

- ich

- Im

- następnie

- Tam.

- Te

- one

- to

- A zatem

- czas

- tytan

- do

- już dziś

- narzędzia

- Trening

- Przekształcać

- Transformacja

- przemiany

- transformatorowy

- prawdziwy

- obcięcie

- rodzaj

- typy

- Ujednolicony

- us

- posługiwać się

- używany

- Użytkownik

- Użytkownicy

- za pomocą

- Cenny

- przez

- Wideo

- wizualny

- solucja

- we

- sieć

- usługi internetowe

- DOBRZE

- który

- Podczas

- KIM

- będzie

- w

- Praca

- workflow

- działa

- by

- napisać

- You

- Twój

- zefirnet