A fotografia falsa não é novidade. Na década de 1910, o autor britânico Arthur Conan Doyle foi famoso por ser enganado por duas irmãs em idade escolar que produziram fotografias de fadas elegantes brincando em seu jardim.

Hoje é difícil acreditar que essas fotos poderiam ter enganado alguém, mas foi só na década de 1980 que um especialista chamado Geoffrey Crawley teve a coragem de aplicar diretamente seu conhecimento de fotografia cinematográfica e deduzir o óbvio.

As fotografias eram falsas, como mais tarde admitiu uma das próprias irmãs.

Caça aos artefatos e bom senso

A fotografia digital abriu uma variedade de técnicas para falsificadores e detetives.

O exame forense de imagens suspeitas hoje em dia envolve a busca de qualidades inerentes à fotografia digital, como examinar metadados incorporados nas fotos, usando software como o Adobe Photoshop para corrigir distorções nas imagens e procurando por sinais reveladores de manipulação, como regiões sendo duplicadas para obscurecer recursos originais.

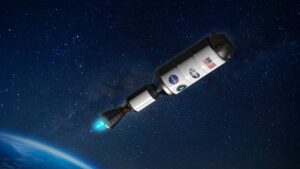

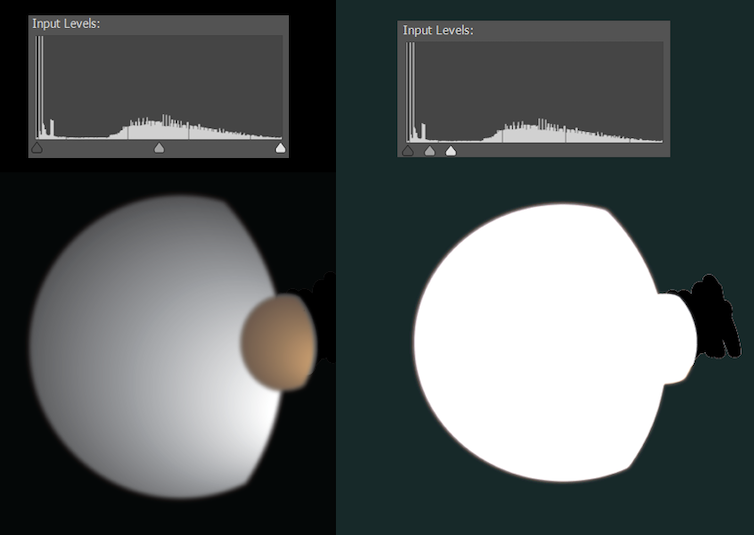

Às vezes, as edições digitais são sutis demais para serem detectadas, mas saltam à vista quando ajustamos a maneira como os pixels claros e escuros são distribuídos. Por exemplo, em 2010, a NASA lançou um foto das luas de Saturno Dione e Titan. Não era de forma alguma falso, mas foi limpo para remover artefatos perdidos - que foram a atenção dos teóricos da conspiração.

Curioso, coloquei a imagem no Photoshop. A ilustração abaixo recria aproximadamente como isso parecia.

A maioria das fotografias digitais está em formatos compactados, como JPEG, reduzidos pela remoção de grande parte das informações capturadas pela câmera. Algoritmos padronizados garantem que as informações removidas tenham um impacto visível mínimo, mas deixam rastros.

A compactação de qualquer região de uma imagem dependerá do que está acontecendo na imagem e nas configurações atuais da câmera; quando uma imagem falsa combina várias fontes, muitas vezes é possível detectar isso análise cuidadosa dos artefatos de compressão.

Alguma metodologia forense tem pouco a ver com o formato de uma imagem, mas é essencialmente trabalho de detetive visual. Todos na fotografia estão iluminados da mesma maneira? As sombras e os reflexos fazem sentido? As orelhas e as mãos estão mostrando luz e sombra nos lugares certos? O que se reflete nos olhos das pessoas? Todas as linhas e ângulos da sala se somariam se modelássemos a cena em 3D?

Arthur Conan Doyle pode ter sido enganado por fotos de fadas, mas acho que sua criação Sherlock Holmes estaria em casa no mundo da análise forense de fotos.

Uma nova era de inteligência artificial

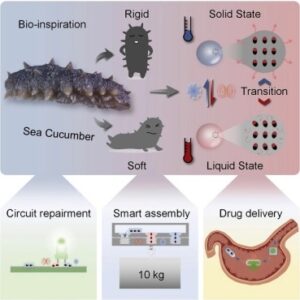

A atual explosão de imagens criado por texto para imagem inteligência artificial ferramentas é, em muitos aspectos, mais radical do que a mudança do filme para a fotografia digital.

Agora podemos conjurar qualquer imagem que quisermos, apenas digitando. Essas imagens não são fotos feitas por remendando aglomerados de pixels pré-existentes. São imagens inteiramente novas com o conteúdo, qualidade e estilo especificados.

Até recentemente, as complexas redes neurais usadas para gerar essas imagens tinham disponibilidade limitada ao público. Isso mudou em 23 de agosto de 2022, com o lançamento ao público do Difusão estável de código aberto. Agora, qualquer pessoa com uma placa gráfica Nvidia de nível de jogo em seu computador pode criar conteúdo de imagem de IA sem nenhum laboratório de pesquisa ou controle de negócios para suas atividades.

Isso levou muitos a perguntar: “podemos acreditar no que vemos online novamente?”. Depende.

A IA de texto para imagem obtém sua inteligência do treinamento - a análise de um grande número de pares de imagem/legenda. Os pontos fortes e fracos de cada sistema são, em parte, derivados de quais imagens ele foi treinado. Aqui está um exemplo: é assim que a Stable Diffusion vê George Clooney passando roupa.

Isso está longe de ser realista. Tudo o que a Stable Diffusion tem para continuar é a informação que aprendeu e, embora esteja claro que viu George Clooney e pode vincular essa sequência de letras às características do ator, não é um especialista em Clooney.

No entanto, teria visto e digerido muito mais fotos de homens de meia-idade em geral, então vamos ver o que acontece quando pedimos um homem de meia-idade genérico no mesmo cenário.

Esta é uma melhoria clara, mas ainda não muito realista. Como sempre foi o caso, a geometria complicada das mãos e orelhas são bons lugares para procurar sinais de falsificação – embora neste meio estejamos olhando para a geometria espacial em vez de sinais de iluminação impossível.

Pode haver outras pistas. Se reconstruíssemos cuidadosamente a sala, os cantos seriam quadrados? As prateleiras fariam sentido? Um especialista forense acostumado a examinar fotografias digitais provavelmente poderia fazer uma ligação sobre isso.

Não podemos mais acreditar em nossos olhos

Se estendermos o conhecimento de um sistema de texto para imagem, ele pode se sair ainda melhor. Você pode adicionar suas próprias fotografias descritas para complementar o treinamento existente. Este processo é conhecido como inversão textual.

Recentemente, o Google lançou Cabine dos Sonhos, um método alternativo e mais sofisticado para injetar pessoas, objetos ou até estilos de arte específicos em sistemas de IA de texto para imagem.

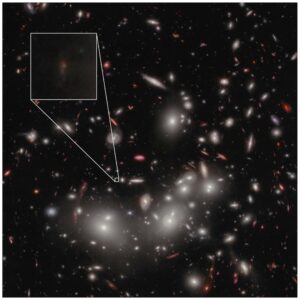

Este processo requer hardware resistente, mas os resultados são surpreendentes. Alguns ótimos trabalhos começaram a ser compartilhados no Reddit. Olhe para as fotos na postagem abaixo que mostram imagens colocadas no DreamBooth e imagens falsas realistas do Stable Diffusion.

Não podemos mais acreditar em nossos olhos, mas ainda podemos confiar nos de especialistas forenses, pelo menos por enquanto. É inteiramente possível que sistemas futuros possam ser deliberadamente treinados para enganá-los também.

Estamos entrando rapidamente em uma era em que a fotografia perfeita e até mesmo o vídeo serão comuns. O tempo dirá o quão significativo isso será, mas, enquanto isso, vale a pena lembrar a lição das fotos da Cottingley Fairy – às vezes as pessoas só querem acreditar, mesmo em falsificações óbvias.![]()

Este artigo foi republicado a partir de A Conversação sob uma licença Creative Commons. Leia o artigo original.

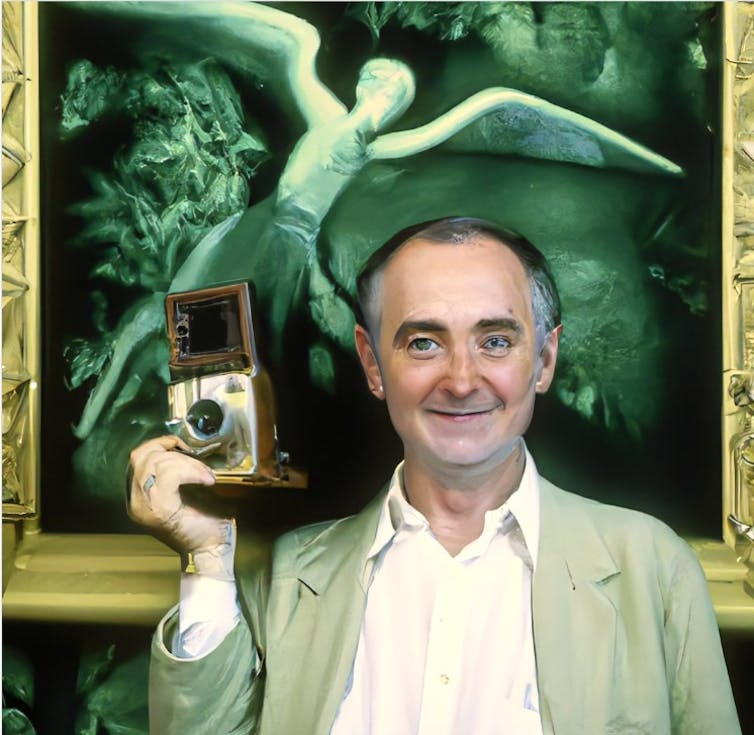

Crédito de imagem: Brendan Murphy/author fornecido