Esta postagem foi escrita em parceria com Ming (Melvin) Qin, David Bericat e Brad Genereaux da NVIDIA.

Os pesquisadores e desenvolvedores de IA de imagens médicas precisam de uma estrutura empresarial escalável para construir, implantar e integrar seus aplicativos de IA. AWS e NVIDIA se uniram para tornar essa visão uma realidade. AWS, NVIDIA e outros parceiros crie aplicativos e soluções para tornar a assistência médica mais acessível, econômica e eficiente, acelerando a conectividade em nuvem de imagens corporativas. Implantação MONAI é um dos principais módulos dentro MONAI (Medical Open Network for Artificial Intelligence) desenvolvida por um consórcio de líderes acadêmicos e da indústria, incluindo a NVIDIA. AWS HealthImaging (AHI) é um armazenamento de imagens médicas qualificado para HIPAA, altamente escalonável, de alto desempenho e econômico. Desenvolvemos um conector MONAI Deploy para AHI para integrar aplicativos de IA de imagens médicas com latências de recuperação de imagens de subsegundos em escala, alimentados por APIs nativas da nuvem. Os modelos e aplicativos MONAI AI podem ser hospedados em Amazon Sage Maker, que é um serviço totalmente gerenciado para implantar modelos de aprendizado de máquina (ML) em escala. O SageMaker se encarrega de configurar e gerenciar instâncias para inferência e fornece métricas e logs integrados para endpoints que você pode usar para monitorar e receber alertas. Também oferece uma variedade de Instâncias de GPU NVIDIA para inferência de ML, bem como várias opções de implantação de modelo com escalonamento automático, incluindo inferência em tempo real, inferência sem servidor, inferência assíncrona e transformação em lote.

Nesta postagem, demonstramos como implantar um pacote de aplicativos MONAI (MAP) com o conector para AWS HealthImaging, usando um endpoint multimodelo SageMaker para inferência em tempo real e inferência assíncrona. Essas duas opções cobrem a maioria dos casos de uso de pipeline de inferência de imagens médicas quase em tempo real.

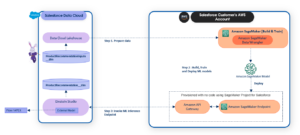

Visão geral da solução

O diagrama a seguir ilustra a arquitetura da solução.

Pré-requisitos

Conclua as seguintes etapas de pré-requisito:

- Use uma conta da AWS com uma das seguintes regiões, onde o AWS HealthImaging está disponível: Virgínia do Norte (

us-east-1), Oregon (us-west-2), Irlanda (eu-west-1) e Sidney (ap-southeast-2). - Crie uma Estúdio Amazon SageMaker domínio e perfil de usuário de Gerenciamento de acesso e identidade da AWS (IAM) para acessar o AWS HealthImaging.

- Habilite a extensão JupyterLab v3 e instale Imjoy-jupyter-extension se desejar visualizar imagens médicas no notebook SageMaker de forma interativa usando itkwidgets.

Conector MAP para AWS HealthImaging

O AWS HealthImaging importa arquivos DICOM P10 e os converte em ImageSets, que são uma representação otimizada de uma série DICOM. AHI fornece acesso API aos metadados ImageSet e ImageFrames. Os metadados contêm todos os atributos DICOM em um documento JSON. ImageFrames são retornados codificados no formato JPEG2000 de alto rendimento (HTJ2K) formato sem perdas, que pode ser decodificado extremamente rápido. ImageSets podem ser recuperados usando o Interface de linha de comando da AWS (AWS CLI) ou o SDKs da AWS.

MONAI é uma estrutura de IA de imagens médicas que leva avanços em pesquisas e aplicações de IA ao impacto clínico. MONAI Deploy é o pipeline de processamento que permite o fluxo de trabalho de ponta a ponta, incluindo empacotamento, teste, implantação e execução de aplicativos de IA de imagens médicas na produção clínica. Compreende o MONAI Implantar o SDK do aplicativo, MONAI Implantar Expresso, Gerente de fluxo de trabalho e Portal de Informática. O MONAI Deploy App SDK fornece algoritmos prontos para uso e uma estrutura para acelerar a construção de aplicativos de IA de imagens médicas, bem como ferramentas utilitárias para empacotar o aplicativo em um contêiner MAP. As funcionalidades integradas baseadas em padrões no SDK do aplicativo permitem que o MAP se integre perfeitamente às redes de TI de saúde, o que requer o uso de padrões como DICOM, HL7 e FHIR, e em data centers e ambientes de nuvem. Os MAPs podem usar operadores predefinidos e personalizados para carregamento de imagens DICOM, seleção de séries, inferência de modelo e pós-processamento

Nós desenvolvemos um Módulo Python usando o AWS HealthImaging Python SDK Boto3. Você pode instalá-lo pip e usar a função auxiliar para recuperar instâncias DICOM Service-Object Pair (SOP) da seguinte forma:

!pip install -q AHItoDICOMInterface

from AHItoDICOMInterface.AHItoDICOM import AHItoDICOM

helper = AHItoDICOM()

instances = helper.DICOMizeImageSet(datastore_id=datastoreId , image_set_id=next(iter(imageSetIds)))As instâncias de SOP de saída podem ser visualizadas usando o visualizador interativo de imagens médicas 3D itkwidgets no seguinte caderno. O AHItoDICOM classe aproveita vários processos para recuperar quadros de pixels do AWS HealthImaging em paralelo e decodificar que o Blobs binários HTJ2K usando o Biblioteca Python OpenJPEG. Os ImageSetIds vêm dos arquivos de saída de um determinado trabalho de importação do AWS HealthImaging. Dado o DatastoreId e o JobId de importação, você pode recuperar o ImageSetId, que é equivalente ao UID da instância da série DICOM, da seguinte maneira:

imageSetIds = {}

try: response = s3.head_object(Bucket=OutputBucketName, Key=f"output/{res_createstore['datastoreId']}-DicomImport-{res_startimportjob['jobId']}/job-output-manifest.json") if response['ResponseMetadata']['HTTPStatusCode'] == 200: data = s3.get_object(Bucket=OutputBucketName, Key=f"output/{res_createstore['datastoreId']}-DicomImport-{res_startimportjob['jobId']}/SUCCESS/success.ndjson") contents = data['Body'].read().decode("utf-8") for l in contents.splitlines(): isid = json.loads(l)['importResponse']['imageSetId'] if isid in imageSetIds: imageSetIds[isid]+=1 else: imageSetIds[isid]=1

except ClientError: passCom ImageSetId, você pode recuperar os metadados do cabeçalho DICOM e os pixels da imagem separadamente usando funções nativas da API AWS HealthImaging. O Agregados exportadores DICOM os cabeçalhos DICOM e pixels de imagem no Pydicom conjunto de dados, que pode ser processado pelo Operador de carregador de dados MAP DICOM. Usando a função DICOMizeImageSet(), criamos um conector para carregar dados de imagem do AWS HealthImaging, com base no MAP Operador de carregador de dados DICOM:

class AHIDataLoaderOperator(Operator): def __init__(self, ahi_client, must_load: bool = True, *args, **kwargs): self.ahi_client = ahi_client … def _load_data(self, input_obj: string): study_dict = {} series_dict = {} sop_instances = self.ahi_client.DICOMizeImageSet(input_obj['datastoreId'], input_obj['imageSetId'])No código anterior, ahi_client é uma instância da classe exportadora AHItoDICOM DICOM, com funções de recuperação de dados ilustradas. Incluímos este novo operador de carregador de dados em um Aplicativo de IA de segmentação de baço 3D criado pelo MONAI Deploy App SDK. Você pode primeiro explorar como criar e executar este aplicativo em uma instância de notebook locale, em seguida, implante esse aplicativo MAP em endpoints de inferência gerenciados pelo SageMaker.

Inferência assíncrona do SageMaker

Um SageMaker inferência assíncrona O endpoint é usado para solicitações com tamanhos de carga grandes (até 1 GB), longos tempos de processamento (até 15 minutos) e requisitos de latência quase em tempo real. Quando não há solicitações para processar, essa opção de implantação pode reduzir a contagem de instâncias para zero para economizar custos, o que é ideal para cargas de trabalho de inferência de ML de imagens médicas. Siga as etapas do caderno de amostra para criar e invocar o endpoint de inferência assíncrona do SageMaker. Para criar um endpoint de inferência assíncrona, você precisará primeiro criar um modelo SageMaker e uma configuração de endpoint. Para criar um modelo SageMaker, você precisará carregar um pacote model.tar.gz com um estrutura de diretório definida em um contêiner Docker. O pacote model.tar.gz inclui um arquivo model.ts de segmentação de baço pré-treinado e um arquivo inference.py personalizado. Usamos um contêiner pré-construído com versões da estrutura Python 3.8 e PyTorch 1.12.1 para carregar o modelo e executar previsões.

No personalizado inferência.py arquivo, instanciamos uma classe auxiliar AHItoDICOM de AHItoDICOMInterface e a usamos para criar uma instância MAP no model_fn() função, e executamos o aplicativo MAP em cada solicitação de inferência no predict_fn() função:

from app import AISpleenSegApp

from AHItoDICOMInterface.AHItoDICOM import AHItoDICOM

helper = AHItoDICOM()

def model_fn(model_dir, context): … monai_app_instance = AISpleenSegApp(helper, do_run=False,path="/home/model-server") def predict_fn(input_data, model): with open('/home/model-server/inputImageSets.json', 'w') as f: f.write(json.dumps(input_data)) output_folder = "/home/model-server/output" if not os.path.exists(output_folder): os.makedirs(output_folder) model.run(input='/home/model-server/inputImageSets.json', output=output_folder, workdir='/home/model-server', model='/opt/ml/model/model.ts')Para invocar o endpoint assíncrono, você precisará fazer upload da carga útil de entrada da solicitação para Serviço de armazenamento simples da Amazon (Amazon S3), que é um arquivo JSON que especifica o ID do armazenamento de dados do AWS HealthImaging e o ID do ImageSet para executar a inferência:

sess = sagemaker.Session()

InputLocation = sess.upload_data('inputImageSets.json', bucket=sess.default_bucket(), key_prefix=prefix, extra_args={"ContentType": "application/json"})

response = runtime_sm_client.invoke_endpoint_async(EndpointName=endpoint_name, InputLocation=InputLocation, ContentType="application/json", Accept="application/json")

output_location = response["OutputLocation"]A saída também pode ser encontrada no Amazon S3.

Inferência multimodelo em tempo real do SageMaker

SageMaker inferência em tempo real endpoints atendem aos requisitos interativos e de baixa latência. Esta opção pode hospedar vários modelos em um contêiner atrás de um endpoint, o que é uma solução escalonável e econômica para implantar vários modelos de ML. A O endpoint multimodelo SageMaker usa o servidor de inferência NVIDIA Triton com GPU para executar várias inferências de modelos de aprendizagem profunda.

Nesta seção, explicamos como criar e invocar um endpoint multimodelo adaptando seu próprio contêiner de inferência na sequência caderno de amostra. Diferentes modelos podem ser servidos num contentor partilhado na mesma frota de recursos. Os endpoints multimodelos reduzem a sobrecarga de implantação e dimensionam as inferências do modelo com base nos padrões de tráfego para o endpoint. Nós costumavamos Ferramentas para desenvolvedores AWS incluam Amazon CodeCommit, Amazon CodeBuild e Amazon Code Pipeline para construir o contêiner personalizado para inferência do modelo SageMaker. Preparamos um model_handler.py para trazer seu próprio contêiner em vez do arquivo inference.py no exemplo anterior e implementou as funções initialize(), preprocess() e inference():

from app import AISpleenSegApp

from AHItoDICOMInterface.AHItoDICOM import AHItoDICOM

class ModelHandler(object): def __init__(self): self.initialized = False self.shapes = None def initialize(self, context): self.initialized = True properties = context.system_properties model_dir = properties.get("model_dir") gpu_id = properties.get("gpu_id") helper = AHItoDICOM() self.monai_app_instance = AISpleenSegApp(helper, do_run=False, path="/home/model-server/") def preprocess(self, request): inputStr = request[0].get("body").decode('UTF8') datastoreId = json.loads(inputStr)['inputs'][0]['datastoreId'] imageSetId = json.loads(inputStr)['inputs'][0]['imageSetId'] with open('/tmp/inputImageSets.json', 'w') as f: f.write(json.dumps({"datastoreId": datastoreId, "imageSetId": imageSetId})) return '/tmp/inputImageSets.json' def inference(self, model_input): self.monai_app_instance.run(input=model_input, output="/home/model-server/output/", workdir="/home/model-server/", model=os.environ["model_dir"]+"/model.ts")Depois que o contêiner for construído e enviado para Registro do Amazon Elastic Container (Amazon ECR), você pode criar um modelo SageMaker com ele, além de diferentes pacotes de modelos (arquivos tar.gz) em um determinado caminho do Amazon S3:

model_name = "DEMO-MONAIDeployModel" + strftime("%Y-%m-%d-%H-%M-%S", gmtime())

model_url = "s3://{}/{}/".format(bucket, prefix)

container = "{}.dkr.ecr.{}.amazonaws.com/{}:dev".format( account_id, region, prefix )

container = {"Image": container, "ModelDataUrl": model_url, "Mode": "MultiModel"}

create_model_response = sm_client.create_model(ModelName=model_name, ExecutionRoleArn=role, PrimaryContainer=container)Vale ressaltar que model_url aqui especifica apenas o caminho para uma pasta de arquivos tar.gz e você especifica qual pacote de modelo usar para inferência ao invocar o endpoint, conforme mostrado no código a seguir:

Payload = {"inputs": [ {"datastoreId": datastoreId, "imageSetId": next(iter(imageSetIds))} ]}

response = runtime_sm_client.invoke_endpoint(EndpointName=endpoint_name, ContentType="application/json", Accept="application/json", TargetModel="model.tar.gz", Body=json.dumps(Payload))Podemos adicionar mais modelos ao endpoint de inferência multimodelo existente sem precisar atualizar o endpoint ou criar um novo.

limpar

Não se esqueça de preencher o Exclua os recursos de hospedagem passo no laboratório-3 e laboratório-4 notebooks para excluir os endpoints de inferência do SageMaker. Você também deve desativar a instância do notebook SageMaker para economizar custos. Por fim, você pode chamar a função de API do AWS HealthImaging ou usar o console do AWS HealthImaging para excluir os conjuntos de imagens e o armazenamento de dados criados anteriormente:

for s in imageSetIds.keys(): medicalimaging.deleteImageSet(datastoreId, s)

medicalimaging.deleteDatastore(datastoreId)Conclusão

Nesta postagem, mostramos como criar um conector MAP para AWS HealthImaging, que é reutilizável em aplicativos criados com o MONAI Deploy App SDK, para integrar e acelerar a recuperação de dados de imagem de um armazenamento DICOM nativo da nuvem para cargas de trabalho de IA de imagens médicas . O MONAI Deploy SDK pode ser usado para dar suporte às operações hospitalares. Também demonstramos duas opções de hospedagem para implantar aplicativos MAP AI no SageMaker em escala.

Veja os cadernos de exemplo no Repositório GitHub para saber mais sobre como implantar aplicativos MONAI no SageMaker com imagens médicas armazenadas no AWS HealthImaging. Para saber o que a AWS pode fazer por você, entre em contato com um representante da AWS.

Para recursos adicionais, consulte o seguinte:

Sobre os autores

Ming (Melvin)Qin é um contribuidor independente da equipe de saúde da NVIDIA, focado no desenvolvimento de uma estrutura e plataforma de aplicativos de inferência de IA para levar IA aos fluxos de trabalho de imagens médicas. Antes de ingressar na NVIDIA em 2018 como membro fundador da Clara, Ming passou 15 anos desenvolvendo PACS de radiologia e SaaS de fluxo de trabalho como engenheiro/arquiteto líder na Stentor Inc., posteriormente adquirida pela Philips Healthcare para formar sua Enterprise Imaging.

Ming (Melvin)Qin é um contribuidor independente da equipe de saúde da NVIDIA, focado no desenvolvimento de uma estrutura e plataforma de aplicativos de inferência de IA para levar IA aos fluxos de trabalho de imagens médicas. Antes de ingressar na NVIDIA em 2018 como membro fundador da Clara, Ming passou 15 anos desenvolvendo PACS de radiologia e SaaS de fluxo de trabalho como engenheiro/arquiteto líder na Stentor Inc., posteriormente adquirida pela Philips Healthcare para formar sua Enterprise Imaging.

David Bericat é gerente de produtos de saúde na NVIDIA, onde lidera o grupo de trabalho do Projeto MONAI Deploy para levar a IA da pesquisa às implantações clínicas. A sua paixão é acelerar a inovação na saúde a nível global, traduzindo-a num verdadeiro impacto clínico. Anteriormente, David trabalhou na Red Hat, implementando princípios de código aberto na interseção de IA, nuvem, computação de ponta e IoT. Seus momentos de maior orgulho incluem caminhar até o acampamento base do Everest e jogar futebol por mais de 20 anos.

David Bericat é gerente de produtos de saúde na NVIDIA, onde lidera o grupo de trabalho do Projeto MONAI Deploy para levar a IA da pesquisa às implantações clínicas. A sua paixão é acelerar a inovação na saúde a nível global, traduzindo-a num verdadeiro impacto clínico. Anteriormente, David trabalhou na Red Hat, implementando princípios de código aberto na interseção de IA, nuvem, computação de ponta e IoT. Seus momentos de maior orgulho incluem caminhar até o acampamento base do Everest e jogar futebol por mais de 20 anos.

Brad Genereaux é líder global de alianças de saúde na NVIDIA, onde é responsável pelas relações com desenvolvedores com foco em imagens médicas para acelerar soluções de inteligência artificial e aprendizagem profunda, visualização, virtualização e análise. Brad evangeliza a adoção e integração onipresente de fluxos de trabalho contínuos de saúde e imagens médicas na prática clínica diária, com mais de 20 anos de experiência em TI de saúde.

Brad Genereaux é líder global de alianças de saúde na NVIDIA, onde é responsável pelas relações com desenvolvedores com foco em imagens médicas para acelerar soluções de inteligência artificial e aprendizagem profunda, visualização, virtualização e análise. Brad evangeliza a adoção e integração onipresente de fluxos de trabalho contínuos de saúde e imagens médicas na prática clínica diária, com mais de 20 anos de experiência em TI de saúde.

Gang Fu é arquiteto de soluções de saúde na AWS. Ele possui doutorado em Ciências Farmacêuticas pela Universidade do Mississippi e tem mais de 10 anos de experiência em tecnologia e pesquisa biomédica. Ele é apaixonado por tecnologia e pelo impacto que ela pode causar na saúde.

Gang Fu é arquiteto de soluções de saúde na AWS. Ele possui doutorado em Ciências Farmacêuticas pela Universidade do Mississippi e tem mais de 10 anos de experiência em tecnologia e pesquisa biomédica. Ele é apaixonado por tecnologia e pelo impacto que ela pode causar na saúde.

JP Leger é arquiteto de soluções sênior, oferecendo suporte a centros médicos acadêmicos e fluxos de trabalho de imagens médicas na AWS. Ele tem mais de 20 anos de experiência em engenharia de software, TI de saúde e imagens médicas, com ampla experiência na arquitetura de sistemas para desempenho, escalabilidade e segurança em implantações distribuídas de grandes volumes de dados no local, na nuvem e híbridos com análises e IA. .

JP Leger é arquiteto de soluções sênior, oferecendo suporte a centros médicos acadêmicos e fluxos de trabalho de imagens médicas na AWS. Ele tem mais de 20 anos de experiência em engenharia de software, TI de saúde e imagens médicas, com ampla experiência na arquitetura de sistemas para desempenho, escalabilidade e segurança em implantações distribuídas de grandes volumes de dados no local, na nuvem e híbridos com análises e IA. .

Chris Hafey é arquiteto de soluções principal da Amazon Web Services. Ele tem mais de 25 anos de experiência na indústria de imagens médicas e é especialista na construção de sistemas escalonáveis de alto desempenho. Ele é o criador do popular projeto de código aberto CornerstoneJS, que alimenta o popular visualizador de código aberto OHIF com pegada zero. Ele contribuiu para a especificação DICOMweb e continua trabalhando para melhorar seu desempenho para visualização baseada na web.

Chris Hafey é arquiteto de soluções principal da Amazon Web Services. Ele tem mais de 25 anos de experiência na indústria de imagens médicas e é especialista na construção de sistemas escalonáveis de alto desempenho. Ele é o criador do popular projeto de código aberto CornerstoneJS, que alimenta o popular visualizador de código aberto OHIF com pegada zero. Ele contribuiu para a especificação DICOMweb e continua trabalhando para melhorar seu desempenho para visualização baseada na web.

- Conteúdo com tecnologia de SEO e distribuição de relações públicas. Seja amplificado hoje.

- PlatoData.Network Gerativa Vertical Ai. Capacite-se. Acesse aqui.

- PlatoAiStream. Inteligência Web3. Conhecimento Amplificado. Acesse aqui.

- PlatãoESG. Carbono Tecnologia Limpa, Energia, Ambiente, Solar, Gestão de resíduos. Acesse aqui.

- PlatoHealth. Inteligência em Biotecnologia e Ensaios Clínicos. Acesse aqui.

- Fonte: https://aws.amazon.com/blogs/machine-learning/build-a-medical-imaging-ai-inference-pipeline-with-monai-deploy-on-aws/

- :tem

- :é

- :não

- :onde

- $UP

- 1

- 10

- 100

- 12

- 15 anos

- 15%

- 20

- 20 anos

- 200

- 2018

- 25

- 3d

- 7

- 8

- a

- Sobre

- acadêmico

- acelerar

- acelerando

- Acesso

- acessível

- Conta

- adquirido

- em

- adicionar

- Adicional

- Adoção

- Vantagem

- acessível

- AI

- Modelos de IA

- Alertas

- algoritmos

- Todos os Produtos

- Alianças

- permitir

- tb

- Amazon

- Amazon Web Services

- an

- analítica

- e

- api

- Acesso à API

- APIs

- app

- Aplicação

- aplicações

- arquitetura

- SOMOS

- artificial

- inteligência artificial

- AS

- At

- atributos

- Automático

- disponível

- AWS

- base

- baseado

- BE

- antes

- atrás

- biomédica

- corpo

- ambos

- prego

- avanços

- trazer

- construir

- Prédio

- construído

- construídas em

- by

- chamada

- Acampamento

- CAN

- Cuidado

- casos

- Centralização de

- Centros

- Clara

- classe

- Clínico

- Na nuvem

- código

- como

- completar

- compreende

- computação

- Configuração

- Conectividade

- cônsul

- consórcio

- Contacto

- Recipiente

- contém

- conteúdo

- contexto

- continua

- contribuiu

- contribuinte

- Custo

- economia de custos

- relação custo-benefício

- custos

- cobrir

- coescrito

- crio

- criado

- criador

- personalizado

- dados,

- Data Center

- David

- profundo

- deep learning

- demonstrar

- demonstraram

- implantar

- Implantação

- desenvolvimento

- Implantações

- Dev

- desenvolvido

- Developer

- desenvolvedores

- em desenvolvimento

- diferente

- distribuído

- do

- Estivador

- documento

- down

- Mais cedo

- borda

- computação de borda

- eficiente

- ou

- outro

- permite

- end-to-end

- Ponto final

- Engenharia

- Empreendimento

- ambientes

- Equivalente

- Evereste

- Cada

- cotidiano

- exemplo

- Exceto

- existente

- vasta experiência

- experiência

- explorar

- extenso

- Experiência Extensiva

- extremamente

- falso

- RÁPIDO

- Envie o

- Arquivos

- Finalmente

- Primeiro nome

- ANIMARIS

- Foco

- focado

- seguir

- seguinte

- segue

- Pegada

- Escolha

- formulário

- formato

- encontrado

- fundando

- Quadro

- da

- fu

- totalmente

- função

- funcionalidades

- funções

- GitHub

- dado

- Global

- Globalmente

- GPU

- Grupo

- chapéu

- Ter

- ter

- he

- cabeçalhos

- Saúde

- saúde

- SUA PARTICIPAÇÃO FAZ A DIFERENÇA

- alta performance

- altamente

- sua

- detém

- hospital

- hospedeiro

- hospedado

- hospedagem

- Como funciona o dobrador de carta de canal

- Como Negociar

- HTML

- http

- HTTPS

- HÍBRIDO

- ID

- ideal

- Identidade

- if

- ilustra

- imagem

- imagens

- Imagiologia

- Impacto

- implementado

- implementação

- importar

- importações

- melhorar

- in

- Inc.

- incluir

- incluído

- inclui

- Incluindo

- de treinadores em Entrevista Motivacional

- indústria

- Inovação

- entrada

- inputs

- instalar

- instância

- em vez disso

- integrar

- integração

- Inteligência

- interativo

- interseção

- para dentro

- iot

- Irlanda

- IT

- ESTÁ

- Trabalho

- juntando

- jpg

- json

- Chave

- Saber

- grande

- Latência

- mais tarde

- conduzir

- líderes

- Leads

- APRENDER

- aprendizagem

- Line

- carregar

- carregador

- carregamento

- local

- longo

- máquina

- aprendizado de máquina

- Maioria

- fazer

- gerenciados

- Gerente

- gestão

- mapa,

- mapas

- médico

- Conheça

- membro

- metadados

- Métrica

- Minutos

- ML

- Moda

- modelo

- modelos

- Módulos

- momentos

- Monitore

- mais

- Ponto de extremidade multimodelo

- múltiplo

- nativo

- você merece...

- rede

- redes

- Novo

- não

- nenhum

- Norte

- caderno

- notável

- Nvidia

- objeto

- of

- Oferece

- on

- ONE

- só

- aberto

- rede aberta

- open source

- Operações

- operador

- operadores

- otimizado

- Opção

- Opções

- or

- Oregon

- OS

- Outros

- saída

- Acima de

- próprio

- pacote

- pacotes

- acondicionamento

- par

- Paralelo

- paixão

- apaixonado

- caminho

- padrões

- atuação

- permissão

- Farmacêutica

- phd

- oleoduto

- pixels

- plataforma

- platão

- Inteligência de Dados Platão

- PlatãoData

- jogar

- mais

- Popular

- Publique

- alimentado

- atribuições

- prática

- Previsões

- preparado

- anterior

- anteriormente

- Diretor

- princípios

- processo

- Processado

- processos

- em processamento

- Produto

- gerente de produto

- Produção

- projeto

- Propriedades

- fornece

- empurrado

- Python

- pytorch

- em tempo real

- Realidade

- receber

- Vermelho

- Red Hat

- reduzir

- referir

- região

- regiões

- relações

- representação

- solicitar

- pedidos

- Requisitos

- exige

- pesquisa

- pesquisadores

- Recursos

- resposta

- responsável

- retorno

- reutilizável

- Execute

- corrida

- s

- SaaS

- sábio

- Inferência do SageMaker

- mesmo

- Salvar

- Poupança

- AMPLIAR

- escalável

- Escala

- dimensionamento

- Ciência

- Sdk

- desatado

- Seção

- segurança

- segmentação

- doadores,

- AUTO

- senior

- Série

- servido

- serviço

- Serviços

- Conjuntos

- contexto

- vários

- formas

- compartilhado

- rede de apoio social

- mostrou

- mostrando

- simples

- tamanhos

- sem problemas

- futebol

- Software

- Engenharia de software

- solução

- Soluções

- fonte

- especializada

- especificação

- gasto

- padrões

- Passo

- Passos

- armazenamento

- loja

- armazenadas

- Tanga

- tal

- ajuda

- Apoiar

- sydney

- sistemas

- toma

- Profissionais

- Tecnologia

- ensaio

- do que

- que

- A

- deles

- Eles

- então

- Lá.

- Este

- isto

- Através da

- vezes

- para

- juntos

- ferramentas

- para

- tráfego

- Tritão

- verdadeiro

- tentar

- VIRAR

- dois

- onipresente

- universidade

- Atualizar

- usar

- usava

- Utilizador

- usos

- utilização

- utilidade

- variedade

- versões

- vendo

- Virgínia

- visão

- visualização

- visualizar

- volumes

- W

- andar

- queremos

- we

- web

- serviços web

- Web-Based

- BEM

- O Quê

- quando

- qual

- precisarão

- de

- dentro

- sem

- Atividades:

- trabalhou

- de gestão de documentos

- fluxos de trabalho

- trabalhar

- Grupo de trabalho

- anos

- Vocês

- investimentos

- zefirnet

- zero