Quando um cliente tem um produto pronto para produção processamento inteligente de documentos (IDP), frequentemente recebemos solicitações de uma revisão do Well-Architected. Para construir uma solução empresarial, os recursos do desenvolvedor, o custo, o tempo e a experiência do usuário devem ser equilibrados para alcançar o resultado comercial desejado. O Estrutura bem arquitetada da AWS fornece uma maneira sistemática para as organizações aprenderem as melhores práticas operacionais e arquitetônicas para projetar e operar cargas de trabalho confiáveis, seguras, eficientes, econômicas e sustentáveis na nuvem.

O IDP Well-Architected Custom Lens segue o AWS Well-Architected Framework, analisando a solução com seis pilares com a granularidade de um caso de uso específico de IA ou machine learning (ML) e fornecendo orientação para enfrentar desafios comuns. A lente personalizada bem arquitetada do IDP no Ferramenta bem arquitetada contém perguntas sobre cada um dos pilares. Ao responder a essas perguntas, você poderá identificar riscos potenciais e resolvê-los seguindo seu plano de melhoria.

Esta postagem se concentra no Pilar de eficiência de desempenho da carga de trabalho do PDI. Nós nos aprofundamos no projeto e na implementação da solução para otimizar o rendimento, a latência e o desempenho geral. Começamos discutindo alguns indicadores comuns que você deve conduzir uma revisão Well-Architected e apresentando as abordagens fundamentais com princípios de design. Em seguida, examinamos cada área de foco de uma perspectiva técnica.

Para acompanhar esta postagem, você deve estar familiarizado com as postagens anteriores desta série (Parte 1 e Parte 2) e as diretrizes em Orientação para processamento inteligente de documentos na AWS. Esses recursos apresentam serviços comuns da AWS para cargas de trabalho de IDP e fluxos de trabalho sugeridos. Com esse conhecimento, agora você está pronto para aprender mais sobre como produzir sua carga de trabalho.

indicadores comuns

A seguir estão indicadores comuns de que você deve conduzir uma revisão da Estrutura Bem Arquitetada para o pilar Eficiência de Desempenho:

- Alta latência – Quando a latência do reconhecimento óptico de caracteres (OCR), do reconhecimento de entidades ou do fluxo de trabalho de ponta a ponta demora mais do que o benchmark anterior, isso pode ser um indicador de que o design da arquitetura não cobre testes de carga ou tratamento de erros.

- Estrangulamento frequente – Você pode enfrentar limitação por serviços da AWS como amazontext devido aos limites de solicitação. Isso significa que a arquitetura precisa ser ajustada por meio da revisão do fluxo de trabalho da arquitetura, da implementação síncrona e assíncrona, do cálculo de transações por segundo (TPS) e muito mais.

- Dificuldades de depuração – Quando há uma falha no processo de documento, você pode não ter uma forma eficaz de identificar onde o erro está localizado no fluxo de trabalho, a qual serviço ele está relacionado e por que a falha ocorreu. Isso significa que o sistema não tem visibilidade de logs e falhas. Considere revisitar o design de registo dos dados de telemetria e adicionar infraestrutura como código (IaC), como pipelines de processamento de documentos, à solução.

| indicadores | Descrição | Lacuna Arquitetônica |

| Alta latência | OCR, reconhecimento de entidade ou latência de fluxo de trabalho de ponta a ponta excede o benchmark anterior |

|

| Estrangulamento frequente | Limitação por serviços da AWS como Amazon Textract devido a limites de solicitação |

|

| Difícil de depurar | Sem visibilidade da localização, causa e motivo das falhas no processamento de documentos |

|

Princípios de design

Nesta postagem, discutimos três princípios de design: delegação de tarefas complexas de IA, arquiteturas IaC e arquiteturas sem servidor. Ao encontrar uma solução de compromisso entre duas implementações, você pode revisitar os princípios de design com as prioridades de negócios da sua organização para poder tomar decisões com eficácia.

- Delegar tarefas complexas de IA – Você pode permitir uma adoção mais rápida de IA em sua organização transferindo o ciclo de vida de desenvolvimento do modelo de ML para serviços gerenciados e aproveitando o desenvolvimento de modelo e a infraestrutura fornecidos pela AWS. Em vez de exigir que suas equipes de ciência de dados e de TI criem e mantenham modelos de IA, você pode usar serviços de IA pré-treinados que podem automatizar tarefas para você. Isso permite que suas equipes se concentrem em trabalhos de maior valor que diferenciam seus negócios, enquanto o provedor de nuvem lida com a complexidade de treinamento, implantação e dimensionamento dos modelos de IA.

- Arquiteturas IaC – Ao executar uma solução IDP, a solução inclui vários serviços de IA para executar o fluxo de trabalho de ponta a ponta cronologicamente. Você pode arquitetar a solução com pipelines de fluxo de trabalho usando Funções de etapa da AWS para aprimorar a tolerância a falhas, processamento paralelo, visibilidade e escalabilidade. Essas vantagens podem permitir otimizar o uso e o custo dos serviços de IA subjacentes.

- Serverless Arquiteturas – O IDP costuma ser uma solução orientada a eventos, iniciada por uploads de usuários ou trabalhos agendados. A solução pode ser ampliada horizontalmente aumentando as taxas de chamadas para os serviços de IA, AWS Lambdae outros serviços envolvidos. Uma abordagem sem servidor oferece escalabilidade sem provisionamento excessivo de recursos, evitando despesas desnecessárias. O monitoramento por trás do design sem servidor auxilia na detecção de problemas de desempenho.

Figura 1. O benefício da aplicação dos princípios de design.

Com esses três princípios de design em mente, as organizações podem estabelecer uma base eficaz para a adoção de IA/ML em plataformas de nuvem. Ao delegar complexidade, implementar infraestrutura resiliente e projetar em escala, as organizações podem otimizar suas soluções de IA/ML.

Nas seções a seguir, discutimos como enfrentar desafios comuns em relação às áreas de foco técnico.

Áreas de foco

Ao analisar a eficiência do desempenho, analisamos a solução a partir de cinco áreas de foco: design de arquitetura, gerenciamento de dados, tratamento de erros, monitoramento de sistema e monitoramento de modelo. Com essas áreas de foco, você pode conduzir uma revisão da arquitetura de diferentes aspectos para aprimorar a efetividade, a observabilidade e a escalabilidade dos três componentes de um projeto, dados, modelo ou meta de negócios de IA/ML.

Projeto de arquitetura

Ao analisar as perguntas nesta área de foco, você revisará o fluxo de trabalho existente para ver se ele segue as práticas recomendadas. O fluxo de trabalho sugerido fornece um padrão comum que as organizações podem seguir e evita custos de tentativa e erro.

Com base nas arquitetura proposta, o fluxo de trabalho segue os seis estágios de captura, classificação, extração, enriquecimento, revisão e validação de dados e consumo. Nos indicadores comuns que discutimos anteriormente, dois em cada três provêm de problemas de projeto de arquitetura. Isso ocorre porque ao iniciar um projeto com uma abordagem improvisada, você poderá encontrar restrições do projeto ao tentar alinhar sua infraestrutura à sua solução. Com a revisão do projeto de arquitetura, o projeto improvisado pode ser desacoplado em etapas, e cada uma delas pode ser reavaliada e reordenada.

Você pode economizar tempo, dinheiro e trabalho implementando classificações no seu fluxo de trabalho e os documentos vão para aplicativos downstream e APIs com base no tipo de documento. Isso melhora a observabilidade do processo do documento e facilita a manutenção da solução ao adicionar novos tipos de documentos.

Gestão de dados

O desempenho de uma solução IDP inclui latência, rendimento e experiência do usuário de ponta a ponta. Como gerenciar o documento e suas informações extraídas na solução é a chave para a consistência, segurança e privacidade dos dados. Além disso, a solução deve lidar com grandes volumes de dados com baixa latência e alto rendimento.

Ao analisar as questões desta área de foco, você revisará o fluxo de trabalho do documento. Isso inclui ingestão de dados, pré-processamento de dados, conversão de documentos em tipos de documentos aceitos pelo Amazon Textract, tratamento de fluxos de documentos recebidos, roteamento de documentos por tipo e implementação de controle de acesso e políticas de retenção.

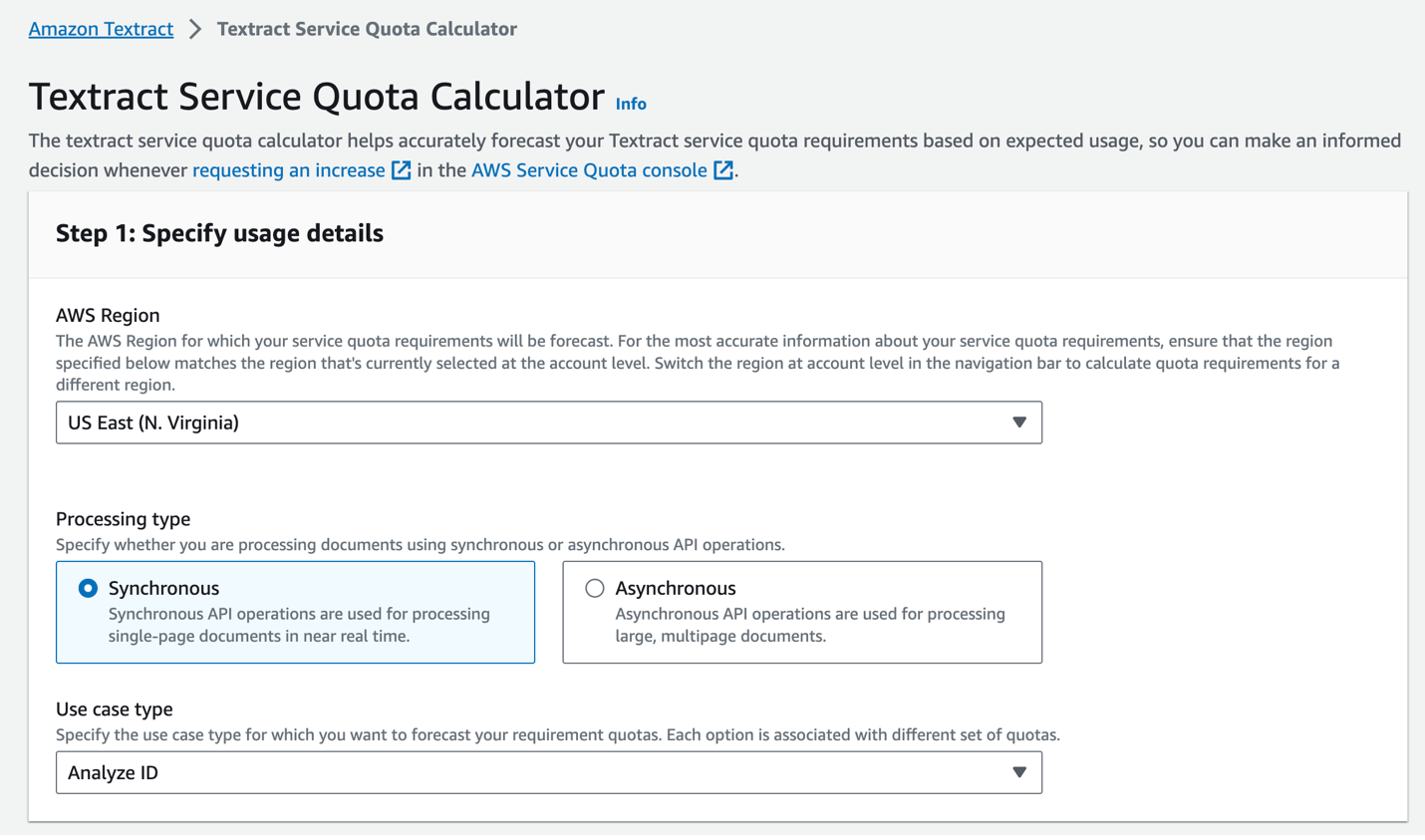

Por exemplo, ao armazenar um documento nas diferentes fases processadas, é possível reverter o processamento para a etapa anterior, se necessário. O ciclo de vida dos dados garante a confiabilidade e a conformidade da carga de trabalho. Ao usar o Calculadora de cotas do Amazon Textract Service (veja a captura de tela a seguir), recursos assíncronos no Amazon Textract, Lambda, Step Functions, Serviço de fila simples da Amazon (Amazon SQS) e Serviço de notificação simples da Amazon (Amazon SNS), as organizações podem automatizar e dimensionar tarefas de processamento de documentos para atender às necessidades específicas de carga de trabalho.

Figura 2. Calculadora de cotas do Amazon Textract Service.

Tratamento de erros

O tratamento robusto de erros é fundamental para rastrear o status do processo de documentos e fornece à equipe de operação tempo para reagir a quaisquer comportamentos anormais, como volumes de documentos inesperados, novos tipos de documentos ou outros problemas não planejados de serviços de terceiros. Do ponto de vista da organização, o tratamento adequado de erros pode melhorar o tempo de atividade e o desempenho do sistema.

Você pode dividir o tratamento de erros em dois aspectos principais:

- Configuração do serviço AWS – Você pode implementar lógica de repetição com espera exponencial para lidar com erros transitórios, como limitação. Quando você inicia o processamento chamando uma operação assíncrona Start*, como IniciarDocumentoTextoDetecção, você pode especificar que o status de conclusão da solicitação seja publicado em um tópico do SNS no arquivo Canal de Notificação configuração. Isso ajuda a evitar limites de limitação nas chamadas de API devido à pesquisa das APIs Get*. Você também pode implementar alarmes em Amazon CloudWatch e gatilhos para alertar quando ocorrerem picos de erros incomuns.

- Aprimoramento do relatório de erros – Inclui mensagens detalhadas com um nível apropriado de detalhe por tipo de erro e descrições de respostas de tratamento de erros. Com a configuração adequada de tratamento de erros, os sistemas podem ser mais resilientes implementando padrões comuns, como repetição automática de erros intermitentes, uso de disjuntores para lidar com falhas em cascata e serviços de monitoramento para obter insights sobre erros. Isso permite que a solução equilibre os limites de novas tentativas e evita loops de circuito sem fim.

Monitoramento de modelo

O desempenho dos modelos de ML é monitorado quanto à degradação ao longo do tempo. À medida que os dados e as condições do sistema mudam, as métricas de desempenho e eficiência do modelo são rastreadas para garantir que o retreinamento seja realizado quando necessário.

O modelo de ML em um fluxo de trabalho IDP pode ser um modelo de OCR, um modelo de reconhecimento de entidade ou um modelo de classificação. O modelo pode vir de um serviço AWS AI, um modelo de código aberto em Amazon Sage Maker, Rocha Amazônicaou outros serviços de terceiros. Você deve compreender as limitações e os casos de uso de cada serviço para identificar maneiras de melhorar o modelo com feedback humano e melhorar o desempenho do serviço ao longo do tempo.

Uma abordagem comum é usar logs de serviço para compreender diferentes níveis de precisão. Esses logs podem ajudar a equipe de ciência de dados a identificar e compreender qualquer necessidade de retreinamento do modelo. Sua organização pode escolher o mecanismo de reciclagem – pode ser trimestral, mensal ou com base em métricas científicas, como quando a precisão cai abaixo de um determinado limite.

O objetivo do monitoramento não é apenas detectar problemas, mas fechar o ciclo para refinar continuamente os modelos e manter o desempenho da solução IDP à medida que o ambiente externo evolui.

Monitoramento do sistema

Depois de implantar a solução IDP em produção, é importante monitorar as principais métricas e o desempenho da automação para identificar áreas de melhoria. As métricas devem incluir métricas de negócios e métricas técnicas. Isso permite que a empresa avalie o desempenho do sistema, identifique problemas e faça melhorias em modelos, regras e fluxos de trabalho ao longo do tempo para aumentar a taxa de automação e compreender o impacto operacional.

Do lado comercial, métricas como precisão de extração de campos importantes, taxa geral de automação que indica a porcentagem de documentos processados sem intervenção humana e tempo médio de processamento por documento são fundamentais. Essas métricas de negócios ajudam a quantificar a experiência do usuário final e os ganhos de eficiência operacional.

Métricas técnicas, incluindo taxas de erros e exceções que ocorrem em todo o fluxo de trabalho, são essenciais para serem rastreadas do ponto de vista da engenharia. As métricas técnicas também podem monitorar cada nível de ponta a ponta e fornecer uma visão abrangente de uma carga de trabalho complexa. Você pode dividir as métricas em diferentes níveis, como nível de solução, nível de fluxo de trabalho ponta a ponta, nível de tipo de documento, nível de documento, nível de reconhecimento de entidade e nível de OCR.

Agora que revisou todas as questões deste pilar, você pode avaliar os outros pilares e desenvolver um plano de melhoria para sua carga de trabalho de PDI.

Conclusão

Nesta postagem, discutimos indicadores comuns que você pode precisar para realizar uma revisão da estrutura bem arquitetada para o pilar de eficiência de desempenho para sua carga de trabalho de deslocados internos. Em seguida, percorremos os princípios de design para fornecer uma visão geral de alto nível e discutir o objetivo da solução. Seguindo essas sugestões em referência à lente personalizada bem arquitetada do IDP e revisando as questões por área de foco, você deverá agora ter um plano de melhoria do projeto.

Sobre os autores

Mia Chang é arquiteto de soluções especialista em ML da Amazon Web Services. Ela trabalha com clientes na EMEA e compartilha práticas recomendadas para executar cargas de trabalho de IA/ML na nuvem com sua experiência em matemática aplicada, ciência da computação e IA/ML. Ela se concentra em cargas de trabalho específicas de PNL e compartilha sua experiência como palestrante em conferências e autora de livros. Em seu tempo livre, ela gosta de fazer caminhadas, jogos de tabuleiro e preparar café.

Mia Chang é arquiteto de soluções especialista em ML da Amazon Web Services. Ela trabalha com clientes na EMEA e compartilha práticas recomendadas para executar cargas de trabalho de IA/ML na nuvem com sua experiência em matemática aplicada, ciência da computação e IA/ML. Ela se concentra em cargas de trabalho específicas de PNL e compartilha sua experiência como palestrante em conferências e autora de livros. Em seu tempo livre, ela gosta de fazer caminhadas, jogos de tabuleiro e preparar café.

Brijesh Pati é arquiteto de soluções empresariais na AWS. Seu foco principal é ajudar clientes empresariais a adotar tecnologias de nuvem para suas cargas de trabalho. Ele tem experiência em desenvolvimento de aplicativos e arquitetura empresarial e trabalhou com clientes de diversos setores, como esportes, finanças, energia e serviços profissionais. Seus interesses incluem arquiteturas sem servidor e IA/ML.

Brijesh Pati é arquiteto de soluções empresariais na AWS. Seu foco principal é ajudar clientes empresariais a adotar tecnologias de nuvem para suas cargas de trabalho. Ele tem experiência em desenvolvimento de aplicativos e arquitetura empresarial e trabalhou com clientes de diversos setores, como esportes, finanças, energia e serviços profissionais. Seus interesses incluem arquiteturas sem servidor e IA/ML.

Rui Cardoso é arquiteto de soluções parceiras da Amazon Web Services (AWS). Ele está se concentrando em IA/ML e IoT. Ele trabalha com parceiros AWS e os apoia no desenvolvimento de soluções na AWS. Quando não está trabalhando, gosta de andar de bicicleta, fazer caminhadas e aprender coisas novas.

Rui Cardoso é arquiteto de soluções parceiras da Amazon Web Services (AWS). Ele está se concentrando em IA/ML e IoT. Ele trabalha com parceiros AWS e os apoia no desenvolvimento de soluções na AWS. Quando não está trabalhando, gosta de andar de bicicleta, fazer caminhadas e aprender coisas novas.

Tim Condello é arquiteto sênior de soluções especializadas em inteligência artificial (IA) e aprendizado de máquina (ML) na Amazon Web Services (AWS). Seu foco é processamento de linguagem natural e visão computacional. Tim gosta de pegar as ideias dos clientes e transformá-las em soluções escalonáveis.

Tim Condello é arquiteto sênior de soluções especializadas em inteligência artificial (IA) e aprendizado de máquina (ML) na Amazon Web Services (AWS). Seu foco é processamento de linguagem natural e visão computacional. Tim gosta de pegar as ideias dos clientes e transformá-las em soluções escalonáveis.

Sherry Ding é arquiteto sênior de soluções especializadas em inteligência artificial (IA) e aprendizado de máquina (ML) na Amazon Web Services (AWS). Ela tem vasta experiência em aprendizado de máquina com doutorado em ciência da computação. Ela trabalha principalmente com clientes do setor público em vários desafios de negócios relacionados à IA/ML, ajudando-os a acelerar sua jornada de aprendizado de máquina na Nuvem AWS. Quando não está atendendo os clientes, ela gosta de atividades ao ar livre.

Sherry Ding é arquiteto sênior de soluções especializadas em inteligência artificial (IA) e aprendizado de máquina (ML) na Amazon Web Services (AWS). Ela tem vasta experiência em aprendizado de máquina com doutorado em ciência da computação. Ela trabalha principalmente com clientes do setor público em vários desafios de negócios relacionados à IA/ML, ajudando-os a acelerar sua jornada de aprendizado de máquina na Nuvem AWS. Quando não está atendendo os clientes, ela gosta de atividades ao ar livre.

Suyin Wang é arquiteto de soluções especialista em IA/ML na AWS. Ela tem formação interdisciplinar em aprendizado de máquina, serviços de informações financeiras e economia, além de anos de experiência na construção de aplicativos de ciência de dados e aprendizado de máquina que resolveram problemas de negócios do mundo real. Ela gosta de ajudar os clientes a identificar as questões de negócios certas e a construir as soluções certas de IA/ML. Nas horas vagas, ela adora cantar e cozinhar.

Suyin Wang é arquiteto de soluções especialista em IA/ML na AWS. Ela tem formação interdisciplinar em aprendizado de máquina, serviços de informações financeiras e economia, além de anos de experiência na construção de aplicativos de ciência de dados e aprendizado de máquina que resolveram problemas de negócios do mundo real. Ela gosta de ajudar os clientes a identificar as questões de negócios certas e a construir as soluções certas de IA/ML. Nas horas vagas, ela adora cantar e cozinhar.

- Conteúdo com tecnologia de SEO e distribuição de relações públicas. Seja amplificado hoje.

- PlatoData.Network Gerativa Vertical Ai. Capacite-se. Acesse aqui.

- PlatoAiStream. Inteligência Web3. Conhecimento Amplificado. Acesse aqui.

- PlatãoESG. Carbono Tecnologia Limpa, Energia, Ambiente, Solar, Gestão de resíduos. Acesse aqui.

- PlatoHealth. Inteligência em Biotecnologia e Ensaios Clínicos. Acesse aqui.

- Fonte: https://aws.amazon.com/blogs/machine-learning/build-well-architected-idp-solutions-with-a-custom-lens-part-4-performance-efficiency/

- :tem

- :é

- :não

- :onde

- 1

- 10

- 100

- 32

- 7

- 8

- a

- Sobre

- acelerar

- aceito

- Acesso

- precisão

- Alcançar

- atividades

- acrescentando

- Adicionalmente

- endereço

- Ajustado

- adotar

- Adoção

- Vantagem

- vantagens

- AI

- Modelos de IA

- Serviços de IA

- AI / ML

- Alertar

- alinhar

- Todos os Produtos

- permite

- juntamente

- tb

- Amazon

- amazontext

- Amazon Web Services

- Amazon Web Services (AWS)

- an

- e

- e infra-estrutura

- qualquer

- api

- APIs

- Aplicação

- Desenvolvimento de Aplicações

- aplicações

- aplicado

- Aplicando

- abordagem

- se aproxima

- apropriado

- arquitetônico

- arquitetura

- SOMOS

- ÁREA

- áreas

- artificial

- inteligência artificial

- Inteligência artificial (AI)

- AS

- aspectos

- avaliar

- ajuda

- At

- autor

- automatizar

- automaticamente

- Automação

- média

- evitar

- AWS

- fundo

- Equilíbrio

- balanced

- baseado

- BE

- Porque

- comportamentos

- atrás

- abaixo

- referência

- beneficiar

- MELHOR

- melhores práticas

- entre

- borda

- Board Games

- livro

- Break

- construir

- Prédio

- negócio

- mas a

- by

- Cálculo

- chamada

- chamada

- chamadas

- CAN

- capturar

- casas

- casos

- Causar

- desafios

- alterar

- personagem

- reconhecimento de caracteres

- Escolha

- classificação

- encerramento

- Na nuvem

- código

- Café

- como

- comum

- Empresa

- realização

- integrações

- complexidade

- compliance

- componentes

- compreensivo

- computador

- Ciência da Computação

- Visão de Computador

- condições

- Conduzir

- Conferência

- Configuração

- Considerar

- consumo

- contém

- continuamente

- ao controle

- conversão

- Custo

- relação custo-benefício

- custos

- cobrir

- crítico

- personalizadas

- cliente

- Clientes

- dados,

- gestão de dados

- ciência de dados

- decisões

- desacoplado

- profundo

- Grau

- implantar

- Implantação

- Design

- princípios de design

- concepção

- desejado

- detalhe

- detalhado

- desenvolver

- Developer

- em desenvolvimento

- Desenvolvimento

- diferente

- dificuldades

- discutir

- discutido

- discutir

- mergulho

- documento

- processo de documento

- INSTITUCIONAIS

- Não faz

- down

- Drops

- dois

- cada

- Mais cedo

- Economia

- Educação

- Eficaz

- efetivamente

- eficiência

- eficiente

- EMEA

- permitir

- final

- end-to-end

- energia

- Engenharia

- aumentar

- Melhora

- enriquecimento

- garantir

- garante

- Empreendimento

- entidade

- Meio Ambiente

- erro

- erros

- essencial

- estabelecer

- avaliar

- evolui

- exemplo

- excede

- exceção

- existente

- despesas

- vasta experiência

- exponencial

- extenso

- Experiência Extensiva

- externo

- Extração

- Falha

- falhas

- familiar

- mais rápido

- Funcionalidades

- retornos

- Campos

- Figura

- financiar

- financeiro

- informação financeira

- cinco

- Foco

- concentra-se

- focando

- seguir

- seguinte

- segue

- Escolha

- Foundation

- Quadro

- Gratuito

- da

- funções

- fundamental

- Ganho

- Ganhos

- Games

- dado

- Go

- meta

- vai

- orientações

- orientações

- manipular

- Alças

- Manipulação

- Ter

- he

- ajudar

- ajuda

- ajuda

- sua experiência

- Alta

- de alto nível

- sua

- horizontalmente

- Como funciona o dobrador de carta de canal

- Como Negociar

- HTML

- http

- HTTPS

- humano

- idéias

- identificar

- if

- Impacto

- executar

- implementação

- implementações

- implementação

- importante

- melhorar

- melhoria

- melhorias

- in

- incluir

- inclui

- Incluindo

- Entrada

- Crescimento

- aumentando

- Indicador

- indicadores

- indústrias

- INFORMAÇÕES

- Infraestrutura

- iniciado

- introspecção

- Inteligência

- Inteligente

- Processamento inteligente de documentos

- interesses

- da intervenção

- para dentro

- introduzir

- envolvido

- iot

- questões

- IT

- ESTÁ

- Empregos

- viagem

- jpg

- apenas por

- Guarda

- Chave

- Conhecimento

- trabalho

- língua

- Latência

- APRENDER

- aprendizagem

- Nível

- níveis

- wifecycwe

- como

- limitações

- limites

- carregar

- localizado

- localização

- logging

- lógica

- mais

- ama

- Baixo

- máquina

- aprendizado de máquina

- principalmente

- a manter

- fazer

- FAZ

- gerencia

- gerenciados

- de grupos

- matemática

- Posso..

- significa

- Conheça

- mensagens

- Métrica

- mente

- ML

- modelo

- modelos

- dinheiro

- Monitore

- monitorados

- monitoração

- mensal

- mais

- múltiplo

- devo

- natural

- Processamento de linguagem natural

- você merece...

- necessário

- Cria

- Novo

- notificação

- agora

- ocorreu

- ocorrendo

- OCR

- of

- frequentemente

- on

- aberto

- open source

- operando

- operação

- operacional

- reconhecimento de caracteres ópticos

- Otimize

- or

- ordem

- organização

- organizações

- Outros

- Fora

- Resultado

- Acima de

- global

- Visão geral

- Paralelo

- Supremo

- parte

- parceiro

- Parceiros

- padrão

- padrões

- para

- percentagem

- Realizar

- atuação

- realizada

- realização

- perspectiva

- phd

- Pilar

- pilares

- plano

- Plataformas

- platão

- Inteligência de Dados Platão

- PlatãoData

- políticas

- Publique

- POSTAGENS

- potencial

- práticas

- impedindo

- impede

- anterior

- primário

- princípios

- política de privacidade

- problemas

- processo

- Processado

- em processamento

- Produção

- profissional

- projeto

- adequado

- fornecer

- fornecido

- provedor

- fornece

- fornecendo

- público

- publicado

- Frequentes

- Taxa

- Preços

- em vez

- Reagir

- pronto

- mundo real

- razão

- receber

- reconhecimento

- referência

- refinar

- em relação a

- Saudações

- relacionado

- confiabilidade

- confiável

- Denunciar

- solicitar

- pedidos

- resiliente

- resolver

- Recursos

- respostas

- retenção

- reverso

- rever

- Comentários

- revendo

- certo

- riscos

- roteamento

- regras

- corrida

- Salvar

- AMPLIAR

- escalável

- Escala

- dimensionamento

- programado

- Trabalhos agendados

- Ciência

- Segundo

- seções

- setor

- seguro

- segurança

- Vejo

- senior

- Série

- Serverless

- serviço

- Serviços

- instalação

- ações

- ela

- rede de apoio social

- lado

- simples

- SIX

- So

- solução

- Soluções

- alguns

- fonte

- Palestrantes

- especialista

- específico

- picos

- Esportes

- Estágio

- começo

- Status

- Passo

- armazenar

- franco

- córregos

- tal

- ajuda

- sustentável

- .

- sistemas

- equipamento

- toma

- tomar

- tarefas

- Profissionais

- equipes

- Dados Técnicos:

- Tecnologias

- ensaio

- do que

- que

- A

- deles

- Eles

- então

- Este

- coisas

- De terceiros

- isto

- três

- limiar

- Através da

- todo

- Taxa de transferência

- Tim

- tempo

- para

- tolerância

- tópico

- tps

- pista

- Rastreamento

- Training

- Transações

- tentando

- Passando

- dois

- tipo

- tipos

- subjacente

- compreender

- Inesperado

- desnecessário

- uptime

- Uso

- usar

- caso de uso

- Utilizador

- Experiência do Usuário

- utilização

- validação

- vário

- Ver

- visibilidade

- visão

- volumes

- vs

- caminhou

- Caminho..

- maneiras

- we

- web

- serviços web

- quando

- qual

- enquanto

- porque

- precisarão

- de

- sem

- Atividades:

- trabalhou

- de gestão de documentos

- fluxos de trabalho

- trabalhar

- trabalho

- anos

- Vocês

- investimentos

- zefirnet