A inferência em lote é um padrão comum em que as solicitações de previsão são agrupadas em lote na entrada, um trabalho é executado para processar essas solicitações em um modelo treinado e a saída inclui respostas de previsão em lote que podem ser consumidas por outros aplicativos ou funções de negócios. A execução de casos de uso em lote em ambientes de produção requer um processo repetível para retreinamento do modelo, bem como inferência em lote. Esse processo também deve incluir o monitoramento desse modelo para medir o desempenho ao longo do tempo.

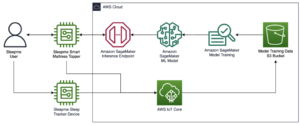

Nesta postagem, mostramos como criar pipelines repetíveis para seus casos de uso em lote usando Pipelines Amazon SageMaker, Registro de modelo do Amazon SageMaker, Trabalhos de transformação em lote do SageMaker e Monitor de modelo do Amazon SageMaker. Esta solução destaca a capacidade de usar os recursos totalmente gerenciados dentro MLOps do SageMaker para reduzir a sobrecarga operacional por meio de recursos totalmente gerenciados e integrados.

Visão geral da solução

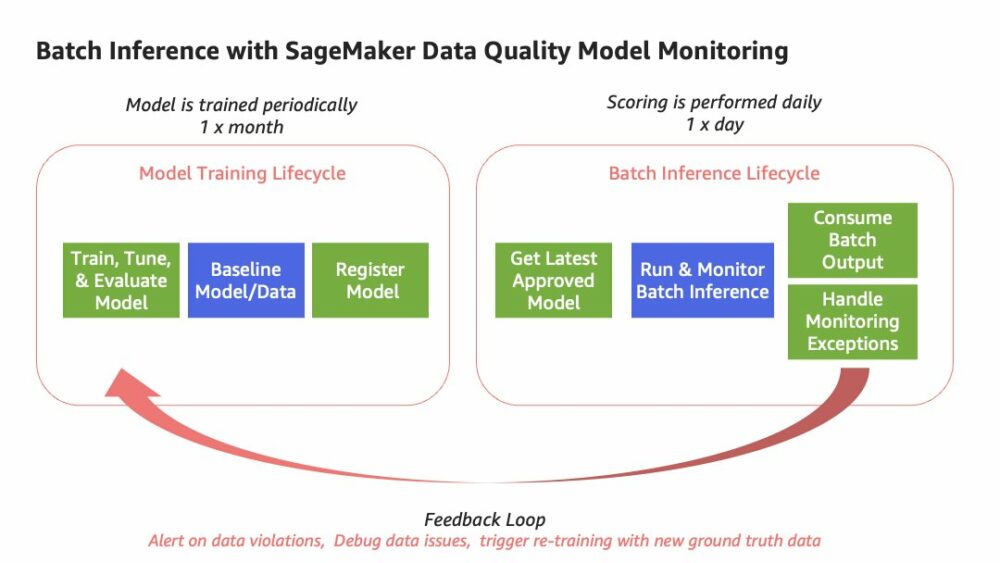

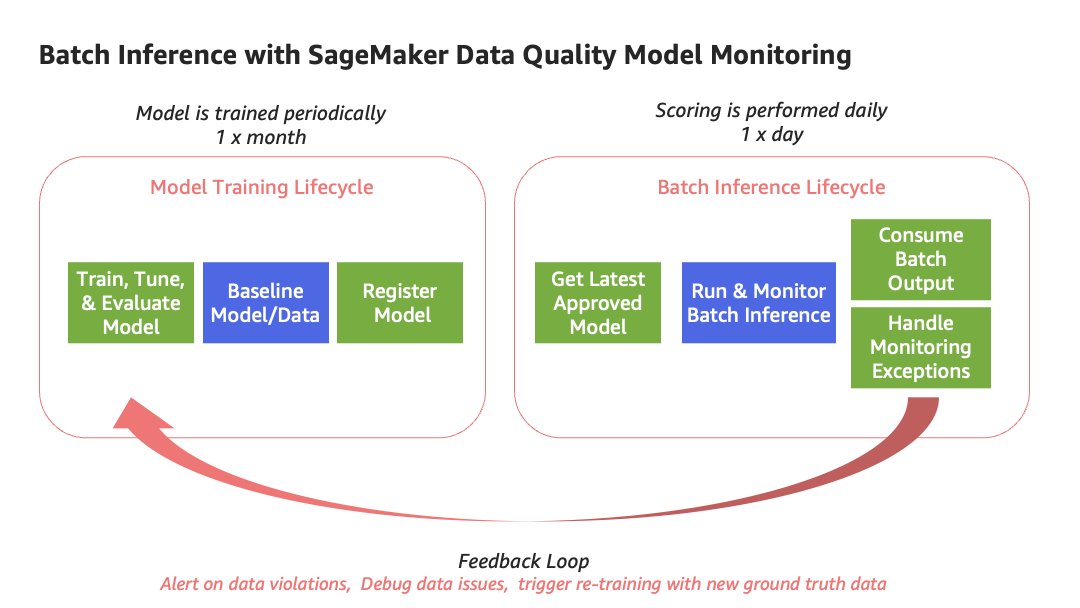

Existem vários cenários para executar a inferência em lote. Em alguns casos, você pode treinar novamente seu modelo toda vez que executar a inferência em lote. Como alternativa, você pode estar treinando seu modelo com menos frequência do que realizando inferência em lote. Neste post, nos concentramos no segundo cenário. Para este exemplo, vamos supor que você tenha um modelo treinado periodicamente, aproximadamente uma vez por mês. No entanto, a inferência em lote é executada diariamente em relação à versão mais recente do modelo. Este é um cenário comum, no qual o ciclo de vida de treinamento do modelo é diferente do ciclo de vida de inferência em lote.

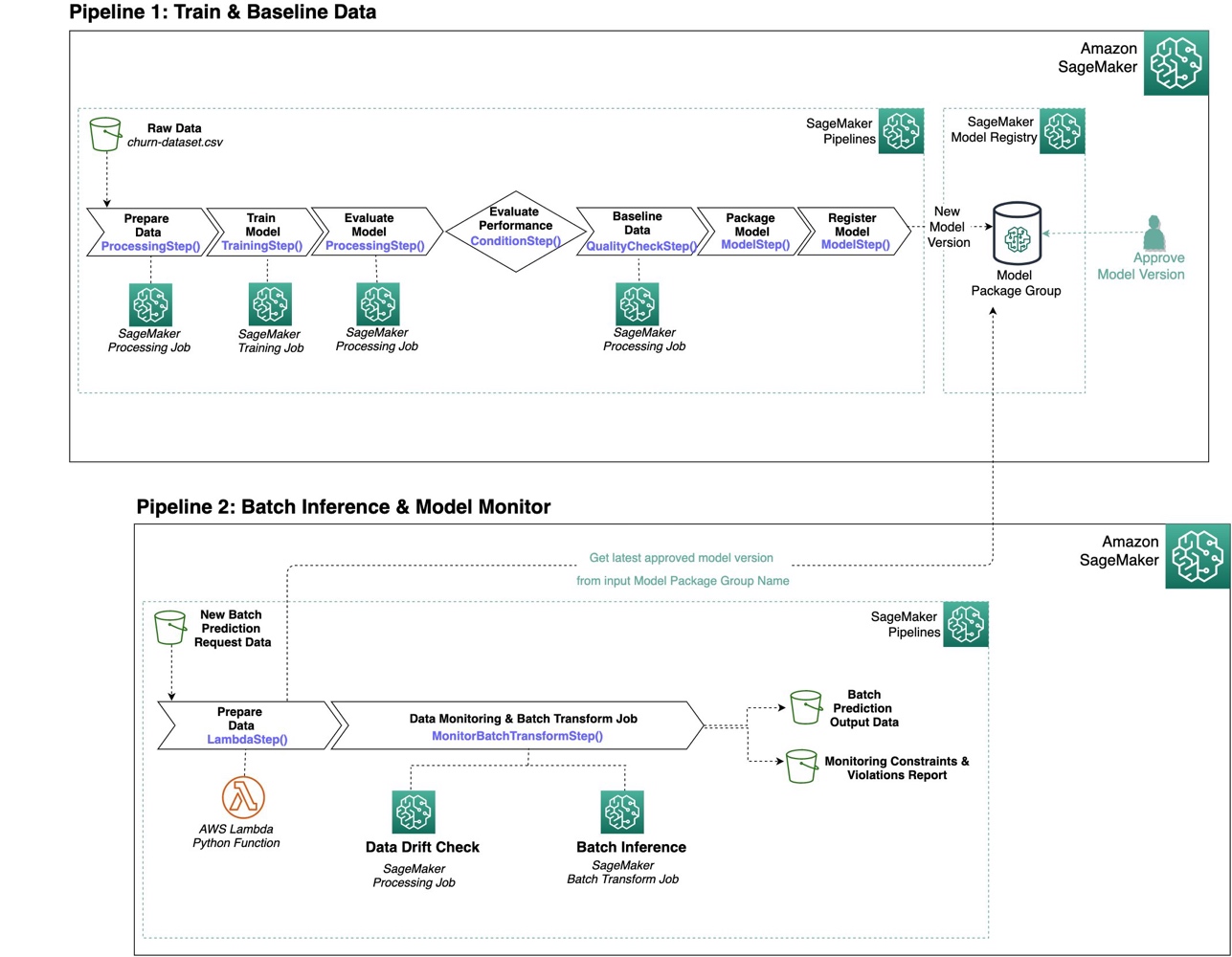

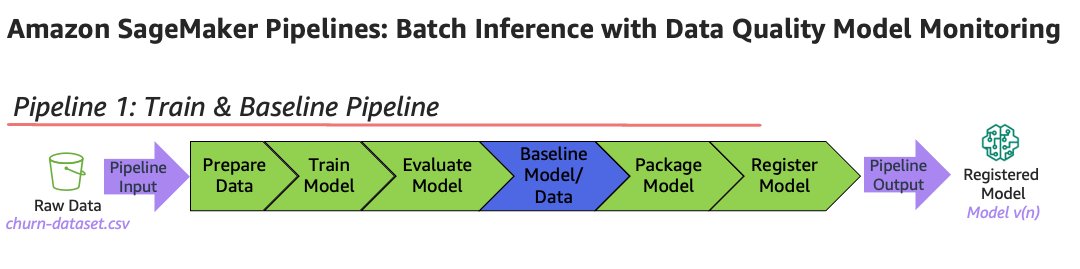

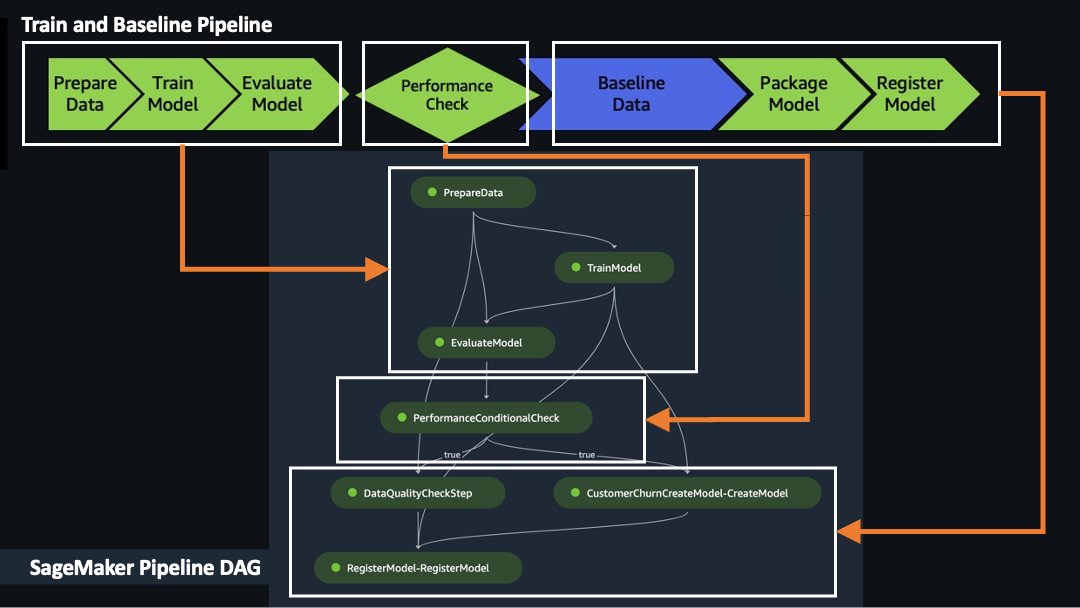

A arquitetura que oferece suporte ao cenário de lote introduzido contém dois pipelines separados do SageMaker, conforme mostrado no diagrama a seguir.

Usamos o primeiro pipeline para treinar o modelo e basear os dados de treinamento. Usamos a linha de base gerada para monitoramento contínuo no segundo pipeline. O primeiro pipeline inclui as etapas necessárias para preparar dados, treinar o modelo e avaliar o desempenho do modelo. Se o desempenho do modelo for aceitável de acordo com os critérios de avaliação, o pipeline continua com uma etapa para estabelecer a linha de base dos dados usando uma etapa integrada do SageMaker Pipelines. Para o monitor de modelo de desvio de dados tipo, a etapa de linha de base usa uma imagem de contêiner gerenciada do SageMaker para gerar estatísticas e restrições com base em seus dados de treinamento. Essa linha de base é usada para monitorar sinais de desvio de dados durante a inferência em lote. Por fim, o primeiro pipeline é concluído quando uma nova versão de modelo é registrada no registro de modelo do SageMaker. Neste ponto, o modelo pode ser aprovado automaticamente ou uma aprovação manual secundária pode ser exigida com base em uma revisão por pares do desempenho do modelo e quaisquer outros critérios identificados.

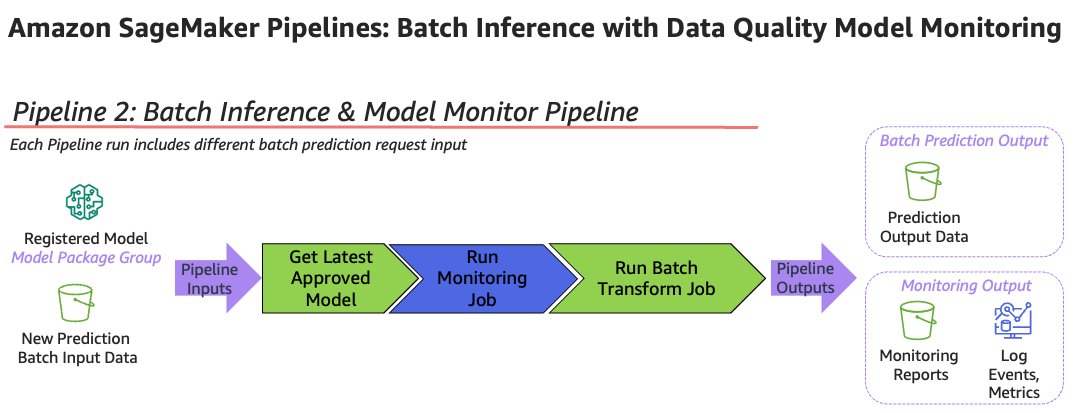

No segundo pipeline, a primeira etapa consulta o registro do modelo para obter a última versão aprovada do modelo e executa o trabalho de monitoramento de dados, que compara a linha de base de dados gerada no primeiro pipeline com os dados de entrada atuais. A etapa final no pipeline é executar a inferência em lote em relação ao modelo aprovado mais recente.

O diagrama a seguir ilustra a arquitetura da solução para cada pipeline.

Para nosso conjunto de dados, usamos um conjunto de dados sintéticos de uma operadora de telefonia móvel de telecomunicações. Este conjunto de dados de amostra contém 5,000 registros, onde cada registro usa 21 atributos para descrever o perfil do cliente. O último atributo, Churn, é o atributo que queremos que o modelo de ML preveja. O atributo de destino é binário, o que significa que o modelo prevê a saída como uma das duas categorias (True or False).

Os seguintes GitHub repo contém o código para demonstrar as etapas executadas em cada pipeline. Ele contém três notebooks: para executar a configuração inicial, para criar o trem de modelo e o pipeline de linha de base e criar a inferência em lote e o pipeline do Monitor de modelo. O repositório também inclui código-fonte Python adicional com funções auxiliares, usadas no notebook de configuração, para configurar as permissões necessárias.

Pré-requisitos

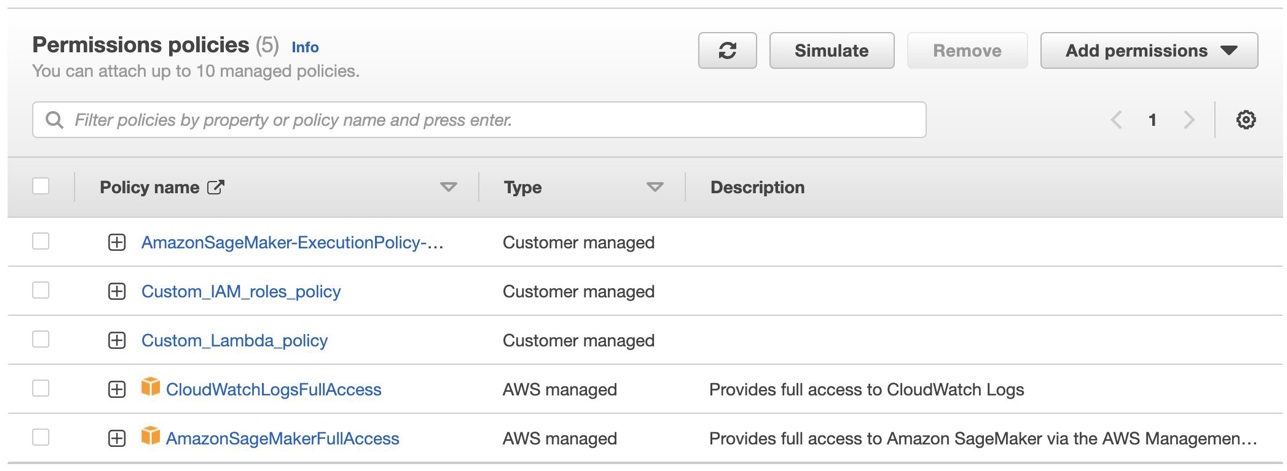

A captura de tela a seguir lista algumas políticas de permissão exigidas pela função de execução do SageMaker para o fluxo de trabalho. Você pode habilitar essas políticas de permissão por meio de Gerenciamento de acesso e identidade da AWS (IAM) permissões de função.

AmazonSageMaker-ExecutionPolicy-<...> é a função de execução associada ao usuário do SageMaker e tem as funções necessárias Serviço de armazenamento simples da Amazon (Amazon S3) políticas de balde. Custom_IAM_roles_policy e Política_Lambda_personalizada são duas políticas personalizadas criadas para dar suporte às ações necessárias para o AWS Lambda função. Para adicionar as duas políticas personalizadas, vá para a função apropriada (associada ao seu usuário do SageMaker) no IAM, clique em Adicionar permissões e depois Criar política em linha. Então escolha JSON dentro Criar política, adicione o código da política para a primeira política personalizada e salve a política. Repita o mesmo para a segunda política personalizada.

0.Setup.ipynb é um notebook de pré-requisito necessário antes de executar os notebooks 1 e 2. O código configura os caminhos S3 para entradas, saídas e artefatos de modelo do pipeline e carrega scripts usados nas etapas do pipeline. Este notebook também usa uma das funções auxiliares fornecidas, create_lambda_role, para criar uma função do Lambda que é usada no notebook 2, 2.SageMakerPipeline-ModelMonitoring-DataQuality-BatchTransform.ipynb. Veja o seguinte código:

Depois de concluir com êxito todas as tarefas no bloco de anotações de configuração, você estará pronto para criar o primeiro pipeline para treinar e definir a linha de base do modelo.

Pipeline 1: pipeline de treinamento e linha de base

Nesta seção, vamos nos aprofundar no pipeline do SageMaker usado para treinar e definir a linha de base do modelo. As etapas e o código necessários estão no 1.SageMakerPipeline-BaselineData-Train.ipynb caderno. Esse pipeline usa os dados brutos de rotatividade do cliente como entrada e, em seguida, executa as etapas necessárias para preparar os dados, treinar o modelo, avaliar o modelo, definir a linha de base do modelo e registrar o modelo no registro do modelo.

Para criar um pipeline do SageMaker, configure o trabalho subjacente (como o Processamento do SageMaker), configure as etapas do pipeline para executar o trabalho e, em seguida, configure e execute o pipeline. Concluímos as seguintes etapas:

- Configure o pipeline de construção de modelo para preparar os dados, treinar o modelo e avaliar o modelo.

- Configure a etapa de linha de base para o desvio de dados com o Model Monitor.

- Configure as etapas para empacotar o modelo e registrar a versão do modelo.

- Configure uma etapa condicional para avaliar o desempenho do modelo.

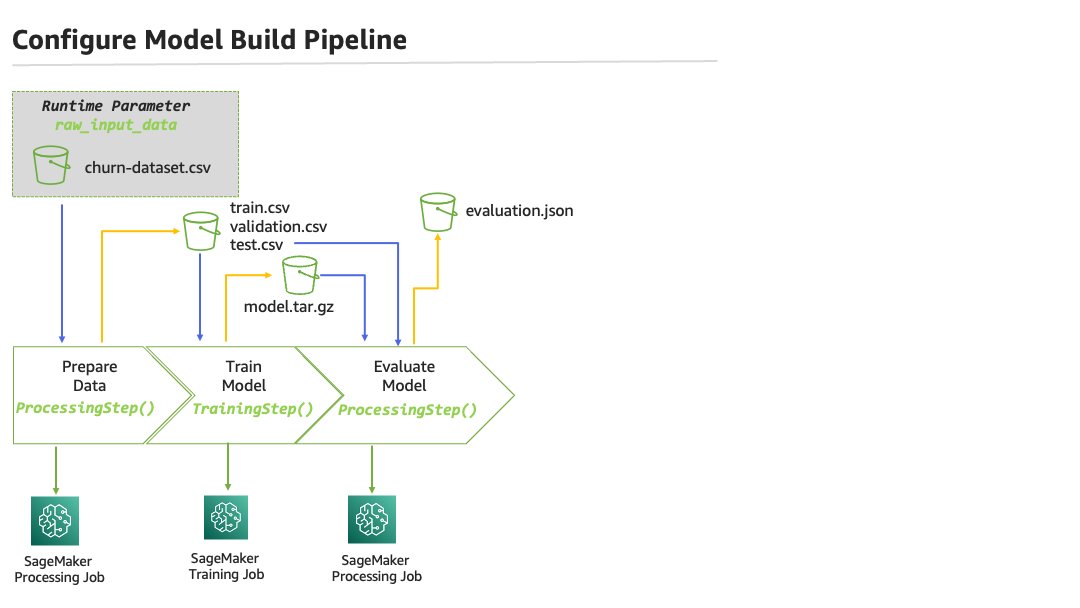

Configurar o pipeline de compilação do modelo

O pipeline de construção do modelo é um processo de três etapas:

- Prepare os dados.

- Treine o modelo.

- Avalie o modelo.

Para preparar os dados, configuramos uma etapa de processamento de dados. Esta etapa executa um trabalho de processamento do SageMaker, usando o Etapa de Processamento, para preparar os dados brutos de entrada para treinamento e avaliação.

Para treinar o modelo, configuramos uma etapa de trabalho de treinamento. Esta etapa executa um trabalho de treinamento do SageMaker, usando o Etapa de Treinamento. Para este caso de uso, realizamos classificação binária usando XGBoost. A saída desta etapa é um artefato de modelo, model.tar.gz, armazenado no Amazon S3.

A última etapa é responsável por avaliar o desempenho do modelo usando o conjunto de dados de validação de teste. Esta etapa usa o built-in ProcessingStep com o código fornecido, evaluation.py, para avaliar métricas de desempenho (precisão, área sob a curva).

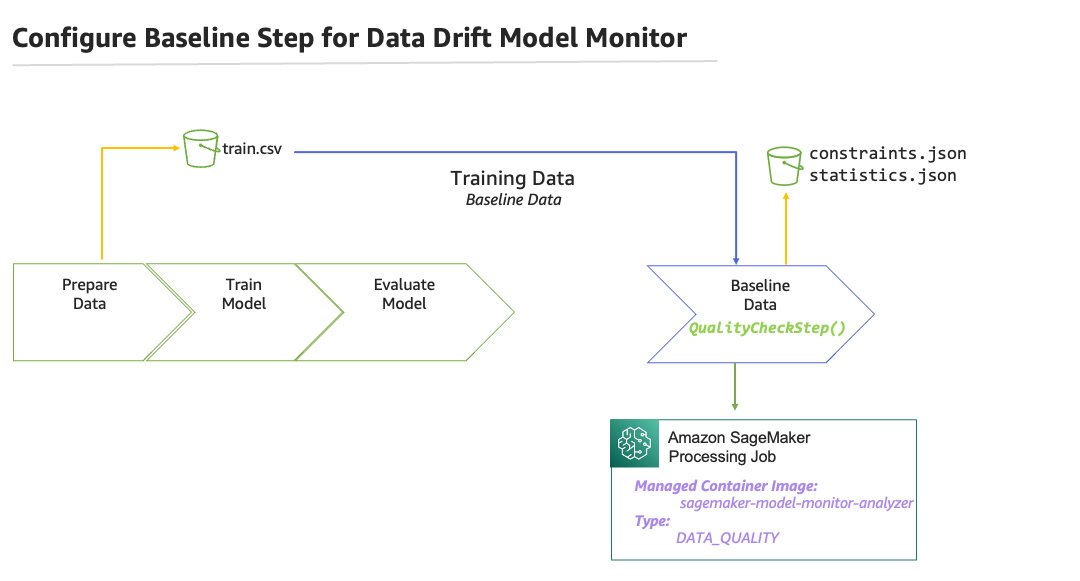

Configurar a etapa de linha de base

Para monitorar o modelo e os dados, é necessária uma linha de base.

O monitoramento do desvio de dados requer uma linha de base de dados de treinamento. A etapa de linha de base usa o recurso integrado do Pipelines Etapa de verificação de qualidade. Esta etapa executa automaticamente um trabalho de processamento do SageMaker que usa a imagem de contêiner pré-criada do Model Monitor. Usamos essa mesma imagem de contêiner para a linha de base e também para o monitoramento do modelo; no entanto, os parâmetros usados durante a configuração desta etapa direcionam o comportamento apropriado. Nesse caso, estamos estabelecendo a linha de base dos dados, portanto, precisamos garantir que o quality_check_config parâmetro está usando DataQualityCheckConfig, que identifica os caminhos de entrada e saída do S3. Também estamos definindo register_new_baseline e skip_check para true. Quando esses valores são definidos como true, ele informa ao SageMaker para executar esta etapa como um trabalho de linha de base e criar uma nova linha de base. Para entender melhor os parâmetros que controlam o comportamento da imagem de contêiner pré-construída do SageMaker, consulte Cálculo de linha de base, detecção de desvio e ciclo de vida com as etapas ClarifyCheck e QualityCheck nos pipelines de criação de modelos do Amazon SageMaker.

Veja o seguinte código:

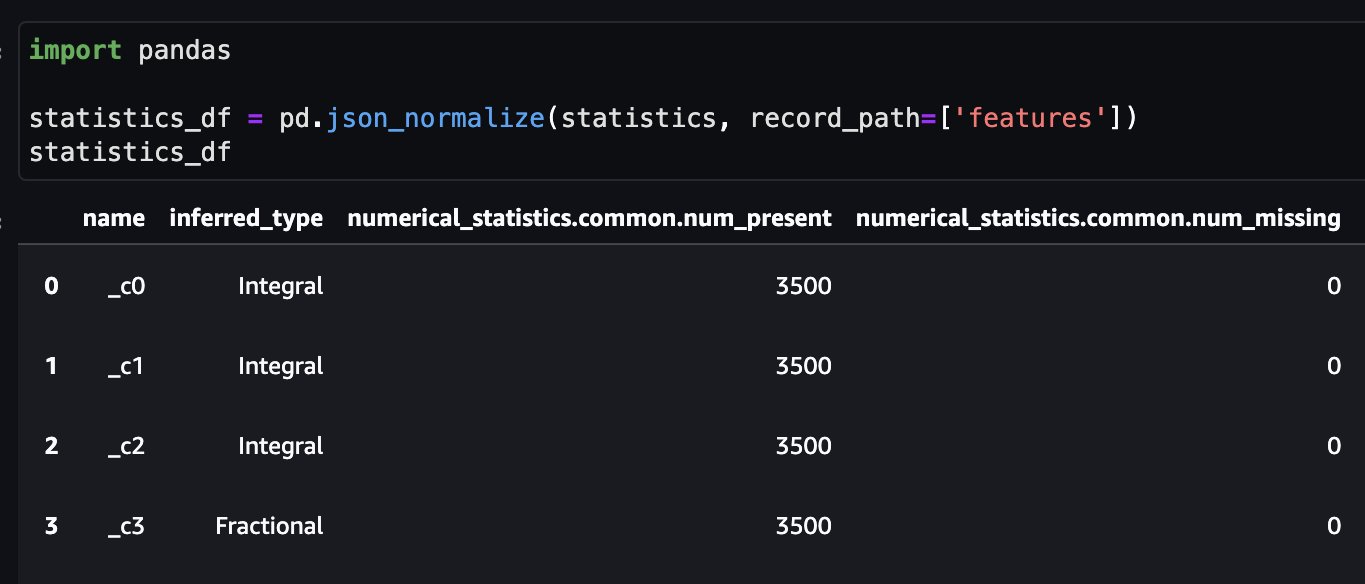

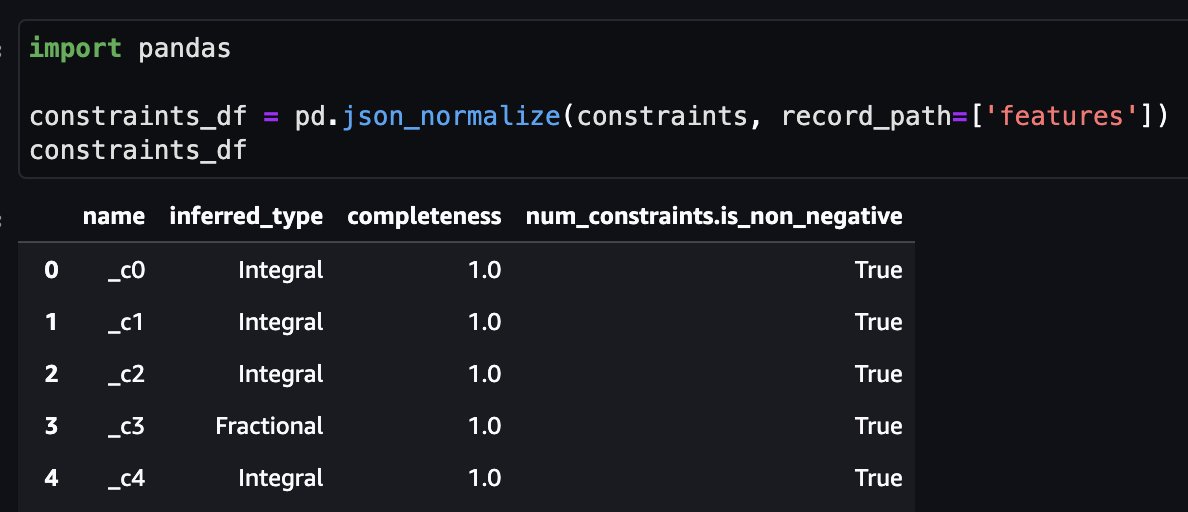

Esta etapa gera dois arquivos JSON como saída:

- estatísticas.json – Contém estatísticas calculadas para cada recurso do conjunto de dados de treinamento

- restrições.json – Sugere restrições de dados com base nas estatísticas coletadas

Essas restrições também podem ser modificadas e são usadas para detectar sinais de desvio durante o monitoramento do modelo.

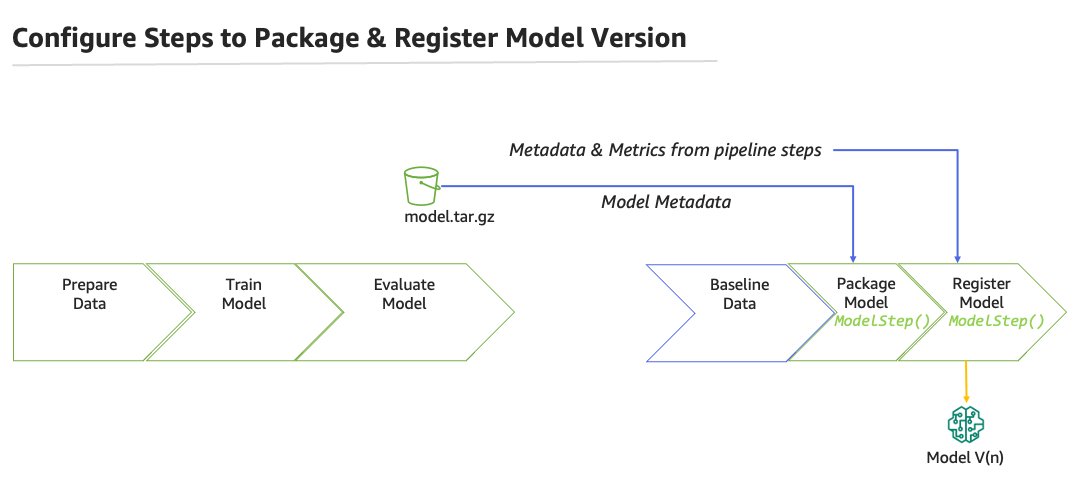

Configurar etapas para empacotar e registrar a versão do modelo

Em seguida, configuramos as etapas para empacotar para implantação e registrar o modelo no registro de modelo usando duas etapas de pipeline adicionais.

A etapa do modelo de pacote empacota o modelo para uso com a opção de implantação de transformação em lote do SageMaker. model.create() cria uma entidade de modelo, que será incluída nos metadados personalizados registrados para esta versão do modelo e posteriormente usada no segundo pipeline para inferência em lote e monitoramento do modelo. Veja o seguinte código:

A etapa de registro do modelo registra a versão do modelo e os metadados associados ao registro do modelo do SageMaker. Isso inclui métricas de desempenho do modelo, bem como metadados para a linha de base de desvio de dados, incluindo os locais do Amazon S3 das estatísticas e arquivos de restrições produzidos por meio da etapa de linha de base. Você também notará os metadados personalizados adicionais observados customer_metadata_properties puxando as informações da entidade do modelo que serão usadas posteriormente no pipeline de inferência. A capacidade de fornecer metadados personalizados no registro do modelo é uma ótima maneira de incorporar metadados adicionais que devem ser coletados e que não estejam explicitamente definidos nos parâmetros nativos do SageMaker. Veja o seguinte código:

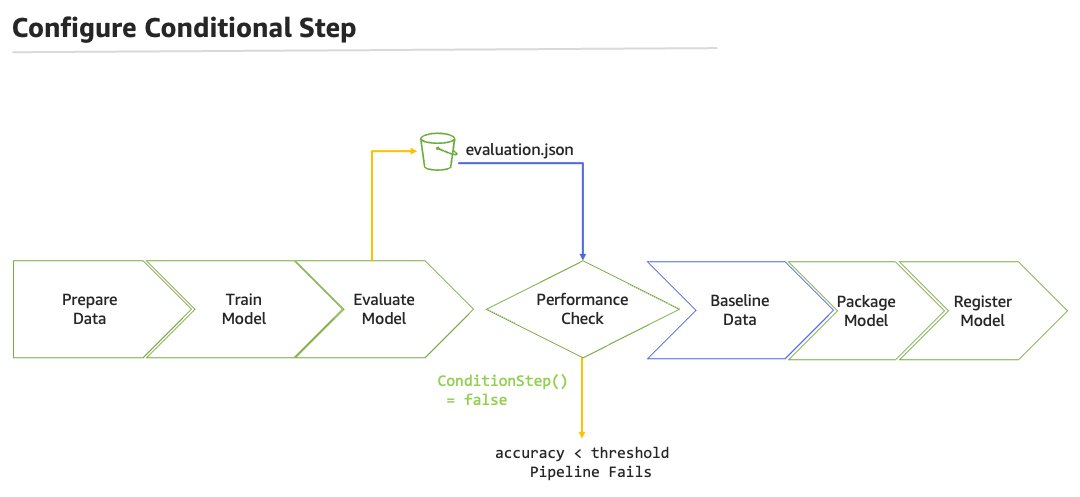

Configurar uma etapa condicional para avaliar o desempenho do modelo

A etapa condicional, PassoCondição, compara a precisão do modelo com um limite identificado e verifica a qualidade do modelo treinado.

ele lê o evaluation.json arquivo e verifica se a precisão do modelo, ou qualquer métrica objetiva que você está otimizando, atende aos critérios que você definiu. Neste caso, o critério é definido usando um dos condições internas, ConditionGreaterThanOrEqualTo. Se a condição for satisfeita, o pipeline continua a basear os dados e executar as etapas subsequentes no pipeline. O pipeline para se a condição não for atendida. Como a condição chama explicitamente as próximas etapas no pipeline, precisamos garantir que essas etapas sejam configuradas antes de configurar nossa etapa condicional. Veja o seguinte código:

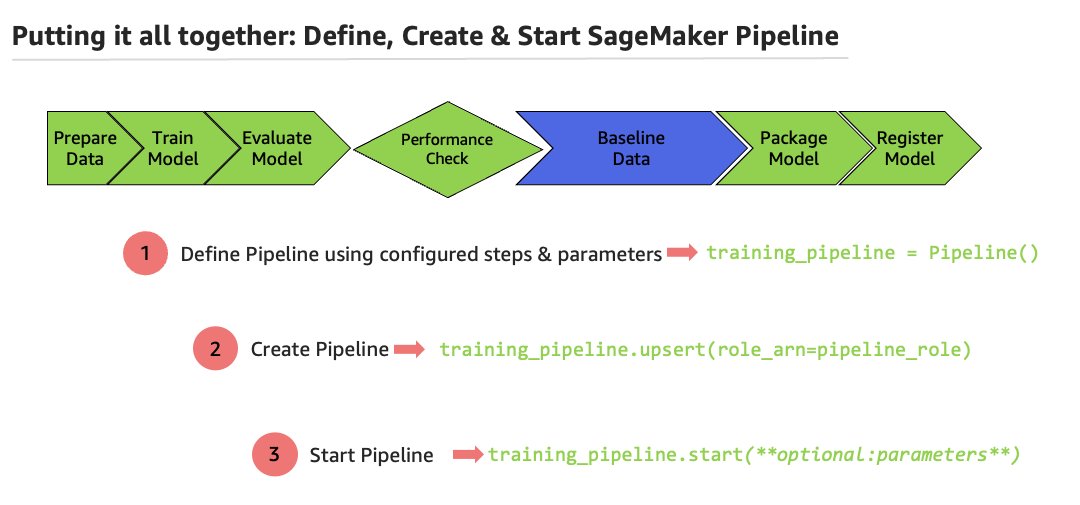

Definir, criar e iniciar o pipeline do SageMaker

Neste ponto, todas as etapas do pipeline de treinamento e linha de base são definidas e configuradas. Agora é hora de definir, criar e iniciar o pipeline.

Primeiro, definimos o pipeline, Pipeline(), fornecendo um nome de pipeline e uma lista de etapas configuradas anteriormente para incluir no pipeline. Em seguida, criamos o pipeline usando training_pipeline.upsert(). Por fim, iniciamos o pipeline usando training_pipeline.start(). Veja o seguinte código:

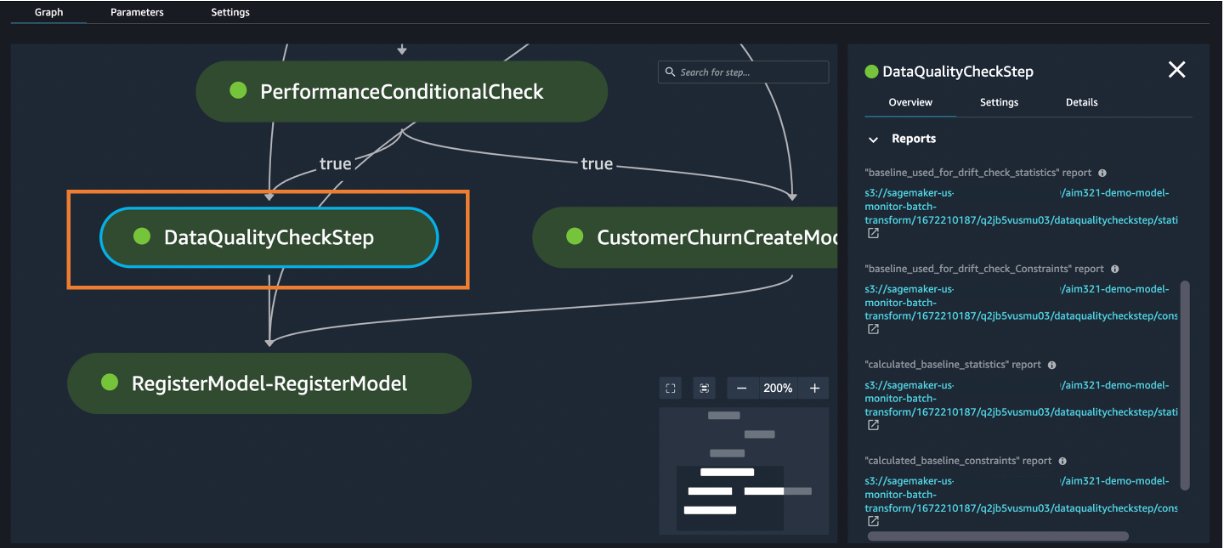

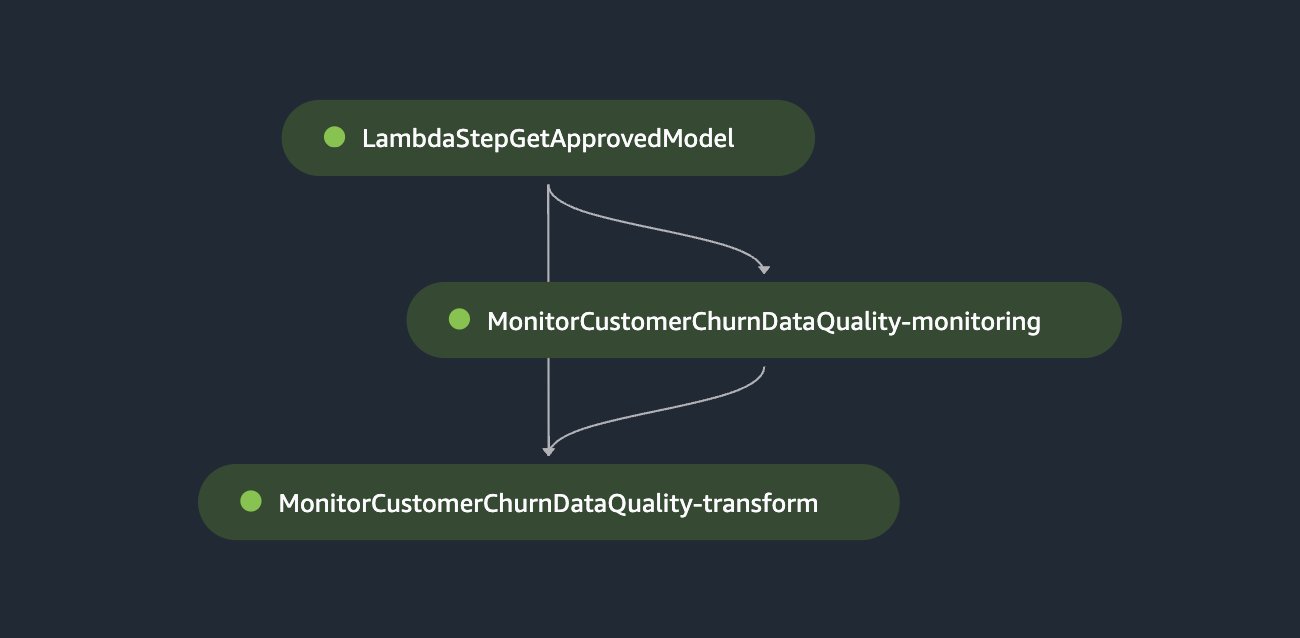

Quando o pipeline começar a rodar, você poderá visualizar seu status no Studio. O diagrama a seguir mostra quais etapas do processo de pipeline estão relacionadas às etapas do grafo acíclico dirigido por pipeline (DAG). Depois que o pipeline de treinamento e linha de base é executado com êxito, ele registra o modelo treinado como parte do grupo de modelos no registro do modelo. O pipeline está atualmente configurado para registrar o modelo em um estado Pendente, o que requer uma aprovação manual. Opcionalmente, você pode configurar a etapa de registro do modelo para aprovar automaticamente o modelo no registro do modelo. O segundo pipeline extrairá o modelo aprovado mais recente do registro para inferência.

No Studio, você pode escolher qualquer etapa para ver seus principais metadados. Por exemplo, a etapa de verificação de qualidade de dados (etapa de linha de base) no pipeline DAG mostra os locais de saída S3 de statistics.json e constraints.json no Relatórios seção. Esses são arquivos-chave calculados a partir de dados brutos usados como linha de base.

Após a execução do pipeline, a linha de base (estatísticas e restrições) para monitoramento de qualidade de dados pode ser inspecionada, conforme mostrado nas capturas de tela a seguir.

Pipeline 2: inferência em lote e pipeline do Monitor de modelo

Nesta seção, nos aprofundamos no segundo pipeline usado para monitorar os novos dados de entrada em lote quanto a sinais de desvio de dados e executar a inferência em lote usando os pipelines do SageMaker. As etapas e o código necessários estão dentro 2.SageMakerPipeline-ModelMonitoring-DataQuality-BatchTransform.ipynb. Esse pipeline inclui as seguintes etapas:

- Uma etapa do Lambda para recuperar a versão do modelo aprovada mais recente e os metadados associados do registro do modelo.

- Uma etapa do Monitor de modelo para detectar sinais de desvio de dados usando os novos dados de entrada e a linha de base do Pipeline 1.

- Uma etapa de transformação em lote para processar os dados de entrada em lote em relação ao modelo aprovado mais recente.

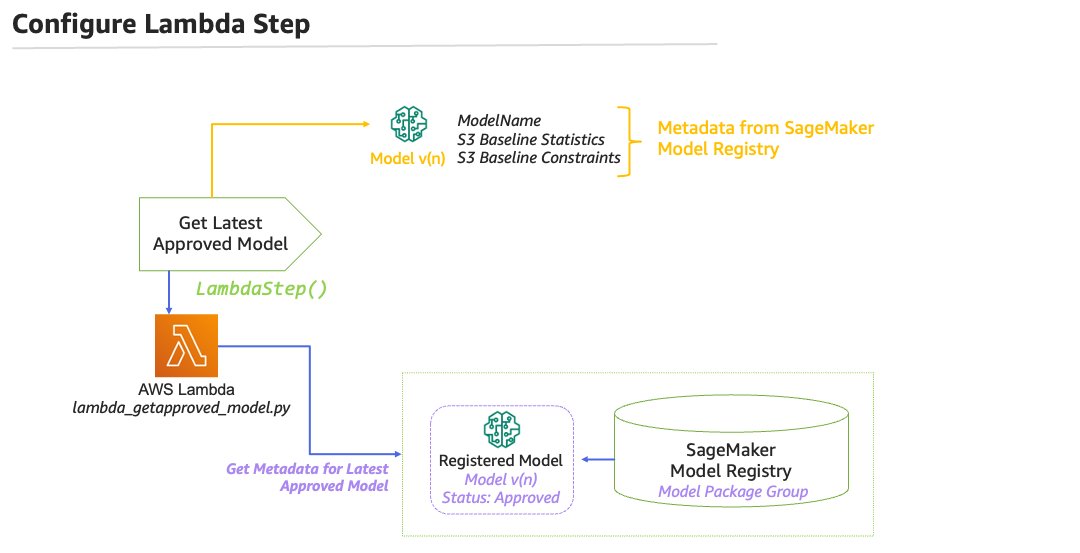

Configurar uma etapa do Lambda

Antes de iniciarmos o monitoramento do modelo e o trabalho de transformação em lote, precisamos consultar o registro do modelo para obter o último modelo aprovado que usaremos para inferência em lote.

Para fazer isso, usamos uma etapa do Lambda, que nos permite incluir lógica personalizada em nosso pipeline. O lambda_getapproved_model.py A função Lambda consulta o registro do modelo SageMaker para um grupo de pacote de modelo específico fornecido na entrada para identificar a versão de modelo aprovada mais recente e retornar os metadados relacionados. A saída inclui metadados criados a partir de nosso primeiro pipeline:

- ARN do pacote de modelos

- Nome do modelo empacotado

- S3 URI para linha de base de estatísticas

- S3 URI para linha de base de restrições

A saída é então usada como entrada na próxima etapa do pipeline, que executa o monitoramento e pontuação do lote usando o modelo aprovado mais recente.

Para criar e executar a função Lambda como parte do pipeline do SageMaker, precisamos adicionar a função como um LambdaStep no pipeline:

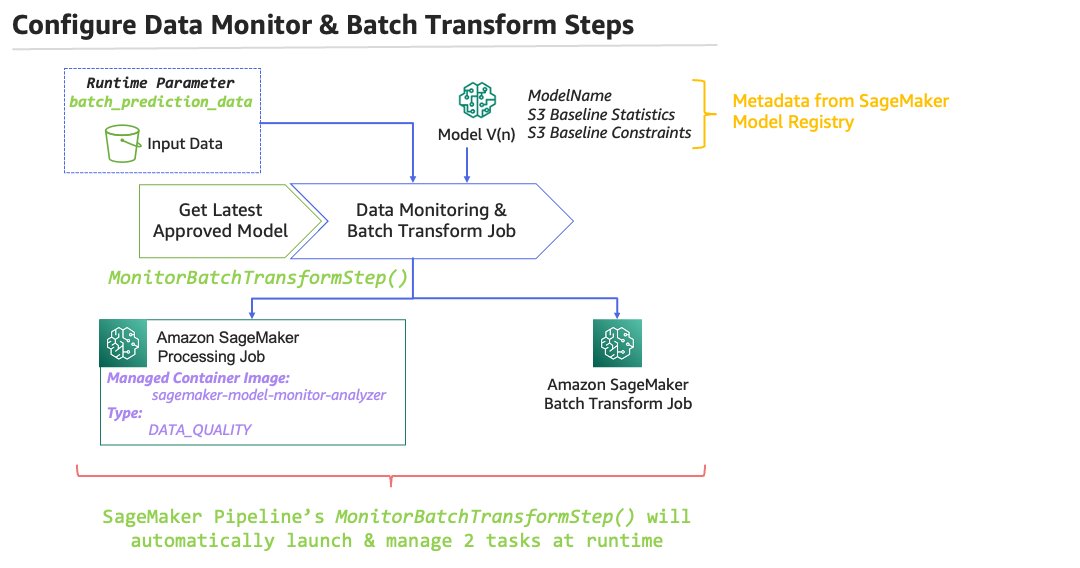

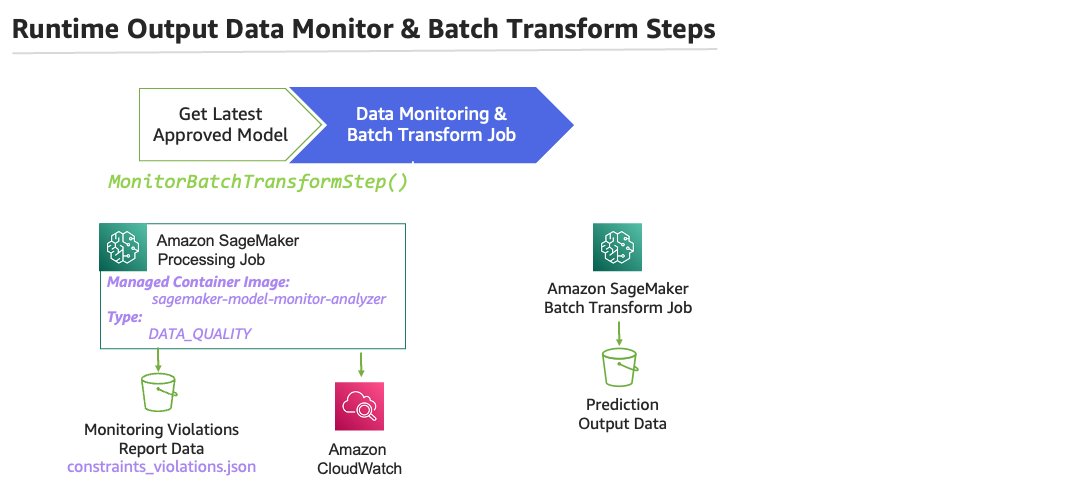

Configure o monitor de dados e as etapas de transformação em lote

Depois de criarmos a etapa do Lambda para obter o último modelo aprovado, podemos criar o MonitorBatchTransformStep. Essa etapa nativa orquestra e gerencia duas tarefas filhas que são executadas sucessivamente. A primeira tarefa inclui o trabalho Model Monitor que executa um trabalho Processing usando uma imagem de contêiner integrada usada para monitorar os dados de entrada em lote e compará-los com as restrições da linha de base gerada anteriormente do Pipeline 1. Além disso, esta etapa inicia o tarefa de transformação em lote, que processa os dados de entrada em relação ao modelo aprovado mais recente no registro do modelo.

Essa etapa de implantação em lote e monitoramento de qualidade de dados usa o S3 URI dos dados de entrada de previsão em lote na entrada. Isso é parametrizado para permitir que cada execução do pipeline inclua um novo conjunto de dados de entrada. Veja o seguinte código:

Em seguida, precisamos configurar o transformador para o trabalho de transformação em lote que processará as solicitações de previsão em lote. No código a seguir, passamos o nome do modelo extraído dos metadados personalizados do registro do modelo, juntamente com outros parâmetros obrigatórios:

O monitor de qualidade de dados aceita o S3 URI das estatísticas e restrições de linha de base para a versão de modelo aprovada mais recente do registro de modelo para executar o trabalho de monitoramento de qualidade de dados durante a execução do pipeline. Este trabalho compara os dados de entrada de previsão em lote com os dados de linha de base para identificar qualquer violação que indique um possível desvio de dados. Veja o seguinte código:

Em seguida, usamos MonitorBatchTransformStep para executar e monitorar a tarefa de transformação. Esta etapa executa uma tarefa de transformação em lote usando o objeto transformador que configuramos e monitora os dados passados para o transformador antes de executar a tarefa.

Opcionalmente, você pode configurar a etapa para falhar se uma violação da qualidade dos dados for encontrada definindo o fail_on_violation bandeira para False.

Veja o seguinte código:

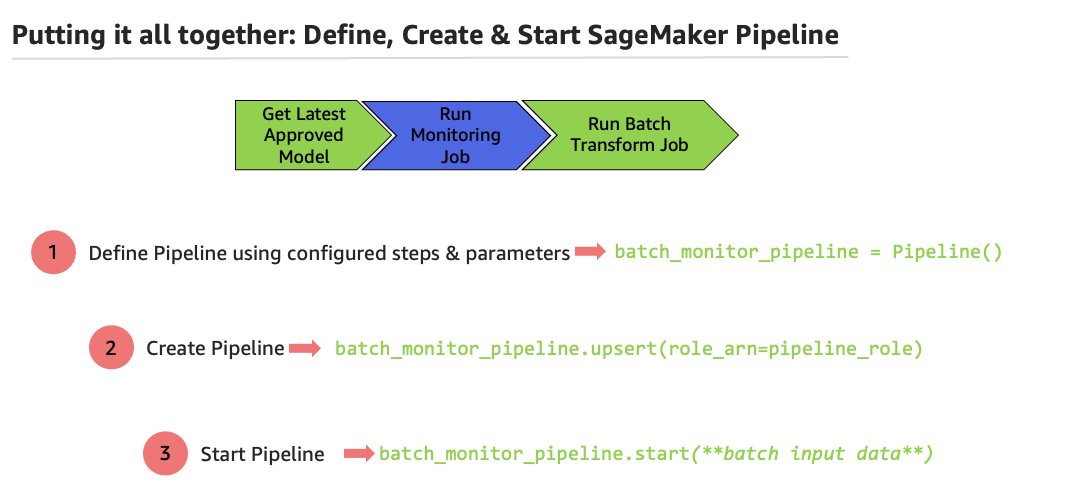

Definir, criar e iniciar o pipeline

Depois de definirmos o LambdaStep e MonitorBatchTransformStep, podemos criar o pipeline do SageMaker.

Veja o seguinte código:

Agora podemos usar o upsert() método, que criará ou atualizará o pipeline do SageMaker com a configuração que especificamos:

Embora existam várias maneiras de iniciar um pipeline do SageMaker, quando o pipeline for criado, podemos executá-lo usando o método start() método.

Note que para que o LambdaStep para recuperar com sucesso um modelo aprovado, o modelo que foi registrado como parte do Pipeline 1 precisa ter um status Aprovado. Isso pode ser feito no Studio ou usando o Boto3. Referir-se Atualizar o status de aprovação de um modelo para obter mais informações.

Para executar o pipeline do SageMaker em uma programação ou com base em um evento, consulte Agende um pipeline com o Amazon EventBridge.

Revise os relatórios do Monitor de modelo

O Model Monitor usa um trabalho de processamento do SageMaker que executa o DataQuality verifique usando as estatísticas e restrições da linha de base. O DataQuality O trabalho de processamento emite um relatório de violações para o Amazon S3 e também emite dados de log para Logs do Amazon CloudWatch sob o grupo de log para o trabalho de processamento correspondente. Exemplo de código para consulta Amazon CloudWatch logs são fornecidos no notebook.

Agora, orientamos você sobre como criar o primeiro pipeline para treinamento de modelo e linha de base, bem como o segundo pipeline para realizar inferência em lote e monitoramento de modelo. Isso permite que você automatize ambos os pipelines enquanto incorpora os diferentes ciclos de vida entre treinamento e inferência.

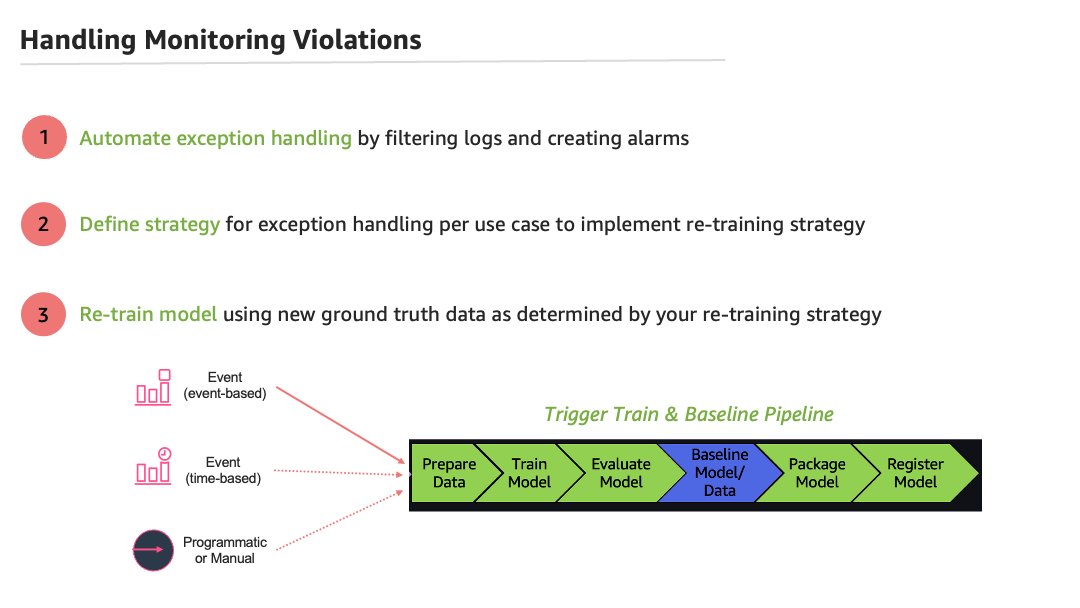

Para amadurecer ainda mais esse padrão de referência, você pode identificar uma estratégia para ciclos de feedback, fornecendo conscientização e visibilidade de possíveis sinais de desvio entre as principais partes interessadas. No mínimo, é recomendável automatizar o tratamento de exceções, filtrando logs e criando alarmes. Esses alarmes podem precisar de análise adicional por um cientista de dados, ou você pode implementar automação adicional para apoiar uma estratégia de retreinamento automático usando novos dados de verdade ao integrar o treinamento do modelo e o pipeline de linha de base com Amazon Event Bridge. Para obter mais informações, consulte Integração do Amazon EventBridge.

limpar

Depois de executar os pipelines de monitoramento de linha de base e lote, certifique-se de limpar todos os recursos que não serão utilizados, programaticamente por meio do console do SageMaker ou por meio do Studio. Além disso, exclua os dados no Amazon S3 e certifique-se de interromper todas as instâncias de bloco de anotações do Studio para não incorrer em cobranças adicionais.

Conclusão

Nesta postagem, você aprendeu a criar uma solução para um modelo de lote que é treinado com menos frequência do que a inferência de lote é executada nesse modelo treinado usando os recursos do SageMaker MLOps, incluindo Pipelines, o registro de modelo e o Monitor de modelo. Para expandir essa solução, você pode incorporá-la a um projeto personalizado do SageMaker que também incorpore CI/CD e acionadores automatizados usando modelos MLOps padronizados. Para se aprofundar na solução e no código mostrados nesta demonstração, confira o GitHub repo. Além disso, consulte Amazon SageMaker para MLOps para obter exemplos relacionados à implementação de práticas de MLOps com o SageMaker.

Sobre os autores

Shelbee Eigenbrode é arquiteto principal de soluções de inteligência artificial e machine learning na Amazon Web Services (AWS). Ela está na área de tecnologia há 24 anos, abrangendo vários setores, tecnologias e funções. Atualmente, ela está se concentrando em combinar seu histórico de DevOps e ML no domínio de MLOps para ajudar os clientes a fornecer e gerenciar cargas de trabalho de ML em escala. Com mais de 35 patentes concedidas em vários domínios de tecnologia, ela tem paixão pela inovação contínua e pelo uso de dados para gerar resultados de negócios. Shelbee é co-criadora e instrutora da especialização Practical Data Science no Coursera. Ela também é co-diretora da Women In Big Data (WiBD), capítulo de Denver. Em seu tempo livre, ela gosta de passar tempo com sua família, amigos e cães hiperativos.

Shelbee Eigenbrode é arquiteto principal de soluções de inteligência artificial e machine learning na Amazon Web Services (AWS). Ela está na área de tecnologia há 24 anos, abrangendo vários setores, tecnologias e funções. Atualmente, ela está se concentrando em combinar seu histórico de DevOps e ML no domínio de MLOps para ajudar os clientes a fornecer e gerenciar cargas de trabalho de ML em escala. Com mais de 35 patentes concedidas em vários domínios de tecnologia, ela tem paixão pela inovação contínua e pelo uso de dados para gerar resultados de negócios. Shelbee é co-criadora e instrutora da especialização Practical Data Science no Coursera. Ela também é co-diretora da Women In Big Data (WiBD), capítulo de Denver. Em seu tempo livre, ela gosta de passar tempo com sua família, amigos e cães hiperativos.

Sovik Kumar Nath é um arquiteto de soluções AI/ML da AWS. Ele tem experiência em projetos e soluções para aprendizado de máquina, análise de negócios em análise financeira, operacional e de marketing; assistência médica; cadeia de mantimentos; e IoT. Fora do trabalho, Sovik gosta de viajar e assistir a filmes.

Sovik Kumar Nath é um arquiteto de soluções AI/ML da AWS. Ele tem experiência em projetos e soluções para aprendizado de máquina, análise de negócios em análise financeira, operacional e de marketing; assistência médica; cadeia de mantimentos; e IoT. Fora do trabalho, Sovik gosta de viajar e assistir a filmes.

Marc Karp é arquiteto de ML da equipe do Amazon SageMaker Service. Ele se concentra em ajudar os clientes a projetar, implantar e gerenciar cargas de trabalho de ML em escala. Nas horas vagas gosta de viajar e explorar novos lugares.

Marc Karp é arquiteto de ML da equipe do Amazon SageMaker Service. Ele se concentra em ajudar os clientes a projetar, implantar e gerenciar cargas de trabalho de ML em escala. Nas horas vagas gosta de viajar e explorar novos lugares.

- Conteúdo com tecnologia de SEO e distribuição de relações públicas. Seja amplificado hoje.

- Platoblockchain. Inteligência Metaverso Web3. Conhecimento Ampliado. Acesse aqui.

- Cunhando o Futuro com Adryenn Ashley. Acesse aqui.

- Fonte: https://aws.amazon.com/blogs/machine-learning/create-sagemaker-pipelines-for-training-consuming-and-monitoring-your-batch-use-cases/

- :tem

- :é

- :não

- $UP

- 000

- 1

- 10

- 100

- 20

- 7

- a

- habilidade

- Aceita

- Acesso

- Segundo

- precisão

- em

- ações

- acíclico

- Adição

- Adicional

- Depois de

- contra

- AI

- AI / ML

- Todos os Produtos

- permite

- juntamente

- tb

- Amazon

- Amazon Sage Maker

- Amazon Web Services

- Amazon Web Services (AWS)

- an

- análise

- analítica

- e

- qualquer

- aplicações

- apropriado

- aprovação

- aprovar

- aprovou

- arquitetura

- SOMOS

- ÁREA

- AS

- associado

- At

- atributos

- automatizar

- Automatizado

- Automático

- automaticamente

- Automação

- consciência

- AWS

- fundo

- baseado

- Linha de Base

- base

- BE

- Porque

- sido

- antes

- Melhor

- entre

- Grande

- Big Data

- ambos

- construir

- Prédio

- construídas em

- negócio

- funções empresariais

- by

- calculado

- chamadas

- CAN

- capacidades

- casas

- casos

- Categorias

- cadeia

- Capítulo

- acusações

- verificar

- Cheques

- criança

- Escolha

- classificação

- clique

- código

- combinando

- comum

- comparar

- completar

- Efetuado

- Completa

- Computar

- condição

- Configuração

- cônsul

- restrições

- consumida

- Recipiente

- contém

- continuar

- continua

- contínuo

- ao controle

- Correspondente

- poderia

- crio

- criado

- cria

- Criar

- critérios

- Atual

- Atualmente

- curva

- personalizadas

- cliente

- Clientes

- DAG

- diariamente

- dados,

- informática

- ciência de dados

- cientista de dados

- profundo

- mergulho profundo

- mais profunda

- definido

- entregar

- demonstrando

- Denver

- implantar

- desenvolvimento

- descreve

- Design

- projetos

- detectou

- Detecção

- diferente

- diretamente

- domínio

- domínios

- distância

- durante

- cada

- ou

- permitir

- garantir

- entidade

- Meio Ambiente

- ambientes

- avaliar

- avaliação

- avaliação

- Evento

- Cada

- exemplo

- exemplos

- exceção

- execução

- Expandir

- vasta experiência

- Explorando

- FALHA

- família

- Característica

- Funcionalidades

- retornos

- Envie o

- Arquivos

- filtragem

- final

- Finalmente

- financeiro

- Primeiro nome

- Foco

- concentra-se

- focando

- seguinte

- Escolha

- formato

- encontrado

- freqüentemente

- amigos

- da

- totalmente

- função

- funções

- mais distante

- gerar

- gerado

- gera

- ter

- Go

- concedido

- gráfico

- ótimo

- Solo

- Grupo

- Manipulação

- Ter

- he

- saúde

- ajudar

- ajuda

- destaques

- Como funciona o dobrador de carta de canal

- Como Negociar

- Contudo

- HTML

- http

- HTTPS

- identificado

- identifica

- identificar

- Identidade

- imagem

- executar

- implementação

- importar

- in

- incluir

- incluído

- inclui

- Incluindo

- incorporar

- incorporando

- indicam

- indústrias

- INFORMAÇÕES

- do estado inicial,

- Inovação

- entrada

- integrado

- Integração

- para dentro

- introduzido

- iot

- IT

- ESTÁ

- Trabalho

- jpg

- json

- Chave

- Kicks

- grande

- Sobrenome

- mais recente

- aprendido

- aprendizagem

- wifecycwe

- ciclos de vida

- Line

- Lista

- listas

- locais

- máquina

- aprendizado de máquina

- fazer

- gerencia

- gerenciados

- gestão

- manual

- Marketing

- maduro

- Posso..

- significado

- a medida

- média

- atende

- metadados

- método

- métrico

- Métrica

- mínimo

- ML

- MLOps

- Móvel Esteira

- telefone móvel

- modelo

- modificada

- Monitore

- monitoração

- monitores

- Mês

- mais

- Filmes

- múltiplo

- nome

- nativo

- necessário

- você merece...

- necessário

- Cria

- Novo

- Próximo

- caderno

- notado

- agora

- objeto

- objetivo

- of

- on

- ONE

- contínuo

- operacional

- otimizando

- Opção

- or

- ordem

- Outros

- A Nossa

- saída

- lado de fora

- Acima de

- pacote

- pacotes

- parâmetro

- parâmetros

- parte

- passar

- passou

- paixão

- Patentes

- caminho

- padrão

- perscrutar

- pendente

- Realizar

- atuação

- realização

- executa

- permissão

- permissões

- telefone

- oleoduto

- Locais

- platão

- Inteligência de Dados Platão

- PlatãoData

- ponto

- políticas

- Privacidade

- Publique

- potencial

- Prática

- práticas

- predizer

- predição

- Previsões

- Preparar

- anteriormente

- Diretor

- Prévio

- processo

- processos

- em processamento

- Produzido

- Produção

- Perfil

- projeto

- Propriedades

- fornecer

- fornecido

- fornecendo

- puxando

- Python

- qualidade

- consultas

- Cru

- pronto

- Recomenda

- registro

- registros

- reduzir

- cadastre-se

- registrado

- registradores

- Registo

- registro

- relacionado

- repetir

- Repetivel

- Denunciar

- repositório

- pedidos

- requeridos

- exige

- Recursos

- responsável

- retorno

- rever

- Tipo

- papéis

- grosseiramente

- Execute

- corrida

- sábio

- Pipelines SageMaker

- mesmo

- Conjunto de dados de amostra

- satisfeito

- Salvar

- Escala

- cenário

- cenários

- cronograma

- Ciência

- Cientista

- marcar

- screenshots

- Scripts

- Segundo

- secundário

- Seção

- separado

- serviço

- Serviços

- conjunto

- Conjuntos

- contexto

- instalação

- rede de apoio social

- mostrar

- mostrando

- Shows

- sinais

- simples

- So

- solução

- Soluções

- alguns

- fonte

- código fonte

- especialista

- específico

- especificada

- gastar

- partes interessadas

- começo

- começa

- Estado

- estatística

- Status

- Passo

- Passos

- Dê um basta

- Pára

- armazenamento

- armazenadas

- Estratégia

- estudo

- subseqüente

- entraram com sucesso

- tal

- Sugere

- supply

- cadeia de suprimentos

- ajuda

- Apoiar

- Tire

- toma

- Target

- Tarefa

- tarefas

- Profissionais

- Tecnologias

- Tecnologia

- telecomunicações

- conta

- modelos

- teste

- do que

- que

- A

- Lá.

- Este

- isto

- aqueles

- três

- três etapas

- limiar

- Através da

- tempo

- para

- juntos

- Trem

- treinado

- Training

- Transformar

- Viagens

- Verdade

- para

- subjacente

- compreensão

- Atualizar

- us

- usar

- caso de uso

- usava

- Utilizador

- utilização

- utilizado

- Valores

- vário

- versão

- via

- VIOLAÇÃO

- Violações

- visibilidade

- caminhou

- foi

- assistindo

- Caminho..

- maneiras

- we

- web

- serviços web

- BEM

- qual

- enquanto

- precisarão

- de

- dentro

- Mulher

- Atividades:

- XGBoostName

- anos

- Vocês

- investimentos

- zefirnet