No atual cenário de saúde em rápida evolução, os médicos se deparam com grandes quantidades de dados clínicos de várias fontes, como anotações do cuidador, registros eletrônicos de saúde e relatórios de imagem. Essa riqueza de informações, embora essencial para o atendimento ao paciente, também pode ser esmagadora e demorada para os profissionais médicos examinarem e analisarem. Resumir e extrair informações com eficiência desses dados é crucial para um melhor atendimento ao paciente e tomada de decisões. As informações resumidas do paciente podem ser úteis para vários processos posteriores, como agregação de dados, codificação eficaz de pacientes ou agrupamento de pacientes com diagnósticos semelhantes para revisão.

Os modelos de inteligência artificial (IA) e aprendizado de máquina (ML) têm se mostrado muito promissores para enfrentar esses desafios. Os modelos podem ser treinados para analisar e interpretar grandes volumes de dados de texto, condensando efetivamente as informações em resumos concisos. Ao automatizar o processo de resumo, os médicos podem obter acesso rápido a informações relevantes, permitindo que se concentrem no atendimento ao paciente e tomem decisões mais informadas. Veja o seguinte estudo de caso para saber mais sobre um caso de uso do mundo real.

Amazon Sage Maker, um serviço de ML totalmente gerenciado, fornece uma plataforma ideal para hospedar e implementar vários modelos e abordagens de resumo baseados em IA/ML. Nesta postagem, exploramos diferentes opções para implementar técnicas de resumo no SageMaker, incluindo o uso JumpStart do Amazon SageMaker modelos de fundação, modelos pré-treinados de ajuste fino de Hugging Face e construção de modelos de resumo personalizados. Também discutimos os prós e contras de cada abordagem, permitindo que os profissionais de saúde escolham a solução mais adequada para gerar resumos concisos e precisos de dados clínicos complexos.

Dois termos importantes para saber antes de começar: pré-treinado e afinação. Um modelo pré-treinado ou básico é aquele que foi construído e treinado em um grande corpus de dados, geralmente para conhecimento geral do idioma. O ajuste fino é o processo pelo qual um modelo pré-treinado recebe outro conjunto de dados mais específico do domínio para melhorar seu desempenho em uma tarefa específica. Em um ambiente de assistência médica, isso significaria fornecer ao modelo alguns dados, incluindo frases e terminologia pertencentes especificamente ao atendimento ao paciente.

Crie modelos de resumo personalizados no SageMaker

Embora seja a abordagem de maior esforço, algumas organizações podem preferir criar modelos de resumo personalizados no SageMaker desde o início. Essa abordagem requer um conhecimento mais aprofundado dos modelos AI/ML e pode envolver a criação de uma arquitetura de modelo a partir do zero ou a adaptação de modelos existentes para atender a necessidades específicas. Construir modelos personalizados pode oferecer maior flexibilidade e controle sobre o processo de resumo, mas também requer mais tempo e recursos em comparação com abordagens que começam com modelos pré-treinados. É essencial avaliar cuidadosamente os benefícios e as desvantagens dessa opção antes de prosseguir, porque ela pode não ser adequada para todos os casos de uso.

Modelos de fundação SageMaker JumpStart

Uma ótima opção para implementar o resumo no SageMaker é usar os modelos básicos do JumpStart. Esses modelos, desenvolvidos pelas principais organizações de pesquisa de IA, oferecem uma variedade de modelos de linguagem pré-treinados otimizados para várias tarefas, incluindo resumo de texto. O SageMaker JumpStart fornece dois tipos de modelos básicos: modelos proprietários e modelos de código aberto. O SageMaker JumpStart também fornece qualificação HIPAA, tornando-o útil para cargas de trabalho de assistência médica. Em última análise, cabe ao cliente garantir a conformidade, portanto, certifique-se de tomar as medidas adequadas. Ver Arquitetura para segurança e conformidade HIPAA no Amazon Web Services para mais detalhes.

Modelos de fundação proprietários

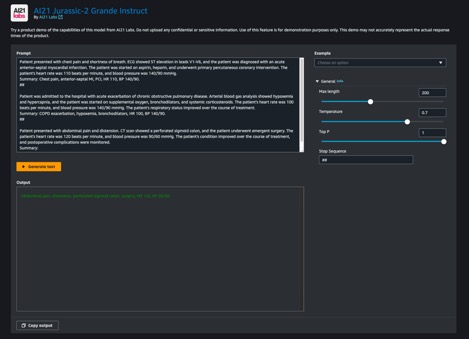

Modelos proprietários, como os modelos jurássicos da AI21 e o modelo Cohere Generate da Cohere, podem ser descobertos por meio do SageMaker JumpStart no Console de gerenciamento da AWS e estão atualmente em pré-visualização. A utilização de modelos proprietários para resumo é ideal quando você não precisa ajustar seu modelo em dados personalizados. Isso oferece uma solução pronta para uso e fácil de usar que pode atender aos seus requisitos de resumo com configuração mínima. Ao usar os recursos desses modelos pré-treinados, você pode economizar tempo e recursos que seriam gastos no treinamento e no ajuste fino de um modelo personalizado. Além disso, os modelos proprietários geralmente vêm com APIs e SDKs fáceis de usar, simplificando o processo de integração com seus sistemas e aplicativos existentes. Se suas necessidades de resumo puderem ser atendidas por modelos proprietários pré-treinados sem exigir personalização específica ou ajuste fino, eles oferecem uma solução conveniente, econômica e eficiente para suas tarefas de resumo de texto. Como esses modelos não são treinados especificamente para casos de uso de assistência médica, a qualidade não pode ser garantida para a linguagem médica pronta para uso sem um ajuste fino.

Jurassic-2 Grande Instruct é um modelo de linguagem grande (LLM) da AI21 Labs, otimizado para instruções de linguagem natural e aplicável a várias tarefas de linguagem. Ele oferece uma API fácil de usar e SDK Python, equilibrando qualidade e acessibilidade. Usos populares incluem geração de cópia de marketing, ativação de chatbots e resumo de texto.

No console do SageMaker, navegue até SageMaker JumpStart, localize o modelo AI21 Jurassic-2 Grande Instruct e escolha Experimente o modelo.

Se quiser implantar o modelo em um endpoint do SageMaker que você gerencia, siga as etapas neste exemplo caderno, que mostra como implantar o Jurassic-2 Large usando o SageMaker.

Modelos de fundação de código aberto

Os modelos de código aberto incluem os modelos FLAN T5, Bloom e GPT-2 que podem ser descobertos por meio do SageMaker JumpStart no Estúdio Amazon SageMaker UI, SageMaker JumpStart no console SageMaker e APIs SageMaker JumpStart. Esses modelos podem ser ajustados e implantados em endpoints em sua conta da AWS, dando a você propriedade total de pesos de modelo e códigos de script.

Flan-T5 XL é um modelo poderoso e versátil projetado para uma ampla gama de tarefas de linguagem. Ao ajustar o modelo com seus dados específicos de domínio, você pode otimizar seu desempenho para seu caso de uso específico, como resumo de texto ou qualquer outra tarefa de NLP. Para obter detalhes sobre como ajustar o Flan-T5 XL usando a IU do SageMaker Studio, consulte Ajuste fino de instruções para FLAN T5 XL com Amazon SageMaker Jumpstart.

Ajustando modelos pré-treinados com Hugging Face no SageMaker

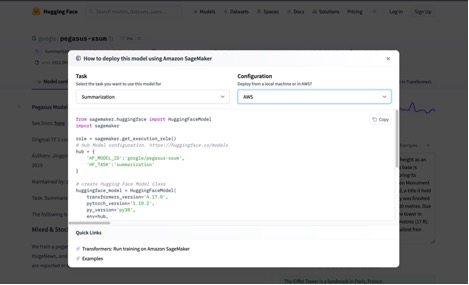

Uma das opções mais populares para implementar a sumarização no SageMaker é o ajuste fino de modelos pré-treinados usando o Hugging Face transformadores biblioteca. Hugging Face fornece uma ampla gama de modelos de transformadores pré-treinados especificamente projetados para várias tarefas de processamento de linguagem natural (NLP), incluindo resumo de texto. Com a biblioteca Hugging Face Transformers, você pode ajustar facilmente esses modelos pré-treinados em seus dados específicos de domínio usando o SageMaker. Essa abordagem tem várias vantagens, como tempos de treinamento mais rápidos, melhor desempenho em domínios específicos e empacotamento e implantação de modelos mais fáceis usando ferramentas e serviços integrados do SageMaker. Se não conseguir encontrar um modelo adequado no SageMaker JumpStart, você pode escolher qualquer modelo oferecido pelo Hugging Face e ajustá-lo usando o SageMaker.

Para começar a trabalhar com um modelo para aprender sobre os recursos do ML, tudo o que você precisa fazer é abrir o SageMaker Studio, encontrar um modelo pré-treinado que deseja usar no Hub de modelo de rosto de abraçoe escolha SageMaker como seu método de implantação. Hugging Face fornecerá o código para copiar, colar e executar em seu notebook. É tão fácil quanto isso! Nenhuma experiência em engenharia de ML é necessária.

A biblioteca Hugging Face Transformers permite que os construtores operem nos modelos pré-treinados e executem tarefas avançadas como ajuste fino, que exploraremos nas seções a seguir.

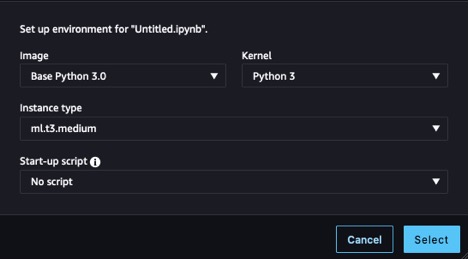

Recursos de provisionamento

Antes de começarmos, precisamos provisionar um notebook. Para obter instruções, consulte as etapas 1 e 2 em Crie e treine um modelo de aprendizado de máquina localmente. Para este exemplo, usamos as configurações mostradas na captura de tela a seguir.

Também precisamos criar um Serviço de armazenamento simples da Amazon (Amazon S3) para armazenar os dados de treinamento e os artefatos de treinamento. Para obter instruções, consulte Criação de um balde.

Preparar o conjunto de dados

Para ajustar nosso modelo para ter um melhor conhecimento de domínio, precisamos obter dados adequados para a tarefa. Ao treinar para um caso de uso corporativo, você precisará passar por várias tarefas de engenharia de dados para preparar seus próprios dados para estarem prontos para o treinamento. Essas tarefas estão fora do escopo deste post. Para este exemplo, geramos alguns dados sintéticos para emular anotações de enfermagem e os armazenamos no Amazon S3. Armazenar nossos dados no Amazon S3 nos permite arquitetar nossas cargas de trabalho para conformidade com HIPAA. Começamos obtendo essas anotações e carregando-as na instância em que nosso notebook está sendo executado:

As notas são compostas por uma coluna contendo a entrada completa, nota e uma coluna contendo uma versão abreviada exemplificando qual deve ser nossa saída desejada, resumo. O propósito de usar este conjunto de dados é melhorar o vocabulário biológico e médico do nosso modelo para que ele esteja mais sintonizado para resumir em um contexto de saúde, chamado ajuste fino de domínio, e mostre ao nosso modelo como estruturar sua saída resumida. Em alguns casos de resumo, podemos querer criar um resumo de um artigo ou uma sinopse de uma linha de uma revisão, mas, neste caso, estamos tentando fazer com que nosso modelo gere uma versão abreviada dos sintomas e ações tomadas para um paciente até agora.

Carregue o modelo

O modelo que utilizamos como base é uma versão do Google Pegasus, disponibilizado no Hugging Face Hub, chamado pégaso-xsum. Ele já está pré-treinado para resumo, então nosso processo de ajuste fino pode se concentrar em estender seu conhecimento de domínio. Modificar a tarefa que nosso modelo executa é um tipo diferente de ajuste fino não abordado neste post. A biblioteca Transformer nos fornece uma classe para carregar a definição do modelo de nosso model_checkpoint: google/pegasus-xsum. Isso carregará o modelo do hub e o instanciará em nosso notebook para que possamos usá-lo posteriormente. Porque pegasus-xsum é um modelo sequência a sequência, queremos usar o tipo Seq2Seq do Automodelo classe:

Agora que temos nosso modelo, é hora de colocar nossa atenção nos outros componentes que nos permitirão executar nosso loop de treinamento.

Criar um tokenizador

O primeiro desses componentes é o tokenizer. tokenization é o processo pelo qual as palavras dos dados de entrada são transformadas em representações numéricas que nosso modelo pode entender. Novamente, a biblioteca Transformer fornece uma classe para carregarmos uma definição de tokenizador do mesmo ponto de verificação que usamos para instanciar o modelo:

Com este objeto tokenizer, podemos criar uma função de pré-processamento e mapeá-la em nosso conjunto de dados para nos fornecer tokens prontos para serem inseridos no modelo. Por fim, formatamos a saída tokenizada e removemos as colunas contendo nosso texto original, pois o modelo não conseguirá interpretá-las. Agora ficamos com uma entrada tokenizada pronta para ser inserida no modelo. Veja o seguinte código:

Com nossos dados tokenizados e nosso modelo instanciado, estamos quase prontos para executar um loop de treinamento. Os próximos componentes que queremos criar são o agrupador de dados e o otimizador. O agrupador de dados é outra classe fornecida pelo Hugging Face por meio da biblioteca Transformers, que usamos para criar lotes de nossos dados tokenizados para treinamento. Podemos construí-lo facilmente usando o tokenizador e os objetos de modelo que já temos, apenas encontrando o tipo de classe correspondente que usamos anteriormente para nosso modelo (Seq2Seq) para a classe de agrupamento. A função do otimizador é manter o estado de treinamento e atualizar os parâmetros com base em nossa perda de treinamento enquanto trabalhamos no loop. Para criar um otimizador, podemos importar o otim pacote do módulo da tocha, onde vários algoritmos de otimização estão disponíveis. Alguns comuns que você pode ter encontrado antes são Stochastic Gradient Descent e Adam , o último dos quais é aplicado em nosso exemplo. O construtor de Adam considera os parâmetros do modelo e a taxa de aprendizado parametrizada para a determinada execução de treinamento. Veja o seguinte código:

As últimas etapas antes de começarmos o treinamento são construir o acelerador e o escalonador de taxa de aprendizado. O acelerador vem de uma biblioteca diferente (usamos principalmente Transformers) produzida por Hugging Face, apropriadamente chamada de Accelerate, e abstrairá a lógica necessária para gerenciar dispositivos durante o treinamento (usando várias GPUs, por exemplo). Para o componente final, revisitamos a sempre útil biblioteca Transformers para implementar nosso agendador de taxa de aprendizado. Ao especificar o tipo de agendador, o número total de etapas de treinamento em nosso loop e o otimizador criado anteriormente, o get_scheduler A função retorna um objeto que nos permite ajustar nossa taxa de aprendizado inicial ao longo do processo de treinamento:

Agora estamos totalmente preparados para o treinamento! Vamos configurar um trabalho de treinamento, começando por instanciar o treinamento_args usando a biblioteca Transformers e escolhendo valores de parâmetros. Podemos passá-los, junto com nossos outros componentes preparados e conjunto de dados, diretamente para o treinador e iniciar o treinamento, conforme mostrado no código a seguir. Dependendo do tamanho do conjunto de dados e dos parâmetros escolhidos, isso pode levar um tempo significativo.

Empacote o modelo para inferência

Após a execução do treinamento, o objeto modelo está pronto para ser usado para inferência. Como prática recomendada, vamos salvar nosso trabalho para uso futuro. Precisamos criar nossos artefatos de modelo, compactá-los e carregar nosso tarball no Amazon S3 para armazenamento. Para preparar nosso modelo para compactação, precisamos desempacotar o modelo agora ajustado e salvar o binário do modelo e os arquivos de configuração associados. Também precisamos salvar nosso tokenizador no mesmo diretório em que salvamos nossos artefatos de modelo para que esteja disponível quando usarmos o modelo para inferência. Nosso model_dir pasta agora deve se parecer com o seguinte código:

Tudo o que resta é executar um comando tar para compactar nosso diretório e fazer upload do arquivo tar.gz para o Amazon S3:

Nosso modelo recém-ajustado agora está pronto e disponível para ser usado para inferência.

Realizar inferência

Para usar esse artefato de modelo para inferência, abra um novo arquivo e use o seguinte código, modificando o model_data para ajustar o local de salvamento do artefato no Amazon S3. O HuggingFaceModel O construtor reconstruirá nosso modelo a partir do ponto de verificação que salvamos model.tar.gz, que podemos implantar para inferência usando o método de implantação. A implantação do endpoint levará alguns minutos.

Após a implantação do endpoint, podemos usar o preditor que criamos para testá-lo. Passe o predict método uma carga útil de dados e execute a célula, e você obterá a resposta de seu modelo ajustado:

Para ver o benefício de ajustar um modelo, vamos fazer um teste rápido. A tabela a seguir inclui um prompt e os resultados de passar esse prompt para o modelo antes e depois do ajuste fino.

| Prompt | Resposta sem ajuste fino | Resposta com ajuste fino |

| Resuma os sintomas que o paciente está apresentando. Paciente do sexo masculino, 45 anos, com queixa de dor torácica subesternal com irradiação para o braço esquerdo. A dor é de início súbito enquanto ele trabalhava no jardim, associada a leve falta de ar e diaforese. Na chegada, a frequência cardíaca do paciente era 120, frequência respiratória 24, pressão arterial 170/95. Eletrocardiograma de 12 derivações feito na chegada ao pronto-socorro e três nitroglicerinas sublinguais administradas sem alívio da dor torácica. Eletrocardiograma mostra supradesnivelamento do segmento ST nas derivações anteriores demonstrando infarto agudo do miocárdio anterior. Entramos em contato com o laboratório de cateterismo cardíaco e preparamos o cateterismo cardíaco pelo cardiologista. | Apresentamos um caso de infarto agudo do miocárdio. | Dor torácica, IM anterior, ICP. |

Como você pode ver, nosso modelo ajustado usa a terminologia de saúde de maneira diferente e conseguimos alterar a estrutura da resposta para atender aos nossos propósitos. Observe que os resultados dependem do seu conjunto de dados e das escolhas de design feitas durante o treinamento. Sua versão do modelo pode oferecer resultados muito diferentes.

limpar

Quando terminar de usar seu notebook SageMaker, certifique-se de desligá-lo para evitar custos de recursos de execução longa. Observe que desligar a instância fará com que você perca todos os dados armazenados na memória efêmera da instância, então você deve salvar todo o seu trabalho no armazenamento persistente antes da limpeza. Você também precisará ir ao Pontos finais página no console do SageMaker e exclua todos os pontos de extremidade implantados para inferência. Para remover todos os artefatos, você também precisa acessar o console do Amazon S3 para excluir os arquivos carregados em seu bucket.

Conclusão

Nesta postagem, exploramos várias opções para implementar técnicas de resumo de texto no SageMaker para ajudar os profissionais de saúde a processar e extrair insights de grandes quantidades de dados clínicos com eficiência. Discutimos o uso de modelos básicos do SageMaker Jumpstart, o ajuste fino de modelos pré-treinados do Hugging Face e a criação de modelos de resumo personalizados. Cada abordagem tem suas próprias vantagens e desvantagens, atendendo a diferentes necessidades e requisitos.

Construir modelos de resumo personalizados no SageMaker permite muita flexibilidade e controle, mas requer mais tempo e recursos do que usar modelos pré-treinados. Os modelos básicos do SageMaker Jumpstart fornecem uma solução econômica e fácil de usar para organizações que não exigem personalização ou ajuste fino específico, bem como algumas opções para ajuste fino simplificado. O ajuste fino de modelos pré-treinados do Hugging Face oferece tempos de treinamento mais rápidos, melhor desempenho específico do domínio e integração perfeita com ferramentas e serviços SageMaker em um amplo catálogo de modelos, mas requer algum esforço de implementação. No momento em que escrevo este post, a Amazon anunciou outra opção, Rocha Amazônica, que oferecerá recursos de resumo em um ambiente ainda mais gerenciado.

Ao compreender os prós e os contras de cada abordagem, os profissionais e as organizações de saúde podem tomar decisões informadas sobre a solução mais adequada para gerar resumos concisos e precisos de dados clínicos complexos. Em última análise, o uso de modelos de resumo baseados em AI/ML no SageMaker pode melhorar significativamente o atendimento ao paciente e a tomada de decisões, permitindo que os profissionais médicos acessem rapidamente informações relevantes e se concentrem em fornecer atendimento de qualidade.

Recursos

Para o script completo discutido neste post e alguns dados de amostra, consulte o GitHub repo. Para obter mais informações sobre como executar cargas de trabalho de ML na AWS, consulte os seguintes recursos:

Sobre os autores

Cody Collins é arquiteto de soluções baseado em Nova York na Amazon Web Services. Ele trabalha com clientes ISV para criar soluções líderes do setor na nuvem. Ele entregou com sucesso projetos complexos para diversos setores, otimizando a eficiência e a escalabilidade. Em seu tempo livre, ele gosta de ler, viajar e treinar jiu jitsu.

Cody Collins é arquiteto de soluções baseado em Nova York na Amazon Web Services. Ele trabalha com clientes ISV para criar soluções líderes do setor na nuvem. Ele entregou com sucesso projetos complexos para diversos setores, otimizando a eficiência e a escalabilidade. Em seu tempo livre, ele gosta de ler, viajar e treinar jiu jitsu.

Ameer Hakme é um arquiteto de soluções da AWS residente na Pensilvânia. Seu foco profissional envolve a colaboração com fornecedores independentes de software em todo o Nordeste, orientando-os no projeto e construção de plataformas escaláveis e de última geração na Nuvem AWS.

Ameer Hakme é um arquiteto de soluções da AWS residente na Pensilvânia. Seu foco profissional envolve a colaboração com fornecedores independentes de software em todo o Nordeste, orientando-os no projeto e construção de plataformas escaláveis e de última geração na Nuvem AWS.

- Conteúdo com tecnologia de SEO e distribuição de relações públicas. Seja amplificado hoje.

- PlatoData.Network Gerativa Vertical Ai. Capacite-se. Acesse aqui.

- PlatoAiStream. Inteligência Web3. Conhecimento Amplificado. Acesse aqui.

- PlatãoESG. Automotivo / EVs, Carbono Tecnologia Limpa, Energia, Ambiente, Solar, Gestão de resíduos. Acesse aqui.

- BlockOffsets. Modernizando a Propriedade de Compensação Ambiental. Acesse aqui.

- Fonte: https://aws.amazon.com/blogs/machine-learning/exploring-summarization-options-for-healthcare-with-amazon-sagemaker/

- :tem

- :é

- :não

- :onde

- $UP

- 1

- 10

- 100

- 12

- 14

- 15%

- 24

- 33

- 7

- 8

- 9

- a

- Capaz

- Sobre

- RESUMO

- acelerar

- acelerador

- Acesso

- Conta

- preciso

- em

- ações

- Adam

- endereçando

- administrado

- avançado

- vantagens

- Depois de

- novamente

- agregação

- AI

- ai pesquisa

- AI / ML

- algoritmos

- Todos os Produtos

- Permitindo

- permite

- juntamente

- já

- tb

- Amazon

- Amazon Sage Maker

- Amazon Web Services

- quantidade

- quantidades

- an

- analisar

- e

- anunciou

- Outro

- qualquer

- api

- APIs

- relevante

- aplicações

- aplicado

- abordagem

- se aproxima

- apropriado

- arquitetura

- SOMOS

- ARM

- chegada

- artigo

- AS

- associado

- At

- por WhatsApp.

- automatizando

- disponível

- evitar

- longe

- AWS

- equilíbrio

- baseado

- BE

- Porque

- sido

- antes

- começar

- beneficiar

- Benefícios

- MELHOR

- Melhor

- BIN

- sangue

- Pressão arterial

- Florescer

- Caixa

- Respiração

- amplo

- construir

- construtores

- Prédio

- construído

- construídas em

- mas a

- by

- chamada

- chamado

- CAN

- capacidades

- Cuidado

- cuidadosamente

- casas

- casos

- catálogo

- Causar

- desafios

- alterar

- chatbots

- escolhas

- Escolha

- escolha

- escolhido

- classe

- Clínico

- Na nuvem

- código

- códigos

- Codificação

- colaborando

- Coluna

- colunas

- como

- vem

- comum

- comparado

- queixas

- integrações

- compliance

- componente

- componentes

- composta

- conciso

- Configuração

- Desvantagens

- cônsul

- construção

- contexto

- ao controle

- Conveniente

- Correspondente

- relação custo-benefício

- custos

- poderia

- coberto

- crio

- criado

- Criar

- crucial

- Atualmente

- personalizadas

- cliente

- Clientes

- personalização

- dados,

- conjuntos de dados

- Tomada de Decisão

- decisões

- definição

- entregue

- demonstrando

- Departamento

- dependente

- Dependendo

- implantar

- implantado

- Implantação

- desenvolvimento

- Design

- projetado

- concepção

- desejado

- detalhes

- desenvolvido

- Dispositivos/Instrumentos

- diferente

- diretamente

- descoberto

- discutir

- discutido

- diferente

- do

- Médicos

- fazer

- domínio

- domínios

- feito

- não

- down

- desvantagens

- durante

- cada

- mais fácil

- facilmente

- fácil

- fácil de usar

- efetivamente

- eficiência

- eficiente

- eficientemente

- esforço

- Eletrônico

- Registros Eletrônicos de Saúde

- elegibilidade

- kit

- permitir

- permite

- permitindo

- Ponto final

- Engenharia

- aumentar

- garantir

- Empreendimento

- entrada

- Meio Ambiente

- época

- essencial

- Mesmo

- evolução

- exemplo

- existente

- vasta experiência

- experimentando

- explorar

- Explorado

- Explorando

- estendendo

- extrato

- Rosto

- enfrentou

- longe

- mais rápido

- Alimentado

- poucos

- Envie o

- Arquivos

- final

- Finalmente

- Encontre

- descoberta

- Primeiro nome

- caber

- Flexibilidade

- Foco

- seguir

- seguinte

- Escolha

- formato

- Foundation

- da

- cheio

- totalmente

- função

- Além disso

- futuro

- Ganho

- Geral

- gerar

- gerado

- gerando

- ter

- obtendo

- OFERTE

- dado

- Dando

- Go

- GPUs

- ótimo

- maior

- garantido

- Ter

- he

- Saúde

- saúde

- Coração

- ajudar

- sua

- hospedagem

- Como funciona o dobrador de carta de canal

- Como Negociar

- HTML

- http

- HTTPS

- Hub

- Abraçando o Rosto

- ideal

- if

- Imagiologia

- executar

- implementação

- implementação

- importar

- importante

- melhorar

- in

- em profundidade

- incluir

- inclui

- Incluindo

- de treinadores em Entrevista Motivacional

- indústrias

- indústria

- INFORMAÇÕES

- informado

- do estado inicial,

- entrada

- inputs

- insights

- instância

- instruções

- integração

- Inteligência

- para dentro

- envolver

- IT

- ESTÁ

- Trabalho

- json

- apenas por

- Saber

- Conhecimento

- laboratório

- Laboratório

- paisagem

- língua

- grande

- Sobrenome

- mais tarde

- conduzir

- principal

- Leads

- APRENDER

- aprendizagem

- esquerda

- Biblioteca

- como

- LLM

- carregar

- carregamento

- localização

- lógica

- olhar

- perder

- fora

- máquina

- aprendizado de máquina

- moldadas

- a manter

- fazer

- Fazendo

- gerencia

- gerenciados

- de grupos

- mapa,

- Marketing

- Posso..

- significar

- médico

- Conheça

- Memória

- conheceu

- método

- poder

- mínimo

- Minutos

- ML

- modelo

- modelos

- Módulo

- mais

- a maioria

- Mais populares

- múltiplo

- Nomeado

- natural

- Processamento de linguagem natural

- Navegar

- você merece...

- Cria

- Novo

- New York

- recentemente

- Próximo

- PNL

- não

- caderno

- Notas

- agora

- número

- objeto

- objetos

- of

- oferecer

- oferecido

- Oferece

- Velho

- on

- ONE

- queridos

- começo

- para

- aberto

- open source

- operar

- otimização

- Otimize

- otimizado

- otimizando

- Opção

- Opções

- or

- ordem

- organizações

- original

- Outros

- de outra forma

- A Nossa

- Fora

- saída

- lado de fora

- Acima de

- próprio

- propriedade

- pacote

- acondicionamento

- página

- Dor

- parâmetro

- parâmetros

- particular

- passar

- Passagem

- paciente

- pacientes

- Pegasus

- Pennsylvania

- atuação

- pertencente

- Frases

- plataforma

- Plataformas

- platão

- Inteligência de Dados Platão

- PlatãoData

- ponto

- Popular

- Publique

- poderoso

- Powering

- prática

- Predictor

- preferir

- Preparar

- preparado

- presente

- pressão

- visualização

- anteriormente

- principalmente

- processo

- processos

- em processamento

- Produzido

- profissional

- projetos

- promessa

- proprietário

- PROS

- fornecer

- fornecido

- fornece

- fornecendo

- provisão

- propósito

- fins

- colocar

- Python

- qualidade

- Links

- rapidamente

- alcance

- rapidamente

- Taxa

- Leitura

- pronto

- mundo real

- registros

- relevante

- alívio

- remover

- Relatórios

- requerer

- requeridos

- Requisitos

- exige

- pesquisa

- Recursos

- resposta

- Resultados

- Retorna

- rever

- Tipo

- Execute

- corrida

- é executado

- sábio

- mesmo

- Salvar

- AMPLIAR

- escalável

- escopo

- arranhar

- Sdk

- SDK

- desatado

- seções

- segurança

- Vejo

- separado

- serviço

- Serviços

- conjunto

- contexto

- Configurações

- vários

- encurtado

- rede de apoio social

- mostrar

- mostrando

- Shows

- desligando

- Peneirar

- periodo

- de forma considerável

- semelhante

- simples

- simplificada

- Tamanho

- So

- até aqui

- Software

- solução

- Soluções

- alguns

- algo

- Fontes

- específico

- especificamente

- gasto

- começo

- Comece

- Estado

- estado-da-arte

- Passos

- armazenamento

- loja

- armazenadas

- armazenar

- racionalização

- estrutura

- estudo

- sublingual

- entraram com sucesso

- tal

- súbito

- terno

- adequado

- RESUMO

- certo

- Sintomas

- sinopse

- sintético

- dados sintéticos

- sistemas

- mesa

- Tire

- tomado

- toma

- Tarefa

- tarefas

- técnicas

- terminologia

- condições

- teste

- do que

- que

- A

- o hub

- Eles

- então

- Este

- deles

- isto

- aqueles

- três

- Através da

- todo

- tempo

- demorado

- vezes

- para

- hoje

- juntos

- tokenized

- Tokens

- ferramentas

- tocha

- Total

- Trem

- treinado

- Training

- transformado

- transformador

- transformadores

- Viagens

- dois

- tipo

- tipos

- tipicamente

- ui

- Em última análise

- incapaz

- para

- compreender

- compreensão

- Atualizar

- carregado

- us

- usar

- caso de uso

- usava

- user-friendly

- usos

- utilização

- Utilizando

- validação

- Valores

- vário

- Grande

- fornecedores

- versátil

- versão

- muito

- volumes

- queremos

- foi

- we

- Riqueza

- web

- serviços web

- pesar

- BEM

- O Quê

- quando

- qual

- enquanto

- Largo

- Ampla variedade

- precisarão

- de

- sem

- palavras

- Atividades:

- trabalhar

- trabalho

- seria

- escrita

- ano

- Iorque

- Vocês

- investimentos

- zefirnet

- Zip