Notícias falsas, definidas como notícias que transmitem ou incorporam informações falsas, fabricadas ou deliberadamente enganosas, já existem desde o surgimento da imprensa escrita. A rápida propagação de notícias falsas e desinformação online não só engana o público, como também pode ter um impacto profundo na sociedade, na política, na economia e na cultura. Exemplos incluem:

- Cultivando a desconfiança na mídia

- Minando o processo democrático

- Divulgar ciência falsa ou desacreditada (por exemplo, o movimento antivax)

Os avanços na inteligência artificial (IA) e no aprendizado de máquina (ML) tornaram ainda mais fácil o desenvolvimento de ferramentas para criar e compartilhar notícias falsas. Os primeiros exemplos incluem bots sociais avançados e contas automatizadas que turbinam o estágio inicial de divulgação de notícias falsas. Em geral, não é trivial para o público determinar se tais contas são pessoas ou bots. Além disso, os bots sociais não são ferramentas ilegais e muitas empresas os compram legalmente como parte da sua estratégia de marketing. Portanto, não é fácil restringir sistematicamente o uso de bots sociais.

Descobertas recentes no campo da IA generativa tornam possível produzir conteúdo textual em um ritmo sem precedentes com a ajuda de grandes modelos de linguagem (LLMs). LLMs são modelos de texto generativos de IA com mais de 1 bilhão de parâmetros e facilitam a síntese de texto de alta qualidade.

Nesta postagem, exploramos como você pode usar LLMs para resolver o problema predominante de detecção de notícias falsas. Sugerimos que os LLMs sejam suficientemente avançados para esta tarefa, especialmente se forem melhoradas técnicas de alerta, como Cadeia de Pensamento e Reagir são usados em conjunto com ferramentas para recuperação de informações.

Ilustramos isso criando um LangChain aplicativo que, diante de uma notícia, informa ao usuário se a matéria é verdadeira ou falsa em linguagem natural. A solução também utiliza Rocha Amazônica, um serviço totalmente gerenciado que torna os modelos básicos (FMs) da Amazon e de fornecedores de modelos terceirizados acessíveis por meio do Console de gerenciamento da AWS e APIs.

LLMs e notícias falsas

O fenômeno das notícias falsas começou a evoluir rapidamente com o advento da Internet e, mais especificamente, das mídias sociais (Nielsen et al., 2017). Nas redes sociais, notícias falsas podem ser compartilhadas rapidamente na rede de um usuário, levando o público a formar uma opinião coletiva errada. Além disso, as pessoas muitas vezes propagam notícias falsas impulsivamente, ignorando a factualidade do conteúdo se a notícia estiver em consonância com as suas normas pessoais (Tsipursky et al. 2018). Pesquisas em ciências sociais sugeriram que o viés cognitivo (viés de confirmação, efeito de movimento e viés de apoio à escolha) é um dos fatores mais importantes na tomada de decisões irracionais em termos de criação e consumo de notícias falsas (Kim, et al., 2021). Isto também implica que os consumidores de notícias partilham e consomem informação apenas no sentido de fortalecer as suas crenças.

O poder da IA generativa para produzir conteúdo textual e rico a um ritmo sem precedentes agrava o problema das notícias falsas. Um exemplo que vale a pena mencionar é a tecnologia deepfake – combinando várias imagens em um vídeo original e gerando um vídeo diferente. Além da intenção de desinformação que os atores humanos trazem para a mistura, os LLMs acrescentam todo um novo conjunto de desafios:

- erros factuais – Os LLMs têm um risco aumentado de conter erros factuais devido à natureza da sua formação e à capacidade de serem criativos ao gerar as próximas palavras numa frase. O treinamento LLM é baseado na apresentação repetida de um modelo com entradas incompletas e, em seguida, no uso de técnicas de treinamento de ML até preencher corretamente as lacunas, aprendendo assim a estrutura da linguagem e um modelo mundial baseado na linguagem. Conseqüentemente, embora os LLMs sejam ótimos combinadores e recombinadores de padrões (“papagaios estocásticos”), eles falham em uma série de tarefas simples que exigem raciocínio lógico ou dedução matemática, e podem alucinar respostas. Além disso, a temperatura é um dos parâmetros de entrada do LLM que controla o comportamento do modelo ao gerar a próxima palavra em uma frase. Ao selecionar uma temperatura mais alta, o modelo utilizará uma palavra de menor probabilidade, proporcionando uma resposta mais aleatória.

- Longo – Os textos gerados tendem a ser longos e carecem de uma granularidade claramente definida para factos individuais.

- Falta de verificação de fatos – Não há ferramentas padronizadas disponíveis para verificação de fatos durante o processo de geração de texto.

No geral, a combinação da psicologia humana e das limitações dos sistemas de IA criou uma tempestade perfeita para a proliferação de notícias falsas e desinformação online.

Visão geral da solução

Os LLMs estão demonstrando capacidades excepcionais em geração de linguagem, compreensão e aprendizado rápido. Eles são treinados em um vasto corpus de texto da Internet, onde a qualidade e a precisão da linguagem natural extraída podem não ser garantidas.

Nesta postagem, fornecemos uma solução para detectar notícias falsas com base nas abordagens imediatas de Cadeia de Pensamento e Reação (Raciocínio e Ação). Primeiro, discutimos essas duas técnicas de engenharia imediata e, em seguida, mostramos sua implementação usando LangChain e Amazon Bedrock.

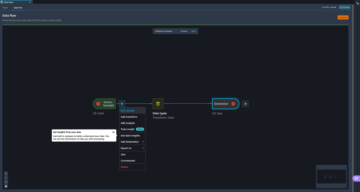

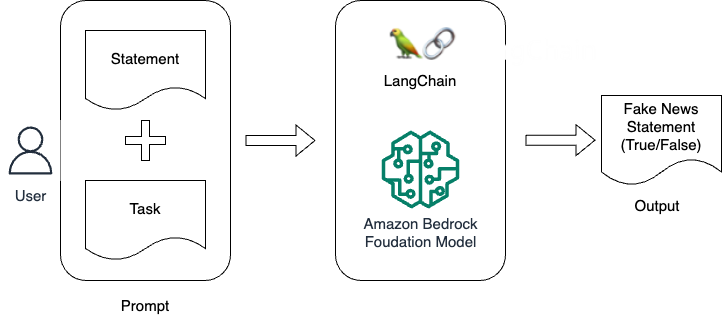

O diagrama de arquitetura a seguir descreve a solução para nosso detector de notícias falsas.

Diagrama de arquitetura para detecção de notícias falsas.

Usamos um subconjunto do Conjunto de dados FEBRE contendo uma declaração e a verdade básica sobre a declaração indicando afirmações falsas, verdadeiras ou não verificáveis (Thorne J. e outros, 2018).

O fluxo de trabalho pode ser dividido nas seguintes etapas:

- O usuário seleciona uma das afirmações para verificar se é falsa ou verdadeira.

- A declaração e a tarefa de detecção de notícias falsas são incorporadas ao prompt.

- O prompt é passado para LangChain, que invoca o FM no Amazon Bedrock.

- O Amazon Bedrock retorna uma resposta à solicitação do usuário com a instrução True ou False.

Neste post, utilizamos o modelo Claude v2 da Anthropic (anthropic.claude-v2). Claude é um LLM generativo baseado na pesquisa da Anthropic na criação de sistemas de IA confiáveis, interpretáveis e orientáveis. Criado usando técnicas como IA constitucional e treinamento de inocuidade, Claude se destaca no diálogo cuidadoso, criação de conteúdo, raciocínio complexo, criatividade e codificação. No entanto, ao usar o Amazon Bedrock e nossa arquitetura de solução, também temos a flexibilidade de escolher entre outros FMs fornecidos pela Amazon, AI21labs, Coerente e Estabilidade.

Você pode encontrar os detalhes da implementação nas seções a seguir. O código fonte está disponível em o repositório GitHub.

Pré-requisitos

Para este tutorial, você precisa de um terminal bash com Python 3.9 ou superior instalado no Linux, Mac ou em um subsistema Windows para Linux e uma conta AWS.

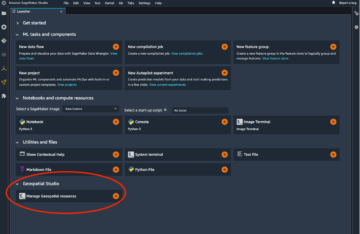

Também recomendamos o uso de um Estúdio Amazon SageMaker caderno, um Nuvem AWS9 exemplo, ou um Amazon Elastic Compute Nuvem (Amazon EC2).

Implante a detecção de notícias falsas usando a API Amazon Bedrock

A solução usa a API Amazon Bedrock, que pode ser acessada usando o Interface de linha de comando da AWS (AWS CLI), o SDK da AWS para Python (Boto3), Ou uma Amazon Sage Maker caderno. Consulte o Guia do usuário do Amazon Bedrock Para maiores informações. Para esta postagem, usamos a API Amazon Bedrock por meio do AWS SDK para Python.

Configurar o ambiente da API Amazon Bedrock

Para configurar seu ambiente de API do Amazon Bedrock, conclua as seguintes etapas:

- Baixe o Boto3 mais recente ou atualize-o:

- Certifique-se de configurar as credenciais da AWS usando o

aws configurecomando ou passe-os para o cliente Boto3. - Instale a última versão do LangChain:

Agora você pode testar sua configuração usando o seguinte script de shell Python. O script instancia o cliente Amazon Bedrock usando Boto3. A seguir, chamamos o list_foundation_models API para obter a lista de modelos básicos disponíveis para uso.

Depois de executar com êxito o comando anterior, você deverá obter a lista de FMs do Amazon Bedrock.

LangChain como uma solução de encadeamento imediato

Para detectar notícias falsas para uma determinada frase, seguimos o processo de raciocínio Zero Shot Chain of Thought (Wei J. et al., 2022), que é composto pelas seguintes etapas:

- Inicialmente, o modelo tenta criar um enunciado sobre a notícia solicitada.

- O modelo cria uma lista de asserções com marcadores.

- Para cada afirmação, o modelo determina se a afirmação é verdadeira ou falsa. Observe que utilizando esta metodologia, o modelo depende exclusivamente de seu conhecimento interno (pesos calculados na fase de pré-treinamento) para chegar a um veredicto. As informações não são verificadas em relação a quaisquer dados externos neste momento.

- Dados os fatos, o modelo responde VERDADEIRO ou FALSO para a afirmação fornecida no prompt.

Para cumprir essas etapas, utilizamos LangChain, um framework para desenvolvimento de aplicações alimentadas por modelos de linguagem. Essa estrutura nos permite aumentar os FMs encadeando vários componentes para criar casos de uso avançados. Nesta solução, usamos o integrado Cadeia Sequencial Simples em LangChain para criar uma cadeia sequencial simples. Isso é muito útil porque podemos pegar a saída de uma cadeia e usá-la como entrada para outra.

O Amazon Bedrock é integrado ao LangChain, portanto, você só precisa instanciá-lo passando o comando model_id ao instanciar o objeto Amazon Bedrock. Se necessário, os parâmetros de inferência do modelo podem ser fornecidos através do model_kwargs argumento, como:

- maxTokenCount – O número máximo de tokens na resposta gerada

- pararSequências – A sequência de parada usada pelo modelo

- temperatura – Um valor que varia entre 0–1, sendo 0 o mais determinístico e 1 o mais criativo

- topo – Um valor que varia entre 0–1 e é usado para controlar as escolhas dos tokens com base na probabilidade das escolhas potenciais

Se esta for a primeira vez que você está usando um modelo fundamental do Amazon Bedrock, solicite acesso ao modelo selecionando na lista de modelos na página Acesso ao modelo página no console Amazon Bedrock, que no nosso caso é claude-v2 da Anthropic.

A função a seguir define a cadeia de prompts Chain-of-Thought que mencionamos anteriormente para detectar notícias falsas. A função usa o objeto Amazon Bedrock (llm) e o prompt do usuário (q) como argumentos. LangChain's Modelo de prompt a funcionalidade é usada aqui para predefinir uma receita para gerar prompts.

O código a seguir chama a função que definimos anteriormente e fornece a resposta. A declaração é TRUE or FALSE. TRUE significa que a declaração fornecida contém fatos corretos, e FALSE significa que a afirmação contém pelo menos um fato incorreto.

Um exemplo de declaração e resposta de modelo é fornecido na saída a seguir:

ReAct e ferramentas

No exemplo anterior, o modelo identificou corretamente que a afirmação é falsa. No entanto, submeter novamente a consulta demonstra a incapacidade do modelo em distinguir a veracidade dos factos. O modelo não possui as ferramentas para verificar a veracidade das declarações além de sua própria memória de treinamento, portanto, execuções subsequentes do mesmo prompt podem levá-lo a rotular erroneamente declarações falsas como verdadeiras. No código a seguir, você tem uma execução diferente do mesmo exemplo:

Uma técnica para garantir a veracidade é o ReAct. Reagir (Yao S. et al., 2023) é uma técnica imediata que amplia o modelo básico com o espaço de ação de um agente. Nesta postagem, assim como no artigo ReAct, o espaço de ação implementa a recuperação de informações usando ações de pesquisa, pesquisa e finalização de uma simples API da web da Wikipedia.

A razão por trás do uso do ReAct em comparação com o Chain-of-Thought é usar a recuperação de conhecimento externo para aumentar o modelo básico para detectar se uma determinada notícia é falsa ou verdadeira.

Nesta postagem, usamos a implementação do ReAct do LangChain por meio do agente ZERO_SHOT_REACT_DESCRIPTION. Modificamos a função anterior para implementar ReAct e usar a Wikipedia usando a função load_tools do langchain.agentes.

Também precisamos instalar o pacote Wikipedia:

!pip install Wikipedia

Abaixo está o novo código:

A seguir está a saída da função anterior, dada a mesma instrução usada antes:

limpar

Para economizar custos, exclua todos os recursos implementados como parte do tutorial. Se você executou o AWS Cloud9 ou uma instância do EC2, poderá excluí-lo por meio do console ou usando a AWS CLI. Da mesma forma, você pode excluir o bloco de notas do SageMaker que pode ter criado por meio do console do SageMaker.

Limitações e trabalhos relacionados

O campo da detecção de notícias falsas é pesquisado ativamente na comunidade científica. Neste post, usamos as técnicas Chain-of-Thought e ReAct e, na avaliação das técnicas, focamos apenas na precisão da classificação da técnica prompt (se uma determinada afirmação é verdadeira ou falsa). Portanto, não consideramos outros aspectos importantes, como a velocidade de resposta, nem estendemos a solução para fontes adicionais de base de conhecimento além da Wikipédia.

Embora esta postagem tenha se concentrado em duas técnicas, Chain-of-Thought e ReAct, um extenso conjunto de trabalhos explorou como os LLMs podem detectar, eliminar ou mitigar notícias falsas. Lee et al. propôs o uso de um modelo codificador-decodificador usando NER (reconhecimento de entidade nomeada) para mascarar as entidades nomeadas, a fim de garantir que o token mascarado realmente use o conhecimento codificado no modelo de linguagem. Chern et al. desenvolveu o FacTool, que usa princípios de cadeia de pensamento para extrair afirmações do prompt e, consequentemente, coletar evidências relevantes das afirmações. O LLM então julga a factualidade da reivindicação dada a lista de evidências recuperada. Du E. et al. apresenta uma abordagem complementar onde vários LLMs propõem e debatem as suas respostas individuais e processos de raciocínio ao longo de múltiplas rodadas, a fim de chegar a uma resposta final comum.

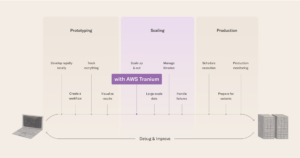

Com base na literatura, vemos que a eficácia dos LLMs na detecção de notícias falsas aumenta quando os LLMs são aumentados com conhecimento externo e capacidade de conversação multiagente. No entanto, essas abordagens são mais complexas do ponto de vista computacional porque exigem múltiplas chamadas e interações de modelo, prompts mais longos e chamadas de camada de rede demoradas. Em última análise, esta complexidade traduz-se num aumento do custo global. Recomendamos avaliar a relação custo/desempenho antes de implantar soluções semelhantes na produção.

Conclusão

Neste post, investigamos como usar LLMs para lidar com a questão predominante das notícias falsas, que é um dos maiores desafios da nossa sociedade hoje em dia. Começámos por delinear os desafios apresentados pelas notícias falsas, com ênfase no seu potencial para influenciar o sentimento público e causar perturbações sociais.

Em seguida, introduzimos o conceito de LLMs como modelos avançados de IA que são treinados em uma quantidade substancial de dados. Devido a este extenso treinamento, esses modelos possuem uma compreensão impressionante da linguagem, permitindo-lhes produzir texto semelhante ao humano. Com esta capacidade, demonstramos como os LLMs podem ser aproveitados na batalha contra notícias falsas usando duas técnicas diferentes de alerta, Chain-of-Thought e ReAct.

Sublinhámos como os LLM podem facilitar os serviços de verificação de factos numa escala sem paralelo, dada a sua capacidade de processar e analisar rapidamente grandes quantidades de texto. Este potencial de análise em tempo real pode levar à detecção precoce e à contenção de notícias falsas. Ilustramos isso criando um script Python que, dada uma declaração, destaca para o usuário se o artigo é verdadeiro ou falso usando linguagem natural.

Concluímos sublinhando as limitações da abordagem atual e terminamos com uma nota de esperança, sublinhando que, com as salvaguardas corretas e melhorias contínuas, os LLMs poderão tornar-se ferramentas indispensáveis na luta contra as notícias falsas.

Adoraríamos ouvir de você. Deixe-nos saber o que você pensa na seção de comentários ou use o fórum de problemas em o repositório GitHub.

Isenção de responsabilidade: o código fornecido nesta postagem destina-se apenas a fins educacionais e de experimentação. Não se deve confiar nele para detectar notícias falsas ou desinformação em sistemas de produção do mundo real. Nenhuma garantia é dada sobre a precisão ou integridade da detecção de notícias falsas usando este código. Os usuários devem ter cautela e realizar a devida diligência antes de utilizar essas técnicas em aplicações confidenciais.

Para começar a usar o Amazon Bedrock, visite o Console Amazon Bedrock.

Sobre os autores

Anamaria Todor é arquiteto de soluções principal baseado em Copenhague, Dinamarca. Ela viu seu primeiro computador quando tinha 4 anos e nunca mais largou a ciência da computação, os videogames e a engenharia desde então. Ela trabalhou em diversas funções técnicas, desde freelancer, desenvolvedora full-stack, até engenheira de dados, líder técnica e CTO, em diversas empresas na Dinamarca, com foco nas indústrias de jogos e publicidade. Ela está na AWS há mais de 3 anos, trabalhando como Arquiteta Principal de Soluções, com foco principalmente em ciências biológicas e IA/ML. Anamaria é bacharel em Engenharia Aplicada e Ciência da Computação, mestre em Ciência da Computação e mais de 10 anos de experiência em AWS. Quando não está trabalhando ou jogando videogame, ela treina meninas e profissionais do sexo feminino para compreender e encontrar seu caminho através da tecnologia.

Anamaria Todor é arquiteto de soluções principal baseado em Copenhague, Dinamarca. Ela viu seu primeiro computador quando tinha 4 anos e nunca mais largou a ciência da computação, os videogames e a engenharia desde então. Ela trabalhou em diversas funções técnicas, desde freelancer, desenvolvedora full-stack, até engenheira de dados, líder técnica e CTO, em diversas empresas na Dinamarca, com foco nas indústrias de jogos e publicidade. Ela está na AWS há mais de 3 anos, trabalhando como Arquiteta Principal de Soluções, com foco principalmente em ciências biológicas e IA/ML. Anamaria é bacharel em Engenharia Aplicada e Ciência da Computação, mestre em Ciência da Computação e mais de 10 anos de experiência em AWS. Quando não está trabalhando ou jogando videogame, ela treina meninas e profissionais do sexo feminino para compreender e encontrar seu caminho através da tecnologia.

Marcelo Castro é arquiteto de soluções sênior baseado em Oslo, Noruega. Em sua função, Marcel ajuda os clientes com arquitetura, design e desenvolvimento de infraestrutura otimizada para nuvem. Ele é membro da equipe de embaixadores de IA generativa da AWS com o objetivo de orientar e apoiar os clientes da EMEA em sua jornada de IA generativa. Ele possui doutorado em Ciência da Computação pela Suécia e mestrado e bacharelado em Engenharia Elétrica e Telecomunicações pelo Brasil.

Marcelo Castro é arquiteto de soluções sênior baseado em Oslo, Noruega. Em sua função, Marcel ajuda os clientes com arquitetura, design e desenvolvimento de infraestrutura otimizada para nuvem. Ele é membro da equipe de embaixadores de IA generativa da AWS com o objetivo de orientar e apoiar os clientes da EMEA em sua jornada de IA generativa. Ele possui doutorado em Ciência da Computação pela Suécia e mestrado e bacharelado em Engenharia Elétrica e Telecomunicações pelo Brasil.

- Conteúdo com tecnologia de SEO e distribuição de relações públicas. Seja amplificado hoje.

- PlatoData.Network Gerativa Vertical Ai. Capacite-se. Acesse aqui.

- PlatoAiStream. Inteligência Web3. Conhecimento Amplificado. Acesse aqui.

- PlatãoESG. Carbono Tecnologia Limpa, Energia, Ambiente, Solar, Gestão de resíduos. Acesse aqui.

- PlatoHealth. Inteligência em Biotecnologia e Ensaios Clínicos. Acesse aqui.

- Fonte: https://aws.amazon.com/blogs/machine-learning/harness-large-language-models-in-fake-news-detection/

- :tem

- :é

- :não

- :onde

- $ 100 milhões

- $UP

- 1

- 10

- 100

- 12

- 13

- 14

- 20

- 2022

- 21st

- 26%

- 27

- 32

- 36

- 7

- 9

- a

- habilidade

- Sobre

- acima

- AC

- acadêmico

- pesquisa acadêmica

- Academia

- Acesso

- acessadas

- acessível

- Conta

- Contas

- precisão

- Alcançar

- realizações

- em

- atuação

- Açao Social

- ações

- ativamente

- atores

- adicionar

- Adição

- Adicional

- avançado

- advento

- Publicidade

- novamente

- contra

- Agente

- agentes

- AI

- Modelos de IA

- Sistemas de IA

- AI / ML

- AL

- Todos os Produtos

- permite

- sozinho

- tb

- Apesar

- Amazon

- Amazon EC2

- Amazon Web Services

- Embaixadora

- americano

- entre

- quantidades

- an

- análise

- analisar

- Antigo

- e

- Anualmente

- Outro

- responder

- respostas

- Antrópico

- qualquer

- api

- APIs

- aparece

- Aplicação

- aplicações

- aplicado

- nomeado

- abordagem

- se aproxima

- aproximadamente

- arquitetura

- SOMOS

- argumento

- argumentos

- por aí

- artigo

- artificial

- inteligência artificial

- Inteligência artificial (AI)

- Artes

- AS

- aspectos

- Avaliando

- avaliações

- suposições

- certo

- astronomia

- At

- Tentativas

- aumentar

- aumentado

- aumentos

- Automatizado

- disponível

- premiado

- AWS

- Nuvem AWS9

- base

- baseado

- bater

- Batalha

- BE

- Porque

- tornam-se

- tornando-se

- sido

- antes

- comportamento

- atrás

- ser

- crenças

- além de

- entre

- Pós

- viés

- bilhão

- biologia

- biomédica

- corpo

- ambos

- bots

- Brazil

- trazer

- Quebrado

- construídas em

- empresário

- mas a

- by

- chamada

- chamadas

- CAN

- capacidades

- capacidade

- Capacidade

- casas

- casos

- Causar

- cautela

- Century

- cadeia

- correntes

- desafios

- chang

- verificar

- química

- chinês

- escolhas

- Escolha

- reivindicar

- reivindicações

- classe

- classificação

- claramente

- cliente

- Fechar

- Cloud9

- treinamento

- código

- Codificação

- cognitivo

- coletar

- Collective

- Faculdade

- COLÔMBIA

- combinação

- comentários

- comum

- geralmente

- comunidade

- Empresas

- comparação

- complementar

- completar

- integrações

- complexidade

- componentes

- composta

- Computar

- computador

- Ciência da Computação

- conceito

- Concluído

- Confirmar

- confirmação

- conjunção

- Consequentemente

- considerado

- consistente

- consiste

- cônsul

- consumir

- Consumidores

- consumo

- Contenção

- contém

- conteúdo

- Criação de conteúdo

- contínuo

- contribuição

- ao controle

- controles

- Conversa

- correta

- corretamente

- Custo

- custos

- poderia

- países

- país

- crio

- criado

- cria

- Criar

- criação

- Criatividade

- criatividade

- Credenciais

- CTO

- Cultura

- refrear

- Atual

- Clientes

- dados,

- debate

- decisões

- definido

- Define

- Grau

- democrático

- demonstraram

- demonstra

- demonstrando

- Dinamarca

- Departamento

- implantado

- Implantação

- Design

- detalhes

- descobrir

- Detecção

- Determinar

- determina

- desenvolvido

- Developer

- em desenvolvimento

- Desenvolvimento

- desenvolvimentos

- Diálogo

- diferente

- diligência

- direção

- discutir

- desinformação

- Ecrã

- interrupções

- distinguir

- desconfiança

- Médico

- parece

- Não faz

- down

- dr

- distância

- dois

- durante

- e

- E & T

- cada

- Mais cedo

- Cedo

- ganhar

- ganhou

- terra

- mais fácil

- fácil

- Economia

- economia

- educacional

- educadores

- efeito

- eficácia

- ou

- eliminado

- em outro lugar

- EMEA

- emergência

- ênfase

- permitindo

- terminou

- engenheiro

- Engenharia

- Melhorias

- garantir

- entrar

- entidades

- entidade

- Meio Ambiente

- igualdade

- erros

- especialmente

- estabelecido

- avaliação

- Mesmo

- eventos

- evolução

- exemplo

- exemplos

- exclusivamente

- Exercício

- vasta experiência

- Explicação

- explorar

- Explorado

- extenso

- externo

- extrato

- facilitar

- facilitado

- fato

- fatores

- fatos

- FALHA

- falsificação

- notícias falsas

- falso

- famoso

- feminina

- campo

- lutar

- preenchimentos

- final

- financeiro

- Encontre

- descoberta

- acabamento

- Primeiro nome

- primeira vez

- Flexibilidade

- focado

- concentra-se

- focando

- seguir

- seguinte

- Escolha

- formulário

- formal

- Fórum

- Foundation

- Fundacional

- Fundado

- Quadro

- da

- fu

- totalmente

- função

- funcionalidade

- Games

- jogos

- lacunas

- Gênero

- Igualdade de Género

- Geral

- gerar

- gerado

- gerando

- geração

- generativo

- IA generativa

- ter

- meninas

- GitHub

- dado

- Go

- meta

- ótimo

- Solo

- garantias

- tinha

- arreios

- Ter

- he

- ouvir

- ajudar

- ajuda

- sua experiência

- SUA PARTICIPAÇÃO FAZ A DIFERENÇA

- alta qualidade

- superior

- destaques

- altamente

- sua

- história

- detém

- honra

- esperançoso

- habitação

- Como funciona o dobrador de carta de canal

- Como Negociar

- Contudo

- HTML

- http

- HTTPS

- humano

- i

- IBM

- identificado

- if

- Ilegal

- ilustrar

- imagens

- Impacto

- executar

- implementação

- implementa

- importar

- importante

- impressionante

- melhorado

- in

- incapacidade

- incluir

- inclui

- Incluindo

- Incorporado

- incorpora

- aumentou

- Aumenta

- indicam

- Individual

- indústrias

- INFORMAÇÕES

- Informa

- Infraestrutura

- do estado inicial,

- entrada

- dentro

- instalar

- instalado

- instância

- Instituto

- instituições

- integrado

- Inteligência

- intenção

- interações

- interno

- Internet

- para dentro

- introduzido

- invoca

- envolvido

- emitem

- questões

- IT

- ESTÁ

- viagem

- jpg

- json

- juízes

- kenneth

- Saber

- Conhecimento

- conhecido

- Falta

- língua

- grande

- Atrasado

- mais recente

- latino

- lançado

- camada

- conduzir

- principal

- aprendizagem

- mínimo

- legalmente

- deixar

- vida

- Ciências da Vida

- como

- limitações

- Line

- Links

- linux

- Lista

- Listado

- literatura

- LLM

- lógico

- mais

- pesquisa

- gosta,

- mac

- máquina

- aprendizado de máquina

- moldadas

- principalmente

- mantém

- principal

- fazer

- FAZ

- Fazendo

- gerenciados

- de grupos

- muitos

- Marketing

- máscara

- mestre

- matemático

- matemática

- máximo

- Posso..

- significa

- significava

- Mídia

- médico

- medicina

- membro

- Membros

- Memória

- mencionado

- Metodologia

- Michigan

- milhão

- minas

- Desinformação

- enganosa

- MIT

- Mitigar

- misturar

- ML

- modelo

- modelos

- modificar

- mais

- a maioria

- movimento

- múltiplo

- my

- Nomeado

- NASA

- Nacional

- natural

- Natureza

- você merece...

- necessário

- rede

- nunca

- Novo

- notícias

- Próximo

- não

- Prêmio Nobel

- normas

- Noruega

- notável

- caderno

- agora

- número

- objeto

- observação

- Outubro

- of

- oferecido

- frequentemente

- Velho

- on

- ONE

- online

- só

- Operações

- Opinião

- or

- ordem

- original

- Outros

- de outra forma

- A Nossa

- contornos

- delineando

- saída

- marcante

- Acima de

- global

- próprio

- propriedade

- Paz

- pacote

- página

- páginas

- Papel

- parâmetros

- parte

- passar

- passou

- Passagem

- Patentes

- caminho

- padrão

- Pessoas

- perfeita

- Realizar

- pessoal

- fase

- phd

- fenómeno

- filosofia

- Física

- peça

- essencial

- platão

- Inteligência de Dados Platão

- PlatãoData

- jogar

- ponto

- política

- possível

- Publique

- potencial

- poder

- alimentado

- apresentado

- presentes

- imprensa

- prevalecente

- anterior

- anteriormente

- principalmente

- Diretor

- princípios

- impressão

- Imprensa

- Prévio

- prêmios

- Problema

- processo

- processos

- produzir

- Produção

- profundo

- Agenda

- oferece

- proposto

- fornecer

- fornecido

- fornecedores

- fornece

- fornecendo

- Psicologia

- público

- compra

- fins

- Python

- qualidade

- quantidade

- rapidamente

- Rádio

- acaso

- gamas

- classificado

- rápido

- rapidamente

- relação

- alcançar

- Reagir

- mundo real

- em tempo real

- razão

- receber

- recebido

- receita

- reconhecimento

- recomendar

- referir

- refere-se

- relacionado

- relativamente

- relevante

- confiável

- REPETIDAMENTE

- repositório

- solicitar

- requerer

- requeridos

- pesquisa

- Ressoa

- Recursos

- Responder

- resposta

- respostas

- responsável

- retorno

- Retorna

- Rico

- Risco

- Tipo

- papéis

- rodadas

- Execute

- corrida

- é executado

- s

- proteções

- sábio

- mesmo

- Salvar

- serra

- Escala

- Escola

- Escola de Engenharia

- Ciência

- CIÊNCIAS

- científico

- cientistas

- escrita

- Sdk

- Pesquisar

- Seção

- seções

- Vejo

- selecionando

- senior

- sensível

- sentença

- sentimento

- Seqüência

- serviço

- Serviços

- conjunto

- instalação

- Partilhar

- compartilhado

- ações

- compartilhando

- ela

- concha

- rede de apoio social

- mostrar

- semelhante

- Similarmente

- simples

- desde

- irmã

- So

- Redes Sociais

- meios de comunicação social

- social

- Sociedade

- solução

- Soluções

- alguns

- fonte

- código fonte

- Fontes

- Espaço

- abrangendo

- especificamente

- velocidade

- propagação

- Espalhando

- Etapa

- padrão

- Stanford

- Universidade de Stanford

- começado

- Declaração

- declarações

- Unidos

- Passos

- Dê um basta

- Storm

- Estratégia

- fortalecimento

- estrutura

- Estudantes

- Estudo

- subseqüente

- substancial

- entraram com sucesso

- tal

- sugerir

- RESUMO

- Sobrecarregar

- ajuda

- certo

- Balançar

- Suécia

- rapidamente

- síntese

- sistemas

- equipamento

- Tire

- toma

- Tarefa

- tarefas

- Profissionais

- Dados Técnicos:

- técnica

- técnicas

- tecnológica

- Tecnologia

- telecomunicações

- modelo

- terminal

- condições

- teste

- texto

- textual

- que

- A

- as informações

- A fonte

- o mundo

- deles

- Eles

- então

- Lá.

- assim

- assim sendo

- Este

- deles

- think

- De terceiros

- isto

- aqueles

- pensamento

- Através da

- todo

- GRAVATA

- tempo

- linha do tempo

- para

- juntos

- token

- Tokens

- ferramentas

- treinado

- Training

- verdadeiro

- Verdade

- tutorial

- dois

- Em última análise

- sublinhado

- compreensão

- Unido

- Estados Unidos

- Universidades

- universidade

- inigualável

- sem precedente

- até

- atualização

- sobre

- us

- usar

- usava

- Utilizador

- usuários

- usos

- utilização

- Utilizando

- valor

- vário

- Grande

- Veredito

- verificado

- verificar

- versão

- muito

- via

- Vídeo

- jogos de vídeo

- Visite a

- foi

- we

- web

- serviços web

- BEM

- O Quê

- quando

- se

- qual

- enquanto

- QUEM

- inteiro

- porque

- Wikipedia

- precisarão

- Windows

- de

- dentro

- mulher

- Mulher

- Ganhou

- Word

- palavras

- Atividades:

- trabalhou

- de gestão de documentos

- trabalhar

- mundo

- Equivalente há

- Errado

- anos

- Vocês

- investimentos

- zefirnet