Grandes modelos de linguagem (LLMs), com seu amplo conhecimento, podem gerar textos semelhantes aos humanos sobre quase todos os tópicos. No entanto, a sua formação em conjuntos de dados massivos também limita a sua utilidade para tarefas especializadas. Sem aprendizagem contínua, estes modelos permanecem alheios aos novos dados e tendências que surgem após a sua formação inicial. Além disso, o custo para treinar novos LLMs pode ser proibitivo para muitos ambientes empresariais. Porém, é possível cruzar uma resposta do modelo com o conteúdo especializado original, evitando assim a necessidade de treinar um novo modelo LLM, utilizando Retrieval-Augmented Generation (RAG).

O RAG capacita os LLMs, dando-lhes a capacidade de recuperar e incorporar conhecimento externo. Em vez de confiar apenas no conhecimento pré-treinado, o RAG permite que os modelos extraiam dados de documentos, bancos de dados e muito mais. O modelo então integra habilmente essas informações externas em seu texto gerado. Ao obter dados relevantes ao contexto, o modelo pode fornecer respostas informadas e atualizadas, adaptadas ao seu caso de uso. O aumento do conhecimento também reduz a probabilidade de alucinações e textos imprecisos ou sem sentido. Com o RAG, os modelos básicos tornam-se especialistas adaptáveis que evoluem à medida que sua base de conhecimento cresce.

Hoje, temos o prazer de revelar três demonstrações generativas de IA, licenciadas sob Licença MIT-0:

- Amazon Kendra com LLM fundamental – Utiliza os recursos de pesquisa profunda de Amazona Kendra combinado com o amplo conhecimento de LLMs. Essa integração fornece respostas precisas e sensíveis ao contexto para consultas complexas, com base em diversas fontes.

- Modelo de incorporações com LLM fundamental – Mescla o poder dos embeddings – uma técnica para capturar significados semânticos de palavras e frases – com a vasta base de conhecimento dos LLMs. Essa sinergia permite modelagem de tópicos, recomendação de conteúdo e recursos de pesquisa semântica mais precisos.

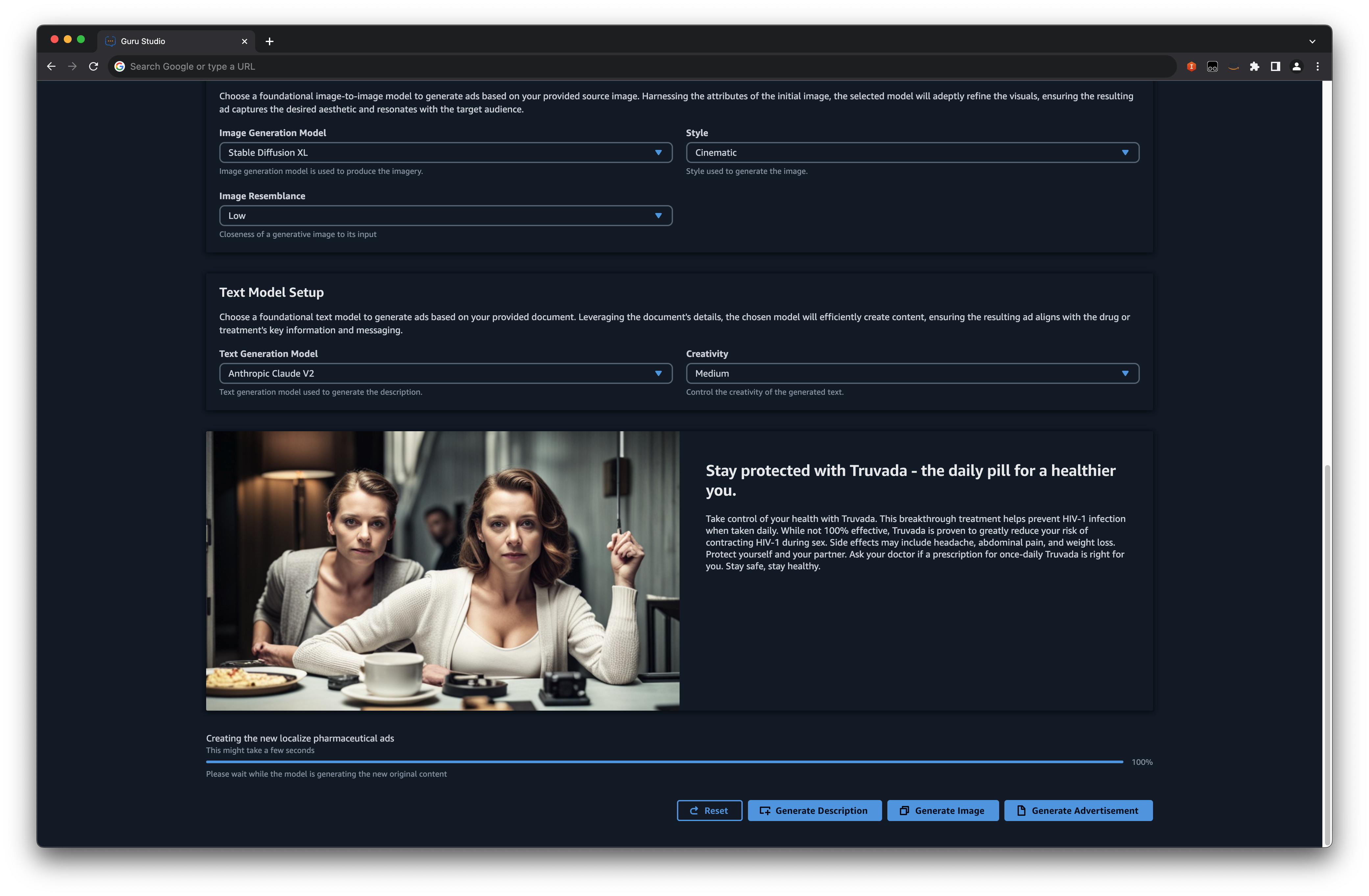

- Gerador de anúncios farmacêuticos de modelos básicos - Um aplicativo especializado feito sob medida para a indústria farmacêutica. Aproveitando os recursos geradores de modelos básicos, esta ferramenta cria anúncios farmacêuticos convincentes e compatíveis, garantindo que o conteúdo esteja em conformidade com os padrões e regulamentações do setor.

Essas demonstrações podem ser implantadas perfeitamente em sua conta da AWS, oferecendo insights básicos e orientação sobre a utilização de serviços da AWS para criar um bot de perguntas e respostas de IA generativo de LLM de última geração e geração de conteúdo.

Nesta postagem, exploramos como o RAG combinado com o Amazon Kendra ou incorporações personalizadas pode superar esses desafios e fornecer respostas refinadas a consultas em linguagem natural.

Visão geral da solução

Ao adotar esta solução, você pode obter os seguintes benefícios:

- Melhor acesso à informação – O RAG permite que os modelos extraiam informações de vastas fontes externas, o que pode ser especialmente útil quando o conhecimento do modelo pré-treinado está desatualizado ou incompleto.

- AMPLIAR – Em vez de treinar um modelo com todos os dados disponíveis, o RAG permite que os modelos recuperem informações relevantes dinamicamente. Isso significa que, à medida que novos dados ficam disponíveis, eles podem ser adicionados ao banco de dados de recuperação sem a necessidade de treinar novamente todo o modelo.

- Eficiência de memória – LLMs requerem memória significativa para armazenar parâmetros. Com o RAG o modelo pode ser menor porque não precisa memorizar todos os detalhes; ele pode recuperá-los quando necessário.

- Atualização dinâmica de conhecimento – Ao contrário dos modelos convencionais com um ponto final de conhecimento definido, o banco de dados externo do RAG pode passar por atualizações regulares, garantindo ao modelo acesso a informações atualizadas. A função de recuperação pode ser ajustada para tarefas distintas. Por exemplo, uma tarefa de diagnóstico médico pode obter dados de revistas médicas, garantindo que o modelo obtenha insights especializados e pertinentes.

- Mitigação de preconceito – A capacidade de recorrer a uma base de dados bem organizada oferece o potencial para minimizar preconceitos, garantindo fontes externas equilibradas e imparciais.

Antes de mergulhar na integração do Amazon Kendra com LLMs básicos, é crucial equipar-se com as ferramentas e os requisitos de sistema necessários. Ter a configuração correta é o primeiro passo para uma implantação perfeita das demonstrações.

Pré-requisitos

Você deve ter os seguintes pré-requisitos:

Embora seja possível configurar e implantar a infraestrutura detalhada neste tutorial no seu computador local, Nuvem AWS9 oferece uma alternativa conveniente. Pré-equipado com ferramentas como AWS CLI, AWS CDK e Docker, o AWS Cloud9 pode funcionar como sua estação de trabalho de implantação. Para utilizar este serviço, basta configurar o ambiente via Console AWS Cloud9.

Com os pré-requisitos resolvidos, vamos nos aprofundar nos recursos e capacidades do Amazon Kendra com LLMs básicos.

Amazon Kendra com LLM fundamental

O Amazon Kendra é um serviço avançado de pesquisa empresarial aprimorado por machine learning (ML) que fornece recursos de pesquisa semântica prontos para uso. Utilizando processamento de linguagem natural (PNL), o Amazon Kendra compreende tanto o conteúdo dos documentos quanto a intenção subjacente das consultas do usuário, posicionando-o como uma ferramenta de recuperação de conteúdo para soluções baseadas em RAG. Ao usar o conteúdo de pesquisa de alta precisão de Kendra como uma carga RAG, você pode obter melhores respostas de LLM. O uso do Amazon Kendra nesta solução também permite a pesquisa personalizada, filtrando as respostas de acordo com as permissões de acesso ao conteúdo do usuário final.

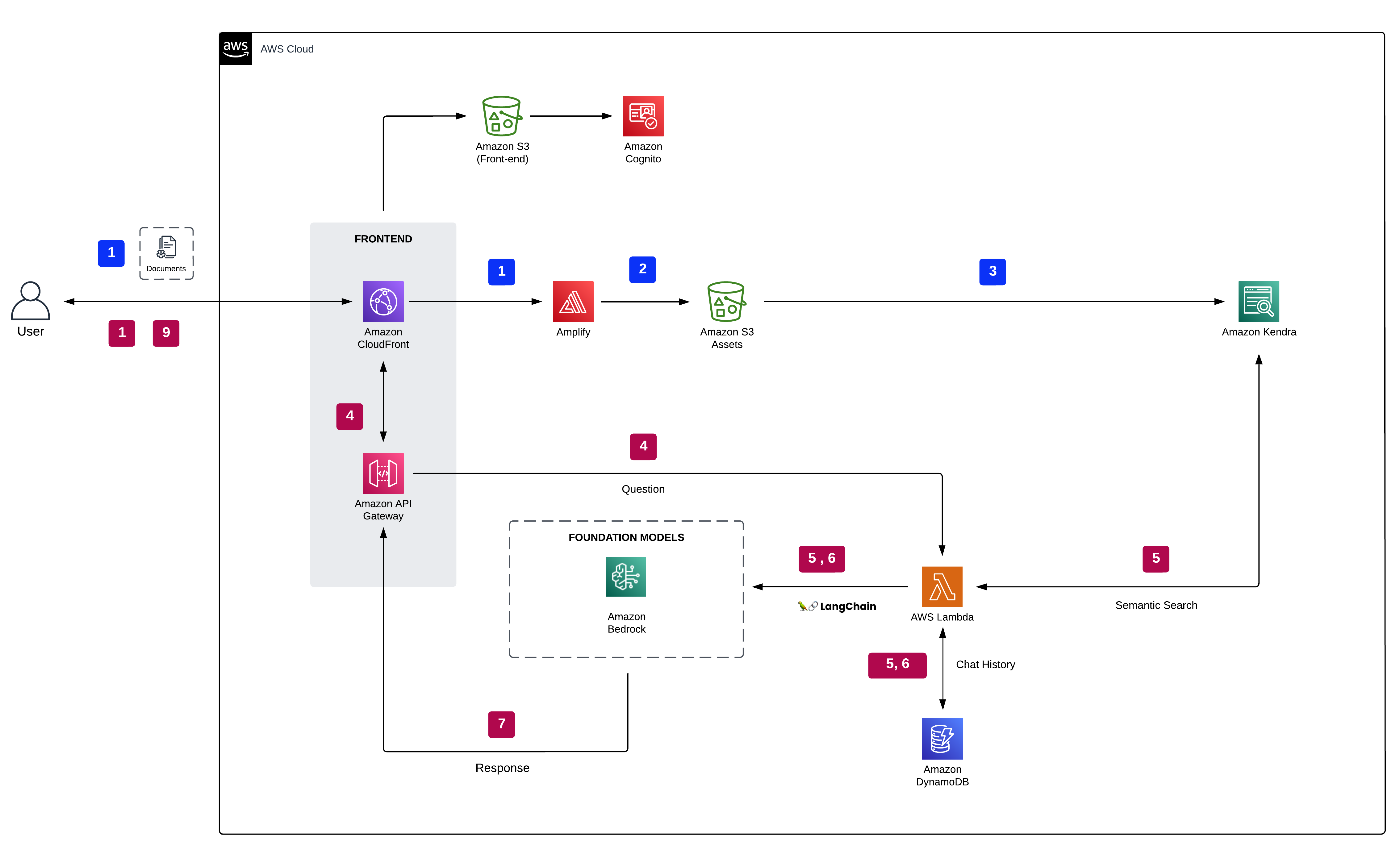

O diagrama a seguir mostra a arquitetura de um aplicativo generativo de IA usando a abordagem RAG.

Os documentos são processados e indexados pelo Amazon Kendra por meio do Serviço de armazenamento simples da Amazon (Amazon S3) conector. As solicitações dos clientes e os dados contextuais do Amazon Kendra são direcionados para um Rocha Amazônica modelo de fundação. A demonstração permite que você escolha entre os modelos Titan da Amazon, Jurassic do AI21 e Claude da Anthropic suportados pelo Amazon Bedrock. O histórico da conversa é salvo em Amazon DynamoDB, oferecendo contexto adicional para o LLM gerar respostas.

Fornecemos esta demonstração no GitHub repo. Consulte as instruções de implantação no arquivo leia-me para implantá-lo em sua conta da AWS.

As etapas a seguir descrevem o processo quando um usuário interage com o aplicativo generativo de IA:

- O usuário faz login no aplicativo da web autenticado por Amazon Cognito.

- O usuário carrega um ou mais documentos no Amazon S3.

- O usuário executa um trabalho de sincronização do Amazon Kendra para ingerir documentos do S3 no índice do Amazon Kendra.

- A pergunta do usuário é encaminhada através de uma API WebSocket segura hospedada em Gateway de API da Amazon apoiado por um AWS Lambda função.

- A função Lambda, habilitada pelo LangChain framework — uma ferramenta versátil projetada para criar aplicações orientadas por modelos de linguagem de IA — se conecta ao endpoint Amazon Bedrock para reformular a pergunta do usuário com base no histórico de chat. Após a reformulação, a pergunta é encaminhada ao Amazon Kendra usando a API Retrieve. Em resposta, o índice Amazon Kendra exibe resultados de pesquisa, fornecendo trechos de documentos pertinentes provenientes dos dados ingeridos pela empresa.

- A pergunta do usuário junto com os dados recuperados do índice são enviados como um contexto no prompt do LLM. A resposta do LLM é armazenada como histórico de chat no DynamoDB.

- Finalmente, a resposta do LLM é enviada de volta ao usuário.

Fluxo de trabalho de indexação de documentos

A seguir está o procedimento para processamento e indexação de documentos:

- Os usuários enviam documentos por meio da interface do usuário (IU).

- Os documentos são transferidos para um bucket S3 utilizando o Amplificar AWS API.

- O Amazon Kendra indexa novos documentos no bucket S3 por meio do conector Amazon Kendra S3.

Benefícios

A lista a seguir destaca as vantagens desta solução:

- Recuperação de nível empresarial – O Amazon Kendra foi projetado para pesquisa empresarial, tornando-o adequado para organizações com grandes quantidades de dados estruturados e não estruturados.

- Compreensão semântica – Os recursos de ML do Amazon Kendra garantem que a recuperação seja baseada em um profundo entendimento semântico e não apenas em correspondências de palavras-chave.

- AMPLIAR – O Amazon Kendra pode lidar com fontes de dados em grande escala e fornecer resultados de pesquisa rápidos e relevantes.

- Flexibilidade – O modelo fundamental pode gerar respostas com base em uma ampla gama de contextos, garantindo que o sistema permaneça versátil.

- Capacidades de integração – O Amazon Kendra pode ser integrado a vários serviços e fontes de dados da AWS, tornando-o adaptável a diferentes necessidades organizacionais.

Modelo de incorporações com LLM fundamental

An embutindo é um vetor numérico que representa a essência de diversos tipos de dados, incluindo texto, imagens, áudio e documentos. Esta representação não apenas captura o significado intrínseco dos dados, mas também os adapta para uma ampla gama de aplicações práticas. A incorporação de modelos, um ramo do ML, transforma dados complexos, como palavras ou frases, em espaços vetoriais contínuos. Esses vetores captam inerentemente as conexões semânticas entre os dados, permitindo comparações mais profundas e perspicazes.

O RAG combina perfeitamente os pontos fortes dos modelos fundamentais, como os transformadores, com a precisão dos embeddings para examinar vastos bancos de dados em busca de informações pertinentes. Ao receber uma consulta, o sistema utiliza incorporações para identificar e extrair seções relevantes de um extenso corpo de dados. O modelo fundamental formula então uma resposta contextualmente precisa com base nas informações extraídas. Esta sinergia perfeita entre a recuperação de dados e a geração de respostas permite que o sistema forneça respostas completas, aproveitando o vasto conhecimento armazenado em extensos bancos de dados.

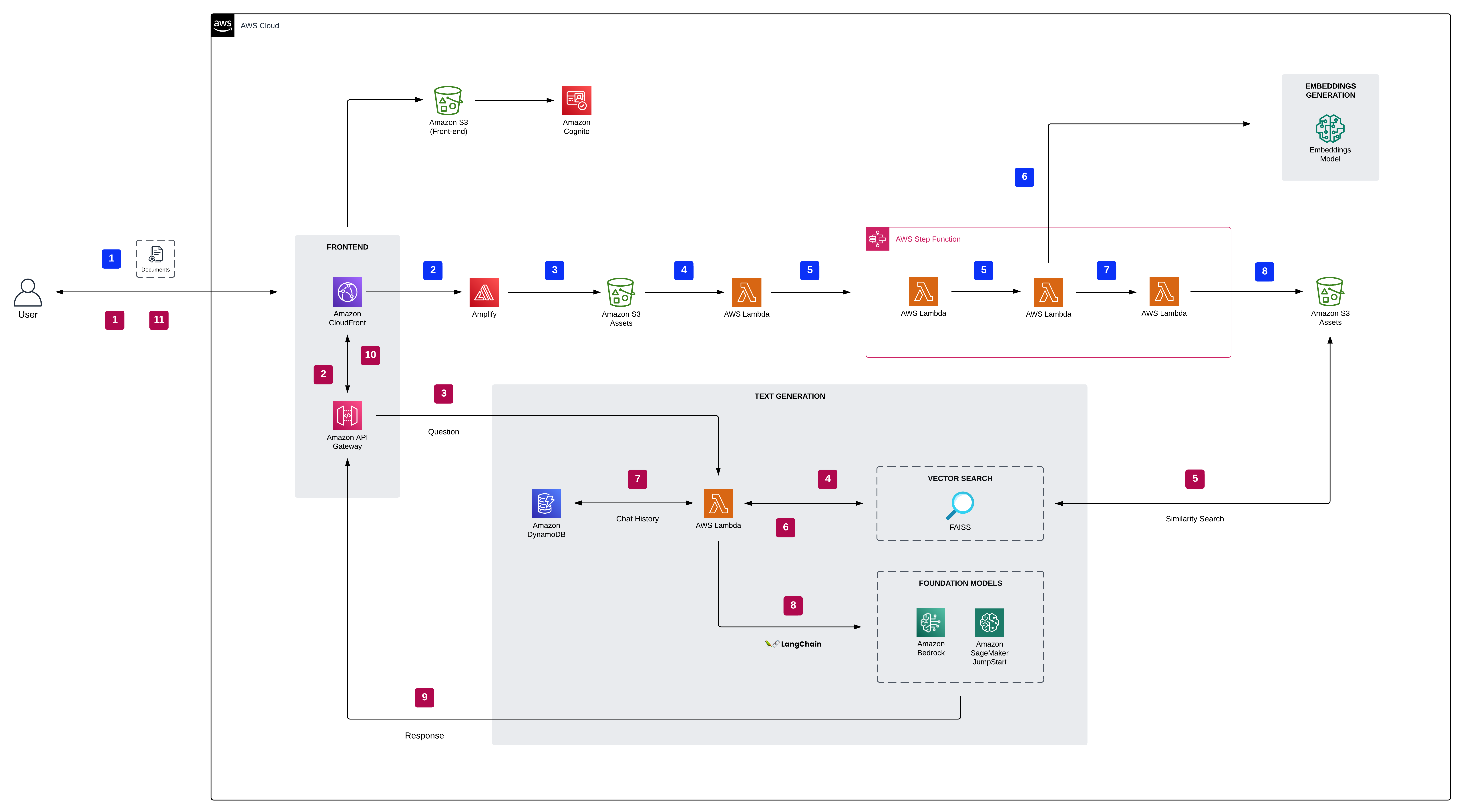

No layout arquitetônico, com base na seleção da UI, os usuários são guiados para o Amazon Bedrock ou JumpStart do Amazon SageMaker modelos de fundação. Os documentos passam por processamento e os embeddings vetoriais são produzidos pelo modelo de embeddings. Esses embeddings são então indexados usando FAISS para permitir uma pesquisa semântica eficiente. Os históricos de conversas são preservados no DynamoDB, enriquecendo o contexto para o LLM criar respostas.

O diagrama a seguir ilustra a arquitetura e o fluxo de trabalho da solução.

Fornecemos esta demonstração no GitHub repo. Consulte as instruções de implantação no arquivo leia-me para implantá-lo em sua conta da AWS.

Modelo de incorporações

As responsabilidades do modelo de incorporação são as seguintes:

- Este modelo é responsável por converter texto (como documentos ou passagens) em representações vetoriais densas, comumente conhecidas como embeddings.

- Essas incorporações capturam o significado semântico do texto, permitindo comparações eficientes e semanticamente significativas entre diferentes partes do texto.

- O modelo de incorporação pode ser treinado no mesmo vasto corpus do modelo fundamental ou pode ser especializado em domínios específicos.

Fluxo de trabalho de perguntas e respostas

As etapas a seguir descrevem o fluxo de trabalho da resposta a perguntas em documentos:

- O usuário faz login no aplicativo web autenticado pelo Amazon Cognito.

- O usuário carrega um ou mais documentos no Amazon S3.

- Após a transferência do documento, uma notificação de evento do S3 aciona uma função Lambda, que então chama o endpoint do modelo de incorporação do SageMaker para gerar embeddings para o novo documento. O modelo de incorporação converte a questão em uma representação vetorial densa (incorporação). O arquivo vetorial resultante é armazenado com segurança no bucket S3.

- O recuperador FAISS compara a incorporação desta questão com a incorporação de todos os documentos ou passagens no banco de dados para encontrar as passagens mais relevantes.

- As passagens, juntamente com a pergunta do usuário, são fornecidas como contexto para o modelo fundamental. A função Lambda usa a biblioteca LangChain e se conecta ao endpoint Amazon Bedrock ou SageMaker JumpStart com uma consulta preenchida com contexto.

- A resposta do LLM é armazenada no DynamoDB junto com a consulta do usuário, o carimbo de data/hora, um identificador exclusivo e outros identificadores arbitrários para o item, como a categoria da pergunta. Armazenar a pergunta e a resposta como itens discretos permite que a função Lambda recrie facilmente o histórico de conversas do usuário com base no horário em que as perguntas foram feitas.

- Por fim, a resposta é enviada de volta ao usuário por meio de uma solicitação HTTPs por meio da resposta de integração da API API Gateway WebSocket.

Benefícios

A lista a seguir descreve os benefícios desta solução:

- Compreensão semântica – O modelo de embeddings garante que o recuperador selecione passagens com base em um profundo entendimento semântico, e não apenas em correspondências de palavras-chave.

- AMPLIAR – Os embeddings permitem comparações de similaridade eficientes, tornando viável a pesquisa rápida em vastos bancos de dados de documentos.

- Flexibilidade – O modelo fundamental pode gerar respostas com base em uma ampla gama de contextos, garantindo que o sistema permaneça versátil.

- Adaptabilidade de domínio – O modelo de embeddings pode ser treinado ou ajustado para domínios específicos, permitindo que o sistema seja adaptado para diversas aplicações.

Gerador de anúncios farmacêuticos de modelos básicos

Na atual indústria farmacêutica em ritmo acelerado, a publicidade eficiente e localizada é mais crucial do que nunca. É aqui que entra em ação uma solução inovadora, usando o poder da IA generativa para criar anúncios farmacêuticos localizados a partir de imagens de origem e PDFs. Além de simplesmente acelerar o processo de geração de anúncios, esta abordagem agiliza o processo de Revisão Legal Médica (MLR). O MLR é um mecanismo de revisão rigoroso no qual equipes médicas, jurídicas e regulatórias avaliam meticulosamente os materiais promocionais para garantir sua precisão, respaldo científico e conformidade regulatória. Os métodos tradicionais de criação de conteúdo podem ser complicados, muitas vezes exigindo ajustes manuais e revisões extensas para garantir o alinhamento com a conformidade e relevância regional. No entanto, com o advento da IA generativa, podemos agora automatizar a elaboração de anúncios que realmente ressoem com o público local, ao mesmo tempo que respeitamos padrões e diretrizes rigorosos.

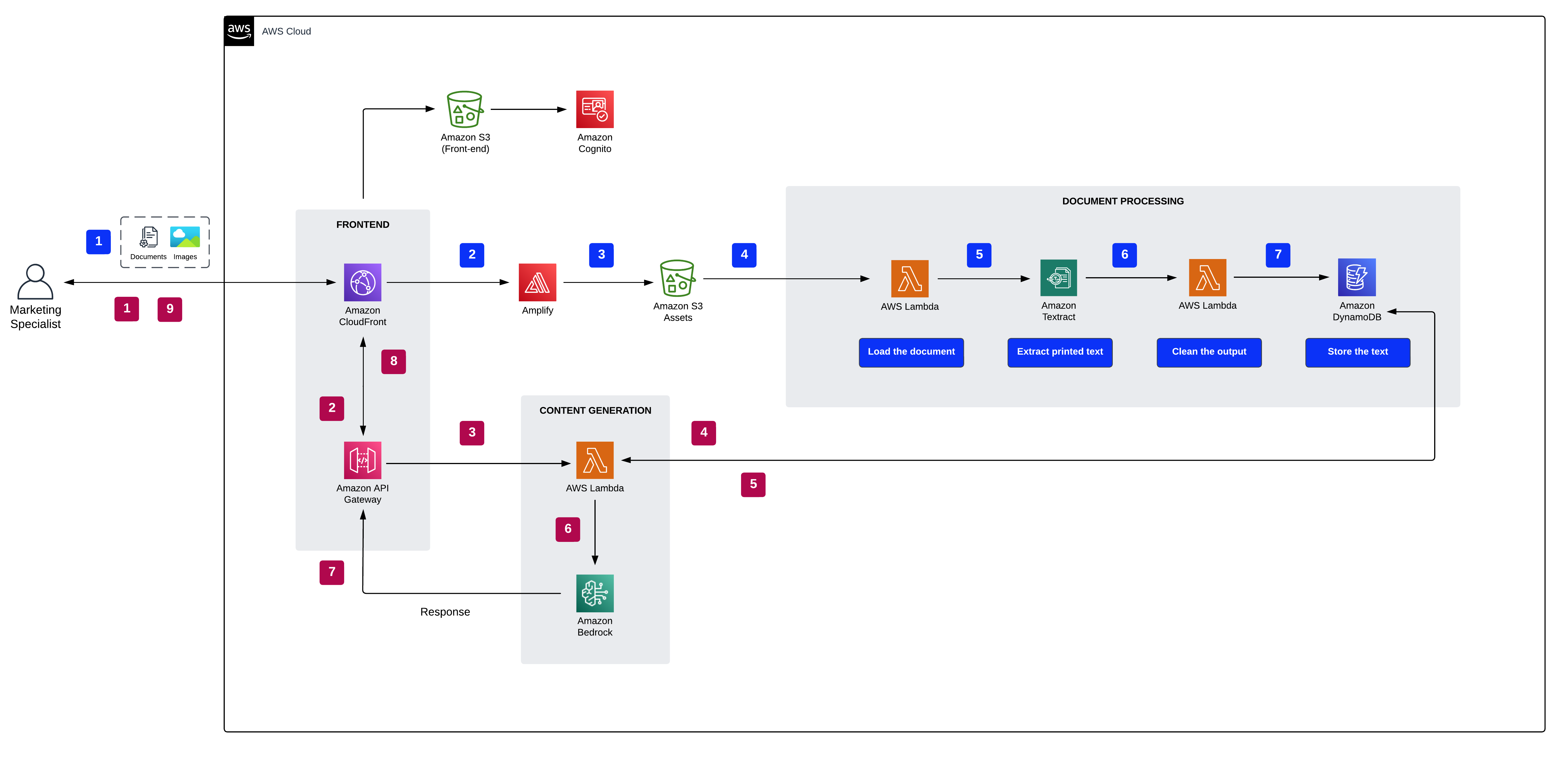

O diagrama a seguir ilustra a arquitetura da solução.

No layout arquitetônico, com base no modelo selecionado e nas preferências de anúncio, os usuários são perfeitamente orientados para os modelos básicos do Amazon Bedrock. Essa abordagem simplificada garante que novos anúncios sejam gerados precisamente de acordo com a configuração desejada. Como parte do processo, os documentos são tratados de forma eficiente por amazontext, com o texto resultante armazenado com segurança no DynamoDB. Um recurso de destaque é o design modular para geração de imagens e texto, garantindo flexibilidade para regenerar independentemente qualquer componente, conforme necessário.

Fornecemos esta demonstração no GitHub repo. Consulte as instruções de implantação no arquivo leia-me para implantá-lo em sua conta da AWS.

Fluxo de trabalho de geração de conteúdo

As etapas a seguir descrevem o processo de geração de conteúdo:

- O usuário escolhe o documento, a imagem de origem, o posicionamento do anúncio, o idioma e o estilo da imagem.

- O acesso seguro à aplicação web é garantido por meio da autenticação do Amazon Cognito.

- O front-end do aplicativo web é hospedado via Amplify.

- Uma API WebSocket, gerenciada pelo API Gateway, facilita as solicitações do usuário. Essas solicitações são autenticadas por meio de Gerenciamento de acesso e identidade da AWS (EU SOU).

- A integração com o Amazon Bedrock inclui as seguintes etapas:

- Uma função Lambda emprega a biblioteca LangChain para se conectar ao endpoint Amazon Bedrock usando uma consulta rica em contexto.

- O modelo básico de texto para texto cria um anúncio contextualmente apropriado com base no contexto e nas configurações fornecidas.

- O modelo fundamental de texto para imagem cria uma imagem personalizada, influenciada pela imagem de origem, estilo escolhido e localização.

- O usuário recebe a resposta por meio de uma solicitação HTTPS por meio da API API Gateway WebSocket integrada.

Fluxo de trabalho de processamento de documentos e imagens

A seguir está o procedimento para processamento de documentos e imagens:

- O usuário carrega ativos por meio da IU especificada.

- A API Amplify transfere os documentos para um bucket S3.

- Depois que o ativo for transferido para o Amazon S3, ocorrerá uma das seguintes ações:

- Se for um documento, uma função Lambda usa o Amazon Textract para processar e extrair texto para geração de anúncios.

- Se for uma imagem, a função Lambda a converte para o formato base64, adequado para o modelo Stable Diffusion criar uma nova imagem a partir da fonte.

- O texto extraído ou a string de imagem base64 são salvos com segurança no DynamoDB.

Benefícios

A lista a seguir descreve os benefícios desta solução:

- Eficiência – O uso de IA generativa acelera significativamente o processo de geração de anúncios, eliminando a necessidade de ajustes manuais.

- Adesão à conformidade – A solução garante que os anúncios gerados cumpram orientações e regulamentações específicas, como as diretrizes de marketing da FDA.

- Custo-beneficio – Ao automatizar a criação de anúncios personalizados, as empresas podem reduzir significativamente os custos associados à produção e revisões de anúncios.

- Processo de MLR simplificado – A solução simplifica o processo de MLR, reduzindo pontos de atrito e garantindo revisões mais tranquilas.

- Ressonância localizada – A IA generativa produz anúncios que repercutem no público local, garantindo relevância e impacto em diferentes regiões.

- estandardização – A solução mantém os padrões e diretrizes necessários, garantindo consistência em todos os anúncios gerados.

- AMPLIAR – A abordagem baseada em IA pode lidar com vastos bancos de dados de imagens de origem e PDFs, tornando viável a geração de anúncios em grande escala.

- Intervenção manual reduzida – A automação reduz a necessidade de intervenção humana, minimizando erros e garantindo consistência.

Você pode implantar a infraestrutura neste tutorial a partir de seu computador local ou usar o AWS Cloud9 como estação de trabalho de implantação. O AWS Cloud9 vem pré-carregado com AWS CLI, AWS CDK e Docker. Se você optar pelo AWS Cloud9, criar o ambiente do Console AWS Cloud9.

limpar

Para evitar custos desnecessários, limpe toda a infraestrutura criada por meio do console do AWS CloudFormation ou executando o seguinte comando em sua estação de trabalho:

Além disso, lembre-se de interromper todos os endpoints do SageMaker iniciados por meio do console do SageMaker. Lembre-se de que excluir um índice do Amazon Kendra não remove os documentos originais do armazenamento.

Conclusão

A IA generativa, sintetizada pelos LLMs, anuncia uma mudança de paradigma na forma como acessamos e geramos informações. Esses modelos, embora poderosos, são frequentemente limitados pelos limites de seus dados de treinamento. O RAG aborda esse desafio, garantindo que o vasto conhecimento contido nesses modelos seja consistentemente infundido com insights relevantes e atuais.

Nossas demonstrações baseadas em RAG fornecem uma prova tangível disso. Eles mostram a sinergia perfeita entre Amazon Kendra, incorporações de vetores e LLMs, criando um sistema onde as informações não são apenas vastas, mas também precisas e oportunas. Ao mergulhar nessas demonstrações, você explorará em primeira mão o potencial transformacional da fusão do conhecimento pré-treinado com os recursos dinâmicos do RAG, resultando em resultados confiáveis e adaptados ao conteúdo empresarial.

Embora a IA generativa alimentada por LLMs abra uma nova forma de obter insights de informações, esses insights devem ser confiáveis e confinados ao conteúdo empresarial usando a abordagem RAG. Essas demonstrações baseadas em RAG permitem que você tenha insights precisos e atualizados. A qualidade desses insights depende da relevância semântica, que é possibilitada pelo uso do Amazon Kendra e da incorporação de vetores.

Se você estiver pronto para explorar e aproveitar ainda mais o poder da IA generativa, aqui estão as próximas etapas:

- Envolva-se com nossas demonstrações – A experiência prática é inestimável. Explore as funcionalidades, entenda as integrações e familiarize-se com a interface.

- Aprofunde seu conhecimento – Aproveite os recursos disponíveis. A AWS oferece documentação detalhada, tutoriais e suporte da comunidade para ajudar em sua jornada de IA.

- Iniciar um projeto piloto – Considere começar com uma implementação em pequena escala de IA generativa em sua empresa. Isto fornecerá insights sobre a praticidade e adaptabilidade do sistema dentro do seu contexto específico.

Para obter mais informações sobre aplicativos generativos de IA na AWS, consulte o seguinte:

Lembre-se de que o cenário da IA está em constante evolução. Mantenha-se atualizado, continue curioso e esteja sempre pronto para se adaptar e inovar.

Sobre os Autores

Jin Tan Ruan é desenvolvedor de prototipagem na equipe de prototipagem e engenharia de clientes da AWS Industries (PACE), especializado em PNL e IA generativa. Com experiência em desenvolvimento de software e nove certificações AWS, Jin traz uma vasta experiência para ajudar os clientes da AWS a materializar suas visões de IA/ML e IA generativa usando a plataforma AWS. Ele possui mestrado em Ciência da Computação e Engenharia de Software pela Universidade de Syracuse. Fora do trabalho, Jin gosta de jogar videogame e mergulhar no emocionante mundo dos filmes de terror.

Jin Tan Ruan é desenvolvedor de prototipagem na equipe de prototipagem e engenharia de clientes da AWS Industries (PACE), especializado em PNL e IA generativa. Com experiência em desenvolvimento de software e nove certificações AWS, Jin traz uma vasta experiência para ajudar os clientes da AWS a materializar suas visões de IA/ML e IA generativa usando a plataforma AWS. Ele possui mestrado em Ciência da Computação e Engenharia de Software pela Universidade de Syracuse. Fora do trabalho, Jin gosta de jogar videogame e mergulhar no emocionante mundo dos filmes de terror.

Aravind Kodandaramaiah é um criador sênior de soluções full stack de prototipagem na equipe de prototipagem e engenharia de clientes da AWS Industries (PACE). Ele se concentra em ajudar os clientes da AWS a transformar ideias inovadoras em soluções com resultados mensuráveis e agradáveis. Ele é apaixonado por uma variedade de tópicos, incluindo segurança em nuvem, DevOps e IA/ML, e geralmente pode ser encontrado mexendo nessas tecnologias.

Aravind Kodandaramaiah é um criador sênior de soluções full stack de prototipagem na equipe de prototipagem e engenharia de clientes da AWS Industries (PACE). Ele se concentra em ajudar os clientes da AWS a transformar ideias inovadoras em soluções com resultados mensuráveis e agradáveis. Ele é apaixonado por uma variedade de tópicos, incluindo segurança em nuvem, DevOps e IA/ML, e geralmente pode ser encontrado mexendo nessas tecnologias.

Arjun Shakdher é desenvolvedor da equipe AWS Industries Prototyping (PACE) e é apaixonado por combinar tecnologia com a estrutura da vida. Com mestrado pela Purdue University, a função atual de Arjun gira em torno da arquitetura e construção de protótipos de ponta que abrangem uma variedade de domínios, atualmente apresentando com destaque os domínios de IA/ML e IoT. Quando não estiver imerso em códigos e paisagens digitais, você encontrará Arjun se entregando ao mundo do café, explorando a intrincada mecânica da relojoaria ou deleitando-se com a arte dos automóveis.

Arjun Shakdher é desenvolvedor da equipe AWS Industries Prototyping (PACE) e é apaixonado por combinar tecnologia com a estrutura da vida. Com mestrado pela Purdue University, a função atual de Arjun gira em torno da arquitetura e construção de protótipos de ponta que abrangem uma variedade de domínios, atualmente apresentando com destaque os domínios de IA/ML e IoT. Quando não estiver imerso em códigos e paisagens digitais, você encontrará Arjun se entregando ao mundo do café, explorando a intrincada mecânica da relojoaria ou deleitando-se com a arte dos automóveis.

- Conteúdo com tecnologia de SEO e distribuição de relações públicas. Seja amplificado hoje.

- PlatoData.Network Gerativa Vertical Ai. Capacite-se. Acesse aqui.

- PlatoAiStream. Inteligência Web3. Conhecimento Amplificado. Acesse aqui.

- PlatãoESG. Carbono Tecnologia Limpa, Energia, Ambiente, Solar, Gestão de resíduos. Acesse aqui.

- PlatoHealth. Inteligência em Biotecnologia e Ensaios Clínicos. Acesse aqui.

- Fonte: https://aws.amazon.com/blogs/machine-learning/harnessing-the-power-of-enterprise-data-with-generative-ai-insights-from-amazon-kendra-langchain-and-large-language-models/

- :é

- :não

- :onde

- $UP

- 100

- 150

- 7

- a

- habilidade

- Sobre

- acelera

- Acesso

- Segundo

- Conta

- precisão

- preciso

- em

- ações

- Ad

- adaptar

- adapta

- adicionado

- endereços

- aderir

- ajustes

- Adotando

- anúncios

- avançado

- Vantagem

- vantagens

- advento

- Publicidade

- Depois de

- AI

- AI / ML

- Ajuda

- alinhamento

- Todos os Produtos

- permitir

- Permitindo

- permite

- quase

- juntamente

- tb

- alternativa

- sempre

- Amazon

- Amazon Cognito

- Amazona Kendra

- amazontext

- Amazon Web Services

- quantidades

- amplificar

- an

- e

- responder

- respostas

- qualquer

- api

- app

- Aplicação

- aplicações

- abordagem

- apropriado

- arquitetônico

- arquitetura

- SOMOS

- por aí

- Ordem

- arte

- AS

- ativo

- Ativos

- auxiliar

- associado

- público

- auditivo

- autenticado

- Autenticação

- automatizar

- automatizando

- Automação

- disponível

- evitar

- evitando

- AWS

- Nuvem AWS9

- Formação da Nuvem AWS

- em caminho duplo

- Apoiado

- fundo

- apoio

- base

- baseado

- BE

- Porque

- tornam-se

- torna-se

- Benefícios

- Melhor

- entre

- Pós

- vieses

- blending

- corpo

- Bot

- ambos

- Ramo

- Traz

- amplo

- construtor

- Prédio

- mas a

- by

- chamadas

- CAN

- Pode obter

- capacidades

- capturar

- capturas

- casas

- Categoria

- certificações

- desafiar

- desafios

- Escolha

- escolhido

- limpar

- Na nuvem

- Cloud Security

- Cloud9

- código

- Café

- combinado

- combina

- vem

- geralmente

- comunidade

- Empresas

- comparações

- integrações

- compliance

- compatível

- componente

- compreende

- computador

- Ciência da Computação

- Configuração

- Contato

- Coneções

- conecta

- Considerar

- consistentemente

- cônsul

- constantemente

- conteúdo

- Geração de Conteúdo

- Criação de conteúdo

- contexto

- Contextos

- contextual

- continuou

- contínuo

- Conveniente

- convencional

- Conversa

- conversão

- núcleo

- Custo

- custos

- artesanato

- crio

- criado

- cria

- Criar

- criação

- crucial

- pesado

- curioso

- Atual

- personalizadas

- cliente

- Clientes

- ponta

- dados,

- banco de dados

- bases de dados

- conjuntos de dados

- Data

- profundo

- mais profunda

- Grau

- delicioso

- demonstração

- Demos

- dependente

- implantar

- implantado

- Implantação

- desenvolvimento

- descreve

- Design

- projetado

- desejado

- destruir

- detalhado

- detalhes

- Developer

- Desenvolvimento

- diagnóstico

- diferente

- Distribuição

- digital

- dirigido

- monitores

- distinto

- mergulho

- diferente

- mergulho

- Estivador

- documento

- documentação

- INSTITUCIONAIS

- Não faz

- domínios

- desenhar

- desenho

- dirigido

- dinâmico

- facilmente

- eficiência

- eficiente

- eficientemente

- ou

- eliminando

- embutindo

- emergem

- emprega

- habilitada

- empodera

- permitir

- habilitado

- permite

- permitindo

- final

- Ponto final

- Engenharia

- aprimorada

- enriquecedor

- garantir

- assegurada

- garante

- assegurando

- Empreendimento

- Todo

- equipado

- erros

- especialmente

- essência

- avaliar

- Evento

- SEMPRE

- evolui

- evolução

- exemplo

- animado

- expansivo

- vasta experiência

- especialista

- especialistas

- explorar

- Explorando

- extenso

- externo

- extrato

- tecidos

- facilita

- familiarizar

- ritmo acelerado

- FB

- factível

- Característica

- Funcionalidades

- Apresentando

- Envie o

- filtragem

- Encontre

- Primeiro nome

- Flexibilidade

- concentra-se

- seguinte

- segue

- Escolha

- formato

- encontrado

- Foundation

- atrito

- da

- frente

- Front-end

- cheio

- Full stack

- função

- funcionalidades

- mais distante

- Além disso

- Ganho

- ganhando

- Games

- porta de entrada

- gerar

- gerado

- geração

- generativo

- IA generativa

- gerador

- ter

- dado

- Dando

- concessão

- aperto

- Cresce

- garanta

- orientações

- dirigido

- orientações

- manipular

- mãos em

- arreios

- Aproveitamento

- Ter

- ter

- he

- ajuda

- arautos

- SUA PARTICIPAÇÃO FAZ A DIFERENÇA

- destaques

- ele mesmo

- histórias

- história

- segurando

- detém

- horror

- hospedado

- Como funciona o dobrador de carta de canal

- Contudo

- HTML

- http

- HTTPS

- humano

- idéias

- identificador

- Identificadores

- identificar

- Identidade

- if

- ilustra

- imagem

- imagens

- imerso

- Impacto

- implementação

- in

- em profundidade

- impreciso

- inclui

- Incluindo

- incorporar

- independentemente

- índice

- indexado

- índices

- indústrias

- indústria

- padrões da indústria

- influenciado

- INFORMAÇÕES

- informado

- Infraestrutura

- inerentemente

- do estado inicial,

- iniciado

- inovar

- inovadores

- perspicaz

- insights

- em vez disso

- instruções

- integrado

- Integra-se

- integração

- integrações

- intenção

- interage

- Interface

- da intervenção

- para dentro

- intrínseco

- inestimável

- iot

- IT

- Unid

- ESTÁ

- Trabalho

- viagem

- jpg

- apenas por

- Conhecimento

- conhecido

- paisagem

- língua

- grande

- em grande escala

- traçado

- aprendizagem

- Legal

- Permite

- Biblioteca

- Licenciado

- vida

- como

- probabilidade

- Limitado

- limites

- Lista

- LLM

- local

- localização

- máquina

- aprendizado de máquina

- mantém

- Fazendo

- gerenciados

- manual

- muitos

- Marketing

- maciço

- mestre

- fósforos

- materiais

- significado

- significativo

- significados

- significa

- mecânica

- mecanismo

- médico

- Memória

- apenas

- mescla

- fusão

- métodos

- meticulosamente

- minimizando

- mitigação

- ML

- modelo

- modelagem

- modelos

- modulares

- mais

- a maioria

- Filmes

- devo

- natural

- Processamento de linguagem natural

- necessário

- você merece...

- necessário

- necessitando

- Cria

- Novo

- Próximo

- nove

- PNL

- notificação

- agora

- of

- oferecendo treinamento para distância

- Oferece

- frequentemente

- on

- ONE

- só

- abre

- or

- organizacional

- organizações

- original

- Outros

- A Nossa

- Fora

- resultados

- esboço

- outputs

- lado de fora

- Acima de

- Superar

- Paz

- paradigma

- parâmetros

- parte

- apaixonado

- perfeita

- permissões

- Personalizado

- farmacêutico

- Farmacêutica

- Frases

- peças

- piloto

- projeto piloto

- Lugar

- localização

- plataforma

- platão

- Inteligência de Dados Platão

- PlatãoData

- Jogar

- jogar

- pontos

- posicionamento

- possível

- Publique

- potencial

- poder

- alimentado

- poderoso

- Prática

- preciso

- justamente

- Precisão

- preferências

- pré-requisitos

- atualmente

- procedimentos

- processo

- Processado

- em processamento

- Produzido

- produz

- Produção

- projeto

- promocional

- protótipos

- prototipagem

- Prove

- fornecer

- fornecido

- fornece

- fornecendo

- qualidade

- consultas

- questão

- Frequentes

- Links

- rapidamente

- alcance

- pronto

- reinos

- recebe

- receber

- Recomendação

- reduzir

- reduz

- redução

- referir

- refinado

- regional

- regiões

- regular

- regulamentos

- reguladores

- Conformidade Regulamentar

- relevância

- relevante

- contando

- permanecem

- permanece

- lembrar

- remover

- reformular

- representação

- representa

- solicitar

- pedidos

- requerer

- requeridos

- Requisitos

- Ressoar

- Recursos

- resposta

- respostas

- responsabilidades

- responsável

- resultante

- resultando

- Resultados

- rever

- Opinões

- revisões

- gira

- certo

- rigoroso

- Tipo

- corrida

- é executado

- sábio

- mesmo

- salvo

- Ciência

- científico

- desatado

- sem problemas

- Pesquisar

- seções

- seguro

- firmemente

- segurança

- selecionado

- doadores,

- senior

- enviei

- serviço

- Serviços

- conjunto

- Configurações

- instalação

- mudança

- mostrar

- Shows

- Peneirar

- periodo

- de forma considerável

- simples

- simplesmente

- menor

- mais suave

- Software

- desenvolvimento de software

- Engenharia de software

- unicamente

- solução

- Soluções

- fonte

- de origem

- Fontes

- Origem

- espaços

- palmo

- especializado

- especializando

- específico

- especificada

- estável

- pilha

- padrões

- Comece

- estado-da-arte

- ficar

- Passo

- Passos

- Dê um basta

- armazenamento

- loja

- armazenadas

- armazenar

- simplificada

- pontos fortes

- Tanga

- rigoroso

- estruturada

- estilo

- enviar

- tal

- adequado

- ajuda

- Suportado

- sinergia

- .

- adaptados

- Tire

- toma

- tangível

- Tarefa

- tarefas

- Profissionais

- equipes

- técnica

- Tecnologias

- Tecnologia

- vontade

- texto

- do que

- que

- A

- A paisagem

- A fonte

- o mundo

- deles

- Eles

- então

- assim

- Este

- deles

- isto

- três

- emocionante

- Através da

- tempo

- oportuno

- timestamp

- titã

- para

- hoje

- ferramenta

- ferramentas

- tópico

- Temas

- para

- tradicional

- Trem

- treinado

- Training

- transferência

- transferido

- fáceis

- Transformar

- transformacional

- transformadores

- Tendências

- verdadeiramente

- digno de confiança

- VIRAR

- tutorial

- tutoriais

- tipos

- ui

- sofrer

- subjacente

- compreender

- compreensão

- único

- universidade

- ao contrário

- desnecessário

- Desvendar

- que vai mais à frente

- Atualizar

- Atualizada

- Atualizações

- sustentação

- sobre

- usar

- caso de uso

- Utilizador

- Interface de Usuário

- usuários

- usos

- utilização

- geralmente

- utiliza

- Utilizando

- vário

- Grande

- versátil

- via

- Vídeo

- jogos de vídeo

- visões

- Caminho..

- we

- Riqueza

- web

- Aplicativo da Web

- serviços web

- soquete da web

- foram

- quando

- qual

- enquanto

- QUEM

- Largo

- Ampla variedade

- precisarão

- de

- dentro

- sem

- palavras

- Atividades:

- de gestão de documentos

- estação de trabalho

- mundo

- Vocês

- investimentos

- você mesmo

- zefirnet